L’integrazione dell’Intelligenza Artificiale (IA) all’interno delle architetture cloud aziendali rappresenta un punto di svolta strutturale per i modelli operativi IT.

Nel corso degli ultimi anni, il mercato ha assistito a una transizione del cloud computing che, da strumento di abilitazione tecnologica, si è trasformato in elemento di interruzione e ridefinizione dei modelli di business.

Tale fase di transizione ha introdotto un livello di complessità senza precedenti per i team che si occupano di Infrastructure and Operations (I&O) e Cloud Center of Excellence (CCOE).

La rapida scalabilità richiesta dai carichi di lavoro basati sul machine learning sta mettendo a dura prova le metodologie tradizionali di gestione, richiedendo un riallineamento delle pratiche di automazione, di governance finanziaria e di sicurezza.

Nel contesto appena descritto, proviamo ad analizzare le dinamiche dell’ecosistema tecnologico e operativo, delineando un framework aggiornato per le funzioni I&O e CCOE ed esplorando l’evoluzione dei modelli di costo, le sfide infrastrutturali e le soluzioni di orchestrazione necessarie per supportare l’adozione dell’IA su larga scala, mantenendo un focus rigoroso sull’efficienza economica e sulla mitigazione dei rischi.

Indice degli argomenti

Dinamiche di mercato e la ricalibrazione del Cloud Computing

Il panorama del cloud computing si trova attualmente in una fase di profonda ricalibrazione. Se da una parte gli investimenti globali in tecnologia aziendale sono previsti in crescita costante, con proiezioni che indicano un raggiungimento dei 4,9 trilioni di dollari nel 2025 guidato da cloud, IA e cybersicurezza, dall’altra emergono segnali tangibili di attrito operativo.

Le analisi di mercato indicano che, entro il 2028, il 25% delle organizzazioni sperimenterà un’insoddisfazione significativa in merito alla propria adozione del cloud. Le cause di questa disillusione sono molteplici e includono aspettative iniziali irrealistiche, processi di implementazione non ottimali e, soprattutto, un incremento incontrollato dei costi operativi.

Il report “State of the Cloud 2025” stima che circa il 27% della spesa cloud venga dissipato a causa di risorse inattive, configurate in modo errato o sovradimensionate soprattutto negli ambienti governativi o in settori altamente regolamentati, dove gli stanziamenti di bilancio sono fissi e l’inefficienza fiscale comporta severe implicazioni per la continuità operativa e la fiducia pubblica.

Si registra anche un incremento verticale nella domanda di risorse computazionali per l’intelligenza artificiale e il machine learning. I principali fornitori di cloud pubblico (hyperscaler) stanno guidando questa crescita incorporando capacità fondamentali direttamente nei livelli base delle loro infrastrutture IT. Le organizzazioni sono passate rapidamente da una fase sperimentale a un’integrazione strutturale. Dati aggiornati confermano che l’82% degli utenti in ambito aziendale utilizza l’IA generativa su base settimanale, con un 46% che ne fa un uso quotidiano, segnando un aumento di 17 punti percentuali rispetto agli anni precedenti.

In tale contesto, i leader dei dipartimenti I&O si trovano a dover navigare tra la spinta all’innovazione e la necessità di consolidamento.

adottando l’IA con lo scopo primario di ottimizzare i costi interni. Gli analisti di settore raccomandano un approccio altamente intenzionale: si suggerisce di evitare vasti e indefiniti progetti di intelligenza artificiale per concentrarsi invece su progetti pilota mirati, caratterizzati da alta fattibilità e valore dimostrabile.

Un caso d’uso primario identificato è l’applicazione dell’IA generativa per la gestione finanziaria del cloud, che consente di analizzare in modo automatizzato la fatturazione, l’utilizzo delle risorse e i parametri di efficienza dell’infrastruttura. Altri settori di investimento prioritari per i leader I&O includono le operazioni di cybersicurezza (49% del campione) e lo sviluppo delle competenze interne (48%).

Tendenze infrastrutturali determinanti per il 2026

L’adattamento dell’infrastruttura fisica e virtuale per supportare carichi di lavoro ad altissima densità richiede un aggiornamento delle strategie tecnologiche.

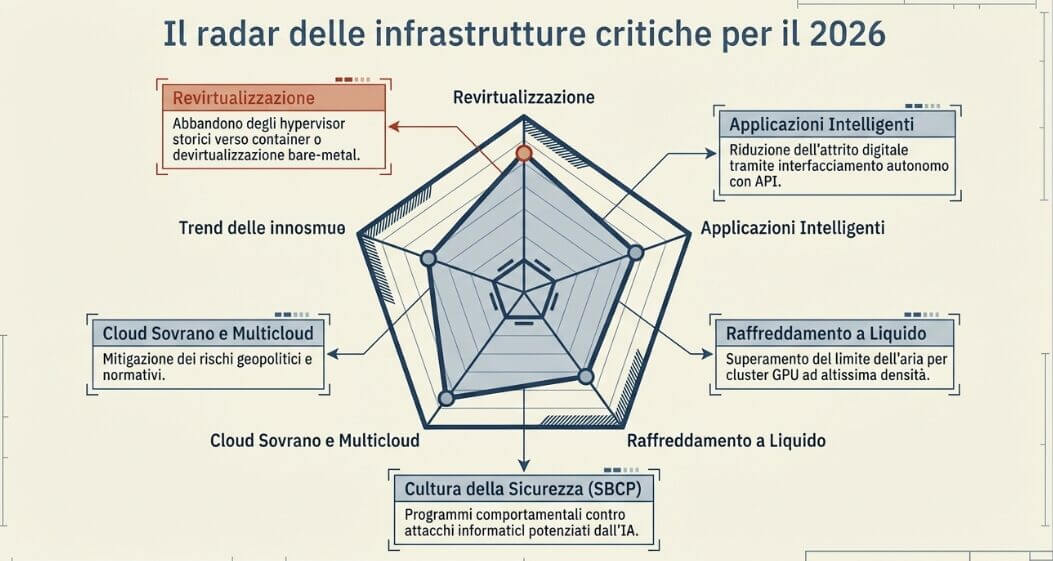

Sono state identificate diverse tendenze critiche che impatteranno le operazioni infrastrutturali nel 2026.

| Tendenza Infrastrutturale | Contesto e Implicazioni Operative per I&O |

| Revirtualizzazione e Devirtualizzazione | Le recenti e sostanziali modifiche ai modelli di licenza da parte dei principali fornitori di soluzioni di virtualizzazione (es. hypervisor storici) hanno imposto ai team I&O una rivalutazione dei propri stack tecnologici. Le organizzazioni stanno esplorando alternative che includono la migrazione accelerata verso il cloud pubblico, l’adozione di cloud distribuiti, la containerizzazione spinta o il ritorno al “bare metal” (devirtualizzazione). Questo richiede un inventario completo delle dipendenze e un’evoluzione delle competenze interne. |

| Applicazioni Intelligenti | Facilitate dai modelli fondazionali di IA, le applicazioni aziendali stanno acquisendo la capacità di operare in modo autonomo, adattandosi al contesto e all’intento dell’utente. Queste applicazioni riducono l’attrito digitale interfacciandosi autonomamente con API esterne e database connessi. Per i dipartimenti I&O, ciò si traduce in un’ottimizzazione dell’utilizzo delle risorse e in una riduzione della necessità di interventi manuali di manutenzione. |

| Infrastrutture a Raffreddamento a Liquido | La densità computazionale richiesta dall’IA e dalle nuove generazioni di GPU sta rendendo obsoleti i tradizionali sistemi di raffreddamento ad aria nei data center. Le soluzioni a liquido, che includono scambiatori di calore a porta posteriore, raffreddamento a immersione e sistemi diretti al chip, offrono flessibilità nel posizionamento dell’infrastruttura, supportando in modo efficiente i casi d’uso edge ad alte prestazioni. |

| Programmi di Comportamento e Cultura della Sicurezza (SBCP) | In risposta all’incremento e alla sofisticazione degli attacchi informatici, spesso facilitati dalla stessa intelligenza artificiale, le difese puramente perimetrali risultano insufficienti. I programmi SBCP rappresentano un approccio olistico a livello aziendale volto a minimizzare gli incidenti di cybersicurezza modificando il comportamento dei dipendenti, migliorando l’adozione di pratiche sicure nella gestione quotidiana dei dati e dei modelli di IA. |

| Adozione del Cloud Sovrano e Multicloud | Le aziende orientano le proprie strategie verso il multicloud e il cloud sovrano per mitigare i rischi geopolitici e garantire la conformità normativa. L’infrastruttura deve essere capace di operare in confini giurisdizionali specifici senza perdere l’efficienza offerta dai provider globali. |

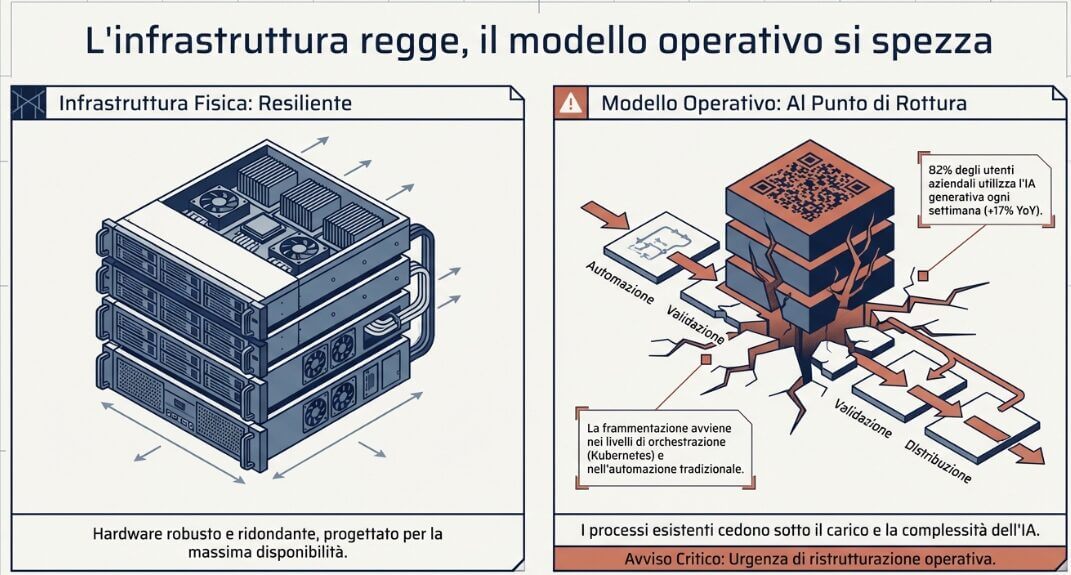

L’elemento di maggiore criticità che emerge da queste tendenze non è l’obsolescenza dell’hardware. Al contrario, l’infrastruttura fisica si dimostra resiliente e performante. Il punto di rottura risiede nel modello operativo.

Nei settori delle telecomunicazioni, dei servizi finanziari e delle imprese distribuite, la proliferazione di ambienti Kubernetes e le distribuzioni di elaborazione accelerata CPU/GPU avvengono a un ritmo che gli strumenti operativi esistenti non riescono a sostenere. L’automazione tradizionale diventa fragile, l’infrastruttura rimane sottoutilizzata o frammentata e i flussi di lavoro manuali non corrispondono più alla velocità richiesta dalle moderne applicazioni di IA.

La metamorfosi del Cloud Center of Excellence (CCOE)

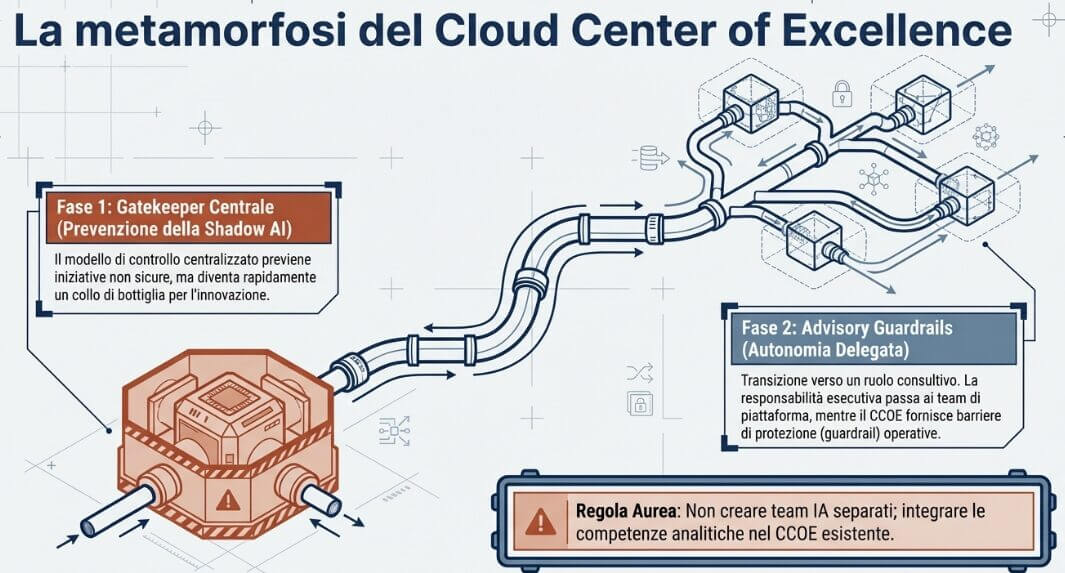

Il Cloud Center of Excellence, che è stato storicamente concepito come l’organo direttivo per facilitare, standardizzare e governare l’adozione del cloud computing all’interno delle grandi organizzazioni, deve essere profondamente rivisto alla luce dell’ingresso dell’intelligenza artificiale come componente nativa e intensiva dei servizi cloud.

Gli analisti sconsigliano la creazione di team separati per l’IA, suggerendo invece di integrare le pratiche e le competenze analitiche direttamente all’interno del CCOE esistente. Taleconvergenza è essenziale poiché l’IA si appoggia inesorabilmente sulle fondamenta infrastrutturali, sui protocolli di gestione dei dati e sui framework di sicurezza già supervisionati dal CCOE.

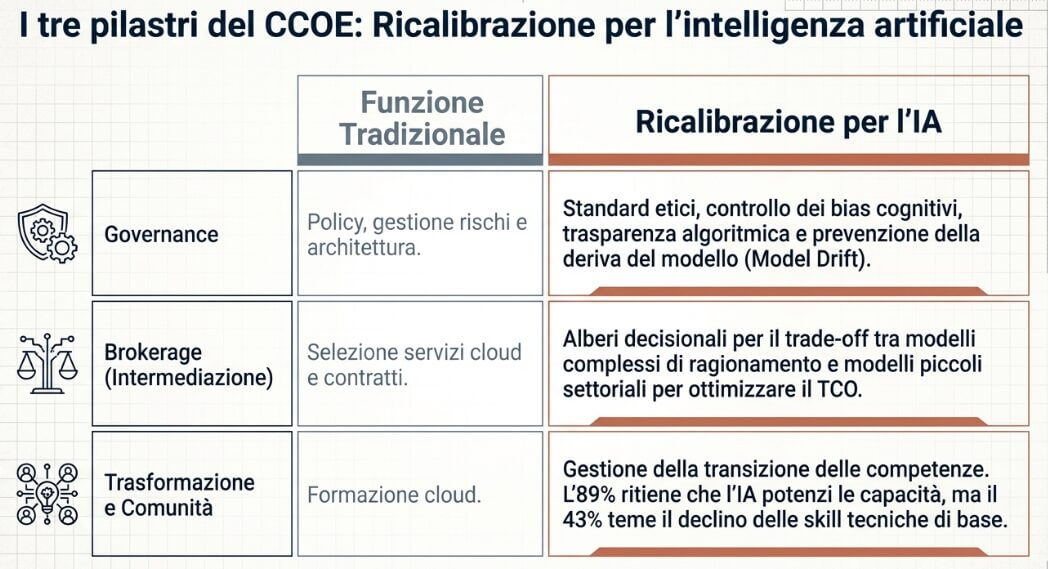

Il framework operativo di un CCOE si struttura su tre pilastri cardine, la cui applicazione deve essere ricalibrata per supportare i carichi di lavoro basati sull’apprendimento automatico.

I tre pilastri del framework CCOE per l’IA

| Pilastro Operativo | Funzione Tradizionale | Ricalibrazione per l’Intelligenza Artificiale |

| Governance | Definizione di policy, gestione dei rischi e standardizzazione dell’architettura. | Sviluppo di standard etici e di sicurezza per l’IA. Documentazione dei parametri operativi, revisione dei modelli algoritmici per l’identificazione di bias cognitivi e garanzia di trasparenza. Gestione rigorosa della qualità dei dati e del ciclo di vita dei modelli (Model Lifecycle Management), integrando audit regolari sulla sicurezza per prevenire la deriva del modello (model drift). |

| Brokerage (Intermediazione) | Abbinamento delle esigenze aziendali con servizi cloud ottimali e supporto nella negoziazione dei contratti. | Assistenza alle unità di business nella selezione delle soluzioni IA più appropriate attraverso alberi decisionali strutturati. Valutazione del trade-off tra l’impiego di complessi modelli di ragionamento e modelli più piccoli e settoriali per ottimizzare il Total Cost of Ownership (TCO). |

| Trasformazione e Comunità | Promozione delle competenze cloud, formazione e gestione del cambiamento organizzativo. | Disseminazione delle best practice in ambito IA attraverso basi di conoscenza. Affrontare la complessa transizione delle competenze: mentre l’89% dei dirigenti concorda sul fatto che l’IA potenzi le capacità, il 43% avverte il rischio di un declino nelle competenze tecniche di base a causa dell’eccessivo affidamento all’automazione. |

L’evoluzione dal controllo centralizzato all’Advisory

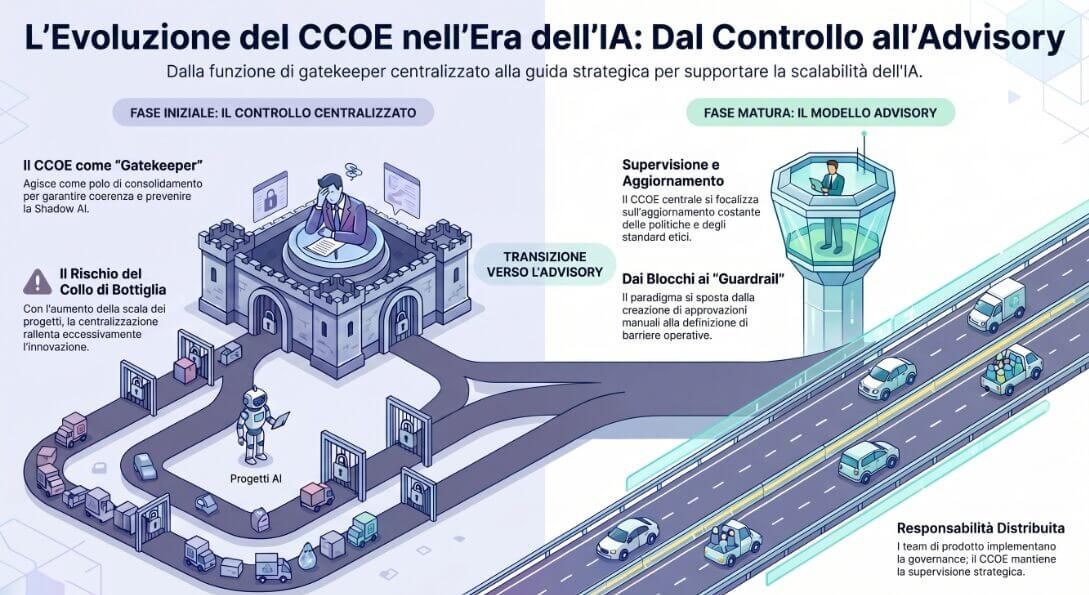

La traiettoria di sviluppo del CCOE nel contesto dell’intelligenza artificiale non è statica. La governance matura attraverso fasi distinte, riflettendo la progressione organizzativa.

Nelle fasi iniziali dell’adozione dell’IA, un approccio centralizzato risulta indispensabile. Il CCOE agisce come un polo di consolidamento delle competenze, stabilendo pratiche fondamentali e operando, di fatto, come un “gatekeeper” (guardiano) per garantire la massima coerenza e prevenire la proliferazione incontrollata di iniziative non sicure (la cosiddetta shadow AI).

Tuttavia, con l’aumento della maturità operativa e la scalabilità dei progetti, il modello centralizzato rischia di trasformarsi in un collo di bottiglia, rallentando l’innovazione. L’evoluzione necessaria prevede la transizione del CCOE verso un ruolo puramente consultivo (advisory). Il paradigma si sposta dalla creazione di blocchi approvativi alla definizione di “guardrail” (barriere di protezione operative). Questo cambiamento trasferisce la responsabilità materiale dell’implementazione ai team di piattaforma e di prodotto che ereditano il compito di applicare una governance coerente all’interno dei loro flussi di lavoro, garantendo distribuzioni affidabili e consegne sicure dei carichi IA, lasciando al CCOE centrale la prerogativa della supervisione strategica e dell’aggiornamento delle politiche.

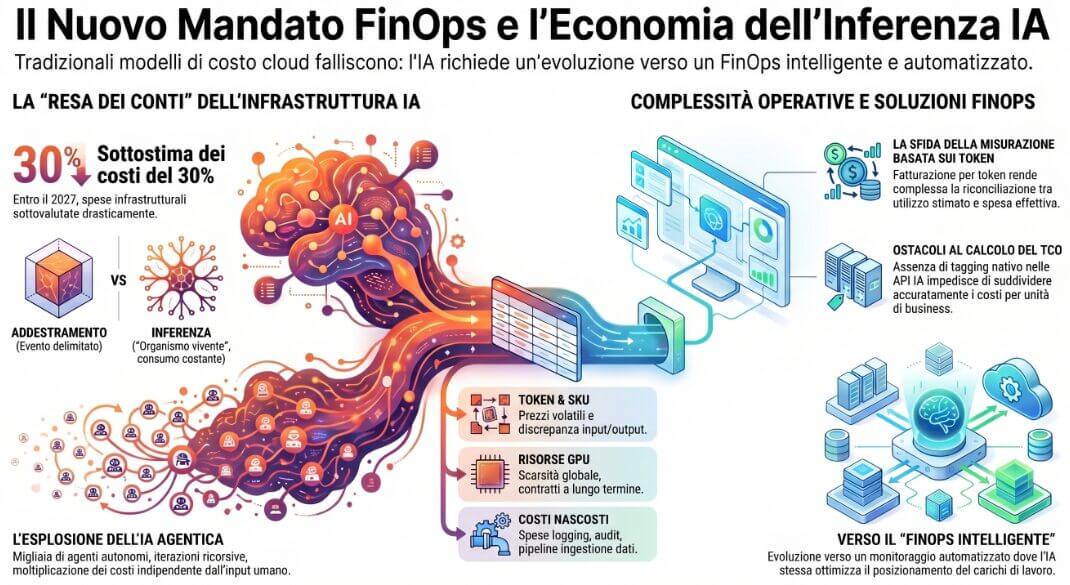

Il nuovo mandato FinOps e l’economia dell’inferenza

La gestione finanziaria del cloud, formalizzata nella disciplina del FinOps, rappresenta l’area in cui l’impatto dell’IA risulta più disorientante per le imprese. I modelli tradizionali di previsione e gestione dei costi IT, perfezionati nel corso di decenni per l’implementazione di sistemi prevedibili come gli ERP, si stanno rivelando del tutto inadeguati per i progetti basati su modelli linguistici e reti neurali.

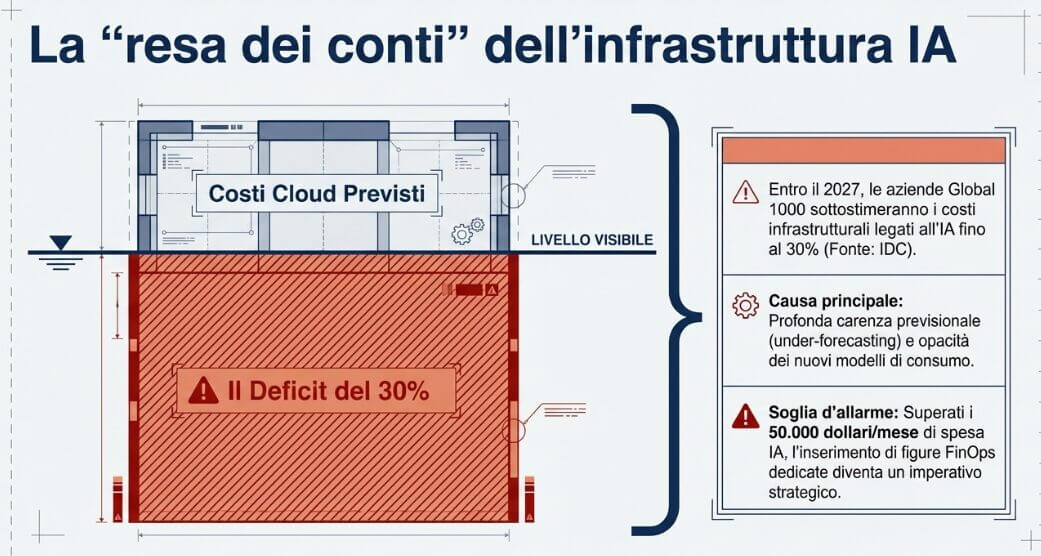

La “Resa dei conti” infrastrutturale

Le società di analisi di mercato, tra cui IDC, hanno categorizzato questo fenomeno come “AI infrastructure reckoning” (la resa dei conti dell’infrastruttura IA). Secondo il report “FutureScape 2026”, si prevede che le aziende appartenenti al segmento Global 1000 sottostimeranno i propri costi di infrastruttura legati all’IA fino al 30% entro la fine del 2027. Il deficit non scaturisce necessariamente da negligenza gestionale, ma da una profonda carenza previsionale (under-forecasting) e dall’opacità dei nuovi modelli di consumo.

È cruciale sottolineare che l’avvertimento di IDC è calibrato su organizzazioni che possiedono già team FinOps dedicati e piattaforme di governance sofisticate. Per aziende di dimensioni inferiori, o per società software (SaaS) prive di tali strutture, il rischio di deviazione del budget è stimato essere considerevolmente superiore a tale soglia del 30%. In termini operativi, si ritiene che l’implementazione di un modello FinOps interfunzionale possa essere sufficiente per livelli di spesa IA inferiori ai 50.000 dollari mensili; superata tale soglia, l’inserimento di figure professionali FinOps specificamente dedicate diventa un imperativo strategico.

L’economia dell’intelligenza artificiale diverge da quella dei tradizionali carichi di lavoro cloud a causa della sua natura esponenziale e continuativa. I modelli operativi descrivono l’IA come un “organismo vivente”: cresce, si adatta e assorbe risorse in modi difficilmente prevedibili. Il calcolo associato all’addestramento dei modelli, pur essendo intensivo e oneroso, rappresenta un evento temporalmente delimitato. Al contrario, l’inferenza, ovvero l’esecuzione del modello in produzione per generare risposte, rappresenta un carico di lavoro continuo che consuma costantemente cicli di calcolo su GPU. Inoltre, l’incremento delle dimensioni dei modelli segue dinamiche non lineari: un modello che raddoppia i propri parametri può richiedere un aumento decuplicato della potenza computazionale necessaria.

La sfida architetturale dell’IA agentica

La complessità economica è destinata a subire un’ulteriore accelerazione con l’introduzione dell’intelligenza artificiale “agentica” (Agentic AI) e la collaborazione multi-agente. A differenza dei modelli basati su interazioni dirette di tipo prompt-risposta gestite da utenti umani, gli agenti IA sono progettati per operare in autonomia, interagendo tra loro, richiamando API e generando iterazioni ricorsive per risolvere compiti complessi. Le previsioni indicano che le aziende del segmento G2000 implementeranno tali agenti nell’ordine delle migliaia per automatizzare flussi di lavoro aziendali e IT. Questa autonomia si traduce in un consumo di risorse ininterrotto e sganciato dall’input umano, moltiplicando esponenzialmente i costi di inferenza e mettendo in crisi i tradizionali sistemi di allerta basati sui volumi di transazione.

Complessità operative del FinOps per l’IA

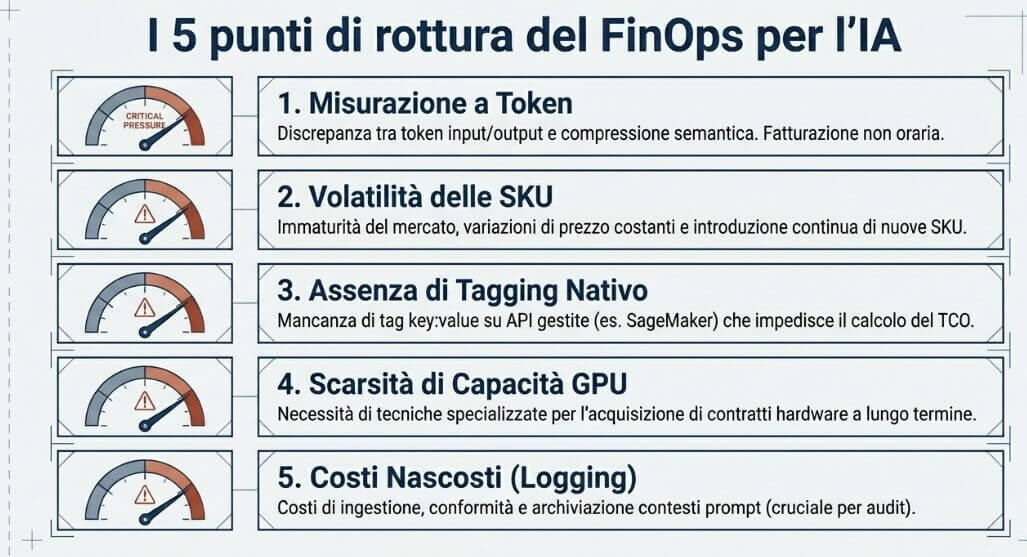

La traduzione del paradigma FinOps per supportare i carichi IA richiede l’adeguamento a ostacoli tecnici molto specifici, dettagliati nella tabella sottostante.

| Area di Complessità FinOps | Dettagli e Criticità |

| Misurazione basata sui Token | I servizi IA generativa non sono fatturati per ora di elaborazione, ma per “token”. La discrepanza tra i token in input (forniti dall’utente o dall’agente) e quelli in output o compressi semanticamente all’endpoint API rende complessa la riconciliazione tra utilizzo stimato e spesa effettiva. |

| Volatilità dei Prezzi e Nuove SKU | I modelli linguistici e i servizi connessi sono soggetti a frequenti variazioni di prezzo e all’introduzione costante di nuove Stock Keeping Unit (SKU) da parte dei fornitori cloud. L’immaturità del mercato genera un panorama tariffario incoerente. |

| Assenza di Tagging Nativo | Molte delle nuove API e dei servizi gestiti (come Amazon SageMaker o Google Vertex AI) vengono rilasciati senza capacità native di assegnazione di etichette (tag). Senza la possibilità di applicare tag key:values, i team FinOps non possono suddividere accuratamente i costi o calcolare il TCO per specifica applicazione o unità di business, costringendo l’ingegneria a sviluppare strumenti personalizzati. |

| Scarsità di Risorse e Gestione della Capacità | A causa della carenza globale di acceleratori hardware, i team FinOps si trovano a dover elaborare tecniche specializzate per la gestione della capacità GPU, l’orchestrazione e l’acquisizione di contratti a lungo termine, affrontando dinamiche assenti nei più maturi servizi di calcolo generale. |

| Costi Nascosti e Moltiplicatori | Oltre all’inferenza, esistono spese operative rilevanti ma spesso omesse nelle previsioni: pipeline per l’ingestione continua dei dati, sistemi di monitoraggio della conformità e requisiti di archiviazione (logging). In settori come il FinTech, i requisiti di audit impongono la registrazione dettagliata di contesti molto estesi all’interno del prompt di sistema per ogni interazione, aggravando enormemente i costi di archiviazione e il consumo di token. |

Il superamento di queste sfide richiede un’evoluzione verso il “FinOps Intelligente”. IDC prospetta che, entro il 2027, questa disciplina diventerà automatizzata e invisibile, con l’impiego dell’IA stessa per monitorare, allocare le risorse e raccomandare il posizionamento più economico dei carichi di lavoro in tempo reale. Nel frattempo, i leader tecnologici devono forgiare team ibridi che uniscano profonda competenza ingegneristica IT a sensibilità economica.

Governance, sicurezza e debito dei dati

Le architetture all’avanguardia e l’ottimizzazione dei costi risultano inefficaci se non supportate da un rigoroso framework di governance.

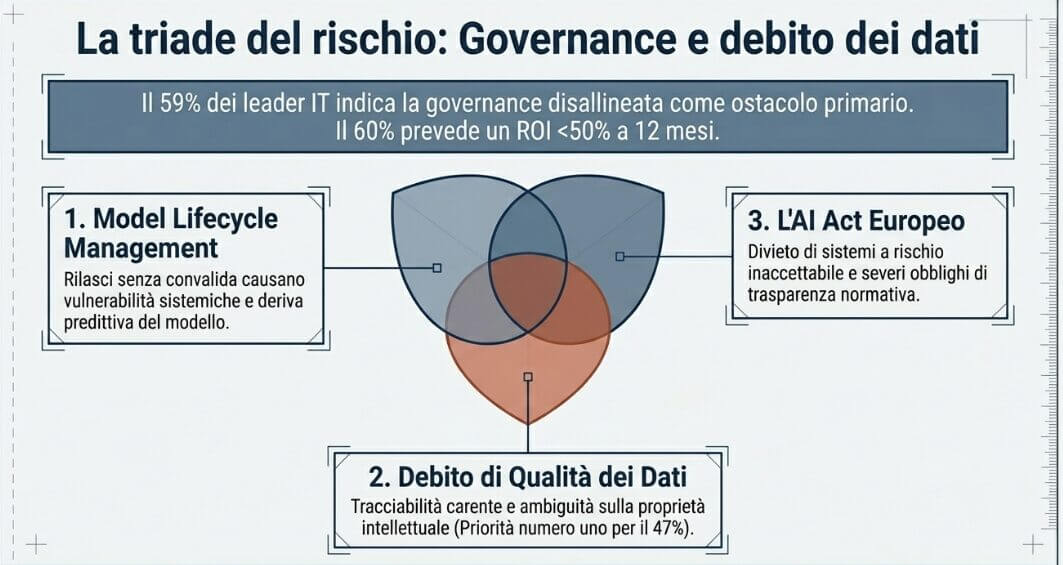

Le carenze in quest’area rappresentano uno dei principali freni all’espansione dei programmi IA. Secondo un’analisi del settore condotta da Domino Data Lab, il 59% dei leader IT individua in processi di governance disallineati e in priorità aziendali contrastanti il principale ostacolo ai propri programmi di intelligenza artificiale. Oltre alla pressione finanziaria (citata dal 60% degli intervistati come limite primario), vi è una diffusa cautela sui rendimenti a breve termine, con il 60% delle organizzazioni che prevede un ROI inferiore al 50% nei dodici mesi successivi.

I vettori di rischio primari

La governance si articola su tre vettori di rischio primari:

- Gestione del Ciclo di Vita del Modello (Model Lifecycle Management) – In contesti privi di controlli centralizzati adeguati, i team di sviluppo spesso rilasciano modelli IA senza sottoporli a convalida indipendente, valutazione formale del rischio o processi di approvazione standardizzati. Questa mancanza di protocolli crea vulnerabilità sistemiche relative all’introduzione di bias algoritmici, alla deriva del modello (il degrado delle prestazioni predittive nel tempo al variare dei dati in ingresso) e a debolezze architetturali sfruttabili da attori malintenzionati.

- Debito di Qualità dei Dati (Data Quality Debt)– l’efficacia di un sistema IA è direttamente correlata all’integrità dei dati che lo alimentano. Il 47% dei dirigenti identifica la qualità dei dati come il parametro fondamentale per il successo dei programmi di governance dell’IA. Tuttavia, criticità come una tracciabilità (lineage) carente e ambiguità nella proprietà intellettuale dei dati rendono estremamente complesso dimostrare che i set di addestramento siano conformi agli standard interni o ai vincoli di legge.

- Conformità Normativa e l’AI Act Europeo – L’esposizione legale sta diventando un fattore preponderante. La promulgazione dell’AI Act da parte dell’Unione Europea ha introdotto dal febbraio 2025 il divieto assoluto per i sistemi considerati a “rischio inaccettabile”, definendo inoltre obblighi vincolanti di trasparenza, documentazione e supervisione umana scaglionati nei tre anni successivi. Le entità commerciali che non adeguano preventivamente i propri framework di governance si espongono al rischio di sostanziali sanzioni finanziarie e danni reputazionali.

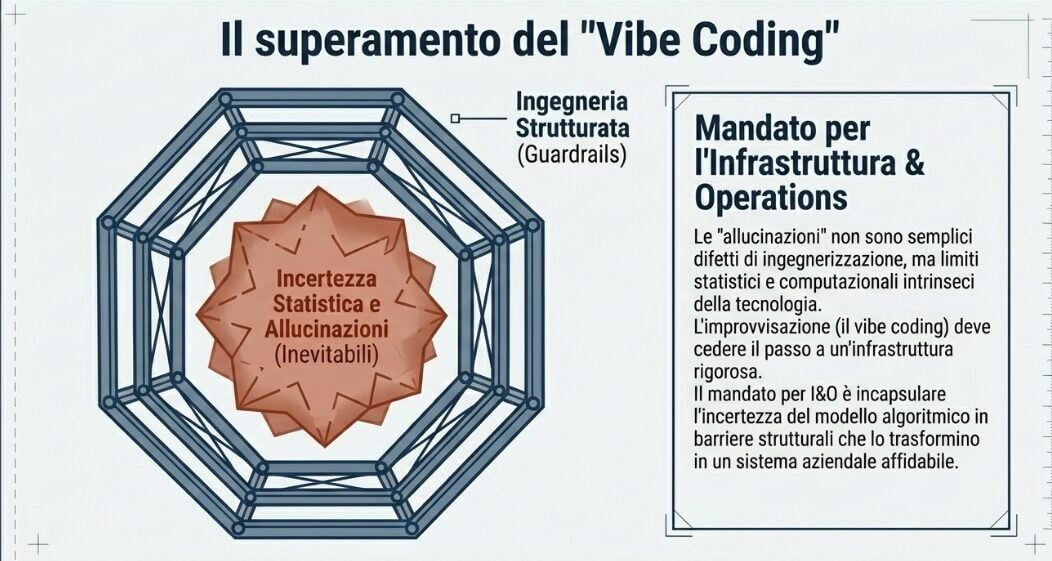

In merito all’affidabilità intrinseca dei modelli, la comunità scientifica e le principali aziende tecnologiche, come OpenAI, hanno chiarito i limiti teorici della tecnologia. Si riconosce che le “allucinazioni” (la generazione di risposte plausibili ma false) non sono meri difetti di ingegnerizzazione risolvibili, ma rappresentano limiti statistici e computazionali fondamentali e inevitabili, presenti anche con dati di addestramento perfetti. Di conseguenza, il ruolo del CCOE e dei team I&O è cruciale: l’improvvisazione (il cosiddetto “vibe coding”) deve cedere il passo a un’ingegneria strutturata.

Le organizzazioni sono chiamate a costruire infrastrutture e “guardrail” capaci di incapsulare l’incertezza statistica dei prompt trasformandola in sistemi aziendali affidabili. Grandi imprese stanno già guidando questa transizione istituendo team di governance dedicati, posizionandosi per sfruttare la tecnologia tutelando contemporaneamente fiducia e trasparenza.

Soluzioni architetturali: piattaforme di orchestrazione e Cloud sovrano

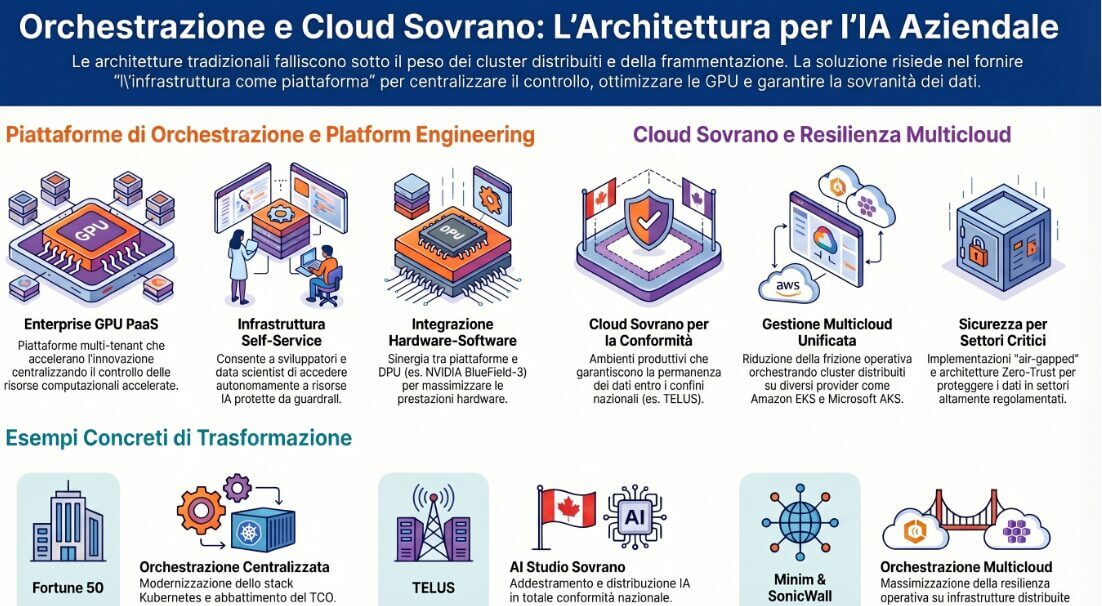

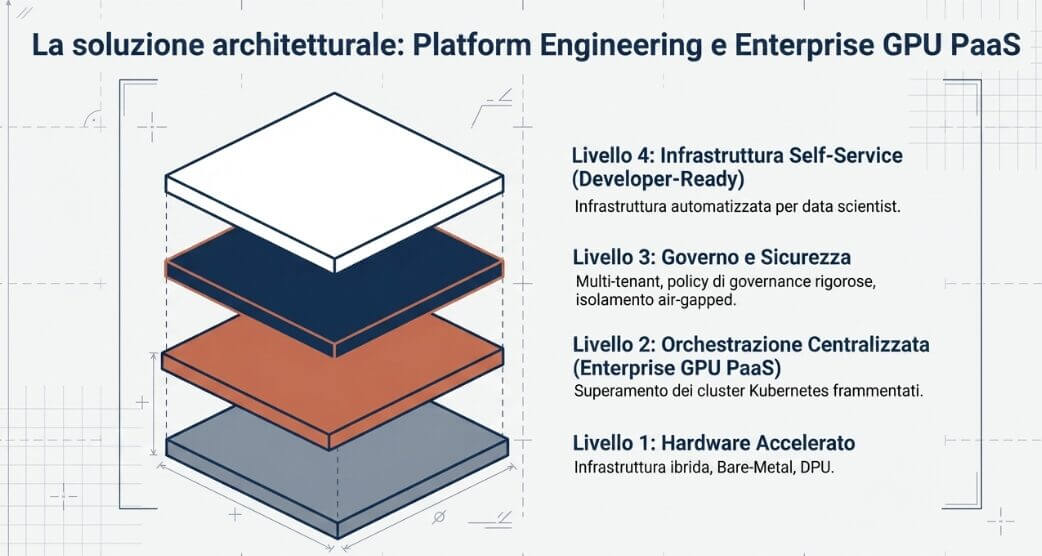

Per risolvere il divario tra la complessità delle implementazioni cloud-native e la rigidità dei modelli operativi tradizionali, l’industria infrastrutturale sta adottando piattaforme avanzate di orchestrazione. Quando l’automazione dei flussi di lavoro manuali fallisce sotto il peso dei cluster Kubernetes distribuiti e della frammentazione tra cloud pubblico e privato, l’approccio vincente consiste nel fornire “l’infrastruttura come piattaforma” (Platform Engineering).

I Managed Service Provider (MSP) e i Systems Integrator (SI) stanno conseguentemente spostando il loro focus operativo verso servizi di consulenza per l’IA e la gestione di piattaforme SaaS avanzate. Nel mercato emergono soluzioni specializzate in “Enterprise GPU PaaS” (Platform as a Service), che offrono fondamenta multi-tenant per accelerare l’innovazione e centralizzare il controllo. L’obiettivo di queste piattaforme è triplice: consentire ai team di ingegneria di fornire infrastrutture self-service a sviluppatori e scienziati dei dati, applicare politiche di governance rigorose su ambienti ibridi e ottimizzare drasticamente i costi riducendo lo spreco di risorse inattive.

Casi studio di trasformazione infrastrutturale

L’impatto di questi sistemi di orchestrazione centralizzata è documentabile attraverso diverse implementazioni industriali e partnership strategiche.

| Società di Consulenza Fortune 50 | |

Un’entità di consulenza globale operante nella classifica Fortune 50 ha sostituito con successo il proprio stack legacy Kubernetes (Rancher), divenuto troppo oneroso e complesso, adottando piattaforme di orchestrazione centralizzate (nello specifico, Rafay) per modernizzare la gestione dei carichi di lavoro e abbattere il TCO. | |

| TELUS (Cloud Sovrano) | |

| L’operatore di telecomunicazioni canadese TELUS ha sviluppato il primo “AI Studio” sovrano in Canada. Utilizzando soluzioni di orchestrazione avanzate, ha creato un ambiente di livello produttivo “developer-ready” che permette a imprese e istituti di ricerca di addestrare, ottimizzare e distribuire applicazioni IA assicurando che i dati rimangano confinati entro i confini nazionali, garantendo la totale conformità in materia di sovranità del dato. | |

| Minim e SonicWall | |

| Entrambe le organizzazioni hanno adottato sistemi di orchestrazione per gestire su vasta scala le operazioni IT e i cluster distribuiti attraverso servizi cloud concorrenti (Amazon EKS e Microsoft AKS), riducendo la frizione operativa associata alle distribuzioni multicloud. | |

| Integrazione Hardware-Software (NVIDIA) | |

| Le piattaforme di orchestrazione si stanno integrando profondamente con le architetture hardware. Collaborazioni dirette con la “NVIDIA Enterprise AI Factory” e il framework DOCA permettono di sfruttare le Data Processing Unit (DPU) BlueField-3 e i server RTX PRO. Questa sinergia consente di scaricare i compiti di rete e sicurezza dalla CPU principale, garantendo alle aziende il lancio di servizi IA scalabili “alle proprie condizioni”, massimizzando il controllo e le prestazioni hardware. | |

Sistemi integrati a livello globale (da entità come Accenture, Indosat, Freddie Mac e Blackstone) dimostrano che la combinazione di architetture Zero-Trust, controlli di accesso basati sui ruoli (RBAC) e supporto per implementazioni “air-gapped” (isolate da reti esterne) rappresenta l’unico approccio sostenibile per rispettare i severi requisiti di residenza dei dati nei settori critici.

Impatto macroeconomico, produttività e capitale umano

Nonostante l’elenco esteso di ostacoli finanziari, sfide di governance e attriti operativi, l’adozione su larga scala delle tecnologie legate all’intelligenza artificiale prosegue senza sosta, trainata da ritorni economici tangibili e misurabili. La trasformazione ha ormai superato la mera ricerca di efficienza teorica per attestarsi su metriche di impatto macroeconomico.

I dati provenienti dagli operatori di mercato primari illustrano un’infiltrazione sistemica nel tessuto aziendale. Ad esempio, si rileva che oltre l’85% delle corporazioni presenti nell’indice Fortune 500 sfrutta attualmente le soluzioni di intelligenza artificiale offerte dal cloud di Microsoft per definire le proprie strategie future. Le ricerche rivolte specificamente alle figure dirigenziali apicali avvalorano questo trend: un sondaggio condotto da IDC documenta come il 66% degli Amministratori Delegati (CEO) riporti benefici aziendali concreti derivanti dalle iniziative di IA generativa. I parametri in cui si registra il miglioramento più sensibile riguardano l’ottimizzazione dell’efficienza operativa interna e l’incremento qualitativo nei livelli di soddisfazione della clientela.

Le proiezioni economiche a medio e lungo termine delineano scenari di crescita considerevoli. Analisi previsionali convergono nello stimare che gli investimenti complessivi in soluzioni e servizi di IA genereranno un impatto economico globale cumulativo pari a 22,3 trilioni di dollari entro il decennio che si conclude nel 2030. Tale cifra corrisponde a un’incidenza stimata di circa il 3,7% sul Prodotto Interno Lordo (PIL) mondiale. L’attributo fondamentale che giustifica simili stime è l’elevato potenziale moltiplicativo degli investimenti tecnologici in questo settore: secondo i modelli economici elaborati, per ogni singolo dollaro investito da un’azienda nell’adozione di soluzioni IA, si attende un ritorno e un valore aggiunto generato pari a 4,9 dollari sull’economia globale.

Questi incredibili ritorni si materializzano operativamente lungo quattro direttrici strategiche:

- Valorizzazione del Capitale Umano – Attraverso l’automazione dei processi ripetitivi o a basso valore cognitivo, le risorse aziendali vengono riallocate verso attività caratterizzate da maggiore complessità e creatività.

- Rinnovamento dell’Interazione Commerciale – Le aziende sfruttano l’analisi predittiva e generativa per costruire esperienze su misura per i clienti, migliorando la fedeltà al marchio e supportando contestualmente il carico di lavoro degli operatori fisici.

- Riconfigurazione dei Flussi Operativi – I tradizionali processi industriali e organizzativi, dalle procedure di back-office, alla logistica di approvvigionamento, sino all’analisi finanziaria, vengono ottimizzati, aprendo la strada a modelli di business inediti e canali di crescita inesplorati.

- Accelerazione del Ciclo di Innovazione – Le capacità analitiche dei modelli comprimono significativamente i tempi richiesti per la progettazione e lo sviluppo di nuovi prodotti, garantendo un sostanziale vantaggio competitivo nel raggiungimento dei mercati target (time-to-market).

Le ripercussioni sul mercato del lavoro e sulle dinamiche salariali per i dipartimenti I&O e i poli di eccellenza (CCOE) sono immediate e quantificabili. Le competenze in ambito di intelligenza artificiale e architetture cloud si confermano come le skill più richieste e remunerative nel mercato della tecnologia. Le statistiche per l’anno di riferimento mostrano che i professionisti in possesso di comprovate competenze legate all’infrastruttura IA godono di un premio salariale del 18% rispetto ai colleghi specializzati in altri segmenti del settore IT. Inoltre, il 72% delle aziende d’avanguardia sta implementando metriche formali per tracciare il ROI specificamente collegato ai guadagni di produttività indotti dall’IA sul personale, dimostrando che l’IA si sta spostando dalle spese in conto capitale (CapEx) tecnologiche agli investimenti in efficienza delle risorse umane.

AI nel cloud, cosa cambia

La piena materializzazione dell’Intelligenza Artificiale come componente centrale e indissolubile degli ecosistemi cloud impone ai leader dell’Infrastructure and Operations (I&O) e ai Cloud Center of Excellence (CCOE) di superare paradigmi gestionali obsoleti. Il passaggio da tecnologie abilitanti a tecnologie dirompenti ha esposto le criticità e le lentezze intrinseche dei flussi operativi manuali. L’approccio frammentato, spesso radicato nell’entusiasmo iniziale della sperimentazione, non risulta più sostenibile in contesti di produzione su larga scala.

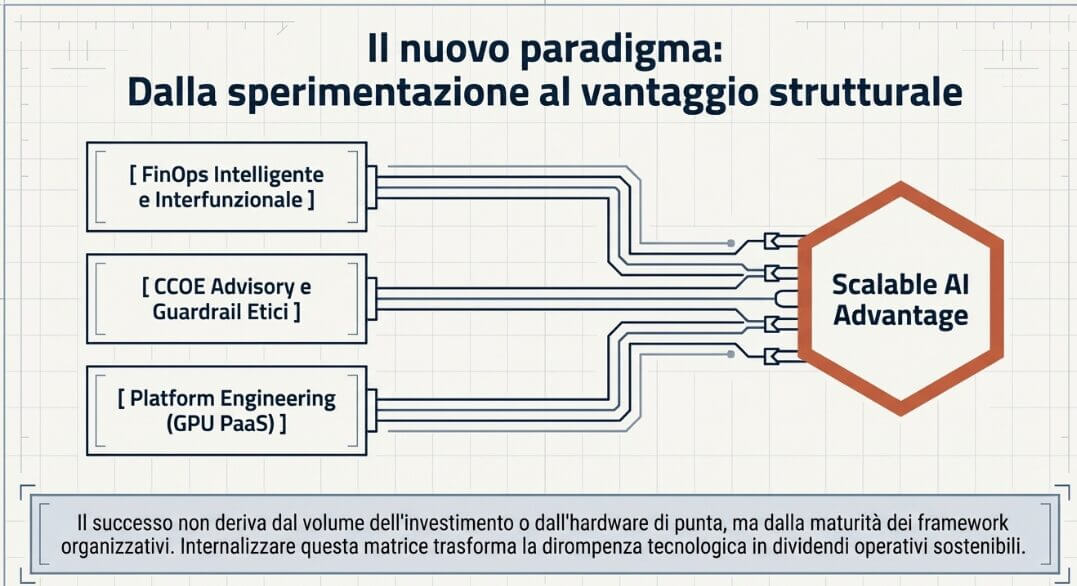

Le analisi dei trend per il biennio 2025-2026 rivelano in modo inequivocabile che il successo non deriverà semplicemente dal volume degli investimenti tecnologici o dall’acquisizione di hardware di punta, ma dalla maturità dei framework organizzativi e di controllo. A livello di infrastruttura, l’impiego del Platform Engineering e di sistemi avanzati di orchestrazione (come l’Enterprise GPU PaaS) diventa determinante per garantire flessibilità in architetture ibride, multicloud o sovrane, mitigando contestualmente i rischi di inefficienza e sottoutilizzo.

A livello organizzativo, il mandato è chiaro: i CCOE devono evolvere da organi di restrizione centralizzati ad agenzie di consulenza interna. Il loro compito sarà quello di definire percorsi tracciati e sicuri (guardrail) che consentano agilità di sviluppo, assicurando contemporaneamente la gestione etica del ciclo di vita dei modelli, l’eccellenza nella qualità dei dati e la piena conformità a direttive legislative rigorose come l’AI Act europeo. L’integrazione di questi processi previene l’accumulo di debito tecnico e algoritmico che risulterebbe catastrofico.

Infine, il controllo economico deve subire una metamorfosi analoga. L’incombente “resa dei conti” dell’infrastruttura IA, dettata da modelli di consumo basati su token, scarsità di risorse computazionali e dall’esplosione dei costi derivanti dall’inferenza continua (inclusa l’intelligenza artificiale agentica), richiede un immediato potenziamento delle discipline FinOps. La convergenza di competenze ingegneristiche e acume finanziario all’interno di team interfunzionali è la chiave per interpretare e prevedere le spese operative. Le organizzazioni che internalizzano e istituzionalizzano questa complessa matrice di automazione, governance e disciplina finanziaria saranno quelle in grado di tradurre l’onda tecnologica in vantaggi competitivi strutturali, intercettando gli immensi dividendi di produttività attesi per il prossimo decennio.