C’è veramente in atto negli US una diffusa reazione popolare – un “backlash” o (con un gioco di parole) un “botlash” – contro l’AI e contro quello che essa comporta?

Contro il sorgere della gigantesca rete di data center che le Big Tech stanno finanziando (spesso combattute dalle comunità locali che si vedono sottratte risorse quali l’acqua, la terra e l’energia elettrica)?

O contro l’idea di utilizzare i film e le produzioni in genere di Hollywood per istruire l’AI allo scopo di automatizzare parte della produzione futura (“Stealing Isn’t Innovation” è il nome della campagna contro lanciata dalle celebrità di Hollywood stessa)?

È la tesi di Marietje Schaake (Stanford University’s Institute for Human-Centered Artificial Intelligence), nel recentissimo articolo di FT “The ‘botlash’ movement is gaining momentum – Protesting and unsubscribing are being promoted as forms of modern-day strikes”.

Indice degli argomenti

AI, Big Tech e politica USA: il “botlash” e la reazione nel mondo Maga

Una tesi confermata dalla quasi rivolta all’interno del MAGA (“Make America Great Again”), il movimento ispirato da Peter Thiel e da cui è stato proiettato alla vicepresidenza degli US J.D. Vance, a fronte del favore accordato da Trump all’AI e alle Big Tech:

- inibendo con un suo decreto l’approvazione da parte di un numero crescente di Stati (compresi alcuni a guida repubblicana) di leggi volte a regolamentare – ovvero a tenere sotto controllo – lo sviluppo e la diffusione dell’AI.

- eliminando gli ostacoli che si frapponevano o rallentavano la veloce realizzazione degli AI data center per cui come noto sono state stanziate cifre enormi e crescenti (ben 660 miliardi di $ nel 2026 da parte delle 4 Big Tech maggiori investitrici e non solo), per il possibile impatto negativo sulle prossime elezioni di “mid term” che tale orientamento politico potrebbe avere.

Come raccontato qualche giorno prima in un altro articolo di FT – “Donald Trump’s AI push fuels revolt in Maga heartlands: Republicans fear backlash against White House agenda could undermine support in this year’s midterm elections”, che non solo esalta le preoccupazioni elettorali di parte dei repubblicani ma evidenzia la storica avversione del mondo MAGA, più legato al “venture capital [VC]”, nei riguardi delle Big Tech.

La frattura interna tra populist e pro-business e le ricadute elettorali

Una frattura, quella fra la componente “populist” e quella “pro-business” (più attenta alle esigenze del business in generale e delle Big Tech in particolare) ora favorita da Trump, che aveva visto la chiara vittoria della seconda qualche giorno prima, come raccontato da The Wall Street Journal [WSJ] nel suo articolo del 12 febbraio “Justice Department’s Antitrust Chief Leaves Post After Clashes With Leadership – Gail Slater’s departure follows feuds with senior officials [l’Attorney General Pam Bondi, fedelissima di Trump, in primo luogo] over her independence during her 11 months in the role”.

Un articolo in cui WSJ mette in luce come essa sia stata sin dall’inizio allineata con i “populist”, anche per i suoi forti legami con Vance, che:

l’aveva scelta come consigliera durante il suo mandato senatoriale, mandato durante il quale egli aveva sempre tenuto un atteggiamento antitrust aggressivo, soprattutto nei riguardi delle Big Tech;

l’aveva fortemente appoggiata, una volta divenuto vicepresidente, per la nomina a capo della Divisione Antitrust del DoJ: un appoggio non più garantitole nel suo scontro con Pam Bondi, molto vicina come detto a Trump.

AI, Big Tech e politica USA: il nodo antitrust tra DoJ, Vance e Bondi

Del tutto simile il punto di vista sul tema espresso da FT qualche giorno dopo: “Populists are losing a Maga tug of war over US antitrust policy – Gail Slater’s exit suggests pro-business Republicans are ascendant in Donald Trump’s justice department”.

Lobbying, interessi privati e narrazioni pubbliche sull’AI

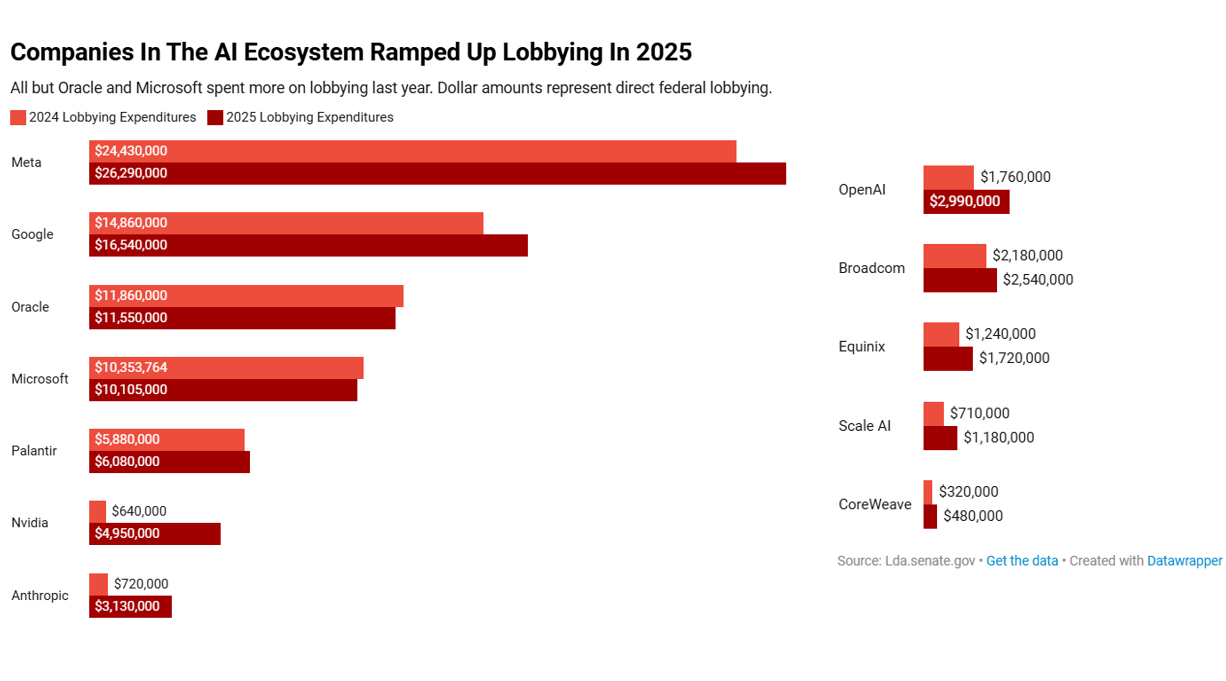

Uno scontro però che secondo Forbes – “AI’s Biggest Builders Are Now Its Biggest Lobbyists: OpenAI and Anthropic spent more on lobbying in 2025 than ever. They’re pushing for friendly treatment and less regulation amid rising tensions—at least for Anthropic—with the Trump administration” – vede un intreccio (peraltro non sorprendente) fra grandi principi e interessi privati:

- con interazioni sempre più strette in tema di AI fra il mondo politico e gli “AI’s Biggest Builders” (OpenAI, Anthropic, Google e Meta quelli al momento più operanti sulla “frontiera”),

- con una certa ipocrisia da parte delle imprese, che mentre criticano le interferenze del mondo politico – “mettere la politica (policy) al di sopra della politica politicante (politics)“ la ricetta del co-fondatore e CEO di Anthropic Dario Amodei – aumentano gli “investimenti in lobbying” (Fig. 1) per ottenere leggi più favorevoli e possibilmente corposi contratti da parte delle diverse amministrazioni pubbliche.

AI, Big Tech e politica USA: il caso Anthropic tra etica, difesa e pressioni competitive

Una accusa giusta quella nei riguardi di Anthropic, in questo momento l’impresa forse più in vista anche perché con i suoi “AI cutting-edge tools” che presenta a ritmo serrato sta demolendo le capitalizzazioni delle imprese operanti nel software (Ibm ha perso il 13% in un giorno quando Anthropic ha parlato di miglioramento del Cobol e il 27% in un mese) e di quelle finanziarie che hanno promosso la crescita delle più giovani di esse?

Almeno in parte sì, e lo dirà l’esito dallo scontro fra Anthropic stessa e il Pentagono, in cui:

- Dario Amodei ha chiesto un uso “etico” del suo Cowork, coerente con le motivazioni date al momento del distacco cinque anni fa da OpenAI ma un po’ curioso dal momento che si tratta di una fornitura militare;

- il governo ha minacciato di tagliare fuori Anthropic da ogni fornitura futura: “Pete Hegseth [US defence secretary] threatens to cut Anthropic from Pentagon supply chain in showdown with CEO – AI start-up’s Dario Amodei summoned to Washington after trying to limit military use of its technology” (FT, 24 febbraio);

Dario Amodei si è giustificato – “Anthropic Dials Back AI Safety Commitments – Company says competitive pressure prompts it to pivot away from a more-cautious stance” (WSJ, 24 febbraio) – lamentando la carenza delle regole sempre richieste dalla sua impresa: “The policy environment has shifted toward prioritizing AI competitiveness and economic growth, while safety-oriented discussions have yet to gain meaningful traction at the federal level.”

Scoppia lo scontro tra Anthropic e il Pentagono (update 28 febbraio)

“Pete Hegseth [segretario alla Difesa degli Stati Uniti] minaccia di escludere Anthropic dalla catena di approvvigionamento del Pentagono in seguito a un confronto con il CEO – Dario Amodei, fondatore della start-up di intelligenza artificiale, convocato a Washington dopo aver cercato di limitare l’uso militare della sua tecnologia” (FT, 24 febbraio), era la minaccia.

E nel pomeriggio di ieri la minaccia si è concretizzata: “Il segretario alla Difesa Pete Hegseth ha dichiarato venerdì che designerà l’azienda di intelligenza artificiale Anthropic come un rischio per la sicurezza nazionale nella catena di approvvigionamento, emanando la designazione dopo che il presidente Donald Trump ha ordinato a tutte le agenzie federali di smettere di utilizzare la tecnologia dell’azienda, che giovedì ha dichiarato di aver rifiutato di concedere al Pentagono l’accesso illimitato ai suoi modelli di IA”, ha scritto Forbes in un suo articolo.

E a tarda notte a sua volta WSJ ha titolato “L’amministrazione Trump snobba Anthropic e abbraccia OpenAI nella disputa sui guardrail – Il capo di OpenAI afferma che l’accordo per l’utilizzo dei suoi strumenti in contesti riservati da parte del Pentagono include le stesse proibizioni che Anthropic aveva voluto“, evidenziando come la dichiarazione di Sam Altman, di aver sottoscritto l’accordo con il Pentagono alle stesse condizioni richieste (ma non ottenute) da Anthropic, fosse dettata dal timore di una rivolta al suo interno e di una fuga per ragioni etiche di parte del suo ”prezioso” capitale umano.

Una paura comprensibile visto anche che “I lavoratori delle Big Tech fanno pressione sui loro capi affinché sostengano Anthropic nello scontro con il Pentagono – Il personale di Amazon, Google e Microsoft esorta i propri dirigenti ad adottare rigide misure di sicurezza per l’IA e a rifiutare qualsiasi contratto di difesa” (FT, 27 febbraio).

Un punto questo che The Economist sottolinea a tarda notte – “Donald Trump va al nucleare su Anthropic – La Silicon Valley sarà coinvolta nelle ricadute” – in un articolo in cui appunto Nel frattempo “Anthropic fa causa all’amministrazione Trump dopo che il laboratorio di IA è stato etichettato come rischio per la sicurezza” (FT, 27 febbraio), ma il tutto passa un po’ in secondo piano perché gli Stati Uniti e Israele attaccano l’Iran: “Stati Uniti e Israele attaccano l’Iran mentre Trump esorta gli iraniani a prendere il potere – Il presidente cita la necessità di eliminare ‘minacce imminenti’; l’Iran prende di mira Israele e diverse basi statunitensi in risposta”.

- Una possibilità quella ventilata in precedenza da Hegseth di invocare il Defence Production Act, che conferisce al presidente degli Stati Uniti l’autorità di obbligare le imprese a svolgere un determinato lavoro in nome della sicurezza nazionale.

- commenta l’estrema gravità della qualifica di “rischio per la sicurezza nazionale nella catena di approvvigionamento”, che impedisce di sottoscrivere contratti con il Pentagono a tutte le imprese che si avvalgono direttamente o indirettamente dell’AI di Anthropic, una qualifica finora riservata alla cinese Huawei che – se confermata – equivale a una sorta di “condanna a morte” di una delle startup innovative statunitensi più brillanti;

- riporta le preoccupazioni dei capi delle imprese operanti nell’AI che “AI researchers – the scarcest and most highly valued resource in Silicon Valley today – will protest if they feel their products are misused in harmful ways” e la inusuale sensibilità nei riguardi delle loro opinioni;

- evidenzia però anche come l’amministrazione Trump si sia tenuta una carta di riserva, stabilendo un periodo di phase-out per Anthropic di 6 mesi, dopo i quali – se non avrà mostrato nel frattempo un atteggiamento costruttivo – la costringerà a farlo con modalità non specificate.

- una possibilità quella ventilata in precedenza da Hegseth di invocare il Defence Production Act, che conferisce al presidente degli Stati Uniti l’autorità di obbligare le imprese a svolgere un determinato lavoro in nome della sicurezza nazionale.

- Nel frattempo “”Anthropic farà causa all’amministrazione Trump dopo che il laboratorio di intelligenza artificiale è stato etichettato come rischio per la sicurezza (FT, 27 febbraio), ma ora il tutto passa un po’ in seconda linea perché gli Stati Uniti e Israele attaccano l’Iran

Accordo openai e Pentagono

I dettagli dell’accordo di OpenAI e la sua solidarietà ad Anthropic sono ambivwlenti

- Giovedì, Altman ha inviato una nota ai dipendenti in cui affermava che l’intelligenza artificiale non dovrebbe essere utilizzata per la sorveglianza di massa o per armi letali autonome, pur concordando con la posizione del Pentagono secondo cui le aziende private non dovrebbero controllare la politica del governo degli Stati Uniti.

- Venerdì, Altman è apparso sulla CNBC e ha sostenuto con più forza Anthropic, fondata da ex dipendenti di OpenAI. “Nonostante tutte le differenze che ho con Anthropic, mi fido di loro come azienda e penso che abbiano davvero a cuore la sicurezza”, ha affermato.

- Poi ha stretto un accordo con il Dipartimento della Difesa, ma OpenAI ha anche affermato di aver trovato un modo per garantire che le sue tecnologie rispettassero i suoi principi di sicurezza installando specifici dispositivi di protezione tecnici sui suoi sistemi.

- “In tutte le nostre interazioni, il DoW ha dimostrato un profondo rispetto per la sicurezza e il desiderio di collaborare per ottenere il miglior risultato possibile”, ha dichiarato Sam Altman, amministratore delegato di OpenAI, in un post sui social media, utilizzando l’acronimo del Dipartimento della Guerra, il nome preferito dall’amministrazione per il Dipartimento della Difesa.

- .