C’è un paradosso al centro dell’intelligenza artificiale contemporanea. I modelli di frontiera dominano i titoli con risultati da primato in esami, benchmark e gare di ragionamento.

Nelle aziende, però, la trasformazione concreta arriva da sistemi più piccoli, veloci e convenienti, orchestrati dentro pipeline che ricordano una catena di montaggio digitale. Gli small language models.

Non è un declassamento dell’eccellenza scientifica, bensì un cambio di prospettiva industriale: per la maggior parte dei compiti ripetitivi, prevedibili e ad alto volume, i piccoli modelli linguistici sono sufficienti, spesso migliori e quasi sempre più economici.

Indice degli argomenti

Small language models e il paradosso dell’IA moderna

L’innovazione degli ultimi due anni ha reso i modelli compatti sorprendentemente capaci. Sfruttano addestramenti mirati, distillazione della conoscenza, tecniche di fine-tuning a basso impatto computazionale e retrieval su basi dati proprietarie.

Il risultato è un equilibrio difficile da battere in produzione: latenza ridotta, costi prevedibili, footprint di memoria contenuto, integrazione semplice con infrastrutture esistenti e, quando serve, possibilità di esecuzione on-device per preservare privacy e continuità del servizio.

Anche sul piano economico la differenza è netta. I listini dei principali provider mostrano ordini di grandezza di scarto tra i modelli di punta e le loro varianti mini o nano.

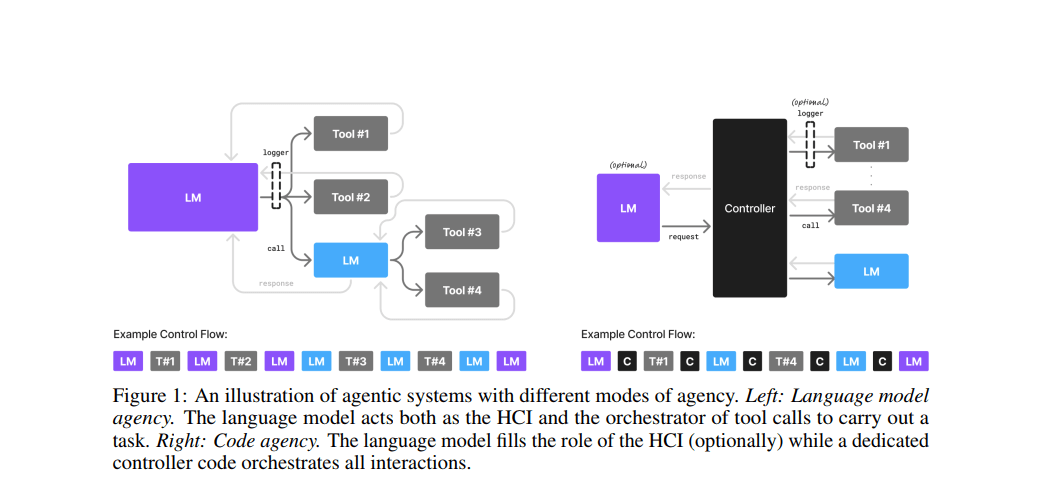

In più, nei workflow reali i modelli più grandi sono spesso usati con parsimonia come “supervisori” per pianificare, verificare o rifinire il risultato, mentre il grosso del lavoro viene delegato a modelli piccoli specializzati che macinano milioni di richieste al giorno con tempi di risposta nell’ordine di poche decine di millisecondi.

Perché i small language models vincono in azienda

Immaginiamo la pipeline di un’azienda come un nastro trasportatore su cui scorrono documenti, ticket, chiamate, eventi di log, e-mail. A intervalli regolari sono posizionate stazioni di lavorazione software che puliscono, arricchiscono, classificano, correggono, estraggono campi strutturati.

In ciascuna stazione opera un piccolo modello, appositamente addestrato o rifinito, che esegue una micro-attività con coerenza e costo minimo. Alcune stazioni sono puramente deterministiche, altre sono agenti leggeri che chiamano tool esterni, interrogano indici vettoriali o applicano regole di business.

Il “capo reparto” può essere un modello più grande che, nei passaggi critici, decide la strategia, valida gli output o compone il report finale, orchestrando così il contributo dei small language models dentro l’intero flusso.

La fabbrica della conoscenza guidata dai small language models

Questa architettura a catena di montaggio presenta tre vantaggi decisivi. Primo, la specializzazione. Un modello piccolo tarato su una tassonomia aziendale classificherà con maggiore affidabilità di un modello generalista.

Secondo, l’osservabilità. Ogni stazione espone metriche chiare su accuratezza, latenza ed errori, permettendo di migliorare dove serve senza toccare l’intero sistema. Terzo, la resilienza.

Se una stazione fallisce, il sistema può ripiegare su regole o su un modello più grande solo per i casi difficili, mantenendo il servizio operativo e riducendo il rischio di blocchi a catena.

Casi d’uso aziendali per i small language models

Nei contact center pubblici e privati l’approccio sta già cambiando il rapporto tra domanda e capacità di risposta. In diversi Stati americani, per le linee non di emergenza collegate ai centri 911 si impiegano agenti vocali che smistano, raccolgono i dati essenziali e chiudono pratiche a bassa priorità.

Il beneficio non è solo economico. Liberare gli operatori umani dalle chiamate amministrative riduce il burnout e migliora i tempi di risposta nelle vere emergenze, mostrando come i piccoli modelli possano assorbire in modo efficace il lavoro ripetitivo.

Applicazioni nei contact center e nel travel

Nel settore travel, piattaforme globali hanno iniziato ad affidare a modelli open source compatti la gestione di una quota significativa dell’assistenza clienti. Quando il dominio è ben delimitato, un modello più piccolo fine-tuned sui flussi conversazionali interni e connesso a basi di conoscenza aggiornate risolve gran parte delle richieste senza escalation.

I casi anomali o i reclami complessi vengono invece lasciati a operatori esperti o a un modello maggiore per il riepilogo finale, mantenendo un equilibrio tra efficienza, qualità del servizio e capacità di gestire situazioni critiche.

Anche nella pubblicità digitale i modelli piccoli sono il motore quotidiano dell’ottimizzazione. Nei sistemi di raccomandazione e delivery degli annunci, le large foundation model vengono usate per trasferire conoscenza e generare segnali ricchi.

La selezione e la graduatoria in tempo reale sono però affidate a reti più leggere che devono reagire in millisecondi e su scala planetaria. L’insieme costituisce una filiera in cui il “cervello” insegna, e le “mani” eseguono.

Small language models sul mobile e on-device

Sul mobile la logica è ancora più chiara. Gli smartphone moderni includono modelli on-device per funzioni come riassunto, correzione, dettatura, trascrizione, assistenza contestuale e prevenzione delle truffe telefoniche.

Le versioni nano girano all’interno di sandbox dedicate, utilizzano acceleratori locali e preservano dati sensibili sul dispositivo. Quando servono capacità aggiuntive, l’orchestratore manda in cloud solo ciò che è strettamente necessario, riducendo esposizione e costi di trasferimento.

Pattern tecnici per orchestrare small language models in azienda

Dietro i risultati ci sono schemi ormai ricorrenti. Il primo è la distillazione, con cui un modello di frontiera trasferisce competenze a studenti più piccoli tramite training supervisionato o tecniche teacher-student più sofisticate.

In produzione questo consente di portare in linea la “saggezza” dei modelli maggiori senza il loro peso computazionale, applicandola in contesti dove latenza e costo sono vincoli rigidi.

Distillazione, cascata con routing e RAG

Il secondo pattern è la cascata con routing. Le richieste passano a un modello veloce che decide se può rispondere con fiducia, eventualmente producendone già l’output. Solo i casi incerti o ad alto rischio vengono promossi a modelli più potenti.

Il criterio di promozione combina segnali di confidenza, limiti di latenza per canale, costo-per-token e obiettivi di qualità concordati con il business. Varianti recenti introducono verificatori leggeri, ensemble e meta-policy che ottimizzano direttamente accuratezza e costo.

Il terzo pattern è l’abbinamento con sistemi di retrieval. I piccoli modelli diventano notevolmente più utili quando ragionano su documenti e dati aziendali recuperati con pipeline RAG robuste.

Per compiti documentari la qualità dell’indice, del chunking, della normalizzazione dei metadati e delle politiche di sicurezza vale più di un salto di scala nel numero di parametri, rendendo cruciale la progettazione dell’infrastruttura di base.

Fine-tuning efficiente e iterazione continua

Infine, il fine-tuning efficiente. Le tecniche PEFT come LoRA o le loro evoluzioni riducono la quantità di parametri aggiornati, accelerano l’addestramento, abilitano la gestione di molte varianti verticali dello stesso modello e permettono roll-back rapidi se una modifica introduce regressioni.

A livello operativo, questo si traduce nella capacità di iterare ogni settimana sulle “stazioni” della catena senza bloccare l’intero impianto, mantenendo al tempo stesso un controllo stretto sulla qualità degli output e sui vincoli di compliance.

Economia, governance e sicurezza dei modelli piccoli

La convenienza economica dei piccoli modelli non è solo nel prezzo per milione di token, ma nella prevedibilità del costo finale. Un modello con finestra e pesi più contenuti tende a usare meno contesto, a ridurre le chiamate a strumenti esterni e a generare risposte più corte e strutturate.

Ciò semplifica il controllo di spesa e la contrattualizzazione dei livelli di servizio. Un ulteriore risparmio arriva dalla cache dei prompt e dalle esecuzioni batch per elaborazioni non interattive, in cui è possibile sfruttare in pieno l’elasticità dell’infrastruttura.

Sul fronte governance, i modelli piccoli sono più facili da auditare. In domini regolati si può mantenere un inventario degli asset di AI, documentare dataset e procedure di addestramento, riprodurre versioni precedenti e misurare con precisione fairness, robustezza e drift.

La superficie di attacco è minore e le superfici di leakage dati possono essere contenute con politiche di isolamento, soprattutto nei deployment on-prem o on-device, dove il controllo sull’ambiente esecutivo resta in mano all’azienda.

Il ruolo dei modelli di frontiera accanto ai small language models

I modelli più grandi non scompaiono. Servono come sorgenti di conoscenza, come pianificatori di alto livello, come strumenti di verifica semantica, come supporto in compiti di generazione complessa o multimodale ad alta creatività.

Sono fondamentali per la ricerca di base, per sbloccare nuove capacità generaliste e come teacher nella distillazione. In un’azienda, però, raramente conviene usarli “in prima linea” per ogni richiesta, proprio per i costi e i vincoli di latenza che comportano.

Una pratica sempre più diffusa prevede di impiegare un modello di ragionamento avanzato a monte, per scomporre il problema in passi eseguibili, e a valle, per sintetizzare una risposta human-grade, mentre gli step intermedi restano alla forza lavoro di micro-modelli specializzati.

Anche quando si ricorre a ensemble o mixture-of-agents, la componente dominante in termini di chiamate e tempo CPU/GPU rimane affidata a modelli compatti, che costituiscono il vero strato operativo dell’architettura.

Linee guida per costruire una catena di montaggio AI con small language models

Il punto di partenza sono i casi d’uso ripetitivi con KPI definiti. La pipeline viene modellata come un grafo di trasformazioni con confini espliciti tra le stazioni. Per ogni nodo si specificano input e output, soglie di confidenza, budget di latenza e regole di fallback.

La scelta converge su modelli compatti, open o commerciali, adatti al dominio di riferimento; un retriever collega l’orchestrazione ai dati proprietari e il primo passo operativo è un fine-tuning leggero.

Strumenti di orchestrazione trasformano prompt e chiamate ai modelli in componenti riutilizzabili con controllo delle versioni. La valutazione è automatizzata, sia offline sia in produzione, usando test realistici, metriche legate agli obiettivi aziendali e controlli di regressione.

Errori, drift e costi vengono monitorati in modo continuo; una policy definita indica quando promuovere i casi difficili a modelli più grandi e ne misura l’impatto sul valore prodotto. La portabilità viene prevista dall’inizio: sostituire un modello con un equivalente, o spostare i carichi tra cloud, onprem e ondevice, riduce il rischio tecnico e contrattuale.

Conclusione: l’era del “giusto dimensionamento”

La narrativa pubblica dell’IA continuerà a celebrare le prodezze dei modelli di frontiera. Nelle sale macchine delle imprese sta però maturando una rivoluzione silenziosa.

La produttività misurabile, la qualità costante e la sostenibilità dei costi arrivano dall’adozione sistematica di piccoli modelli dentro catene di montaggio intelligenti. L’AGI, se e quando arriverà, non eliminerà questa realtà.

Semmai fornirà teacher, strumenti e nuove tecniche per rendere ancora più efficienti gli operai specializzati della fabbrica della conoscenza.

Il futuro dell’IA agentiva si costruisce un flusso di lavoro alla volta. E in ognuno di quei flussi, a fare davvero il lavoro, ci saranno soprattutto i modelli piccoli.

Bibliografia

• NVIDIA & Georgia Tech, “Small Language Models are the Future of Agentic AI”. arXiv (2025). [https://arxiv.org/pdf/2506.02153]

• NVIDIA Research, “Small Language Models are the Future of Agentic AI”. Sito ufficiale. [https://research.nvidia.com/labs/lpr/slm-agents/]

• Meta Engineering, “Generative Ads Model (GEM): trasferimento gerarchico e distillazione nei modelli pubblicitari”. (2025). [https://engineering.fb.com/2025/11/10/ml-applications/metas-generative-ads-model-gem]

• OpenAI, “API Pricing” e schede modelli mini/nano. (2024–2025). [https://openai.com/api/pricing/]

• Microsoft, “Phi-3: la famiglia di small language model”. Comunicati e blog ufficiali. (2024). [https://azure.microsoft.com/en-us/blog/introducing-phi-3-redefining-whats-possible-with-slms/]

• Apple Machine Learning Research, “Introducing Apple Foundation Models” e OpenELM per on-device. (2024). [https://machinelearning.apple.com/research/introducing-apple-foundation-models]

• Ars Technica, “Apple rilascia OpenELM, piccoli modelli per l’on-device”. (2024). [https://arstechnica.com/information-technology/2024/04/apple-releases-eight-small-ai-language-models-aimed-at-on-device-use/]

• Google/Android Developers, “Gemini Nano on-device con ML Kit”. (2025). [https://developer.android.com/ai/gemini-nano]

• Aurelian, “Automating non-emergency calls for 911 centers”. Sito e profilo YC. (2025). [https://www.aurelian.com/] – [https://www.ycombinator.com/companies/aurelian]

• TechRadar, “AI is coming to 911 dispatch centers… Aurelian gestisce la coda non emergenze”. (2025). [https://www.techradar.com/ai-platforms-assistants/ai-is-coming-to-911-dispatch-centers-heres-why-it-might-be-a-good-thing]

• South China Morning Post / Tech in Asia / Yahoo Finance, “Airbnb affida a Qwen l’assistenza clienti”. (2025). [https://www.scmp.com/tech/tech-trends/article/3329921/airbnb-picks-alibabas-qwen-over-chatgpt-win-chinese-open-source-ai] – [https://www.techinasia.com/news/airbnb-adopts-alibabas-qwen-ai-for-customer-service-chatbot] – [https://finance.yahoo.com/news/airbnb-picks-alibabas-qwen-over-093000045.html]

• Gong, “AI in sales: use case e analisi delle chiamate”. Blog ufficiale. (2024–2025). [https://www.gong.io/blog/ai-in-sales]

• Khattab et al., “DSPy: Compiling Declarative Language Model Calls into Self-Improving Pipelines”. ICLR (2024). [https://arxiv.org/abs/2310.03714]

• Zhang et al., “Large Language Model Cascades with MIX” e successivi lavori su routing/cascading. ICLR (2024) e seguenti. [https://proceedings.iclr.cc/paper_files/paper/2024/file/5de11e930c1bbfda5d4fc9d2b0924032-Paper-Conference.pdf]

• Wang et al., “Searching for Best Practices in Retrieval-Augmented Generation”. EMNLP (2024). [https://aclanthology.org/2024.emnlp-main.981.pdf]

• Vari lavori su PEFT/LoRA e fine-tuning efficiente, tra cui LongLoRA (ICLR 2024) e mLoRA (VLDB 2025). [https://proceedings.iclr.cc/paper_files/paper/2024/file/211ab571cc9f3802afa6ffff52ae3e5b-Paper-Conference.pdf] – [https://www.vldb.org/pvldb/vol18/p1948-tang.pdf]