Anthropic Claude Opus 4.7 cambia il lavoro, ancora una volta.

Con il lancio del 16 aprile 2026, l’azienda americana descrive questa versione come il suo miglior modello generalmente disponibile per il ragionamento complesso e il coding agentico, mentre riserva a Mythos Preview il ruolo di sistema più ampio e più sensibile sul piano della sicurezza. Opus 4.7 nasce quindi in uno spazio molto preciso: meno vetrina e più infrastruttura, meno effetto dimostrativo e più affidabilità operativa nei flussi di lavoro reali.

Indice degli argomenti

Claude Opus 4.7: non più un chatbot che risponde, ma un sistema che coordina il lavoro

Per capire la posizione di Opus 4.7 conviene allargare leggermente l’inquadratura. Negli ultimi anni i modelli di frontiera hanno smesso di essere soltanto interfacce conversazionali capaci di generare testo plausibile e sono diventati motori di orchestrazione. La risposta in linguaggio naturale resta il punto di contatto con l’utente, ma sotto quella superficie si muove sempre più spesso una catena operativa fatta di strumenti, memorie, file, browser, ambienti di esecuzione e controlli successivi sul risultato.

È in questo passaggio che il termine agentico acquista un significato concreto. Un modello non si limita più a proporre una soluzione, ma pianifica i passaggi, decide quando usare un tool, incorpora il risultato di un’azione esterna e prosegue il compito mantenendo coerenza tra obiettivo, vincoli e stato di avanzamento. Letto in questa prospettiva, Opus 4.7 non appare come un semplice incremento di qualità rispetto a Opus 4.6. Sembra piuttosto un tentativo di rafforzare il livello intermedio che oggi conta di più nei prodotti professionali, quello in cui il modello deve coordinare lavoro multi-step senza perdere precisione, memoria locale e disciplina esecutiva.

Un aggiornamento mirato, non un cambio di paradigma indiscriminato

La novità più rilevante è la specializzazione del progresso. Anthropic sostiene che Opus 4.7 migliori in modo netto rispetto a Opus 4.6 soprattutto nei compiti di software engineering avanzato, nei workflow lunghi e nella gestione di istruzioni complesse. La promessa non riguarda tanto la brillantezza estemporanea quanto la continuità dell’esecuzione: il modello dovrebbe seguire meglio le consegne, lavorare più a lungo senza deragliare e verificare i propri risultati prima di restituirli.

Questa impostazione emerge anche dai numeri diffusi al lancio. Su un benchmark interno di 93 task di coding, Anthropic parla di un aumento del 13 per cento rispetto a Opus 4.6. In un test interno per agenti di ricerca, il punteggio complessivo raggiunge 0,715 e, nel modulo General Finance, sale a 0,813 contro 0,767 del predecessore. AWS, annunciando la disponibilità del modello in Bedrock, richiama inoltre risultati del 64,3 per cento su SWE-bench Pro, dell’87,6 per cento su SWE-bench Verified e del 69,4 per cento su Terminal-Bench 2.0. Sono valori che non autorizzano confronti assoluti con ogni contesto produttivo, ma indicano una direzione chiara: Opus 4.7 è stato ottimizzato per il lavoro tecnico dove il modello deve pianificare, usare strumenti, correggersi e andare fino in fondo.

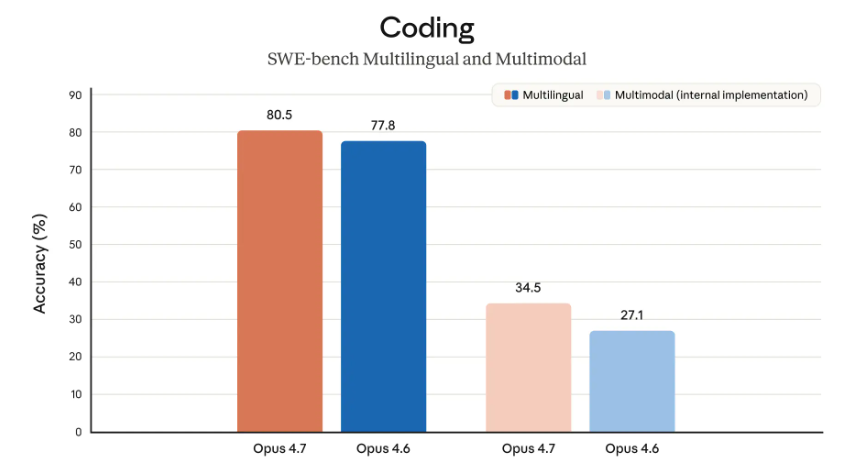

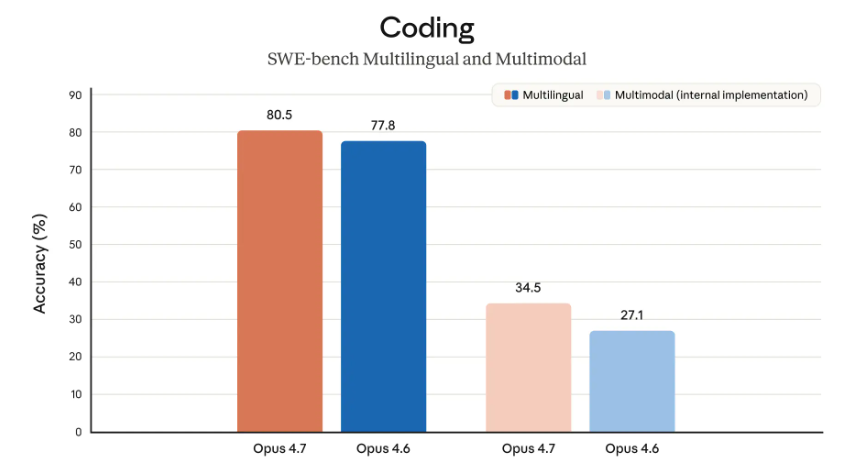

I grafici allegati al materiale di lancio aggiungono un livello di dettaglio utile anche sul coding meno standard. In SWE-bench Multilingual, Opus 4.7 sale all’80,5 per cento rispetto al 77,8 di Opus 4.6, mentre nella variante multimodale interna passa da 27,1 a 34,5. Il dato non riguarda soltanto la correzione del codice in senso stretto. Suggerisce che il modello gestisca meglio anche contesti ibridi, dove repository, testo, screenshot e altri elementi visuali concorrono alla soluzione del problema.

Figura 1. Risultati di Claude Opus 4.7 nei benchmark di coding multilingual e multimodale, con un vantaggio su Opus 4.6 in entrambe le prove. Fonte: Anthropic.

Il quadro, però, è meno trionfalistico di quanto suggerisca una lettura frettolosa del materiale di lancio, e proprio per questo appare più credibile. Opus 4.7 migliora quasi ovunque rispetto a Opus 4.6, ma non domina ogni benchmark generale. Su BrowseComp, per esempio, si ferma al 79,3 per cento, sotto a Opus 4.6, GPT-5.4 e Gemini 3.1 Pro. Su GPQA Diamond arriva al 94,2 per cento, in linea con i migliori ma non davanti a Mythos Preview, mentre su MMMLU tocca il 91,5 per cento, con un vantaggio minimo sul predecessore e un dato leggermente inferiore a Gemini 3.1 Pro. È un passaggio importante, perché aiuta a leggere Opus 4.7 non come modello migliore in assoluto, ma come modello affinato per un insieme molto preciso di compiti tecnici e agentici.

Figura 2. Confronto tra Claude Opus 4.7, Opus 4.6, GPT-5.4, Gemini 3.1 Pro e Mythos Preview su benchmark agentici, di ragionamento, visione e Q&A multilingue. Fonte: Anthropic.

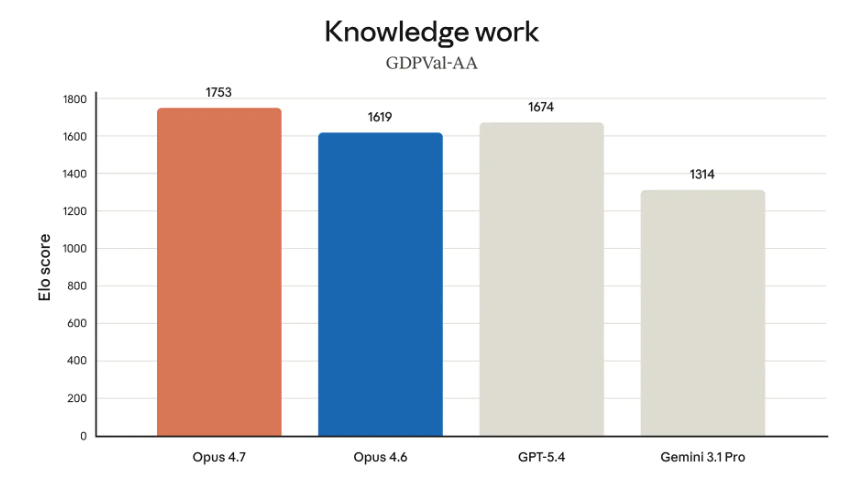

Un altro dato utile arriva dal benchmark GDPVal-AA sul knowledge work. Nel grafico allegato, Opus 4.7 raggiunge un punteggio Elo di 1753, davanti a Opus 4.6, fermo a 1619, e a Gemini 3.1 Pro, che si colloca a 1314. GPT-5.4, nel medesimo confronto, è accreditato di 1674. Anche questo risultato conferma la tesi di fondo del lancio: il modello non punta solo alla risposta brillante, ma alla qualità del lavoro intellettuale prolungato e strutturato.

Figura 3. Benchmark GDPVal-AA sul knowledge work, con Opus 4.7 davanti a Opus 4.6 e Gemini 3.1 Pro, e sopra anche a GPT-5.4 nel grafico allegato. Fonte: Anthropic.

Dove il salto Claude Opus 4.7 è più visibile: agenti, memoria e lavoro documentale

Uno degli aspetti più interessanti di Opus 4.7 è che Anthropic lo descrive come un modello più adatto alla continuità operativa. In altre parole, non solo risponde meglio a una richiesta, ma conserva più efficacemente appunti, contesto e memoria di lavoro quando un agente deve attraversare più sessioni o più passaggi. La documentazione tecnica parla esplicitamente di miglioramenti nell’uso di memorie basate su file system, una scelta che guarda ai sistemi agentici reali più che alla chat isolata.

Questo punto aiuta anche a leggere meglio il modo in cui oggi vengono integrate le funzioni agentiche nei modelli di punta. Non si tratta di un modulo separato aggiunto a valle, ma di una combinazione tra capacità del modello e infrastruttura del prodotto. Il modello interpreta il compito, valuta se serve un’azione esterna, richiama uno strumento, riceve un output strutturato e lo usa per decidere il passo successivo. Quando Anthropic insiste su memoria, tool use e self-verification, sta quindi descrivendo la qualità di questa catena decisionale più che una generica abilità conversazionale.

Anche il lavoro documentale riceve un trattamento particolare. Anthropic sostiene che Opus 4.7 sia più solido nella revisione di file .docx, nella modifica di presentazioni e nell’analisi di grafici o figure tramite tool calling. È un segnale da non sottovalutare. La corsa dei modelli più avanzati non passa più soltanto dal testo generico, ma dalla capacità di intervenire su artefatti professionali, dove contano formattazione, controlli incrociati, coerenza tra parti diverse del materiale e rispetto dei vincoli.

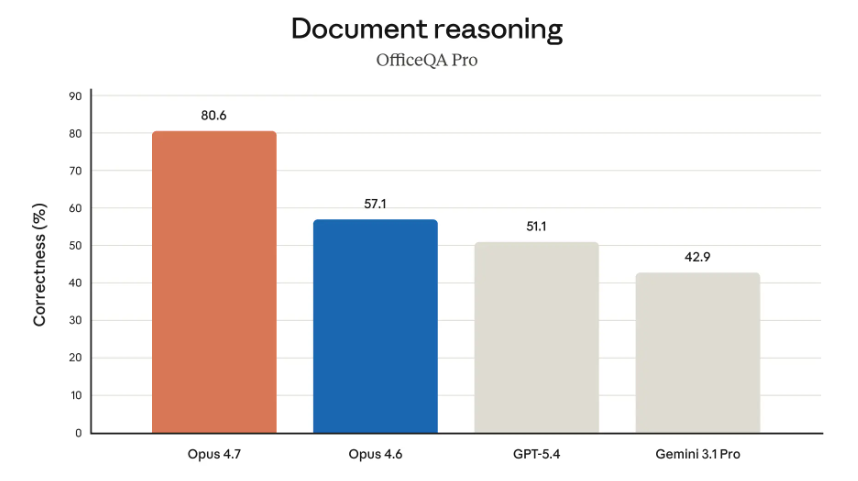

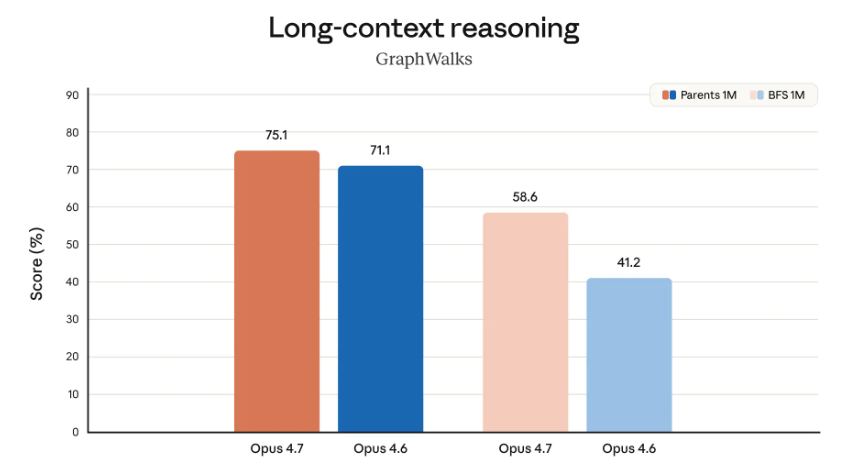

I benchmark mostrati nelle immagini vanno nella stessa direzione. Su OfficeQA Pro, dedicato al ragionamento documentale, Opus 4.7 è accreditato dell’80,6 per cento, contro il 57,1 di Opus 4.6, il 51,1 di GPT-5.4 e il 42,9 di Gemini 3.1 Pro. Su GraphWalks, pensato per misurare il ragionamento a lunghissimo contesto, passa da 71,1 a 75,1 nel setting Parents 1M e da 41,2 a 58,6 nel setting BFS 1M. Letti insieme, questi numeri suggeriscono un miglioramento che non si limita alla precisione locale, ma investe anche la capacità di inseguire dipendenze sparse in finestre molto estese.

Figura 4. Benchmark OfficeQA Pro sul document reasoning, dove Opus 4.7 mostra un vantaggio netto rispetto a Opus 4.6, GPT-5.4 e Gemini 3.1 Pro. Fonte: Anthropic.

Figura 5. Benchmark GraphWalks sul ragionamento a lungo contesto, con miglioramenti di Opus 4.7 rispetto a Opus 4.6 sia nel setting Parents 1M sia nel setting BFS 1M. Fonte: Anthropic.

La visione non è un dettaglio, è una leva di prodotto

Il miglioramento più concreto, e forse meno appariscente nel dibattito pubblico, riguarda la visione. Claude Opus 4.7 è il primo modello Claude con supporto nativo a immagini ad alta risoluzione fino a 2.576 pixel sul lato lungo, circa 3,75 megapixel. Il limite precedente era 1.568 pixel, pari a circa 1,15 megapixel. Per Anthropic non si tratta di una finezza tecnica, ma di una modifica strutturale che apre casi d’uso nuovi o più affidabili.

Un agente che legge screenshot densi, interfacce complesse, diagrammi tecnici o documenti visivi beneficia infatti non solo di una maggior nitidezza, ma di un rapporto più preciso tra coordinate e pixel. La documentazione sottolinea proprio questo aspetto, spiegando che in Opus 4.7 la mappatura è 1:1 con i pixel reali. Per chi sviluppa sistemi di computer use, automazione visuale o analisi di grafici, è un dettaglio che diventa immediatamente operativo.

Anche qui, però, il vantaggio non è gratuito. Più risoluzione significa più token. Anthropic suggerisce esplicitamente di ridurre la definizione delle immagini quando non serve il massimo dettaglio. È una raccomandazione pratica che aiuta a leggere tutto il lancio con il giusto realismo. Opus 4.7 offre più capacità, ma chiede anche più disciplina ingegneristica nella gestione del costo.

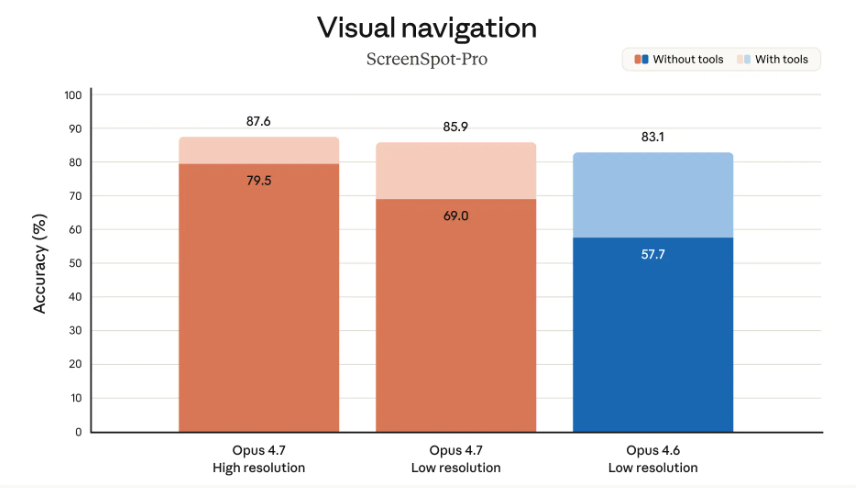

L’effetto si vede bene anche nei test di navigazione visiva. Su ScreenSpot-Pro, Opus 4.7 raggiunge il 79,5 per cento senza strumenti e l’87,6 con strumenti nel setting ad alta risoluzione. Nella configurazione a bassa risoluzione scende a 69,0 e 85,9, mentre Opus 4.6, sempre a bassa risoluzione, si ferma a 57,7 e 83,1. La differenza tra i due assetti mostra che la nuova pipeline visiva non è un semplice incremento quantitativo, ma un fattore che incide direttamente sulla capacità di localizzare elementi, leggere interfacce dense e agire con precisione.

Figura 6. Benchmark ScreenSpot-Pro sulla navigazione visiva, con confronto tra Opus 4.7 ad alta e bassa risoluzione e Opus 4.6 a bassa risoluzione, sia senza strumenti sia con strumenti. Fonte: Anthropic.

Per gli sviluppatori cambia anche il modo di usare l’API

L’altra faccia del lancio è meno visibile al grande pubblico, ma decisiva per chi integra il modello in produzione. Opus 4.7 mantiene una finestra di contesto da 1 milione di token e supporta fino a 128 mila token in output, senza sovrapprezzo per il long context. In compenso introduce una serie di cambiamenti che obbligano a rivedere codice, harness e abitudini operative.

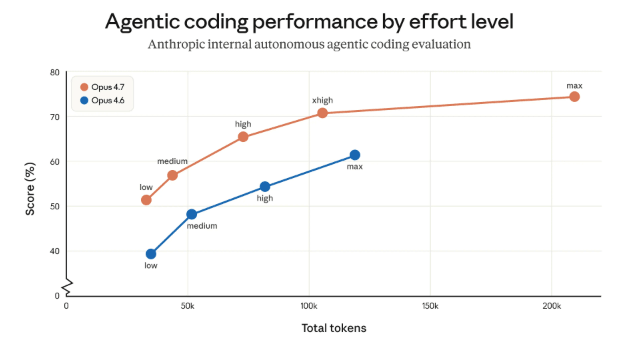

Il primo è l’affermazione definitiva dell’adaptive thinking. La modalità con budget manuale dei token di ragionamento non è più accettata e restituisce errore. Al suo posto arriva una logica adattiva, accompagnata da un nuovo livello di effort, xhigh, collocato tra high e max. Anthropic lo propone come impostazione consigliata per coding e casi agentici, cioè per quei compiti in cui serve una riflessione più profonda ma si vuole evitare il costo eccessivo o i possibili effetti di overthinking del livello massimo.

Il grafico interno sull’agentic coding per livello di effort rende visibile questa logica. Opus 4.7 supera il predecessore in ogni gradino di ragionamento e amplia il divario man mano che il budget cresce. L’introduzione di xhigh ha quindi un significato operativo concreto: offre uno scalino intermedio che sembra migliorare il rapporto tra prestazioni e consumo, invece di costringere gli sviluppatori a scegliere soltanto tra un profilo alto e uno massimo.

Figura 7. Prestazioni di Claude Opus 4.7 nell’agentic coding in funzione del livello di effort e del numero totale di token, con confronto diretto con Opus 4.6. Fonte: Anthropic.

Il secondo cambiamento riguarda i parametri classici di campionamento. Con Opus 4.7, impostare temperature, top_p o top_k a valori non di default genera un errore. È una scelta controcorrente rispetto ad altri ecosistemi, perché sottrae controllo fine a chi usava questi parametri per irrigidire o modulare il comportamento del modello. Anthropic suggerisce di guidare l’output soprattutto tramite prompting e configurazione dell’effort. È una filosofia che accentua l’idea del modello come sistema più opinionato sul piano operativo.

Il terzo elemento è l’introduzione dei task budgets in beta. Qui l’azienda prova a dare agli sviluppatori uno strumento per contenere la spesa complessiva lungo un intero loop agentico, includendo pensiero, chiamate agli strumenti, risultati e output finale. Non è solo una funzione di ottimizzazione economica. È il tentativo di trasformare il budget di token in un vincolo cognitivo esplicito, quasi una forma di gestione delle risorse interne dell’agente.

Prezzo Claude Opus 4.7 nominale invariato, costo reale da misurare

Sul listino, Opus 4.7 non cambia rispetto a Opus 4.6. Il prezzo resta di 5 dollari per milione di token in input e 25 dollari per milione di token in output. La novità, però, è che il tokenizer è stato aggiornato e la stessa porzione di testo può tradursi in un consumo compreso tra 1 e 1,35 volte rispetto al modello precedente. In pratica, il prezzo unitario è identico, ma il costo effettivo di alcuni workload può aumentare.

Anthropic sostiene che il bilancio finale, nelle sue valutazioni interne, resti favorevole grazie a una migliore efficienza complessiva. Alcuni rilievi indipendenti diffusi da Artificial Analysis vanno nella stessa direzione su test sintetici, segnalando miglioramenti nell’indice complessivo e una riduzione delle allucinazioni. Ma il punto decisivo resta un altro. Opus 4.7 non va giudicato sulla tariffa teorica. Va misurato sul traffico reale, sui prompt reali e soprattutto sulle traiettorie lunghe, dove effort, memoria e uso degli strumenti incidono più del prezzo nominale per token.

Dai benchmark scientifici alla coerenza di lungo periodo

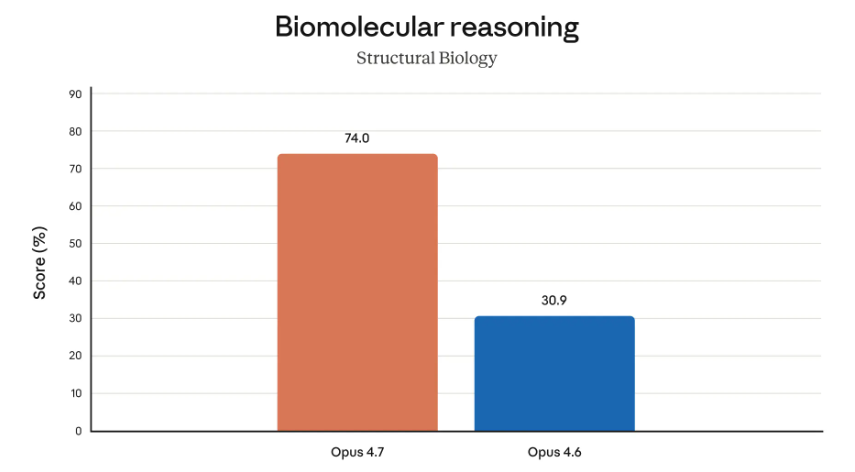

Tra i grafici allegati ce n’è uno meno appariscente ma molto rivelatore. Nel benchmark di biomolecular reasoning dedicato alla Structural Biology, Opus 4.7 passa da 30,9 a 74,0 rispetto a Opus 4.6. È un salto troppo ampio per essere liquidato come semplice rumore statistico e suggerisce che gli aggiustamenti del modello abbiano migliorato la capacità di trattare contesti tecnico-scientifici fortemente vincolati, dove la fluidità linguistica conta meno della coerenza interna dell’inferenza.

Figura 8. Benchmark di biomolecular reasoning in Structural Biology, con un incremento molto marcato di Opus 4.7 rispetto a Opus 4.6. Fonte: Anthropic.

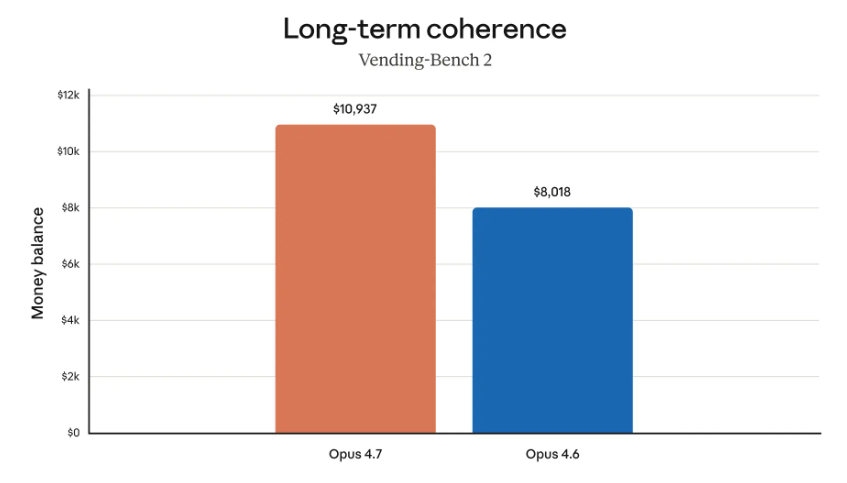

Qualcosa di simile emerge da Vending-Bench 2, usato per misurare la coerenza di lungo periodo in un compito economico simulato. Qui Opus 4.7 chiude con un saldo di 10.937 dollari contro 8.018 di Opus 4.6. Il valore assoluto va letto con prudenza, perché dipende dal setup del benchmark, ma il segnale è chiaro: il modello sembra conservare meglio strategia, vincoli e obiettivi quando l’interazione si prolunga molto oltre la singola richiesta.

Figura 9. Risultato di Opus 4.7 in Vending-Bench 2, usato per misurare la coerenza di lungo periodo, con saldo finale superiore rispetto a Opus 4.6. Fonte: Anthropic.

Sicurezza e cybersecurity, il convitato di pietra del lancio

Il contesto del rilascio aiuta a capire perché Anthropic abbia insistito tanto sulla distinzione tra Opus 4.7 e Mythos Preview. L’azienda aveva già segnalato, con Project Glasswing, la volontà di testare nuovi meccanismi di difesa su modelli meno capaci prima di allargare l’accesso a sistemi con competenze cyber più spinte. Opus 4.7 diventa così un banco di prova tecnico e politico insieme.

Anthropic afferma di aver introdotto filtri automatici per identificare e bloccare richieste che suggeriscano usi cybersecurity vietati o ad alto rischio, lasciando però una via di accesso verificata ai professionisti della sicurezza tramite il Cyber Verification Program. Nello stesso tempo, l’azienda dichiara che il profilo di sicurezza del modello resta simile a quello di Opus 4.6, con miglioramenti in onestà e resistenza al prompt injection maligno, ma qualche debolezza relativa in specifiche categorie di risposta sensibile.

Un altro grafico del pacchetto di lancio indica inoltre una riduzione del punteggio di misaligned behavior rispetto a Opus 4.6, pur senza raggiungere il profilo più cauto attribuito a Mythos Preview. È un dettaglio rilevante, perché conferma che Anthropic non sta proponendo Opus 4.7 come il suo modello più avanzato in senso assoluto, ma come un equilibrio tra capacità operativa, produttività e contenimento del rischio.

Figura 10. Confronto sul misaligned behavior tra Opus 4.7, Opus 4.6, Sonnet 4.6 e Mythos Preview, con un profilo di rischio in miglioramento ma non allineato a quello del modello più prudente. Fonte: Anthropic.

Claude Opus 4.7: più che un modello brillante, un modello da mettere al lavoro

Claude Opus 4.7 non sembra voler vincere la gara della meraviglia istantanea. La sua ambizione è più concreta e, per certi versi, più significativa. Anthropic sta cercando di costruire un modello che renda meno fragile il passaggio dall’assistente conversazionale all’agente operativo, capace di leggere codice, manipolare documenti, gestire strumenti, usare memoria e lavorare con continuità dentro processi professionali complessi.

In questo senso il rilascio riflette anche un cambiamento più ampio dell’industria. La competizione non si gioca più soltanto sulla brillantezza della risposta singola, ma su come il modello si inserisce in una pipeline di lavoro e su quanta supervisione umana richiede quando deve operare per più passaggi consecutivi. Opus 4.7 prova a presidiare proprio questo spazio: meno assistente che conversa, più componente software che coordina strumenti e decisioni dentro flussi tecnici reali.

È qui che si giocherà il valore del rilascio. Se i miglioramenti annunciati terranno anche fuori dai benchmark proprietari, Opus 4.7 potrebbe consolidare l’idea che il vero terreno competitivo dei modelli del 2026 non sia la risposta migliore in una singola interazione, ma la qualità del lavoro che riescono a sostenere per decine di passaggi senza perdere precisione, disciplina e contesto.

Bibliografia

Anthropic, Introducing Claude Opus 4.7 — https://www.anthropic.com/news/claude-opus-4-7

Anthropic, Claude Opus 4.7 — https://www.anthropic.com/claude/opus

Anthropic Claude Docs, Models overview — https://platform.claude.com/docs/en/about-claude/models/overview

Anthropic Claude Docs, What’s new in Claude Opus 4.7 — https://platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

Anthropic Claude Docs, Migration guide — https://platform.claude.com/docs/en/about-claude/models/migration-guide

Anthropic Claude Docs, Extended thinking — https://platform.claude.com/docs/en/build-with-claude/extended-thinking

Anthropic Claude Docs, Pricing — https://platform.claude.com/docs/en/about-claude/pricing

AWS News Blog, Introducing Anthropic’s Claude Opus 4.7 model in Amazon Bedrock — https://aws.amazon.com/blogs/aws/introducing-anthropics-claude-opus-4-7-model-in-amazon-bedrock/

Artificial Analysis, Opus 4.7: Everything you need to know — https://artificialanalysis.ai/articles/opus-4-7-everything-you-need-to-know