Il dato che attira subito l’attenzione è la scala: 1.600 miliardi di parametri nella versione Pro, con 49 miliardi attivati per token. Eppure la parte più interessante del rilascio di DeepSeek V4, il modello open weight cinese, non è la dimensione del modello. È il tentativo, più concreto e industriale, di trasformare il contesto da un milione di token da dimostrazione tecnica a funzione utilizzabile in modo ordinario, senza rendere ogni richiesta un esercizio proibitivo di memoria, latenza e costo computazionale.

Presentato il 24 aprile 2026 in versione preview, DeepSeek V4 arriva in due varianti, Pro e Flash, entrambe pubblicate con pesi aperti e licenza MIT secondo la documentazione disponibile su Hugging Face.

La prima è orientata a ragionamento, programmazione e compiti agentici di lunga durata. La seconda riduce la scala a 284 miliardi di parametri totali, 13 miliardi attivi, e punta su velocità ed economia d’uso. Dietro questa divisione non c’è solo una scelta commerciale.

C’è una lettura precisa della fase attuale dell’intelligenza artificiale generativa: i grandi modelli non vengono più misurati soltanto sulla qualità della singola risposta, ma sulla capacità di reggere interazioni lunghe, multi-step, con strumenti, codice e documenti estesi.

Indice degli argomenti

DeepSeek V4 , una preview che sposta il baricentro dei modelli a pesi aperti

DeepSeek descrive V4 come una famiglia di modelli Mixture-of-Experts. V4-Pro conta 1.600 miliardi di parametri totali, mentre V4-Flash si ferma a 284 miliardi. In entrambi i casi, la finestra di contesto dichiarata è di un milione di token, valore che l’azienda indica come standard sui propri servizi ufficiali. È un passaggio rilevante perché cambia il perimetro d’uso: non si tratta solo di inserire più testo in un prompt, ma di mantenere abbastanza memoria operativa da rendere più credibili sessioni lunghe di sviluppo software, revisione documentale, analisi scientifica o automazione aziendale.

Un contesto di queste dimensioni può includere repository quasi interi, fascicoli complessi, lunghi log di sistema, manuali tecnici o sequenze estese di interazioni tra agente e strumenti. Il beneficio, almeno in teoria, non è quantitativo in senso banale. Il modello può conservare più informazioni lungo il percorso, riducendo la necessità di comprimere tutto in riassunti intermedi o di affidarsi continuamente a recuperi esterni. Resta però una condizione essenziale: il contesto lungo è utile solo se il modello riesce a consultarlo senza degradare in modo significativo tempi di risposta, costi e precisione.

Il rilascio include versioni base e instruct delle due varianti. La documentazione tecnica segnala anche l’uso di accorgimenti di precisione numerica, tra cui quantizzazione FP4 per i pesi esperti MoE, con l’obiettivo di contenere memoria e calcolo. La licenza MIT rende il rilascio particolarmente permissivo rispetto a molti modelli concorrenti, anche se la disponibilità dei pesi non equivale, da sola, a piena trasparenza sui dati di addestramento o sulle condizioni effettive di deployment.

Il vero limite dei modelli lunghi è la KV cache

La novità più sostanziale riguarda l’attenzione. Nei transformer tradizionali, l’aumento della lunghezza del contesto fa crescere in modo pesante il costo computazionale e la KV cache, cioè la memoria che conserva chiavi e valori dei token precedenti per riutilizzarli durante la generazione. Per un agente che consulta strumenti, riceve output dal terminale, modifica file e continua a ragionare, questa cache diventa rapidamente uno dei principali colli di bottiglia.

DeepSeek V4 introduce una forma di hybrid attention che combina Compressed Sparse Attention e Heavily Compressed Attention. La prima comprime le entry key-value e poi seleziona in modo sparso i blocchi più rilevanti per ciascuna query. La seconda applica una compressione più aggressiva e mantiene un’attenzione densa su una sequenza ormai molto più corta. In altre parole, il modello non assegna la stessa granularità a tutto il passato: preserva dettaglio dove serve e condensa informazione dove il costo sarebbe sproporzionato.

Secondo il technical report, nel caso di un contesto da un milione di token V4-Pro richiede il 27 per cento dei FLOPs per token singolo e il 10 per cento della KV cache rispetto a DeepSeek V3.2. V4-Flash scende ulteriormente, al 10 per cento dei FLOPs e al 7 per cento della cache. Sono numeri dichiarati dal produttore e vanno letti come tali, ma sono coerenti con la direzione architetturale del progetto e spiegano perché DeepSeek presenti il milione di token non come un accessorio, bensì come infrastruttura di base.

Il modello conserva elementi già noti della linea DeepSeek, tra cui DeepSeekMoE e la strategia di multi-token prediction. A questi aggiunge Manifold-Constrained Hyper-Connections, pensate per rafforzare le connessioni residue, e l’ottimizzatore Muon, indicato dagli autori come strumento per migliorare convergenza e stabilità. La fase di pre-training viene descritta su oltre 32.000 miliardi di token complessivi, con circa 32.000 miliardi per Flash e 33.000 miliardi per Pro, includendo codice, matematica, documenti lunghi, contenuti scientifici e materiale multilingue.

DeepSeek V4 Pro e Flash raccontano due modi diversi di spendere calcolo

La distinzione fra Pro e Flash non è soltanto una differenza di dimensione. È una distinzione fra due economie del ragionamento. Pro è il modello da attivare quando la qualità su compiti difficili giustifica un costo più alto, soprattutto in coding, matematica, analisi documentale e workflow agentici. Flash sembra invece progettato per i casi in cui il rapporto fra costo, velocità e prestazioni conta più dell’ultimo punto percentuale sui benchmark.

Nelle API ufficiali, entrambi i modelli supportano modalità thinking e non-thinking. La documentazione prevede anche un controllo dello sforzo di ragionamento, con livelli high e max, e un output massimo dichiarato fino a 384.000 token. Questa impostazione colloca V4 nel filone dei modelli che separano la risposta finale da una traccia di reasoning gestita a livello API, con implicazioni operative non banali quando entrano in gioco tool call, conversazioni multi-turn e agenti software.

Il posizionamento economico è aggressivo soprattutto per Flash. I prezzi ufficiali indicano 0,14 dollari per milione di token in input senza cache hit e 0,28 dollari per milione di token in output. Pro è più costoso e, al momento del rilascio, viene offerto con uno sconto temporaneo del 75 per cento fino al 5 maggio 2026, con 0,435 dollari per milione di token in input senza cache hit e 0,87 dollari in output. Il listino pieno indicato è pari a 1,74 e 3,48 dollari. Il messaggio è piuttosto chiaro: Flash deve diventare il modello quotidiano, Pro quello da usare quando il problema richiede più capacità.

Un dettaglio operativo riguarda la migrazione. DeepSeek comunica che i vecchi nomi deepseek-chat e deepseek-reasoner saranno ritirati dopo il 24 luglio 2026 e, nel periodo di transizione, instradati rispettivamente verso le modalità non-thinking e thinking di V4-Flash. Per chi ha integrato le API in prodotti esistenti, il passaggio a V4 non è quindi solo un aggiornamento opzionale, ma una scadenza tecnica già fissata.

DeepSeek V4: benchmark solidi sulla carta, ma da verificare sul campo

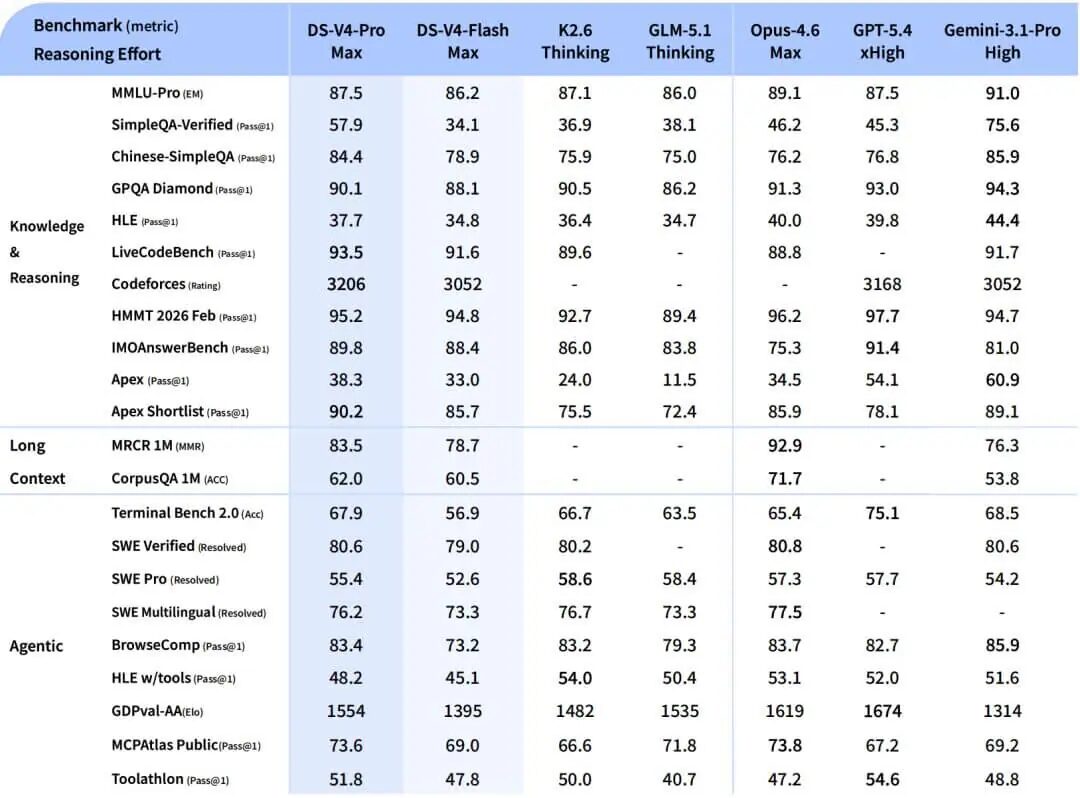

Le valutazioni pubblicate da DeepSeek collocano V4-Pro-Max, cioè la modalità a massimo sforzo di ragionamento di V4-Pro, fra i sistemi a pesi aperti più competitivi. La model card e il technical report riportano risultati elevati in coding, compiti STEM, benchmark agentici e prove di lungo contesto, compresi LiveCodeBench, Codeforces, SWE Verified, Terminal Bench 2.0, MRCR 1M e CorpusQA 1M. Sono dati importanti, perché combinano ragionamento, programmazione e capacità di lavorare su input molto estesi, ma restano in larga misura legati ai protocolli dichiarati dall’azienda.

L’analisi indipendente di Artificial Analysis offre un quadro più utile per ridurre l’effetto annuncio. Al momento della pubblicazione, V4-Pro in modalità Max Effort viene indicato come il secondo modello reasoning a pesi aperti nell’Intelligence Index della società, dietro Kimi K2.6, e mostra un progresso netto rispetto a DeepSeek V3.2. La stessa analisi evidenzia però due limiti rilevanti: un costo complessivo di valutazione più alto rispetto a diversi concorrenti open weight, dovuto anche all’uso elevato di token in output, e un tasso di allucinazione molto alto nel benchmark AA-Omniscience. È un punto delicato. Un modello capace di gestire contesti lunghissimi e workflow agentici può diventare molto efficace, ma può anche amplificare errori quando non riconosce con sufficiente affidabilità ciò che non sa.

DeepSeek riconosce alcuni margini di miglioramento nel proprio technical report. L’architettura viene presentata come potente ma complessa, con componenti introdotti anche per mitigare instabilità di training non ancora pienamente comprese. Inoltre V4 resta un modello solo testo: non offre capacità native multimodali, un’assenza significativa in una fase in cui molte piattaforme frontier integrano testo, immagini, audio e video.

DeepSeek V4 usa chip Huawei. Nvidia e la geopolitica dell’inferenza

Il rilascio di V4 ha una dimensione industriale che va oltre i benchmark. Reuters ha riportato che il modello è stato adattato alla tecnologia dei chip Huawei Ascend e che Huawei ha dichiarato il supporto alla serie V4 sui propri cluster Ascend 950. Secondo la stessa ricostruzione, chip Huawei sarebbero stati usati per una parte del training di V4-Flash. È un passaggio coerente con la spinta cinese verso maggiore autonomia nell’infrastruttura AI, soprattutto in un contesto segnato dai controlli statunitensi sull’export di acceleratori avanzati.

Il quadro, però, non è lineare. Nvidia non è fuori dei giochi qui. Ha reso disponibili indicazioni ed endpoint GPU-accelerati per sperimentare DeepSeek V4 sulle proprie piattaforme, presentando il modello come un carico di lavoro rilevante per inferenza a contesto lungo e agenti software. V4 diventa così, allo stesso tempo, un simbolo della maturazione dell’ecosistema cinese e un modello che l’infrastruttura statunitense vuole supportare rapidamente. La competizione si sposta dal solo addestramento alla capacità di servire modelli enormi con costi, latenza e affidabilità sostenibili.

Questa è forse la parte più concreta della novità. Se i benchmark misurano l’intelligenza in condizioni controllate, le aziende misureranno V4 sulla continuità del servizio, sulla qualità delle risposte a contesto pieno, sull’integrazione con strumenti reali, sui costi di cache e sulla governance dei dati. Un milione di token è utile solo se non rende opaca l’interazione, non manda fuori controllo la fatturazione e non trasforma la memoria lunga in una fonte di errori difficili da isolare.

DeepSeek V4: un passo importante, non una sentenza definitiva

DeepSeek V4 segna un passaggio significativo per i modelli a pesi aperti. Non perché chiuda automaticamente la distanza con tutti i sistemi proprietari più avanzati, ma perché rende più credibile una direzione tecnica precisa: modelli capaci di lavorare più a lungo, con più memoria operativa e con minori costi marginali del contesto. È una traiettoria particolarmente importante per agenti di programmazione, analisi scientifica, automazione documentale e workflow aziendali complessi.

La prudenza resta necessaria. Le prestazioni dichiarate dovranno essere verificate da una comunità più ampia, soprattutto su compiti reali, dataset non contaminati e scenari in cui il modello deve ammettere l’incertezza senza costruire risposte plausibili ma false. La disponibilità dei pesi e una licenza permissiva sono vantaggi notevoli, ma non sostituiscono trasparenza completa sui dati, valutazioni indipendenti robuste e pratiche di deployment responsabili.

Se DeepSeek V4 manterrà nelle implementazioni quotidiane ciò che promette nel technical report, il suo impatto potrebbe essere meno spettacolare di un record da benchmark e più profondo: trasformare il lungo contesto da funzione premium a componente ordinaria dell’infrastruttura AI. È lì, più che nella sola classifica dei modelli, che si giocherà la reale utilità della nuova generazione di sistemi generativi.

Bibliografia

DeepSeek API Docs — DeepSeek V4 Preview Release, 24 aprile 2026

DeepSeek-AI — DeepSeek-V4: Towards Highly Efficient Million-Token Context Intelligence, technical report su Hugging Face

DeepSeek-AI — DeepSeek-V4-Pro, model card su Hugging Face

DeepSeek API Docs — Models & Pricing

DeepSeek API Docs — Thinking Mode

Hugging Face Blog — DeepSeek-V4: a million-token context that agents can actually use

Artificial Analysis — DeepSeek is back among the leading open weights models with V4 Pro and V4 Flash

Reuters — DeepSeek-V4, the Chinese AI model adapted for Huawei chips

Nvidia Technical Blog — Build with DeepSeek V4 Using NVIDIA Blackwell and GPU-Accelerated Endpoints