DLSS 5 di Nvidia è davvero il futuro della grafica fotorealistica, come ho potuto vedere di persona all’evento dell’azienda negli Stati Uniti. Questa tecnologia per il rendering di scene 3D si presenta come il il più grande punto di svolta nel settore dopo l’introduzione del raytracing realtime otto anni fa.

Ma di cosa si tratta? Ed è davvero così rivoluzionario? E cosa vuol dire che ora il rendering è fatto da reti neurali e AI generativa?

Cerchiamo di capire di cosa si tratta e quali novità porta questa tecnologia al di là degli evidenti miglioramenti che Jensen Huang di Nvidia ha sapientemente mostrato sul palco con esempi di rendering con e senza il DLSS 5 attivo o meno.

Indice degli argomenti

La tecnologia DLSS 5 di Nvidia

Come lascia intendere il numero di versione si tratta della quinta generazione della tecnologia DLSS, la vedremo entro la fine dell’anno, ma solo pochi mesi fa sempre Huang aveva annunciato al CES 2026 la disponibilità della versione 4.5. Ma di cosa si tratta? E perché questa nuova generazione è così rivoluzionaria?

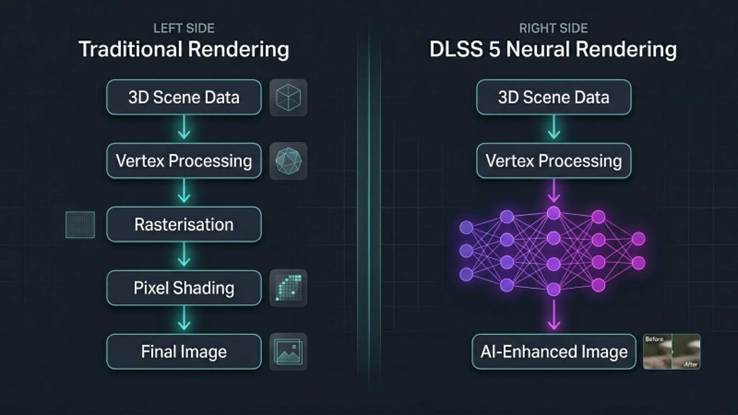

Innanzitutto cominciamo dal nome: DLSS sta per Deep Learning Super Sampling, è quindi una tecnica che serve a supportare il rendering di scene ad alta risoluzione effettuando la prima fase del rendering a più bassa risoluzione (ad esempio renderizzando un frame FullHD) per poi usare reti neurali per fare l’upscaling a piena risoluzione (ad esempio 4K).

Si potrebbe quindi pensare che la tecnologia si limiti a fare un ridimensionamento dell’immagine senza sgranare riducendo il costo computazionale del rendering 3D che richiede un costo significativo per calcolare ogni singolo pixel di una scena. Ma come testimoniano i confronti tra frame visualizzati con DLSS 5 attivo o meno è evidente come non si tratti di un semplice resize di immagini.

Una rete neurale riceve in input il frame corrente renderizzato a più bassa risoluzione, i frame precedenti, i motion vector degli oggetti visualizzati e il depth buffer (un’area di memoria che associa la profondità dalla camera virtuale per ogni pixel). La DNN restituisce un fotogramma a più alta risoluzione in cui molti dettagli sono ricostruiti e non semplicemente scalati.

La prima generazione di questa tecnologia aveva un po’ deluso, ma già dalla seconda generazione i risultati sono arrivati. La terza generazione di DLSS ha introdotto la generazione di frame intermedi così che un gioco può raddoppiare il framerate a parità di fotogrammi renderizzati dalle strutture dati 3D. La versione 3.5 ha cambiato in parte l’uso del ray tracing ricostruendo in parte luce e riflessi grazie all’AI. La generazione 4 ha consolidato la tecnologia migliorando i dettagli e riducendo significativamente gli artefatti dovuti all’allucinazione del modello nurale.

E quindi qual è la novità della quinta generazione? Se fino alla quarta generazione la tecnologia si limitava a lavorare sui frame migliorando la qualità del fotogramma finale la nuova generazione è capace di aggiungere dettagli ad un frame incompleto, andando per la prima volta dopo molti anni ad alterare il comportamento di pixel e vertex shader aggiungendo dettagli generati, materiali più fotorealistici ed illuminazione plausibile (non necessariamente dettata dalle leggi della fisica).

Una nuova pipeline di rendering

Il neural rendering introdotto da DLSS 5 rappresenta quindi un vero e proprio cambio di paradigma: il processo di rendering 3D non si limita a simulare un’approssimazione dell’equazione di rendering e quindi delle leggi della fisica, ma si usa un modello di AI per completare un rendering incompleto sfruttando la conoscenza del modello del mondo reale.

Affidare la visualizzazione di un’immagine fotorealistica a partire dalla descrizione 3D del mondo ad una rete neurale non può non far pensare a Sam Altman che mentre annunciava il modello Sora indicava il successo nella generazione di un video nell’aver insegnato all’AI la fisica del mondo così che il modello potesse generare fotogrammi coerenti e compatibili con l’evoluzione fisica del mondo avendo appreso, almeno qualitativamente, le leggi della fisica rilevanti alla simulazione di una videocamera che riprende una scena.

I cambiamenti delle GPU per il DLSS 5

Questo salto architetturale non è solo algoritmico, già ora la serie RTX delle schede di nVidia supporta in hardware una parte delle operazioni eseguite dal DLSS, ma Jensen ha lasciato intendere che assisteremo a cambiamenti architetturali delle GPU per supportare la nuova architettura di rendering. E si possono pensare cambiamenti drastici: magari riducendo le unità capaci di effettuare calcoli in virgola mobile a singola e doppia precisione in favore di precisioni più basse, non adatte ai calcoli dei rendering 3D ma assolutamente centrali nell’inferenza dei modelli AI.

Impatti di DLSS sullo sviluppo e applicazioni

Il cambiamento del modello di rendering è significativo e c’è già chi si interroga sulla perdita di controllo da parte dei programmatori: come si potrà evitare che le immagini generate, seppur più fotorealistiche, potrebbero avere dettagli in comune portando ad un’omogeneizzazione dei rendering, con potenziali bias introdotti dal modello. Non resta che attendere il rilascio previsto per la fine dell’anno per capire gli impatti reali di questa nuova architettura.

Sicuramente GPU lato client capaci di eseguire modelli AI per il DLSS 5 potrebbero anche aprire ad una più efficiente esecuzione di modelli LLM locali a cui tutti ci stiamo preparando.

Resta il fatto che sembra essere assolutamente fondata l’affermazione di Huang a proposito del “GPT Moment” della grafica 3D: se tenessi ancora il corso di Programmazione di interfacce grafiche che ho tenuto per tanti anni presso la laurea triennale in Informatica all’Università di Pisa dovrei rivedere in modo significativo le lezioni dedicate alla pipeline di rendering 3D includendo il neural rendering.

DLSS 5, le polemiche nascono dal confine tra rendering e filtro

DLSS 5 ha attirato anche critiche a livello internazionale.

Il caso nasce dallo scarto tra la promessa iniziale e i dettagli emersi dopo il lancio.

Al GTC del 16 marzo 2026 Nvidia ha presentato la tecnologia come un modello di neural rendering capace di aggiungere illuminazione e materiali fotorealistici ai giochi, con debutto previsto nell’autunno 2026.

Il 20 marzo Jacob Freeman, tra i volti della divisione GeForce, ha però chiarito che l’algoritmo lavora su un frame 2D già renderizzato insieme ai motion vectors: non legge direttamente geometrie 3D, profondità o proprietà dei materiali, che vengono invece dedotte dall’immagine finale.

Qui si concentra la contestazione. Se il modello ricostruisce pelle, capelli o superfici partendo dal fotogramma finito, l’output può allontanarsi dalla resa voluta dallo studio. Nvidia replica che la geometria di base resta invariata e che gli sviluppatori avranno controlli su intensità, color grading e maschere per limitare l’intervento dell’AI. Il punto, per i critici, è che quei controlli arrivano dopo la reinterpretazione del frame e non offrono un modo diretto per correggere ogni dettaglio generato.

La polemica riguarda anche il margine di autonomia degli autori quando un algoritmo comincia a riscrivere luci, materiali e tratti dei volti. Alcuni sviluppatori indipendenti hanno parlato di un rischio per l’identità estetica dei giochi, mentre altri vedono nel DLSS 5 un passaggio tecnico destinato a maturare.

Nvidia insiste sul fatto che la scelta resterà nelle mani degli studi. La verifica vera arriverà quando la tecnologia uscirà dalle demo e finirà nei giochi completi, dove ogni differenza rispetto alla direzione artistica sarà molto più difficile da archiviare come semplice effetto collaterale.

Redazione