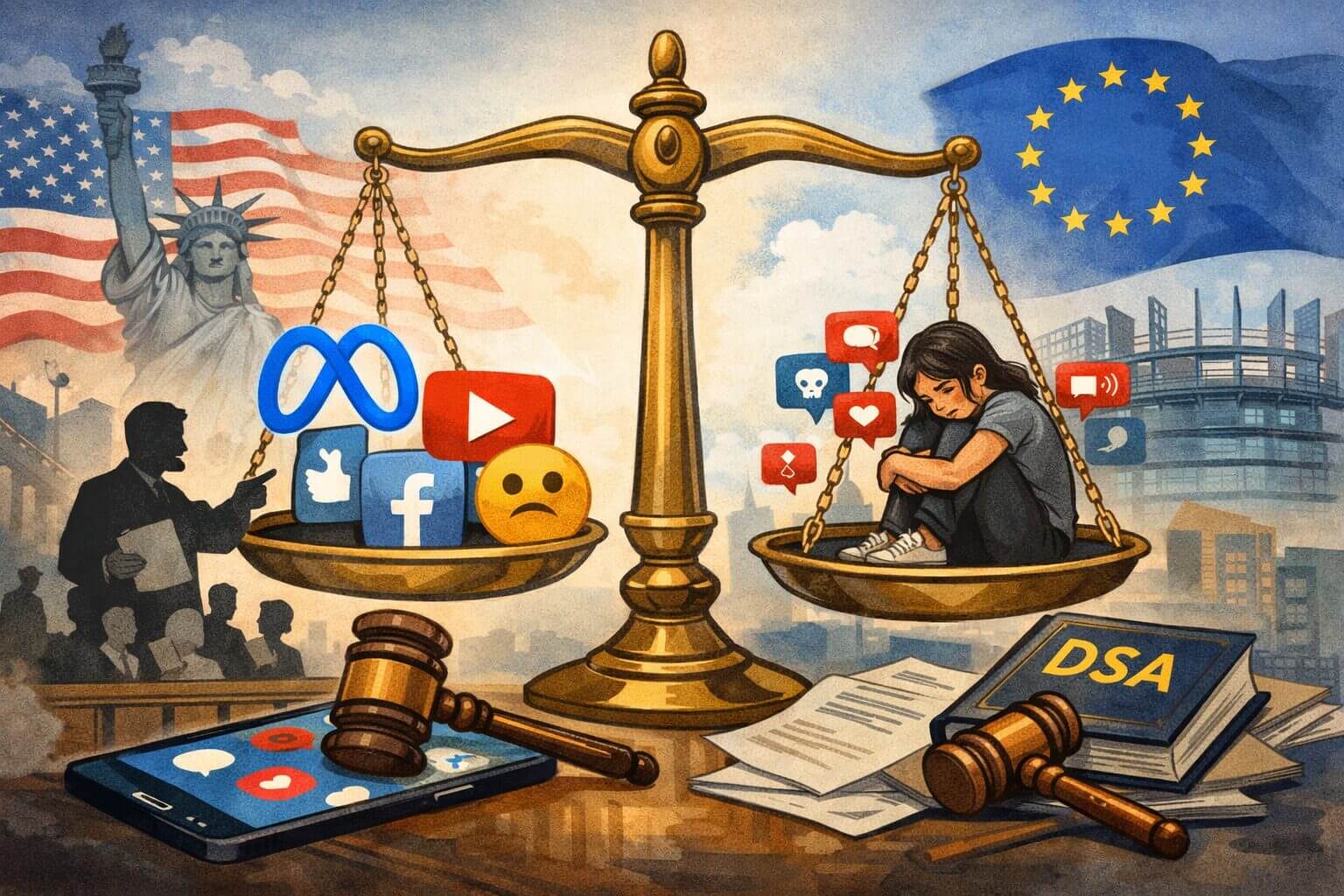

Ci sono settimane in cui un settore smette di sembrare intoccabile. Quella del 24 e 25 marzo 2026 rischia di essere una di queste per l’industria dei social media. Un po’ come accaduto in passato con l’industria del tabacco.

In meno di quarantotto ore, due giurie americane, una a Santa Fe, New Mexico, l’altra a Los Angeles, California, hanno emesso due verdetti che colpiscono Meta su un punto preciso: la responsabilità non riguarda più soltanto i contenuti pubblicati dagli utenti, ma può estendersi al modo in cui le piattaforme sono progettate.

A Santa Fe la giuria ha condannato Meta a 375 milioni di dollari per violazioni della legge statale a tutela dei consumatori; a Los Angeles un’altra giuria ha stabilito che Meta e YouTube sono responsabili per danni alla salute mentale di una giovane utente legati al design addictivo dei loro servizi. In entrambi i casi le società hanno annunciato appello.

Indice degli argomenti

Perché la responsabilità da design dei social cambia il quadro

La novità, nel caso californiano, non è la cifra in sé. Sei milioni di dollari, per gruppi che fatturano centinaia di miliardi, non cambiano i conti. Cambia però la qualificazione giuridica: per la prima volta una giuria americana ha accettato fino in fondo l’idea che un social, o una piattaforma che organizza attenzione e permanenza con logiche simili, possa essere trattato come un prodotto difettoso.

La civilista Catherine M. Sharkey, della Nyu, osserva che nell’economia digitale va ripensata la nozione di prodotto a partire da chi possiede le informazioni e il potere di prevenire il danno. È il punto che collega Los Angeles non solo al contenzioso americano che verrà, ma anche al dsa europeo.

Due verdetti in quarantotto ore

Il primo verdetto è arrivato il 24 marzo 2026 da Santa Fe. La giuria del New Mexico ha ritenuto Meta responsabile per avere ingannato gli utenti sulla sicurezza di Facebook, Instagram e WhatsApp e per avere esposto i minori a rischi gravi, inclusi sfruttamento sessuale e adescamento, in violazione dell’Unfair Practices Act statale. Il New Mexico Department of Justice ha parlato di primo successo processuale di uno Stato americano contro una Big Tech per danni ai minori, con una sanzione di 5.000 dollari per ciascuna delle 37.500 violazioni accertate, fino al totale di 375 milioni. A maggio si aprirà una seconda fase per discutere eventuali rimedi ulteriori e modifiche operative.

Ventiquattro ore dopo è arrivato il verdetto di Los Angeles. La giuria ha assegnato 3 milioni di dollari di danni compensativi e altri 3 milioni di danni punitivi, per un totale di 6 milioni, ripartiti per il 70% a carico di Meta e per il 30% a carico di YouTube. I giurati hanno risposto a favore della ricorrente con una maggioranza di 10 a 2 sui quesiti chiave e il verdetto è stato quasi unanime sui 18 quesiti sottoposti dalla giudice Carolyn B. Kuhl. Anche qui Meta e Google hanno annunciato ricorso.

Letti insieme, i due casi segnano un passaggio preciso. Quello del New Mexico colpisce Meta per avere rappresentato le sue piattaforme come più sicure di quanto fossero davvero e per non avere impedito danni gravissimi ai minori. Quello di Los Angeles va oltre e mette sotto accusa il design in sé: feed infiniti, autoplay, notifiche push, sistemi di raccomandazione, meccaniche pensate per ridurre l’attrito e aumentare il tempo di permanenza. È qui che il terreno cambia.

La storia di K.G.M. e il banco di prova del processo

La ricorrente è indicata negli atti come K.G.M., ma nel materiale di stampa viene identificata come Kaley, oggi ventenne, residente a Chico, in California. Ha raccontato di avere iniziato a usare YouTube a sei anni e Instagram a nove. Prima di compiere quindici anni, aveva creato quindici account Instagram e aveva caricato oltre duecento video su YouTube prima dei dieci anni; in un giorno avrebbe trascorso sedici ore su Instagram. Nella sua denuncia del 2023 contro Meta, Snap, YouTube e TikTok ha sostenuto che quell’uso compulsivo abbia contribuito a causarle ansia, depressione, dismorfofobia corporea, autolesionismo e pensieri suicidari. Snap e TikTok hanno transatto prima del dibattimento. Meta e YouTube hanno scelto il processo.

Nel corso del processo i giurati hanno ascoltato non solo la testimonianza di K.G.M., ma anche quella di dirigenti e top manager delle piattaforme, whistleblower ed esperti sui meccanismi di dipendenza e di raccomandazione. Nel Word si ricorda che tra i testimoni sono comparsi Mark Zuckerberg e Adam Mosseri. Zuckerberg ha sostenuto che l’obiettivo della società fosse offrire qualcosa di utile agli utenti e ha aggiunto che Meta non usa più il tempo di permanenza come metrica interna nello stesso modo in cui lo faceva in passato. È un dettaglio che conta, perché mostra quanto il processo si sia concentrato non sui singoli post, ma sulla logica industriale che governa il prodotto.

La difesa di Meta e Google ha insistito su un altro punto: la salute mentale degli adolescenti dipende da molti fattori e non può essere ricondotta a una sola app. Le aziende hanno provato a spostare l’attenzione sulla vita familiare di Kaley, sul bullismo scolastico, su fragilità pregresse, e hanno ricordato di avere introdotto negli anni strumenti di parental control, limiti al tempo di utilizzo e funzioni di pausa. Ma la giuria ha ritenuto più convincente la tesi opposta: le piattaforme sapevano che alcune scelte di design erano rischiose e non hanno avvertito adeguatamente gli utenti.

Come la responsabilità da design dei social supera lo scudo costituzionale dei contenuti e la section 230

Per capire perché il verdetto di Los Angeles è rilevante bisogna partire da un ostacolo storico: la section 230 del Communications Decency Act del 1996. Quella norma ha protetto per quasi trent’anni le piattaforme dalla responsabilità per i contenuti caricati dagli utenti. Se un utente pubblica un post offensivo, una foto autolesiva o un messaggio di bullismo, la difesa tipica delle piattaforme è che il contenuto non è loro ma dell’utente. È uno scudo potentissimo e in moltissimi casi ha funzionato.

La strategia degli avvocati di K.G.M., come quella usata dal New Mexico su un piano diverso, è stata costruita per aggirare proprio quello scudo. Il bersaglio della causa non erano i contenuti, ma le scelte architetturali delle aziende: scroll infinito, autoplay, notifiche, classifiche implicite, raccomandazioni personalizzate, incentivi continui al ritorno sulla piattaforma. Reuters osserva che giudici in California e nel New Mexico, almeno in questa fase, hanno accettato di distinguere il design del prodotto dai contenuti degli utenti. Se questa lettura reggerà in appello, la section 230 resterà importante, ma non basterà più da sola a chiudere i casi che attaccano il prodotto come tale.

È qui che il processo di Los Angeles diventa qualcosa di più grande di un singolo risarcimento. I ricorrenti hanno provato a spostare i social più vicino al trattamento giuridico riservato a tabacco, oppioidi e altri prodotti di consumo che sono stati giudicati difettosi o insufficientemente avvertiti dei loro rischi. Non è ancora una teoria consolidata, ma non è più neppure un esperimento marginale. Una giuria l’ha già accettata.

Il modello Big Tobacco: analogie e limiti

Il paragone con Big Tobacco attraversa tutta questa stagione di cause. Nel secolo scorso, gli Stati americani accusarono le grandi compagnie del tabacco di avere nascosto per anni quello che sapevano sui danni delle sigarette e di avere continuato a spingere prodotti concepiti per consolidare la dipendenza. Il Master Settlement Agreement del 1998 impegnò le principali società a cambiare pratiche di marketing e a pagare ai 46 Stati firmatari un totale stimato di 206 miliardi di dollari, oltre a restrizioni specifiche sulla promozione verso i minori. È per questo che gli avvocati dei ricorrenti oggi richiamano spesso quel precedente.

Nel processo di Los Angeles, Mark Lanier ha usato un linguaggio pensato proprio per quel parallelismo. Ha parlato di “engineering of addiction”, ha mostrato alla giuria un barattolo di M&M per dare la misura delle risorse di Alphabet e ha insistito sul fatto che i danni economici, da soli, rischiano di non fare male a gruppi di quella taglia. Il gesto scenico conta meno della sostanza: i ricorrenti vogliono dimostrare che le piattaforme conoscevano il rischio, lo hanno discusso internamente e hanno continuato a privilegiare funzioni che aumentavano il coinvolgimento.

Il parallelismo, però, ha anche un limite serio. Pete Etchells, docente di psicologia e comunicazione della scienza alla Bath Spa University, ricorda che qui non si parla di una sostanza biologica con un effetto chimico dimostrabile come la nicotina. La relazione causale è più difficile da isolare. Depressione, ideazione suicidaria e disturbi dell’immagine corporea dipendono da un intreccio di fattori familiari, sociali, clinici e scolastici. Lo stesso Word riporta il giudizio prudente di Eric Goldman, professore di diritto a Santa Clara, secondo cui questi verdetti potrebbero essere ridotti o perfino cancellati nei gradi successivi. È una cautela necessaria. Ma non cambia il fatto che due giurie, in due Stati diversi, hanno considerato credibile la responsabilità da design.

Altre cause in corso negli Usa sui social

Il caso K.G.M. non era un processo qualsiasi. Era un bellwether case, una causa pilota scelta per testare come una giuria reagisce agli argomenti di entrambe le parti, in vista di una massa molto più ampia di contenziosi. Il procedimento di Los Angeles è il primo di un gruppo consolidato di circa 3mila cause in California promosso da oltre 1.600 ricorrenti, tra cui più di 350 famiglie e 250 distretti scolastici. È anche il primo di oltre venti bellwether trials previsti nei prossimi anni. Il prossimo, relativo a un minore identificato come R.K.C., è atteso in estate.

In parallelo si muove il fronte federale. Reuters riferisce che un processo collegato davanti alla corte federale inizierà in giugno con il caso di un distretto scolastico del Kentucky, che chiede non solo risarcimenti ma anche rimedi strutturali: age verification, parental controls e interventi su funzioni di targeting come notifiche costanti e autoplay. Nel Word questo filone viene descritto come uno dei punti da osservare con maggiore attenzione, perché porta in aula non la storia individuale di una singola ragazza, ma l’impatto di queste piattaforme sulla vita scolastica e sulla gestione quotidiana delle classi.

Sul tavolo c’è poi il grande contenzioso politico e istituzionale aperto dagli attorney general. Nell’ottobre 2023 una coalizione bipartisan di 32 attorney general ha citato Meta in giudizio in sede federale, sostenendo che Instagram, Facebook e altri servizi del gruppo fossero stati progettati per creare dipendenza nei minori. Nello stesso giorno nove Stati hanno avviato azioni separate, portando a 42 il numero complessivo delle autorità statali impegnate contro la società in tribunali federali e statali. Quello che è successo il 24 e 25 marzo non nasce quindi nel vuoto: è l’esito provvisorio di un’offensiva legale che dura da anni.

Il fronte europeo: il dsa sposta già la responsabilità sul design

Per capire perché questi verdetti riguardano anche l’Europa non serve importare il diritto americano della product liability. Basta leggere il dsa. Il 16 maggio 2024 la Commissione europea ha aperto un procedimento formale contro Meta sulla protezione dei minori, spiegando di temere che i sistemi di Facebook e Instagram, “inclusi gli algoritmi”, possano stimolare dipendenze comportamentali nei bambini e creare effetti di rabbit hole. La Commissione ha indicato tra i nodi critici anche age assurance e metodi di verifica dell’età. In altre parole, Bruxelles ha già spostato il fuoco dal singolo contenuto al design della piattaforma.

Il 14 luglio 2025 la Commissione ha pubblicato le linee guida sulla protezione dei minori ai sensi dell’articolo 28 del dsa. Quelle linee guida non parlano solo di rimuovere contenuti. Parlano di account privati per default per i minori, maggiore controllo sui recommender systems, limiti alla profilazione, strumenti per ridurre i contatti indesiderati, misure per contenere uso eccessivo e interazioni manipolative. Lo stesso giorno Bruxelles ha presentato anche un prototipo di app per la verifica dell’età, pensato per consentire una prova dell’età rispettosa della privacy.

Il 6 febbraio 2026 la Commissione ha fatto un passo ulteriore su TikTok. Nelle sue conclusioni preliminari ha scritto che il design della piattaforma viola il dsa proprio per funzioni come infinite scroll, autoplay, notifiche push e recommender system altamente personalizzato. Non è solo una contestazione simbolica: la Commissione ha indicato come possibili correttivi pause di schermo efficaci, comprese quelle notturne, e una riduzione progressiva di quelle funzioni che spingono verso un uso compulsivo. È esattamente il lessico che oggi vediamo nei tribunali californiani.

Il 26 marzo 2026, proprio mentre si commentavano i verdetti americani, Bruxelles ha aperto un altro procedimento formale, questa volta contro Snapchat, sempre sul fronte della tutela dei minori: verifica dell’età, default settings, rischio di grooming e insufficienza degli strumenti di segnalazione. Nello stesso giorno la Commissione ha comunicato conclusioni preliminari contro Pornhub, Stripchat, XNXX e XVideos per accesso dei minori a contenuti pornografici. Il segnale è chiaro: il dsa europeo sta già trattando il design come un fattore di rischio regolatorio autonomo.

Anche il potere sanzionatorio cambia la scala del problema. Per le very large online platforms il dsa consente multe fino al 6% del fatturato annuo globale. Con ricavi Meta 2025 pari a 200,97 miliardi di dollari, il tetto teorico supera i 12 miliardi: una cifra incomparabile con i 375 milioni del New Mexico e con i 6 milioni di Los Angeles. I tempi dell’enforcement europeo sono più lunghi di quelli di una giuria statale americana. Ma la direzione è la stessa: il design delle piattaforme non è più una zona franca.

Il contesto italiano su regole social: Agcom si muove, ma il baricentro resta europeo

In Italia il fronte più avanzato è oggi quello della verifica dell’età. La delibera agcom 96/25/CONS, adottata nel 2025 in attuazione del decreto Caivano, ha reso operativi obblighi stringenti per i siti e le piattaforme che diffondono contenuti pornografici. Dal 12 novembre 2025 il sistema è entrato in vigore per gli operatori interessati; dal 1° febbraio 2026 l’obbligo è scattato anche per i siti stabiliti in altri Paesi Ue ma accessibili in Italia. Agcom insiste su un modello con soggetti terzi indipendenti e separazione tra identificazione e autenticazione, per limitare la raccolta di dati personali.

Sempre nel 2025 l’autorità ha approvato, con la delibera 197/25/CONS, il Codice di condotta per gli influencer rilevanti, estendendo a questa platea obblighi più stringenti di trasparenza e responsabilità editoriale. Non è uno strumento pensato per governare l’addictive design dei grandi social, ma mostra che in Italia la tendenza regolatoria è quella di allargare il perimetro della responsabilità nella comunicazione digitale, soprattutto quando entra in gioco la tutela dei minori.

Il limite strutturale, però, resta evidente. Agcom può intervenire su age verification, su creator e su alcuni profili di tutela degli utenti. Non può da sola imporre a Meta, TikTok, YouTube o Snapchat una riscrittura sistemica di feed, autoplay, notifiche o raccomandazioni. Quello è terreno europeo, e passa dal dsa e dall’azione della Commissione. Per questo i verdetti americani contano anche nel dibattito italiano: rafforzano l’idea che la responsabilità possa investire l’architettura del servizio, non soltanto il contenuto che vi circola.

Che cosa implica la responsabilità da design dei social

Se questa linea reggerà nei processi americani e nei procedimenti europei, i social potrebbero cambiare in modo molto concreto. Per i minori, prima di tutto, potremmo vedere servizi meno aggressivi: account privati di default, meno notifiche, più attrito nelle sessioni lunghe, limiti notturni effettivi, raccomandazioni meno opache, funzioni di pausa non sepolte nelle impostazioni, strumenti di parental control più visibili e meno facili da aggirare. Non è una previsione teorica: sono interventi che compaiono già nei documenti europei e nelle richieste dei ricorrenti americani.

Il secondo cambiamento riguarderà le metriche interne.

Zuckerberg ha detto in aula che Meta non assegna più ai team obiettivi centrati sul tempo di permanenza nello stesso modo in cui lo faceva in passato. Anche se pronunciata in chiave difensiva, quella frase riconosce un fatto industriale: per anni il valore economico delle piattaforme è dipeso dalla capacità di trattenere l’utente. Se il trattenimento diventa un fattore di rischio legale, cambiano anche gli incentivi con cui si progettano i prodotti.

Il terzo cambiamento è più silenzioso, ma forse più profondo. A contare sempre di più saranno i documenti interni, gli audit, i risk assessment, i test A/B, i dati sull’uso dei minori, le analisi su autoplay e raccomandazioni. Nel New Mexico sono stati usati documenti aziendali e operazioni sotto copertura; nel dsa la Commissione può chiedere dati, documenti e accesso ai sistemi. Il diritto, in questo modo, non si limita a punire ex post. Costringe le piattaforme a spiegare come funzionano e perché hanno scelto di funzionare così.

Oltre i social: un precedente che può toccare anche l’AI

Ma anche: questo precedente sulla product liability da design algoritmico può estendersi anche all’intelligenza artificiale? Oggi non c’è ancora una risposta giudiziaria stabile. Però il terreno si sta già muovendo. Reuters ha riferito, il 4 marzo 2026, di una causa contro Google in cui il padre di un uomo morto suicida sostiene che Gemini abbia favorito un rapporto emotivo manipolativo e abbia contribuito al gesto. È un caso diverso, ma la struttura del ragionamento è simile: non solo l’output, bensì il modo in cui il sistema è progettato, presentato e reso persuasivo.

Per ora la partita centrale resta sui social. Ma una volta accettato in aula che un prodotto digitale possa essere difettoso per il suo design, la discussione non si ferma automaticamente a Instagram, YouTube o TikTok. È questo, più ancora dell’ammontare dei risarcimenti, il punto che rende i verdetti del 24 e 25 marzo così rilevanti.

La responsabilità da design non è più un’ipotesi marginale

I 6 milioni di dollari che Meta e YouTube dovranno pagare a K.G.M. sono una somma minima per società di quella scala. Lo stesso vale, in termini relativi, per i 375 milioni del New Mexico. Il peso dei due verdetti sta altrove. In quarantotto ore, due giurie in due Stati diversi hanno detto che i danni prodotti dalle piattaforme non si esauriscono nella moderazione insufficiente o nei singoli contenuti illeciti. Possono stare nell’architettura stessa del servizio: nelle scelte che decidono quanto a lungo un minore resta online, che cosa vede, con quale intensità viene risospinto dentro il feed e quanto è difficile uscire.

Per Meta e Google la battaglia immediata si sposterà in appello. Per l’Europa il tema è già entrato nelle istruttorie del dsa. Per l’Italia il nodo resta capire come tradurre quella stessa logica in strumenti regolatori efficaci sui grandi intermediari globali. Il punto fermo, oggi, è più semplice di quanto sembri: il design di un social non è più trattato come una scelta neutra di prodotto. Negli Stati Uniti una giuria lo ha qualificato come possibile fonte di lesione personale. In Europa la Commissione lo sta già trattando come una fonte di rischio sistemico per i minori. È da qui che cambiano i rapporti di forza tra piattaforme, regolatori e utenti.