I progressi dell’intelligenza artificiale e della robotica sociale hanno contribuito al perseguimento di obiettivi da sempre centrali nella progettazione di agenti intelligenti, come l’autonomia, l’adattabilità e la capacità di interazione.

Oggi i robot, con un design sempre più antropomorfo, rispondono e partecipano in modo appropriato a conversazioni in linguaggio naturale, modulano il tono di voce, classificano con accuratezza volti ed emozioni e non sono più confinati a contesti sperimentali, ma vengono impiegati in contesti sociali, dalla scuola all’assistenza, interagendo direttamente con le persone e influenzando le dinamiche relazionali.

Indice degli argomenti

Trasparenza e comprensione come requisiti etici

Trasparenza e comprensione: requisiti etici dell’intelligenza artificiale.

Foto di Agnese Augello

Quando un agente intelligente implementato su un corpo robotico interagisce direttamente con le persone occupando lo spazio, modulando gesti, sguardi e distanza, il suo comportamento non va più valutato solo in termini di correttezza tecnica o funzionale, ma deve anche essere comprensibile.

Nei contesti educativi, assistivi o di servizio, la possibilità di interpretare e motivare le azioni di un robot costituisce un elemento essenziale della sua responsabilità sociale, legata alle aspettative e alla fiducia riposte in esso.

La ricerca di spiegazioni può essere guidata da una semplice curiosità intellettuale o essere necessaria per attribuire responsabilità per le conseguenze del comportamento del robot. Se, ad esempio, un robot chirurgico taglia il tessuto errato durante un intervento, sarà importante stabilire se il danno sia dovuto a un movimento scorretto del chirurgo o a un malfunzionamento del robot.

Comprendere la “mente” dei robot sociali

Comprendere la “mente” di un robot Foto di Agnese Augello

Negli ultimi anni, il filone di ricerca noto come eXplainable Artificial Intelligence (XAI) ha sviluppato metodi e strumenti per ridurre l’opacità dei modelli di apprendimento automatico e rendere più interpretabili i loro processi decisionali. Questo obiettivo è perseguito prevalentemente attraverso un approccio tecnico, volto a chiarire il funzionamento interno dei modelli e a supportare attività di analisi, validazione e controllo, ad esempio evidenziando le informazioni e le variabili che contribuiscono in modo determinante all’esito di una decisione.

Nella vita sociale, tuttavia, cerchiamo di comprendere un comportamento analizzando le cause, le intenzioni, le regole condivise e le aspettative sociali. Di fronte a un robot che si ferma, cede il passo, ignora una richiesta o interviene in una conversazione, la domanda non è “quale variabile ha pesato di più?”, ma: “Perché si è comportato così?”

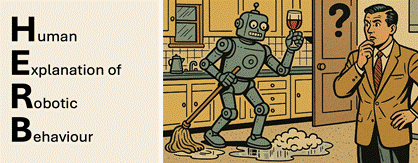

HERB – Human Explanation of Robotic Behaviour

Prima di chiederci come un agente intelligente o un robot debba spiegare le proprie decisioni, dobbiamo prima di tutto ribaltare la prospettiva e comprendere come le persone spiegano il comportamento dei robot. Questo è l’obiettivo del progetto di ricerca “HERB – Human Explanation of Robotic Behaviour”, finanziato dal Ministero dell’Università e della Ricerca (programma PRIN 2022).

Il progetto, che si concluderà nel febbraio 2026 dopo due anni di lavoro, ha coinvolto il Dipartimento di Scienze Umane per la Formazione “R. Massa” dell’Università degli Studi di Milano-Bicocca, il Dipartimento di Lettere e Filosofia dell’Università di Firenze, l’Istituto di Calcolo e Reti ad Alte Prestazioni (ICAR) del Consiglio Nazionale delle Ricerche e l’Istituto Nazionale di Documentazione, Innovazione e Ricerca Educativa (INDIRE).

Quando interagiamo con un robot sociale, costruiamo spiegazioni così come facciamo quando osserviamo un fenomeno o il comportamento di un altro essere umano: cerchiamo di collegare ciò che vediamo a un insieme di ragioni, cause o scopi che rendano quell’azione comprensibile

Ma una spiegazione non è un semplice commento: è un concetto articolato che può assumere forme diverse, derivare da criteri differenti e riflettere il modo in cui interpretiamo il mondo e le azioni altrui.

Logiche diverse possono condurre a spiegazioni di tipo diverso, che mettono l’accento su meccanismi, regole di funzionamento, funzioni o intenzioni attribuite all’azione osservata.

Le spiegazioni possono essere ricondotte a una tassonomia di forme esplicative ricorrenti.

Nel contesto della robotica sociale possiamo parlare di spiegazioni meccanicistiche quando l’azione del robot viene interpretata facendo riferimento a sensori, moduli o processi operativi (“Il robot si è fermato perché i suoi moduli sensoriali hanno rilevato un oggetto”); di spiegazioni nomologiche quando il comportamento è ricondotto a leggi generali, regolarità o principi (“Tutti i robot dotati di questo tipo di sensore reagiscono in questo modo quando rilevano un ostacolo”), di spiegazioni teleologiche quando il comportamento viene giustificato in riferimento a uno scopo o a un obiettivo (“Il robot si è fermato per evitare di rompersi”); e infine di spiegazioni folk-psicologiche quando si attribuiscono al robot stati mentali, intenzioni o capacità di comprensione tipicamente umane (“Il robot non ha capito cosa gli è stato detto”).

Studio delle spiegazioni nell’interazione uomo-robot – Immagine generata da ChatGPT

Aspettative sociali nell’interazione uomo-robot

Un elemento chiave di questo studio è il ruolo delle aspettative sociali. L’assunzione è che quando il comportamento di un robot è allineato a ciò che ci aspettiamo in una determinata situazione, raramente emerge un bisogno esplicito di spiegazioni. Il sistema, in quel caso, viene considerato prevedibile e affidabile.

Quando invece il robot viola le aspettative, anche in modo sottile, emerge il bisogno di una spiegazione.

È pur vero che le aspettative nei confronti di una macchina possono differire da quelle che abbiamo nelle tipiche situazioni sociali in cui ci troviamo.

Tuttavia, un robot umanoide, anche in assenza di una reale competenza sociale, tende a essere interpretato come un agente intenzionale. Questo porta a un’attribuzione spesso falsata di competenze, a una fiducia eccessiva, ad aspettative irrealistiche.

Le spiegazioni giocano quindi un ruolo etico cruciale: non devono rafforzare illusioni, ma possono aiutare a ricalibrare le aspettative, rendendo chiari i limiti del sistema.

Aspettative nell’interazione uomo-robot

Foto di Agnese Augello

Studiare le spiegazioni per progettare sistemi più responsabili

Raccogliere e analizzare le spiegazioni che le persone producono nei confronti dei robot consente di individuare dove e perché emergono aspettative errate e di capire quali forme esplicative adottare, tenendo conto del contesto applicativo.

Come osservato da Tom Ziemke, esperto di interazione umani-robot presso l’Università di Linköping, sappiamo ancora relativamente poco su come le persone interpretano il comportamento dei sistemi autonomi interattivi, come i robot sociali o i veicoli automatizzati.

Gran parte della letteratura si è concentrata sull’attribuzione, a grana grossa, di stati mentali ai robot: intenzionalità, emozioni, capacità cognitive. Questi studi analizzano se e quando le persone tendono ad antropomorfizzare i robot, utilizzando questionari, misure comportamentali o neuroscientifiche. Altri lavori si focalizzano su abilità cognitive specifiche, come la capacità di attribuire false credenze o di assumere la prospettiva visiva altrui.

Nonostante l’ampiezza di questo filone di ricerca, resta aperta una questione fondamentale: come le persone prevedono e spiegano il comportamento dei robot nel dettaglio. Studi recenti mostrano che non è ancora chiaro come le aspettative degli utenti si formino e si modifichino in base al contesto, all’esperienza o al tipo di interazione. Questo tipo di analisi richiede strumenti concettuali solidi per distinguere tra diversi tipi di spiegazione, strutture argomentative e indicatori linguistici utilizzati per dare senso all’azione del robot. Richiede inoltre strumenti computazionali in grado di analizzare grandi quantità di spiegazioni in forma testuale, individuando variazioni e pattern ricorrenti.

Si osserva infatti che le spiegazioni variano profondamente, anche quando a formularle è la stessa persona in momenti diversi. Le differenze possono riguardare il linguaggio adottato, il livello di analisi scelto, il riferimento a fattori contestuali o il tipo di connessione logica stabilita tra il comportamento osservato e gli elementi chiamati a giustificarlo.

Rilevanza sociale

Studiare e comprendere le spiegazioni che le persone elaborano di fronte al comportamento dei robot è fondamentale per orientare la progettazione di sistemi più responsabili, comprensibili e, di conseguenza, socialmente accettabili. Le forme esplicative adottate e accettate influenzano direttamente la fiducia, la prevedibilità percepita e la qualità dell’interazione.

Questo aspetto assume una rilevanza etica particolarmente elevata nei contesti sensibili, come quelli assistivi o della mobilità autonoma, dove le aspettative sulle capacità sociali dei sistemi rivestono un ruolo decisivo. Comprendere quali tipi di spiegazione emergono nei diversi contesti sociali diventa quindi essenziale per progettare robot che possano essere interpretati correttamente e utilizzati in modo appropriato.

Il progetto HERB ha affrontato queste problematiche attraverso un lavoro sistematico di raccolta e analisi delle spiegazioni prodotte dalle persone in situazioni di interazione reale con robot sociali. Ispirandosi alle Strange Stories sviluppate da Francesca G. E. Happé [Happé, 1994] nell’ambito degli studi sulla Theory of Mind, la ricerca ha adattato questo approccio al contesto dell’interazione uomo–robot. In particolare, sono stati progettati scenari sociali ispirati a pratiche sociali quotidiane (come la navigazione in spazi condivisi, l’accoglienza e l’assistenza), messi in scena tramite un robot umanoide e utilizzati per elicitare spiegazioni spontanee da parte degli osservatori [Augello, 2025].

Questo ha permesso di raccogliere un corpus ampio di spiegazioni testuali, analizzate sia qualitativamente sia attraverso strumenti sviluppati all’interno del progetto, in collaborazione con il Professore Antonio Lieto dell’Università di Salerno. Tra questi, un ruolo centrale è svolto da un’ontologia di spiegazioni, costruita a partire da una tassonomia di forme esplicative derivate dalla filosofia della scienza, e da un sistema di classificazione ibrido che integra tale conoscenza simbolica con modelli linguistici di grandi dimensioni mediante un approccio di retrieval-augmented generation [Rausa et al., 2025], [Augello et al., 2025].

Un aspetto particolarmente rilevante riguarda la conferma empirica del ruolo delle aspettative sociali.

I risultati mostrano che, quando il comportamento del robot è percepito come allineato alle aspettative della situazione, le persone tendono a produrre spiegazioni più stabili, facendo prevalentemente ricorso a spiegazioni di tipo teleologico, ossia orientate allo scopo attribuito all’azione del robot. Al contrario, quando il comportamento risulta inatteso o ambiguo, emerge più chiaramente il bisogno di una spiegazione: in questi casi aumentano le spiegazioni di tipo meccanicistico e, come osservato anche attraverso momenti di discussione e confronto con i partecipanti, si riduce l’accettazione di attribuzioni antropomorfiche, accompagnata da una valutazione più negativa della competenza sociale del sistema [Augello, 2025].

Rilevanza educativa

Nei contesti educativi, le HERB rappresentano uno strumento prezioso per comprendere come studenti e bambini concettualizzano il funzionamento dei sistemi tecnologici. Nonostante l’uso crescente dei robot come strumenti didattici, sappiamo ancora poco su come i bambini spiegano il loro comportamento. Analizzare queste spiegazioni significa osservare in tempo reale la costruzione di modelli mentali, offrendo nuove possibilità per sostenere l’alfabetizzazione tecnologica e il pensiero critico.

Le Human Explanations of Robotic Behaviour (HERB) assumono rilevanza educativa nel contesto di quella che viene ormai definita con espressioni quali code society o software society, in cui le tecnologie sono tanto pervasive quanto “opache” rispetto ai loro meccanismi di funzionamento. In ambito scolastico, le HERB consentono di affrontare questa opacità potenziando una prospettiva unblackboxing della tecnologia, auspicata dalla pedagogia maker, nell’approccio ad attività didattiche di coding, robotica educativa e computational thinking.

Lo studio delle HERB, infatti, supporta una progettazione didattica orientata a rendere espliciti i criteri, le regole e le logiche interpretative che guidano il comportamento degli agenti artificiali. Analizzare come bambini e studenti spiegano le azioni di un robot permette di osservare la costruzione di modelli mentali e aspettative nei confronti dei sistemi intelligenti, evidenziando attribuzioni intenzionali, semplificazioni antropomorfiche e forme emergenti di comprensione algoritmica.

A partire da studi precedenti sulla Theory of Mind e sulla sua declinazione in Theory of Artificial Mind, attraverso le HERB è possibile mettere in luce come la spiegazione del comportamento robotico non significhi soltanto comprenderne l’azione, ma anche riflettere sulle categorie cognitive utilizzate per interpretarla. In tale prospettiva, l’interazione bambino–robot diventa un dispositivo educativo per sostenere lo sviluppo del pensiero critico e della consapevolezza tecnologica, poiché sollecita il confronto sulla distinzione tra comportamento programmato, adattamento automatico e intenzionalità propriamente umana.

Le HERB si collocano all’interno di percorsi educativi che integrano coding, pensiero computazionale e robotica educativa, rafforzandone la dimensione riflessiva e metacognitiva. In particolare, esse consentono di sostenere la costruzione di una AI literacy che non si limita all’uso corretto degli strumenti, ma include la capacità di spiegare, prevedere e valutare il comportamento dei sistemi intelligenti in relazione al contesto. In questo senso, lo studio delle HERB assume un valore educativo fondamentale perché aiuta a calibrare le aspettative degli studenti, a prevenire forme di fiducia indebita o di delega cognitiva e a promuovere un rapporto critico, responsabile e informato con le tecnologie emergenti, contribuendo alla formazione di cittadini capaci di comprendere e interagire attivamente con la complessità della società.

Bibliografia

● Artemov, S., and Fitting, M. (2019). Justification Logic: Reasoning with Reasons. Cambridge University Press.

● Augello, A., Datteri, E., Lieto, A., Rausa, M., and Zagni, N. (2025). RAGGAE for HERBS: Testing the Explanatory Performance of Ontology-powered LLMs for Human Explanation of Robotic Behaviors. Proceedings of the International Conference on Social Robotics. Singapore: Springer Nature Singapore, pp. 558–569.

● Augello, A. Rausa, M. Datteri, E., Zagni N., and Lieto, A. (2025). How are people’s explanations of the behaviour of robots structured? An exploratory study and discussion,” In Proceedings of the IEEE Conference on Pervasive and Intelligent Computing (PICom), Hakodate, Japan, 2025, pp. 66-73.

● Bromberger, S. (1992). On What We Know We Don’t Know: Explanation, Theory, Linguistics, and How Questions Shape Them. University of Chicago Press.

● De Graaf, M. A., and Malle, B. F. (2019). People’s explanations of robot behavior subtly reveal mental state inferences. Proceedings of the 14th ACM/IEEE International Conference on Human-Robot Interaction (HRI).

● Dennett, D. C. (1971). Intentional systems. The Journal of Philosophy, 68(4), pp. 87–106.

● Di Stasio, M., Miotti, B. (2024). Intelligent Agents at School. Child–Robot Interactions as an Educational Path. Education Sciences, 14(7), 774.

● Happé, F. G. E. (1994). An advanced test of theory of mind: Understanding of story characters’ thoughts and feelings by able autistic, mentally handicapped, and normal children and adults. Journal of Autism and Developmental Disorders, 24(2), pp. 129–154.

● Hempel, C.G. (1965). Aspects of scientific explanation: And other essays in the philosophy of science. New York: The Free Press.

● Hempel, C. G., and Oppenheim, P. (1948). Studies in the logic of explanation. Philosophy of Science, 15(2), pp. 135–175.

● Larghi, S., and Datteri, E. (2024). Mentalistic stances towards AI systems: Beyond the intentional stance. Proceedings of the International Conference on Software Engineering and Formal Methods, pp. 28–41. Springer Nature Switzerland.

● Luo, J., Studer, T., and Dastani, M. (2025). Tailoring explanations through conversation. Journal of Logic and Computation, 35(4).

● Marchesi, S., Ghiglino, D., Ciardo, F., Perez-Osorio, J., Baykara, E., and Wykowska, A. (2019). Do we adopt the intentional stance toward humanoid robots? Frontiers in Psychology, 10, 450.

● Rausa, M., Augello, A., and Lieto, A. (2025). Towards an ontology of human explanations of robotic behavior. Proceedings of SOCIALIZE 2025, Workshop at Intelligent User Interfaces (IUI).

● Samek, W., Montavon, G., Vedaldi, A., Hansen, L. K., and Müller, K. R. (2019). Explainable AI: Interpreting, Explaining and Visualizing Deep Learning (Vol. 11700). Springer Nature.

● Thellman, S., Silvervarg, A., and Ziemke, T. (2017). Folk-psychological interpretation of human vs. humanoid robot behavior: Exploring the intentional stance toward robots. Frontiers in Psychology, 8, 1962.

● Ziemke, T. (2020). Understanding robots. Science Robotics, 5(46), eabe2987.