GPT 5-4 è da oggi disponibile (in ChatGPT come GPT‑5.4 Thinking, API e Codex), ma negli ultimi giorni diversi tester hanno avuto accesso anticipato al nuovo modello OpenAI e i primi feedback stanno convergendo su una valutazione piuttosto netta: siamo di fronte a uno dei salti qualitativi più evidenti degli ultimi cicli di evoluzione dei modelli.

Il punto che molti stanno sottolineando è semplice: la versione standard di GPT-5.4, con modalità di ragionamento attiva, sembra già superare le prestazioni dei modelli precedenti in modalità “Pro”. In altre parole, ciò che prima richiedeva la configurazione più potente ora è disponibile nella modalità base. Questo cambia l’economia d’uso del modello: meno latenza, meno token di ragionamento necessari per arrivare allo stesso risultato e, di conseguenza, risposte più rapide a parità di qualità.

Indice degli argomenti

GPT-5.4 come strumento per il lavoro professionale

OpenAI, però, presenta GPT-5.4 non solo come un modello più forte sul piano astratto, ma come un sistema pensato esplicitamente per il lavoro professionale. Nell’annuncio ufficiale il focus è su attività concrete come fogli di calcolo, documenti e presentazioni, cioè sui formati in cui la qualità del modello si misura meno nei benchmark puri e più nella capacità di produrre output utili, accurati e già spendibili nel lavoro quotidiano.

Sul fronte tecnico emergono tre aree dove il salto è particolarmente evidente.

Il coding come primo terreno di verifica

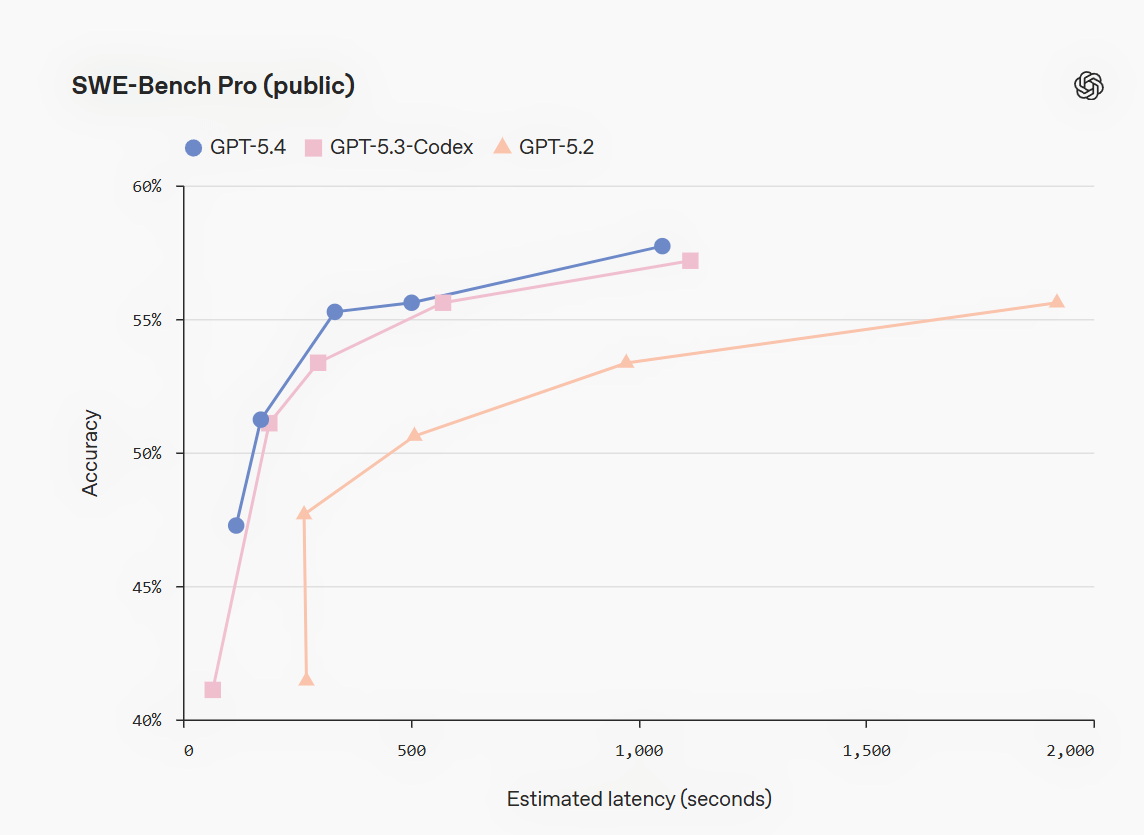

La prima è il coding. Molti tester riportano risultati quasi “banali” per il modello: implementazioni pulite, architetture corrette e spesso accompagnate automaticamente da test suite funzionanti al primo tentativo. In diversi ambienti di sviluppo, come Codex o benchmark di programmazione, il comportamento appare estremamente affidabile, tanto che qualcuno ha commentato provocatoriamente che “coding is essentially solved”. È probabilmente un’esagerazione, ma segnala chiaramente quanto il livello medio si sia alzato.

Ragionamento, generalizzazione e domande implicite

La seconda area è il ragionamento e la generalizzazione. Alcuni tester che hanno utilizzato la versione Pro parlano di una capacità maggiore di porre domande implicite durante il ragionamento: “perché?”, “e se?”, “posso farlo in modo diverso?”, “perché è rilevante?”. Questo tipo di comportamento rende le risposte più simili a un processo cognitivo umano, con maggiore capacità di collegare concetti e sintetizzare dataset complessi. In ambiti scientifici, come quello biomedico, diversi utenti hanno osservato una sorprendente capacità di integrare informazioni provenienti da fonti differenti.

Scrittura e controllo stilistico sotto vincoli precisi

La terza area riguarda la scrittura e il controllo stilistico. Alcuni tester che in passato consideravano ChatGPT meno forte rispetto ad altri modelli nella produzione di testi stanno cambiando opinione. Il punto chiave non è tanto lo stile di default, quanto la capacità del modello di adattarsi con precisione a vincoli molto specifici: lunghezza esatta, tono emotivo, persona narrativa, canale di destinazione (report, post, ecc.). Con istruzioni chiare, il modello sembra produrre testi molto naturali e aderenti alle richieste.

GPT-5.4 nei benchmark del lavoro reale

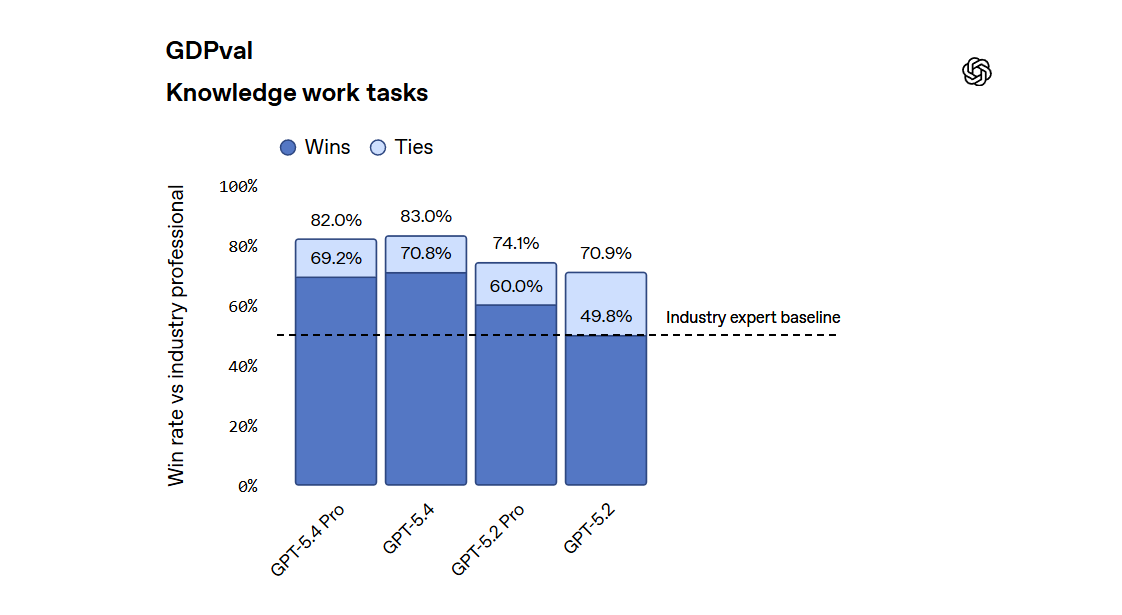

Questo orientamento emerge anche nei numeri che OpenAI ha scelto di mettere in evidenza. Nel benchmark GDPval, che misura la capacità degli agenti di produrre lavoro ben specificato in 44 occupazioni, GPT-5.4 raggiunge l’83,0% contro il 70,9% di GPT-5.2. Su task interni di spreadsheet modeling arriva all’87,3% contro il 68,4% del modello precedente, mentre nelle valutazioni sulle presentazioni i revisori umani hanno preferito gli output di GPT-5.4 nel 68% dei casi, citando estetica, varietà visiva e uso più efficace della generazione di immagini. OpenAI aggiunge anche che, su prompt in cui gli utenti avevano segnalato errori fattuali, le singole affermazioni di GPT-5.4 risultano 33% meno spesso false e le risposte complete 18% meno spesso errate rispetto a GPT-5.2.

Anche i benchmark iniziano a riflettere questo salto. In alcune valutazioni agentiche come APEX-Agents, GPT-5.4 è il primo modello a superare il 50% di score medio. In altri benchmark di capacità economico-strategica, come GDPval, si parla di risultati intorno all’83%. Più che i numeri in sé, è interessante la velocità con cui stanno migliorando.

Computer use, visione e workflow più lunghi

Un altro elemento importante, quasi assente nella lettura solo “testers first”, è la dimensione di computer use e visione. OpenAI definisce GPT-5.4 il suo primo modello general-purpose con capacità native di uso del computer, cioè in grado di operare tra interfacce, screenshot, browser e software per portare a termine workflow più lunghi. Nei benchmark citati dall’azienda il modello raggiunge il 75,0% su OSWorld-Verified, il 67,3% su WebArena-Verified e il 92,8% su Online-Mind2Web. Alla componente operativa si affianca un miglioramento della percezione visiva: su MMMU-Pro arriva all’81,2% senza tool e mostra progressi anche nel parsing di documenti su OmniDocBench.

Gpt 5.4. Limiti che restano aperti

Naturalmente restano ancora dei limiti.

Quando manca il contesto del mondo reale

Alcuni utenti segnalano che il modello continua talvolta a trascurare elementi di contesto del mondo reale se non vengono esplicitati nel prompt. Un esempio citato riguarda la pianificazione di un viaggio perfettamente coerente dal punto di vista logistico ma che ignorava il fatto che alcune destinazioni sarebbero state invase dagli “spring breakers”.

È un limite noto dei modelli linguistici: senza contesto esplicito, la rappresentazione della realtà resta inevitabilmente incompleta.

Strumenti, ricerca web e sicurezza operativa

C’è poi un punto che aiuta a capire perché GPT-5.4 venga percepito come più utile nel lavoro reale: il modello migliora anche nell’uso degli strumenti e nella ricerca web agentica. OpenAI riporta un 82,7% su BrowseComp, un 67,2% su MCP Atlas e un 54,6% su Toolathlon, sostenendo che il modello riesca a cercare meglio tra più fonti, usare con più efficacia i tool disponibili e mantenere il filo su task composti da più passaggi. In questa chiave, il salto non riguarda solo la qualità della singola risposta, ma la capacità di costruire processi più robusti dall’inizio alla consegna finale.

C’è poi un aspetto interessante emerso dal paper di sicurezza pubblicato insieme al modello. OpenAI ha testato se i modelli siano in grado di nascondere deliberatamente il proprio chain-of-thought ai sistemi di monitoraggio. Il risultato è che, al momento, i modelli non riescono ancora a mentire in modo sistematico nel loro “scratchpad” interno. Questo rende il monitoraggio del ragionamento ancora uno strumento di sicurezza efficace.

La sicurezza, inoltre, nell’annuncio non viene trattata come un elemento isolato. OpenAI collega GPT-5.4 a un impianto più ampio che comprende il controllo dei comportamenti ad alto rischio, policy di conferma configurabili per l’uso del computer e un lavoro specifico su superfici sensibili e ambienti con requisiti più restrittivi. Il quadro che ne esce è quello di un modello pensato non soltanto per essere più capace, ma per essere integrato in contesti professionali dove affidabilità, supervisione e limiti operativi contano quanto le performance pure.

Come avvenuto in precedenza, questa è una metrica che diversi ricercatori suggeriscono di osservare attentamente nel tempo.

GPT-5.4 e la nuova percezione della frontiera AI

Mettendo insieme tutti questi segnali emerge una sensazione diffusa tra chi lo sta testando: GPT-5.4 non è solo un miglioramento incrementale, ma un modello che cambia la percezione di dove si trovi la frontiera attuale.

Il contesto del rilascio e della disponibilità

Anche il contesto di rilascio aiuta a leggere meglio il significato di questa versione. GPT-5.4 è stato lanciato in ChatGPT, API e Codex, mentre GPT-5.4 Pro è disponibile in ChatGPT e API per chi cerca la massima performance su task complessi. In ChatGPT, la variante Thinking può mostrare un preambolo iniziale del lavoro per consentire correzioni in corsa; in API e Codex il modello supporta fino a 1 milione di token di contesto, anche se in Codex il supporto è indicato come sperimentale e oltre la finestra standard di 272K il consumo viene conteggiato al doppio. OpenAI indica inoltre la disponibilità per Plus, Team e Pro, l’accesso anticipato per Enterprise ed Edu tramite impostazioni admin e il ritiro di GPT-5.2 Thinking fissato al 5 giugno 2026.

Il momento wow dei primi ricercatori

Per alcuni ricercatori è stato persino un momento wow: vedere un algoritmo risolvere in pochi minuti problemi che avevano richiesto decenni per essere formulati. Non nel senso di sostituire l’esperto, ma nel senso di amplificarne drasticamente la capacità di lavoro. Come ha scritto uno dei tester: non ho perso il mio campo di ricerca, ho appena guadagnato uno strumento che ragiona allo stesso livello dei migliori specialisti.

E forse è proprio questa la chiave di lettura più interessante.

La cautela necessaria davanti al salto percepito

Resta comunque utile una cautela metodologica. Una parte dei risultati comunicati da OpenAI arriva da benchmark pubblici, un’altra da benchmark interni e un’altra ancora da valutazioni o testimonianze di partner. Questo non invalida i segnali emersi, ma suggerisce di distinguere tra misure indipendenti, misure proprietarie e giudizi d’uso raccolti in contesti controllati. È un passaggio importante, perché il salto percepito sembra reale, ma la sua portata va letta tenendo insieme entusiasmo, condizioni di test e verifica sul campo.

Non è ancora l’AGI. Ma è sempre più difficile ignorare quanto rapidamente ci stiamo avvicinando a sistemi che non si limitano a generare testo, ma ragionano, progettano e collaborano come veri partner cognitivi.