Costruire agenti AI più potenti non basta più: bisogna anche impedire che sbaglino. È su questo terreno che nVidia prova a muoversi con NemoClaw, il framework open source presentato al GTC 2026 per introdurre limiti, regole e accountability nei sistemi agentici.

Indice degli argomenti

L’annuncio di NemoClaw al GTC 2026

La conferenza per gli sviluppatori nVidia GTC 2026 si è conclusa con molti annunci importanti prevalentemente concentrati sull’intelligenza artificiale di cui la compagnia si propone di essere il motore.

Il CEO e fondatore Jensen Huang in quasi due ore di Keynote ha annunciato molte novità sia hardware che software, sottolineando il posizionamento della compagnia come il coltellino svizzero per supportare la realizzazione di sistemi AI mediante hardware software che terze parti possono utilizzare per costruire soluzioni di intelligenza artificiale.

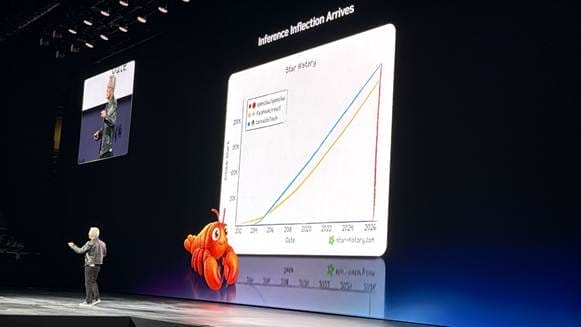

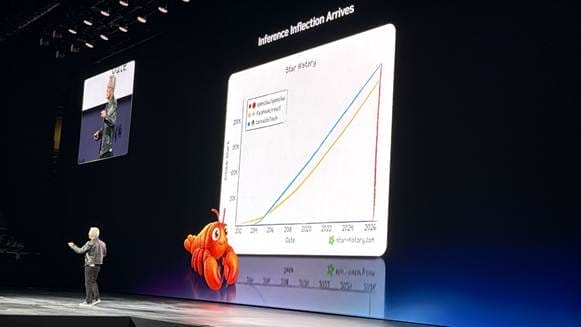

Dopo aver celebrato i 20 anni di CUDA, la libreria software che ha contribuito a determinare il successo della compagnia, e dopo aver sottolineato la centralità di un sempre maggiore accoppiamento tra hardware e software necessario a fornire l’efficienza richiesta dalla generazione di token, il CEO ha annunciato il nuovo framework per agenti supportato da nVidia chiamato NemoClaw e basato su OpenClaw, il progetto OpenSource che più rapidamente ha acquisito più popolarità nella storia del software, e comunque di Linux e React (se le stelle di GitHub si possono considerare la misura di successo di un progetto open).

È indubbio che OpenClaw stia suscitando sempre più attenzione, come dimostrano i numerosi cloni che si stanno diffondendo, dimostrando come il framework abbia saputo costruire il giusto mix di Agent loop, Tool e Skill necessari per costruire agenti capaci di utilizzare sempre più strumenti per raggiungere obiettivi specifici utilizzando modelli LLM differenti (sia in cloud che locali).

Viene naturale chiedersi quindi quali possano essere i contributi che nVidia porta con il rilascio in anteprima del framework NemoClaw, anche lui open source, e che ha come obiettivo quello di fornire un framework di agenti che sia capace anche di limitare l’AI impedendo l’esecuzione di azioni indesiderate che possano compromettere il funzionamento di un sistema.

Cosa è NemoClaw

NemoClaw è un framework derivato da OpenClaw, ma non collegato (e quindi si tratta di un progetto che vive di vita propria) che introduce un componente centrale chiamato OpenShell che svolge il ruolo di sandbox lightweight in cui gli agenti vengono confinati ad eseguire e che decide se un’azione che un agente vuole intraprendere durante la sua esecuzione sia accettabile o meno.

Si tratta di una sorta di container ma più “leggero” dei container linux a cui siamo abituati, disegnato solo per limitare le azioni dell’agente e non per ospitare processi come nel caso dei container.

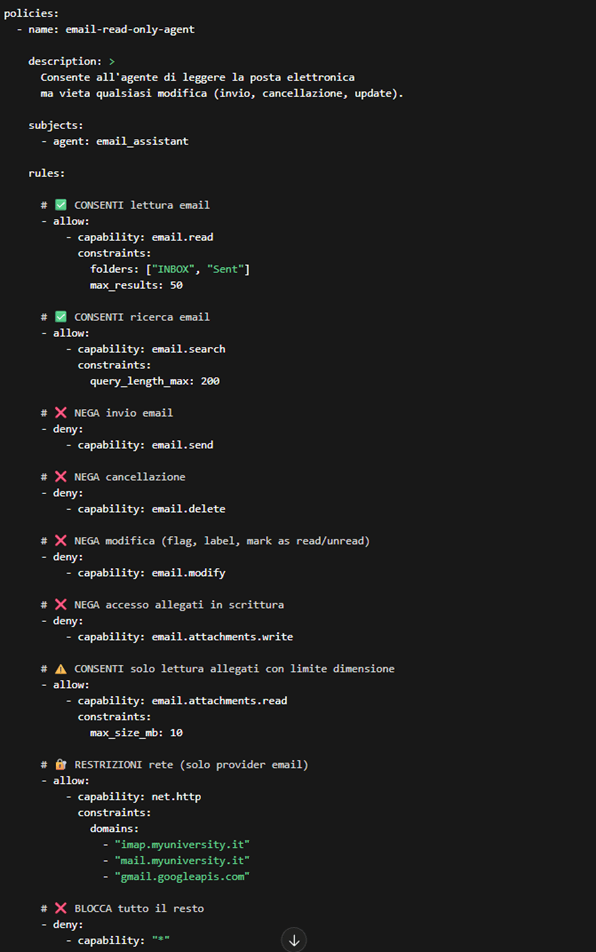

Se, ad esempio, un agente che è stato istruito di monitorare una casella di posta elettronica decide di ripulirla, come ha fatto un agente OpenClaw al Director di Meta Summer Yue, cancellando tutti i messaggi le azioni di cancellazione possono essere impedite dalla Open Shell in cui l’agente sta eseguendo. Le politiche che governano il modulo Open Shell di NemoClaw sono espresse con la sintassi YAML e non sono altro che una lunga lista di permessi che indicano le azioni che un agente può intraprendere o meno.

Il funzionamento dell’agente è per il resto analogo a quello di OpenClaw anche se NemoClaw non usa OpenClaw al suo interno, si tratta piuttosto di un fork che si comporta in modo analogo e che non è garantito evolvere lungo le stesse direzioni di sviluppo.

Il framework è naturalmente integrato con i framework e i modelli open di nVidia disegnati per una maggiore integrazione tra hardware e software secondo le indicazioni di Jensen.

Quando ho cominciato a studiare il policy engine di NemoClaw mi sono chiesto perché abbiamo bisogno di un motore dedicato all’interno del framework ad agenti, non bastano i sistemi di controllo dei permessi che già molte applicazioni enterprise implementano? Perché non possiamo considerare l’AI semplicemente come un altro utente? La risposta che ho trovato risiede nel fatto che i sistemi di permessi sono stati disegnati per utenti che devono essere limitati nelle proprie azioni ma che in ultima analisi possono essere poi perseguiti in caso di abuso delle risorse.

Inoltre la configurazione delle autorizzazioni di un sistema è spesso troppo complessa per essere gestita da esseri umani e inevitabilmente la granularità dei permessi e l’assunzione che sia l’uomo in ultima analisi ad accedere al dato portano ad API in cui, come succede nel caso della posta elettronica, spesso non si può separare il permesso di lettura e di scrittura. E i sistemi che offrono una granularità molto fine di permessi (come ad esempio la Graph API di Microsoft) sono considerati ostici da configurare ed è anche difficile da un punto di vista della sicurezza apprezzare tutte le conseguenze di un grant.

Ecco quindi perché il motore di policy e la OpenShell di NemoClaw svolge un ruolo importante, è di fatto un sistema che consente di normalizzare le policies nell’accesso alle risorse, a volte consentendo anche configurazioni impossibili con i sistemi esistenti (si pensi ad esempio al sistema di permessi di default nell’accesso ai file di linux senza le ACL).

In OpenClaw il motore dei permessi ha una grana molto più grossolana rispetto a quello di NemoClaw e soprattutto l’agente può cercare di modificarlo in autonomia aggirando le limitazioni imposte. Le policy potrebbero però essere scaricati sui tool ovverosia sulle librerie usate dall’agente per accedere e modificare risorse varie.

Quale framework?

Finora la maggior parte di framework “Claw” ispirati ad OpenClaw ne hanno seguito le orme e le scelte architetturali cercando ottimizzazioni o semplificazioni rispetto al framework originale. NemoClaw introduce invece la dimensione dell’accountability dell’operato dell’agente e la possibilità di definire guardrails per mitigare comportamenti indesiderati da parte dell’AI, una sorta di implementazione di leggi della robotica che cercano di accelerare il processo di adozione nell’enterprise di queste tecnologie, elemento centrale per la strategia di business di nVidia.

NemoClaw è ancora in early preview, è quindi presto per valutare l’impatto che potrà avere nel panorama dell’Agentic AI, ma è indubbio che l’aspetto delle policy da applicare all’AI quando manipola risorse digitali che possono provocare danni se utilizzate in modo erroneo è importante e potrebbe condizionare i design futuri. L’attuale modello di politiche è abbastanza elementare, non è possibile ad esempio definire macrostati di un sistema in cui una certa azione sia possibile o meno, ma sono sicuro che nel tempo il policy engine si svilupperà se il framework sarà adottato. Non resta quindi che sperimentare ed osservare per capire come NemoClaw condizionerà il futuro (che al ritmo di oggi ha un orizzonte di qualche mese).