Con GPT‑5.5, annunciato ieri sera, OpenAI prova a spostare il discorso sull’intelligenza artificiale generativa fuori dalla logica della semplice risposta migliore.

L’accento, questa volta, cade sul lavoro operativo: comprendere un obiettivo poco definito, usare strumenti, muoversi tra file e interfacce, verificare il risultato e proseguire finché il compito non è davvero concluso.

È una distinzione meno appariscente di un nuovo record di benchmark, ma probabilmente più importante sul piano pratico. Se questa impostazione troverà conferma nell’uso quotidiano, GPT‑5.5 potrebbe consolidare il passaggio dall’assistente conversazionale a un software capace di sostenere attività complesse in sviluppo, analisi documentale e ricerca tecnico-scientifica.

Indice degli argomenti

Dall’assistente conversazionale al collega operativo

OpenAI definisce GPT‑5.5 “a new class of intelligence for real work” e la formula, al di là dell’enfasi promozionale, chiarisce bene dove cade l’accento. Il modello è costruito per gestire compiti sporchi, lunghi e multi-fase, quelli in cui l’utente non fornisce una pipeline pulita ma un obiettivo imperfetto, pieno di ambiguità, file da aprire, strumenti da usare e vincoli da scoprire strada facendo. In questo scenario il parametro decisivo non è la brillantezza di una singola risposta, bensì la capacità di mantenere contesto, pianificare sottotask, fare controlli intermedi e correggersi senza perdere il filo.

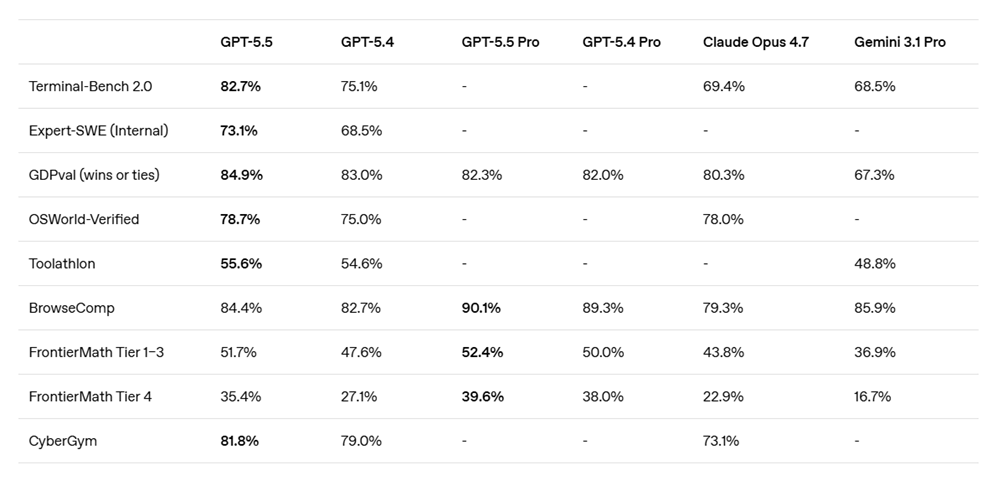

I benchmark che OpenAI mette in primo piano vanno letti proprio in questa chiave. Su Terminal-Bench 2.0, che misura workflow da riga di comando complessi, GPT‑5.5 raggiunge l’82,7 per cento contro il 75,1 di GPT‑5.4. Su OSWorld-Verified, centrato sull’uso autonomo del computer, passa da 75,0 a 78,7.

Su GDPval, che valuta lavori di conoscenza ben specificati in 44 occupazioni, arriva all’84,9 per cento. Non sono numeri che dimostrano una “intelligenza generale”, ma indicano una crescita abbastanza coerente in un’area precisa, quella dei modelli che devono fare più di una buona sintesi testuale.

Il salto si vede soprattutto quando il modello usa strumenti

La parte più interessante del lancio non è la tradizionale tabella di confronto con i concorrenti, ma l’insistenza sull’uso degli strumenti. GPT‑5.5 viene descritto come più efficace nel passare dalla ricerca all’azione, dalla lettura di materiale grezzo alla produzione di documenti, fogli di calcolo, codice e passaggi verificabili. In altri termini, OpenAI prova a spostare il baricentro dal modello che “sa molte cose” al modello che sa lavorare dentro un ambiente digitale.

Questo spiega anche perché Codex occupi uno spazio così centrale nella presentazione. OpenAI sostiene che GPT‑5.5 non solo scriva e corregga meglio il codice, ma tenga il contesto su basi di codice estese, individui fallimenti ambigui e anticipi test e revisioni con meno prompting esplicito. Su SWE-Bench Pro il vantaggio su GPT‑5.4 è modesto, 58,6 contro 57,7, ma su benchmark più agentici il salto è più netto. È un dettaglio importante, perché suggerisce che il progresso più visibile non sia tanto sulla risoluzione puntuale di issue isolate, quanto sulla persistenza in task lunghi e strumentati.

Va aggiunta una cautela. Anche quando i numeri sono solidi, i benchmark restano indicatori incompleti. La stessa OpenAI segnala che su SWE-Bench Pro esistono discussioni sul rischio di memorization, mentre Artificial Analysis ricorda che i suoi indici sintetici sono utili per orientarsi ma non sostituiscono i test su casi d’uso concreti. Il messaggio, in sostanza, è che GPT‑5.5 sembra più credibile come agente operativo, ma il giudizio finale dipenderà dall’affidabilità su workflow reali, non dalla somma dei punteggi.

Per la ricerca scientifica il segnale è serio, ma non ancora definitivo

Il capitolo più rilevante per chi guarda alla ricerca è quello scientifico. OpenAI insiste sul fatto che GPT‑5.5 non si limiti a rispondere a domande difficili, ma sia più persistente nei cicli che contano davvero in laboratorio e nell’analisi computazionale: esplorare un’ipotesi, raccogliere evidenze, testare assunzioni, interpretare risultati e decidere il passo successivo. È una distinzione cruciale, perché gran parte del lavoro scientifico non coincide con il recupero di nozioni, ma con iterazioni lunghe, dati sporchi e decisioni metodologiche.

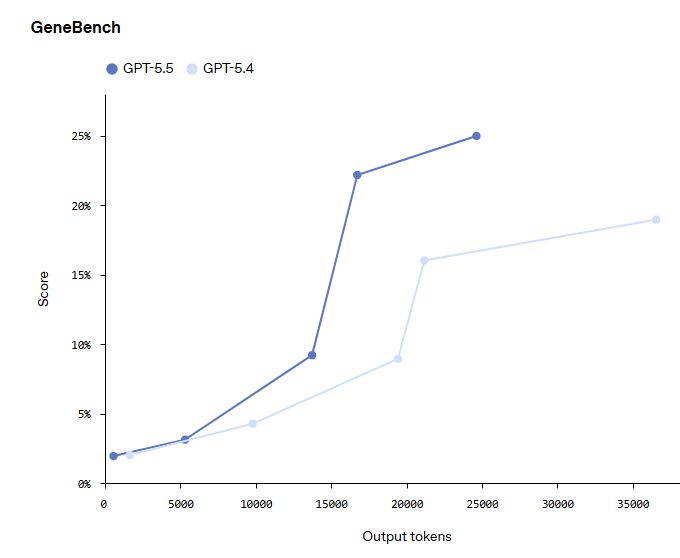

Il nuovo benchmark GeneBench, pubblicato in parallelo da OpenAI e Herasight, è costruito proprio per misurare analisi multi-stadio in genomica e biologia quantitativa. Secondo la documentazione, include 103 valutazioni distribuite su 10 domini e mette alla prova pulizia dei dati, controllo di qualità, scelta dei modelli statistici e interpretazione finale. GPT‑5.5 ottiene il 25 per cento, meglio del 19 di GPT‑5.4, mentre GPT‑5.5 Pro sale al 33,2. Il dato, preso isolatamente, non impressiona come percentuale assoluta. Proprio per questo è interessante. Significa che il benchmark è duro e che il margine di miglioramento del settore resta enorme, anche per i modelli più avanzati.

OpenAI cita anche un risultato su BixBench e persino un nuovo contributo matematico sui numeri di Ramsey, poi verificato in Lean. Sono segnali da prendere sul serio perché mostrano un allargamento del perimetro applicativo.

Allo stesso tempo non autorizzano scorciatoie narrative sull’“AI scienziato” già maturo. La lezione che emerge da GeneBench è quasi opposta al trionfalismo: i modelli stanno diventando utili come partner cognitivi, ma nei domini scientifici più complessi la differenza la fanno ancora orchestrazione, verifica esterna e supervisione esperta.

Dietro il modello c’è anche una partita industriale

Un altro elemento che distingue GPT‑5.5 dai lanci precedenti riguarda l’infrastruttura. OpenAI afferma di aver ottenuto un livello di intelligenza superiore mantenendo la latenza per token di GPT‑5.4 nel servizio reale. Per riuscirci ha ridisegnato il sistema di inferenza come un problema integrato e ha utilizzato, oltre al nuovo hardware NVIDIA GB200 e GB300 NVL72, anche Codex e lo stesso GPT‑5.5 per ottimizzare parti dello stack. Il caso raccontato più chiaramente riguarda gli algoritmi di bilanciamento del carico e di partizionamento delle richieste, che secondo OpenAI hanno portato a un aumento superiore al 20 per cento nella velocità di generazione dei token.

È un passaggio meno spettacolare di un benchmark, ma forse più importante sul piano industriale. I modelli di frontiera non si giocano soltanto sulla qualità delle risposte. Si giocano su costo marginale, velocità, efficienza token per compito e sostenibilità operativa. In questo senso GPT‑5.5 appare come un modello pensato fin dall’inizio per l’uso produttivo, non solo per il primato di laboratorio. Anche il pricing va letto in questa chiave. OpenAI indica per l’API un prezzo di 5 dollari per milione di token in input e 30 in output, il doppio di GPT‑5.4, con una finestra di contesto da un milione di token. La società precisa però che la disponibilità API arriverà a breve, non è ancora una voce pienamente operativa. La scommessa è che una maggiore efficienza sul compito compensi almeno in parte il costo nominale più alto, soprattutto nei workflow in cui il modello riesce a usare meno token per arrivare al risultato.

Sicurezza e affidabilità, il punto su cui si misurerà davvero

Il lancio di GPT‑5.5 arriva accompagnato da un system card insolitamente ricco. OpenAI colloca il modello al livello High sia per il dominio biologico e chimico sia per quello cyber, pur dichiarandolo sotto la soglia Critical. Sul piano operativo questo si traduce in classificatori più severi per richieste cyber ad alto rischio, controlli più stretti sui pattern di abuso ripetuto e una logica di conferma per le azioni sensibili durante l’uso del computer.

Ci sono anche segnali positivi sul versante dell’affidabilità. Nelle conversazioni che gli utenti avevano segnalato in passato come factuality-prone, GPT‑5.5 mostra affermazioni individuali corrette con una probabilità superiore del 23 per cento e contiene errori fattuali nel 3 per cento di risposte in meno rispetto a GPT‑5.4. Inoltre migliora nei test progettati per evitare azioni distruttive accidentali sui dati degli utenti, un aspetto cruciale se il modello deve diventare davvero un operatore software e non solo un sistema di consultazione.

Resta però un punto aperto, e sarebbe sbagliato minimizzarlo. Nel system card si legge che UK AISI ha trovato un jailbreak universale capace di produrre contenuti cyber vietati anche in scenari multi-turno agentici. OpenAI dichiara di avere aggiornato successivamente lo stack di mitigazione, ma la configurazione finale non è stata verificata da UK AISI per un problema di configurazione della build fornita ai test. È uno di quei dettagli che contano più della retorica di lancio. Non smentisce il progresso del modello, ma ricorda che la robustezza dei sistemi agentici resta un bersaglio mobile.

Quanto cambia davvero il mercato dei modelli

Per gli utenti ChatGPT il cambiamento immediato è l’arrivo di GPT‑5.5 Thinking su Plus, Pro, Business ed Enterprise, mentre la variante Pro è riservata a Pro, Business ed Enterprise. Per gli sviluppatori la questione è più sottile. GPT‑5.5 promette di valere il sovrapprezzo se il compito richiede pianificazione, tool use, codice, documenti complessi e ricerca ad alta densità informativa. Dove invece conta soprattutto il costo per risposta, GPT‑5.4 resta un’opzione razionale.

La vera scommessa di OpenAI, in ogni caso, non riguarda un singolo modello ma una traiettoria industriale. GPT‑5.5 suggerisce che la competizione tra laboratori si stia spostando dai modelli che scrivono meglio ai modelli che riescono a portare a termine un lavoro con meno supervisione. È in questo punto che coding, computer use e ricerca scientifica iniziano a toccarsi davvero. Non perché l’autonomia piena sia dietro l’angolo, ma perché la divisione del lavoro tra persone e software comincia ad assumere una forma più concreta e meno dimostrativa.

Bibliografia

OpenAI Deployment Safety Hub, “GPT‑5.5 System Card”

Artificial Analysis, “Intelligence Benchmarking Methodology”