I terminali stupidi degli anni ’80 erano macchine senza capacità di elaborazione autonoma, completamente dipendenti dal mainframe centrale. Eppure, proprio questa limitazione garantiva stabilità, sicurezza e controllo che i sistemi moderni faticano ancora a replicare.

Ripercorrere la storia di quegli strumenti “passivi” aiuta a capire quanto sia cambiato — e quanto si sia complicato — il mondo dell’informatica aziendale.

Indice degli argomenti

Stupido non è un insulto: l’usabilità come obiettivo del software

In informatica, l’aggettivo “stupido” (o “dumb” se preferite l’inglese) non è necessariamente offensivo. Sviluppare un software, un’interfaccia “a prova di stupido” vuol dire realizzare qualcosa che anche una persona non proprio preparatissima è in grado di utilizzare agevolmente e senza sbagliare.

E, credetemi, non è per niente facile tenere alta l’usabilità di un software, soprattutto se di largo uso. “Interfaccia usabile” è il termine un po’ più elegante per esprimere più o meno lo stesso concetto.

L’era dei terminali stupidi: centralizzazione e controllo totale

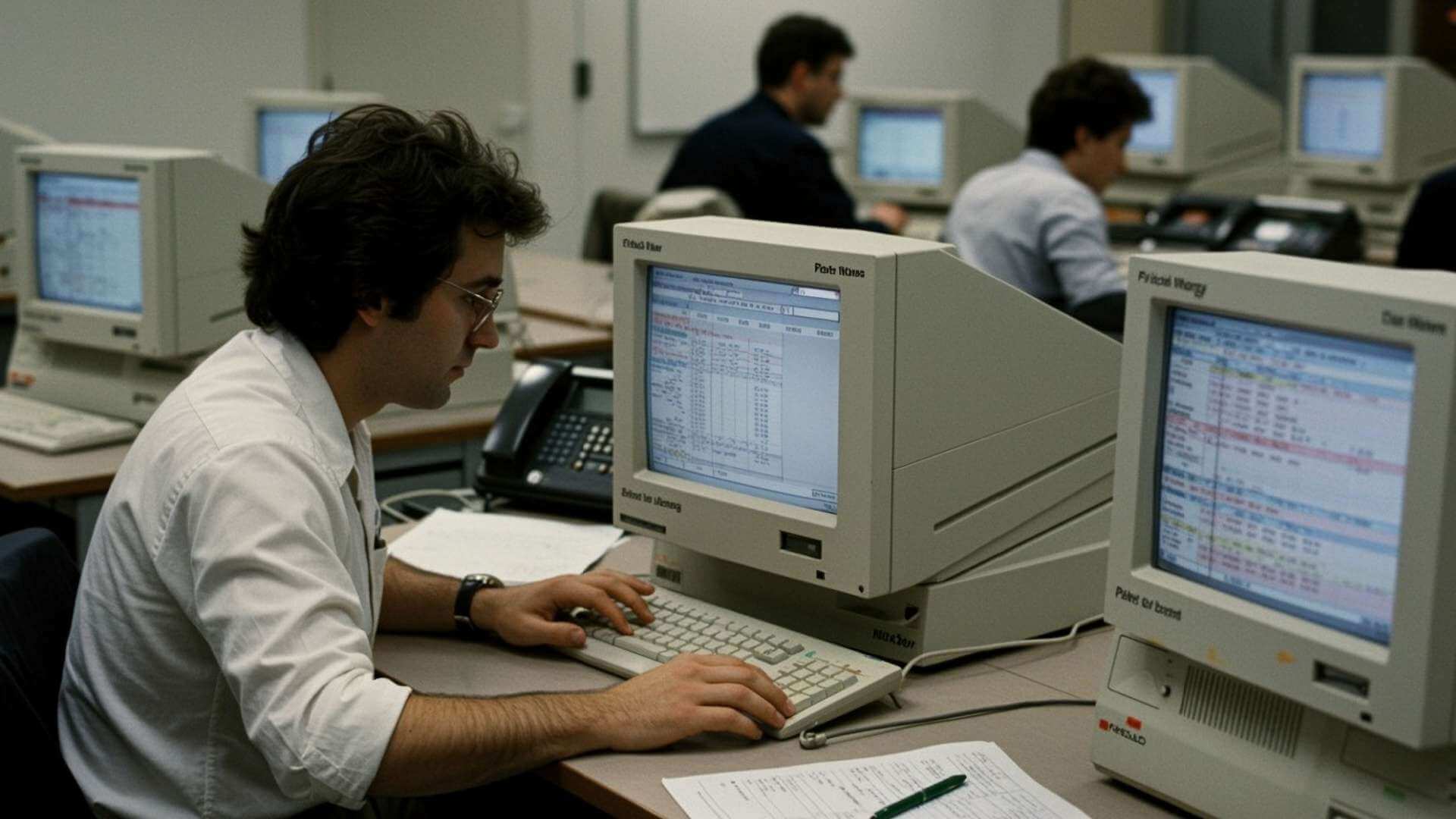

Fino agli anni ’80, gli utenti interagivano con terminali stupidi (dumb terminals, appunto) ma prima che vi venga il sospetto che Internet sia nata dalla stupidità globale degli sviluppatori, vediamo di chiarire il concetto.

La struttura di base dell’informatica pre-Internet ed anche pre-PC era quella basata sulla centralizzazione: un grande computer unico che elaborava le informazioni, e tanti schermi con tastiera ad esso collegati, di solito via cavo. Le funzioni dei terminali non erano impostate “a bordo”, ma venivano completamente gestite dal sistema centrale, detto in gergo mainframe.

L’utente aveva a disposizione solo quanto disposto dall’amministratore di sistema e non poteva né installare nuovi software, né uscire in qualche modo dalla rete aziendale. Nessuna “navigazione”, insomma.

Nessun virus, nessun social: il paradiso (perduto) degli amministratori di sistema

Se usare questi terminali (“stupidi” perché non avevano nessuna capacità di elaborazione) poteva essere in qualche modo frustrante per l’operatore, che già allora pretendeva qualcosa di più smart, per gli informatici era una vera pacchia: sistemi operativi stabili, software in larga parte “fatto in casa” e soprattutto utenti tenuti al guinzaglio senza possibilità di infettarsi con virus e malware, esfiltrare dati, giocare in rete o andare sui social network (che non esistevano).

Arriva il Personal Computer: libertà per gli utenti, guai per l’IT

E poi, a metà anni ’80, arriva Lui: il Personal Computer. Felicità degli utenti, che cominciano a fare un po’ quello che vogliono (anche se i primi sistemi operativi tipo DOS non davano molta soddisfazione, senza grafica e con lo schermo in bianco e nero. Diversa la storia per l’Apple Macintosh, splendida idea ma rimasta sempre confinata in una nicchia).

E per i responsabili IT cominciano a profilarsi i primi guai, chiamati virus, problemi su sistema operativo, su software applicativi, su dispositivi esterni. Da semplici televisori con tastiera si passa a macchine “intelligenti” e per questo meno controllabili. Non c’è ancora Internet, ma i software, principalmente giochi, si comprano su CD in edicola. E, guarda caso, qualche collega si fa reinstallare il PC ogni mese perché “si è impallato”.

Le reti e Internet: opportunità infinite, problemi di sicurezza inediti

Arrivano le reti. Prima locali (collegano i PC dell’ufficio e magari qualche server) poi geografiche, che escono dal Palazzo e permettono di interagire con il mondo. Utenti al settimo cielo, CIO (Chief Infomation Officer, ovvero Capo CED, Centro Elaborazione Dati) con le mani nei capelli, se ne hanno ancora. L’enorme potenzialità della Rete delle Reti dà la stura ad una quantità di problemi di sicurezza e di gestione dei sistemi informatici fino ad allora sconosciuti. Anche perché molto spesso gli addetti informatici sono ferrati in sviluppi COBOL e RPG e mal si adattano alle nuove filosofie di sviluppo, principalmente object-oriented, e soprattutto alle insidie della rete IP.

COBOL, RPG e la difficoltà di adattarsi al nuovo

Per i più giovani: COBOL e RPG sono linguaggi di programmazione ormai desueti ma che hanno costituito l’ossatura dei sistemi di elaborazione dati per molti anni; si calcola che circa l’80% dei software in ambito bancario sia tuttora basato su questi vecchi arnesi).

L’intelligenza artificiale: il nuovo coltellino svizzero (con qualche rischio)

Infine, dopo il Covid e l’Europeo di calcio vinto dall’Italia, arriva l’intelligenza artificiale, che sta monopolizzando da diversi anni il dibattito su Internet, anche se non si tratta di un’invenzione proprio recente. Presto diventa il coltellino svizzero sul luogo di lavoro, la si usa anche quando se ne potrebbe fare tranquillamente a meno. E anche in questo caso ci sono grattacapi informatici, principalmente per dati personali e sensibili che vengono inserite con troppa leggerezza nelle fauci del motore di IA preferito, o per la troppa fiducia riposta in questi sistemi.

Il PC è uno strumento di lavoro: lo dimentichiamo troppo spesso

Alla fine della storia, spesso non ci ricordiamo che il PC in ufficio (desktop, laptop, tablet o cosa volete voi) è uno strumento di lavoro e come tale andrebbe utilizzato, anche se somiglia moltissimo a quello di casa, o alla Playstation.

Funzioni avanzate inutilizzate: Word 5.5 e la nostalgia del software essenziale

Da non trascurare, inoltre, che i moderni PC Playstation-like hanno funzioni anche avanzatissime ma spesso seminascoste o comunque non utilizzate dalla maggior parte degli utenti, che potrebbero tranquillamente utilizzare i computer di dieci anni prima.

Ricordo infatti con una certa nostalgia la versione 5.5 di Word per DOS (prima di Windows, si parla del 1990) che con un software di soli 2 Megabyte permetteva di fare la gran parte delle attività di word processing per le quali oggi si ritiene necessario un PC ultra potente ed un software, Microsoft 365, non proprio leggero ed economico.

I computer del 2026 sono davvero necessari? Il ritorno (nostalgico) ai terminali

E a questo punto una domanda sorge spontanea, come direbbe l’indimenticato giornalista Antonio Lubrano. Ma siamo sicuri che i computer del 2026, tutta grafica, colori, prestazioni e spazio disco siano davvero necessari?

Forse i responsabili IT sono un po’ nostalgici, soprattutto se sono boomer come chi scrive: ma il tempo dei terminali stupidi (pardon: passivi) aveva i suoi bei vantaggi.

Stupido è chi stupido fa, direbbe Forrest Gump. E i terminali stupidi lo erano di nome ma non certo di fatto.