Il vademecum dell’Ordine degli avvocati di Roma, pubblicato il 17 febbraio 2026 dalla commissione processo civile, fissa principi e obblighi per l’uso dell’AI nella professione forense, ma non indica quali strumenti utilizzare.

Tradurre quei principi in scelte tecniche spetta a ciascuno studio. La scelta non è semplice: il mercato delle soluzioni di intelligenza artificiale per il settore legale è in una fase di trasformazione accelerata, con nuovi attori, nuove architetture e un riassetto competitivo senza precedenti.

Per orientarsi servono criteri chiari. Quelli che emergono dal vademecum e dalla la legge italiana sull’intelligenza artificiale (L. 132/2025) possono essere sintetizzati in cinque domande che ogni avvocato dovrebbe porsi prima di adottare qualsiasi strumento.

Indice degli argomenti

Framework normativo

Dove finiscono i dati che inserisco? Vengono utilizzati per addestrare il modello? Le fonti giuridiche citate sono verificabili? Il fornitore opera in Unione europea? Il sistema mi consente di adempiere all’obbligo di trasparenza verso il cliente previsto dall’articolo 13 della legge 132/2025?

Una precisazione necessaria sul quadro normativo: la legge 132/2025 non è l’attuazione italiana dell’AI Act europeo. Il Regolamento UE 2024/1689 (AI Act) è direttamente applicabile in tutti gli Stati membri senza bisogno di trasposizione.

La legge 132/2025 è uno strumento normativo italiano autonomo, che disciplina aspetti specifici dell’uso dell’AI nell’ordinamento nazionale, tra cui, all’articolo 13, l’impiego nell’attività professionale.

I due strumenti sono complementari: l’AI Act fissa i requisiti generali per i sistemi di AI ad alto rischio (inclusi quelli usati nell’amministrazione della giustizia), la legge 132 definisce gli obblighi specifici per il professionista italiano.

Lo studio legale che adotta strumenti di AI deve confrontarsi con entrambi. Accanto ai criteri di compliance, c’è una domanda altrettanto fondamentale e più concreta: per farne cosa? Non tutti gli strumenti servono allo stesso scopo. La ricerca giurisprudenziale, la redazione di un atto, l’analisi di un contratto complesso, il monitoraggio normativo sono attività diverse, che richiedono strumenti diversi.

Un responsabile di studio che deve scegliere ha bisogno di sapere non solo se una piattaforma è conforme, ma cosa permette di fare ai propri collaboratori nella pratica quotidiana. Partendo da queste due coordinate, conformità e funzione, è possibile mappare quattro livelli di soluzioni.

Primo livello: intelligenza artificiale negli studi legali con modelli generalisti

I modelli di AI generativa come Claude (Anthropic), ChatGPT (OpenAI) e Gemini (Google) sono strumenti di ragionamento e produzione testuale. Non sono banche dati e non contengono un archivio giuridico strutturato.

Il loro valore per un avvocato sta altrove: nella capacità di analizzare un testo complesso e restituirne una sintesi ragionata, di impostare la struttura argomentativa di un parere, di rielaborare una bozza in un registro diverso, di confrontare clausole contrattuali e identificare incongruenze, di esplorare le implicazioni di una norma da più angolazioni.

Sono, in sostanza, un interlocutore cognitivo che accelera il lavoro di pensiero.

Nella pratica di studio, questo si traduce in scenari concreti. Un associato che deve preparare una memoria può sottoporre al modello la propria bozza e chiedere di identificarne le debolezze argomentative.

Il titolare che riceve un contratto di 80 pagine può ottenere in pochi minuti un’analisi delle clausole critiche con evidenziazione dei rischi.

Un praticante può usare il modello per esplorare un tema giuridico nuovo e ottenere un primo inquadramento delle questioni rilevanti, da approfondire poi sulle fonti.

Sono attività che prima richiedevano ore e che oggi richiedono minuti, a patto di sapere che ogni output va verificato, perché il modello può produrre riferimenti normativi o giurisprudenziali inesatti o del tutto inventati.

Il limite strutturale

Nessuno di questi modelli dispone di una banca dati giuridica integrata e verificata. Le citazioni di norme e sentenze possono essere imprecise o fabbricate, si tratta del fenomeno delle allucinazioni che il vademecum romano menziona esplicitamente come rischio primario.

Per questo, i modelli generalisti non sostituiscono la ricerca giurisprudenziale: la affiancano. Servono a ragionare, non a citare.

Il legal plugin di Claude Cowork

Il 30 gennaio 2026, Anthropic ha lanciato una serie di plugin specializzati per Claude Cowork, la versione agentica di Claude progettata per eseguire attività complesse in più passaggi.

Il plugin legale aggiunge funzionalità specifiche: contract review clausola per clausola con segnalazione dei rischi (classificati per gravità), triage di NDA, monitoraggio della compliance, generazione di redline basate sui playbook dell’organizzazione e briefing strutturati.

A differenza di un chatbot generico, il sistema può accedere a una cartella di file sul computer dell’utente, leggere documenti, crearne di nuovi e orchestrare più passaggi in sequenza: non è una conversazione, è un flusso di lavoro.

L’architettura è significativa dal punto di vista della protezione dei dati: il sistema può accedere a file locali dell’utente e utilizzarli come contesto per l’elaborazione, i playbook sono file markdown archiviati sulla macchina dell’utente, i connettori utilizzano il Model Context Protocol (MCP), uno standard aperto.

Va precisato che i contenuti vengono comunque trasmessi ai server di Anthropic per l’elaborazione, ma non vengono utilizzati per l’addestramento del modello.

L’impatto sui mercati è stato immediato: nelle sedute successive all’annuncio dell’intera suite di plugin Cowork, i titoli di Thomson Reuters hanno perso circa il 20%, quelli di RELX (proprietaria di LexisNexis) il 14%, Wolters Kluwer il 10,5%.

Il plugin legale era solo uno dei tasselli, ma il segnale al mercato era inequivocabile: per la prima volta, un produttore di foundation model entrava direttamente nel mercato delle applicazioni professionali, invece di limitarsi a fornire l’infrastruttura ai vendor specializzati.

Le reazioni sono state rapide: il 24 febbraio, Anthropic ha annunciato partnership con Harvey, LexisNexis (che ha integrato il plugin nel proprio sistema Protégé), Intapp e LegalZoom, segnalando una strategia di complementarietà più che di sostituzione.

Va precisato che il legal plugin è attualmente in research preview. Anthropic stessa sconsiglia l’uso per workload regolamentati. Non è un prodotto enterprise con supporto, deploy centralizzato e garanzie contrattuali.

Per un avvocato italiano, oggi, usare Claude Cowork per rivedere un contratto è tecnicamente possibile e il profilo di protezione dei dati è interessante, manca però l’elemento cruciale richiesto dal vademecum, la verificabilità delle fonti giuridiche.

Profilo di conformità: il rischio dipende in larga misura dalla versione utilizzata. Le interfacce gratuite o consumer presentano un profilo di rischio alto se usate con dati del fascicolo: i dati possono transitare su server extra-UE e, in alcuni casi, essere utilizzati per l’addestramento del modello.

Le licenze enterprise (ChatGPT Enterprise, Claude for Enterprise, Gemini for Business) riducono drasticamente questo rischio, garantendo contrattualmente l’isolamento dei dati, il divieto di addestramento e, in alcuni piani, la residenza dei dati in UE.

Claude Cowork in locale offre un profilo ancora più protetto, con il dato che resta sulla macchina dell’utente. Resta, in ogni caso, il limite strutturale dell’assenza di fonti giuridiche verificate, questi strumenti vanno usati per ragionamento, bozze e analisi, non come sostituto di una banca dati.

Rimane, soprattutto, il principio cardine del vademecum, indipendentemente dalla versione scelta, la responsabilità della verifica di ogni output è interamente in capo all’avvocato.

Una menzione spetta anche a Microsoft 365 Copilot, che integra funzionalità di AI generativa direttamente in Word, Outlook e Teams.

Per molti studi legali italiani è il punto d’ingresso de facto nell’intelligenza artificiale, perché lo trovano già dentro gli strumenti che usano quotidianamente, con standard di sicurezza enterprise e gestione centralizzata delle policy.

Copilot condivide però lo stesso limite dei modelli generalisti, non dispone di una banca dati giuridica italiana integrata, e ogni output va verificato sulle fonti.

Secondo livello: intelligenza artificiale negli studi legali con piattaforme verticali italiane ed europee

Se i modelli generalisti sono strumenti di ragionamento, le piattaforme verticali sono strumenti di ricerca e verifica.

La loro funzione primaria è dare all’avvocato accesso rapido e affidabile al patrimonio normativo e giurisprudenziale: trovare la sentenza pertinente, verificare lo stato di una norma, costruire un parere con fonti citabili e scaricabili.

Alcune estendono le proprie funzionalità alla redazione assistita di atti e all’analisi documentale, ma il cuore della proposta è la qualità e la verificabilità delle fonti.

Per un responsabile di studio, questo significa che la piattaforma verticale è lo strumento che un associato apre quando deve fondare un’argomentazione su un precedente, quando deve verificare se una linea giurisprudenziale è consolidata o in evoluzione, quando deve controllare che i riferimenti normativi in un atto siano aggiornati.

Questo è anche lo strumento che protegge lo studio dal rischio reputazionale più insidioso, citare una sentenza inesistente generata da un chatbot.

Le piattaforme costruite per il mercato legale italiano ed europeo rispondono nativamente a molti dei requisiti posti dal vademecum: fonti verificate e citabili, server in UE, conformità GDPR, interfacce progettate per il flusso di lavoro forense.

Il compromesso riguarda la flessibilità (sono strumenti specializzati, meno versatili dei generalisti per il ragionamento astratto) e il costo.

Lexroom

Fondata a Milano nel 2023 da Martina Domenicali, Andrea Lonza e Paolo Fois, Lexroom è oggi una delle realtà più finanziate del legal tech europeo.

A settembre 2025 ha chiuso un round di Serie A da 16 milioni di euro guidato dal fondo Base10 Partners, con la partecipazione di Acurio Ventures, del fondo View Different di Diego Piacentini e di Riccardo Zacconi.

La piattaforma integra intelligenza artificiale generativa con un database giuridico proprietario di oltre cinque milioni di documenti e dichiara un tasso di accuratezza del 97% nei quesiti legali.

La funzionalità che interessa di più al responsabile di studio è in realtà triplice: ricerca in linguaggio naturale con generazione di bozze di parere complete di fonti citate, analisi documentale (caricamento di contratti e atti per comparazione, estrazione di clausole, revisione) e redazione assistita di atti processuali.

I moduli per area del diritto, sviluppati con studi di primo piano come Gianni & Origoni, Ichino Brugnatelli, GPBL, Trevisan & Cuonzo e altri, integrano normativa, giurisprudenza e prassi operative specifiche.

La piattaforma consente inoltre di caricare documenti propri e interrogarli con la stessa potenza del motore di ricerca generale, un vantaggio concreto per gli studi che vogliono valorizzare il proprio patrimonio di conoscenza interna.

Certificazione ISO 27001, conformità GDPR e AI Act dichiarate. Diversi Ordini degli avvocati hanno stipulato convenzioni per i propri iscritti.

Simpliciter

Simpliciter si presenta come la prima piattaforma italiana ad aver integrato l’AI generativa con banche dati normative e giurisprudenziali, fin dal 2023.

Offre ricerca giuridica in linguaggio naturale con accesso a milioni di pronunce, supporto alla redazione di contratti e atti, la possibilità di creare banche dati private in cui caricare i propri documenti, anche scansionati, per consulenze personalizzate.

La piattaforma si è progressivamente estesa ad altri paesi europei. Per lo studio che cerca un punto d’ingresso nell’AI legale con un’interfaccia semplice e un database solido, è un’opzione da valutare.

Doctrine

Di origine francese, Doctrine è operativa in Italia con oltre duemila professionisti e più di quindicimila in Europa.

Il suo elemento distintivo è il Legal Graph, una rete dinamica che interconnette le fonti giuridiche tra loro, con oltre 35 milioni di collegamenti aggiornati in tempo reale.

Non si limita a restituire un elenco di risultati: collega ogni pronuncia con le norme applicate, i precedenti citati e le decisioni successive, riproducendo la logica di navigazione che un giurista esperto seguirebbe manualmente.

Con Doctrine Flow, la piattaforma entra anche nella gestione documentale, ordinamento automatico dei fascicoli, sintesi dei fatti e ricostruzione della cronologia di una vicenda.

Per studi che gestiscono contenziosi complessi con fascicoli voluminosi, è una funzionalità che fa la differenza.

Lisia

Lisia è focalizzata su un’unica funzione, che svolge con precisione: la ricerca giurisprudenziale.

Dispone di un database di oltre sei milioni di sentenze integrali e massime (Cassazione, tribunali di merito, TAR e Consiglio di Stato) e consente la ricerca in linguaggio naturale, evidenziando direttamente il passaggio della sentenza che contiene la risposta.

Per un avvocato che fa molto contenzioso e ha bisogno di trovare il precedente giusto velocemente, è lo strumento da valutare. Per la redazione di atti e l’analisi documentale, va integrato con altri strumenti.

Aptus.AI

Aptus.AI si colloca su un segmento diverso, non è pensato per il contenzioso ma per la compliance.

Monitora in tempo reale le modifiche legislative e regolamentari, genera alert personalizzati per area di interesse e offre un assistente per interrogare database normativi in linguaggio naturale.

Il suo target naturale sono i compliance officer, i consulenti d’impresa e gli avvocati in-house che devono garantire che l’organizzazione resti allineata al quadro regolamentare in evoluzione.

Per uno studio con una pratica significativa in diritto regolamentare, bancario o delle telecomunicazioni, il monitoraggio automatizzato può sostituire ore di rassegna manuale.

Profilo di conformità: buono. Fonti verificabili, server in UE, citazioni puntuali.

Il trade-off riguarda il costo (abbonamenti variabili, spesso con pricing personalizzato), il possibile lock-in e una copertura che può essere disomogenea a seconda dell’area del diritto.

Terzo livello: piattaforme enterprise globali per intelligenza artificiale negli studi legali

Le piattaforme enterprise non risolvono un singolo problema, provano a risolverne molti contemporaneamente.

Ricerca, redazione, analisi documentale, gestione dei workflow, collaborazione tra team, integrazione con l’infrastruttura IT dello studio, tutto in un unico ambiente.

Il loro valore è l’integrazione, l’avvocato non deve saltare da uno strumento all’altro e lo studio ha un punto di controllo centralizzato su chi usa cosa e come.

Sono progettate per organizzazioni in cui decine o centinaia di professionisti devono lavorare sulla stessa piattaforma, con audit trail, permessi di accesso e reportistica.

Harvey

Harvey ha raggiunto a dicembre 2025 una valutazione di 8 miliardi di dollari dopo un round da 160 milioni guidato da Andreessen Horowitz.

La sua architettura è ibrida, utilizza un modello custom sviluppato con OpenAI, integrato con modelli di Anthropic e Google, attinge a oltre 200 fonti legali su più di 60 giurisdizioni.

Gli utenti hanno creato oltre 18.000 workflow personalizzati.

Nella pratica, questo significa che un team di due diligence può caricare un’intera data room e ottenere un’analisi strutturata dei rischi in una frazione del tempo tradizionale.

Un dipartimento legale corporate può costruire un workflow per il triage automatico degli NDA in ingresso, con classificazione per rischio e escalation predefinite.

Un grande studio può creare template di analisi personalizzati che riflettono la propria metodologia e riutilizzarli su ogni nuovo incarico.

Harvey si integra con Microsoft 365, iManage, NetDocuments e SharePoint.

Il 24 febbraio 2026 ha annunciato l’integrazione con Anthropic tramite MCP, un utente di Claude può richiamare i workflow legali di Harvey direttamente dall’interfaccia di Claude.

Parallelamente, LexisNexis ha integrato il plugin legale di Claude nel proprio sistema Protégé, combinando le capacità agentiche di Anthropic con il proprio patrimonio di dati.

È un ecosistema potente ma chiuso: quello che si costruisce dentro Harvey resta dentro Harvey. Il costo non è pubblico e richiede una trattativa dedicata.

Legora

Legora ha raccolto 150 milioni di dollari raggiungendo una valutazione di 1,8 miliardi di dollari.

Si basa prevalentemente su modelli Anthropic e si posiziona come piattaforma per l’automazione del lavoro legale su larga scala.

Come Harvey, è pensata per il segmento enterprise e per il mercato anglosassone, con espansione internazionale in corso.

Profilo di conformità: elevato in termini di sicurezza, audit trail e segregazione dei dati.

Il costo però è significativo, il lock-in rilevante, per la gran parte degli studi italiani, studi individuali o con pochi associati, rappresentano una soluzione sproporzionata.

Quarto livello: intelligenza artificiale negli studi legali con deployment on-premise

Il deployment locale di modelli open-weight come Llama (Meta) o Mistral (Mistral AI) su un server interno o una workstation dedicata serve essenzialmente a una cosa, avere la potenza di ragionamento di un modello generalista senza che i dati escano dallo studio.

Le capacità sono simili a quelle descritte per il primo livello, sintesi, analisi, redazione di bozze, esplorazione argomentativa, ma con una differenza strutturale: il dato resta nel perimetro fisico e informatico dello studio, non transita su server di terze parti e non viene utilizzato per addestrare alcun modello esterno. Per lo studio legale che tratta abitualmente dati ad alta sensibilità, fascicoli penali, contenziosi in materia sanitaria, operazioni di M&A riservate, è la soluzione che consente di sfruttare l’AI senza compromettere in alcun modo il segreto professionale.

Nella lettera di incarico, lo studio può dichiarare che nessun dato del cliente viene trasmesso a terze parti, un elemento di conformità e di valore reputazionale insieme.

Il limite è lo stesso dei generalisti in cloud, nessuna banca dati giuridica integrata. Chi sceglie questa strada deve verificare ogni riferimento sulle banche dati tradizionali o su una piattaforma verticale.

Si aggiungono i costi di hardware, una workstation adeguata per modelli di dimensioni medie (7-13 miliardi di parametri) può costare dai 3.000 ai 6.000 euro; per far girare modelli più potenti come Llama 3 70B con velocità accettabile, l’investimento sale significativamente, oppure si ricorre a soluzioni di cloud privato (VPC) che mantengono l’isolamento dei dati pur delegando la potenza di calcolo.

A questo si aggiungono le competenze tecniche per configurazione e manutenzione, una velocità di elaborazione generalmente inferiore rispetto alle soluzioni cloud.

Profilo di conformità: eccellente per la protezione dei dati; debole per la verificabilità delle fonti giuridiche. Va combinato con altri strumenti per la ricerca.

Come scegliere: l’approccio combinato tra intelligenza artificiale negli studi legali e banche dati

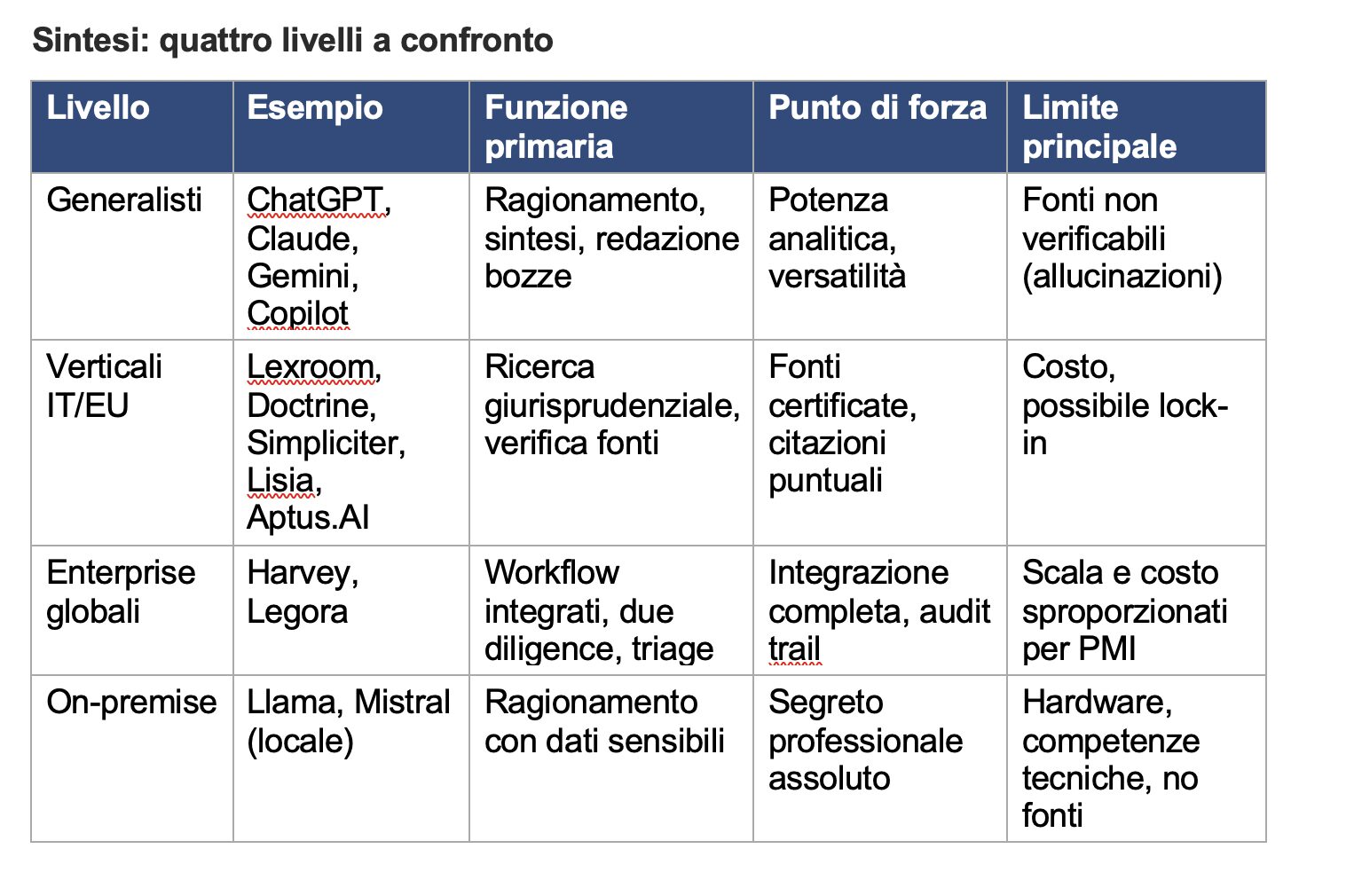

La mappa dei quattro livelli mostra con chiarezza che nessuna soluzione singola risponde contemporaneamente a tutti i requisiti del vademecum e a tutte le esigenze operative di uno studio.

I modelli generalisti eccellono nel ragionamento ma mancano di fonti verificate. Le piattaforme verticali offrono fonti affidabili ma sono meno versatili per l’analisi e la redazione. Le enterprise risolvono quasi tutto, ma a un prezzo e una scala inaccessibili per la maggioranza degli studi italiani.

L’on-premise protegge i dati come nessun’altra soluzione, ma non sostituisce una banca dati. Nella pratica, la configurazione più realistica per uno studio italiano è un approccio combinato, un modello generalista (o un deployment locale per chi tratta dati molto sensibili) per il ragionamento giuridico, la redazione di bozze e l’analisi documentale, affiancato da una piattaforma verticale per la ricerca giurisprudenziale e la verifica delle fonti.

Una configurazione che risponde ai cinque criteri di compliance posti in apertura, il dato è protetto, le fonti sono verificabili, il fornitore opera in UE, l’obbligo di trasparenza verso il cliente è assolto dichiarando nella lettera di incarico quali strumenti si utilizzano e con quale ruolo.

La scelta specifica dipende da tre variabili, la dimensione dello studio, la sensibilità dei dati trattati abitualmente e il budget disponibile. Un avvocato individuale che tratta contenzioso civile avrà esigenze diverse da un dipartimento legale corporate che gestisce centinaia di NDA al mese.

In entrambi i casi, il punto di partenza è lo stesso, capire cosa serve fare, poi scegliere lo strumento che lo fa nel modo più conforme. Il mercato si muove a velocità senza precedenti: il legal plugin di Anthropic ha un mese di vita, le partnership tra vendor si ridisegnano ogni settimana, nuove funzionalità emergono con cadenza ravvicinata.

I principi fissati dal vademecum dell’Ordine di Roma e dalla legge 132/2025, responsabilità dell’avvocato, trasparenza, protezione dei dati, verifica umana degli output, resteranno validi a lungo, indipendentemente dallo strumento scelto. Chi parte da quei principi per selezionare la propria dotazione tecnologica non sbaglia, perché sceglie con consapevolezza e non per moda.