La generazione visuale sta uscendo dalla stagione dell’effetto sorpresa. Per anni il criterio dominante è stato la capacità di produrre immagini belle, fotorealistiche o stilisticamente riconoscibili.

Con ChatGPT Images 2.0, OpenAI prova a spostare il confronto su un piano più esigente: immagini capaci di contenere testo leggibile, mantenere coerenza tra scene diverse, rispettare vincoli compositivi e usare informazioni aggiornate senza trasformare ogni richiesta in una lunga sequenza di correzioni manuali.

La nuova release, presentata a fine aprile 2026, segnala una fase più matura della generazione d’immagini dentro ChatGPT, dove il modello non serve soltanto a disegnare una scena ma entra nel lavoro di progettazione, impaginazione, revisione e produzione seriale.

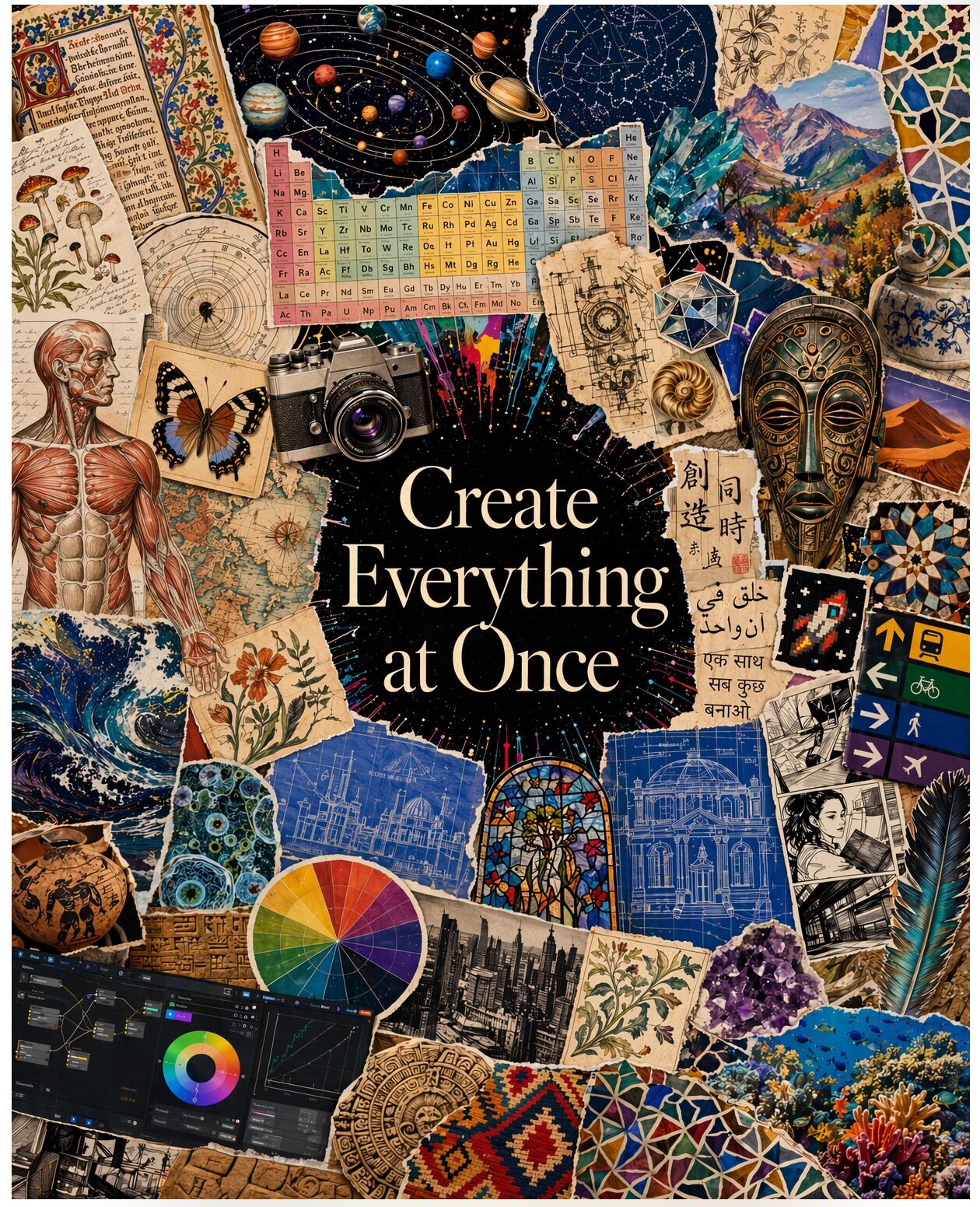

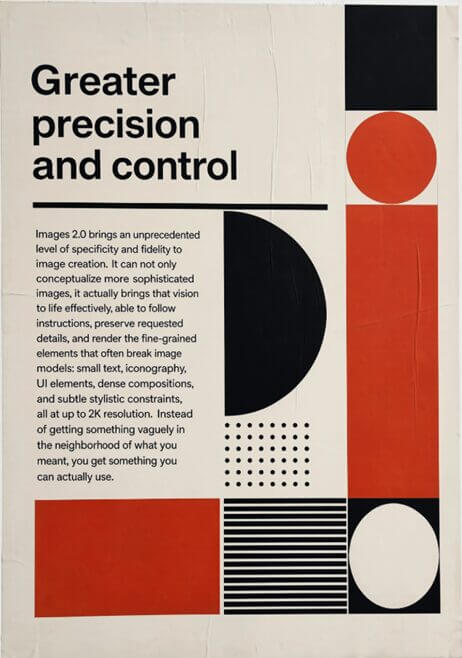

Figura 1. Poster generato con ChatGPT Images 2.0 per illustrare maggiore precisione, controllo compositivo e resa del testo. Fonte: OpenAI.

Indice degli argomenti

ChatGPT Images 2.0, non basta più una bella immagine

La direzione era già emersa con l’integrazione della generazione visuale in GPT-4o, quando OpenAI aveva insistito sull’idea di immagini più utili, non soltanto più spettacolari. Images 2.0 riprende quella traiettoria e la rende più esplicita. L’obiettivo è generare materiali che possano essere usati in contesti concreti: un’infografica scientifica, una locandina, una pagina a fumetti, un mockup editoriale, una campagna promozionale o un supporto didattico.

La differenza, per chi lavora con contenuti professionali, è sostanziale. Un’immagine singola può essere impressionante anche se contiene piccoli errori. Un artefatto destinato alla comunicazione, invece, deve reggere a uno sguardo più severo. Deve contenere parole corrette, disporre gli elementi in modo leggibile, mantenere personaggi e oggetti coerenti, rispettare un formato e produrre un risultato che non sembri una bozza casuale uscita bene per fortuna. È su questo terreno, più che sul fotorealismo puro, che Images 2.0 cerca di distinguersi.

Il banco di prova resta il testo nelle immagini

Il rendering del testo è da tempo una delle prove più difficili per i generatori visuali. Anche modelli avanzati hanno spesso prodotto lettere deformate, pseudo-parole o scritte plausibili soltanto a prima vista. OpenAI descrive Images 2.0 come un passo avanti nella gestione di testi densi, elementi tipografici minuti, interfacce, diagrammi e composizioni ricche di dettagli. È un progresso importante perché, in molti casi, un errore tipografico non è un difetto minore ma rende l’immagine inutilizzabile.

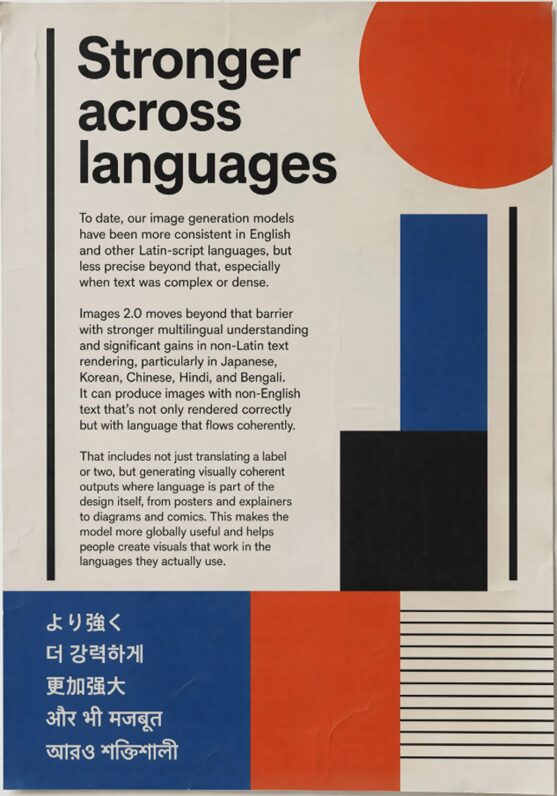

Il miglioramento riguarda anche le lingue non latine. OpenAI cita progressi nel giapponese, coreano, cinese, hindi e bengalese, un’area in cui la generazione visuale ha mostrato limiti persistenti. Le prime prove giornalistiche confermano un salto sensibile soprattutto in inglese e nella complessità generale dell’output, ma indicano che alcune scritture non latine restano ancora irregolari. Conviene quindi evitare toni definitivi. Images 2.0 non risolve una volta per tutte il problema del testo dentro le immagini; lo riduce in modo visibile e rende più credibili usi che fino a poco tempo fa richiedevano un intervento grafico esterno quasi inevitabile.

Figura 2. Poster generato con ChatGPT Images 2.0 sul miglioramento della resa multilingue. Fonte: OpenAI.

La modalità thinking cambia il flusso di lavoro in Images 2.0

La novità più interessante non è soltanto estetica. OpenAI affianca a Images 2.0 una modalità chiamata “images with thinking”, disponibile per gli utenti Plus, Pro e Business, con arrivo previsto per Enterprise ed Edu secondo il centro assistenza dell’azienda. In questa modalità il sistema può impiegare più tempo per ragionare prima della generazione, usare strumenti, consultare il web e analizzare file caricati dall’utente.

Il passaggio è rilevante perché avvicina la generazione d’immagini a un processo editoriale. Una richiesta come “crea un’infografica su un fenomeno scientifico recente” non richiede soltanto sensibilità visiva. Richiede selezione delle informazioni, gerarchia dei contenuti, controllo delle fonti, organizzazione dello spazio e traduzione grafica. La modalità thinking tenta di portare una parte di questi passaggi dentro ChatGPT. Non elimina la verifica umana, soprattutto quando entrano in gioco dati tecnici, salute, politica o ricerca scientifica, ma rende il modello più simile a un assistente di progettazione che a un semplice motore iconografico.

La stessa impostazione favorisce la produzione seriale. Con thinking attivo, OpenAI e le prime analisi della stampa tecnologica indicano la possibilità di generare più immagini da un singolo prompt, mantenendo personaggi, oggetti e stile su scene diverse. Per fumetti, storyboard, materiali didattici, social campaign e proposte di interior design, la coerenza tra più output conta quanto la qualità della singola immagine. È uno dei segnali più chiari del passaggio da strumento dimostrativo a componente di un flusso creativo.

Chatgpt images 2.0: disponibilità, formati e qualità operativa

Secondo la documentazione di OpenAI, ChatGPT Images 2.0 è disponibile su tutti i piani ChatGPT ed è accessibile da web, iOS e Android. Il centro assistenza indica anche che l’utente può generare nuove immagini, modificare quelle già create, caricare un’immagine di partenza e descrivere le trasformazioni desiderate. L’editor consente di intervenire su un’area selezionata o di chiedere la modifica direttamente nella conversazione.

La flessibilità dei formati è un altro elemento da non sottovalutare. OpenAI parla di una maggiore libertà nel rapporto d’aspetto, mentre The Verge ha riportato la generazione fino a 2K e formati molto ampi o molto verticali, dal 3:1 all’1:3. Per un uso professionale, questi dettagli incidono più di quanto sembri. Un banner, una storia per smartphone, un poster verticale e una doppia pagina editoriale non sono la stessa immagine ritagliata in modi diversi. Quando il formato nasce insieme alla composizione, diminuisce il lavoro di adattamento e aumenta la probabilità che il risultato finale sia davvero utilizzabile.

Resta comunque una distinzione da mantenere. Le capacità dichiarate e mostrate da OpenAI rappresentano il profilo del modello nelle condizioni migliori; le prestazioni reali dipendono dalla complessità del prompt, dalla lingua, dal livello di dettaglio richiesto e dal tipo di contenuto. In questo senso, le prove indipendenti sono preziose perché riportano un quadro più sfumato: qualità superiore, testo più pulito e maggiore varietà stilistica, ma non assenza di errori.

Limiti di Images 2.0, più realismo significa anche più rischio

Ogni avanzamento nella generazione visuale aumenta il valore creativo dello strumento e, allo stesso tempo, il potenziale abuso. La system card di OpenAI riconosce che Images 2.0, rispetto alle versioni precedenti, può accrescere il rischio di deepfake più convincenti, inclusi contenuti politici, sessuali o sensibili legati a persone, luoghi ed eventi reali. È una conseguenza diretta della maggiore qualità dell’immagine e della capacità di controllarne meglio dettagli, stile e contesto.

La risposta descritta da OpenAI è stratificata. Prima della generazione, classificatori testuali valutano se la richiesta viola le policy. Durante e dopo il processo, sistemi multimodali orientati alla sicurezza controllano input e output. Se l’immagine finale risulta problematica, viene bloccata prima di essere mostrata all’utente. Nelle valutazioni avversarie pubblicate nella system card, OpenAI riporta per Images 2.0 un tasso combinato di rilevamento del 96,1 per cento sui contenuti giudicati violativi e, per la modalità thinking, una quota finale di output sicuri pari al 99,2 per cento nel test descritto.

Questi numeri vanno letti con cautela. La stessa azienda specifica che le prove sono state condotte su prompt costruiti per sollecitare violazioni e non rappresentano il traffico ordinario. Servono quindi a capire il funzionamento della catena di mitigazione, non a certificare l’assenza di rischio. Una volta prodotta, un’immagine sintetica può uscire dalla piattaforma, essere ricontestualizzata, compressa, ritagliata o ripubblicata in ambienti dove la verifica è fragile. Il problema non finisce al momento della generazione.

Provenienza e C2PA non sono una garanzia assoluta

OpenAI collega Images 2.0 anche al tema della provenienza. La società conferma l’uso dei metadati C2PA, uno standard tecnico aperto pensato per incorporare nei media digitali informazioni sull’origine e sulla storia del contenuto. Nella system card viene citato anche un watermark impercettibile, associato a strumenti interni per valutare se una determinata immagine sia stata creata da prodotti OpenAI.

La provenienza tecnica è importante, ma non va caricata di aspettative eccessive. La stessa documentazione di OpenAI ricorda che i metadati possono essere rimossi accidentalmente o intenzionalmente, per esempio tramite piattaforme social, screenshot o conversioni di formato. In altre parole, la presenza di credenziali può aiutare a ricostruire l’origine di un contenuto, mentre la loro assenza non dimostra automaticamente che un’immagine non sia stata generata con AI. Per redazioni, aziende e istituzioni, il valore del C2PA cresce se viene preservato lungo tutta la filiera; da solo, però, non sostituisce verifica, contesto e responsabilità editoriale.

Una tecnologia creativa universale, quali effetti? Dove resta l’umano?

Liquidare Images 2.0 come uno strumento per designer o social media manager sarebbe riduttivo. Le sue capacità toccano la didattica, la comunicazione scientifica, la prototipazione di prodotto, la ricerca applicata e la produzione editoriale. Un docente può chiedere uno schema visuale di un concetto matematico, un laboratorio può preparare una bozza divulgativa, un team di prodotto può visualizzare varianti di interfaccia o packaging, una redazione può produrre un concept iconografico da verificare prima della pubblicazione.

La tecnologia, però, non elimina le competenze. Le sposta. A monte servono prompt chiari, fonti affidabili e criteri di qualità. A valle servono controllo, correzione, sensibilità culturale e valutazione legale, soprattutto quando l’immagine rappresenta persone reali, dati scientifici o scenari pubblici sensibili. Images 2.0 può avvicinare molto la prima bozza a un risultato professionale, ma non possiede responsabilità editoriale. Questa resta umana, e diventa più importante proprio perché lo strumento produce output più convincenti.

Ecco: la generazione visuale sta lasciando il territorio della singola immagine sorprendente per entrare in quello dell’infrastruttura creativa. Qualità visiva, controllo testuale, ragionamento, ricerca, editing, sicurezza e provenienza cominciano a far parte dello stesso prodotto. La sfida non sarà soltanto generare pixel migliori, ma governare ciò che quei pixel pretendono di rappresentare.

Bibliografia

WIRED, OpenAI Beefs Up ChatGPT’s Image Generation Model

OpenAI, Introducing ChatGPT Images 2.0

OpenAI Deployment Safety Hub, ChatGPT Images 2.0 System Card

OpenAI Help Center, Images in ChatGPT

OpenAI Help Center, C2PA in ChatGPT Images

C2PA, Verifying Media Content Sources

Content Credentials, Verify Media Authenticity

The Verge, OpenAI’s updated image generator can now pull information from the web