Sono apparse recentemente sui giornali le notizie degli investimenti colossali nel settore dell’intelligenza artificiale: Amazon annuncia 200 miliardi di dollari per nuovi datacenter, Google e Microsoft non sono da meno. Cifre che, sommate, superano il prodotto interno lordo di molti Paesi europei. Ma perché servono queste somme enormi? E soprattutto: siamo sicuri che saranno sempre necessarie?

Per comprendere i cambiamenti in corso nel mondo dell’intelligenza artificiale, è utile partire da una domanda semplice: perché i sistemi di IA hanno bisogno di così tanta potenza di calcolo? La risposta sta nel modo in cui funzionano i Large Language Model (LLM), ovvero quei sistemi — come ChatGPT, Gemini o Claude — capaci di generare testi, rispondere a domande e sostenere conversazioni in modo naturale.

Un LLM è, in sostanza, una gigantesca rete matematica composta da miliardi di numeri, chiamati parametri. Quando poniamo una domanda a ChatGPT, il sistema esegue miliardi di operazioni su questi parametri per generare ciascuna delle parole che comporranno la risposta. Più parametri ha il modello, più è capace di cogliere sfumature e produrre risposte accurate — ma anche più memoria e potenza di calcolo richiede. GPT-3, il modello che ha inaugurato l’era dei chatbot nel 2022, contava 175 miliardi di parametri. Il modello Gemini di Google, che oggi Apple intende utilizzare per potenziare Siri, ne ha 1.200 miliardi, quasi sette volte tanto.

Un parametro occupa spazio in memoria: nella rappresentazione standard a 16 bit, un modello da 175 miliardi di parametri richiede circa 350 gigabyte di RAM solo per essere caricato, senza contare la memoria aggiuntiva necessaria durante l’elaborazione, ad esempio quella necessaria per la finestra di contesto della conversazione. Questi numeri spiegano perché i sistemi di IA più avanzati funzionano oggi grazie a enormi datacenter, dotati di migliaia di processori grafici (GPU – Graphical Processing Unit) specializzati e di vasti banchi di memoria RAM (Random Access Memory); ciascuno di questi elementi ha un costo di migliaia di dollari. È questo il motore economico principale dietro la corsa ai datacenter che sta investendo il settore tecnologico.

Ma in parallelo a questa corsa verso una sempre maggiore capacità computazionale, c’è la corsa all’ottimizzazione dei modelli stessi, che permette di avere prestazioni alte (o comunque sufficienti) con modelli più piccoli o più efficienti.

Indice degli argomenti

La compressione dei modelli: fare di più con meno

La tecnica più diffusa per la compressione dei modelli di IA si chiama quantizzazione. Nella sua forma più semplice, il concetto è intuitivo: ogni parametro del modello è un numero, normalmente rappresentato con 16 bit di precisione. La quantizzazione riduce questa precisione a 8, 4 bit o addirittura meno. Un modello quantizzato a 4 bit occupa un quarto della memoria rispetto alla versione a 16 bit, e può dunque essere eseguito su hardware molto più modesto in termini di memoria.

Negli ultimi mesi, questa frontiera si è spostata in modo spettacolare. Il 25 marzo 2026, Google Research ha presentato TurboQuant, un algoritmo che comprime una componente critica della memoria dei LLM — la cosiddetta KV cache, ovvero la “memoria di lavoro” che il modello usa per ricordare il contesto della conversazione in corso — fino a 3 bit per elemento, ottenendo una riduzione di 6 volte della memoria necessaria e un’accelerazione fino a 8 volte, il tutto senza alcuna perdita misurabile di accuratezza.[1] Internet ha immediatamente ribattezzato TurboQuant “il Pied Piper dell’IA”, dal nome della startup immaginaria della serie televisiva Silicon Valley che comprimeva i dati in modo rivoluzionario.[2]

L’aspetto più rilevante di TurboQuant è che non richiede di riaddestrare il modello: si applica come una sorta di “filtro” post-produzione a qualsiasi LLM esistente. In termini pratici, significa che una finestra di contesto da 32.000 parole — che a precisione piena richiederebbe decine di gigabyte — diventa gestibile su un dispositivo con 8-16 GB di RAM, ovvero uno smartphone di fascia alta o un laptop.

Ma Google non è l’unica azienda impegnata su questo fronte. Microsoft ha sviluppato BitNet, un approccio ancora più radicale: invece di comprimere un modello dopo l’addestramento, BitNet addestra il modello fin dall’inizio utilizzando pesi a 1 solo bit. Il risultato è sorprendente: un modello da 100 miliardi di parametri può essere eseguito su una singola CPU, senza bisogno di costose GPU, a una velocità paragonabile alla lettura umana (5-7 parole al secondo), con una riduzione del consumo energetico fino all’82%.[3]

Accanto a queste due innovazioni di punta, l’ecosistema della compressione è ormai vasto e maturo. Formati come GGUF (utilizzato dalla popolarissima libreria open source llama.cpp) e AWQ permettono a chiunque di scaricare ed eseguire modelli di IA quantizzati sul proprio computer. I numeri ci dicono del successo ottenuto: nel primo trimestre 2026, la piattaforma Ollama ha raggiunto 52 milioni di download mensili, e su HuggingFace sono disponibili oltre 135.000 modelli ottimizzati per l’esecuzione locale.[4]

Naturalmente la compressione ha un prezzo: ridurre la precisione dei numeri significa inevitabilmente perdere qualcosa in termini di qualità delle risposte. Tuttavia, i test condotti su centinaia di migliaia di valutazioni mostrano che il compromesso è sorprendentemente favorevole: a 8 bit la perdita è trascurabile (meno del 2%), a 4 bit resta contenuta (2-8%), e solo scendendo sotto i 3 bit il degrado diventa significativo.[5] Il punto di equilibrio, oggi, si colloca a 4 bit: un modello quantizzato a questo livello conserva oltre il 92% della qualità originale occupando un quarto della memoria. Per la maggior parte degli usi quotidiani, la differenza con il modello non compresso è impercettibile.

Piccolo è potente: la rivoluzione dei modelli compatti

Accanto alla compressione dei modelli esistenti, un’altra tendenza sta trasformando il panorama dell’IA: la creazione di modelli nativamente più piccoli ma capaci di prestazioni che, fino a pochi mesi prima, erano appannaggio di sistemi molto più grandi. Il MIT Technology Review ha inserito gli small language models fra le dieci tecnologie più importanti del 2025, e la tendenza si è ulteriormente accelerata nel 2026.[6]

Il caso più eclatante è quello di DeepSeek, un’azienda cinese che ha scosso il settore dimostrando che è possibile ottenere prestazioni di livello GPT-4 con una frazione delle risorse. Il suo modello DeepSeek-R1, specializzato nel ragionamento logico e matematico, è stato addestrato con un budget stimato di circa 6 milioni di dollari — contro i 100 milioni stimati per GPT-4 — e offre un’inferenza da 20 a 50 volte meno costosa rispetto ai modelli equivalenti di OpenAI. Ancora più sorprendente: la versione “distillata” a soli 7 miliardi di parametri supera GPT-4o in diversi test di ragionamento, un risultato notevole per un modello che può girare su un singolo laptop.

DeepSeek non è un caso isolato. Microsoft con Phi-4 (14 miliardi di parametri) ha dimostrato di poter competere con modelli da 5 a 50 volte più grandi nei compiti che richiedono ragionamento. Alibaba con Qwen3, addestrato su 36 miliardi di token in 119 lingue, ha prodotto una famiglia di modelli compatti ma multilingue. Queste aziende condividono la stessa intuizione: architetture più intelligenti, dati di addestramento migliori e tecniche di distillazione — il processo con cui un modello piccolo “impara” dal comportamento di un modello grande — possono compensare la differenza di dimensioni.

Il risultato pratico è che le prestazioni che oggi fornisce il modello di punta, nel giro di pochi mesi diventano raggiungibili con un modello dieci volte più piccolo. È una dinamica che ricorda la legge di Moore nell’elettronica, ma applicata all’intelligenza dei modelli anziché alla densità dei transistor. E soprattutto, è una dinamica che rende l’esecuzione locale sempre più attraente, perché riduce continuamente la soglia di potenza necessaria per ottenere risultati utili.

Due fasce di intelligenza artificiale

Questi sviluppi stanno delineando un’architettura a due livelli per l’intelligenza artificiale del prossimo futuro, che ricorda, in modo non casuale, la distinzione fra le applicazioni che girano sul nostro telefono e i servizi a cui accediamo via internet.

Il primo livello è costituito da modelli relativamente piccoli ma capaci, eseguiti direttamente sul dispositivo dell’utente — lo smartphone, il laptop, persino lo smartwatch. Questi modelli offrono risposte immediate (nessuna latenza di rete), funzionano anche senza connessione a internet e, soprattutto, garantiscono la massima privacy perché i dati dell’utente non lasciano mai il dispositivo. Possiamo immaginare sistemi con capacità paragonabili a quelle di ChatGPT-3 o superiori: sufficienti per rispondere a domande, riassumere documenti, comporre messaggi, gestire appuntamenti, e operare come veri e propri agenti digitali che eseguono azioni per conto dell’utente.

Il secondo livello è quello dei modelli molto più grandi e potenti, accessibili esclusivamente via cloud: sistemi con centinaia o migliaia di miliardi di parametri, capaci di ragionamento complesso, analisi approfondite, generazione di codice sofisticato e compiti creativi avanzati. Questi modelli richiedono datacenter potenti, sono offerti a pagamento e troveranno il loro mercato naturale nell’uso professionale e aziendale. Questa direzione è stata confermata solo pochi giorni fa dal nuovo modello Mythos di Anthropic, che sarà per ora rilasciato solo ad un consorzio di aziende (ad esempio Microsoft, Amazon e Apple) citando preoccupazioni relative alle capacità di hacking dimostrate dal modello[7].

Chi sembra aver indirizzato la propria strategia con questo scenario in mente è Apple. Il sistema Apple Intelligence, presentato nel 2024 e progressivamente ampliato, si basa su un’architettura dichiaratamente a due livelli.[8] Il primo è un modello on-device da circa 3 miliardi di parametri, ottimizzato per i chip Apple Silicon attraverso una quantizzazione aggressiva a 2 bit e tecniche di condivisione della memoria cache. Sui chip più recenti (A19, M5), questo modello gestisce circa l’80% di tutte le richieste dell’utente. Il secondo livello è il Private Cloud Compute di Apple: un’infrastruttura cloud proprietaria, costruita con hardware Apple dedicato, dove i dati sono crittografati in transito e a riposo, e dove girano modelli più potenti basati su un’architettura chiamata PT-MoE (Parallel-Track Mixture-of-Experts).

L’iPhone come “browser” per l’intelligenza artificiale

A gennaio 2026, Apple e Google hanno annunciato un accordo pluriennale il cui valore è stimato intorno a un miliardo di dollari l’anno: la prossima generazione di Siri sarà alimentata da un modello Gemini di Google da 1.200 miliardi di parametri.[9],[10] Il modello Gemini sarà “white-label”, ovvero completamente invisibile all’utente: nessun logo Google, nessuna indicazione che Siri stia consultando un’intelligenza esterna. L’anteprima è attesa al WWDC di giugno 2026, con il lancio previsto insieme a iOS 26.4.

Questo accordo è estremamente significativo per le sue implicazioni strategiche. Apple, la più grande azienda tecnologica del mondo per capitalizzazione di mercato, ha scelto deliberatamente di non costruire datacenter giganteschi e di non competere nella corsa ai modelli più grandi. Ha scelto invece di trasformare i propri dispositivi in una sorta di browser per l’intelligenza artificiale: un terminale intelligente che gestisce localmente ciò che può, e smista le richieste più complesse verso “supermotori” esterni, esattamente come un browser web è il punto di accesso a servizi che risiedono altrove.

In questa prospettiva, l’architettura dei chip Apple Silicon della serie M — con la loro memoria unificata, condivisa fra CPU, GPU e Neural Engine — si rivela una scelta tutt’altro che casuale. A differenza dei PC tradizionali, dove la memoria del processore e quella della scheda grafica sono separate, nei Mac la stessa memoria è accessibile a tutti i componenti del chip, eliminando i colli di bottiglia nel trasferimento dei dati. Il risultato è che un MacBook Pro con chip M5 Max e 128 GB di memoria unificata può eseguire localmente modelli da 70 miliardi di parametri a 18-25 parole al secondo, senza alcun ricorso al cloud[11]. I Mac si stanno così posizionando come le macchine più efficienti per far girare in locale modelli sofisticati, confermando la strategia a due livelli di Apple.

Così, come negli anni Duemila il browser divenne la porta d’accesso universale ai servizi online, i dispositivi Apple si candidano a diventare oggi la porta d’accesso universale all’IA. E così come allora chi controllava il browser (Google, con Chrome) acquisiva un potere strategico enorme, oggi chi controlla il dispositivo — e quindi decide quale modello cloud interrogare — si trova in una posizione analoga.

Anche Google e Microsoft, peraltro, perseguono un modello simile per i propri dispositivi: Google con Gemini Nano sui telefoni Pixel (capace di operare offline per riassunti, composizione di messaggi e perfino rilevamento di truffe telefoniche in tempo reale) e Microsoft con i modelli della famiglia Phi, come Phi-4-mini-reasoning (3,8 miliardi di parametri), già ottimizzati per le NPU (Neural Processing Unit, i processori specializzati per l’IA) degli Snapdragon Copilot+ PC. In tutti questi casi, il dispositivo dell’utente è il primo livello di elaborazione, il cloud è il secondo.

La corsa ai datacenter IA e gli investimenti record

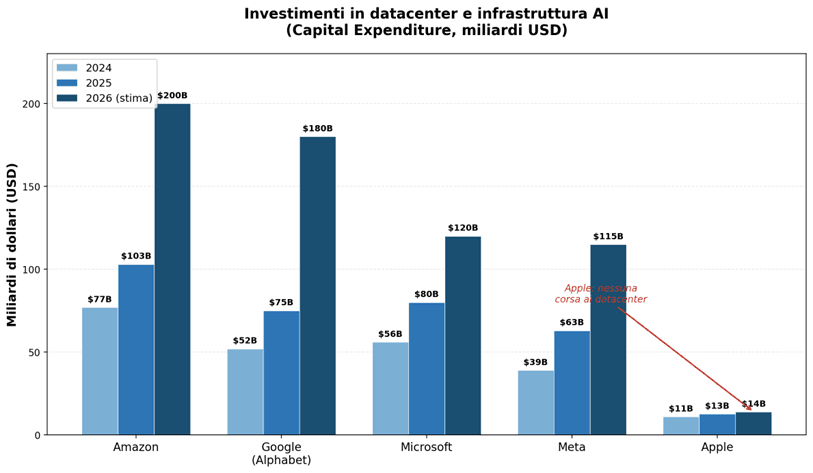

Mentre Apple punta sull’intelligenza on-device, i suoi concorrenti stanno investendo somme senza precedenti nella costruzione di datacenter. I numeri sono impressionanti: nel 2026, i cinque maggiori “hyperscaler” (Amazon, Google, Microsoft, Meta e Oracle) spenderanno complessivamente oltre 600 miliardi di dollari in infrastruttura, di cui circa il 75% destinato specificamente all’IA.[12][13] Fortune ha notato, con una certa preoccupazione, che questa cifra supera il PIL della Svezia.[14]

Titolo: CAPEX Datacenter – Descrizione: Confronto investimenti datacenter 2024-2026

Figura 1 — Investimenti in datacenter e infrastruttura AI (Capital Expenditure, miliardi USD). Elaborazione dell’autore su dati IEEE ComSoc, Fortune, Futurum Group.

Il grafico mostra un contrasto che non potrebbe essere più netto. Amazon ha annunciato investimenti per 200 miliardi di dollari nel 2026, seguita da Google con 175-185 miliardi, Microsoft con 120 miliardi e Meta con 115 miliardi. Apple? Circa 14 miliardi — meno di un decimo di Google, meno di un quattordicesimo di Amazon. Questa capital intensity, ovvero il rapporto fra investimenti e fatturato, ha raggiunto per i grandi spender livelli del 45-57%, storicamente impensabili per aziende tecnologiche.[15]

Apple sta puntando su una direzione diversa: non costruire la fabbrica dell’IA, ma costruire il dispositivo che la rende accessibile. È una scelta che potrebbe rivelarsi lungimirante, oppure un errore strategico. Per capire quale delle due ipotesi sia più probabile, è utile guardare a un precedente storico illuminante.

Lezione dalla storia: la bolla della fibra ottica

Alla fine degli anni Novanta, Internet era in piena esplosione e tutti erano convinti che la domanda di banda sarebbe cresciuta a dismisura. Le aziende di telecomunicazioni si lanciarono in una corsa frenetica a stendere cavi in fibra ottica: dopo il Telecommunications Act del 1996, il settore investì oltre 500 miliardi di dollari, in gran parte finanziati a debito, per posare fibra, installare apparati di rete e costruire dorsali intercontinentali.[16]

Poi arrivò un’innovazione tecnologica che cambiò le regole del gioco. Si chiamava DWDM, acronimo di Dense Wavelength Division Multiplexing. Per capire come funziona, si pensi alla luce che viaggia in una fibra ottica come a un fascio di luce bianca: il DWDM è come un prisma che separa questa luce in 80 o più colori diversi, ciascuno dei quali può trasportare un flusso di dati indipendente. Di colpo, ogni singola fibra già posata poteva trasportare da 80 a 96 volte più dati di prima, senza bisogno di posare un solo metro di fibra in più. Combinando la nuova fibra con il DWDM e i nuovi standard di trasmissione, l’offerta di capacità di rete aumentò di un fattore 100.000.[17]

Il risultato fu una sovracapacità catastrofica. Nel 2002, secondo il Wall Street Journal, solo il 2,7% della fibra installata veniva effettivamente utilizzata.[18] Tra il 2000 e il 2002, i titoli delle aziende telecom persero globalmente oltre 2.000 miliardi di dollari di capitalizzazione. WorldCom dichiarò quello che era allora il più grande fallimento nella storia degli Stati Uniti, seguita da Global Crossing e altre.

C’è però un epilogo che vale la pena ricordare. Tutta quella fibra “spenta” — dark fiber, come venne chiamata — non sparì. Rimase sotto terra e sotto gli oceani, e nel decennio successivo divenne l’infrastruttura a basso costo su cui si costruirono la banda larga, YouTube, Netflix, il cloud computing e l’intera economia digitale moderna. L’eccesso di capacità non fu uno spreco assoluto: fu uno spreco per chi ci aveva investito, ma un regalo per chi venne dopo.

Datacenter e fibra ottica: due bolle a confronto?

Le analogie con la situazione attuale sono notevoli. Come alla fine degli anni ’90 le telco investivano in fibra sulla base di previsioni di domanda esponenziale, oggi i giganti del tech costruiscono datacenter sulla base della convinzione che la domanda di potenza computazionale per l’IA crescerà senza sosta. Come allora, gli investimenti raggiungono livelli storicamente senza precedenti e sono in parte finanziati con aspettative aggressive sui ritorni futuri.

Ma c’è un’analogia ancora più profonda, ed è quella tecnologica. Nel caso della fibra, il DWDM fu un moltiplicatore di capacità dell’infrastruttura esistente: ogni fibra già posata diventava 80 volte più capace. Nel caso dell’IA, la compressione dei modelli (quantizzazione, BitNet, TurboQuant) è un moltiplicatore di capacità del software: ogni modello esistente può funzionare con una frazione della memoria e della potenza di calcolo precedentemente necessarie. Se un modello che prima richiedeva un datacenter domani girerà su un telefono, una parte significativa di quei datacenter potrà restare sottoutilizzata.

Naturalmente esistono anche differenze importanti. La domanda di IA potrebbe effettivamente crescere a ritmi tali da assorbire la nuova capacità, soprattutto se l’IA diventerà pervasiva in ogni settore economico. I datacenter, inoltre, sono asset più flessibili della fibra ottica: possono essere riconvertiti per usi diversi dall’IA. E i modelli più grandi e potenti — quelli da migliaia di miliardi di parametri — continueranno a richiedere infrastruttura cloud per gli anni a venire.

Tuttavia, il ritmo dell’innovazione nella compressione è impressionante. Solo nell’ultimo anno siamo passati dalla quantizzazione a 4 bit come standard alla compressione a 3 bit (TurboQuant) e all’addestramento nativo a 1 bit (BitNet), con riduzioni di memoria e consumi che si misurano in ordini di grandezza. Inoltre, come dimostra il caso di DeepSeek, modelli molto più compatti raggiungono ormai le prestazioni che solo pochi mesi prima richiedevano sistemi enormi e costosissimi, accelerando ulteriormente lo spostamento verso l’elaborazione locale. Se questa traiettoria continua — e non c’è ragione per ritenere che si arresti — il rischio che una parte dei 600 e più miliardi di dollari investiti in datacenter nel 2026 risulti sovradimensionata non è trascurabile.

Il futuro dei datacenter IA tra cloud e on-device

Lo scenario che si profila per i prossimi due o tre anni è quello di un’intelligenza artificiale a due velocità. Da un lato, LLM di capacità media ma sufficiente per la maggior parte degli usi quotidiani, integrati nei nostri dispositivi, rapidi, sempre disponibili, rispettosi della nostra privacy e capaci di agire come agenti digitali al nostro servizio. Dall’altro, modelli di potenza molto superiore, accessibili via cloud, destinati a un uso professionale e aziendale che giustifichi il costo dell’abbonamento.

Apple ha scommesso in modo netto sulla prima categoria, delegando la seconda a partner come Google. Amazon, Microsoft e Google stessa stanno investendo centinaia di miliardi per dominare la seconda. La strategia vincente dipenderà in larga misura dalla velocità con cui l’innovazione nella compressione proseguirà: se i modelli on-device diventeranno sufficientemente capaci per la stragrande maggioranza degli utenti, la domanda di potenza cloud potrebbe crescere meno del previsto, lasciando datacenter semivuoti — proprio come le dorsali in fibra ottica vent’anni fa.

E proprio come allora, quell’infrastruttura non andrà sprecata per sempre: troverà altri usi, abiliterà applicazioni che oggi non immaginiamo. Ma per gli investitori che stanno finanziando questa corsa, la lezione della fibra ottica dovrebbe suonare come un monito: in tecnologia, la sovracapacità non è mai impossibile, anche quando la domanda sembra destinata a crescere all’infinito.

Note

[1]Google Research, TurboQuant: Redefining AI efficiency with extreme compression, marzo 2026. https://research.google/blog/turboquant-redefining-ai-efficiency-with-extreme-compression/

[2]TechCrunch, Google’s TurboQuant — and yes, the internet is calling it ‘Pied Piper’, marzo 2026. https://techcrunch.com/2026/03/25/google-turboquant-ai-memory-compression-silicon-valley-pied-piper/ — Pied Piper è la startup fittizia protagonista della serie TV Silicon Valley (HBO, 2014-2019), il cui fondatore inventa un rivoluzionario algoritmo di compressione dati capace di ridurre qualsiasi file a una frazione delle sue dimensioni originali.

[3]Microsoft Research, BitNet: Scaling 1-bit Transformers for Large Language Models. https://github.com/microsoft/BitNet

[4]DEV Community, Local LLM Inference in 2026: The Complete Guide. https://dev.to/starmorph/local-llm-inference-in-2026-the-complete-guide-to-tools-hardware-open-weight-models-2iho

[5]Red Hat Developer, We ran over half a million evaluations on quantized LLMs. https://developers.redhat.com/articles/2024/10/17/we-ran-over-half-million-evaluations-quantized-llms

[6]MIT Technology Review, Small language models: 10 Breakthrough Technologies 2025, gennaio 2025. https://www.technologyreview.com/2025/01/03/1108800/small-language-models-ai-breakthrough-technologies-2025/

[7] Vedi articolo del sole 24 ore: Anthropic dà vita a Project Glasswing: l’Ai per la sicurezza informatica, reperibile qui: https://www.ilsole24ore.com/art/anthropic-da-vita-project-glasswing-l-intelligenza-artificiale-che-va-caccia-bug-vecchi-27-anni-AIg946MC

[8]Apple Machine Learning Research, Apple Intelligence Foundation Language Models Tech Report 2025. https://machinelearning.apple.com/research/apple-foundation-models-tech-report-2025

[9]CNBC, Apple picks Google’s Gemini to run AI-powered Siri coming this year, gennaio 2026. https://www.cnbc.com/2026/01/12/apple-google-ai-siri-gemini.html

[10]Bloomberg, Apple Nears $1 Billion-a Year Deal to Use Google AI for Siri, novembre 2025.

[11]Apple Machine Learning Research, Exploring LLMs with MLX and the Neural Accelerators in the M5 GPU. https://machinelearning.apple.com/research/exploring-llms-mlx-m5

[12]IEEE ComSoc Technology Blog, Hyperscaler capex > $600 bn in 2026, dicembre 2025. https://techblog.comsoc.org/2025/12/22/hyperscaler-capex-600-bn-in-2026/

[13]Futurum Group, AI Capex 2026: The $690B Infrastructure Sprint. https://futurumgroup.com/insights/ai-capex-2026-the-690b-infrastructure-sprint/

[14]Fortune, Big Tech’s $630 billion AI spree now rivals Sweden’s economy, febbraio 2026.

[15]Statista, Tech’s AI-Fueled Spending Surge. https://www.statista.com/chart/35046/capital-expenditure-of-meta-alphabet-amazon-and-microsoft/

[16]Fabricated Knowledge, Lessons from History: The Rise and Fall of the Telecom Bubble. https://www.fabricatedknowledge.com/p/lessons-from-history-the-rise-and

[17]A. Odlyzko, Internet traffic growth: Sources and implications, Optical Transmission Systems and Equipment for WDM Networking II, Proc. SPIE 5247, 2003. La stima di un fattore 100.000 combina la nuova fibra posata, l’aumento delle fibre per cavo (da 8 a 864), il DWDM (80-96 lunghezze d’onda per fibra) e il passaggio da 2,5 a 10 Gbps per canale.

[18]Wall Street Journal, dati 2002. Solo il 2,7% della fibra ottica installata risultava in uso.