Se dovessi consigliare un caso da discutere in un corso di Strategia, come vecchio appassionato della materia (oltre che emerito della stessa al Politecnico di Milano), suggerirei di guardare a come si sta muovendo Nvidia per contrastare la crescente minaccia competitiva. Sappiamo che è l’impresa di maggior valore al mondo con oltre quattro trilioni di dollari di capitalizzazione dopo avere per breve tempo addirittura superato i cinque.

Il pericolo (al momento appare molto concreto): il mercato che ha fatto la sua fortuna, quello dei chip specializzati per il “training” dei modelli AI dove tuttora gode di una posizione assolutamente dominante, è destinato a perdere progressivamente peso in uno scenario che vede viceversa (se le speranze riposte nelle applicazioni si confermeranno) l’AI in continua crescita.

Indice degli argomenti

Un caso da manuale: perché Nvidia è il caso strategico del momento

Un caso interessante perché il pericolo non è originato dalla nascita di una nuova tecnologia, ma dei cambiamenti nel contesto competitivo generati dall'”eccesso di successo” della tecnologia ove Nvidia è leader di mercato.

Un caso per altri versi classico, dove si richiede a Nvidia non tanto e non solo di continuare ad accrescere i ricavi – il suo CEO Jenseng Huang ha promesso che essi raggiungeranno entro il 2027 i mille miliardi di dollari (una cifra enorme se si pensa che negli ultimi 4 trimestri essi hanno superato di poco i 200 miliardi di dollari e che ammontano a 700 miliardi circa i ricavi delle due quotate leader per fatturato su scala mondiale Walmart e Amazon) – ma di riuscire a difendere i margini: obiettivo non certo facile, dato il livello attuale pari al 70 per cento circa.

Come cambia la strategia Nvidia AI davanti al nuovo scenario

Nvidia è impegnata cioè nella difficilissima sfida di aggiungere nuovi business al suo portafoglio, che le permettano di crescere, individuando business che – per le loro specifiche caratteristiche e/o per la possibilità di sfruttare rilevanti sinergie – non comportino sacrifici troppo rilevanti nei margini: pena una contrazione più o meno forte della capitalizzazione.

Huang, che non si può certamente accusare di mancanza di visione, ci lavora da tempo e ha presentato qualche giorno fa – nel corso del grande incontro annuale che la società organizza – il dettaglio delle prime mosse che Nvidia ha pronte e in termini più sfumati la strategia che intende perseguire: temi di cui si è parlato molto in questi giorni, nella stampa specialistica internazionale ma non solo, che cercherò di sintetizzare e commentare in questo mio articolo.

Dall’era del “training” dei modelli AI a quella dell'”inference”

Molte cose sono cambiate, e continuano a modificarsi, dal lancio – meno di tre anni e mezzo fa – dell’AI “generativa”. Per almeno i primi due anni

- la messa a punto dei modelli AI e gli enormi investimenti infrastrutturali in “data center” sono stati finanziati, nella quasi totale assenza di utenti finali paganti (privati, imprese e istituzioni), dalle cosiddette hyperscalers (Amazon, Microsoft e Alphabet-Google, leader mondiali nel cloud computing, e Meta) e in misura minore – nel supporto soprattutto alla crescita delle startup (OpenAI e Anthropic le due di maggior successo) – da fondi finanziari quali in primo luogo la giapponese SoftBank;

- uno dei miti perseguiti in questa prima fase è stato quello della superintelligenza, della messa a punto cioè di modelli AI in grado di superare l’intelligenza umana (nel primo accordo fra OpenAI e Microsoft tale superamento era addirittura citato nella clausola che definiva l’orizzonte temporale degli obblighi della prima nei riguardi della seconda);

- Nvidia, nata nel lontano 1993, si è trovata nella doppiamente fortunata posizione di disporre di chip (i notissimi GPU), nati per i giochi e utilizzati poi anche per l’estrazione dei bitcoin, insuperabili nel “training” dei modelli AI e di avere clienti quali le hyperscalers in grado come detto di investire cifre enormi in infrastrutture di calcolo basate sui suoi chip, confidando nello sviluppo nel futuro di un mercato in grado di ripagarne i servizi.

Lo scenario che cambia: dall’infrastruttura alla monetizzazione

Nei periodi più vicini a noi, però, lo scenario ha iniziato a modificarsi e lo fa in misura crescente:

- il perseguimento della superintelligenza lascia sempre più il posto – come obiettivo – alla creazione e allo sfruttamento di modelli AI in grado di generare ritorni, rivolti più al mondo “corporate” che ai singoli: è quanto vuole il mercato finanziario, sempre più perplesso nel mettere soldi in attività con ritorni incerti e comunque lontani nel tempo; è quanto devono fare le startup di maggior successo (OpenAI, Anthropic, xAI …), se vogliono quotarsi in Borsa con un IPO che le proietti verso il ristretto circolo delle Big Tech; è quanto si sentono di dover fare imprese come Alphabet-Google, Amazon, Microsoft e Meta, se non vogliono vedere calare le loro capitalizzazioni;

- i modelli che arrivano sul mercato – molti di essi riguardanti l’automazione del “coding” piuttosto che la predisposizione degli “agenti AI” e sempre più focalizzati su specifici ambiti di utilizzo – hanno una capacità di attrazione che, se si consoliderà nel tempo, porterà da un lato ad accrescere sempre più l’importanza della fase di “inference”, di consultazione cioè dei modelli stessi in funzione delle proprie esigenze, e dall’altro conseguentemente incrementerà la domanda di chip volti a ottimizzare i processi di “inference” stessi, dal punto di vista della riduzione dei costi di consultazione (consumi energetici inclusi) e della accelerazione dei tempi di risposta dei modelli.

Le mosse di portafoglio e il ruolo del marketing strategico

Di Huang non si può dire che non abbia il marketing nel sangue. Tratta un cambiamento di scenario pericoloso per il mantenimento della leadership di Nvidia – “”The inference inflection has arrived” ha sottolineato nel suo discorso di apertura -come una grande opportunità, che promette proietterà a 500 miliardi di dollari i ricavi del 2026 e addirittura a mille (o anche oltre) quelli del 2027. I nuovi chip sono pronti e hanno fruito dell’acquisizione per 20 miliardi di dollari (con una tipica operazione di “acqui-hire”) delle competenze e delle risorse umane della startup Groq.

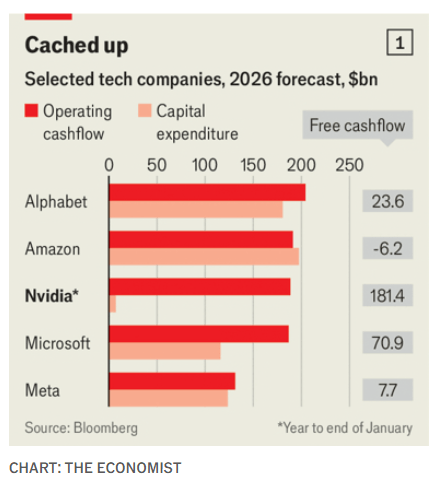

The Wall Street Journal, nel suo articolo “Nvidia’s CEO Projects $1 Trillion in AI Chip Sales as New Computing Era Begins – ‘This is the AI future,’ Jensen Huang said at the company’s GTC event, speaking about the shift to inference” del 16 marzo, passa in rassegna una molteplicità di altre iniziative in cui Nvidia, ricca del suo free cash flow (Fig. 1), è implicata: iniziative che si aggiungono alla molteplicità di accordi “circolari” (entrata nel capitale di startup a fronte di acquisti consistenti di GPU) sottoscritti per garantirsi il mercato futuro per i suoi tradizionali chip, di cui ho parlato nei mesi scorsi in miei articoli su Agendadigitale.

Le nuove iniziative: dall’open source ai robotaxi, fino ai robot danzanti

Ne cito solo alcune

- la creazione di una coalizione con un insieme di imprese operanti nel software – tra cui Cursor, Mistral, Perplexity, Reflection e Thinking Machines – volta a facilitare lo sviluppo di modelli AI “open-sourced” di frontiera e a convertire la “software-as-a-service industry” in una “agentic-AI-as-a-service industry”;

- l’espansione del suo “autonomous driving business“, che prevede l’uso dei chip e dei modelli di simulazione di Nvidia, con l’aggiunta di 5 nuovi partner (BYD Auto, Geely Auto, Isuzu Motors, Nissan Motor and Hyundai Motor), volto ad accrescere sensibilmente il numero di robotaxi sulle strade;

- la presentazione di un robot, con le fattezze di un pupazzo del film animato di Disney “Frozen”, messo a punto da una partnership fra Nvidia, DeepMind e Disney, in grado di tenere una conversazione con Huang.

La Strategia AI DI Nvidia e l’ambizione di diventare impresa-pilastro

Il sogno dichiarato di Nvidia è più grande: diventare “the foundational company on which the AI economy rests”, l’impresa-pilastro su cui poggia l’intera economia dell’AI. Un sogno realistico o il tentativo di rendere più roseo agli occhi del mercato un futuro con diverse nuvole all’orizzonte?

L’insieme di iniziative – apparentemente confuso – che Nvidia sta prendendo nelle più diverse direzioni è stato giustificato da Huang come il perseguimento da parte di Nvidia stessa dell’obiettivo di diventare l’impresa al centro di tutta l’economia dell’AI: destando (come racconta The Economist “Nvidia is expanding its empire – The AI boom’s biggest winner moves beyond chips”, 17 marzo) l’entusiasmo degli ingegneri e la perplessità degli investitori.

I fattori a favore e i rischi: l’analisi equilibrata di The Economist

Ma qual’è l’opinione di The Economist? Il giornale, famoso per la qualità delle sue analisi e per il suo equilibrio, preferisce non fare scommesse in un contesto così complesso come quello dell’AI e limitarsi a citare alcuni dei fattori a favore e alcuni di quelli contro: fattori che, almeno per quanto riguarda il biennio 2026-2027, sono rilevanti anche per quanto riguarda la credibilità dell’obiettivo di portare a mille miliardi, partendo dai poco più che duecento del 2025, i ricavi.

Tra i punti a favore, almeno nel breve periodo, il rafforzamento della supply chain che Nvidia sta attuando da tempo – con il rilevantissimo free cash flow di cui dispone – in particolare per quanto riguarda la memoria, risorsa più rilevante per i chip destinati all'”inference” che per quelli destinati al “training”, prevista in grave carenza nel futuro prossimo e alcuni sostengono addirittura sino alla fine del decennio.

Tra i dubbi, più che legittimo quello relativo al moltiplicarsi dei competitori – soprattutto nei chip destinati all'”inference” dove come detto la competizione è in larga misura sui prezzi e dove hanno fatto rilevanti investimenti le hyperscalers – che potrebbe impattare non solo sui ricavi ma anche sui margini. E quello relativo a un possibile rallentamento, rispetto alle previsioni estremamente rosee attuali, della domanda complessiva legata all’AI: dovuto a crisi macroeconomiche piuttosto che a dubbi sulle prestazioni reali di alcuni modelli AI.

Vorrei aggiungere un altro dubbio, relativo all’obiettivo (se veramente perseguito e non solo decantato) di essere una impresa-pilastro, presente ovunque nell’intera filiera dell’AI e delle sue applicazioni: è molto facile, come la storia insegna, che le sinergie non siano tali da giustificare una copertura di tutte le attività legate all’AI e che una impresa come Nvidia – con una storia alle spalle di forte focalizzazione – rischi di trasformarsi in una “conglomerata”. E le “conglomerate” di successo non sono sicuramente molte.