Sono ancora pochi, allo stato attuale, gli studi comportamentali nell’ambito della sicurezza informatica: il comportamento psicologico dell’utente di fronte alle minacce informatiche è infatti di un oggetto di analisi complesso e variegato, a tratti oscuro, il cui esame è reso ancora più difficile dalla rapida evoluzione tecnologica delle minacce informatiche e dall’utilizzo sempre più massiccio dell’intelligenza artificiale, che rende maggiormente credibili e pericolose le strategie di attacco informatico.

Indice degli argomenti

Ingegneria sociale e psycho-hacking: intersezioni, sovrapposizioni e convergenze di obiettivi

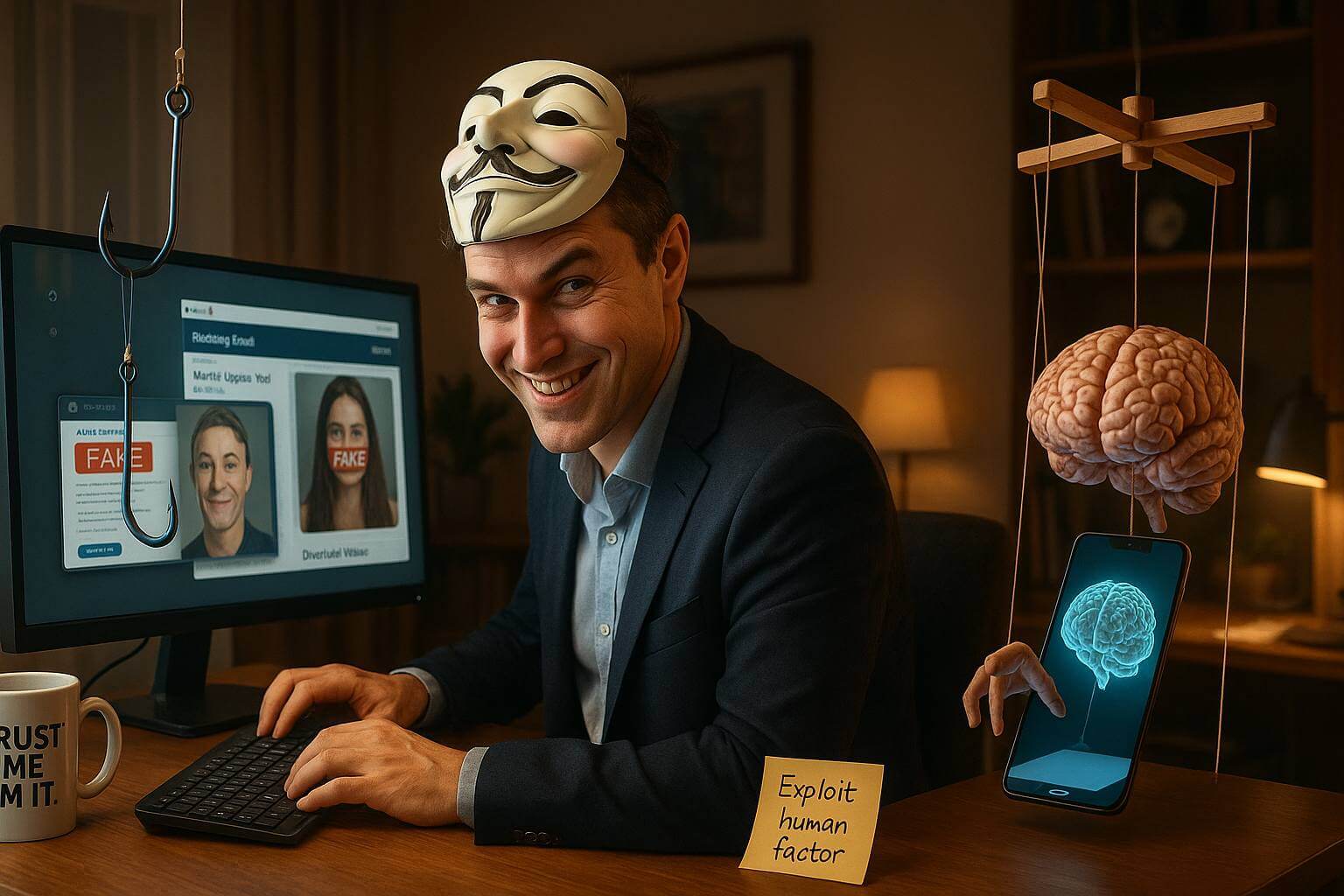

Si sta dunque rivelando di fondamentale importanza conoscere i punti deboli e le vulnerabilità del “fattore umano” nell’ambito della cybersecurity, affinché una maggiore comprensione delle minacce nascoste possano aiutare gli utenti a proteggersi consapevolmente dagli attacchi informatici.

Dal punto di vista della cyberpsicologia (o psicologia digitale), ossia la disciplina che studia i fenomeni psicologici che emergono dall’interazione umana con la tecnologia digitale, la cosiddetta ingegneria sociale o social engineering si configura come un insieme di strategie, tecniche e metodi basati sulla manipolazione psicologica attraverso un utilizzo fraudolento e ingannevole delle risorse informatiche e dei media digitali, al fine di indurre le vittime a rivelare informazioni riservate quali dati personali, informazioni sensibili, credenziali di accesso o dettagli finanziari, rappresentando quindi una minaccia non soltanto per la privacy e l’identità digitale degli individui, ma anche per la sicurezza delle organizzazioni e istituzioni di cui essi fanno parte (Atrill-Smith et al., 2019).

In pratica, lo psycho-hacker (eufemisticamente definito “ingegnere sociale”) è un cybercriminale, o meglio un black hat hacker, in grado di sfruttare da un punto di vista tecnologico le tecniche di persuasione e manipolazione psicologica allo scopo di esercitare il controllo su pensieri, emozioni e comportamenti degli utenti-bersaglio, spingendoli a compiere azioni ben precise o influenzandone le decisioni, a danno degli utenti stessi, di aziende, organizzazioni o istituzioni, sia pubbliche che private: infatti, le vittime dello psycho-hacking spesso rappresentano solo la porta di accesso ai sistemi informatici delle organizzazioni (data breach), che sono il vero obiettivo del cyberattacco, attraverso l’inoculazione di virus o malware in grado di infiltrarsi attraverso il canale aperto avventatamente dalla vittima, portando alla sottrazione o compromissione dei dati delle organizzazioni stesse (data loss).

Il target degli attacchi di psycho-hacking è, dunque, la mente umana prima ancora dei sistemi informatici e una delle tecniche maggiormente utilizzate per raggirare le vittime e superare le loro resistenze, inducendoli ad aprire una falla nei sistemi informatici, è quella di spacciarsi per entità affidabili, conosciute e autorevoli, attraverso la costruzione di identità realistiche e del tutto credibili (falsificazione dell’identità o spoofing), soprattutto grazie all’utilizzo dell’intelligenza artificiale (si pensi, ad esempio, all’incremento del fenomeno dei deepfake). Lo sfruttamento della fiducia è, infatti, una vulnerabilità psicologica chiave per questa tipologia di attacchi informatici: nonostante i significativi investimenti in sistemi di sicurezza da parte delle organizzazioni, anche un solo dipendente vulnerabile alle tecniche di ingegneria sociale è in grado di compromettere l’intera infrastruttura informatica. Questo sottolinea la persistente debolezza del “fattore umano” e l’importanza di concentrarsi sull’analisi psicologica di tali minacce e sulle vulnerabilità dell’utente, che di solito vengono trascurate nell’ambito delle analisi sulla cybersecurity, preferendo concentrarsi piuttosto su nozioni e contromisure di tipo tecnologico e strettamente tecnico. Un’interessante, quanto esaustiva classificazione degli attacchi di ingegneria sociale può essere reperita sul sito dell’Università degli Studi di Urbino Carlo Bo.

Nell’attuale contesto geopolitico internazionale, caratterizzato da enormi stravolgimenti a livello globale, lo psycho-hacking sta diventando una delle armi più utilizzate nella guerra cibernetica da parte degli apparati militare e d’intelligence dei paesi belligeranti (cyber-warfare), che sono chiamati ad affrontarsi nel cosiddetto “quinto dominio” (il cyberspazio) anche attraverso operazioni di psycho-warfare.

Tali operazioni, qualificate come offensive da un punto di vista militare, utilizzano sofisticate tecniche di manipolazione psicologica, spesso supportate da agenti IA, per aprire brecce nei sistemi informatici dell’avversario attraverso le vittime (psyops), spiazzando gli analisti d’intelligence e controspionaggio, nonché gli stessi esperti di cybersecurity, che spesso non riescono a simulare correttamente i comportamenti di attacco da parte del nemico, rendendo più difficili prevenirli (Hiruni, 2024; Parnes, 2024); infatti, questi professionisti informatici non sempre sono in possesso di competenze psicologiche in grado di decodificare le intenzioni degli aggressori, adottando specifiche misure di reverse social engineering, intesa, in questo caso, come ricostruzione al contrario della minaccia ai fini di una sua più precisa comprensione (Irani et al., 2011). Non si tratta, quindi, delle classiche operazioni di disinformazione o costruzione di post-verità, ma di vere e proprie operazioni di guerra psicologica in grado di far leva sulle debolezze e vulnerabilità del “fattore umano”, con l’obiettivo di ottenere risposte comportamentali ben precise da parte degli avversari, agganciandoli attraverso tecniche di manipolazione psicologica per indurli a compiere specifiche azioni, come, ad esempio, ingenerare valutazioni errate nelle vittime, conducendole proprio laddove vuole l’aggressore, al fine di carpire informazioni segrete, aprirsi un varco nei firewall nemici o sabotare operazioni militari sul campo. È questo il caso, ad esempio, della diffusione di un malware all’interno della versione trojanizzata di AlpineQuest, un’app gps con mappe topografiche utilizzata dalle truppe russe a supporto delle incursioni in territorio ucraino (fonte: Dr.Web). I soldati russi sono stati persuasi dagli hacker ucraini a scaricare una versione gratuita e crackata dell’app, convincendoli di poter accedere a funzionalità premium a costo zero, ma una volta scaricata e lanciata l’applicazione, il malware si attiva per rubare dati sensibili dai dispositivi, rivelando all’esercito ucraino le posizioni delle truppe nemiche in tempo reale attraverso la geolocalizzazione dei loro spostamenti, oltre ad accedere a informazioni segrete e documenti riservati sui piani dell’esercito russo, inviate dai soldati tramite app di messaggistica, come WhatsApp e Telegram, funzionando dunque come strumento di spionaggio militare.

Cosa distingue lo psycho-hacking dall’ingegneria sociale

Lo psycho-hacking (o hackeraggio psicologico) si configura dunque come una forma avanzata e più subdola di ingegneria sociale, che sfrutta deliberatamente e strategicamente le vulnerabilità psicologiche proprie dell’essere umano per raggiungere specifici target di attacco, richiedendo non soltanto conoscenze informatiche, ma anche consapevolezza delle tecniche di manipolazione psicologica. Infatti lo psycho-hacker, oltre ad avere conoscenze informatiche avanzate, possiede anche competenze nell’ambito delle scienze comportamentali e delle tecniche di manipolazione mentale, o potrebbe essere coadiuvato da team di professionisti d’intelligence, esperti in digital psyops.

Questo distingue lo psycho-hacking dall’ingegneria sociale più generale, che nasce in ambito sociopolitico e la cui finalità è il controllo sociale e politico delle masse da parte di governi o gruppi privati (Le Bon, 2021). Lo psycho-hacking si concentra prevalentemente sull’applicazione strategica delle tecniche di manipolazione psicologica per il controllo della mente e la persuasione occulta, finalizzandole alle intrusioni cibernetiche: è, in pratica, un hackeraggio della mente (Bone, 2021). Una caratteristica fondamentale del psycho-hacking è, infatti, l’inganno (deception): la vittima viene persuasa a compiere azioni che danneggiano i propri interessi e, potenzialmente, gli interessi delle organizzazioni o istituzioni di cui fa parte. Questo evidenzia la natura manipolativa e le pericolose conseguenze di questa particolare tipologia di attacco informatico. Un classico esempio di psycho-hacking è quello in cui gli attaccanti si fingono colleghi per stabilire un rapporto di fiducia, utilizzando varie tecniche di persuasione, come la reciprocità o l’autorità, con l’obiettivo di estrarre informazioni o ottenere credenziali di accesso ai sistemi (come, ad esempio, nei casi di spionaggio industriale). Sebbene non esista ancora una definizione accademica ampiamente condivisa di psycho-hacking, il concetto si riferisce allo sfruttamento dei bias cognitivi e alla manipolazione della percezione della realtà di un individuo allo scopo di influenzarne il comportamento e il processo decisionale.

Lo psycho-hacking si configura quindi come una sofisticata, quanto pericolosa, intersezione tra la manipolazione psicologica e le metodologie di attacco informatico, che va oltre la generica categoria dell’ingegneria sociale, in quanto prende di mira le vulnerabilità cognitive ed emotive degli utenti.

Questa particolare forma di manipolazione psicologica ha caratteristiche eclettiche e multidisciplinari, in quanto prende in prestito anche le tecniche di persuasione tipiche dell’economia comportamentale e del neuromarketing, che si concentrano principalmente sul convincimento e la persuasione del consumatore, orientando le sue scelte e decisioni d’acquisto. Manca dunque, al momento attuale, una definizione standardizzata e univoca del concetto di psycho-hacking, nonché uno statuto epistemologico che consenta una chiara comprensione di un oggetto ancora sfuggente, trattandosi appunto di una minaccia emergente che prende a prestito varie tecniche per raggiungere i propri scopi. Inoltre, lo psycho-hacking è reso ancora più insidioso dall’utilizzo dell’intelligenza artificiale, capace di simulare in modo realistico persone di cui la vittima si fida, allo scopo di estorcerne più facilmente il consenso (deepfake).

Il panorama dello psycho-hacking: motivazioni, attori e obiettivi

Le motivazioni alla base dello psycho-hackings sono varie e spaziano dal guadagno finanziario (furto di credenziali, numeri di carte di credito, estorsioni di ransomware), alle agende politiche, agli atti di vendetta (come il revenge porn), fino alla sfida intellettuale di ingannare l’utente o violare la sicurezza. Comprendere le diverse motivazioni è cruciale per anticipare i tipi di attacchi e sviluppare strategie di difesa efficaci. Gli attori coinvolti nello psycho-hacking possono variare da singoli criminali informatici e script kiddies in cerca di notorietà, a gruppi di criminalità organizzata e attori statali o di intelligence, dotati di risorse sofisticate e obiettivi a lungo termine. Questo spettro di attori implica diversi livelli di competenza e di targeting.

Gli obiettivi dello psycho-hacking sono altrettanto diversificati, includendo individui vulnerabili a causa di specifici tratti della personalità (come bassa empatia, alta impulsività, ansia, depressione) o specifiche debolezze (desiderio di sicurezza finanziaria, fiducia nell’autorità), così come organizzazioni che detengono dati di valore o infrastrutture critiche. La scelta dell’obiettivo spesso si allinea con le motivazioni dell’attaccante (Frauenstein & Flowerday, 2020; Cristescu et al., 2022). L’anonimato fornito dall’ambiente digitale agisce infatti come un significativo facilitatore per gli psycho-hacker, riducendo le conseguenze morali percepite delle loro azioni e incoraggiandoli ad impiegare tattiche ancora più sofisticate e manipolative. Questa distanza psicologica tra vittima e attaccante è un fattore chiave nella maggior parte dei cybercrimini.

Il panorama del psycho-hacking è caratterizzato da una vasta gamma di motivazioni che spingono attori con differenti livelli di sofisticazione e competenze diversificate a colpire determinate tipologie di individui e organizzazioni. L’anonimato offerto dall’ambiente digitale complica ulteriormente questo scenario, abbassando le inibizioni e facilitando l’impiego di tattiche manipolative.

La tecnologia svolge infatti un ruolo fondamentale nell’amplificare la portata e l’efficacia delle tecniche di psycho-hacking. Strumenti e piattaforme avanzate facilitano la creazione di e-mail, siti web e persino audio e video altamente convincenti e verosimili (deepfake), rendendo sempre più difficile per gli individui distinguere le comunicazioni autentiche da quelle dannose, portando alla costruzione di postverità sempre più persuasive.

Strumenti basati sull’intelligenza artificiale come ChatGPT possono generare messaggi personalizzati e persuasivi su vasta scala, aumentando significativamente la probabilità di successo di attacchi di phishing e altre forme di ingegneria sociale.

Gli algoritmi basati sull’IA sono in grado di analizzare enormi quantità di dati, identificando modelli di comportamento e consentendo agli psico-hacker di prevedere e sfruttare le vulnerabilità degli utenti con precisione. Aspetti tecnici come lo spoofing di dominio, in cui gli aggressori falsificano domini e-mail legittimi, migliorano la credibilità delle loro comunicazioni e rendono più difficile per i destinatari identificare l’intento malevolo.

Le piattaforme di social media, pur essendo progettate per la connessione e la condivisione, forniscono un tesoro di informazioni personali che gli psycho-hacker possono sfruttare per personalizzare i loro attacchi con notevole precisione, aumentandone le possibilità di successo. Inoltre, l’interconnessione dei dispositivi digitali e dell’Internet of Things (IoT) crea nuove vulnerabilità che gli psycho-hacker possono sfruttare a loro vantaggio. Ad esempio, i dispositivi IoT compromessi possono essere utilizzati come punti di ingresso nelle reti o per raccogliere informazioni sensibili sulle abitudini e le routine degli utenti, che possono poi essere utilizzate in attacchi di ingegneria sociale mirati.

La tecnologia agisce come un potente moltiplicatore di forze per gli psycho-hacker, consentendo loro di creare attacchi sofisticati e scalabili che sfruttano la psicologia umana con un’efficienza senza precedenti. La facilità nel creare inganni realistici e la vasta quantità di informazioni personali accessibili online abbassano drasticamente la barriera d’ingresso e aumentano il potenziale impatto dello psycho-hacking. L’evoluzione dell’ingegneria sociale in ambito informatico rivela dunque un progressivo affinamento delle tecniche di manipolazione psicologica, con un crescente sfruttamento delle tecnologie digitali per ampliare la portata e l’efficacia degli attacchi informatici, sfruttando la debolezza delle vittime come “cavallo di troia”.

L’identificazione del “fattore umano” come l’anello debole nella catena della sicurezza informatica sottolinea la necessità di un’analisi psicologica approfondita per comprendere appieno e contrastare tali minacce. Infine, non va sottovalutata la dimensione sociale dello psycho-hacking, in quanto la manipolazione dei pensieri e dei comportamenti degli individui possono essere soggetti ad effetti moltiplicatori, portando alla diffusione di ideologie dannose, alla disinformazione, fino all’incitamento alla violenza, determinando un impatto negativo sulla coesione sociale, sulla fiducia nelle istituzioni e sui processi democratici.

Come lo psycho-hacking sfrutta i principi della persuasione: il modello di Cialdini e il Modello della Probabilità di Elaborazione (ELM)

L’ingegneria sociale, nella sua essenza, si basa fortemente su principi consolidati di persuasione per manipolare le vittime a compiere azioni che compromettono la loro sicurezza. L’opera fondamentale dello psicologo statunitense Robert B. Cialdini sui sei principi della persuasione – reciprocità, scarsità, autorità, impegno e coerenza, simpatia, riprova sociale – fornisce un quadro di riferimento essenziale per comprendere tali tecniche (Cialdini, 1984; 2022). Gli psycho-hacker impiegano strategicamente questi principi per sfruttare le prevedibili risposte umane.

Il principio di reciprocità

Il principio di reciprocità viene sfruttato quando gli aggressori iniziano il contatto con la vittima offrendo una risorsa gratis o un servizio apparentemente prezioso (ad esempio, un e-book gratuito, oppure assistenza tecnica), allo scopo di creare un senso di obbligo nella vittima, che tenderà a ricambiare il dono o la disponibilità dimostrati dallo psycho-hacker, rendendola più propensa a soddisfare le successive richieste di informazioni o accesso.

Il principio di scarsità

Il principio di scarsità viene utilizzato creando un falso senso di urgenza o di disponibilità limitata (ad esempio, “Il tuo account verrà chiuso se non agisci immediatamente”, oppure “Offerta a tempo limitato”), spingendo le vittime ad agire rapidamente senza pensare in maniera critica, prendendo decisioni affrettate e impulsive, senza concedersi il tempo per un’adeguata verifica o riflessione, aumentando quindi la probabilità che divulghi informazioni o faccia clic su un link dannoso.

Il principio di autorità

Il principio di autorità è sfruttato impersonando individui in posizioni autorevoli (ad esempio, amministratori IT, funzionari bancari, CEO), conferendo credibilità alle richieste dell’aggressore e inducendo le vittime a obbedire per rispetto o timore di ripercussioni. Infatti, poichè le persone tendono ad obbedire alle figure autoritarie, uno psycho-hacker potrebbe impersonare una falsa autorità, come un dirigente aziendale, un amministratore IT, un funzionario bancario o di un’agenzia governativa, chiedendo alla vittima di fornire le proprie credenziali di accesso, trasferire denaro o installare software dannoso. La vittima, percependo l’aggressore come legittimamento, è più propensa a soddisfare la richiesta senza mettere in discussione l’identità o la validità della richiesta.

Il principio di impegno e coerenza

Il principio di impegno e coerenza viene sfruttato quando gli psycho-hacker iniziano il loro attacco chiedendo un piccolo favore o un’informazione apparentemente innocua. Poiché le persone tendono a rispettare gli impegni presi, una volta che la vittima acconsente, è più probabile che accetti richieste più grandi e compromettenti per mantenere la coerenza con la sua azione iniziale. Questo perché le persone hanno il desiderio psicologico di apparire coerenti con le loro azioni precedenti. L’aggressore sfrutta questo bisogno di coerenza per intensificare gradualmente le proprie richieste fino a quando la vittima non divulga informazioni sensibili o esegue azioni dannose.

Il principio di simpatia

Il principio di simpatia è sfruttato quando gli aggressori tentano di costruire un rapporto con i loro obiettivi mostrandosi amichevoli, disponibili o trovando un terreno comune, rendendo la vittima più incline a fidarsi di loro e a soddisfare le loro richieste. Infatti, le persone risultano essere più facilmente influenzate da chi si mostra loro simpatico e disponibile, tendendo maggiormente ad abbassare le loro difese e la naturale diffidenza. Durante gli attacchi di questa tipologia, uno psycho-hacker interagisce con la vittima sui social media, oppure tramite e-mail o telefono, cercando di costruire un rapporto amichevole, trovando punti in comune, usando l’umorismo o mostrando disponibilità. Una volta stabilita una connessione basata sulla simpatia, la vittima è più propensa a fidarsi dell’aggressore e a soddisfare le sue richieste, come condividere informazioni personali o cliccare su un link. Gli psycho-hacker possono anche usare false identità e storie per suscitare simpatia ed empatia, rendendo la vittima più vulnerabile alla manipolazione.

Il principio di riprova sociale

Il principio di riprova sociale si basa sull’assunto che, in assenza di informazioni pertinenti, le persone tendono a guardare gli altri per capire come comportarsi. Ad esempio, un’e-mail di phishing costruita su false testimonianze o statistiche che suggeriscono che molte altre persone hanno intrapreso una particolare azione (come, cliccare su un link, scaricare un file, o fornire informazioni), indurrà la vittima a fare lo stesso. Infatti, lo psycho-hacker sfrutterà il bisogno umano di conformarsi al comportamento degli altri, specialmente in situazioni ambigue o incerte. creando un senso di normalità, di conformità e di rassicurazione, incoraggiando la vittima a fare lo stesso per uniformarsi al comportamento della massa, riducendo i suoi sospetti.

Il Modello della Probabilità di Elaborazione (ELM)

A complemento del modello di Cialdini, il Modello della Probabilità di Elaborazione (ELM), elaborato dagli esperti in neuroscienze sociali Richard E. Petty e John T. Cacioppo, offre spunti illuminanti su come gli individui elaborano i messaggi persuasivi (Petty & Cacioppo, 1986). Spesso gli psycho-hacker progettano i loro attacchi per coinvolgere il “percorso periferico” della persuasione, che si basa su una maggiore attenzione da parte della vittima agli indizi superficiali e formali del messaggio (ad esempio, l’apparente autorità del mittente, o specifici appelli emotivi), piuttosto che sulla valutazione critica del contenuto del messaggio.

Ciò è particolarmente efficace in ambienti digitali frenetici, in cui gli utenti potrebbero non avere il tempo o la motivazione per un’analisi approfondita di dati e indizi che potrebbero rivelare l’inganno: in un mondo sommerso da dati e informazioni, il cervello tende a risparmiare energie, trattenendo solo le informazioni superficiali (skimming) per evitare il sovraccarico cognitivo (cognitive overload). Il “percorso periferico” è infatti caratterizzato da un basso livello di analisi e rielaborazione da parte della vittima, che presta maggiore attenzione agli aspetti superficiali e formali del messaggio, senza analisi critica e impegno cognitivo, e con un basso livello informativo. Gli psycho-hacker combinano strategicamente la comprensione dei principi fondamentali della persuasione con le intuizioni di modelli come l’ELM per creare attacchi altamente efficaci. Prendendo di mira specifici fattori psicologici e spesso bypassando il pensiero razionale attraverso indizi periferici, aumentano significativamente le loro possibilità di manipolare le vittime. Una profonda comprensione di questi modelli teorici è essenziale, sia per analizzare l’efficacia degli attacchi di psycho-hacking, sia per sviluppare contromisure robuste.

Attraverso gli studi sull’economia comportamentale sono emersi diversi principi che hanno aiutato gli economisti a comprendere meglio il comportamento economico umano. Partendo da tali principi, i governi e le imprese hanno sviluppato politiche per incoraggiare le persone a fare scelte particolari, ma alcuni di essi vengono utilizzati efficacemente nello psycho-hacking. I principi di persuasione maggiormente sfruttati dagli psycho-hacker sono i seguenti:

- framing: è il principio del modo in cui qualcosa viene presentato a un individuo. Questo concetto presenta un pregiudizio cognitivo (bias), in quanto un risultato può essere determinato in base alla struttura di come qualcosa è stato presentato;

- euristica: significa che gli esseri umani tendono a prendere decisioni più rapidamente usando scorciatoie mentali invece di usare ragionamenti lunghi e razionali. In questa situazione, è più facile per il consumatore continuare a fare quello che sta facendo piuttosto che rendersi conto che esiste una situazione più vantaggiosa;

- avversione alle perdite: le persone cercano di prevenire le perdite più di quanto cerchino di ottenere guadagni. Ad esempio, alcune persone ritengono che le emozioni negative associate alla perdita di una banconota da 20 euro siano molto più forti rispetto al ritrovamento di una banconota da 20 euro per terra;

- contabilità mentale: le persone classificano e trattano il denaro in modo diverso a seconda della sua provenienza e della sua destinazione;

- potere del gratis: un prezzo pari a zero è molto più desiderabile di qualsiasi altro prezzo, anche se basso;

- fallacia dei costi irrecuperabili: si tratta dell’attaccamento emotivo ai costi sostenuti in passato. I consumatori e gli investitori tendono ad avere difficoltà a “lasciar perdere” gli investimenti falliti o il capitale impegnato;

- avidità: per agganciare le loro vittime, gli psyscho-hacker propongono spesso offerte imperdibili, come la truffa ordita nel 2012 ai danni degli utenti Facebook, nella quale la Ray-Ban proponeva un’opportunità incredibile per l’acquisto di un modello esclusivo di occhiali a basso costo; ovviamente l’evento era un falso e il link per accedere all’offerta portava a scaricare un malware in grado di accedere ai dati delle carte di credito degli utenti;

- senso di colpa: far sentire in colpa la vittima, lo spingerà ad uscire dalla situazione stressante e ad accondiscendere alle richieste dello psycho-hacker, che è l’unico in grado di proporre una soluzione. Infatti l’ingegnere sociale, conoscendo questa vulnerabilità emotiva, costruisce specifiche situazioni in grado di suscitare senso di colpa nell’utente, spingendolo a fare una scelta. Ad esempio, facendo credere alla vittima di aver scaricato illecitamente dei file e obbligandolo a pagare una multa online, in modo da estorcere non solo il denaro, ma anche i dati della sua carta di credito;

- senso di gratitudine, compassione e buoni sentimenti: creare un senso di obbligo nella vittima è un altro espediente utilizzato dallo psycho-hacker, il quale può fingere di offrire un servizio o aiuto alla vittima che, sentendosi in obbligo, cederà più facilmente alle richieste dell’aggressore. Questi potrebbe anche fingere di essere un collega in difficoltà, puntando sulla compassione e i buoni sentimenti della vittima, spingendolo ad esempio a fare donazioni o a fornire informazioni riservate;

- panico: sconvolgere l’equilibrio e la consuetudine della vittima è un modo per spingerla a compiere azioni in grado di ristabilire serenità e normalità; il panico infatti può spingere la vittima ad agire d’istinto, inducendolo a compiere atti a volte sconsiderati pur di risolvere il problema e ristabilire l’equilibrio, rientrando nella sua comfort zone;

- ignoranza: alcune azioni di psycho-hacking puntano a creare disorientamento nella vittima, ad esempio utilizzando nei messaggi di attacco un linguaggio tecnico e ricercato, capace di trarre in inganno; in questo caso, la vittima si rivolgerà all’aggressore per risolvere questioni complesse, non avendo la competenza necessaria per affrontarle ed affidandosi ad una persona più esperta e preparata per risolvere il problema;

- desiderio: spesso lo psycho-hacker fa leva sulla libido della vittima, spingendolo a visitare siti di natura pornografica per indurlo a cliccare su link malevoli, in grado di sottrarre dati sensibili e diffondere virus e malware.

Altri principi di persuasione utilizzati dagli psycho-hacker sono: il senso di urgenza e di volatilità (l’utente non può farsi sfuggire un’occasione, perché durerà ancora per poco), nonché l’orientamento al vantaggio e al profitto tipici dell’essere umano, che è utilitaristicamente attratto da stimoli gratificanti, in grado di fargli raggiungere un vantaggio, in soddisfazione di uno scopo o di un interesse (Abdelhamid & Maqableh, 2024).

Le scorciatoie mentali: euristiche e bias cognitivi

La cognizione umana è intrinsecamente limitata, portando gli individui a fare affidamento su euristiche cognitive, o scorciatoie mentali, per prendere decisioni in maniera efficiente e più rapida. Tuttavia, queste scorciatoie possono anche portare a errori sistematici nel pensiero, noti come bias cognitivi, ossia errori di giudizio sistematici, in grado di influenzare e condizionare le decisioni degli utenti. In pratica, mentre le euristiche sono strategie che l’essere umano utilizza per semplificare il processo di analisi e decisione, fornendo una valutazione rapida ed intuitiva di una situazione, i bias cognitivi, sono tendenze sistematiche del ragionamento a deviare dal pensiero razionale, influenzando la percezione e i giudizi dell’individuo. Gli psycho-hacker sono abili nel comprendere e sfruttare queste scorciatoie mentali per manipolare le vittime dei loro attacchi e raggiungere i propri obiettivi.

L’euristica della disponibilità porta gli aggressori a sfruttare notizie recenti o eventi ampiamente pubblicizzati per rendere le loro truffe più pertinenti e credibili, sapendo che gli individui tendono a sovrastimare la probabilità di eventi facilmente richiamati alla mente. L’ancoraggio si verifica quando gli aggressori, presentando un’informazione iniziale (anche se irrilevante o fuorviante), possono influenzare giudizi e decisioni successivi. Ad esempio, un’e-mail di phishing potrebbe menzionare una transazione ampia e apparentemente legittima per far sembrare insignificante una richiesta fraudolenta più piccola in confronto.

Il bias di conferma spinge gli psycho-hacker ad adattare i loro messaggi per allinearli alle convinzioni o ai pregiudizi della vittima, rendendola più propensa ad accettare le informazioni come vere e ad agire di conseguenza. Ciò è particolarmente efficace nelle campagne di disinformazione o negli attacchi di social engineering mirati che sfruttano i profili dei social media. Il bias di autorità si manifesta invece quando gli individui hanno una forte tendenza a soddisfare le richieste di figure che percepiscono come autorevoli.

Gli aggressori sfruttano questo impersonando entità affidabili come agenzie governative, istituzioni finanziarie o dirigenti aziendali per estorcere informazioni sensibili o sollecitare azioni specifiche. Il bias di scarsità si verifica quando la creazione di un senso di urgenza o disponibilità limitata (ad esempio, “Solo pochi account rimasti”, “Questa offerta scade presto”) innesca la paura di perdere qualcosa, spingendo gli individui ad agire impulsivamente senza considerare appieno i potenziali rischi. L’avversione umana alla perdita fa sì che la paura di perdere qualcosa sia spesso un motivatore più forte del desiderio di ottenere qualcosa di equivalente. Gli aggressori sfruttano tale debolezza minacciando conseguenze negative (ad esempio, sospensione dell’account, o sanzioni finanziarie) per costringere le vittime ad agire immediatamente senza riflettere. Il bias dell’ottimismo induce gli individui a sopravvalutare la propria capacità di resistenza agli attacchi informatici e quindi ad adottare pratiche di sicurezza molto superficiali e permissive, sottovalutando le probabilità che eventi negativi possano accadere proprio a loro.

Gli psycho-hacker sfruttano tale vulnerabilità creando scenari che sembrano improbabili truffe, inducendo le vittime ad abbassare la guardia. Allo stesso modo, il bias di familiarità aumenta la tendenza degli individui a fidarsi di e-mail o siti web che sono familiari o legittimi e che si rivelano invece essere ingannevoli. Il bias del conformismo o convalida sociale (ossia il cosiddetto “comportamento del gregge”) si verifica quando le persone tendono a osservare il comportamento degli altri per capire come agire, specialmente in situazioni incerte, conformandosi quindi al comportamento, al pensiero e alle opinioni della maggioranza, da cui trae un senso di sicurezza, di appartenenza al gruppo e di non esclusione (“se lo fanno tutti, allora dovrei farlo anch’io”): il comportamento della maggioranza funge dunque da guida per le azioni individuali, senza una valutazione critica delle proprie decisioni. Sfruttando tale vulnerabilità, gli aggressori potrebbero fabbricare le prove che molte altre persone hanno già intrapreso una particolare azione per incoraggiare la vittima a fare lo stesso. L’effetto curiosità spinge invece gli individui a soddisfare la propria curiosità, anche se ciò comporta conseguenze negative, portandoli a cliccare su link dannosi o ad aprire allegati sospetti semplicemente per soddisfare la propria curiosità.

Le strategie di manipolazione dei bias cognitivi costituiscono, dunque, una componente critica essenziale dell’arsenale psicologico dello psycho-hacker. Comprendendo queste intrinseche debolezze nel ragionamento umano, gli aggressori possono creare tattiche di manipolazione altamente efficaci che spesso eludono un’analisi e una riflessione consapevoli. Riconoscere questi bias non è solo essenziale per comprendere il successo dello psycho-hacking, ma anche per sviluppare interventi orientati a mitigarne l’impatto.

Influenza sociale e obbedienza all’autorità nella manipolazione cyberpsicologica: le lezioni di Milgram e Zimbardo

L’influenza sociale, che comprende sia gli sforzi intenzionali che non intenzionali per alterare il comportamento o l’atteggiamento di qualcuno, svolge un ruolo significativo nel successo degli attacchi di psycho-hacking. Gli aggressori spesso sfruttano varie forme di influenza sociale, incluse l’influenza utilitaristica (basata sulla ricompensa), l’influenza espressiva di valore (basata sulle convinzioni) e l’influenza informativa (basata sulla competenza percepita), per manipolare le loro vittime. Il classico esperimento di obbedienza dello psicologo statunitense Stanley Milgram, condotto nel 1961 presso l’Interaction Laboratory dell’Università di Yale, fornisce una prova evidente della forte propensione degli individui a obbedire a figure autoritarie, considerate legittime, anche quando viene chiesto loro di compiere azioni che sono in conflitto con la loro morale personale e i valori etico-sociali condivisi (Milgram, 1974). Gli psycho-hacker sfruttano frequentemente questa tendenza, impersonando figure autorevoli all’interno di un’organizzazione (ad esempio, un CEO, o il supporto IT di un’azienda) o da entità esterne affidabili (ad esempio, agenzie governative, banche, amministrazioni pubbliche) per ottenere obbedienza.

Allo stesso modo, l’esperimento carcerario di Stanford, condotto nel 1971 nell’università californiana dallo psicologo americano Philip G. Zimbardo, ha dimostrato la potente influenza dei ruoli e delle norme sociali sul comportamento individuale (Zimbardo, 1999). Spesso replicato negli attacchi informatici, il principio evidenzia come gli aggressori possano sfruttare i ruoli percepiti (ad esempio, quelli autoritari, o autoritativi, ossia determinati da una supposta istituzione pubblica), o creare pressioni sociali all’interno di ambienti online per manipolare le vittime, inducendole a mettere in atto comportamenti specifici, influenzando la loro consapevolezza e il senso di responsabilità. Ad esempio, creare una falsa comunità online in cui i membri sono incoraggiati a condividere informazioni sensibili con la scusa della collaborazione.

Una profonda comprensione delle dinamiche dell’influenza sociale e dei potenti fattori psicologici dell’obbedienza e della conformità è cruciale per analizzare come gli psycho-hacker manipolano gli individui in ambiente digitale. Queste tendenze sociali, profondamente radicate nell’essere umano, possono spesso prevalere sul miglior giudizio di un individuo, portando all’obbedienza a richieste dannose anche quando potrebbero essere presenti segnali di allarme, che la vittima non riesce a rilevare.

Manipolazione emotiva: sfruttare i sentimenti umani per trarre guadagni illeciti

La manipolazione emotiva è una tattica fondamentale impiegata dai psycho-hacker, che sfruttano una vasta gamma di emozioni umane, tra cui paura, senso di colpa, compassione, interesse, amore, affetto, tristezza, perdita, per offuscare il giudizio, estorcere informazioni sensibili o indurre azioni specifiche. Creare un senso di urgenza o panico è una tecnica comune utilizzata per bypassare il pensiero razionale e spingere le vittime a prendere decisioni affrettate senza un’adeguata verifica.

Ad esempio, le e-mail che avvertono di un’immediata sospensione dell’account a causa di attività sospette o che affermano che un dispositivo è stato infettato da un virus, spesso innescano paura e il desiderio di risolvere rapidamente il problema. Fare appello all’avidità e al desiderio di facili guadagni attraverso offerte che sembrano troppo belle per essere vere (ad esempio, vincere una lotteria, o ricevere una grande eredità) è un’altra tattica efficace utilizzata per attirare vittime ignare in trappole in cui potrebbero divulgare informazioni personali o dettagli finanziari. Sfruttare l’innato desiderio umano di aiutare gli altri e i sentimenti di empatia è un’altra potente tecnica di manipolazione e persuasione. Gli aggressori potrebbero impersonare qualcuno in difficoltà o affermare di rappresentare una causa benefica per sollecitare donazioni o estorcere informazioni con false pretese.

La capacità di manipolare efficacemente le emozioni umane è un’abilità fortemente presente nell’arsenale dello psycho-hacker. Conoscendo i meccanismi mentali e prendendo di mira particolari vulnerabilità emotive, gli aggressori possono aumentare significativamente la probabilità di successo dei loro attacchi. Riconoscere questi fattori emotivi scatenanti e sviluppare strategie efficaci, che consentono di mantenere una mentalità razionale e una lucidità emotiva di fronte a comunicazioni emotivamente cariche e insidiose, è vitale per costruire un’atteggiamento vigile e resiliente contro lo psycho-hacking.

Tattiche avanzate di psycho-hacking in scenari reali: alcuni casi di studio

Numerosi casi di studio reali illustrano in maniera evidente le tattiche diversificate e spesso sofisticate impiegate dagli psycho-hacker e le loro significative conseguenze per individui e organizzazioni. Esempi di alto profilo includono attacchi di compromissione della posta elettronica aziendale (BEC), che hanno comportato perdite multimilionarie per aziende come Ubiquiti Networks e Toyota, o violazioni di dati che hanno interessato milioni di clienti presso organizzazioni come Target e Sony Pictures avviate tramite ingegneria sociale, e persino sofisticati attacchi mirati a influenzare i risultati politici, come gli attacchi di spear-phishing che hanno preso di mira il Partito Democratico U.S.A. nel 2016, portando alla compromissione dell’account email di John Podesta, responsabile della campagna di Hillary Clinton; tali attacchi, che si sono dimostrati particolarmente mirati, hanno permesso ai cybercriminali di ottenere accesso a informazioni sensibili, poi rivelate da WikiLeaks. Si ricordi inoltre la recente truffa ai danni di numerosi imprenditori italiani, inscenata attraverso un attacco di vishing a nome dell’attuale ministro della difesa Guido Crosetto, che ha spinto il Governo italiano ad aumentare nei prossimi anni la spesa in tema di cybersecurity. Tutti questi casi evidenziano il pericolo di infliggere gravi danni finanziari, reputazionali e persino politici a tutti gli Stati. Tattiche evolute di psycho-hacking, supportate dall’AI, sono ancora più evidenti nel caso della tecnologia deepfake utilizzata per impersonare il direttore finanziario di una multinazionale britannica con sede a Hong Kong (rimasta anonima) durante una videochiamata che ha ingannato i dipendenti, portando al trasferimento fraudolento di 25 milioni di dollari, e l’attacco di social engineering strategico utilizzato per bypassare l’autenticazione a più fattori presso Uber. Questi esempi dimostrano la crescente sofisticazione e integrazione tra psicologia e tecnologia di questi attacchi.

L’ingegneria sociale inversa, qui intesa non come tecnica di decostruzione della minaccia partendo dai danni inferti (con l’obiettivo di escogitare specifiche contromisure), ma nel senso in cui gli aggressori sabotano i sistemi informatici e poi pubblicizzano la loro capacità di risolvere il problema, inducendo le vittime ad avvicinarsi a loro per assistenza, nonché gli attacchi di baiting, che comportano l’abbandono di supporti infetti da malware come chiavette USB in luoghi pubblici con etichette allettanti, illustrano ulteriormente la creatività e adattabilità degli psycho-hacker. L’analisi di questi casi di studio reali fornisce preziose informazioni sulle specifiche vulnerabilità psicologiche prese di mira, sulle tecniche impiegate e sul potenziale impatto degli attacchi di psycho-hacking finora riusciti, fungendo da strumenti di apprendimento critici, per comprendere l’evoluzione del panorama delle minacce e informare lo sviluppo di strategie di difesa più efficaci.

La vulnerabilità del “fattore umano”

Il “fattore umano” è costantemente identificato come la vulnerabilità primaria nell’ambito della sicurezza informatica, spesso più facile da sfruttare rispetto alle misure di sicurezza tecniche, in quanto mirata ad ottenere una risposta d’impulso da parte delle vittime (Hadnagy, 2014; 2019; Cochran, 2024). Questa suscettibilità è profondamente radicata nei tratti psicologici fondamentali ed i bias cognitivi intrinseci alla natura umana. Tendenze umane innate come la fiducia, il desiderio di essere utili, il bisogno di accettazione sociale e di approvazione, e l’empatia sono leve psicologiche chiave che gli psycho-hacker sfruttano abilmente per ottenere la fiducia delle loro vittime e manipolarle, compromettendo la loro sicurezza e quella delle organizzazioni di cui fanno parte, che sono spesso il vero obiettivo dell’attacco (Halevi et al., 2013; Corradini & Franchina, 2016; Cusack & Adedokun, 2018; Gratian et al., 2018).

I bias cognitivi, che sono schemi sistematici di deviazione dal giudizio razionale, svolgono un ruolo significativo nel rendere gli individui vulnerabili agli attacchi di psycho-hacking. Queste scorciatoie mentali (o euristiche), pur essendo spesso efficienti nel processo decisionale quotidiano, possono essere facilmente sfruttate in scenari di ingegneria sociale attentamente orchestrati. Inoltre, le risposte emotive a situazioni stressanti o urgenti possono spesso prevalere sul pensiero razionale, portando gli individui a prendere decisioni impulsive e potenzialmente rischiose che altrimenti eviterebbero. Gli psycho-hacker sfruttano frequentemente questi fattori emotivi scatenanti a loro vantaggio.

La vulnerabilità del “fattore umano” nella sicurezza informatica non è semplicemente una questione di insufficiente conoscenza tecnica o mancanza di consapevolezza. È profondamente radicata nei processi psicologici fondamentali che governano il comportamento umano e il processo decisionale.

Affrontare efficacemente tali vulnerabilità richiede una chiara comprensione di questi meccanismi psicologici sottostanti e lo sviluppo di contromisure che li prendano di mira direttamente. Un esempio del cinismo dello psycho-hacking è il cosiddetto “opportunismo delle minacce informatiche” (exploit), che in questo caso si riferisce alla capacità di sfruttare precisi momenti storici, eventi o situazioni contingenti, di solito largamente notiziati dai media, durante i quali le vittime potrebbero essere più vulnerabili ed emotive e, quindi, maggiormente a rischio di essere ingannate. Non è un caso che un evento di risonanza globale, come la recente scomparsa del Pontefice, sia stata sfruttata dai criminali informatici puntando sulla commozione, il senso di pietà, il coinvolgimento e la vulnerabilità emotiva delle vittime. Infatti, come rilevato da Check Point Research, società israeliana specializzata nella rilevazione delle cyberminacce su scala globale, attraverso alcune piattaforme social sono state diffuse false immagini di Papa Francesco moribondo, manipolate attraverso l’intelligenza artificiale, con l’obiettivo di trarre in inganno le vittime, spingendole a cliccare su link malevoli per carpire informazioni sensibili o sottrarre denaro.

Un gruppo di esperti dello Human Technology Lab dell’Università Cattolica del Sacro Cuore di Milano ha recentemente proposto la teoria del “sistema di pensiero 0” per cercare di spiegare l’influenza dell’intelligenza artificiale sui nostri processi cognitivi (Chiriatti et al., 2024): mentre il “sistema di pensiero 1” riguarda tutte le decisioni che un utente prende velocemente, d’istinto e senza riflettere (che, come si è visto, rappresentano la vera debolezza del “fattore umano” negli attacchi di psycho-hacking); il “sistema di pensiero 2” è, al contrario, analitico e riflessivo; è quello dove avvengono scelte ponderate e razionali (e che viene accuratamente evitato dagli psycho-hacker).

Il “sistema di pensiero 0” è invece il nuovo dominio di azione degli psycho-hacker, in quanto rappresenta una sorta di estensione cognitiva umana: tale sistema riguarda la tendenza dell’utente ad affidarsi ai risultati dell’intelligenza artificiale, reputandoli veri e affidabili (bias dell’infallibilità della macchina). Questo sistema di pensiero (o meglio, di processamento delle informazioni) non risiede nelle mente umana, ma si estende al di fuori di essa potenziando le sue capacità cognitive, in quanto capace di elaborare una grande quantità di informazioni che l’utente non sarebbe in grado di gestire. Ma mentre i sistemi 1 e 2 sono capaci di dare un significato alle informazioni elaborate, in quanto direttamente connessi alla mente umana, il “sistema 0”, essendo un’estensione artificiale della mente, non le comprende ed ha bisogno dell’interpretazione dell’utente per dar loro un senso compiuto. È proprio lì che lo psycho-hacking si insinua pericolosamente, confidando nella fiducia della vittima nelle rappresentazioni dell’AI: ad esempio, fidandosi di un deepfake. Affidare le proprie decisioni o scelte al “sistema 0” significa rinunciare alle proprie capacità di ragionamento autonomo, pensiero critico-riflessivo e consapevolezza razionale, accettando passivamente la realtà proposta dalla macchina. Ed uno psycho-hacker farà di tutto per stimolare tale sistema di pensiero nelle sue vittime.

Quadri etici e legali che affrontano lo psycho-hacking

L’applicazione delle tecniche di manipolazione psicologica nell’ambito degli attacchi informatici solleva importanti dilemmi etici, soprattutto per quanto riguarda il problema della privacy e del consenso informato, nonché la capacità di causare danni non solo a singoli individui, ma ad intere organizzazioni. Il principio di base è che non rileva la negligenza dell’utente, ma il percorso psicologico ingannevole messo in atto da terzi per indurre l’utente a compiere determinate azioni dannose per sé e per le organizzazioni di cui fa parte.

Quadri giuridici, come il Computer Fraud and Abuse Act (CFAA) e l’Electronic Communications Privacy Act (ECPA) negli Stati Uniti, disciplinano il ricorso legale contro l’accesso non autorizzato ai computer e le violazioni dei dati, che sono spesso il risultato diretto di tentativi di psycho-hacking andati a segno. Queste leggi criminalizzano le attività che comportano l’accesso ai sistemi informatici senza autorizzazione, o l’abuso di accesso autorizzato per ottenere informazioni. Come ulteriore misura di difesa, è importante accennare all’hacking etico, che utilizza tecniche simili allo psycho-hacking per scopi leciti e difensivi (ad esempio, penetration testing, o valutazioni d’impatto di ingegneria sociale), opera secondo rigidi codici di condotta e richiede un consenso esplicito e informato da parte degli amministratori dei sistemi o degli individui presi di mira. In questo caso, la trasparenza e la responsabilità sono fondamentali nelle pratiche di hacking etico.

A volte, però, il confine etico tra test di sicurezza legittimi che coinvolgono l’ingegneria sociale e lo psycho-hacking dannoso può essere sfumato e potenzialmente problematico, specialmente quando le tecniche comportano l’inganno o la raccolta di informazioni personali sensibili. Bilanciare la necessità di testare le vulnerabilità della sicurezza con l’imperativo etico di rispettare la privacy e l’autonomia individuali è una sfida critica che necessita di ulteriori approfondimenti.

Il panorama etico e legale che circonda lo psycho-hacking è dunque complesso e richiede un’attenta analisi, anche alla luce dell’evoluzione delle strategie d’inganno, rese ancora più complesse dall’utilizzo dell’intelligenza artificiale. Sebbene l’uso della manipolazione psicologica possa essere giustificato in determinati contesti (ad esempio, con il consenso esplicito per i test di sicurezza), la sua applicazione senza tale consenso, o per scopi dannosi, comporta significative ramificazioni etiche e legali. L’adesione a rigide linee-guida etiche, e una profonda comprensione dei quadri giuridici necessari, sono essenziali per i ricercatori e i professionisti della cybersicurezza, sollecitando nuove riflessioni su un tema di grande attualità.

Contromisure individuali: aumentare la consapevolezza, il pensiero critico e la comprensione dell’errore umano

Un passo fondamentale per difendersi dallo psycho-hacking è senz’altro quello di aumentare la consapevolezza individuale delle varie tattiche impiegate dagli aggressori. Ciò comporta programmi di istruzione e formazione completi e continui, che informino gli utenti sulle comuni tecniche di ingegneria sociale come phishing, spear phishing, vishing, spoofing, pretexting, baiting, tailgating e piggybacking. Coltivare forti capacità di pensiero critico e promuovere un sano senso di scetticismo nei confronti delle interazioni online e digitali sono cruciali affinché gli individui possano resistere ai tentativi di manipolazione.

Gli utenti dovrebbero essere incoraggiati a mettere in discussione richieste insolite, a verificare l’identità dei mittenti e a diffidare delle comunicazioni emotivamente cariche o urgenti. Gli individui dovrebbero prestare molta attenzione quando condividono informazioni personali online ed essere particolarmente cauti nei confronti di richieste insolite e non pertinenti di dati sensibili come password, dettagli finanziari o numeri di identificazione personale. La verifica della legittimità delle richieste attraverso canali ufficiali è essenziale. L’adozione di pratiche di base per la sicurezza informatica può ridurre significativamente il rischio di cadere vittima dello psycho-hacking. Ciò include, comè noto, l’utilizzo di password complesse e univoche per diversi account, l’abilitazione dell’autenticazione a più fattori quando possibile, il mantenimento aggiornato del software e la cautela nel fare clic su link o scaricare allegati da fonti sconosciute o sospette. Data la debolezza e vulnerabilità del “fattore umano”, potenziare negli individui la conoscenza delle tattiche di psycho-hacking e promuovere le capacità di pensiero critico sono le prime linee di difesa più efficaci. Comprendendo come potrebbero essere manipolati, gli individui possono diventare più resilienti a questi attacchi.

Strategie organizzative: costruire un “firewall umano” resiliente e proattivo

Le organizzazioni (aziende o enti, sia pubblici che privati) dovrebbero svolgere un ruolo cruciale nella costruzione di un “firewall umano” resiliente contro lo psycho-hacking, aumentando la comprensione delle basi psicologiche della cybersecurity. Com’è noto, il concetto di human firewall, nell’ambito della sicurezza informatica, si riferisce ad un approccio che descrive la necessità di educare e formare i dipendenti di un’organizzazione a riconoscere e contrastare le minacce informatiche, proprio come un firewall di rete tradizionale. In sostanza, i dipendenti diventano la prima linea di difesa contro gli attacchi informatici che, nel caso dello psycho-hacking, sfruttano l’errore umano per penetrare nei sistemi. L’implementazione di programmi di formazione sulla consapevolezza e la sicurezza informatica completi e regolarmente aggiornati è di fondamentale importanza. Tali programmi dovrebbero andare oltre la semplice definizione tecnica delle minacce ed educare i dipendenti sui principi psicologici alla base dell’ingegneria sociale, aiutandoli a capire perché questi attacchi sono efficaci. Gli esseri umani rappresentano, quindi, sia l’anello più debole che la risorsa più forte per quanto riguarda la sicurezza informatica e i dipendenti possono contribuire attivamente alla protezione dei dati sensibili, rimanendo costantemente informati sulle ultime minacce e tendenze della cybersecurity, nonché sulle principali vulnerabilità del “fattore umano”.

La conduzione di attacchi di ingegneria sociale simulati, come le campagne di phishing, consente alle organizzazioni di testare l’efficacia della loro formazione e identificare i dipendenti che potrebbero essere più vulnerabili, consentendo una formazione mirata. L’istituzione di politiche e procedure di sicurezza chiare e ben comunicate per la gestione delle informazioni sensibili, la verifica delle richieste e la segnalazione di attività sospette è essenziale per guidare il comportamento dei dipendenti. L’implementazione di solidi controlli tecnici, come l’autenticazione a più fattori, un robusto filtraggio antispam e soluzioni di sicurezza degli endpoint, può fornire ulteriori livelli di difesa e protezione, riducendo la probabilità di inganno anche se un utente commette un errore. Promuovere una cultura della sicurezza psicologica all’interno dell’organizzazione, in cui i dipendenti si sentano a proprio agio nel segnalare potenziali incidenti di sicurezza o errori senza timore di essere incolpati per eventuali errori, è fondamentale per la rilevazione precoce e la mitigazione dei tentativi di psycho-hacking. L’utilizzo di strumenti di analisi del comportamento degli utenti può aiutare a identificare schemi di attività anomali che potrebbero indicare un account compromesso o un attacco di psycho-hacking riuscito, consentendo un intervento tempestivo.

Costruire un “firewall umano” resiliente e proattivo richiede un approccio olistico, stratificato e multidisciplinare che integri una formazione completa sulle tecniche di manipolazione tecnologica in ambiente digitale, simulazioni realistiche, politiche organizzative chiare, solidi controlli tecnici e una cultura attenta alla sicurezza. Affrontare gli aspetti psicologici di questi attacchi è fondamentale per rafforzare la postura di sicurezza complessiva, sia da parte delle aziende che di enti pubblici.

Il futuro della ricerca e della difesa nell’ambito dello psycho-hacking

Il panorama del psycho-hacking è in costante evoluzione, rendendo necessaria una ricerca continua per comprendere le tattiche emergenti, in particolare quelle che sfruttano tecnologie avanzate come l’intelligenza artificiale e i deepfake per creare attacchi sempre più sofisticati e convincenti. Ulteriori ricerche sono fondamentali per acquisire una comprensione più approfondita dei fattori e dei tratti psicologici specifici che contribuiscono alla suscettibilità individuale ai diversi tipi di attacchi di psycho-hacking. Ciò include necessariamente l’esplorazione del ruolo dei tratti della personalità, degli stili cognitivi e dell’intelligenza emotiva. Questo significa conoscere le basi neurali dei processi cognitivi per ridurre l’errore umano, al fine di evitare le manipolazioni e gli inganni degli psycho-hacker ed aumentare la resilienza verso le minacce emergenti (neuroergonomia).

Lo sviluppo di metodologie di formazione più efficaci e coinvolgenti che vadano oltre la tradizionale sensibilizzazione alla sicurezza e affrontino attivamente i bias cognitivi e i fattori emotivi scatenanti è essenziale per costruire una resilienza a lungo termine (Widdowson, 2025). Ciò potrebbe comportare l’implementazione di principi di economia comportamentale, neuromarketing e gamification. Le implicazioni etiche, sia nella conduzione di ricerche sullo psycho-hacking (ad esempio, attraverso simulazioni), sia nello sviluppo di strategie difensive che potrebbero comportare un certo grado di manipolazione psicologica (ad esempio, utilizzando tecniche di nudge), richiedono una considerazione attenta e continua, nonché una particolare attenzione all’architettura delle scelte (Thaler & Sunstein, 2009). Una maggiore collaborazione tra esperti di sicurezza informatica, psicologi e scienziati comportamentali è vitale per far progredire la comprensione dell’elemento umano nella sicurezza informatica e per sviluppare strategie di difesa più efficaci e incentrate sull’uomo. Il futuro della ricerca e della difesa nell’ambito dello psycho-hacking sarà probabilmente caratterizzato da una continua corsa agli armamenti tra aggressori e difensori, con la tecnologia che svolgerà un ruolo sempre più significativo. Rimanere al passo con le minacce emergenti richiederà una forte attenzione alla ricerca interdisciplinare, allo sviluppo di tecniche di formazione innovative e a un’attenta considerazione delle implicazioni etiche delle strategie adottate.

Conclusioni

L’analisi presentata in questo articolo evidenzia come lo psycho-hacking rappresenti una minaccia sofisticata e in continua evoluzione nel panorama della cybersecurity. Come si è visto, sfruttando la complessa interazione tra psicologia umana e tecnologia, gli psycho-hacker sono in grado di manipolare individui e organizzazioni in modi che spesso eludono le tradizionali difese di tipo tecnologico. La comprensione dei principi della persuasione, dei bias cognitivi, dell’influenza sociale e della manipolazione emotiva, così come il ruolo amplificatore della tecnologia, è fondamentale per affrontare efficacemente questa sfida, rafforzando il principio della cybersicurezza comportamentale.

Le contromisure individuali e organizzative devono andare oltre la semplice consapevolezza tecnica e concentrarsi sullo sviluppo del pensiero critico e della resilienza psicologica. Programmi di formazione mirati, simulazioni realistiche e la promozione di una cultura della sicurezza attenta sono elementi essenziali per costruire un “firewall umano” efficace. Inoltre, la continua ricerca interdisciplinare e la considerazione delle implicazioni etiche e legali sono necessarie per rimanere al passo con le tattiche emergenti e garantire che le strategie di difesa siano efficaci, oltre che responsabili. In definitiva, la lotta contro lo psycho-hacking richiede un approccio olistico ed interdisciplinare che riconosca la centralità dell’elemento umano nella sicurezza informatica, preservando le sue capacità di discernimento razionale.

Bibliografia

Abdelhamid, R.K., & Maqableh, M. (2024). The Power of Persuasion: Exploring Social Engineering in the Digital Age. In M.A. Al-Sharafi, M. Al-Emran, G.WH. Tan & K.B. Ooi, (Eds.), Current and Future Trends on Intelligent Technology Adoption. Studies in Computational Intelligence, 1161, vol. 2 (pp. 307-330). Cham, CH: Springer.

Abraham, S., & Chengalur-Smith, I. (2010). An overview of social engineering malware: trends, tactics, and implications. Technology in Society, 32(3), 183-196. https://doi.org/10.1016/j.techsoc.2010.07.001.

Albladi, S.M., & Weir, G.R.S. (2018). User characteristics that influence judgment of social engineering attacks in social networks. HCIS 8(1), 1-24. https://doi.org/10.1186/s13673-018-0128-7.

Ancis, J.R. (2020). The Age of Cyberpsychology: An Overview. Technology, Mind, and Behavior, 1(1). https://doi.org/10.1037/tmb000000.

Attrill, A. (Ed.) (2015). Cyberpsychology. Oxford: Oxford University Press.

Attrill, A., & Fullwood, C. (Eds.) (2016). Applied Cyberpsychology: Practical Applications of Cyberpsychological Theory and Research. London: Palgrave Macmillan.

Attrill-Smith, A., Fullwood, C., Keep, M., & Kuss, D.J. (Eds.) (2019). The Oxford Handbook of Cyberpsychology. Oxford: Oxford University Press.

Bone, J. (2021). Cognitive Hack: The New Battleground in Cybersecurity… the Human Mind. Boca Raton, FL: CRC Press (Auerbach Publications) – Taylor & Francis Group.

Bossomaier, T., D’Alessandro, S., & Bradbury, R. (2022). Human Dimensions of Cybersecurity. Boca Raton, FL: CRC Press (Auerbach Publications) – Taylor & Francis Group.

Bhusal, C.S. (2021). Systematic review on social engineering: hacking by manipulating humans. Journal of Information Security, 12, 104-114.

Chetioui, K., Bah, B., Alami, A. O., & Bahnasse, A. (2022). Overview of Social Engineering Attacks on Social Networks. Procedia Computer Science, 198, 656-661. https://doi.org/10.1016/j.procs.2021.12.302.

Chiriatti, M., Ganapini, M., Panai, E., Ubiali, M., & Riva, G. (2024). The case for human–AI interaction as system 0 thinking. Nature Human Behavior, 8, 1829-1830. https://doi.org/10.1038/s41562-024-01995-5.

Cialdini, R.B. (1984). Influence: The Psychology of Persuasion. New York, NY: William Morrow and Company.

Cialdini, R.B. (2022). Le armi della persuasione. Milano: Giunti.

Cochran, K.A. (2024). Social Engineering: Manipulating the Human Element. In: Cybersecurity Essentials. Berkeley, CA: Apress. https://doi.org/10.1007/979-8-8688-0432-8_13.

Conteh, N.Y., & Royer, M.D. (2016). The Rise in Cybercrime and the Dynamics of Exploiting the Human Vulnerability Factor. International Journal of Computer, 20(1), 1-12.

Corradini, I., & Franchina, L. (2016). Ingegneria sociale: aspetti umani e tecnologici. Roma: Edizioni Themis.

Cristescu, I., Ciupercă, E.M., & Cîrnu, C.E. (2022). Exploiting personality traits in social engineering attacks. Romanian Journal of Information Technology and Automatic Control, 32(1), 113-122.

Curioni, A. (2024). Hacker. Storie di uomini e di macchine. Milano: Chiarelettere.

Curtis, S. R., Rajivan, P., Jones, D. N. & Gonzales, C. (2018). Phishing attempts among the dark triad: Patterns of attack and vulnerability. Computers in Human Behavior, 87, 174-182.

Cusack, B., & Adedokun, K. (2018). The impact of personality traits on user’s susceptibility to social engineering attacks. In Proceedings of the 16th Australian Information Security Management Conference(pp. 83-89). Perth, AU: Edith Cowan University. https://doi.org/10.25958/5c528ffa66693.

Ecker, P.A. (2025). The Digital Reinforcement of Bias and Belief. Understanding the Cognitive and Social Impact of Web-Based Information Processing. Cham, CH: Palgrave Macmillan.

Emond, B., & West, R.L. (2004). Cyberpsychology: A Human-Interaction Perspective based on Cognitive Modeling. CyberPsychology & Behavior, 6(5), 527-536.

Erbschloe, M. (2020). Social Engineering: Hacking Systems, Nations, and Societies. Boca Raton, FL: CRC Press – Taylor & Francis Group.

European Union Agency for Cybersecurity, ENISA (2022). European Cybersecurity Skills Framework. https://www.enisa.europa.eu/topics/skills-and-competences/skills-development/european-cybersecurity-skills-framework-ecsf.

Fogg, B.J. (2003). Persuasive technology: Using computers to change what we think and do. San Francisco, CA: Morgan Kaufmann Publishers Inc.

Frauenstein, E.D. & Flowerday, S. (2020). Susceptibility to phishing on social network sites: A personality information processing model. Computers & Security, 94, 101862. https://www.sciencedirect.com/science/article/pii/S0167404820301346.

Frumento, E. (2015). Le PA vittime ideali degli attacchi social engineering per le lacune di cultura informatica (online). https://www.forumpa.it/pa-digitale/sicurezza-digitale/le-pa-vittime-ideali-degli-attacchi-social-engineering-per-le-lacune-di-cultura-informatica/#_ftn1.

Fuertes, W., Arévalo, D., Castro, J.D., Ron,Carlos, M., Estrada, A., Andrade, R., Fernández Peña, F., & Benavide, E. (2022). Impact of Social Engineering Attacks: A Literature Review. In Á. Rocha, C.H. Fajardo-Toro & J.M.R. Rodríguez (Eds.). Developments and Advances in Defense and Security. Smart Innovation, Systems and Technologies, vol. 255 (pp. 25-35). Singapore: Springer.

Germani, L.S. (Ed.) (2017). Disinformazione e manipolazione delle percezioni. Roma: Eurilink University Press.

Goleman, S. (2023). Psicologia nera e manipolazione mentale. La Vergne, TN: IngramSpark – Digital Services and Publication Expert, LLC.

Gordo-López, Á.J., & Parker, I. (Eds.) (1999). Cyberpsychology. New York, NY: Routledge.

Gratian, M., Bandi, S., Cukier, M., Dykstra, J., & Ginther, A. (2018). Correlating human traits and cyber security behavior intentions. Computers & Security, 73, 345-358.

Guidetti, O., Ahmed, M., & Speelman, C. (Eds.) (2025). Psybersecurity. Human Factors of Cyber Defence. Boca Raton, FL: CRC Press – Taylor & Francis Group.

Hadnagy, C. (2014). Unmasking the Social Engineer: The Human Element of Security. Hoboken, NJ: John Wiley & Sons Inc.

Hadnagy, C. (2019). Human Hacking. Influenzare e manipolare il comportamento umano con l’ingegneria sociale. Milano: Apogeo.

Halevi, T., Lewis, J., & Memon, N. (2013). Phishing, Personality Traits and Facebook. arXiv:1301.7643. https://doi.org/10.48550/arXiv.1301.7643.

Hiruni, C. (2024). Psychological Warfare in the Digital Age: The Role of Cyber Operations in Modern PsyOps (preprint). https://doi.org/10.13140/RG.2.2.34079.37283.

Imanaka, J., Ogawa, M-B., Crosby, M.E. (2023). Personality Traits as Predictors for Social Engineering Vulnerability. In D.D. Schmorrow & C.M. Fidopiastis (Eds.) Augmented Cognition. Proceedings of the 25th HCI International Conference, HCII 2023, vol. 14019 (pp. 221-231). Cham, CH: Springer. https://doi.org/10.1007/978-3-031-35017-7_15.

Irani, D., Balduzzi, M., Balzarotti, D., Kirda, E., & Pu, C. (2011). Reverse Social Engineering Attacks in Online Social Networks. In T. Holz & H. Bos (Eds.), Detection of Intrusions and Malware, and Vulnerability Assessment. DIMVA 2011, vol 6739 (pp. 55-74). Berlin, Heidelberg: Springer. https://doi.org/10.1007/978-3-642-22424-9_4.

Jones, K.S., Armstrong, M.E., Tornblad, M.K., & Siami Namin, A. (2021). How social engineers use persuasion principles during vishing attacks. Information & Computer Security, 29(2), 314-331.

Khan, N.F., Yaqoob, A., & Khan, M.S. (2022). The cybersecurity behavioral research: A tertiary study. Computers & Security, 120. https://doi.org/10.1016/j.cose.2022.102826.

Kirwan G, & Power A. (2011). The psychology of cyber crime. Hesrhey, PA: IGI Global Press.

Kirwan, G., Connolly, I., Barton, H., Palmer, M. (Eds.) (2024). An introduction to cyberpsychology. New York, NY: Routledge.

Klimburg-Witjes, N., & Wentland, A. (2021). Hacking humans? Social Engineering and the construction of the “deficient user” in cybersecurity discourses. Science, Technolology, & Human Values, 46(6), 1316-1339.

Koza, E., Öztürk, A., & Willer, M. (2024). Social Engineering and Human Hacking. Berlin, Heidelberg: Springer Vieweg.

Kushwaha, A., Singh, P., & Waoo, A.A. (2024). Review on Social Engineering Attacks and Defense Mechanisms. ShodhKosh: Journal of Visual and Performing Arts, 5(5), 362-368. https://doi.org/10.29121/shodhkosh.v5.i5.2024.1887.

Lahcen, R.A.M., Caulins, B., Mohapatra, R., & Kumar, M. (2020). Review and insight on the behavioral aspects of cybersecurity. Cybersecurity, 3(1). https://doi.org/10.1186/s42400-020-00050-w.

Le Bon, G. (2021) [1895]. Psicologia delle folle (con espansione sulle folle digitali). Cesano Maderno, MB: Ibex Edizioni.

Lee, S., Eom, J.H., Lee, B., & Choi, J.H. (2012). A Conceptual Study on Knowledge-Based Personal Information Gathering Methods for Conducting Psychological Warfare in Cyberspace. In: G. Lee, D. Howard, D. Ślęzak, & Y.S. Hong (Eds.), Communications in Computer and Information Science, vol. 310. Berlin, Heidelberg: Springer. https://doi.org/10.1007/978-3-642-32692-9_37.

Longtchi, T.T., Rodriguez, R.M., Al-Shawaf, L., Atyabi, A., & Xu, S. (2024). Internet-Based Social Engineering Psychology, Attacks, and Defenses: A Survey. Proceedings of the IEEE, 112(3), 210-246. https://doi.org/10.1109/JPROC.2024.3379855.

Lugo, R.G., Sütterlin, S., Knox, B.J., Bukauskas, L., Brilingaitė, A., & Maennel, O.M. (2023) Editorial: The human factor in cyber security education. Frontiers in Education, 8:1277282. https://doi.org/10.3389/feduc.2023.1277282.

Mann, M.I. (2008). Hacking the human: social engineering techniques and security countermeasures. Aldershot, UK: Gower Publishing Ltd.

McAlaney, J., Frumkin, L.A., & Benson, V. (Eds.) (2018). Psychological and behavioral examinations in cyber security. Hershey, PA: IGI Global Scientific Publishing.

Milgram, S. (1974). Obedience to Authority: An Experimental View. New York, NY: HarperCollins.

Mitnick, K.D., & Simon, W.L. (2003). L’arte dell’inganno. Milano: Feltrinelli.

Mitnick, K.D., & Simon, W.L. (2005).The Art of Intrusion. Indianapolis, IN: Wiley Publishing.

Montañez, R., Golob, E., & Xu, S. (2020). Human Cognition Through the Lens of Social Engineering Cyberattacks. Frontiers in Cyberpsychology, 11. https://doi.org/10.3389/fpsyg.2020.01755.

Moustafa, A.A., Bello, A., & Maurushat, A. (2021). The Role of User Behaviour in Improving Cyber Security Management. Frontiers in Psychology, 12. https://doi.org/10.3389/fpsyg.2021.561011.

Murphy, J., & Keane, A. (2019). Cyberpsychological threat intelligence. In T. Cruz & P. Simoes (Eds.), Proceedings of the 18th European Conference on Cyber Warfare and Security, ECCWS 2019 (pp. 314-318). Red Hook, NY: Curran Associates Inc. https://www.proquest.com/conference-papers-proceedings/cyberpsychological-threat-intelligence/docview/2261026637/se-2.

Norman, K.L. (2017). Cyberpsychology: An Introduction to Human-Computer Interaction. Cambridge: Cambridge University Press.

Numada, K., Nozaki, S., Takaiwa, T., Ohki, T., & Nishigaki, M. (2024). Perceiving Human Psychological Consistency: Attack Detection Against Advanced Persistent Social Engineering. In L. Barolli (Ed.). Advances in Internet, Data & Web Technologies, EIDWT 2024. vol 193. Cham, CH: Springer. https://doi.org/10.1007/978-3-031-53555-0_15.

Oltramari, A., Henshel, D, Cains, M., & Hoffman, B. (2015). Towards a Human Factors Ontology for Cyber Security. Semantic Technologies for Intelligence, Defense, and Security, Corpus ID: 18074878. https://stids.c4i.gmu.edu/papers/STIDS_2015_T04_Oltramari_etal.pdf.

Pacilli, M.G., Giovannelli, I., Spaccatini, F. (Eds.) (2021). Psicologia sociale dei media digitali. Milano: Apogeo.

Packard, V. (2015) [1957]. I persuasori occulti. Torino: Einaudi.

Papatsaroucha, D., Nikoloudakis, Y., Kefaloukos, I., Pallis, E., & Markakis, E. K. (2021). A Survey on Human and Personality Vulnerability Assessment in Cybersecurity: Challenges, Approaches, and Open Issues. arXiv:2106.09986. https://doi.org/10.48550/arXiv.2106.09986.

Parnes, A. (2024). PsyOps in Cybersecurity and the New Challenges of Regulatory Compliance. Solutions Review (online), 24 January. https://solutionsreview.com/security-information-event-management/psyops-in-cybersecurity-and-the-new-challenges-of-regulatory-compliance/.

Parsons, T.D. (2017). Cyberpsychology and the Brain: The Interaction of Neuroscience and Affective Computing. Cambridge: Cambridge University Press.

Parsons, T.D. (2019). Ethical Challenges in Digital Psychology and Cyberpsychology. Cambridge: Cambridge University Press.

Patterson, W. (Ed.) (2024). New Perspecitives in Behavioral Cybersecurity. Human Behavior and Decision-Making Models. Boca Raton, FL: CRC Press – Taylor & Francis Group.

Patterson, W., & Winston-Proctor, C.E. (2024). Behavioral Cybersecurity. Applications of Personality Psychology and Computer Science. Boca Raton, FL: CRC Press – Taylor & Francis Group.

Petty, R.E., & Cacioppo, J.T. (1986). The Elaboration Likelihood Model of Persuasion. Advances in Experimental Social Psychology, vol. 19, 123-205. https://doi.org/10.1016/S0065-2601(08)60214-2.

Riva, G., & Galimberti, C. (Eds.) (2001). Towards Cyberpsychology: Mind, Cognition, and Society in the Internet Age. Amsterdam: IOS Press.

Schmitt, M., & Flechais, I. (2024). Digital deception: generative artificial intelligence in social engineering and phishing. Artificial Intelligence Review, 57, 324. https://doi.org/10.1007/s10462-024-10973-2.

Schneier, B. (2024). La mente dell’hacker. Roma: LUISS University Press.

Siddiqi, M.A.1, & Pak, W., Siddiqi, M.A.2 (2022). A Study on the Psychology of Social Engineering-Based Cyberattacks and Existing Countermeasures. Applied Sciences, 12(12), 6042. https://www.mdpi.com/2076-3417/12/12/6042.

Singh, T. (2025a). Cybersecurity, Psychology and People Hacking. Cham, CH: Palgrave Macmillan.

Singh, T. (2025b). Social Engineering: Exploiting Human Psychology. In Cybersecurity, Psychology and People Hacking. Cham, CH: Palgrave Macmillan. https://doi.org/10.1007/978-3-031-85994-6_7.

Singh, T. (2025c). Psychology and Its Impact on Cybersecurity. In Cybersecurity, Psychology and People Hacking. Cham, CH: Palgrave Macmillan. https://doi.org/10.1007/978-3-031-85994-6_3.

Thaler, R., & Sunstein, C. (2009). Nudge. La spinta gentile. Milano: Giacomo Feltrinelli Editore.

Uebelacker, S., & Quiel, S. (2014). The Social Engineering Personality Framework. In Proceedings of the 2014 Workshop on Socio-Technical Aspects in Security and Trust (pp. 24-30). New York, NY: IEEE Publishing. https://doi.org/10.1109/STAST.2014.12.

Veksler, V.D., Buchler, N., LaFleur, C.G., Yu, M.S., Lebiere, C., & Gonzalez, C. (2020). Cognitive Models in Cybersecurity: Learning From Expert Analysts and Predicting Attacker Behavior. Frontiers in Psychology, 11. https://doi.org/10.3389/fpsyg.2020.01049.

Wang, Z., Zhu, H., & Sun, L. (2021). Social engineering in cybersecurity: effect mechanisms, human vulnerabilities and attack methods. IEEE Access, 9, 11895-11910.

Whitty, M.T., & Young, G. (2017). Cyberpsychology: the study of individuals, society and digital technologies. Hoboke, NJ: John Wiley & Sons.

Widdowson, A. (2025). Humans and Cyber Security. How Organisations Can Enhance Resilience Through Human Factors. Boca Raton, FL: CRC Press – Taylor & Francis Group.

Wiederhold, B.K. (2014). The Role of Psychology in Enhancing Cybersecurity. Cyberpsychology, Behavior, and Social Networking, 17(3). https://doi.org/10.1089/cyber.2014.1502.

Yang, R., Zheng, K., Wu, B., Li, D., Wang, Z., & Wang, X. (2022). Predicting User Susceptibility to Phishing Based on Multidimensional Features. Computational Intelligence and Neuroscience, 2022, 1. https://doi.org/10.1155/2022/7058972.

Zimbardo, P.G., Maslach, C., & Haney, C. (1999). Reflections on the Stanford prison experiment: Genesis, transformations, consequences. In T. Blass (Ed.), Obedience to authority: Current Perspectives on the Milgram paradigm (pp. 207-252). Mahwah, NJ: Erlbaum.