I robot umanoidi rappresentano l’apice dell’evoluzione della robotica moderna, combinando ingegneria avanzata, intelligenza artificiale e sistemi autonomi per creare macchine capaci di interagire con il mondo umano in modo fluido e naturale. La loro progettazione si ispira alla nostra anatomia, con arti mobili, testa e articolazioni sofisticate, ma il vero salto tecnologico è arrivato con l’integrazione dei modelli Vision-Language-Action (VLA).

Questa innovazione permette ai robot umanoidi di:

- Percepire il mondo visivamente, analizzando immagini e video in tempo reale con reti neurali avanzate.

- Comprendere e rispondere al linguaggio naturale, grazie a modelli linguistici multimodali simili a quelli usati nei chatbot di nuova generazione.

- Tradurre informazioni visive e linguistiche in azioni fisiche, coordinando la motricità fine con l’interpretazione contestuale.

L’integrazione dei modelli VLA ha reso questi robot sempre più autonomi, capaci di apprendere nuove mansioni senza necessità di programmazione esplicita, segnando un punto di svolta nell’automazione.

Indice degli argomenti

Lo stato dell’arte: i progressi recenti nel campo dei robot umanoidi

Grazie all’avanzamento delle tecnologie di visione artificiale, apprendimento automatico e controllo motorio, i robot umanoidi sono diventati più sofisticati, capaci di operare in contesti complessi e di adattarsi a compiti variabili.

Alcuni esempi di robot umanoidi all’avanguardia includono:

Atlas

Atlas (Boston Dynamics): resta il punto di riferimento storico per la qualità della locomozione e del controllo del corpo: la “leggenda” del parkour e delle acrobazie appartiene soprattutto alla generazione precedente, ma il passaggio chiave oggi è un altro. Al CES 2026 Boston Dynamics e Hyundai hanno mostrato Atlas in pubblico e lo hanno esplicitamente riposizionato come umanoide industriale: una piattaforma “da fabbrica”, con roadmap di adozione negli impianti Hyundai (a partire dal plant EV in Georgia dal 2028, secondo quanto dichiarato).

L’elemento più nuovo è l’accordo con Google DeepMind: Boston Dynamics ha annunciato una partnership per portare su Atlas (e Spot) i foundation model “Gemini Robotics”, cioè un approccio che mira a unificare percezione, linguaggio e azione in modo più generalista rispetto ai tradizionali stack robotici. In pratica: meno “script” e più capacità di comprendere istruzioni e contesto fisico per eseguire compiti variabili. Atlas sfrutta modelli VLA per interpretare il terreno, prendere decisioni in tempo reale e muoversi in ambienti irregolari.

Digit (Agility Robotics)

Digit è l’umanoide che più chiaramente nasce per un compito “da lavoro”: logistica e movimentazione in ambienti progettati per persone. Il punto non è la spettacolarità, ma l’inserimento in flussi reali. Amazon ha comunicato di aver avviato test con Digit nelle proprie strutture, presentandolo come robot in grado di muoversi e manipolare oggetti in spazi di magazzino difficili da automatizzare con robot tradizionali.

Agility, dal canto suo, ha raccontato Digit come piattaforma commerciale in consegna ai partner e con ambizione di disponibilità più ampia, indicando chiaramente che la “scommessa” è scalare dall’esperimento alla flotta.

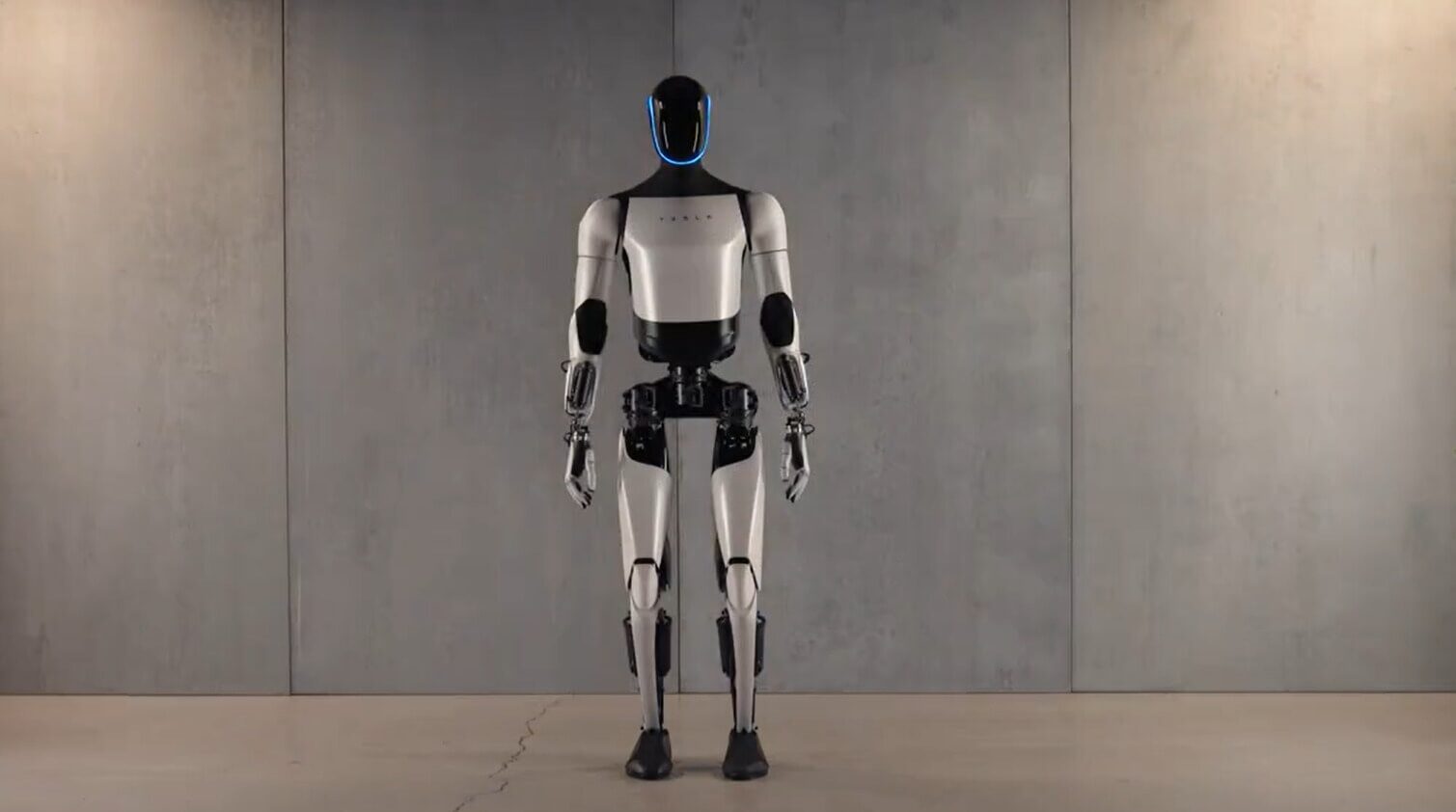

Optimus (Tesla)

Optimus è l’umanoide più “politico” nel senso industriale del termine: Tesla lo presenta come parte della strategia di lungo periodo e Musk lo descrive come futuro moltiplicatore di valore dell’azienda. Ma, a differenza di Figure o Boston Dynamics, Tesla comunica meno in termini di “modello VLA” esplicito e più come traiettoria: robot generalista, addestramento progressivo, e integrazione con la sua filiera AI (chip, training, produzione). Reuters ha riportato che Tesla prevede chip (AI6) destinati anche a Optimus.

Sul fronte training, un dettaglio rilevante emerso da ricostruzioni giornalistiche è lo spostamento verso un approccio più “vision-only” e più dipendente da video di task umani per insegnare abilità manuali (un metodo che ricorda, concettualmente, la direzione vision-to-action di molta robotica contemporanea, anche quando non viene chiamata formalmente VLA).

Sintesi utile per il tuo testo: Optimus punta alla generalità e alla scalabilità produttiva, ma molte promesse (tempi e quantità) restano ancora in fase dichiarativa e di prototipazione avanzata.

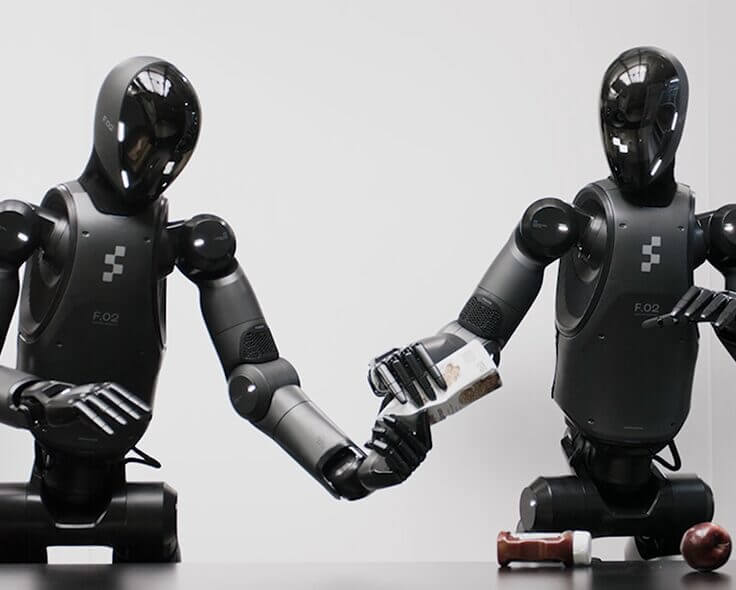

Figure (Figure AI) + Helix (VLA)

Qui la connessione con i VLA è diretta e verificabile: Figure ha presentato Helix, definendolo esplicitamente un Vision-Language-Action model generalista, progettato per unificare percezione, comprensione del linguaggio e controllo motorio (con enfasi sul controllo dell’upper body e della manipolazione fine).

Figure ha poi collegato Helix a use case concreti (ad esempio attività logistiche come manipolazione e smistamento pacchi), cioè a quel tipo di compiti ripetitivi ma variabili che rappresentano il banco di prova del “robot generalista”.

Apollo (Apptronik)

Apollo è spesso citato perché ha costruito un ponte esplicito verso la manifattura: Apptronik e Mercedes-Benz hanno annunciato un accordo per esplorare impieghi di Apollo in logistica interna e attività di fabbrica.

In parallelo, Reuters ha riportato un maxi-round per scalare la produzione e partnership industriali: segnali tipici di chi vuole passare dalla demo al prodotto.

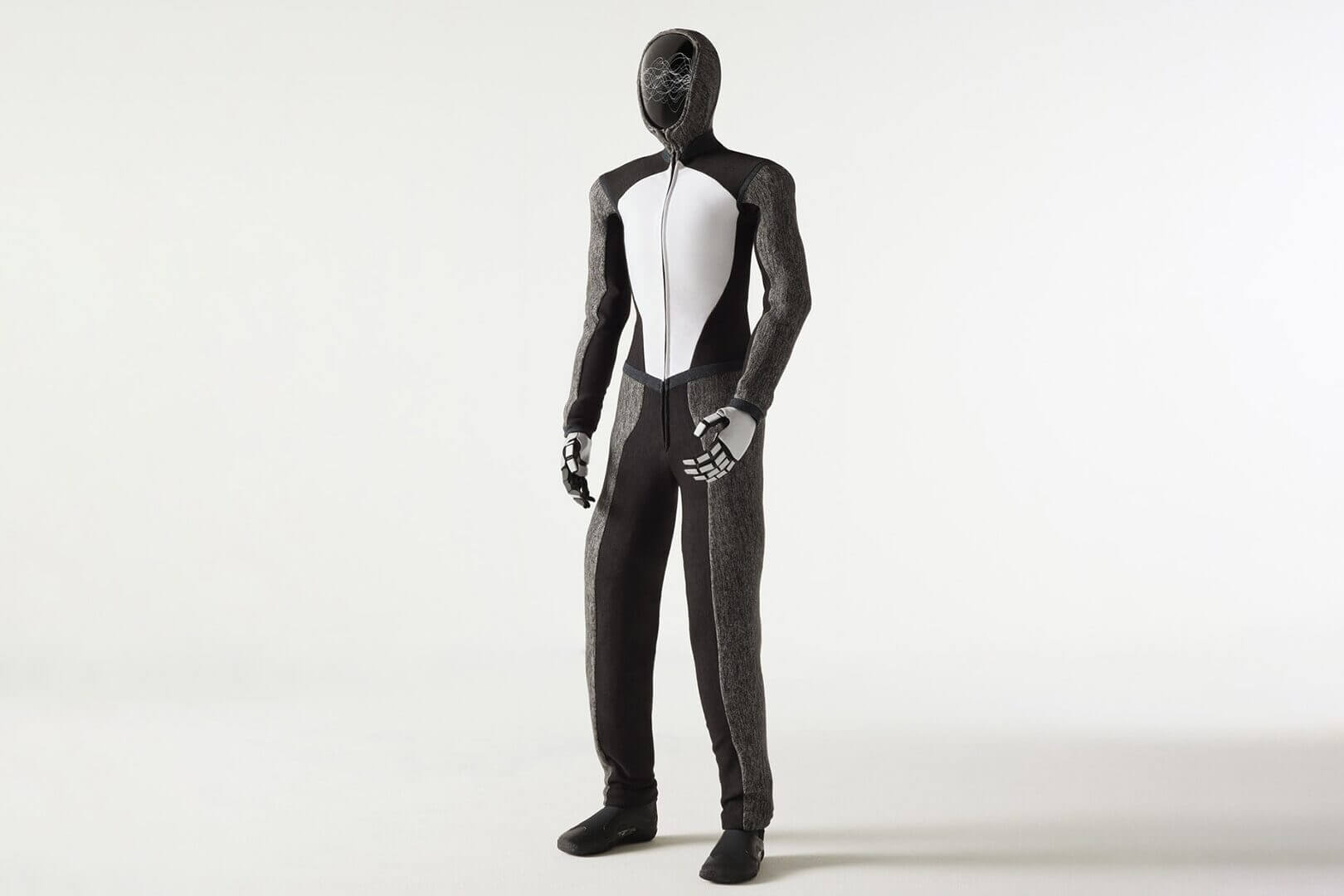

NEO (1X)

1X spinge una narrativa diversa: più vicina all’idea di robot “da casa”, ma con ambizione anche industriale. L’azienda ha annunciato NEO come “consumer-ready” e, allo stesso tempo, ha comunicato partnership per rendere disponibili migliaia di unità in contesti di portfolio industriale (un modo per cercare scala commerciale).

Phoenix (Sanctuary AI)

Sanctuary AI insiste su un asse preciso: destrezza delle mani e feedback tattile, cioè la parte più difficile della manipolazione “umana”. Phoenix viene presentato come robot general-purpose “for work”, con evoluzioni legate a sensori tattili e controllo fine.

GR-1 (Fourier Intelligence)

GR-1 è spesso richiamato nel filone cinese degli umanoidi “pratici” (anche in ambito salute/riabilitazione in alcune demo), con un posizionamento che mira a uscire dal prototipo e a entrare in applicazioni reali.

Questi esempi dimostrano come i modelli Vision-Language-Action abbiano migliorato drasticamente la capacità dei robot umanoidi di percepire, comprendere e agire in modo più naturale. Il settore sta rapidamente evolvendo grazie all’integrazione con le reti neurali transformer, che permettono ai robot di apprendere dai dati visivi e linguistici e di affinare continuamente le proprie capacità.

LG CLOiD

LG CLOiD è il robot domestico con forma umanoide presentato da LG al CES 2026 come parte della visione “Zero Labor Home”, un concetto che punta a far svolgere alle macchine i compiti domestici più gravosi.

È dotato di un corpo con due braccia articolate a sette gradi di libertà e mani con cinque dita indipendenti, una testa con display, sensori, telecamere e intelligenza generativa vocale, oltre a un sistema di navigazione basato su ruote che gli consente di muoversi autonomamente negli spazi interni. CLOiD integra tecnologie AI e di visione per interpretare comandi visivi e verbali e interagire con altri dispositivi smart della casa tramite l’ecosistema ThinQ di LG, con funzioni dimostrate come lo scarico della lavastoviglie, il piegamento dei panni e la preparazione di cibo.

Aeon (Hexagon)

AEON è l’umanoide industriale con cui Hexagon (storicamente forte in metrologia, sensoristica e “reality capture”) prova a portare la robotica bipede fuori dai demo e dentro fabbriche, cantieri, magazzini. L’idea è una piattaforma “tutto in uno”, progettata per svolgere compiti diversi senza dover aggiungere moduli esterni: manipolazione, ispezione di parti e asset, acquisizione 3D dell’ambiente (“reality capture”) e attività di supporto agli operatori.

La promessa tecnologica ruota attorno a tre pilastri: un sistema di locomozione che consente movimenti rapidi in ogni direzione, mani “dexterous” per operazioni precise e una suite di sensori integrata con controllo missione guidato da AI e “spatial intelligence” per capire e navigare spazi complessi in sicurezza, fianco a fianco con le persone. AEON viene presentato esplicitamente come risposta a carenze di manodopera e alla richiesta di automatizzare mansioni ripetitive o rischiose nei contesti industriali, con un’impostazione che mira anche all’accettazione da parte della forza lavoro (il robot come collaboratore, non come ingombro)

Gene.01

Gene.01 è un robot umanoide italiano sviluppato dalla startup genovese Generative Bionics e presentato al CES 2026 con un approccio innovativo alla percezione fisica. A differenza di molte macchine che affidano la comprensione dell’ambiente quasi esclusivamente a telecamere o LiDAR, Gene.01 è rivestito di una “pelle” di sensori di contatto e forza distribuiti su tutto il corpo.

Questa sensoristica tattile consente al robot di percepire direttamente pressioni e interazioni fisiche, modulando i movimenti e le risposte in tempo reale, migliorando sicurezza e adattabilità negli ambienti condivisi con le persone. Progettato attorno al concetto di “Physical AI”, dove l’intelligenza emerge dall’integrazione fra corpo, sensori e calcolo, Gene.01 rappresenta una piattaforma di robotica avanzata con partnership tecnologiche come quella con AMD e un lancio commerciale pianificato per la seconda metà del 2026.

RoBee

RoBee è un robot umanoide cognitivo Made in Italy sviluppato dalla startup Oversonic Robotics e già operativo in contesti industriali e sanitari. A differenza di molti prototipi, RoBee è un prodotto certificato per lavorare fianco a fianco con gli esseri umani in ambienti reali. Dotato di una struttura antropomorfa con sensori avanzati, visione computerizzata e intelligenza artificiale, può muoversi autonomamente, manipolare oggetti e dialogare con gli operatori.

È disponibile in diverse serie, tra cui la RoBee R per applicazioni industriali, capace di pick-and-place, carreggiamento di macchinari e operazioni complesse, e la RoBee M per il settore sanitario e riabilitativo, dove assiste personale medico e pazienti nelle attività quotidiane. RoBee combina autonomia di movimento, capacità cognitive e un’interazione naturale con l’ambiente, con autonomia operativa fino a circa otto ore.

Applicazioni dei robot umanoidi nei settori chiave

L’adozione dei robot umanoidi si sta espandendo in diverse industrie, trainata dalla crescente necessità di automazione avanzata. Tra i principali settori di applicazione troviamo:

- Logistica e supply chain: robot come Digit stanno già rivoluzionando il settore dello stoccaggio e della movimentazione merci, ottimizzando i tempi di consegna e migliorando la sicurezza nei magazzini.

- Industria manifatturiera: Optimus e altri robot umanoidi stanno introducendo un nuovo livello di flessibilità nelle catene di montaggio, consentendo operazioni più efficienti e adattabili alle variazioni della produzione.

- Sanità e assistenza: nei Paesi con una popolazione anziana in crescita, come il Giappone e la Cina, i robot umanoidi stanno iniziando a supportare infermieri e caregiver nel sollevamento dei pazienti, nella somministrazione di farmaci e nell’assistenza quotidiana.

- Retail e customer service: robot umanoidi vengono sperimentati in negozi e hotel per fornire assistenza clienti, gestire pagamenti e migliorare l’esperienza di acquisto.

L’integrazione con modelli VLA permette a questi robot di interpretare le esigenze umane con una naturalezza mai vista prima, riducendo gli errori di comprensione e aumentando la loro efficacia operativa.

Impatto economico e business: il motore della trasformazione industriale

L’adozione dei robot umanoidi nel settore business non è più un’ipotesi futuristica, ma una realtà in espansione. Grandi aziende stanno investendo miliardi di dollari per integrare questi robot nei processi produttivi e logistici. Secondo un rapporto di McKinsey & Company, il potenziale economico della robotica umanoide potrebbe tradursi in un incremento della produttività globale fino al 30% entro il 2040, con un impatto significativo su settori strategici come la logistica, la manifattura e la sanità. Secondo Goldman Sachs, il mercato dei robot umanoidi potrebbe raggiungere i 38 miliardi di dollari entro il 2035, con un’accelerazione della domanda in ambiti industriali e commerciali.

I robot umanoidi non sono semplicemente macchine avanzate, ma strumenti di trasformazione economica. Ecco i principali benefici che stanno spingendo sempre più aziende a investire in questa tecnologia:

- Riduzione dei costi operativi: grazie alla loro versatilità, i robot umanoidi possono sostituire più macchinari specializzati, riducendo gli investimenti in automazione rigida.

- Maggiore produttività: i modelli VLA consentono ai robot di apprendere nuove attività e di adattarsi rapidamente alle esigenze produttive, migliorando l’efficienza aziendale.

- Minore dipendenza dalla manodopera umana: in contesti come la logistica e la manifattura, dove la carenza di lavoratori è un problema crescente, i robot umanoidi possono colmare il divario senza richiedere costosi interventi infrastrutturali.

- Aumento della sicurezza: nei lavori pericolosi, come la gestione di sostanze chimiche o la manutenzione di impianti industriali, i robot umanoidi possono ridurre il rischio di incidenti sul lavoro.

Grandi multinazionali hanno già avviato programmi di test su larga scala per valutare l’efficacia dei robot umanoidi. Ad esempio, BMW ha recentemente annunciato una partnership con Figure AI per integrare robot umanoidi nelle proprie linee di assemblaggio, con l’obiettivo di ridurre i costi di produzione e migliorare l’efficienza operativa.

Un altro esempio concreto è l’uso dei robot umanoidi da parte di GXO Logistics, che ha iniziato a impiegare Digit nei suoi magazzini per automatizzare il trasporto di pacchi pesanti. L’azienda prevede di espandere l’uso di questi robot in diverse fasi operative, dimostrando che la flessibilità è uno dei principali vantaggi economici della robotica umanoide.

Anche Nvidia sta puntando fortemente su questo settore: l’azienda ha annunciato il lancio del chip Jetson Thor, una piattaforma progettata specificamente per migliorare la potenza di calcolo dei robot umanoidi. Questo sviluppo è cruciale, poiché le operazioni in tempo reale richiedono enormi capacità computazionali per l’elaborazione simultanea di input visivi, linguistici e motori. L’adozione di hardware specializzato ridurrà i costi operativi e migliorerà le prestazioni complessive dei robot, facilitandone l’integrazione su larga scala in ambienti industriali e commerciali.

Secondo un’analisi di Boston Consulting Group, entro il 2030, il costo dei robot umanoidi potrebbe ridursi del 60%, rendendoli accessibili anche per le piccole e medie imprese. Questo potrebbe portare a un’esplosione della loro diffusione, con impatti rivoluzionari su settori tradizionali e nuovi ambiti di applicazione, come l’assistenza domiciliare e il customer service avanzato.

Il futuro della robotica umanoide: verso un’intelligenza autonoma e adattabile

L’integrazione dei modelli Vision-Language-Action nei robot umanoidi sta segnando l’inizio di un’era in cui le macchine non saranno più solo strumenti programmati, ma veri e propri agenti autonomi in grado di prendere decisioni contestuali e di adattarsi in tempo reale alle necessità umane. La convergenza tra intelligenza artificiale, robotica avanzata e sistemi di apprendimento continuo sta creando macchine capaci di interpretare il mondo con un livello di sofisticazione sempre maggiore. I progressi nelle reti neurali multimodali e nei chip specializzati stanno accelerando lo sviluppo di robot in grado di comprendere e interagire con l’ambiente senza necessità di essere rigidamente programmati. Nei prossimi anni, potremmo vedere robot umanoidi sempre più integrati nelle attività quotidiane, con applicazioni che spaziano dalla logistica alla sanità, dall’intrattenimento all’assistenza domestica. Aziende come Tesla, Agility Robotics e Figure stanno già testando implementazioni pratiche, mentre colossi dell’hardware come Nvidia lavorano su architetture di calcolo più efficienti per supportare questi avanzamenti.

Uno degli aspetti più interessanti è la possibilità di combinare i robot umanoidi con sistemi di cloud AI, che permetterebbero loro di accedere a conoscenze aggiornate in tempo reale, apprendendo nuove abilità senza necessità di addestramenti manuali. Questo ridurrebbe il tempo di implementazione nei diversi settori e renderebbe l’adozione ancora più conveniente per le aziende. Inoltre, con la riduzione dei costi di produzione, ci si aspetta che i robot umanoidi diventino accessibili anche per applicazioni domestiche, migliorando la qualità della vita attraverso assistenza intelligente. La rivoluzione dell’automazione è appena iniziata, e i robot umanoidi ne saranno i protagonisti.