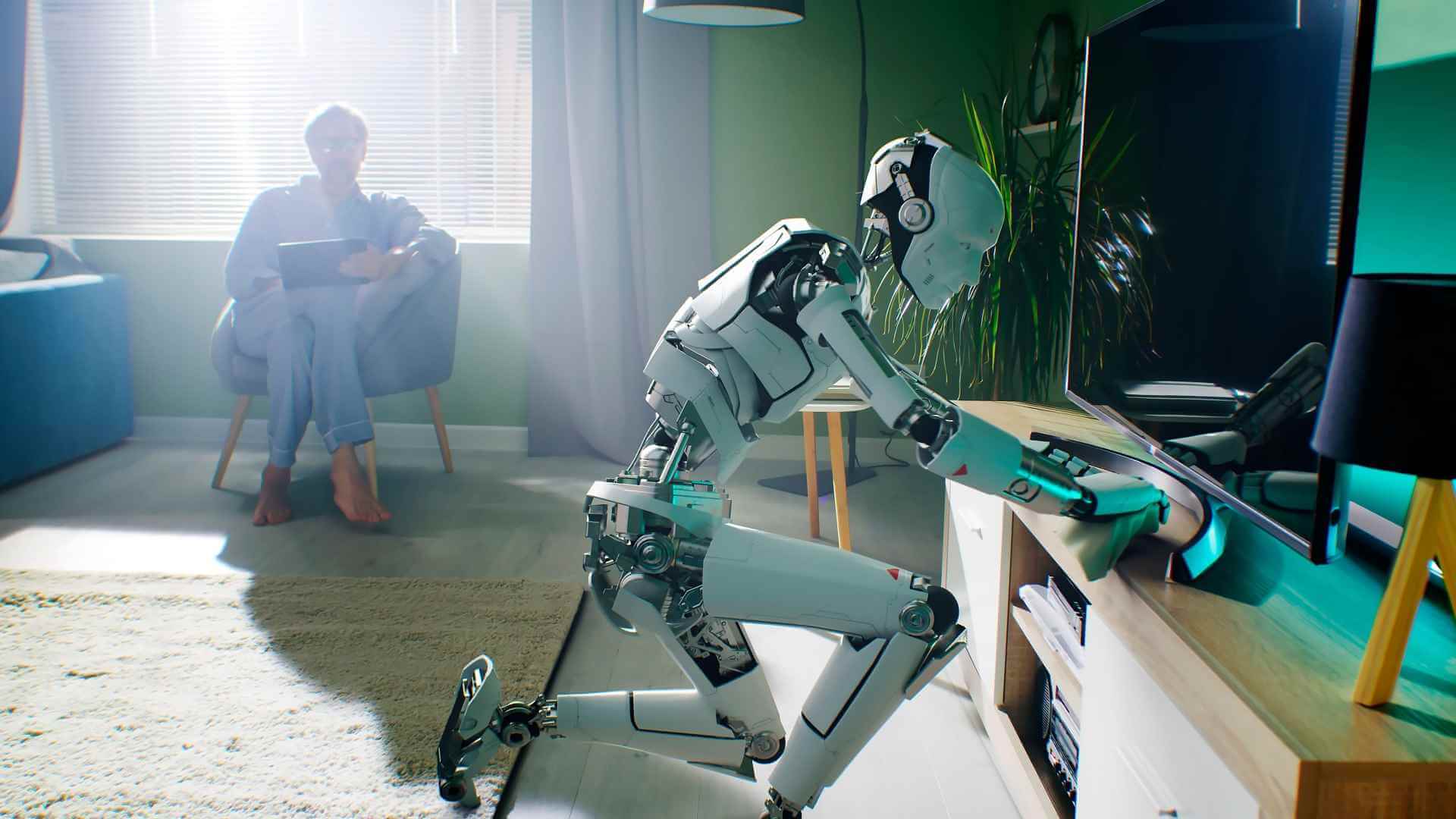

I robot domestici basati su modelli Vision–Language–Action (VLA) segnano un passaggio decisivo: non eseguono soltanto istruzioni, ma osservano, interpretano e agiscono nello spazio quotidiano. È da qui che nasce un problema fondamentale: la cybersicurezza non riguarda più solo software e rete, ma l’intero processo che trasforma percezione e linguaggio in azione fisica.

l'analisi

Robot domestici e cybersicurezza: i rischi reali da conoscere

I robot domestici basati su VLA non si limitano più a eseguire ordini, ma interpretano ambiente e linguaggio per decidere come agire. Per questo la cybersicurezza smette di essere un dettaglio tecnico e diventa una condizione essenziale della vita digitale in casa

Laboratorio di Robotica, dipartimento di Ingegneria Università degli Studi di Palermo

Continua a leggere questo articolo

Argomenti

Canali

InnovAttori

-

L’IA nel turismo corre, ma non per tutti: la mappa italiana e globale

08 Mag 2026 -

AI agentica nel turismo: come cambia il mercato dei viaggi

09 Apr 2026 -

OpenBIM e interoperabilità: perché gli standard aperti sono decisivi in edilizia

03 Apr 2026 -

Competitività europea e sovranità, cosa manca davvero alle startup Ue

01 Apr 2026 -

Come l’AI porta il caffè sulle nostre tavole al tempo della guerra

13 Mar 2026