Per anni la profilazione digitale è stata raccontata come uno strumento commerciale: capire gusti, prevedere consumi, indirizzare acquisti. Oggi quel modello ha cambiato scala, velocità e ambizione. Con l’intelligenza artificiale generativa la raccolta dei dati non serve più soltanto a conoscere gli individui, ma a seguirli in tempo reale, aggiornarne il profilo, individuarne vulnerabilità e orientarne le scelte. Quando questa capacità viene applicata alla politica, il passaggio dalla persuasione al controllo diventa una questione democratica.

Indice degli argomenti

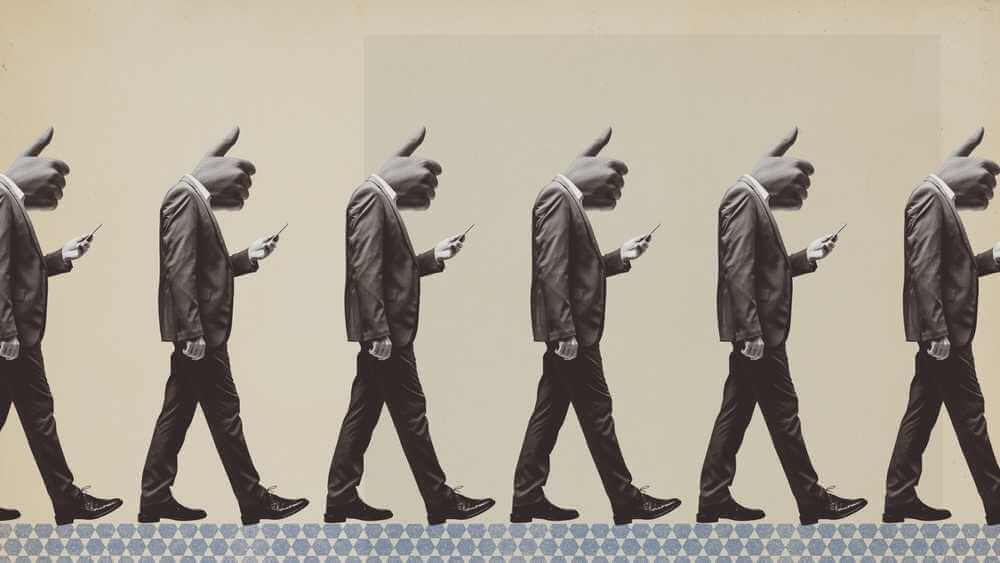

Dalla profilazione alla manipolazione comportamentale

Nel 2020, un’era geologica fa, un team di ricercatori della CIROs61 in Australia[1] sviluppò un sistema di intelligenza artificiale (chiamato rete neurale ricorrente e apprendimento per rinforzo profondo) in grado di imparare ad identificare le vulnerabilità di una persona nelle sue abitudini e comportamenti al fine di influenzarne le decisioni (Dezfoulia et al. 2020).

Per testarlo il gruppo di ricercatori australiano aveva predisposto tre esperimenti.

Nel primo i partecipanti dovevano cliccare su alcune caselle colorate di rosso o di blu per vincere una somma di denaro (immaginaria), con l’intelligenza artificiale che apprendeva i modelli di scelta adottati dai partecipanti e li guidava verso una scelta specifica. In questo caso l’intelligenza artificiale ebbe successo in circa il 70% dei casi.

Nel secondo esperimento, ai partecipanti era stato chiesto di guardare uno schermo e premere un pulsante quando veniva mostrato loro un simbolo particolare (un triangolo arancione) e di non premerlo quando ne veniva mostrato un altro (un cerchio blu). L’intelligenza artificiale in questo caso doveva organizzare la sequenza di simboli in modo che i partecipanti commettessero più errori. L’intelligenza artificiale riuscì ad aumentare il loro tasso di errore di quasi il 25%.

Quando il microtargeting politico diventa adattivo

Nel terzo esperimento un partecipante doveva fingere di essere un investitore che dava del denaro ad un soggetto fiduciario (l’intelligenza artificiale) che poi restituiva la somma al partecipante, il quale aveva così la possibilità di decidere quanto investire nel round successivo.

L’intelligenza artificiale aveva due strategie a disposizione. O doveva cercare di massimizzare la quantità di denaro che avrebbe ricevuto, oppure doveva mirare ad una distribuzione equa del denaro tra sé e l’investitore umano. In entrambe le modalità l’intelligenza artificiale ha avuto un considerevole tasso di successo.

Sono passati 6 anni da quell’esperimento e l’intelligenza artificiale è cambiata. Radicalmente.

Nel 2022, due anni dopo, OpenAi ha rilasciato la prima versione di ChatGpt. Oggi è appena stato rilasciato il primo modello di intelligenza artificiale generale, GpT 5.4, in grado di interagire con i pc navigando sul browser eseguendo attività al posto dell’utente, come cliccare su un sito web, fare prenotazioni, acquistare prodotti e servizi valutando eventuali ostacoli imprevisti e adattando la catena di comandi in tempo reale. In altri termini, fa contratti. Già la versione precedente, ChatGpt 4.3-Codex, aveva fatto qualcosa di sorprendente: aveva fatto il debug del proprio addestramento, gestito il proprio deployment e diagnosticato i risultati dei test e delle valutazioni. Aveva contribuito a creare se stessa.

Il Ceo di Anthropic, Dario Amodei, ha confermato che Claude, oggi famoso perché utilizzato dagli Usa prima in Venezuela per individuare dove si nascondesse Nicolàs Maduro (catturato e immediatamente processato a New York) e, poi, in Iran per trovare e uccidere la guida spirituale Ali Hosseini Khamenei, sta già scrivendo “gran parte del codice” della sua azienda e tra 1/2 anni sarà in grado di costruire in totale autonomia la sua prossima versione. Senza l’aiuto dell’uomo.

Dati personali, piattaforme e mercato dell’influenza

È chiaro che le potenzialità dell’intelligenza artificiale generativa sono tali da renderla particolarmente indicata per chi opera nel campo del microtargeting nell’odierno mercato online. E in fondo è questo uno dei più ovvi utilizzi che se ne possono fare. Non a caso Meta, non molto tempo fa (il 10 giugno 2024)[2], ha annunciato che in Europa si sarebbe servita dei dati degli utenti dei suoi due social network, Facebook e Instagram, per fare il training dei propri modelli di intelligenza artificiale generativa (Large Linguistic Models o LLMs)[3].

È chiaro che ciò che interessa Mark Zuckerberg non è tanto l’addestramento (o non solo), ma quello che avviene dopo, coi dati degli utenti, a livello di marketing. Perché ciò che fa Meta è appunto vendere dati, dati dei propri utenti che quindi vengono profilati al fine di fornire ai propri clienti, e ai clienti dei propri clienti, pacchetti previsionali sulle future scelte che gli stessi utenti faranno come consumatori (Cfr. Zuboff 2019).

Scelte commerciali su prodotti e servizi a cui potremmo essere interessati e che potremmo quindi acquistare. I dati oggetto dell’addestramento sono costituiti dai contenuti creati dagli utenti, dai post, i likes, le informazioni relative alle app, browser, o il device, le informazioni relative ai partners, venditori e terze parti, informazioni relative a loro contatti (Pandey 2024).

Dati che poi vengono presi anche retrospettivamente, il che significa che potrebbero essere usati anche post vecchi di dieci anni pubblicati su Instagram. Nella rete possono finire anche le informazioni relative a tutti i contatti di un utente, che pur non essendo utenti Facebook o Instagram, siano entrati in contatto con utenti Facebook o Instagram e ignari saranno poi profilati da Meta (Ruggiu 2025, 177-178). Sempre sulla base del legittimo interesse.

Perché il microtargeting politico è più pericoloso oggi

Il vantaggio dei meccanismi di profilazione operati da sistemi di intelligenza artificiale generativa è che sono massivi, procedono automaticamente alla creazione dei profili potendoli aggiornare in tempo reale a seconda della variazione delle informazioni o, come si è visto, a seconda degli algoritmi che il sistema è in grado di riscrivere e migliorare.

Una volta applicato all’ambito politico questo modello diviene micidiale.

Mentre i tradizionali meccanismi di profilazione, dunque, sono generalmente statici e aggiornati periodicamente, i modelli basati su sistemi di intelligenza artificiale permettono di integrare e aggiornare i profili in maniera dinamica, consentendo di inferire, attraverso i dati provenienti in tempo reale da molteplici piattaforme e servizi usati dall’utente, gli stati emozionali e i tratti della personalità di un individuo (Carlini et al. 2021; Mittelstadt et al. 2016; Zuiderveen et al. 2018).

Ad esempio, i post di un individuo possono essere letti in maniera istantanea e utilizzati per aggiornarne il profilo ed adottare in maniera automatizzata le relative decisioni, come potrebbe essere includere altri contatti e creare a loro volta altri profili a cascata oppure includerlo o meno in una data classificazione sulla base di un post appena comparso su un social. Tutto in tempo reale e senza che sia necessario alcun intervento umano.

Quindi, come si è visto, il sistema può anche studiare il proprio bersaglio apprendendone le vulnerabilità al fine di fargli compiere determinate azioni. Il che in ambito politico significa poter controllare i meccanismi democratici.

Sorveglianza predittiva e rischio democratico

Un analogo modello è stato utilizzato, per esempio, da Palantir per creare un sistema che utilizza Claude di Anthropic messo a disposizione del Dipartimento della polizia di New York. Questo modello è in grado di profilare i cittadini di New York in tempo reale integrando, senza alcuna autorizzazione di un giudice, le informazioni di localizzazione di ciascuno (ad esempio il fatto che frequentemente si trovi in una certa zona ad alto tasso di criminalità), riconoscimento facciale, dati sanitari, precedenti penali, e persino i post pubblicati sui social che possono essere considerati sintomo della pericolosità sociale di un cittadino, in modo da costruire classi di rischio relative a ciascun individuo sempre aggiornate (Vasquez 2025).

È chiaro che qui i confini tra profilazione criminale e profilazione politica sono sfuggenti, dal momento che utilizzando i post sui social, il sistema si presta ad essere usato per associare il rischio criminale alle preferenze politiche dei cittadini di New York. È successo? Chissà… Il fatto che chi ha contestato a Minneapolis le azioni dell’ICE (sempre supportata da Palantir) sia stato poi additato come terrorista non è però di buon auspicio.

Il precedente del microtargeting politico da Cambridge Analytica all’IA

Per capire fino in fondo le potenzialità di questo modello bisogna guardare indietro al 2013 al caso Cambridge Analytica quando una società inglese guidata da Alexander Nix mise a punto un sistema di profilazione, il modello OCEAN, cui pare abbia collaborato proprio Palantir[4], che applicava per la prima volta all’ambito politico le tecniche del marketing che già erano state utilizzate in ambito militare dai Behavioral Dynamics Institute di Londra di Nigel Oaks negli anni 90, e poi dagli Strategic Communication Laboratories, per indebolire oppositori politici o colpire aspiranti jihadisti (Ruggiu 2025, 229-239). In pratica utilizzava nell’ambito politico un’arma. Non convenzionale.

In quell’occasione a partire da un test della personalità fatto circolare su Facebook che aveva ottenuto solo qualche migliaia di downloads si era creato un database con oltre 87 milioni di profili, nel mondo, poi utilizzato per alterare i processi elettorali, come: influenzare il referendum della Brexit che ha portato all’uscita del Regno Unito dall’Unione europea o portare all’elezione di Donald Trump nel 2016. Immaginate solo che questo database possa oggi essere costruito, aggiornato e ristrutturato in tempo reale automaticamente in modo da adattare il perseguimento di determinati obiettivi politici al variare delle informazioni.

Il caso Cambridge Analytica aveva portato al fallimento della società e a diverse sanzioni a Facebook (ben 5 miliardi di dollari da parte della Federal Trade Commission) che, pur essendosi accorta di quanto stava accadendo sulla sua piattaforma, non aveva mosso un dito. Oggi tutti i protagonisti del caso Cambridge Analytica sono quotidianamente sulle pagine dei giornali. Da Bennon a Trump… In pratica il caso Cambridge Analytica non si è mai chiuso: siamo tutti dentro a Cambridge Analytica, a maggior ragione con l’evoluzione dell’intelligenza artificiale generativa e le nuove frontiere aperte per il microtargeting.