L’adozione dell’AI generativa viene spesso letta come una gara tra modelli, benchmark e nuove release. Nei contesti organizzativi, però, il punto di rottura tende a emergere altrove: la cultura AI che rende l’AI sostenibile nel quotidiano e il modo in cui si governa l’impatto su ruoli, processi e aspettative.

Indice degli argomenti

I fondamenti di una cultura AI centrata sull’essere umano

In Italia i numeri fotografano un mercato in accelerazione, ma anche una distanza tra sperimentazione e messa a regime: secondo i dati degli Osservatori del Politecnico di Milano, nel 2025 il mercato AI cresce del +50% fino a 1,8 miliardi di euro e la Generative AI aumenta del +60%, arrivando a rappresentare il 46% del valore complessivo; allo stesso tempo, solo l’8% delle PMI dichiara progetti AI attivi, nonostante il 69% si dica interessato.

Questa asimmetria è coerente con quanto misurato dall’ISTAT sulle imprese con almeno 10 addetti: nel 2024 utilizzava tecnologie di AI l’8,2% delle imprese. È un quadro che spinge a trattare l’adozione come change e non come semplice rollout tecnologico, portando i principi di una human centered AI dentro governance, formazione e metriche.

Promuovere una cultura dell’innovazione

Da questo scenario discende un punto chiave: la cultura AI non è un insieme di slogan, ma un sistema di decisioni ripetibili che orienta come l’AI entra nei processi e chi viene messo nelle condizioni di usarla.

| Human-Centered AI: una definizione Un approccio all’intelligenza artificiale che focalizza l’attenzione sulla persona, progettando sistemi che rispondano alle sue necessità, predilezioni e aspettative, sempre nel rispetto dei suoi valori e della sua esperienza. L’obiettivo è facilitare l’uso degli strumenti, rendendoli intuitivi e capaci di migliorare la qualità della vita professionale e personale, garantendo al contempo sicurezza, privacy ed etica.[Sapiens Analytics] |

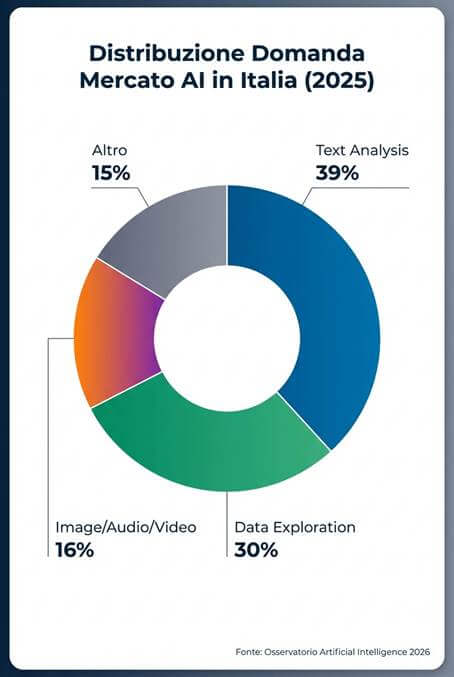

In questo passaggio, i dati di adozione si intrecciano con l’organizzazione dell’offerta e con la struttura dei casi d’uso. Nel 2025 la domanda si concentra soprattutto su Text Analysis, Classification & Generation Systems(39%), seguiti da Data Exploration, Prediction & Optimization Systems(30%) e da Image, Audio, Video Analysis & Generation Systems(16%). Parallelamente, l’offerta resta ancora prevalentemente custom (77%), pur mostrando una tendenza verso modelli più standardizzati basati su servizi e licenze software. Ne deriva che l’innovazione non è solo una scelta di tool, ma una scelta di operating model e di priorità.

Le prime iniziative nelle grandi organizzazioni si concentrano su Customer Service, Production & Operations e ICT, con chatbot conversazionali e Intelligent Document Processing tra i casi d’uso più frequenti. In concreto, promuovere una cultura di innovazione compatibile con un approccio AI human centric significa legare l’ideazione a criteri chiari di fattibilità e impatto, e rendere esplicite anche le scelte di esclusione: la pratica dell’“anti-strategia”, cioè chiarire quali aree non saranno trasformate dall’AI nel breve periodo, riduce l’ambiguità sui cambiamenti attesi e crea spazio per l’apprendimento senza sovraccarico.

| Indicatori di maturità e diffusione (Italia) | Valore | Periodo |

| Mercato AI complessivo | 1,8 mld € (+50% a/a) | 2025 |

| Quota Generative AI sul mercato AI | 46% (+60% a/a) | 2025 |

| Grandi imprese con almeno un progetto AI | 71% | 2025 |

| PMI con progetti AI attivi | 8% | 2025 |

| Imprese (≥10 addetti) che usano IA | 8,2% (da 5,0%) | 2024 vs 2023 |

| Grandi imprese che usano IA | 32,5% (da 24,1%) | 2024 vs 2023 |

Indicatori chiave del mercato e dell’adozione dell’AI in Italia.

Strumenti di audit per misurare il tasso di adozione

Se l’innovazione va resa ripetibile, il passaggio successivo è renderla misurabile. Qui l’audit diventa lo strumento che collega l’adozione dell’AI ai segnali che contano davvero: continuità d’uso, accettazione, impatto sui processi e qualità degli output. Una roadmap in quattro fasi, usata nei programmi di trasformazione organizzativa, mette in sequenza attività concrete: valutare l’impatto sulla forza lavoro, pianificare il change management, educare e preparare, monitorare e adattare. L’obiettivo è trattare la cultura AI come un programma governato nel tempo, non come una campagna una tantum.

Nella pratica, l’audit interno tiene insieme due piani. Il primo è organizzativo: rivedere i ruoli, costruire campagne di awareness e definire un piano iniziale che renda esplicite dipendenze e rischi. Il secondo è operativo: identificare AI champion e osservare in modo continuativo la preparazione e l’accettazione dell’AI da parte dei dipendenti. In assenza di questo secondo livello, la scalabilità tende a essere fragile, perché l’adozione resta appesa a singoli team o a singoli sponsor.

| Un approccio pragmatico alla governance include la creazione di un comitato interfunzionale e multilivello per la revisione etica dell’AI. Tale organismo è incaricato di approvare i casi d’uso prima della loro implementazione e di imporre l’applicazione di protocolli “human-on-the-loop”, assicurando così che le decisioni finali e i risultati dell’IA siano sempre sotto la responsabilità di una persona fisica, e non esclusivamente di un algoritmo. |

Un punto ricorrente è la difficoltà di misurare il valore delle licenze GenAI ready-to-use. Nel 2025, tra le grandi imprese italiane con iniziative AI, l’84% dichiara di aver acquistato licenze GenAI pronte all’uso (tra gli strumenti più diffusi compaiono Microsoft Copilot, ChatGPT Plus e Gemini Advanced), ma solo circa la metà prova a misurarne i benefici e lo fa soprattutto tramite employee feedback. L’audit, quindi, ha anche una funzione di controllo manageriale: trasformare feedback e percezioni in indicatori confrontabili nel tempo.

- Readiness e literacy: copertura dei programmi di AI literacy e livello di preparazione per ruolo, distinguendo tra uso occasionale e integrazione nei workflow.

- Adozione e continuità: frequenza d’uso per funzione e per processo, separando sperimentazione individuale e utilizzo in produzione.

- Accettazione e rischio umano: segnali di fiducia e resistenze, inclusi indicatori di AI fatigue e qualità della comunicazione sui cambiamenti.

In questo quadro, la governance pesa quanto la misurazione. Nel 2025 solo il 9% delle grandi imprese dichiara una governance AI integrata e matura: un dato che aiuta a spiegare perché spesso l’adozione cresce più velocemente delle regole che dovrebbero renderla stabile. Una governance essenziale può partire da un principio semplice: ogni iniziativa deve avere un owner, un perimetro e una metrica di successo, con un ciclo di revisione che consenta di correggere rapidamente direzione e aspettative.

Attivare strategie HR per favorire un approccio human centric all’AI

Con principi e audit impostati, la trasformazione entra nel territorio più delicato: le persone. Un approccio human centered AI richiede che HR e leadership trattino l’AI come un cambiamento che modifica competenze, carichi di lavoro e aspettative di carriera. In assenza di una gestione esplicita, il rischio non è solo la resistenza, ma la perdita di valore: quando l’adozione non diventa abitudine, l’investimento resta confinato a trial e licenze sottoutilizzate.

Programmi di upskilling per facilitare la transizione tecnologica

Questo vale in modo particolare nei contesti di GenAI “a consumo”, dove l’uso tende a scalare rapidamente dentro processi ripetuti. Una cultura AI che funziona, quindi, è anche una cultura di disciplina: percorsi di literacy differenziati, comunicazioni chiare sui cambiamenti, e regole che impediscano che l’innovazione diventi sovraccarico organizzativo.

La prima leva HR è l’upskilling, inteso come preparazione mirata a seconda di ruoli e livelli di esposizione all’AI. Nei programmi di change management focalizzati sull’elemento umano, la formazione non è solo trasferimento di competenze, ma un intervento per ridurre ansia e incertezza. È in questo spazio che prende forma il tema dell’AI fatigue, definita come l’insieme di reazioni negative dei dipendenti — apatia, burnout, frustrazione — legate a cambiamenti guidati dall’AI su ruoli e processi, spesso alimentate da timori sulla sicurezza del lavoro.

Le previsioni sono esplicite: entro il 2028 oltre il 50% delle aziende globali indicherà la AI fatigue come principale ostacolo al raggiungimento del ROI atteso dagli investimenti in AI. E, quando change management e formazione vengono trascurati, il rischio è anche sociale oltre che operativo: si associa un turnover del 30% più alto tra i dipendenti più giovani e remoti.

Per prevenire questo scenario, una pratica adottata nei percorsi AI human centric è la creazione di un team di change management AI interfunzionale, con HR, esperti di business, specialisti tecnologici e leadership. Il team lavora su roadmap, adozione personalizzata e sviluppo di competenze future-ready, mantenendo coerenza tra obiettivi di processo e impatto sulle persone. A livello formativo, la segmentazione per profilo diventa essenziale: percorsi diversi per generalisti, profili in evoluzione e specialisti, così da evitare che la stessa iniziativa sia troppo complessa per alcuni e troppo basica per altri.

| Applicazioni pratiche dell’approccio Human-Centric in ambito HR Recruiting: Utilizzare software per individuare candidati potenziali, semplificando il processo di selezione e permettendo agli specialisti HR di concentrarsi sulla valutazione delle soft skill. Onboarding: Automatizzare la gestione di dati e documenti per velocizzare l’inserimento di nuovi dipendenti e ridurre il carico burocratico. Formazione: Implementare piattaforme digitali per personalizzare i percorsi di crescita professionale, valorizzando il potenziale di ogni dipendente in base al suo ruolo. Gestione data-driven: Sfruttare report e analisi predittive per formulare scelte strategiche, identificando gli ambiti che necessitano di potenziamento. |

Nei programmi basati su apprendimento sociale, l’esperienza pratica viene resa esplicita attraverso workshop e attività interattive, fino a esercizi di team che simulano l’uso di strumenti GenAI su casi concreti. Accanto a questo, si inserisce un filone spesso decisivo per la fiducia: i workshop sui fallimenti dell’AI, progettati per chiarire rischi come bias, allucinazioni, uso improprio e violazioni di sicurezza, definendo obiettivi, modalità di rilevamento e risposte operative. In contesti di mercato, iniziative di questo tipo vengono associate a un aumento della fiducia interna, a una riduzione dei sintomi di AI fatigue e a tassi di adozione più stabili nel tempo.

Misurare l’efficacia dell’implementazione dell’AI

Quando l’upskilling è attivo, l’ultimo passaggio è misurare se l’implementazione produce risultati coerenti e sostenibili. Qui torna utile la logica “monitorare e adattare” della roadmap: identificare segnali precoci, intervenire sui punti di frizione e aggiornare periodicamente il piano. In una prospettiva di cultura AI, l’efficacia non coincide con il numero di iniziative avviate, ma con la loro capacità di restare in produzione senza aumentare i costi di coordinamento e controllo.

La misurazione serve anche a distinguere tra adozione superficiale e cambiamento reale. Nel 2025, tra le grandi imprese italiane, le principali barriere restano la percezione di processi inadeguati, competenze limitate e compliance normativa. Indicatori di efficacia devono quindi catturare sia il miglioramento di processo sia il grado di autonomia delle persone, perché senza autonomia la pressione ricade sui team di controllo e riduce il ROI.

| Ambito di controllo | Cosa osservare | Perché conta in ottica human centric |

| Preparazione e accettazione | Livello di AI literacy, readiness per ruolo, segnali di AI fatigue | Riduce resistenze e limita il carico di supervisione |

| Adozione nei processi | Uso continuativo in Customer Service, Production & Operations, ICT; stabilità dei workflow | Trasforma l’AI da sperimentazione a routine di lavoro |

| Qualità e rischio | Incidenti legati a bias, allucinazioni o uso improprio; efficacia delle contromisure | Protegge persone e clienti, preservando fiducia interna |

| Governance | Ownership, cicli di revisione, perimetro delle iniziative | Rende prevedibile l’evoluzione e limita l’adozione disordinata |

Tabella di controllo per la misurazione dell’efficacia dell’AI.

Un approccio orientato al mercato, come quello adottato nei programmi di transizione AI promossi dal team di Mario Maschio, tende a unire queste metriche in dashboard essenziali, con revisioni periodiche che permettono di correggere rapidamente formazione, comunicazione e priorità dei casi d’uso. In questo modo l’implementazione resta coerente con l’obiettivo di una human centered AI: aumentare capacità operative senza trasformare l’innovazione in un fattore di incertezza organizzativa.