Negli ultimi anni, la crescente diffusione di tecnologie connesse nelle sfere più intime della vita quotidiana — dagli smartphone ai dispositivi domotici, dagli assistenti vocali ai sistemi di geolocalizzazione — ha dato origine a una nuova e pervasiva forma di vulnerabilità: l’abuso facilitato dalla tecnologia (technology-facilitated abuse, TFA).

Comprenderne le dinamiche è essenziale per affrontare una sfida che coinvolge il diritto, la progettazione digitale e la protezione delle persone vulnerabili.

Indice degli argomenti

La natura dell’abuso tecnologico nelle relazioni intime

L’abuso facilitato dalla tecnologia è un insieme di pratiche di sorveglianza, manipolazione, isolamento e minaccia che si avvalgono di strumenti digitali per esercitare un controllo coercitivo all’interno di relazioni affettive o familiari. Non si tratta di una nuova forma di violenza, bensì di una sua metamorfosi: le tecnologie digitali, lungi dal rappresentare strumenti neutri, vengono utilizzate come prolungamento e potenziamento di pratiche abusive già note, che si iscrivono nel dominio delle violenze interpersonali, in particolare della violenza del partner (Intimate Partner Violence, IPV).

Questa analisi ne esplora le caratteristiche, le criticità e le implicazioni regolative.

In modo particolare emergono questioni centrali di responsabilità: Qual è il ruolo delle aziende tecnologiche nel prevenire l’uso abusivo delle loro piattaforme?

È sufficiente l’approccio “user-centric” nella progettazione degli strumenti digitali?

Come si bilanciano privacy, sicurezza e usabilità nei casi in cui la minaccia provenga da un soggetto conosciuto e vicino?

Nonostante l’evidenza crescente del fenomeno, le risposte da parte dell’industria tecnologica sono state spesso tardive, frammentarie e reattive. Solo recentemente alcuni colossi digitali hanno avviato tavoli di confronto con centri antiviolenza, attivisti e studiosi per sviluppare strumenti di protezione dedicati, come centri di sicurezza (safety centers), modalità stealth o sistemi di segnalazione discreti.

Tuttavia, manca ancora un quadro regolativo chiaro e una progettazione responsabile che includa l’analisi dei rischi di abuso nei contesti di vulnerabilità. Le istituzioni giuridiche, i policy maker e gli sviluppatori devono dunque confrontarsi con una sfida complessa: riconoscere che la tecnologia non è mai neutra rispetto ai contesti sociali e relazionali in cui viene incorporata, e che ogni strumento digitale porta con sé implicazioni relazionali e giuridiche che vanno comprese, anticipate e governate.

Affrontare il nodo della responsabilità in questo ambito significa promuovere una nuova cultura della safety-by-design, valorizzare l’ascolto delle vittime, e costruire un ecosistema digitale che tuteli realmente chi si trova in condizioni di dipendenza, isolamento o rischio.

Tecnologie digitali come strumenti di controllo coercitivo

L’Organizzazione Mondiale della Sanità, così come numerosi centri di ricerca e policy makers, hanno ormai riconosciuto che l’IPV può assumere anche una dimensione tecnologica, laddove dispositivi connessi, applicazioni, social network, sistemi di geolocalizzazione o accessi da remoto vengano impiegati per esercitare controllo, minaccia, sorveglianza o umiliazione. Ed è in questa prospettiva che il TFA non si configura come un fenomeno isolato né alternativo rispetto alla violenza offline, ma come una sua estensione, capace di amplificare le dinamiche di dominio e coercizione, oltrepassando i confini fisici e temporali della relazione.

Il problema non risiede unicamente nell’uso improprio degli strumenti, ma nella neutralità presunta del design tecnologico. Le piattaforme digitali, spesso concepite con una logica orientata alla massimizzazione dell’engagement o alla semplificazione dell’accesso, non tengono conto delle asimmetrie relazionali, né delle strategie di sorveglianza o di stalking attuate da partner abusanti. In molti casi, account condivisi, notifiche push, backup automatici o tracciamento GPS diventano veri e propri vettori di violenza, anche dopo la fine della relazione.

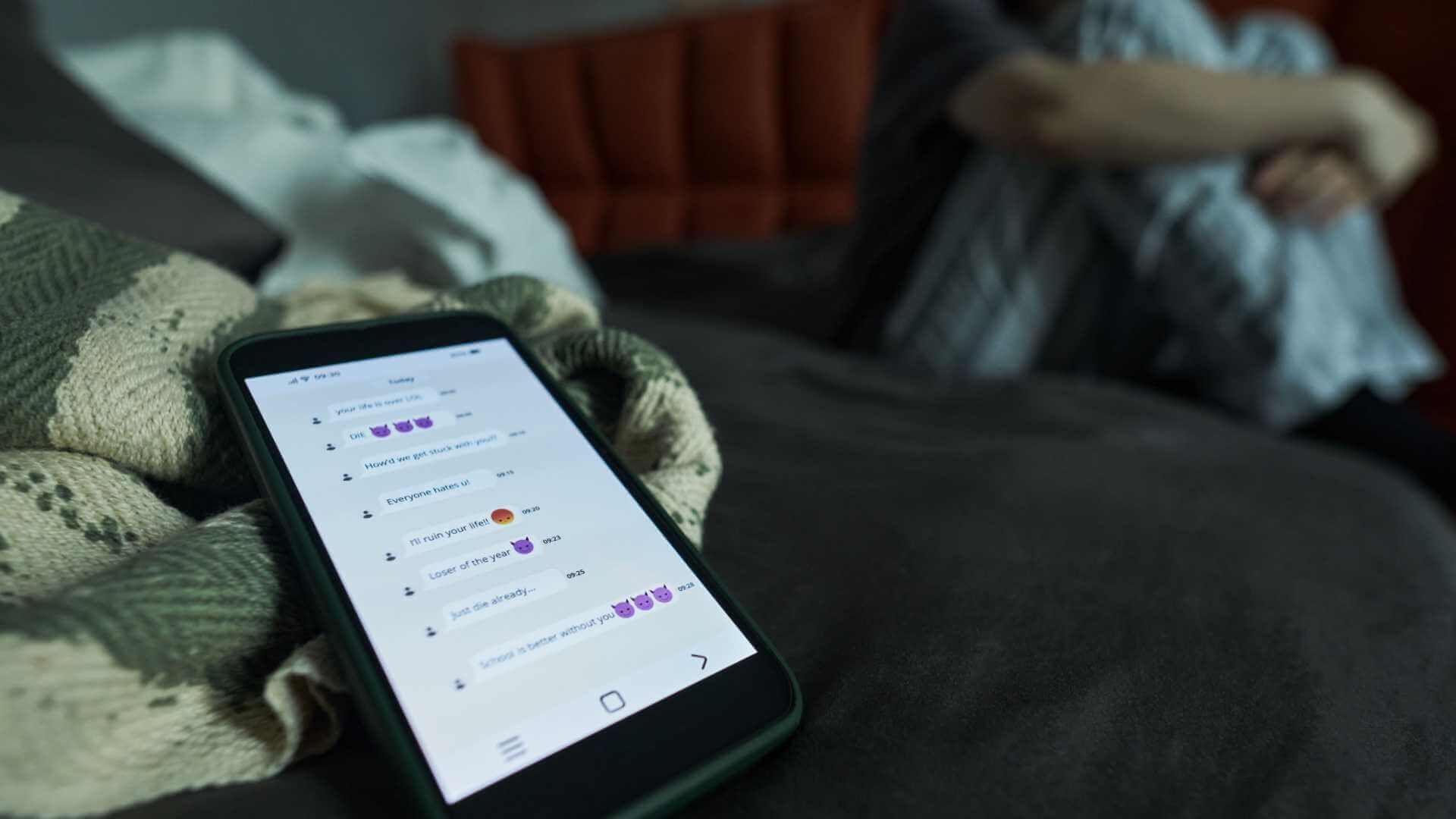

In effetti, una delle caratteristiche più destabilizzanti dell’abuso digitale è proprio la sua capacità di agire in ogni momento e da qualsiasi luogo, anche a distanza o dopo la fine del rapporto. Laddove l’abuso fisico ha limiti spaziali precisi, la dimensione tecnologica consente una sorta di “presenza continua” dell’abusante: la persona sopravvissuta può ritrovarsi esposta a forme di sorveglianza, messaggi minacciosi o diffusione di contenuti intimi ben oltre la rottura del legame. È ciò che emerge, tra gli altri, dagli studi condotti da Woodlock (2017)[1] e Dragiewicz et al. (2018)[2], secondo cui le nuove tecnologie, lungi dal costituire solo una risorsa per la comunicazione o l’autodeterminazione, possono diventare strumenti invasivi che intensificano la vulnerabilità delle vittime.

Tuttavia, l’analisi del fenomeno incontra non poche difficoltà concettuali e metodologiche. La letteratura, pur in costante crescita, appare ancora frammentata: si alternano definizioni e categorie diverse – come cyber abuse, digital coercive control, cyber IPV, image-based abuse – senza che vi sia ancora un framework teorico condiviso. Questa mancanza di uniformità si riflette anche nelle difficoltà di rilevazione statistica e nelle divergenze nei dati di prevalenza. Ad esempio, studi statunitensi e australiani[3] hanno rilevato tassi di esposizione al TFA superiori al 60% tra donne che hanno subito violenza domestica, ma questi numeri variano sensibilmente a seconda dei criteri adottati per definire il fenomeno. Tali disomogeneità non sono solo un limite descrittivo, ma incidono direttamente sulla capacità di formulare politiche di prevenzione e protezione efficaci.

Forme e dinamiche dell’abuso nei contesti domestici digitalizzati

Il punto nevralgico del fenomeno risiede nel fatto che molte delle tattiche impiegate nel TFA ricalcano – e al tempo stesso rielaborano – le dinamiche di potere e controllo tipiche dell’abuso relazionale, come già descritto da Stark[4] nel suo lavoro fondativo sul coercive control. L’utilizzo della tecnologia diviene dunque un nuovo vettore attraverso cui esercitare il dominio: accedendo indebitamente agli account del partner, monitorandone gli spostamenti, minacciandolo attraverso app di messaggistica, diffondendo immagini intime senza consenso, oppure manipolando il suo ambiente digitale per isolarlo o danneggiarne la reputazione. Queste pratiche si configurano come autentiche forme di violenza psicologica, sociale, talvolta anche economica, poiché spesso impediscono alla vittima di accedere liberamente alle proprie risorse, reti e spazi virtuali.

Nonostante l’ampiezza e la gravità del fenomeno, uno degli aspetti meno esplorati nella letteratura è rappresentato dalle strategie di resistenza delle vittime. Gli studi esistenti si soffermano principalmente sugli effetti dell’abuso, spesso drammatici: ansia, senso di ipervigilanza costante, perdita di autonomia, isolamento, stigmatizzazione. Ma le reazioni attive e resilienti messe in atto dalle sopravvissute – come il ricorso a tecnologie difensive, il coinvolgimento di esperti digitali, la ricerca di supporto legale o sociale – sono ancora scarsamente tematizzate e valorizzate. Questo silenzio contribuisce, in parte, a perpetuare una rappresentazione passivizzante della vittima, priva di agency, mentre molti casi reali dimostrano che, pur in condizioni di vulnerabilità estrema, le persone soggette a TFA mettono in campo forme complesse di resistenza, adattamento e richiesta di giustizia.

Reazioni, agency e strategie di resistenza delle vittime

La riflessione su questi aspetti non è solo accademica, ma ha implicazioni cruciali per le pratiche di tutela e per l’elaborazione di strumenti normativi e tecnici. Riconoscere la specificità dell’abuso tecnologico, senza separarlo artificialmente dalle altre forme di violenza relazionale, significa coglierne l’intima continuità: la tecnologia non inventa la violenza, ma le offre nuove modalità, più pervasive e meno visibili, per manifestarsi.

La sfida, oggi, è infatti duplice: da un lato, sviluppare una grammatica condivisa per nominarlo e comprenderlo; dall’altro, costruire dispositivi di protezione che tengano conto della natura ibrida, fluida e spesso invisibile del TFA.

In questo senso, il lavoro interdisciplinare – tra diritto, scienze sociali, tecnologia e pratiche di advocacy – rappresenta una condizione necessaria per affrontare la complessità del fenomeno e per restituire alle persone coinvolte, in particolare alle donne, strumenti efficaci di autodeterminazione e giustizia.

Verso una regolazione del TFA e un design orientato alla sicurezza

L’articolo “Technology-Facilitated Abuse in Intimate Relationships: A Scoping Review” di Rogers et al. (2023), pubblicato su BMC Public Health, offre una rassegna sistematica della letteratura internazionale dedicata all’abuso facilitato dalla tecnologia (TFA) nelle relazioni intime. L’obiettivo dello studio era comprendere in che modo il TFA si manifesta, quali effetti produce e come le vittime reagiscono, partendo da una ricognizione degli studi pubblicati tra il 2000 e il 2020 in paesi anglofoni come Regno Unito, Stati Uniti, Canada, Irlanda, Australia e Nuova Zelanda. Gli autori hanno selezionato 22 studi, attingendo a banche dati scientifiche primarie come MEDLINE, CINAHL e Scopus.

L’analisi conferma che il TFA non costituisce un fenomeno isolato né marginale, ma una modalità sempre più centrale attraverso cui si esercita la violenza tra partner. Si tratta di una forma di abuso profondamente eterogenea, adattabile ai diversi contesti tecnologici e personali. Lungi dal limitarsi all’uso molesto dei social media o all’invio eccessivo di messaggi, il TFA include condotte altamente invasive come la sorveglianza digitale tramite spyware, il controllo dell’ambiente domestico attraverso tecnologie smart, l’accesso non autorizzato ai dati personali, fino alla diffusione non consensuale di immagini intime. Queste condotte, nel loro insieme, possono essere ricondotte alle otto categorie di abuso previste dalla “Ruota del Potere e del Controllo di Duluth[5]“, tradizionalmente utilizzata per analizzare la violenza domestica offline. L’introduzione delle tecnologie digitali non modifica la logica del dominio, ma ne amplia radicalmente la portata e l’efficacia, rendendo il controllo più pervasivo, continuo e difficilmente eludibile, anche dopo la cessazione del rapporto.

Gli effetti documentati del TFA sono significativi e riguardano più dimensioni della vita delle vittime. In primo luogo, la salute mentale è profondamente compromessa: molti studi riportano sintomi da stress, ansia, depressione, panico e insonnia. In secondo luogo, si registrano ricadute sul piano sociale e reputazionale, dovute all’esposizione forzata o alla distruzione dell’immagine pubblica della vittima, spesso attraverso contenuti manipolati o diffusi senza consenso. Anche le conseguenze economiche sono rilevanti, specie nei casi in cui l’autore dell’abuso limita l’accesso al denaro, sabota gli strumenti di lavoro o accumula debiti a nome della vittima. L’aspetto più insidioso di questo tipo di abuso risiede però nella sua onnipresenza: mentre la violenza fisica può essere delimitata nello spazio e nel tempo, il TFA travalica ogni confine, insinuandosi negli oggetti di uso quotidiano, nel telefono, nel computer, nei dispositivi della casa. La vittima non ha tregua, nemmeno quando è sola, poiché il controllo si esercita a distanza, spesso in modo invisibile.

Uno degli aspetti più critici evidenziati dalla review riguarda la scarsità di informazioni sulle strategie di resistenza adottate dalle vittime. Pochi studi si sono occupati in modo sistematico delle risposte individuali al TFA, e quando lo hanno fatto hanno descritto tentativi di interruzione diretta del controllo tecnologico, la ricerca di aiuto professionale o legale, o l’identificazione delle barriere che impediscono di reagire efficacemente. Tuttavia, la letteratura tende ancora a soffermarsi più sulla descrizione delle dinamiche di abuso che sulla capacità delle persone sopravvissute di fronteggiarle, con il risultato che l’esperienza della vittima resta centrata sul danno subito e non sulla sua agency. Non solo. Le definizioni sono ancora incerte, le categorie giuridiche spesso inadeguate, e le pratiche di intervento frammentarie. Di fronte a questo scenario, gli autori invocano non a caso proprio la necessità di sviluppare un quadro teorico robusto e condiviso, che consenta di identificare, misurare e contrastare efficacemente il TFA.

La casa come spazio di sorveglianza e dominio tecnologico

Proseguendo nel filone di indagine sulle forme contemporanee di abuso tecnologico, un articolo della BBC del maggio 2020[6], ripreso anche da fonti come Post Parliament del Regno Unito, ha offerto un quadro ancora più vivido e aggiornato su come la violenza domestica si intreccia con l’Internet delle cose, i social network e i dispositivi smart. Qui non si parla solo di spyware o tracciamento, ma di un sovrapporsi di pratiche coercitive che scavano nell’intimità della quotidianità fino a renderla terreno di dominio.

Nel racconto di diverse vittime emerge un’immagine perturbante: dalle videocamere installate in casa per tenere la donna continuamente sotto controllo, all’accensione notturna di luci e dispositivi per interrompere il sonno, fino alla manipolazione a distanza di serrature, termostati e sistemi audio. In questi casi, la tecnologia non è un mero strumento, ma l’elemento stesso della violenza: un veicolo che trasforma la casa in un luogo di sorveglianza costante, un teatro dell’onnipresenza del partner abusante. Una donna ha descritto la paura generata da un messaggio apparentemente innocuo che arrivava proprio quando lei si trovava da sola in giardino, segno che era costantemente monitorata. Un’altra ha parlato della scelta di una tecnologia domotica all’avanguardia come parte di una messa in scena di potere, dove persino un pannello di controllo smart diventava arma di intimidazione.

Parallelamente, lo scenario digitale continua a prestarsi a forme subdole di abuso: account social violati, attività impersonate, diffusione di immagini private senza consenso. Alcuni abusanti, secondo il reportage, hanno utilizzato i dati contenuti nei profili online delle vittime per sabotare processi giudiziari, inviando messaggi falsi a giudici o futuri datori di lavoro con lo scopo di minare la reputazione e discreditare la persona. Si tratta di una violenza che agisce sulla psiche attraverso l’umiliazione, la paura, la stigmatizzazione personale e professionale.

Inoltre, un rapporto del Culture, Media and Sport Committee del Parlamento del Regno Unito, intitolato “Connected tech: smart or sinister?”, discute come dispositivi come baby monitor, altoparlanti smart e tracker fitness vengano facilmente utilizzati per monitorare, molestare e controllare le vittime. Il rapporto, se da una parte evidenzia la crescente preoccupazione per l’abuso facilitato dalla tecnologia, sempre più percepito come complementare e potenziante alle forme tradizionali di violenza, dall’altra raccomanda al governo di affrontare con solerzia questa problematica, migliorando la formazione delle forze dell’ordine e la consapevolezza dei servizi di supporto.

Non ultimo, durante la pandemia da COVID-19, l’isolamento forzato ha accentuato ulteriormente il rischio da TFA: il tempo trascorso in casa ha aumentato esponenzialmente la dipendenza dalla tecnologia, e con essa la possibilità di azioni coercitive mediate da dispositivi digitali. L’Osservatorio di Women’s Aid[7] ha registrato un’impennata delle richieste di supporto telefonico e online, confermando quanto l’abuso tecnologico si alimenti nella dimensione domestica quotidiana.

L’inchiesta pubblicata sul New Zealand Herald da Isaac Davison offre un’ulteriore testimonianza concreta di come i dispositivi domestici intelligenti, concepiti per garantire sicurezza e comfort, possano venire riconfigurati in strumenti di intimidazione e controllo. Racconti emersi durante una ricerca interna di IBM rivelano che l’automazione della casa – il remoto azionamento di riscaldamento e Wi-Fi – ha finito per trasformarsi in un gioco al massacro, con persone proprietarie dei dispositivi capaci di mutarne la funzione primaria per esercitare potere sul partner inconsapevole.

Oltre alla banale interruzione del sonno provocata da luci comandate a distanza, è emerso un meccanismo di gaslighting tecnologico, in cui il responsabile dell’abuso negava ogni intervento sulla temperatura e induceva la vittima a dubitare della propria percezione della realtà, insinuandole che stesse impazzendo. In un altro episodio, l’ex partner escluso dai canali social è riuscito a ricostruire con un’app fotografica i percorsi della famiglia, sfruttando involontarie geolocalizzazioni incorporate nelle immagini, dimostrando come ogni innovazione digitale nasconda potenziali falle di privacy.

Sul fronte normativo, il legislatore neozelandese ha aggiornato nel 2019 la definizione di violenza familiare per includere comportamenti di controllo protratti nel tempo, riconoscendo implicitamente il ruolo della tecnologia nella creazione di situazioni di “intrappolamento”. Tuttavia, a differenza del modello inglese – dove il «coercive control» è un reato autonomo – in Nuova Zelanda la vittima deve ancora dimostrare un pericolo concreto e ricondurre il danno a episodi violenti tradizionali, poiché manca una tipizzazione specifica per l’abuso digitale. Questa lacuna evidenzia la necessità di strumenti probatori innovativi, capaci di captare tracce e logiche di controllo tecnologico in assenza di violenza fisica documentata

Pianificazione della sicurezza e ostacoli sistemici

Il documento intitolato Technology-facilitated abuse within the context of intimate partner violence: Barriers to and recommendations for safety planning (Pentaraki & Speake, 2024)[8], si inserisce nel crescente corpo di ricerca che esplora l’intersezione tra violenza domestica e abusi facilitati dalla tecnologia (TFA). Lo studio si distingue per l’approccio transdisciplinare, combinando le prospettive del lavoro sociale e della geografia, e per il focus specifico sulla pianificazione della sicurezza, un aspetto cruciale ma spesso trascurato nella risposta istituzionale alla TFA.

Condotto in quattro paesi europei—Estonia, Finlandia, Grecia e Irlanda del Nord—lo studio ha coinvolto professionisti che lavorano nel campo della violenza di partner intimi (IPV). I risultati evidenziano una lacuna significativa nella formazione e nella consapevolezza riguardo alla TFA tra i professionisti intervistati. In particolare, la valutazione del rischio legato alla TFA non è sistematicamente integrata nei piani di sicurezza, nonostante la crescente evidenza del suo impatto sulle vittime.

Le barriere identificate includono la mancanza di conoscenze specifiche, risorse limitate e la percezione che la TFA sia un fenomeno marginale rispetto ad altre forme di abuso. Queste lacune possono compromettere l’efficacia delle strategie di protezione e supporto, lasciando le vittime vulnerabili a ulteriori abusi.

Dal racconto delle professioniste emerge in modo dettagliato quanto il safety planning, pur essendo una pratica consolidata nella risposta alla violenza domestica, fatichi a intercettare i rischi digitali. Se da un lato le operatrici sono consapevoli di modalità di abuso relativamente note – come il monitoraggio telefonico o lo stalking via GPS – dall’altro riconoscono un vuoto su strumenti più recenti, come app di smart home, sorveglianza tramite dispositivi IoT o spionaggio attraverso applicazioni evolute. Le donne assistite ignorano spesso di essere sotto sorveglianza, e le stesse operatrici, a meno che non emergano segni evidenti, non riescono a inserirle nel piano di sicurezza. Questa carenza, alimentata da un divario di competenze tecnologiche amplificato sia dal gender gap digitale sia da condizioni strutturali di scarsità di risorse, mina la possibilità di trasformare il piano di sicurezza in un autentico strumento di tutela. Il lavoro evidenzia dunque un circolo vizioso pericoloso: gli sforzi di empowerment delle donne sono ostacolati non solo dalla disuguaglianza strutturale, ma anche dalla mancanza di formazione specialistica da parte delle operatrici, che operano in condizioni di sottoutilizzo e scarso sostegno. In questi contesti, l’assenza di fondi e di strumenti adeguati non permette di aggiornare i piani di sicurezza in base alle nuove minacce tecnologiche, rendendo la protezione delle vittime incompleta.

Sul piano teorico, lo studio ramifica l’idea di patriarchal surveillance capitalism, reinterpretando la sorveglianza di massa non solo come una questione di controllo commerciale o governativo, ma come un elemento strutturale della violenza di genere. Le tecnologie digitali, nella loro essenza progettuale e nel loro uso quotidiano, riflettono e rafforzano disuguaglianze di potere. Si delinea quindi un percorso che non può e non deve limitarsi a tecnicismi emergenziali, ma richiede un ripensamento radicale: dalla formazione specialistica e dagli investimenti sostenibili, fino a un design che includa la sicurezza come categoria fondativa.

Il documento conclude con una riflessione critica: ridurre la questione della TFA a una mera carenza di competenze professionali rischia di ignorare le disuguaglianze strutturali più ampie, come il capitalismo della sorveglianza patriarcale, che facilitano e perpetuano tali abusi. Pertanto, è essenziale adottare un approccio che consideri anche le dinamiche di potere e controllo alla base della TFA, promuovendo una risposta più olistica e sensibile al genere che fonde tecnologia, femminismo e trasformazione sociale.

Tecnologie protettive contro il TFA: opportunità e rischi

Nel solco delle analisi precedenti, l’approfondimento[9] pubblicato su MIT Technology Review nel giugno 2025 rappresenta un passaggio decisivo nel dibattito sul technology-facilitated abuse (TFA), spostando ulteriormente l’attenzione dalla mera descrizione del fenomeno alla ricerca di risposte concrete e trasformative. Dopo anni in cui la riflessione si è concentrata sull’emergere delle nuove forme di controllo digitale e sulle loro ricadute psicologiche e sociali, si apre dunque una fase orientata alla costruzione di soluzioni: dispositivi, funzioni e pratiche digitali non solo pensati per prevenire l’abuso, ma capaci di supportare attivamente le vittime nel riconoscere i segnali, uscire da situazioni coercitive e riappropriarsi del proprio spazio tecnologico.

Questo rovesciamento di prospettiva implica un cambio di paradigma profondo: la tecnologia, finora strumento di sorveglianza e controllo, viene ripensata come leva di emancipazione e protezione. Si tratta, in sostanza, di rendere visibile e decifrabile ciò che finora è rimasto celato nell’opacità del codice, delle impostazioni di default, dell’interfaccia user-unfriendly. In questo senso, l’evoluzione segnalata nell’inchiesta di Jessica Klein appare come una risposta concreta a quanto lamentato nella scoping review di Rogers et al. (2023), che evidenziava una grave carenza di strategie tecnologiche di resistenza: mentre le vittime finora si affidavano quasi esclusivamente a risposte tradizionali (denunce, blocchi fisici, cambi di dispositivo), ora emergono strumenti digitali specialistici, progettati per fornire tutela preventiva, autonomia e agency.

L’inchiesta descrive come oggetti quotidiani – smartwatch, baby monitor, AirTag, automobili connesse – vengano sfruttati per esercitare controllo coercitivo all’interno delle relazioni intime. Il caso di “Gioia” (nome di fantasia), costretta dal partner a vivere sotto la costante sorveglianza di baby monitor e di un orologio smart regalato al figlio ma controllabile solo da lui, mostra con chiarezza quanto il TFA si radichi in tecnologie solo apparentemente neutre. L’assenza di lesioni fisiche rende però il fenomeno difficile da riconoscere e denunciare: come riporta Klein, molte vittime si sentono ignorate perché «nessuna frattura, nessun livido, quindi nessun reato». Una donna arriva a dire: «Vorrei che mi rompesse un braccio, almeno qualcuno mi crederebbe» («I wish he was breaking my arms and punching me in the face, because then people could see it»).

Il quadro delineato trova pieno riscontro nella letteratura sulla violenza di genere, in particolare nel concetto di controllo coercitivo: un dominio relazionale perpetuato anche tramite strumenti legalmente acquistabili e di uso comune. Studi australiani segnalano come molte vittime siano costrette a rinunciare all’uso di telefoni o account personali perché “everything is in his name”, a conferma della centralità della proprietà tecnologica nel mantenimento del controllo. La sorveglianza domestica digitale – realizzata tramite app spia, telecamere nascoste, falsi profili, manipolazioni di dispositivi – appare come un’estensione dello stalking, ma potenziata dalla pervasività delle infrastrutture digitali. Le minacce si spostano online, si moltiplicano e assumono forme sofisticate, come nel caso estremo citato dall’articolo: la pubblicazione sui social di una foto della figlia armata per intimidire la madre.

In questo contesto, l’articolo evidenzia l’urgenza di risposte progettuali proattive. Le iniziative delle grandi piattaforme, come le notifiche anti-tracciamento di Apple, i sistemi anti condivisione di immagini intime di Meta o i codici PIN per le corse Uber, sono infatti perlopiù reattive, introdotte solo dopo che i danni si sono verificati. Gli esperti del Safety Net Project sottolineano invece l’importanza di progettare la sicurezza “by design”, fin dall’origine. In quest’ottica si inserisce l’esperienza del Clinic to End Tech Abuse (CETA) di Cornell Tech, dove informatici e operatori sociali collaborano per restituire alle vittime il controllo dei propri strumenti digitali. Si tratta di esperimenti pionieristici che indicano la necessità di approcci integrati, in grado di coniugare competenze tecnologiche e sensibilità umana, per produrre soluzioni davvero efficaci.

Un’attenzione crescente viene dedicata, inoltre, all’intelligenza artificiale: sistemi capaci di rilevare accessi anomali, spyware, manipolazioni di dispositivi smart o pattern coercitivi nei comportamenti digitali. Ma la posta in gioco non è solo tecnica: è anche emotiva, cognitiva e simbolica. Gli strumenti devono essere progettati perché siano comprensibili e accessibili per chi vive condizioni di fragilità, affinché la consapevolezza del rischio non sia privilegio di pochi, ma risorsa condivisa.

Eppure, come evidenziato, il ruolo delle big tech resta ambiguo. Se da un lato si moltiplicano iniziative collaborative con organizzazioni antiviolenza, dall’altro persistono architetture digitali pensate per potenziare il controllo del cosiddetto “utente principale” – spesso coincidente con l’uomo, proprietario o amministratore del sistema. La promessa di neutralità della tecnologia si rivela ancora una volta fallace: le piattaforme continuano a riflettere e rinforzare gerarchie esistenti, occultando il potenziale oppressivo dietro l’efficienza dell’automazione.

In questo scenario, il diritto è chiamato a ridefinire il proprio ruolo. Sebbene strumenti come il GDPR o il Digital Services Act offrano un quadro normativo utile, l’assenza di una tipizzazione autonoma del TFA ne ostacola l’efficace contrasto. I comportamenti abusivi restano dispersi tra reati diversi, incapaci di cogliere l’intreccio tra violenza, intimità e tecnologia. Inoltre, il diritto tende ancora a operare in chiave reattiva, quando invece il TFA richiederebbe una capacità di intervento precoce, capace di cogliere segnali deboli e non codificati.

Non mancano, infine, rischi sistemici legati all’adozione di tecnologie predittive: la rilevazione automatica dei comportamenti devianti può diventare a sua volta strumento di sorveglianza, se non accompagnata da garanzie robuste di trasparenza, controllo umano e tutela dei diritti fondamentali. La protezione delle vittime non può tradursi in un nuovo paternalismo tecnologico o in una medicalizzazione dell’intimità.

Tutto ciò rende evidente una necessità culturale prima ancora che normativa: abbandonare la visione della tecnologia come spazio neutro per riconoscerla come ambiente relazionale, attraversato da poteri, diseguaglianze e possibilità trasformative. Solo a partire da questa consapevolezza sarà possibile costruire politiche pubbliche, pratiche progettuali e strumenti giuridici realmente in grado di affrontare la violenza digitale nelle relazioni affettive.

In definitiva, si delinea una traiettoria evolutiva: dal riconoscimento del fenomeno (come emerso nelle scoping review) alla sperimentazione di soluzioni tecnologiche (documentata dal Technology Review), fino a un ripensamento più ampio, che integri autodeterminazione, privacy, sicurezza e giustizia relazionale. Non basta contenere i danni: è necessario immaginare infrastrutture tecnologiche capaci di promuovere libertà, dignità e responsabilità condivisa.

Note

[1]Delanie Woodlock ha analizzato la diffusione delle tecnologie – telefoni, tablet, PC, social media – come strumenti quotidiani di stalking e abuso in contesti di violenza domestica e di coppia.Basandosi su indagini a 152 operatrici anti‑violenza e 46 vittime, ha rilevato come i perpetratori sfruttino le tecnologie per creare un senso di onnipresenza, isolare, punire e umiliare le vittime, persino minacciando la diffusione di contenuti sessualizzati online anrows.org.au+11research.monash.edu+11unboundmedicine.com+11.

L’articolo sottolinea come tale abuso digitale sia estensione grave della violenza, rendendo urgente sviluppare risposte giuridiche, pratiche e politiche adeguate .

[2] Nel loro studio Dragiewicz et al. (2018), la tecnologia è descritta come via per il controllo coercitivo digitale (“technology facilitated coercive control”) nei contesti di violenza domestica. Identificano i media digitali – telefoni, social, app – come strumenti con cui i perpetratori ampliano la loro influenza, superando limiti spaziali e temporali, espandendo lo spazio di controllo

Il lavoro dimostra che queste forme di abuso digitale si intrecciano con violenza emotiva, psicologica, finanziaria e sessuale, aggravando la condizione delle vittime

[3] Secondo un’analisi dell’eSafety Commission (2023), il 62,3% degli adulti australiani (18–54 anni) ha dichiarato di aver subito technology-facilitated sexual violence

Un’indagine rappresentativa condotta nel 2022 su circa 4.600 adulti ha trovato che il 51% ha sperimentato almeno un comportamento legato al technology-facilitated abuse (TFA) nella propria vita

La percentuale sale al 72% tra i giovani 18–24 anni, il gruppo di età con il più alto tasso di TFA Questi numeri derivano da definizioni ampie che includono monitoraggio, controllo, molestie, minacce e condivisione di immagini intime senza consenso. Le variazioni sono correlate ai criteri adottati (es. include o meno violenza sessuale tecnologica, tracciamento GPS, ecc.) .Sebbene le statistiche specifiche per il TFA siano meno consolidate negli USA, alcuni studi segnalano che un’elevata percentuale di donne vittime di violenza domestica:Molto frequente l’uso di strumenti tecnologici da parte dei perpetratori (spyware, tracciamento, controllo delle comunicazioni), con tassi stimati superiori al 60%, ma i dati variano in base al campione e alla definizione usata (ad esempio, se si considera solo il tracciamento o anche molestie e diffamazione online).

Molte ricerche riportano che smartphone, app e social media sono comunemente utilizzati nel contesto di violenza domestica .

[4] Stark, Evan, Coercive Control: How Men Entrap Women in Personal Life (Oxford University Press, 2007). Stark ha descritto per primo le dinamiche di coercive control: una strategia complessa basata su micro-controlli, isolamento, sorveglianza e minaccia. Il TFA applica le stesse tattiche – ma tramite tecnologie digitali –, trasformando il modello di Stark e ampliandone la dimensione: le stesse pratiche di potere e dominio vengono rielaborate e intensificate attraverso strumenti come app, GPS, social network e dispositivi personali. In sintesi, il cuore del problema risiede proprio in questa continuità adattativa: le tattiche di potere e controllo relazionale classiche non vengono sostituite, ma reinventate attraverso la tecnologia, in linea con quanto già teorizzato da Stark.

[5] Power and Control Wheel – Duluth Model. Sviluppata a partire dal 1984, in seguito a focus group con donne vittime di violenza domestica, la ruota identifica le tattiche abusive più comuni utilizzate dai partner nel contesto dell’Intimate Partner Violence.

Al centro della ruota c’è il concetto di Potere e Controllo; intorno vi sono varie strategie come intimidazione, abuso emotivo, isolamento, minacce, uso dei figli, privilegi di genere, abuso economico e coercizione, con la violenza fisica e sessuale che funge da “cerchio esterno” a tenere tutto unito.La ruota è stata creata da Ellen Pence, Michael Paymar e Coral McDonald delle DAIP, basandosi sulle testimonianze dirette delle sopravvissute È diventata un’immagine educativa fondamentale per comprendere come la violenza domestica sia una strategia sistemica volta al mantenimento del potere, non un insieme di episodi isolati

[6] L’articolo della BBC del maggio 2020, intitolato “How smart home devices are being used for domestic abuse”, esplora come i dispositivi domestici intelligenti, come videocitofoni, altoparlanti smart e termostati, vengano sfruttati per controllare, monitorare e intimidire le vittime di violenza domestica. Le testimonianze di donne abusate evidenziano come questi dispositivi possano essere utilizzati per monitorare i movimenti, ascoltare conversazioni e manipolare l’ambiente domestico, creando un senso di sorveglianza costante. L’articolo sottolinea anche la necessità di una maggiore consapevolezza e regolamentazione per prevenire l’abuso tecnologico.

[7]Secondo il report “The impact of Covid-19 on domestic abuse support services” di Women’s Aid (Estate 2020), il 91% dei servizi di supporto online e l’81% di quelli telefonici hanno registrato un aumento della domanda durante il lockdown. Il “Technology and domestic abuse 2022 Evidence Hub” di Women’s Aid evidenzia inoltre che oltre la metà dei servizi ha rilevato un aumento di richieste relative a tecnologie abusate (spyware, monitoraggio GPS, hacking account ecc.), sottolineando l’importanza crescente del TFA nel contesto domestico womensaid.org.uk.

[8] Lo studio, condotto con professioniste di quattro paesi europei (Estonia, Finlandia, Grecia e Irlanda del Nord), esplora come il TFA venga considerato – o spesso ignorato – all’interno dei piani di sicurezza per vittime di violenza domestica.

Identifica barriere chiave, tra cui la mancanza di conoscenza specifica e la limitata inclusione della valutazione del TFA nei protocolli di sicurezza; offre infine raccomandazioni per migliorare formazione e politiche, tenendo presente le disuguaglianze strutturali.

[9] “From remotely-controlled smart cars to menacing Netflix messages, tech‑facilitated abuse is keeping up with the times.” L’articolo esplora come abusi digitali evoluti — dall’IoT alla manipolazione di dispositivi smart — stiano trasformando le dinamiche dell’Intimate Partner Violence, rendendo la violenza domestica più pervasiva e invisibile.