La letteratura scientifica ha identificato l’età avanzata come una delle principali barriere alla digitalizzazione (Atkinson et al., 2016), con effetti diretti sull’incremento del rischio di sostituzione sul lavoro (Yamashita et al., 2024).

Più recentemente, numerosi studi hanno esplorato l’AI literacy degli anziani (Kaur & Chen, 2023) e – più in generale – l’atteggiamento verso l’Intelligenza Artificiale (Kowalski et al., 2019; Beaney, Singh Kalirai & Chambers, 2020; Bonilla & Martin-Hammond, 2020; Shandilya & Fan, 2022).

Indice degli argomenti

Come le diverse generazioni vedono l’IA

Arrivando a sviluppare suggerimenti e pratiche per migliorane l’accettazione o l’apprendimento. Zhengkun et al. (2025) evidenziano come l’accettazione dell’AI da parte degli anziani non dipenda esclusivamente da facilità d’uso e funzionalità, ma anche da esperienza di servizio, supporto emotivo e reti sociali. L’offerta di formazione e assistenza personalizzate risulta fondamentale per migliorare l’accettazione delle tecnologie AI in questa fascia demografica.

Allargando il focus, dagli anziani alle differenze generazionali (o, più in generale, all’effetto dell’età), alcuni studi hanno confrontato differenze di utilizzo (Isbanner et al., 2022; Gnambs et al., 2025) e atteggiamento (Watts, Holder & Vikram, 2018; Zhang & Dafoe, 2019; Alruwaili et al., 2024) tra diverse generazioni nei confronti dell’AI.

La ricerca “Hesitant & Hopeful: How Different Generations View Artificial Intelligence” condotta dalla società Barna nel 2023 (e pubblicata l’anno successivo) su 1.500 adulti statunitensi ha rivelato profonde differenze generazionali. Gen Z e Millennials manifestano prevalentemente curiosità e fiducia, mentre Gen X e Boomers esprimono scetticismo e sfiducia.

Le generazioni divergono anche nel senso di urgenza rispetto all’integrazione dell’AI nella vita quotidiana: il 50% della Gen Z percepisce tale urgenza contro il 14% dei Boomers. I Boomers risultano la generazione più propensa a dichiarare incomprensione dell’AI, indicando un duplice divario di comprensione e fiducia rispetto alle coorti più giovani.

Lo scetticismo caratterizza le generazioni anziane mentre l’entusiasmo contraddistingue i giovani (Alabbad et al., 2025). La Generazione Z e i Millennial apprezzano i sistemi AI emotivamente reattivi, mentre gli adulti anziani privilegiano prevedibilità e bassa ambiguità (Nguyen & Connolly, 2025). La Generazione Z dimostra maggiore comfort e minore riluttanza verso l’AI, considerandola strumento di produttività e innovazione grazie all’esposizione precoce agli ambienti digitali (Baki & Yusri, 2024).

Questa differenza emerge con particolare evidenza nello studio di Chan & Lee (2023) che confronta studenti (Gen Z) e insegnanti (Gen X o Boomer) sui temi dell’AI generativa. Gli insegnanti manifestano maggiore scetticismo sulle capacità della GenAI in ambito educativo e preoccupazione per i rischi che comporta per apprendimento, crescita e risultati accademici degli studenti. Gli insegnanti dimostrano maggiore cautela verso i risultati della GenAI, concordando sulla necessità di verificare e convalidare le informazioni prodotte da queste tecnologie. La divergenza risulta particolarmente marcata rispetto all’utilizzo della GenAI per i compiti scolastici.

Le generazioni convergono nelle preoccupazioni sulla privacy (Racine et al., 2024), mentre divergono sull’integrazione professionale. Gli anziani manifestano preoccupazione per l’integrazione dell’AI nelle professioni e maggiore inclinazione verso pratiche tradizionali, riflettendo riluttanza generazionale ad abbracciare pienamente tali progressi. Le generazioni anziane percepiscono minacce in vari ambiti, richiedendo comprensione approfondita di come i sentimenti di minaccia all’identità interagiscano con l’accettazione dell’AI (Jussupow et al., 2022). Le persone anziane citano frequentemente preoccupazioni etiche, uso improprio dei dati e perdita di posti di lavoro (Nguyen, 2024; Al-Omari et al., 2025).

Gli adulti anziani, spesso stereotipati come resistenti alla tecnologia, si impegnano attivamente con l’AI quando questa risponde alle loro esigenze di analisi e funzionalità (Sell et al., 2025). Lo studio di Ost Mor, Wittenberg e Birati (2024), pur focalizzandosi sugli over 60, conferma l’età come principale determinante dell’atteggiamento verso l’AI, evidenziando una correlazione significativa tra attitudine positiva alla vita e capacità percepita di utilizzare l’AI.

Un’importante eccezione emerge nello studio di Cinalioglu, Elbaz, Sekhon e Sekhon (2022) in ambito sanitario: gli over 55 esprimono il maggiore livello di comfort rispetto all’uso dell’AI per supportare decisioni mediche, medicina di precisione, sviluppo di farmaci e vaccini o tracciamento epidemico. Paradossalmente, gli over manifestano minore comfort rispetto agli under 55 nel consentire accesso ai propri dati sanitari all’AI. Il risultato suggerisce che la percezione di utilità dell’AI modifica radicalmente l’atteggiamento.

Zubair, Hashmat e Aimen (2025), attraverso revisione sistematica basata su linee guida PRISMA di 32 articoli peer-reviewed pubblicati tra 2020 e 2025, identificano variabili psicologiche, culturali e contestuali che influenzano l’adozione dell’AI. Utilizzando la teoria degli usi e gratificazioni (UGT) come framework teorico, lo studio rivela divisioni generazionali significative.

La Generazione Z mostra maggiore fiducia e utilizzo di strumenti AI come ChatGPT per gratificazioni cognitive e sociali quali apprendimento e produttività. Le conclusioni specifiche del modello UGT indicano: Gen Z prioritizza gratificazioni cognitive e affettive, concentrandosi sull’AI per produttività, apprendimento, coinvolgimento e infotainment; la Generazione X bilancia gratificazioni cognitive e sociali mostrando crescente preoccupazione per aree di integrazione personale come la privacy; gli adulti anziani attribuiscono grande importanza a gratificazioni personali e sociali e rischi percepiti, manifestando preoccupazione per equità, autonomia e sicurezza.

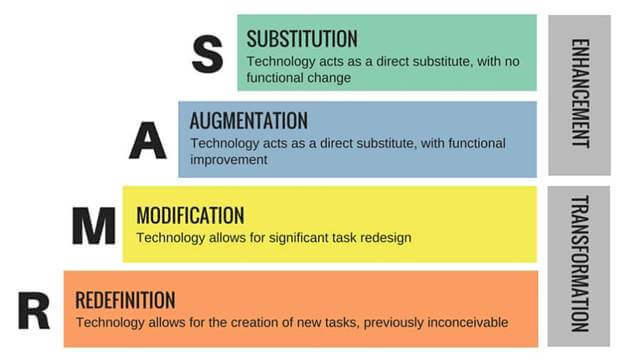

Il modello SAMR

La complessità del panorama attuale richiede framework interpretativi capaci di catturare non solo l’atteggiamento statico verso l’AI, ma la sua evoluzione qualitativa in relazione ai diversi livelli di integrazione tecnologica (Stein et al., 2024). Le ricerche esistenti si limitano prevalentemente a misurazioni dicotomiche (accettazione/rifiuto) o scale lineari di atteggiamento, senza cogliere le sfumature processuali dell’adozione tecnologica. La letteratura evidenzia la necessità di modelli multidimensionali che possano identificare i diversi pattern di approccio all’AI in termini di predisposizione alla trasformazione dei processi lavorativi e cognitivi.

Il modello SAMR (Substitution, Augmentation, Modification, Redefinition), sviluppato da Ruben Puentedura nel 2006 e formalizzato nel 2010, rappresenta un framework gerarchico originariamente concepito per l’integrazione tecnologica in ambito educativo (Puentedura, 2010). Il modello delinea quattro livelli progressivi di utilizzo della tecnologia che influenzano i processi di insegnamento e apprendimento.

- Il livello Substitution (Sostituzione) prevede la sostituzione diretta degli strumenti tradizionali con tecnologie digitali senza modificazioni funzionali sostanziali – ad esempio, sostituire una macchina da scrivere con un word processor mantenendo le stesse modalità di scrittura.

- Il livello Augmentation (Aumento) introduce miglioramenti funzionali ai metodi tradizionali attraverso features aggiuntive che incrementano l’efficienza – come l’utilizzo di spell-check e formatting automatico nel word processing.

- Il livello Modification (Modifica) consente trasformazioni significative delle attività che alterano sostanzialmente i processi operativi – ad esempio, l’utilizzo di strumenti collaborativi online che modificano le dinamiche di scrittura condivisa.

- Il livello Redefinition (Ridefinizione) reinventa completamente le esperienze, abilitando attività precedentemente inconcepibili – come la creazione di contenuti multimediali interattivi che integrano testo, video, audio e elementi di realtà aumentata (Boateng & Kalonde, 2024; Uke et al., 2024; Lestari & Munir, 2022).

Il modello SAMR presenta caratteristiche metodologiche particolarmente rilevanti per lo studio degli atteggiamenti verso l’AI. La struttura gerarchica implica una progressione qualitativa che va dalla semplice sostituzione tecnologica alla trasformazione radicale dei processi. Questa progressione riflette diversi framework epistemologici nel concepire il rapporto uomo-tecnologia: dai livelli “Enhancement” (Substitution e Augmentation), dove la tecnologia potenzia pratiche esistenti, ai livelli “Transformation” (Modification e Redefinition), dove la tecnologia riconfigura ontologicamente l’attività umana. La distinzione tra Enhancement e Transformation risulta particolarmente pertinente nell’analisi degli atteggiamenti generazionali verso l’AI, poiché riflette concezioni radicalmente diverse del ruolo della tecnologia nell’esperienza umana.

L’applicazione del modello SAMR al dominio dell’atteggiamento verso l’AI richiede una ricontestualizzazione teorica significativa. Mentre il modello originale si focalizza sull’integrazione tecnologica come variabile dipendente, la presente ricerca lo utilizza come framework interpretativo per categorizzare orientamenti attitudinali verso l’intelligenza artificiale.

Questa trasposizione concettuale permette di operazionalizzare quattro differenti approcci all’AI nel contesto lavorativo:

- un approccio sostitutivo, dove l’AI viene percepita come rimpiazzo diretto di specifiche funzioni umane;

- un approccio aumentativo, dove l’AI potenzia capacità esistenti senza alterare i processi fondamentali;

- un approccio modificativo, dove l’AI trasforma significativamente le modalità operative;

- un approccio ridefinitivo, dove l’AI abilita nuove forme di attività precedentemente impensabili.

Questa ricontestualizzazione del modello SAMR come sistema di categorizzazione attitudinale presenta vantaggi metodologici rilevanti. La struttura gerarchica fornisce un continuum interpretativo che supera le limitazioni delle scale dicotomiche, consentendo di catturare sfumature qualitative nell’orientamento verso l’AI. La distinzione tra livelli Enhancement e Transformation offre un criterio di demarcazione teoricamente fondato tra atteggiamenti conservativi e trasformativi. L’operazionalizzazione attraverso i quattro livelli SAMR permette di codificare sistematicamente le rappresentazioni soggettive emergenti dalle interviste qualitative, facilitando l’analisi comparativa tra gruppi generazionali.

L’ipotesi centrale della ricerca postula che i quattro livelli del modello SAMR possano sintetizzare efficacemente l’atteggiamento nei confronti dell’AI, identificando pattern generazionali distintivi nella concezione del rapporto uomo-intelligenza artificiale. Specificatamente, si ipotizza che le generazioni anziane si concentrino prevalentemente sui livelli Enhancement (Substitution e Augmentation), riflettendo un approccio conservativo che preserva l’architettura dei processi esistenti, mentre le generazioni giovani privilegino i livelli Transformation (Modification e Redefinition), indicando una propensione verso la riconfigurazione radicale delle pratiche lavorative e cognitive attraverso l’AI.

Obiettivo della ricerca: analizzare il divario generazionale nell’atteggiamento verso l’IA

La presente ricerca esplorativa si propone di analizzare il divario generazionale nell’atteggiamento verso l’intelligenza artificiale nel contesto lavorativo, utilizzando il modello SAMR come framework interpretativo per identificare pattern qualitativi di integrazione tecnologica. L’obiettivo principale è mappare le rappresentazioni soggettive dell’AI attraverso i quattro livelli gerarchici del modello SAMR (Substitution, Augmentation, Modification, Redefinition), al fine di caratterizzare gli orientamenti generazionali prevalenti e identificare i fattori che mediano la transizione da approcci conservativi (Enhancement) a trasformativi (Transformation).

Lo studio adotta una prospettiva fenomenologico-interpretativa per esplorare come diverse coorti generazionali (under 25 vs. over 50) concettualizzano la relazione uomo-AI nei processi lavorativi, con particolare attenzione alle dimensioni di fiducia, controllo, identità professionale e percezione dei rischi etici. La ricerca mira a superare le limitazioni delle dicotomie di atteggiamento verso l’AI (Zhang & Dafoe, 2019; Gnambs et al., 2025) attraverso un processo che conduca ad una categorizzazione multidimensionale che catturi le sfumature qualitative dell’adozione tecnologica.

Domande di ricerca

Domanda principale: Come si distribuiscono i gruppi generazionali (under 25 vs. over 50) attraverso i quattro livelli del modello SAMR nell’atteggiamento verso l’intelligenza artificiale, e quali pattern linguistici e concettuali caratterizzano gli approcci Enhancement versus Transformation?

La domanda secondaria: Quali caratteristiche individuali e contestuali permettono ad alcuni partecipanti di trascendere i pattern generazionali prevalenti, suggerendo fattori di mediazione del divario tecnologico?

L’approccio esplorativo consente di generare insights teorici per la comprensione del fenomeno senza pretese di generalizzazione statistica, contribuendo allo sviluppo di framework concettuali per future ricerche quantitative e interventi formativi differenziati per generazione.

Metodologia della ricerca

La ricerca adotta un disegno qualitativo di tipo fenomenologico-interpretativo, orientato all’esplorazione delle rappresentazioni soggettive e dei significati attribuiti all’intelligenza artificiale da parte di diversi gruppi generazionali. L’approccio metodologico si basa sui principi della Grounded Theory (Strauss & Corbin, 1998) per la generazione di categorie teoriche emergenti dai dati, integrata con tecniche di analisi del contenuto qualitativa (Mayring, 2014) per la sistematizzazione dei pattern tematici.

Il framework teorico di riferimento combina il Technology Acceptance Model (TAM) sviluppato da Davis (1986), che analizza i fattori cognitivi dell’accettazione tecnologica, con la Uses and Gratification Theory (UGT) di Katz et al. (1973), che esamina le motivazioni d’uso e le gratificazioni ricercate dagli utenti. Il modello SAMR (Puentedura, 2006) viene utilizzato come sistema di codifica per operazionalizzare i diversi livelli di integrazione tecnologica e categorizzare gli orientamenti attitudinali verso l’AI.

Partecipanti

Lo studio utilizza una strategia di campionamento ragionato (purposive sampling) di tipo stratificato per età, combinata con selezione a valanga (snowball sampling) per garantire diversità di background professionali e esperienze. La stratificazione generazionale mira a massimizzare il contrasto teorico tra coorti con differente esposizione alle tecnologie digitali e diverse fasi del ciclo di vita professionale.

Il campione finale è composto da 38 partecipanti, equamente distribuiti per genere (21 uomini, 55.3%; 17 donne, 44.7%) e bilanciati tra i due gruppi generazionali target. La distribuzione geografica include 33 partecipanti (86.8%) provenienti dall’Area Metropolitana di Roma e 5 partecipanti (13.2%) dalla Provincia di Roma. La composizione professionale del campione comprende studenti (31.6%, n = 12), lavoratori dipendenti (42.1%, n = 16), liberi professionisti (15.8%, n = 6) e pensionati (10.5%, n = 4).

I due gruppi generazionali presentano le seguenti caratteristiche demografiche:

- Gruppo Under 25: 18 partecipanti con età media di 21.83 anni (DS = 3.25), range 17-25 anni

- Gruppo Over 50: 20 partecipanti con età media di 60.05 anni (DS = 6.83), range 51-72 anni

Strumenti

È stato sviluppato un protocollo di intervista semi-strutturata della durata di 45-55 minuti, articolato in quattro sezioni tematiche principali:

- Rappresentazioni mentali dell’AI: esplorazione di associazioni spontanee, definizioni personali e metafore utilizzate per concettualizzare l’intelligenza artificiale

- Esperienze d’uso concrete: indagine dell’utilizzo quotidiano e professionale dell’AI, con focus su episodi significativi e pratiche consolidate

- Percezione di benefici e rischi: valutazione critica delle opportunità e minacce associate all’AI, incluse preoccupazioni etiche e sociali

- Scenari futuri: reazioni a tre scenari lavorativi standardizzati per valutare l’orientamento verso diverse modalità di implementazione dell’AI

Per valutare le reazioni all’implementazione dell’AI in contesti lavorativi specifici, sono stati presentati tre scenari standardizzati:

Scenario A – Call Center Assicurativo: “Immagini di lavorare in un call center di una compagnia assicurativa. L’azienda introduce un sistema di AI che può: analizzare in tempo reale il tono di voce del cliente per suggerire le risposte più appropriate, compilare automaticamente i moduli durante la chiamata, e proporre soluzioni personalizzate basate sulla storia del cliente. Come pensa che cambierebbe il suo lavoro?”

Scenario B – Ufficio Contabilità: Implementazione di sistemi AI per automazione dell’elaborazione di documenti fiscali e identificazione di anomalie nei bilanci aziendali.

Scenario C – Redazione Giornalistica: Utilizzo di AI per monitoraggio automatico delle notizie e generazione di bozze di articoli giornalistici.

La selezione degli scenari è stata guidata da criteri di rilevanza nel contesto romano, diversificazione settoriale e capacità di evocare reazioni sia positive (efficienza, supporto) che negative (controllo algoritmico, sostituzione).

Analisi dei dati

Per garantire l’affidabilità della codifica secondo il modello SAMR, è stato implementato un sistema di valutazione multi-giudice con tre esperti indipendenti. Tutti i giudici hanno ricevuto formazione specifica sui quattro livelli del modello SAMR e sui criteri di distinzione tra Enhancement (Substitution/Augmentation) e Transformation (Modification/Redefinition).

La codifica indipendente dei protocolli di intervista ha raggiunto un accordo inter-rater sostanziale (κ di Fleiss = 0.68), con il 44,7% di accordo completo tra i tre giudici e 42,1% di accordo parziale. I casi di disaccordo parziale sono stati risolti attraverso discussione collegiale fino al raggiungimento del consenso.

L’analisi delle trascrizioni ha seguito un approccio di codifica tematica induttiva, procedendo dalle unità di significato elementari verso l’identificazione di pattern tematici ricorrenti. L’analisi quantitativa ha utilizzato test statistici appropriati per il tipo di variabili: test del Chi-quadrato per l’associazione tra variabili categoriali (gruppo di età e livello SAMR), correlazione di Spearman per variabili ordinali (età anagrafica e livello SAMR), e calcolo dell’effect size tramite Cramér’s V per quantificare la forza dell’associazione. L’analisi è stata supportata da software di analisi testuale per l’identificazione di costellazioni terminologiche distintive tra i gruppi generazionali.

Risultati

L’analisi dei dati raccolti attraverso le 38 interviste semi-strutturate ha rivelato pattern distintivi tra i due gruppi generazionali, evidenziando differenze significative nella distribuzione attraverso i livelli del modello SAMR e nell’articolazione delle rappresentazioni cognitive dell’intelligenza artificiale.

Distribuzione dei livelli SAMR

L’analisi quantitativa della codifica SAMR ha evidenziato una distribuzione generazionale marcata ma non assoluta attraverso i quattro livelli del modello. I risultati mostrano una chiara tendenza dei gruppi generazionali a concentrarsi su diversi segmenti della gerarchia SAMR.

Il gruppo Over 50 (n = 20) si concentra prevalentemente sui livelli di Substitution (45.00%, n = 9) e Augmentation (35.00%, n = 7), rappresentando complessivamente l’80.00% del gruppo nei livelli Enhancement. Una presenza significativa emerge nel livello Modification (20.00%, n = 4), mentre nessun partecipante over 50 raggiunge il livello Redefinition.

Il gruppo Under 25 (n = 18) presenta una distribuzione differente ma non radicalmente opposta, con una prevalenza nei livelli trasformativi di Modification (33.33%, n = 6) e Redefinition (27.78%, n = 5), per un totale del 61.11% nei livelli Transformation. Una presenza non trascurabile si registra nei livelli Substitution (16.67%, n = 3) e Augmentation (22.22%, n = 4), indicando maggiore eterogeneità intra-generazionale di quanto inizialmente ipotizzato.

L’analisi statistica attraverso il test del Chi-quadrato ha confermato l’associazione significativa tra gruppo di età e livello di adozione dell’AI (χ²(3) = 16.77, p = 0.0008). L’effect size, misurato tramite il Cramér’s V = 0.664, indica un effetto importante dell’età sulla distribuzione dei livelli SAMR. L’analisi di correlazione di Spearman (appropriata per variabili ordinali) rivela una correlazione negativa moderata tra età anagrafica e livello SAMR (ρ = -0.48, p = 0.002), indicando una tendenza significativa, con ampia variabilità individuale che suggerisce l’influenza di fattori mediatori oltre l’età anagrafica.

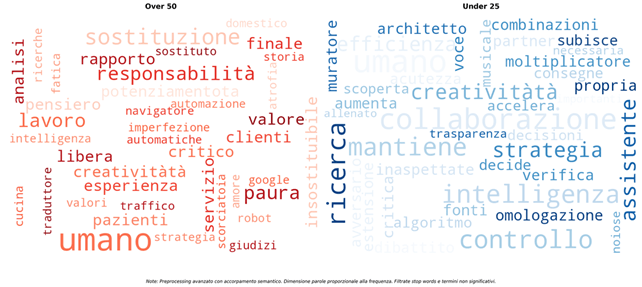

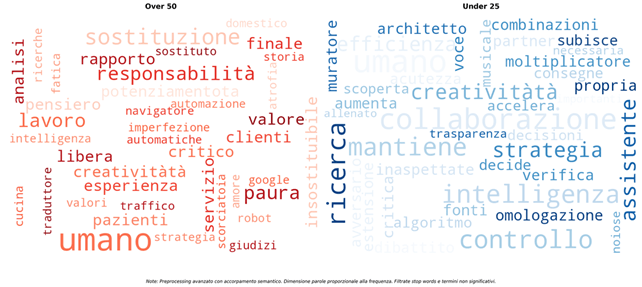

Analisi testuale e pattern linguistici

L’analisi testuale delle trascrizioni ha rivelato costellazioni terminologiche distintive tra i due gruppi generazionali. L’analisi automatica del contenuto linguistico ha identificato pattern lessicali ricorrenti che riflettono framework epistemologici divergenti nella concettualizzazione dell’AI.

Analisi tematica

Dall’analisi induttiva delle trascrizioni sono emersi sei temi principali che articolano la natura del divario generazionale nell’atteggiamento verso l’AI. L’identificazione di questi temi è avvenuta attraverso codifica iterativa fino al raggiungimento della saturazione teorica, con particolare attenzione all’emergere di casi “ponte” che dimostrano la complessità del fenomeno oltre le semplificazioni generazionali.

Paura della sostituzione versus ricerca del potenziamento

Il primo tema rappresenta la dimensione più polarizzante emersa dall’analisi, evidenziando concezioni radicalmente divergenti del ruolo dell’AI nei processi lavorativi. Per la maggioranza del gruppo Over 50, l’intelligenza artificiale viene percepita attraverso una lente di minaccia esistenziale al ruolo professionale consolidato. Marco (58 anni, impiegato) articola chiaramente questa preoccupazione: “Boh, se fa tutto lei… io che ci sto a fare? Ho lavorato trent’anni qui, conosco i clienti a memoria. Ma se la macchina fa tutto meglio di me… mah, non lo so. Mi fa un po’ paura, ecco.”

Tuttavia, emergono figure “ponte” significative che trascendono i pattern generazionali prevalenti. Antonio (52 anni, medico), pur appartenendo al gruppo Over 50, adotta un paradigma chiaramente integratista: “L’AI potrebbe liberarmi da tutta la parte burocratica che mi porta via tempo prezioso con i pazienti. […] Mi restituirebbe al mio vero lavoro: fare il medico, ascoltare i pazienti, visitarli.”

Per la maggioranza del gruppo Under 25, il paradigma dominante è quello dell’integrazione e del potenziamento cognitivo. Giulia (21 anni, studentessa) articola questa visione con chiarezza:

“Per me è tipo… come avere un super assistente sempre disponibile. Mi aiuta un sacco a studiare, a capire le cose difficili. È figo, non so come spiegarlo.”

Valore dell’esperienza e dell’imperfezione umana

Il secondo tema evidenzia differenze fondamentali nella percezione del valore dell’expertise umana e dei processi di acquisizione delle competenze. La maggioranza degli Over 50 mantiene un forte attaccamento al valore dell’esperienza umana e della fatica come elementi costitutivi del valore professionale. Roberto (65 anni, ex artigiano) esprime questa filosofia: “Per me il valore di un mobile sta nella fatica che ci metti, nell’imperfezione che lo rende unico. Queste intelligenze artificiali… mi sembrano una scorciatoia. Fanno tutto subito, senza sudore, senza errori. Ma un mobile fatto dalla macchina vale quanto uno fatto a mano? Per me no.”

Paolo (63 anni, ex commerciale) rappresenta un caso ponte interessante, combinando valorizzazione dell’esperienza con apertura all’integrazione tecnologica: “Io ho esperienza, so come trattare con le persone, conosco i trucchi del mestiere. Se la macchina mi dà le informazioni giuste al momento giusto, posso usare la mia esperienza in modo più mirato. Il responsabile resto io, l’AI è solo uno strumento.”

I giovani sono generalmente più focalizzati sul risultato e sulla capacità dell’AI di generare nuove possibilità creative. Sofia (19 anni, designer) trova valore proprio nell’inaspettato:

“È incredibile come possa combinare stili diversi in modi inaspettati. Poi prendo queste ispirazioni e le sviluppo a modo mio, con la mia sensibilità.”

Tema 3: Trasformazione del processo versus sostituzione del compito

Il terzo tema rivela differenze nella concettualizzazione dell’integrazione dell’AI: approccio task-oriented versus process-oriented. La maggioranza degli Over 50 tende a descrivere l’uso dell’AI in termini di sostituzione di compiti discreti e specifici. Marco (58 anni) esemplifica questo approccio:

“Uso già alcune cose, […] Ma sono strumenti, ecco. Li uso quando mi servono.”

Clara (55 anni, avvocato) rappresenta un’eccezione significativa nel suo gruppo generazionale, descrivendo una vera trasformazione del processo lavorativo: “Se l’AI può aiutarmi a fare ricerche […] più velocemente, a trovare precedenti rilevanti, a redigere bozze di contratti standard… ben venga! Il mio valore aggiunto non sta nel copiare […], ma nell’interpretarli, nel costruire strategie difensive.”

Per la maggioranza degli Under 25, l’AI trasforma l’intero processo cognitivo e operativo. Beatrice (25 anni, ricercatrice) articola questa visione: “L’AI sta rivoluzionando la ricerca. […] può vedere cose invisibili. Accelera incredibilmente il processo di scoperta. Nel bene e nel male.”

Ruolo della fiducia e del controllo

Il quarto tema identifica la fiducia come variabile chiave che modula l’adozione dell’AI, con pattern generazionali distintivi nella gestione del controllo. Negli Over 50, la fiducia è generalmente bassa e fortemente condizionata da meccanismi di verifica. Marco (58 anni) esprime questa cautela: “Il traduttore lo rileggo sempre dieci volte prima di inviare una mail.”

Antonio (52 anni, medico) mostra una fiducia più elevata ma sempre controllata e responsabilizzata: “È come avere un consulto con un collega molto preparato, ma la responsabilità finale resta mia.”

Nei giovani, la fiducia è generalmente più alta ma non acritica. Giulia (21 anni) descrive un approccio pragmatico: “Uso ChatGPT tutti i giorni per studiare, non per copiare, eh! Ma per capire meglio i concetti. […] Poi vado a verificare […] e approfondisco. Mi faccio spiegare le cose, chiedendo un linguaggio semplice e mi faccio dare delle ‘dritte’ per memorizzare.”

Luca (20 anni, studente) mostra un approccio particolarmente sofisticato alla gestione della relazione con l’AI: “Uso l’AI come uso un avversario in un dibattito. Le pongo domande complesse, la sfido […], la uso per testare le mie argomentazioni. Non per farmi dare le risposte, ma per aumentare la mia […] critica.”

Implicazioni sociali ed etiche

Il quinto tema evidenzia come entrambi i gruppi mostrino consapevolezza dei rischi etici e sociali associati all’AI, ma con accenti e priorità differenti. Gli Over 50 si concentrano maggiormente sulla sostituzione lavorativa e sulla perdita di competenze umane fondamentali. Franco (72 anni, ex insegnante) esprime questa preoccupazione: “L’apprendimento non è solo acquisire informazioni, è sviluppare il pensiero critico, imparare a ragionare. Se gli studenti si abituano a far fare tutto all’AI, che ne sarà della loro capacità di pensare autonomamente?”

Gli Under 25 sono più sensibili a temi sistemici come i bias algoritmici e l’omologazione culturale. Elena (24 anni, social media manager) articola questa preoccupazione: “Se tutti usiamo gli stessi algoritmi, i contenuti rischiano di diventare tutti uguali. E poi c’è il problema della verifica delle fonti: l’AI può amplificare fake news se non stai attento.”

Ridefinizione dell’identità professionale

Il sesto tema rivela le differenze più profonde ma anche le convergenze più interessanti nella rinegoziazione dell’identità professionale. Per la maggioranza degli Over 50, l’AI rappresenta una potenziale minaccia a un’identità professionale consolidata nel tempo. Luigi (59 anni, ex operaio) esprime questa angoscia identitaria: “Trent’anni di fabbrica mi hanno insegnato a sentire quando una macchina non va bene, a capire i problemi prima che diventino gravi. Se l’AI fa tutto, questa esperienza dove va a finire?”

Tuttavia, figure come Antonio (52 anni) e Clara (55 anni) vedono l’AI come opportunità per concentrarsi sugli aspetti più specificatamente umani del loro lavoro professionale.

Per la maggioranza degli Under 25, l’AI è un elemento costitutivo della loro identità professionale in formazione. Sofia (19 anni) articola questa visione: “Il valore aggiunto diventa la tua capacità di connetterti con le persone. […] Il mio valore non risiede più solo nel ‘saper disegnare’, ma nel ‘saper dialogare con questi strumenti’.”

L’analisi ha rivelato alcuni ulteriori pattern. Tre partecipanti Under 25 (17%) hanno mostrato atteggiamenti marcatamente conservativi verso l’AI, spesso legati a esperienze negative con algoritmi o preoccupazioni per la privacy. Similmente, quattro partecipanti Over 50 (20%) hanno dimostrato entusiasmo per le potenzialità trasformative dell’AI, particolarmente in ambiti dove percepiscono benefici diretti per la qualità del servizio (sanità, educazione).

Inoltre, è emersa una dimensione trasversale legata al “controllo percepito”: partecipanti di entrambe le generazioni che hanno esperienza diretta di progettazione o gestione di sistemi tecnologici mostrano atteggiamenti più sfumati e meno polarizzati, indipendentemente dall’età. Questo suggerisce che la familiarità con i meccanismi tecnologici possa essere un mediatore più forte dell’età anagrafica nell’atteggiamento verso l’AI.

Analisi degli scenari standardizzati

L’analisi delle reazioni ai tre scenari lavorativi standardizzati conferma e approfondisce i pattern tematici emersi dall’analisi qualitativa generale. Gli scenari hanno funzionato come stimoli proiettivi, elicitando risposte che evidenziano le differenze generazionali negli orientamenti verso l’implementazione dell’AI.

Scenario Call Center: Il 58% degli Over 50 (n = 12) esprime preoccupazione per la sostituzione del ruolo umano, mentre il 67% degli Under 25 (n = 12) identifica opportunità di miglioramento del servizio. Tuttavia, il 25% degli Over 50 mostra interesse per gli aspetti di supporto, mentre il 22% degli Under 25 esprime preoccupazioni per il controllo algoritmico, evidenziando maggiore complessità attitudinale di quanto le tendenze generali suggeriscano. Marco (58 anni) reagisce con ansia manifesta: “Questo è esattamente quello che temo”, mentre Giulia (21 anni) risponde con entusiasmo: “[…] invece di perdere tempo con le procedure burocratiche, potresti concentrarti davvero sul cliente.”

Le reazioni agli scenari B e C seguono pattern analoghi.

Conclusioni

La presente ricerca conferma e approfondisce le tendenze identificate in letteratura riguardo al divario generazionale nell’atteggiamento verso l’Intelligenza Artificiale, evidenziando una marcata differenza tra over 50 e under 25 che si sostanzia, in linea con la letteratura, con atteggiamenti profondamenti diversi (Chan & Lee, 2023; Alabbad et al., 2025) che generano pattern linguistici e costellazioni terminologiche profondamente diverse.

Il modello SAMR si è rivelato uno strumento interpretativo efficace per analizzare l’atteggiamento verso l’AI, evidenziando un approccio essenzialmente “sostitutista” da parte degli over 50 e “integratista” da parte dei giovani. Questa dicotomia, tuttavia, non deve essere interpretata in modo rigido: l’emergere di figure “ponte” suggerisce la presenza di traiettorie evolutive più complesse e sfumate.

L’approccio sostitutista si caratterizza per una visione dell’AI come alternativa all’essere umano, generando ansie esistenziali legate alla perdita di ruolo e identità professionale. Al contrario, l’approccio integratista concepisce l’AI come supporto e amplificazione delle competenze umane, in una prospettiva di co-evoluzione cognitiva. Questa differenza fondamentale riflette non solo diverse competenze digitali, ma soprattutto differenti framework epistemologici nel concepire la relazione uomo-macchina.

I giovani sembrano naturalmente predisposti verso quello che può essere definito un paradigma di “orchestrazione cognitiva”, dove il valore umano risiede nella capacità di dirigere, integrare e valorizzare le capacità dell’AI. Questa prospettiva richiama il concetto di “competenze centauriche” (Laudadio, 2025a), abilità ibride che emergono dalla fusione sinergica tra capacità umane e artificiali. Come nel mito del centauro, dove la forza del cavallo si unisce all’intelligenza umana, le competenze centauriche rappresentano una nuova forma di capability che trascende la semplice somma delle parti.

Le implicazioni pedagogiche e formative sono profonde. Diventa urgente una riflessione sulla ridefinizione ontologica della pedagogia nell’era dell’AI generativa (Laudadio, 2025b). Stiamo assistendo non a una semplice integrazione tecnologica ma a una trasformazione epistemologica che richiede di ripensare radicalmente cosa significhi apprendere, insegnare e conoscere.

I risultati suggeriscono che le strategie di formazione e accompagnamento all’AI debbano essere profondamente differenziate per generazione. Per gli over 50, è cruciale un approccio che:

- Valorizzi l’esperienza accumulata come asset complementare all’AI

- Demistifichi le paure di sostituzione attraverso esempi concreti di augmentation

- Fornisca scaffolding graduale per sviluppare fiducia nell’interazione con l’AI

- Enfatizzi il ruolo insostituibile del giudizio umano, dell’empatia e della saggezza esperienziale

Per i giovani, invece, la sfida è:

- Sviluppare pensiero critico per non cadere in dipendenza acritica dall’AI

- Mantenere e coltivare competenze fondamentali che rischiano l’atrofia

- Bilanciare l’entusiasmo tecnologico con consapevolezza etica

- Costruire competenze di “orchestrazione cognitiva” che massimizzino la sinergia umano-AI

La ricerca documenta inoltre l’emergere di quello che potremmo definire un “digital divide generazionale di secondo livello”: non più solo accesso e competenze d’uso, ma differenze qualitative nel concepire il rapporto con l’intelligenza artificiale. Questo divide rischia di creare fratture sociali profonde se non affrontato con politiche inclusive e percorsi di alfabetizzazione differenziati.

L’approccio centaurico emerge come prospettiva più promettente per superare la dicotomia sostituzione/integrazione, ma questa prospettiva richiede un cambio di paradigma: dall’AI come minaccia o strumento all’AI come partner cognitivo in una danza evolutiva di reciproco potenziamento.

Le implicazioni per le organizzazioni sono sostanziali. La coesistenza di mindset generazionali così diversi richiede strategie di change management sofisticate che tengano conto non solo delle competenze tecniche ma soprattutto delle dimensioni psicologiche, identitarie ed emotive del cambiamento. Il successo dell’integrazione dell’AI dipenderà dalla capacità di creare ponti tra questi mondi cognitivi, valorizzando sia l’innovazione dei giovani sia la saggezza degli anziani.

In conclusione, la ricerca rivela che il divario generazionale nell’atteggiamento verso l’AI non è semplicemente una questione di competenze digitali o resistenza al cambiamento, ma riflette differenze profonde nel concepire la natura stessa dell’intelligenza, del lavoro e dell’identità umana nell’era delle macchine “pensanti” o percepite come “pensanti”. Il superamento di questo divario richiede non solo formazione tecnica ma un accompagnamento culturale e psicologico che aiuti entrambe le generazioni a navigare questa transizione epocale verso forme di intelligenza ibrida e distribuita. Solo attraverso un dialogo intergenerazionale e un approccio inclusivo potremo realizzare il pieno potenziale della collaborazione umano-AI, evitando che la rivoluzione dell’intelligenza artificiale diventi un fattore di ulteriore frammentazione sociale.

Limiti e sviluppi

Oltre ai tradizionali limiti di una ricerca qualitativa che limita fortemente la generalizzabilità statistica, si aggiungono ulteriori elementi critici di natura metodologica. Il disegno trasversale impedisce di cogliere l’evoluzione temporale degli atteggiamenti verso l’AI, aspetto particolarmente rilevante considerando la rapida trasformazione del panorama tecnologico. La natura fenomenologico-interpretativa, pur consentendo l’approfondimento delle rappresentazioni soggettive, introduce inevitabili elementi di soggettività nell’interpretazione dei dati raccolti. Il campionamento ragionato, necessario per gli obiettivi esplorativi della ricerca, presenta bias di selezione intrinseci. La tecnica snowball utilizzata per garantire diversità di background può aver prodotto cluster omogenei all’interno delle reti sociali dei partecipanti. La numerosità campionaria (n=38), pur adeguata rispetto alla saturazione teorica, risulta insufficiente per analisi statistiche robuste dei sottogruppi e per generalizzazioni quantitative.

La dimensione del campione è insufficiente per garantire una potenza statistica sufficiente a rilevare un effetto reale, per i test utilizzati, aumentando il rischio di commettere errori. La risoluzione postuma dei disaccordi – da parte dei giudici – può avere, inavvertitamente, mascherato ambiguità nel protocollo di codifica e minare l’indipendenza dei giudizi originali. I partecipanti, pur diversificati, sono geograficamente circoscritti alla provincia di Roma. Questa limitazione impedisce di verificare se i pattern emersi siano replicabili in contesti geografici con diverse caratteristiche socio-economiche, culturali e di penetrazione tecnologica. L’uso di scenari ipotetici potrebbe non riflettere completamente le reazioni in contesti reali di implementazione dell’AI. Le risposte ai tre scenari standardizzati (call center, contabilità, redazione) potrebbero essere influenzate dalla desiderabilità sociale o dalla difficoltà dei partecipanti di immaginare concretamente situazioni non vissute direttamente. In ultimo, rispetto ai profili “ponte”, non è stato esplorato perché la loro esperienza professionale, il loro mindset o la loro posizione nel ciclo di vita abbiano permesso loro di trascendere i pattern prevalenti. Il principale limite teorico è legato alla scelta del modello SAMR come framework interpretativo. Il modello implica una progressione gerarchica lineare, ma l’integrazione della tecnologia può essere più complessa, contestuale e non necessariamente sequenziale. Il modello potrebbe enfatizzare eccessivamente il ruolo della tecnologia come variabile determinante, sottovalutando altri fattori psicologici, organizzativi e culturali che influenzano l’atteggiamento verso l’AI.

Il modello SAMR, originariamente sviluppato per l’ambito educativo, presenta problemi di validità ecologica quando applicato a contesti lavorativi diversificati. Il modello non prevedeva una rigorosa verifica empirica delle relazioni proposte, non esistendo criteri standardizzati e validati per determinare i livelli SAMR. È ormai assodato che la stessa tecnologia può funzionare a diversi livelli SAMR a seconda del contesto di implementazione, della formazione degli utenti e delle caratteristiche organizzative.

Il protocollo di intervista semi-strutturata, pur permettendo flessibilità esplorativa, introduce variabilità nella raccolta dati che può influenzare la comparabilità delle risposte tra partecipanti. L’assenza di scale psicometriche validate impedisce la misurazione quantitativa robusta delle dimensioni attitudinali verso l’AI. La codifica dei livelli SAMR, nonostante l’accordo inter-rater sostanziale raggiunto, rimane dipendente dall’interpretazione soggettiva dei giudici. L’analisi tematica, pur seguendo procedure sistematiche, è influenzata dalle prospettive teoriche e potrebbe non cogliere pattern interpretativi alternativi.

La dicotomia “sostitutista vs. integratista” emersa, pur euristicamente utile, rischia di semplificare la complessità delle rappresentazioni soggettive. L’identificazione di “figure ponte” suggerisce pattern più complessi che richiederebbero modelli interpretativi multidimensionali. La concettualizzazione di “generazione” basata esclusivamente sull’età cronologica (under 25 vs. over 50) sottovaluta la variabilità intra-generazionale e l’influenza di altri fattori demografici, professionali e biografici nell’atteggiamento verso l’AI.

Lo sviluppo della ricerca sarà duplice. Da una parte, utilizzare quanto emerso per guidare una strategia di comunicazione più adeguata ai target per la diffusione di corsi di formazione e per facilitare il superamento delle barriere in ingresso. Questo include lo sviluppo di percorsi formativi differenziati per generazione che tengano conto dei diversi framework epistemologici identificati. Dall’altra, l’idea è di realizzare uno strumento psicometrico validato che sia in grado di cogliere la fase di atteggiamento del soggetto rispondente rispetto all’AI. Tale strumento dovrebbe superare i limiti del modello SAMR attraverso una concettualizzazione multidimensionale che integri variabili cognitive, affettive e comportamentali. Ulteriori sviluppi includeranno: replicazione della ricerca in contesti geografici diversificati; studio longitudinale per tracciare l’evoluzione degli atteggiamenti; approfondimento delle “figure ponte” per comprendere i fattori di mediazione del divario generazionale; analisi settoriale per identificare specificità professionali nell’atteggiamento verso l’AI.

Bibliografia

Alabbad, F., Almeneessier, A., Alshalan, M., & Aljarba, M. (2025). Knowledge, attitude, and practice of artificial intelligence among doctors and medical students in Saudi Arabia. Journal of Family Medicine and Primary Care, 14(4), 1459-1464. https://doi.org/10.4103/jfmpc.jfmpc_1812_24

Al-Omari, O., Alyousef, A., Fati, S., Shannaq, F., & Omari, A. (2025). Governance and ethical frameworks for AI integration in higher education: Enhancing personalized learning and legal compliance. Journal of Ecohumanism, 4(2), 80–86. https://doi.org/10.62754/joe.v4i2.5781

Alruwaili, M., Abuadas, F., Alsadi, M., Alruwaili, A., Ramadan, O., Shaban, M., & Arab, R. (2024). Exploring nurses’ awareness and attitudes toward artificial intelligence: Implications for nursing practice. Digital Health, 10. https://doi.org/10.1177/20552076241271803

Atkinson, K., Barnes, J., Albee, J., Anttila, P., Haataja, J., Nanavati, K., Steelman, K., & Wallace, C. (2016). Breaking barriers to digital literacy: An intergenerational social-cognitive approach. In Proceedings of the 18th International ACM SIGACCESS Conference on Computers and Accessibility (pp. 239–244). New York, NY: Association for Computing Machinery. https://doi.org/10.1145/2982142.2982183

Barna Group. (2024, January 24). Hesitant & hopeful: How different generations view artificial intelligence. Retrieved from https://www.barna.com/research/generations-ai/

Beaney, P., Kalirai, H. S., & Chambers, R. (2020). Alexa… what pills do I need to take today? Prescriber, 31(6), 20–23.

Boateng, S., & Kalonde, G. (2024). Exploring the synergy of the SAMR (substitution, augmentation, modification, and redefinition) model and technology integration in education: The key to unlocking student engagement and motivation. Proceedings of the International Conference on Advanced Research in Education, Teaching, and Learning, 1(1), 37-46. https://doi.org/10.33422/aretl.v1i1.185

Bonilla, K., & Martin-Hammond, A. (2020). Older adults’ perceptions of intelligent voice assistant privacy, transparency, and online privacy guidelines. In Sixteenth Symposium on Usable Privacy and Security (SOUPS 2020).

Chan, C. K. Y., & Lee, K. K. W. (2023). The AI generation gap: Are Gen Z students more interested in adopting generative AI such as ChatGPT in teaching and learning than their Gen X and millennial generation teachers? Smart Learning Environments, 10(1). https://doi.org/10.1186/s40561-023-00269-3

Cinalioglu, K., Elbaz, S., Sekhon, K., & Sekhon, H. (2022). Exploring younger versus older Canadians’ perceptions of the use of AI in healthcare [Conference abstract]. The American Journal of Geriatric Psychiatry, 30(4), S124–S125. https://doi.org/10.1016/j.jagp.2022.01.031

Davis, F. D. (1986). A technology acceptance model for empirically testing new end-user information systems: Theory and results (Doctoral dissertation). MIT Sloan School of Management, Cambridge, MA.

Gnambs, T., Stein, J., Zinn, S., Griese, F., & Appel, M. (2025). Attitudes, experiences, and usage intentions of artificial intelligence: A population study in Germany. https://doi.org/10.31234/osf.io/6u49f

Isbanner, S., O’Shaughnessy, P., Steel, D., Wilcock, S., & Carter, S. (2022). The adoption of artificial intelligence in health care and social services in Australia: Findings from a methodologically innovative national survey of values and attitudes (the AVA-AI study). Journal of Medical Internet Research, 24(8), e37611. https://doi.org/10.2196/37611

Jussupow, E., Spohrer, K., & Heinzl, A. (2022). Identity threats as a reason for resistance to artificial intelligence: Survey study with medical students and professionals. JMIR Formative Research, 6(3), e28750. https://doi.org/10.2196/28750

Katz, E., Blumler, J. G., & Gurevitch, M. (1973). Uses and gratifications research. Public Opinion Quarterly, 37(4), 509–523. https://doi.org/10.1086/268109

Kaur, A., & Chen, W. (2023). Exploring AI literacy among older adults. Studies in Health Technology and Informatics, 306, 9–16. https://doi.org/10.3233/SHTI230589

Kowalski, J., Jaskulska, A., Skorupska, K., Abramczuk, K., Biele, C., Kopeć, W., & Marasek, K. (2019). Older adults and voice interaction: A pilot study with Google Home. In Extended Abstracts of the 2019 CHI Conference on Human Factors in Computing Systems (pp. 1–6).

Laudadio, A. (2025a, 23 giugno). AI e competenze umane: verso l’intelligenza “centaurica”. Agenda Digitale. Retrieved from https://www.agendadigitale.eu/cultura-digitale/competenze-digitali/ai-e-competenze-umane-verso-lintelligenza-centaurica/

Laudadio, A. (2025b). Ehi ChatGPT, ridefinisci ontologicamente la pedagogia e la formazione! Lifelong, Lifewide Learning (LLL), 23(46), 15-27.

Lester, S., & Hofmann, J. (2020). Some pedagogical observations on using augmented reality in a vocational practicum. British Journal of Educational Technology, 51(3), 645-656. https://doi.org/10.1111/bjet.12901

Lestari, S. A., & Munir, A. (2022). The use of the SAMR model to improve students speaking ability. English Education Journal, 12(4), 694-704. https://doi.org/10.15294/eej.v12i4.70246

Mayring, P. (2014). Qualitative content analysis: Theoretical foundation, basic procedures and software solution. Klagenfurt. Retrieved from http://nbn-resolving.de/urn:nbn:de:0168-ssoar-395173

Nguyen, T., & Connolly, R. (2025). Employees’ justice perceptions and trust in AI systems for performance evaluation: Uncovering the role of gender and culture. In Proceedings of the 58th Hawaii International Conference on System Sciences. Retrieved from https://hdl.handle.net/10125/109657

Nguyen, V. K. (2025). The use of generative AI tools in higher education: Ethical and pedagogical principles. Retrieved from https://ssrn.com/abstract=5003394

Ost Mor, S., Wittenberg, N., & Birati, Y. (2024). I? AI? Exploring artificial intelligence usage, personality and other characteristics in older adults. Innovation in Aging, 2024. https://doi.org/10.1093/geroni/igae098.4213

Puentedura, R. R. (2006). Transformation, technology, and education [Blog post]. Retrieved from http://hippasus.com/resources/tte/

Puentedura, R. R. (2010). SAMR and TPCK: A hands-on approach to classroom practice. Retrieved from http://www.hippasus.com/rrpweblog/archives/000049.html

Racine, N., Chow, C., Hamwi, L., Bucsea, O., Cheng, C., Du, H., … Riddell, R. P. (2024). Health care professionals’ and parents’ perspectives on the use of AI for pain monitoring in the neonatal intensive care unit: Multisite qualitative study. JMIR AI, 3, Article e51535. https://doi.org/10.2196/51535

Sell, A., Makkonen, M., Walden, P., & Dahlberg, T. (2025). Introduction to the Minitrack on Age and Generational Aspects in Technology Acceptance and Use. In T. X. Bui (Ed.), Proceedings of the 58th Hawaii International Conference on System Sciences, HICSS 2025 (pp. 802-803). (Proceedings of the Annual Hawaii International Conference on System Sciences). Hawaii International Conference on System Sciences. https://doi.org/10.24251/HICSS.2025.095

Shandilya, E., & Fan, M. (2022). Understanding older adults’ perceptions and challenges in using AI-enabled everyday technologies. In Proceedings of the Tenth International Symposium of Chinese CHI (pp. 105-116).

Stein, J., Messingschlager, T., Gnambs, T., Hutmacher, F., & Appel, M. (2024). Attitudes towards AI: Measurement and associations with personality. Scientific Reports, 14(1). https://doi.org/10.1038/s41598-024-53335-2

Strauss, A., & Corbin, J. (1998). Basics of qualitative research: Techniques and procedures for developing grounded theory. Thousand Oaks, CA: Sage Publications.

Umar Baki, N., & Mohd Yusri, A. B. (2024). Gen-X to Zoomers: A systematic review on intergenerational digital tensions during digitalisation. Journal of Public Administration and Governance, 14(2S), 97–113. https://doi.org/10.5296/jpag.v14i2S.22591

Uke, W. A. S., Noni, N., Basri, M., & Muhammad, A. P. A. (2024). Enhancing language learning: Exploring TELL implementation in integrated intensive course through the SAMR model. Asian Journal of Education and Social Studies, 50(10), 392-404. https://doi.org/10.9734/ajess/2024/v50i101630

Yamashita, T., Narine, D., Chidebe, R. C. W., Kramer, J. W., Karam, R., Cummins, P. A., & Smith, T. J. (2024). Digital skills, STEM occupation, and job automation risks among the older workers in the United States. The Gerontologist, 2024. https://doi.org/10.1093/geront/gnae069

Zhang, B., & Dafoe, A. (2019). Artificial intelligence: American attitudes and trends. Available at SSRN 3312874.

Zhengkun, Z., Chuhao, G., Shenhui, S., Junhao, W., Jia, W., & Wenrui, L. (2025). L’accettazione della tecnologia e l’esperienza di servizio degli utenti anziani con gli strumenti di traduzione assistita. Journal of Management World, 2025(1), 467-472. https://doi.org/10.53935/jomw.v2024i4.715

Zubair, N., Hashmat, S., & Aimen, U. (2025). Artificial intelligence and the generational divide: A study on trust and acceptance. Annual Methodological Archive Research Review, 3(6), 19–44. https://doi.org/10.63075/s0a9ec84