Negli ultimi anni l’intelligenza artificiale analogamente a quanto sta avvenendo in molte altre discipline, è entrata con forza tra le tecnologie essenziali delle telecomunicazioni e in generale delle infrastrutture digitali, come soluzione alle crescenti esigenze di gestione della complessità, di efficienza e di resilienza.

In particolare oggi, nel contesto delle reti di nuova generazione e per le funzioni di sviluppo, esercizio e manutenzione (Operations o Ops), l’introduzione massiva dell’intelligenza artificiale, cui ci si riferisce con il termine AIOps, è basata sull’evoluzione naturale delle architetture di observability e automation verso un modello operativo in grado di minimizzare l’intervento umano e capace di apprendere costantemente, anticipare e adattarsi.

Le reti moderne sono ormai sistemi fondati sul software, distribuiti, multi-dominio e abilitati ambienti di computing ad alte prestazioni ed ecosistemi di sicurezza. La loro gestione richiede decisioni rapide, coordinate e coerenti su piani tecnologici differenti, spesso in condizioni di estrema variabilità e con volumi di dati crescenti. In questo scenario, il paradigma del closed loop operativo, basato su osservazione, analisi, decisione ed esecuzione, non è più sufficiente se rimane ancorato a logiche statiche o puramente deterministiche.

L’intelligenza artificiale utilizzata nelle reti, oggi, contribuisce a migliorarne l’affidabilità, la resilienza e la sostenibilità economica e per far questo è necessario distinguere tra semplici strumenti di analytics, modelli di machine learning per l’anomaly detection e sistemi più evoluti capaci di suggerire e attuare decisioni operative in modo autonomo.

Per arrivare a livelli di autonomia e automazione molto spinti, oggi indicati come livello 5 dello standard Autonomous Network del Tele Management Forum (TMF), occorre affrontare con realismo i limiti strutturali dell’approccio, legati alla qualità dei dati, alla trasparenza dei modelli, ai rischi di bias e alla responsabilità delle azioni automatizzate.

In un settore Telco caratterizzato da margini compressi e da una crescente complessità tecnologica, AIOps rappresenta una leva decisiva per completare il percorso verso il ripristino della redditività del settore. Il suo valore risiede non solo nella promessa di un’automazione molto spinta, ma anche nella capacità di integrare osservabilità profonda, apprendimento continuo e controllo governabile, mantenendo chiari i confini tra autonomia algoritmica che si scarica sulle attività più semplici e ripetitive, e responsabilità umana, che si mantiene essenziale per le situazioni complesse e critiche. Comprendere questa evoluzione è essenziale non solo per progettare le reti del presente, ma anche per prepararsi alle architetture AI-native che caratterizzeranno il 6G e le infrastrutture digitali del prossimo decennio.

Indice degli argomenti

AIOps e reti autonome come evoluzione del closed loop operativo

AIOps come evoluzione delle metodologie basate sul closed loop operativo

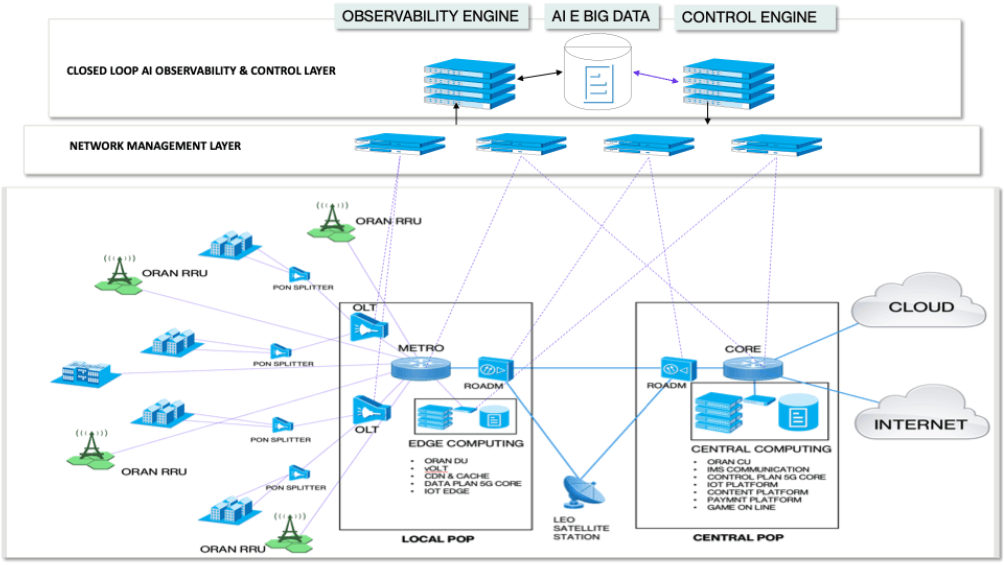

Per comprendere correttamente il significato di AIOps nelle reti di nuova generazione è necessario partire dal concetto di closed loop operativo o anche di Observability e Automation, che negli ultimi anni ha rappresentato l’architettura di riferimento per l’automazione delle infrastrutture digitali. Il modello classico del closed loop si basa su una sequenza ben definita: osservazione dello stato della rete, analisi dei dati raccolti, decisione dell’azione correttiva o migliorativa, esecuzione dell’azione e verifica dell’efficacia. Questo schema ha permesso di superare la gestione puramente manuale, introducendo processi ripetibili e progressivamente automatizzabili. Tale modello è schematizzato nella figura 1.

Figura 1: Il modello “closed loop” per la gestione delle reti di nuova generazione

Tuttavia, nelle reti software-defined e convergenti di oggi, questo ciclo non può più basarsi esclusivamente su regole statiche, soglie predefinite o workflow deterministici. La quantità di dati generati, la velocità con cui cambiano le condizioni operative e la molteplicità delle interdipendenze tra rete, computing e sicurezza rendono insufficiente un approccio basato unicamente su logiche prescrittive. È in questo punto di tensione tra complessità crescente e capacità decisionale limitata che si colloca l’evoluzione verso AIOps.

AIOps potenzia l’architettura closed loop introducendo capacità di apprendimento e di generalizzazione che consentono al sistema di adattarsi a condizioni non completamente previste in fase di progettazione. L’analisi non si limita più alla correlazione di eventi o all’applicazione di soglie dinamiche, ma incorpora modelli capaci di riconoscere pattern complessi, identificare anomalie sottili e stimare l’evoluzione futura dello stato della rete. In questo senso, il ciclo operativo non è più soltanto reattivo o semi-proattivo, ma diventa progressivamente predittivo.

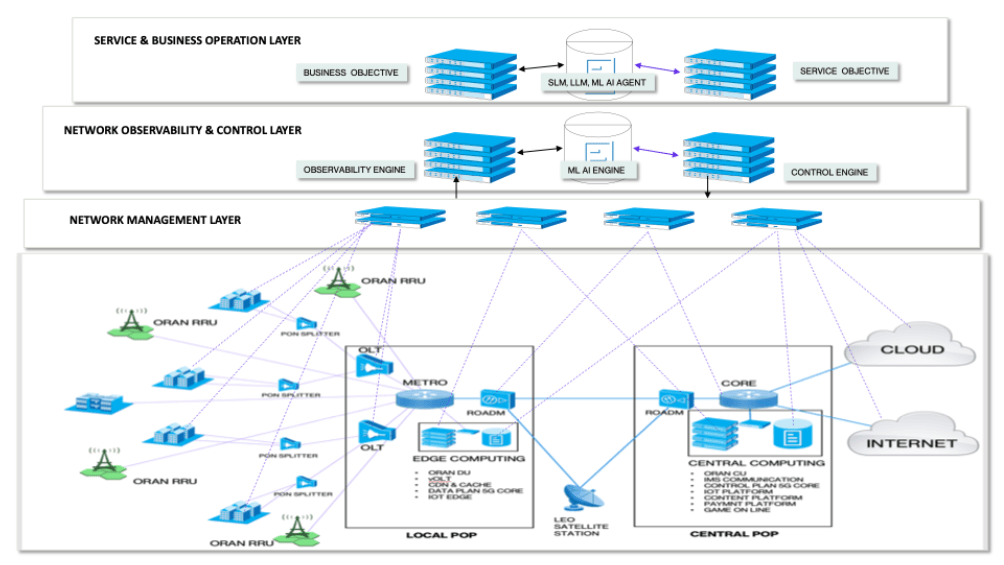

Elementi chiave di questa trasformazione sono la capacità di integrare i dati eterogenei e multi-dominio (networking, computing, security) della rete, con i dati e kpi dei servizi e dei clienti, in un’unica rappresentazione coerente del sistema. Il closed loop tradizionale opera spesso su silos tecnologici separati, con meccanismi di automazione confinati a specifici ambiti funzionali. AIOps, al contrario, tende a superare questa frammentazione, analizzando congiuntamente telemetria di rete, metriche applicative, eventi di sicurezza e informazioni di contesto percepite dai clienti, costruendo una visione olistica a livello di servizio che consente decisioni più informate e coordinate come indicato nella figura 2.

Figura 2: Evoluzione del modello closed loop verso le Autonomous Network

Un ulteriore aspetto distintivo è l’apprendimento continuo. Nei modelli più evoluti, il sistema non si limita a eseguire azioni, ma valuta l’efficacia delle decisioni intraprese e aggiorna i propri modelli sulla base dei risultati osservati. Il closed loop diventa così non solo un meccanismo di controllo, ma un processo adattivo che migliora nel tempo, riducendo progressivamente l’incertezza e aumentando la qualità delle decisioni. In questo senso, AIOps rappresenta l’evoluzione che include lo zero touch network operation e proietta verso forme di autonomia più mature e consapevoli.

È importante sottolineare che questa evoluzione comporta anche una ridefinizione del ruolo dell’operatore umano. L’ingegnere di rete non viene sostituito, ma spostato verso un livello di supervisione, definizione delle policy e validazione dei modelli ossia si passa da un modello organizzativo piramidale a un modello a diamante (descritto in seguito) dove una parte significativa della base della piramide è sostituita da agenti intelligenti. L’intelligenza artificiale diventa uno strumento di amplificazione delle capacità decisionali, non un sostituto della responsabilità tecnica. Il vero salto di qualità non è tecnologico in senso stretto, ma organizzativo e culturale: richiede di accettare che il governo delle reti passi da un controllo diretto delle configurazioni a un controllo dei modelli e delle regole che guidano le decisioni automatiche.

Standard internazionali e percorso di autonomia

L’evoluzione verso AIOps e modelli agentici non si sviluppa in modo isolato, ma si inserisce in un quadro più ampio di standardizzazione internazionale. In questo contesto, il lavoro del TMF rappresenta un punto di riferimento per l’industria delle telecomunicazioni. L’iniziativa sulle Autonomous Networks nasce dalla consapevolezza che l’accelerazione verso reti sempre più autonome è oggi una priorità strategica per i CTO e per i responsabili delle infrastrutture di connettività a livello globale.

Il modello di maturità proposto dal TM Forum definisce livelli progressivi di autonomia, con l’obiettivo di accompagnare gli operatori verso il raggiungimento del Livello 5, in cui la rete è in grado di operare in modo altamente autonomo, con capacità estese di auto-diagnosi, auto-riparazione e auto-ottimizzazione. Questo percorso non si limita all’introduzione di automazione avanzata, ma implica la costruzione di un’architettura standardizzata capace di integrare domini di rete differenti in un framework coerente e interoperabile.

L’architettura di riferimento promossa nell’ambito delle Autonomous Networks mira a rendere i domini di rete self-healing e self-optimizing, predisponendo l’infrastruttura a operare secondo il paradigma “Zero-X”, ossia zero wait, zero touch e zero trouble. In tale visione, la rete è progettata per minimizzare l’intervento umano nelle attività operative ripetitive, ridurre drasticamente i tempi di attesa, prevenire i disservizi e migliorare in modo continuo l’esperienza del cliente.

Il modello di maturità delle Autonomous Networks definito dal TM Forum articola il percorso verso l’autonomia su cinque livelli progressivi, che descrivono l’evoluzione da una gestione prevalentemente manuale a un’operatività completamente autonoma e integrata con i processi di business.

Al Livello 1 l’automazione è limitata e fortemente dipendente dall’intervento umano. Gli operatori si affidano principalmente a sistemi di gestione tradizionali e a workflow manuali; eventuali script o strumenti automatici supportano attività specifiche, ma il controllo rimane centralmente umano e reattivo.

Il Livello 2 introduce forme di automazione intermedia. Alcuni processi operativi vengono automatizzati, in particolare nei domini più strutturati, ma la supervisione manuale resta significativa. L’automazione è spesso circoscritta a singoli ambiti funzionali e non ancora pienamente integrata in un framework coerente multi-dominio.

Il Livello 3 si entra nella fase dell’automazione avanzata. In questo stadio vengono introdotti agenti intelligenti in grado di gestire in modo autonomo operazioni all’interno di un dominio specifico, riducendo in modo sostanziale l’intervento umano diretto. Il closed loop è implementato a livello di dominio e consente miglioramenti tangibili in termini di efficienza e tempi di risposta, pur mantenendo meccanismi di supervisione e controllo.

Il Livello 4 rappresenta un salto qualitativo verso l’autonomia proattiva. Le capacità di intelligenza artificiale e machine learning vengono integrate estensivamente su più domini, abilitando correlazioni cross-domain e capacità di previsione della domanda, dei fault e dei rischi operativi. In questa fase emergono concretamente le funzionalità di self-healing e self-optimization, con un’integrazione più profonda tra rete, servizi e sistemi di orchestrazione.

Il Livello 5 descrive infine uno scenario di operazioni completamente autonome. L’automazione è estesa end-to-end su tutti i domini di rete e si integra in modo fluido con i processi di business e con le applicazioni. La rete diventa capace di adattarsi dinamicamente agli obiettivi definiti, orchestrando risorse, servizi e flussi operativi in modo coerente e continuo, con un intervento umano limitato alla definizione delle policy strategiche e alla supervisione di alto livello.

Il collegamento con AIOps è diretto. I livelli più avanzati di maturità delle Autonomous Networks presuppongono l’integrazione di capacità predittive, di decisione automatica e di apprendimento continuo, ossia proprio quelle funzioni che caratterizzano i modelli agentici descritti nei capitoli precedenti. In questo senso, AIOps può essere interpretato come il motore cognitivo che rende possibile il raggiungimento dei livelli superiori del modello di autonomia definito a livello internazionale.

Il riferimento agli standard del TM Forum è particolarmente rilevante anche sul piano della governance e dell’interoperabilità. In un ecosistema multi-vendor e multi-dominio, l’adozione di architetture e modelli condivisi riduce il rischio di soluzioni proprietarie non interoperabili e favorisce la costruzione di piattaforme aperte e governabili. L’allineamento con framework internazionali contribuisce inoltre a dare maggiore solidità industriale ai percorsi di trasformazione verso reti altamente autonome, evitando approcci frammentati o eccessivamente sperimentali.

AIOps e reti autonome tra modelli open weight e DSLM

Nel panorama attuale dell’Agentic AI, la costruzione di reti autonome non richiede necessariamente modelli di grandi dimensioni generalisti, ma architetture intelligenti calibrate sul dominio specifico. Accanto ai Large Language Model open weight, un ruolo crescente è svolto dagli Small Language Model specializzati o Domain Specific Language Models (DSLM), addestrati e contestualizzati attraverso tecniche di Retrieval Augmented Generation (RAG).

L’ecosistema europeo promosso da Mistral AI offre una base particolarmente interessante in questa direzione, grazie a modelli open weight come Mistral 7B e 8x7B, che possono essere utilizzati sia come foundation model sia come base per la costruzione di agenti più leggeri e verticalizzati.

In contesti Telco e infrastrutture critiche, l’adozione di SLM specializzati, arricchiti da basi di conoscenza proprietarie e integrati in pipeline RAG controllate, consente di ottenere sistemi agentici più efficienti, con minore latenza e maggiore governabilità rispetto a soluzioni puramente generaliste. La possibilità di eseguire tali modelli in ambienti on-premise o cloud sovrani, mantenendo il controllo sul ciclo di vita, sull’addestramento e sull’auditabilità delle decisioni, rende l’approccio open europeo non soltanto tecnicamente valido, ma strategicamente coerente con le esigenze di sovranità tecnologica e di protezione dei dati delle reti di nuova generazione.

Analytics, machine learning e AI agentica nelle reti

Analytics, Machine Learning e AI agentica: cosa cambia davvero nelle reti

Nel dibattito corrente su AIOps, i termini analytics, machine learning e intelligenza artificiale vengono spesso utilizzati come sinonimi, generando confusione e aspettative irrealistiche. In realtà, si tratta di stadi tecnologici e cognitivi distinti, ciascuno con un impatto differente sul governo delle reti. La sintesi è presentata in Tabella 1.

Il primo stadio è rappresentato dall’analytics avanzata. In questo ambito rientrano tecniche di correlazione eventi, analisi statistica, soglie dinamiche e pattern recognition deterministica. L’analytics non “apprende” in senso stretto, ma applica modelli matematici e regole evolute per identificare deviazioni rispetto a comportamenti attesi. Un esempio concreto nelle reti di telecomunicazione è la riduzione della quantità e del “rumore” negli allarmi. In una rete di grandi dimensioni, un singolo guasto può generare centinaia di eventi secondari. Un sistema di analytics avanzata è in grado di correlare questi eventi e identificarne la causa primaria, riducendo drasticamente il numero di ticket aperti e il carico sul personale operativo. In questo caso, l’intelligenza del sistema è legata alla capacità di modellare relazioni note e di applicare logiche di deduplicazione e clustering, ma non vi è ancora una vera capacità predittiva.

Il secondo stadio è quello del machine learning, che introduce la capacità di apprendere dai dati e di generalizzare oltre le regole esplicitamente definite. Qui l’algoritmo non si limita a riconoscere condizioni pre-programmate, ma costruisce un modello statistico o probabilistico sulla base dei dati storici. Un esempio concreto è l’anomaly detection su traffico di rete. Invece di definire manualmente una soglia di utilizzo della banda oltre la quale scatta un allarme, un modello di machine learning apprende il comportamento normale del traffico in funzione dell’ora del giorno, del giorno della settimana e di altre variabili contestuali. Quando si verifica una deviazione significativa rispetto al profilo appreso, il sistema segnala un’anomalia, anche se non esiste una soglia fissa predefinita. Analogamente, il machine learning può essere utilizzato per prevedere la saturazione di un link o di un nodo edge con giorni o settimane di anticipo, consentendo interventi pianificati e riducendo il rischio di congestione.

| Stadio | Funzioni | Esempi | Autonomia | Impatto |

| Analytics | Correlazione e rilevamento dei pattern | Riduzione del rumore degli allarmi | Basso | Diagnostica più rapida |

| Machine Learning | Modellazione predittiva | Previsione della capacità | Medio | Ottimizzazione proattiva |

| Agentic AI | Pianificazione e esecuzione decisionale | Instradamento dinamico del traffico | Alto | Operazioni autonome |

Tabella 1: Comparazione tra Analytics, Machine Learning e Agentic AI

Il terzo stadio, più evoluto e ancora in fase di maturazione nelle reti operative, è quello dell’AI agentica. In questo caso il sistema non si limita a identificare anomalie o a stimare probabilità, ma è in grado di proporre o pianificare azioni operative sulla base di obiettivi definiti senza supervisione dell’operatore umano. L’AI agentica opera in un contesto orientato all’intent o obiettivo da raggiungere, dove le policy e gli obiettivi di servizio costituiscono il riferimento primario. Un esempio concreto può essere la gestione dinamica del traffico in una rete core software-defined. In presenza di una previsione di congestione su una tratta critica, un sistema agentico potrebbe simulare diverse strategie di rerouting, valutarne l’impatto su latenza e qualità del servizio, selezionare la soluzione più coerente con gli obiettivi definiti e proporre l’azione all’operatore o eseguirla automaticamente in modalità supervisionata. In questo scenario, l’intelligenza non si limita alla diagnosi, ma entra nel dominio della pianificazione e della decisione.

Un ulteriore esempio di AI agentica può essere osservato nella gestione energetica delle reti mobili. In presenza di variazioni previste della domanda di traffico, un sistema agentico potrebbe decidere di modulare dinamicamente l’attivazione di celle radio o la potenza trasmissiva, bilanciando obiettivi di qualità del servizio e riduzione dei consumi energetici. Qui il sistema deve considerare simultaneamente variabili tecniche, vincoli operativi e obiettivi economici, avvicinandosi a un comportamento decisionale complesso.

La differenza tra questi tre livelli non è puramente tecnica, ma organizzativa e strategica. L’analytics migliora l’efficienza operativa riducendo il rumore e accelerando la diagnosi. Il machine learning introduce capacità predittive che consentono di anticipare problemi e ottimizzare la pianificazione. L’AI agentica, infine, entra nel dominio della decisione operativa, con implicazioni dirette sulla responsabilità, sulla governance e sulla necessità di meccanismi di supervisione e audit.

I limiti reali di AIOps: dati, bias, explainability e governance

Se AIOps rappresenta un’evoluzione naturale del closed loop operativo, è altrettanto vero che la sua efficacia non è automatica né garantita. L’introduzione dell’intelligenza artificiale nei processi di governo delle reti espone l’organizzazione a nuove complessità e a nuovi rischi, che devono essere compresi e gestiti con realismo. Ignorare questi limiti significa trasformare una leva di efficienza in una potenziale fonte di instabilità.

Il primo e più evidente limite riguarda la qualità dei dati. Ogni sistema di AIOps si fonda su volumi significativi di telemetria, log, ticket dai clienti, metriche e informazioni di configurazione e di contesto. Se questi dati sono incompleti, incoerenti, rumorosi o non correttamente sincronizzati, il modello costruito su di essi risulterà inevitabilmente fragile. Il principio noto come “garbage in, garbage out” assume qui una valenza industriale concreta. In una rete multi-dominio, dove convivono apparati legacy, funzioni virtualizzate e componenti cloud-native, ottenere una base dati omogenea e affidabile è un compito tutt’altro che banale. Senza una observability matura e strutturata, l’adozione di AIOps rischia di produrre decisioni basate su una rappresentazione parziale o distorta della realtà operativa.

Un secondo limite è legato al tema del bias (polarizzazione) nei modelli di machine learning. I modelli apprendono dai dati storici e tendono a riprodurre i pattern osservati nel passato. Se la rete cambia rapidamente, se vengono introdotte nuove tecnologie o se si verificano condizioni operative mai sperimentate prima, il modello può perdere efficacia o generare valutazioni errate. Un esempio concreto può essere rappresentato da un sistema di anomaly detection addestrato su un certo profilo di traffico, che fatica a interpretare correttamente variazioni strutturali dovute all’introduzione di nuovi servizi o a eventi straordinari. In questi casi, il rischio non è solo la mancata individuazione di un problema, ma anche la generazione di falsi positivi che alimentano instabilità operativa.

Il tema della explainability rappresenta un terzo elemento critico. Nelle reti di telecomunicazione, le decisioni operative hanno impatti diretti su milioni di utenti e su servizi essenziali. Se un sistema AIOps suggerisce o esegue una determinata azione, è necessario che l’organizzazione sia in grado di comprenderne la logica sottostante. Modelli opachi o difficilmente interpretabili possono creare una dipendenza algoritmica che riduce la capacità di audit e di verifica. Questo è particolarmente rilevante quando le decisioni coinvolgono ambiti sensibili come la sicurezza, il rerouting del traffico o la gestione di priorità tra servizi critici.

Accanto alla explainability emerge il quarto tema della governance. L’introduzione di AIOps non è solo un progetto tecnologico, ma una trasformazione organizzativa. Occorre definire con chiarezza quali decisioni possono essere delegate al sistema, quali richiedono supervisione umana e quali restano sotto controllo diretto degli operatori. La definizione delle policy, la validazione dei modelli e il monitoraggio continuo delle prestazioni dell’AI diventano attività strutturali, non accessorie. Senza un framework di governance chiaro, il rischio è quello di oscillare tra un’eccessiva fiducia nell’automazione e un ritorno a interventi manuali che annullano i benefici ottenuti.

Un ulteriore aspetto, il quinto, riguarda la responsabilità operativa. Se un sistema agentico decide di modificare dinamicamente una configurazione di rete e tale decisione genera un disservizio, chi ne risponde? Il produttore della piattaforma, il team che ha configurato le policy, l’organizzazione che ha approvato il modello? La questione non è teorica, ma centrale per l’adozione su larga scala di AIOps in contesti regolati o in infrastrutture critiche. È necessario stabilire meccanismi di tracciabilità delle decisioni, registri delle azioni automatiche e procedure di rollback che garantiscano la reversibilità degli interventi.

Infine, esiste un sesto limite legato alla complessità sistemica. Le reti di nuova generazione sono sistemi adattivi complessi, nei quali piccole variazioni possono produrre effetti non lineari. Un modello di AIOps che ottimizza localmente una porzione della rete potrebbe, in assenza di una visione globale adeguata, generare effetti collaterali in altri domini. Questo richiede un’integrazione profonda tra AIOps e architetture di modellazione dinamica, come i Digital Twin, che consentano di valutare l’impatto delle decisioni in modo più ampio e strutturato.

Riconoscere questi limiti non significa ridimensionare il potenziale di AIOps, ma collocarlo in un quadro realistico. L’intelligenza artificiale applicata alle reti non è una soluzione magica, ma uno strumento potente che richiede dati affidabili, modelli governabili, trasparenza decisionale e una chiara attribuzione delle responsabilità. Solo in presenza di queste condizioni AIOps può contribuire in modo stabile alla resilienza, all’efficienza e alla sostenibilità economica delle infrastrutture digitali.

AIOps e reti autonome nell’evoluzione organizzativa

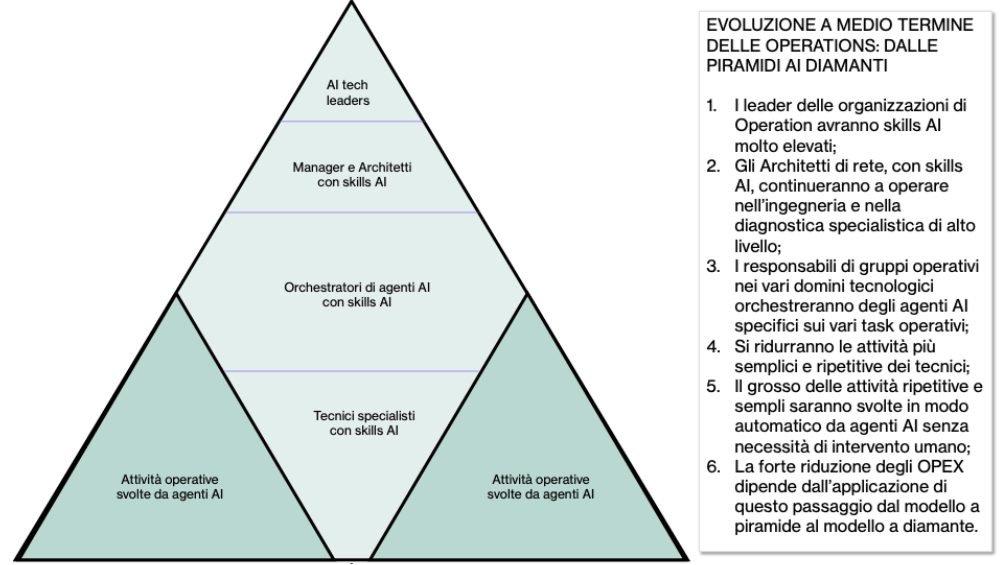

L’introduzione di AIOps agentico non modifica soltanto i processi operativi, ma incide profondamente sulla struttura organizzativa delle funzioni Infrastructure & Operations. Le organizzazioni tradizionali sono costruite secondo una piramide classica, con una base ampia di operatori dedicati a task ripetitivi e un vertice ristretto di architetti e responsabili decisionali. L’evoluzione verso agenti intelligenti, capaci di eseguire autonomamente attività di diagnostica, remediation e orchestrazione, tende progressivamente a ridurre la necessità di una vasta base esecutiva.

Il modello emergente è più simile a una struttura “a diamante” (figura 3): alla base operano agenti software in grado di gestire volumi elevati di attività standardizzate; al centro si colloca una fascia di ingegneri e orchestratori AI-enabled, responsabili della definizione delle policy, della supervisione dei modelli e della gestione delle eccezioni; al vertice rimangono architetti e leader in grado di governare la strategia e il rischio complessivo. In questo scenario, il valore non risiede più nell’esecuzione manuale delle operazioni, ma nella capacità di progettare, addestrare e controllare sistemi intelligenti.

Figura 3: Evoluzione del modello organizzativo verso strutture a diamante che sostituiranno quelle a piramide

Questa trasformazione non implica una semplice riduzione del personale, ma una riconfigurazione delle competenze. Le figure operative evolvono verso ruoli di agent orchestration, model supervision e policy engineering. La maturità di un’organizzazione AIOps si misura anche nella capacità di gestire questa transizione culturale, evitando sia la resistenza conservativa sia un’adozione acritica dell’autonomia algoritmica.

La trasformazione indotta da AIOps può essere descritta anche come un passaggio progressivo dal paradigma human-in-the-loop a quello human-on-the-loop. Nel primo modello, l’operatore umano è parte integrante del ciclo decisionale: ogni azione rilevante viene validata, autorizzata o eseguita manualmente. L’automazione resta subordinata alla verifica costante dell’uomo, che mantiene il controllo diretto di ogni singola operazione.

Nel paradigma human-on-the-loop, invece, l’intervento umano si sposta a un livello superiore. L’operatore non valida ogni decisione puntuale, ma definisce obiettivi, policy, vincoli e guardrail entro cui gli agenti possono operare autonomamente. Il controllo non scompare, ma si trasforma: da controllo sull’azione a controllo sul sistema che genera l’azione. L’uomo interviene in modalità di supervisione, auditing e gestione delle eccezioni, lasciando agli agenti la gestione dei casi standardizzati e ad alta frequenza.

Questa evoluzione non è immediata né uniforme. Nei contesti a maggiore criticità, la presenza dell’uomo nel ciclo decisionale rimarrà elevata più a lungo. Tuttavia, con il crescere della maturità dei modelli e della fiducia organizzativa, il baricentro tenderà a spostarsi verso una supervisione strutturata piuttosto che una validazione puntuale. È in questo equilibrio dinamico tra autonomia e controllo che si gioca la reale efficacia di AIOps nel lungo periodo.

Un aspetto particolarmente rilevante dell’evoluzione verso AIOps agentico riguarda il confronto tra modelli di gestione tradizionali basati su Managed Network Services (MNS) e modelli do-it-yourself (DIY) abilitati da piattaforme intelligenti. Negli ultimi anni molte organizzazioni hanno esternalizzato una parte significativa delle attività di network operations per compensare carenze di competenze interne e per stabilizzare i costi operativi. Tuttavia, questo modello presenta rigidità contrattuali e costi ricorrenti che tendono a crescere nel tempo.

L’introduzione di agentic NetOps modifica progressivamente questo equilibrio. Se gli agenti intelligenti sono in grado di gestire in modo autonomo attività di monitoraggio, triage, correlazione eventi, remediation standardizzata e persino alcune attività di pianificazione, la necessità di ricorrere a servizi gestiti per le attività di livello operativo diminuisce. Il confronto non è più soltanto tra personale interno e outsourcing, ma tra spesa ricorrente per servizi e investimento in piattaforme software agentiche.

Dal punto di vista del Total Cost of Ownership, il modello DIY abilitato da AIOps richiede un investimento iniziale più elevato in piattaforme, integrazione e competenze, ma può ridurre in modo strutturale i costi ricorrenti nel medio periodo. La progressiva internalizzazione di competenze di orchestrazione e supervisione degli agenti consente di ridurre la dipendenza da contratti basati su ore-uomo o su volumi di ticket gestiti. In questo scenario, una parte dei budget tradizionalmente destinati ai servizi gestiti tende a spostarsi verso licenze software, piattaforme di agent orchestration e AI engineering.

L’elemento critico è la soglia di maturità. Un’adozione superficiale di AIOps non è sufficiente a sostituire servizi gestiti complessi. Solo quando gli agenti sono in grado di operare in modo affidabile su un numero significativo di workflow standardizzati, e quando l’organizzazione dispone di competenze interne adeguate, il passaggio verso un modello più autonomo diventa economicamente vantaggioso. In caso contrario, il rischio è quello di sovrapporre costi di piattaforma e costi di outsourcing, erodendo il ROI atteso.

In prospettiva, le organizzazioni che non adottano progressivamente modelli agentici rischiano di mantenere strutture operative più costose e meno scalabili rispetto a competitor che investono in autonomia intelligente. La vera leva competitiva non è quindi soltanto la riduzione immediata dei costi, ma la capacità di costruire un modello operativo più elastico, meno dipendente da servizi esterni e meglio allineato a obiettivi di efficienza di lungo periodo.

Principali use case nelle reti autonome

L’evoluzione verso Autonomous Networks, soprattutto nel caso degli Operatori delle Reti di Telecomunicazioni, si traduce in un insieme di use case concreti che abilitano progressivamente il passaggio ai livelli più avanzati di maturità operativa. Le iniziative più rilevanti si concentrano su domini ad alto impatto operativo, dove l’integrazione di AI, Machine Learning, tecniche di Small Language Model e agenti autonomi consente di attivare closed loop a livello di elemento di rete, dominio, servizio e business.

Il modello NOC-less

L’evoluzione del NOC tradizionale verso un modello “NOC-less” rappresenta uno dei casi d’uso più emblematici dell’adozione di AIOps agentico. In questo scenario, un sistema multi-agente consente agli ingegneri di rete di interagire con l’infrastruttura attraverso linguaggio naturale, riducendo la dipendenza da competenze specialistiche su strumenti e comandi specifici.

L’architettura integra agenti dedicati alla gestione degli incidenti, alla consultazione di informazioni, alla creazione di audit, al troubleshooting, all’ottimizzazione e alle azioni di remediation. Attraverso modelli linguistici combinati con meccanismi di Retrieval Augmented Generation, il sistema è in grado di contestualizzare richieste, recuperare conoscenza operativa e proporre o attivare azioni coerenti con le policy definite.

L’integrazione con API, microservizi e piattaforme di automazione consente di trasformare le analisi e le raccomandazioni degli agenti in workflow operativi, abilitando closed loop a livello di dominio e di servizio. Il risultato è un miglioramento significativo dell’efficienza operativa, tempi di risposta ridotti e accesso in tempo reale a informazioni strutturate, con un impatto diretto sulla qualità della gestione degli incidenti.

Il digital twin di rete

Il Digital Twin di rete consiste nella creazione di una rappresentazione virtuale dinamica dell’infrastruttura fisica, utilizzata per simulazione, validazione preventiva e analisi delle performance. Questa replica può includere l’intera architettura o moduli specifici, consentendo di testare modifiche configurative, aggiornamenti software o nuove policy operative in un ambiente controllato prima della loro introduzione in produzione.

Integrando pipeline di Continuous Integration, Continuous Delivery e Continuous Testing, il Digital Twin diventa parte integrante del ciclo operativo, permettendo di automatizzare upgrade, change management e rollback in modo strutturato. Questo approccio abilita closed loop evoluti, in cui le decisioni possono essere validate in ambiente virtuale prima di essere propagate sulla rete reale.

I benefici includono riduzione dei rischi associati ai change, diminuzione dei costi operativi legati a incidenti post-deploy e incremento della disponibilità complessiva dell’infrastruttura, con livelli di affidabilità prossimi ai “five nines”. Il Digital Twin si configura così come uno strumento abilitante per reti realmente autonome e governabili.

Agenti AI per la manutenzione dei livelli 2 e 3

L’agente di self-healing a livello Layer 2 e Layer 3 rappresenta uno dei casi d’uso più concreti di closed loop nel dominio delle risorse di rete. L’obiettivo è individuare in tempo reale anomalie nei livelli di trasporto e instradamento – inclusi layer ottici e IP – e attivare automaticamente azioni correttive, con possibilità di rollback controllato e workflow di approvazione nei casi più critici.

Il sistema si basa su modelli di machine learning o small language model alimentati da telemetria granulare proveniente dai diversi layer della rete. L’integrazione con strumenti di automazione consente di trasformare l’analisi in intervento operativo, mentre una “situation room” centralizzata offre una visione completa e contestualizzata delle anomalie rilevate.

Questo approccio abilita un closed loop a livello di resource domain, riducendo significativamente il Mean Time To Detect e il Mean Time To Repair. Il risultato è una rete progressivamente self-healing, con maggiore resilienza, minore impatto degli incidenti e miglioramento tangibile dell’esperienza del cliente finale.

Dashboard integrata per incident management

Uno use case fondamentale nel percorso verso livelli avanzati di autonomia è la realizzazione di una dashboard unificato a supporto degli agenti di incident management. L’obiettivo è consolidare in un’unica interfaccia le viste operative, di pianificazione e direzionali, superando la frammentazione tipica tra strumenti NOC, sistemi OSS e piattaforme di monitoraggio applicativ

Il sistema integra monitoraggio a livello di servizio e funzionalità avanzate di Root Cause Analysis, basate su tecniche di correlazione tra syslog, eventi strutturati e dati non strutturati, elaborate attraverso modelli di machine learning. L’elemento distintivo non è solo la visualizzazione, ma la capacità di correlare informazioni provenienti da domini diversi, includendo dati applicativi e di business, per abilitare un closed loop a livello di servizio.

Questo approccio costituisce una base abilitante per i livelli più avanzati di maturità autonoma, in cui l’automazione non è più limitata al dominio infrastrutturale ma si estende alla gestione orientata agli obiettivi. I benefici includono una riduzione significativa di MTTD e MTTR, maggiore efficacia nelle azioni correttive e una migliore coordinazione tra applicazioni e domini tecnologici, con impatti diretti su qualità del servizio e time-to-market.

Rilevazione dei difetti di configurazione

Il rilevamento del configuration drift rappresenta uno dei casi d’uso più concreti nel percorso verso reti autonome. L’obiettivo è identificare in tempo reale deviazioni non intenzionali o non autorizzate rispetto allo stato configurativo desiderato dei dispositivi di rete. A differenza dei sistemi tradizionali basati su regole statiche, l’approccio utilizza modelli di machine learning o small language model capaci di apprendere i pattern configurativi normali e di segnalare anomalie contestuali.

Questa capacità consente di intercettare tempestivamente incoerenze che potrebbero tradursi in degradi prestazionali, vulnerabilità di sicurezza o violazioni di compliance. Integrando i risultati dell’analisi in una piattaforma di automazione, è possibile attivare remediation controllate, rollback o riallineamenti automatici, abilitando un closed loop configurativo ad alta affidabilità.

Il beneficio principale è la riduzione preventiva dei disservizi e dei rischi operativi, attraverso un monitoraggio continuo e adattivo dello stato della rete, con un impatto diretto sulla stabilità del servizio e sull’efficienza dei processi di gestione.

Audit di configurazione basati su DSLM

Uno use case ad alto impatto operativo è l’audit configurativo basato su modelli linguistici, progettato per analizzare in tempo reale le configurazioni di rete in ambienti di produzione e verificarne la conformità rispetto a best practice, standard interni e policy di resilienza. A differenza dei tradizionali sistemi rule-based, l’utilizzo di modelli linguistici specifici (DSLM) integrati con meccanismi di Retrieval Augmented Generation consente di interpretare configurazioni complesse in modo contestuale, individuando anomalie, incoerenze o potenziali vulnerabilità.

L’obiettivo primario è rafforzare la resilienza della rete, intercettando condizioni di rischio prima che si traducano in disservizi. I risultati dell’audit non si limitano alla segnalazione, ma possono essere integrati in piattaforme di attivazione automatizzata end-to-end, attivando remediation controllate e abilitando un closed loop di configurazione esteso a più domini.

Questo approccio contribuisce al raggiungimento dei livelli intermedi e avanzati di maturità autonoma, migliorando disponibilità e affidabilità del servizio e riducendo i costi operativi associati a verifiche manuali e gestione reattiva degli incidenti.

Attivazione automatica end-to-end del servizio

Uno degli use case più abilitanti nel percorso verso reti autonome è l’attivazione automatizzata end-to-end dei servizi su domini multipli. In questo scenario, una piattaforma di orchestrazione aperta coordina in modo integrato catalogo servizi, provisioning, verifiche pre e post-attivazione e gestione del ciclo di vita, superando la frammentazione tra domini di rete, IT e sistemi OSS/BSS.

Agenti intelligenti dedicati alla gestione dei change configurativi operano all’interno di un framework multi-agente, attivando workflow in base a trigger provenienti da altri agenti o da richieste espresse in linguaggio naturale. L’uso di modelli linguistici integrati con meccanismi di Retrieval-Augmented Generation consente di tradurre intenti di servizio in chiamate API e azioni configurative coerenti con le policy operative.

Questo approccio rappresenta un elemento chiave per il raggiungimento dei livelli più avanzati di maturità nel modello di Autonomous Networks, poiché abilita closed loop non solo a livello di risorsa ma anche a livello di servizio e di processo di business. I benefici includono riduzione dei costi operativi, accelerazione del provisioning, maggiore coerenza di configurazione e livelli elevati di disponibilità del servizio, con impatti diretti su affidabilità e customer experience.

Rilevamento dei fattori tossici di degrado

Un ulteriore ambito di applicazione riguarda l’identificazione dei cosiddetti “toxic factors”, ossia combinazioni di condizioni operative che, pur non generando immediatamente un guasto evidente, aumentano in modo significativo il rischio di degrado prestazionale o di failure latenti. Si tratta spesso di correlazioni non banali tra versioni software, tipologie hardware, configurazioni specifiche e pattern di traffico.

Attraverso modelli di machine learning addestrati su dati storici, il sistema è in grado di riconoscere pattern ricorrenti associati a soft failures o a situazioni di instabilità progressiva. L’obiettivo non è soltanto rilevare l’anomalia quando si manifesta, ma individuare precocemente condizioni di rischio strutturale, costruendo un framework di health e diagnostica evoluto.

Integrando tali capacità all’interno di una piattaforma di automazione, le situazioni classificate ad alto “tasso di tossicità” possono attivare azioni preventive, come aggiornamenti mirati, sostituzioni pianificate o modifiche configurative controllate, abilitando un closed loop di prevenzione. Il risultato è un miglioramento della resilienza complessiva della rete, una riduzione degli incidenti ricorrenti e una gestione più proattiva di sicurezza e performance.

Assicurazione dell’esperienza applicativa

Un ulteriore USE CASE strategico per gli operatori riguarda l’assurance e la customer experience end-to-end, ossia la capacità di monitorare in modo continuo e intelligente la qualità percepita dall’utente finale sui servizi digitali erogati attraverso la rete. Non si tratta più soltanto di garantire KPI infrastrutturali, ma di misurare e ottimizzare l’effettiva qualità dell’esperienza applicativa.

L’approccio si basa sull’analisi in tempo reale di telemetria proveniente da sonde di rete e punti di osservazione distribuiti lungo il percorso del servizio. Modelli di machine learning leggeri o small language model elaborano questi flussi per individuare degradi prestazionali, anomalie comportamentali o pattern emergenti che possano anticipare un deterioramento della qualità percepita.

Integrando tali capacità all’interno di una piattaforma di automazione, l’individuazione proattiva di criticità può attivare meccanismi di closed loop, come riallocazione dinamica di risorse, ottimizzazione dei percorsi di traffico o interventi correttivi mirati. Il risultato è un miglioramento della performance applicativa e della soddisfazione dell’utente finale, con un impatto diretto sui livelli di servizio e sulla riduzione dei reclami.

AIOps e reti autonome verso il 6G AI-native

Se nelle reti attuali AIOps rappresenta un’evoluzione del closed loop operativo, nel contesto del 6G l’intelligenza artificiale non sarà più un elemento sovrapposto all’architettura, ma una componente nativa del sistema. La differenza è sostanziale. Oggi l’AI viene integrata in reti progettate originariamente senza una dipendenza strutturale da modelli cognitivi; nel 6G, al contrario, la capacità di apprendere, adattarsi e ottimizzare in modo autonomo sarà prevista fin dalla fase di progettazione architetturale.

Le future reti 6G saranno caratterizzate da una densità ancora maggiore di nodi edge, da una distribuzione estesa delle capacità di calcolo, da servizi ultra-low latency e da requisiti di affidabilità estremamente stringenti, in particolare per applicazioni industriali, veicoli autonomi, sanità connessa e sistemi cyber-fisici complessi. In questo scenario, la quantità di decisioni operative da prendere in tempo reale crescerà in modo esponenziale. La gestione manuale o anche solo rule-based non sarà in grado di garantire la stabilità del sistema.

L’introduzione di AIOps in un contesto 6G assume quindi una dimensione architetturale. Non si tratta solo di analizzare eventi o prevedere congestioni, ma di orchestrare dinamicamente risorse radio, capacità di trasporto, funzioni virtualizzate e workload di edge computing in funzione di obiettivi di servizio variabili nel tempo. L’intelligenza non opererà esclusivamente nel dominio del management, ma sarà distribuita lungo la rete, con componenti AI integrate nei nodi periferici e nei sistemi di controllo centrale.

Un esempio concreto può essere rappresentato dalla gestione dinamica dello slicing di rete. Nel 6G, i network slice saranno altamente personalizzati e adattivi, con requisiti che possono cambiare in funzione del contesto applicativo. Un sistema AIOps evoluto dovrà essere in grado di monitorare in tempo reale le performance di ciascun slice, prevederne la saturazione, riallocare risorse radio o computazionali e garantire il rispetto degli obiettivi di latenza e affidabilità. Questo processo non potrà essere interamente predeterminato, ma richiederà capacità di apprendimento continuo e adattamento contestuale.

Analogamente, la gestione dell’energia nelle reti 6G diventerà un elemento strutturale. Con una proliferazione di nodi e dispositivi, l’ottimizzazione dei consumi non potrà basarsi su logiche statiche. AIOps dovrà bilanciare in tempo reale qualità del servizio, utilizzo delle risorse e consumo energetico, adattando configurazioni radio e capacità di elaborazione in funzione dei carichi effettivi e delle priorità operative.

Un ulteriore ambito critico sarà la sicurezza. Le reti 6G saranno intrinsecamente più esposte, sia per la loro distribuzione sia per l’integrazione con ecosistemi applicativi complessi. L’identificazione di attacchi sofisticati, basati su pattern anomali difficilmente riconoscibili con regole statiche, richiederà modelli intelligenti capaci di correlare fenomeni multilivello e di reagire con tempestività. In questo contesto, AIOps e cybersecurity convergeranno progressivamente, dando origine a modelli di difesa adattiva e auto-ottimizzante.

Tuttavia, l’architettura AI-native del 6G non elimina le criticità già discusse. Al contrario, le amplifica. La dipendenza strutturale da modelli intelligenti rende ancora più rilevanti i temi della qualità dei dati, della robustezza degli algoritmi, della explainability e della governance. Se l’AI diventa parte integrante del sistema di controllo della rete, il controllo degli algoritmi stessi diventa una questione strategica, con implicazioni tecniche, industriali e geopolitiche.

In questo senso, AIOps nel 6G non sarà solo una leva di efficienza operativa, ma un elemento determinante per la sovranità tecnologica. Le scelte relative ai modelli di intelligenza, alla loro localizzazione, alla loro trasparenza e alla loro auditabilità incideranno direttamente sulla capacità di governare infrastrutture critiche in modo autonomo e resiliente.

Il passaggio verso reti AI-native non deve quindi essere interpretato come un’automatizzazione totale e incontrollata, ma come una nuova fase di maturità delle infrastrutture digitali. AIOps rappresenta il ponte tra le reti software-defined attuali e le architetture 6G del futuro, a condizione che venga progettato come parte integrante di un modello di governo consapevole, governabile e responsabile.

AIOps e responsabilità operativa: autonomia algoritmica e controllo umano

L’evoluzione verso AIOps introduce un cambiamento profondo non solo nelle architetture tecnologiche, ma anche nel concetto stesso di responsabilità operativa. Nelle reti tradizionali, la catena decisionale era relativamente lineare: un evento veniva rilevato, analizzato da un operatore o da un team tecnico, e l’azione correttiva veniva eseguita sotto responsabilità umana diretta. Con l’introduzione di sistemi capaci di apprendere, suggerire e talvolta eseguire decisioni in modo autonomo, questa linearità si attenua, e il confine tra decisione umana e decisione algoritmica diventa meno evidente.

Il primo punto da chiarire è che AIOps non elimina la responsabilità, ma la ridistribuisce. L’attenzione si sposta dalla singola azione operativa alla progettazione del sistema che genera quella decisione. Se un motore agentico decide di modificare una configurazione di rete per prevenire una congestione e tale modifica produce effetti inattesi, la questione non riguarda soltanto l’esecuzione dell’azione, ma l’intero ciclo di progettazione del modello, delle policy e dei criteri di attivazione dell’automazione. La responsabilità si estende quindi alla definizione delle soglie di autonomia, alla validazione dei modelli e al monitoraggio continuo delle loro prestazioni.

Un elemento centrale in questo equilibrio è la definizione dei livelli di autonomia. Non tutte le decisioni operative hanno lo stesso impatto e non tutte devono essere delegate allo stesso grado di automazione. In ambiti a basso rischio, come l’ottimizzazione dinamica della distribuzione del traffico su percorsi ridondanti, può essere accettabile un livello elevato di autonomia algoritmica. In ambiti più sensibili, come la gestione di servizi critici o l’applicazione di policy di sicurezza che possono influire su infrastrutture strategiche, è spesso necessario mantenere un livello di supervisione umana esplicita. La maturità di un’organizzazione nell’adozione di AIOps si misura anche nella capacità di definire questi confini in modo chiaro e coerente.

La tracciabilità delle decisioni rappresenta un ulteriore requisito imprescindibile. Ogni azione intrapresa da un sistema AIOps deve essere registrata, contestualizzata e resa auditabile. Questo non solo per ragioni normative o regolatorie, ma per garantire la possibilità di apprendere dagli errori e di migliorare progressivamente i modelli. Senza meccanismi di logging dettagliati e strumenti di analisi ex post, il sistema rischia di evolvere in una direzione opaca, in cui le cause di un malfunzionamento diventano difficili da ricostruire.

Un altro aspetto riguarda la competenza interna. L’adozione di AIOps non riduce la necessità di competenze tecniche avanzate, ma ne modifica la natura. Gli operatori non devono più solo configurare apparati e analizzare log, ma comprendere il funzionamento dei modelli, valutarne le performance, identificare potenziali bias e intervenire per correggere derive indesiderate. In questo senso, la responsabilità operativa si trasforma in responsabilità di governo dei modelli. L’organizzazione deve essere in grado di interrogare il sistema, di comprenderne le scelte e, se necessario, di sospenderne temporaneamente l’autonomia.

Il tema assume una dimensione ancora più rilevante nelle infrastrutture critiche e nei contesti regolati. In questi ambienti, l’affidabilità e la sicurezza non sono soltanto obiettivi tecnici, ma obblighi giuridici e sociali. L’adozione di AIOps deve quindi integrarsi con framework di compliance, procedure di certificazione e meccanismi di verifica indipendente. La responsabilità non può essere delegata implicitamente all’algoritmo, ma deve restare chiaramente attribuibile all’organizzazione che governa la rete.

In questo equilibrio tra autonomia e controllo si gioca la maturità delle reti di nuova generazione. Un’automazione eccessivamente conservativa rischia di neutralizzare i benefici di AIOps, mantenendo elevati i costi operativi e limitando la capacità di adattamento. Un’autonomia incontrollata, al contrario, può generare instabilità e compromettere la fiducia nel sistema. La sfida è trovare un punto di equilibrio dinamico, in cui l’intelligenza artificiale amplifichi la capacità decisionale umana senza sostituirla in modo acritico.

In definitiva, AIOps non rappresenta una fuga dalla responsabilità, ma una sua evoluzione. Governa non solo configurazioni e parametri, ma modelli, obiettivi e processi decisionali. La capacità di mantenere questo governo in modo trasparente, auditabile e coerente con gli obiettivi industriali e regolatori sarà il vero fattore distintivo tra reti semplicemente automatizzate e reti realmente intelligenti e governabili nel lungo periodo.

L’ingresso degli agenti intelligenti in processi operativi mission-critical introduce un’ulteriore dimensione di governance che fino a pochi anni fa non esisteva: la definizione di Service Level Agreement specifici per gli agenti AI. Se un agente è autorizzato a diagnosticare, pianificare o persino eseguire azioni correttive su infrastrutture critiche, la sua performance non può essere valutata esclusivamente in termini di disponibilità della piattaforma software che lo ospita. È necessario misurarne l’efficacia decisionale.

Gli SLA tradizionali, focalizzati su uptime, tempi di risposta o livelli di servizio generici, diventano insufficienti in un contesto agentico. Occorre introdurre metriche nuove, quali accuratezza delle diagnosi, tasso di successo delle remediation automatizzate, tempi medi di decisione, percentuale di interventi corretti al primo tentativo, capacità di spiegazione delle scelte effettuate e resilienza del modello in condizioni di degrado o dati incompleti. In altri termini, la qualità dell’algoritmo diventa parte integrante del contratto.

Questa evoluzione modifica profondamente le pratiche di vendor management. Le organizzazioni dovranno richiedere maggiore trasparenza sui modelli utilizzati, sulle modalità di addestramento, sui meccanismi di aggiornamento e sulle logiche di controllo dei rischi. Le clausole contrattuali tenderanno a includere diritti di audit, procedure di escalation specifiche per errori decisionali degli agenti e, in alcuni casi, rimedi economici legati a performance non conformi. La gestione del rischio operativo si sposterà progressivamente dal semplice monitoraggio dell’infrastruttura alla valutazione della qualità dei sistemi intelligenti che la governano.

In prospettiva, la formalizzazione di SLA per agenti AI potrebbe favorire la nascita di standard di settore e di schemi di certificazione dedicati, soprattutto nei contesti regolati e nelle infrastrutture critiche. La capacità di dimostrare conformità, tracciabilità e controllo dei modelli diventerà un fattore distintivo nella selezione dei fornitori. In questo scenario, le piattaforme di AIOps non saranno valutate soltanto per le funzionalità offerte, ma per il livello di accountability che sono in grado di garantire.

L’introduzione di AI agent SLA rappresenta quindi un passaggio chiave nella maturazione dell’ecosistema AIOps: da tecnologia promettente a componente contrattualmente governata delle infrastrutture digitali. È in questo momento che l’autonomia algoritmica si confronta con la responsabilità industriale, trasformando il rapporto tra imprese e fornitori e ridefinendo i confini del rischio operativo.

AI agent engineering platform

L’adozione di AIOps agentico su scala significativa non può essere gestita come un’estensione incrementale delle piattaforme di automazione esistenti. Con l’aumentare del numero di agenti, dei domini coperti e dei workflow autonomi attivati, emerge la necessità di una vera e propria AI Agent Engineering Platform, ossia di un’infrastruttura dedicata alla progettazione, gestione e governo dei sistemi intelligenti.

Questa piattaforma non coincide con il semplice motore di esecuzione degli agenti, ma comprende funzioni di versioning dei modelli, gestione delle identità e dei permessi, definizione dei guardrail operativi, controllo dei costi computazionali, monitoraggio delle performance decisionali e validazione continua dei comportamenti. In un ambiente distribuito e multi-dominio, dove gli agenti possono interagire con sistemi di rete, cloud, sicurezza e IT service management, l’assenza di un livello di ingegneria strutturato rischia di generare proliferazione incontrollata di automazioni e perdita di visibilità.

Un ulteriore elemento critico è la gestione del ciclo di vita dei modelli. Gli agenti non sono statici: vengono aggiornati, riaddestrati, ottimizzati. Ogni modifica può alterarne il comportamento operativo. È quindi necessario introdurre processi analoghi a quelli del software engineering, con ambienti di test, validazione preproduzione, meccanismi di rollback e monitoraggio post-deploy. Senza queste pratiche, l’autonomia agentica può trasformarsi in una fonte di rischio sistemico.

Anche il tema dei costi assume una nuova dimensione. Gli agenti basati su modelli avanzati possono comportare consumi significativi di risorse computazionali, soprattutto in scenari ad alta frequenza decisionale. Una AI Agent Engineering Platform deve includere strumenti di controllo e ottimizzazione dei costi, evitando che l’incremento dell’intelligenza operativa si traduca in una crescita non controllata della spesa infrastrutturale.

Infine, la presenza di una piattaforma di ingegneria agentica rafforza la sovranità tecnologica dell’organizzazione. Governare internamente il ciclo di vita dei modelli, le policy di esecuzione e i dati utilizzati per l’addestramento significa mantenere il controllo del sistema decisionale che regola l’infrastruttura. In un contesto in cui le reti diventano progressivamente AI-native, questa capacità non è soltanto un vantaggio competitivo, ma una componente essenziale di autonomia strategica.

AIOps e reti autonome negli economics

L’adozione di AIOps non può essere valutata esclusivamente sul piano tecnologico. Come per ogni trasformazione strutturale del modello operativo, la questione centrale riguarda l’equilibrio tra investimenti iniziali e ritorni misurabili nel medio periodo. In un settore TELCO caratterizzato da margini compressi e da flussi di cassa limitati, ogni iniziativa deve dimostrare la propria sostenibilità economica con dati concreti e obiettivi verificabili (Tabella 2).

| Componente | Investimento | Impatto sul ritorno | Orizzonte temporale |

| Aggiornamento dell’osservabilità e automazione | 2% rispetto agli OPEX | Riduzione OPEX del 15% – 25% | 3 anni |

| Piattaforma e modelli AIOps | 2% rispetto agli OPEX | Riduzione OPEX del 10% – 15% | 3 anni |

| Operazioni Autonome Complete | Investimento cumulativo del 4% rispetto agli OPEX | Efficienza cumulativa fino al 40% di riduzione OPEX | 5 anni |

Tabella 2: Intensità degli investimenti e tempi di ritorno attesi

Dal punto di vista degli investimenti, AIOps richiede tre componenti principali. La prima è l’evoluzione dell’infrastruttura di observability e automation, che deve essere sufficientemente matura da garantire qualità, coerenza e granularità dei dati. Senza una base dati affidabile, l’intelligenza artificiale non può produrre valore. Questo comporta investimenti in piattaforme di telemetria, data lake operativi, strumenti di normalizzazione e integrazione multi-dominio.

La seconda componente riguarda lo sviluppo e l’addestramento dei modelli. Ciò include l’acquisizione o la realizzazione di piattaforme AIOps, l’integrazione con sistemi OSS/BSS e automation esistenti, e la fase di training iniziale dei modelli su dataset storici. In molti casi, la fase di tuning e validazione può durare mesi, soprattutto in ambienti complessi, con reti multi-vendor e architetture ibride.

La terza componente è organizzativa. L’introduzione di AIOps richiede competenze nuove, figure in grado di comprendere sia il dominio di rete sia quello dei modelli statistici, oltre a processi di governance e validazione delle decisioni automatiche. Una parte dell’investimento è quindi legata alla formazione e alla riorganizzazione dei team operativi.

Complessivamente, per un operatore di medie o grandi dimensioni, l’investimento iniziale può collocarsi nell’intorno del 4% degli OPEX annuali, distribuito su un arco temporale di tre anni. In termini assoluti, nel caso di un operatore con costi operativi nell’ordine dei miliardi di euro, si tratta di investimenti significativi ma non proibitivi, soprattutto se inseriti in un piano pluriennale di trasformazione digitale.

Sul fronte dei ritorni, le evidenze oggi disponibili indicano che AIOps può contribuire a riduzioni incrementalmente superiori rispetto alla sola automazione rule-based. Seguendo le analisi del TMF, le quali indicano, nei contesti più maturi di Autonomous Network, obiettivi di riduzione dei costi di esercizio e manutenzione fino al 55%, si può ritenere che aggiungendo ai benefici dell’observability e automation tradizionale che consente riduzioni OPEX nell’ordine del 15% – 25% su specifici domini operativi, l’integrazione di capacità predittive e agentiche può aggiungere un ulteriore 10% – 15% di efficienza nei processi più maturi, si può tendere a recuperi di OPEX dell’ordine del 40%. Questo spiega l’importanza strategica dell’adozione di adozione di tali tecnologie in un settore che necessita di tornare a margini operativi lordi superiori al 40% sui ricavi.

Le aree di impatto più immediate sono la gestione degli incidenti e la prevenzione dei fault. La riduzione del Mean Time To Detect e del Mean Time To Restore comporta minori costi diretti di troubleshooting e minori penali legate a SLA non rispettati. A questo si aggiunge la riduzione dei falsi positivi e delle escalation non necessarie, che alleggerisce il carico dei team operativi.

Un secondo ambito rilevante è la pianificazione della capacità. Modelli predittivi accurati consentono di ottimizzare gli investimenti infrastrutturali, riducendo l’overprovisioning e migliorando il tasso di utilizzo delle risorse esistenti. In un settore ad alta intensità di capitale, anche piccoli miglioramenti percentuali nell’efficienza d’uso delle infrastrutture possono tradursi in risparmi significativi.

Un terzo ambito è l’ottimizzazione energetica, sempre più rilevante nei bilanci degli operatori. AIOps può contribuire alla modulazione dinamica dei consumi in funzione del carico effettivo, riducendo la spesa energetica senza compromettere la qualità del servizio.

È importante sottolineare che questi ritorni non sono immediati. La curva di valore è progressiva e dipende dalla maturità iniziale dell’organizzazione. Nelle fasi iniziali, l’impatto può essere limitato a domini specifici; solo quando l’intelligenza artificiale viene integrata in modo trasversale nei processi operativi, il beneficio diventa sistemico.

In definitiva, l’adozione di AIOps non è un costo aggiuntivo da giustificare, ma un investimento trasformativo che, se correttamente governato, può contribuire in modo sostanziale alla sostenibilità economica del settore. La vera variabile critica non è la tecnologia in sé, ma la capacità dell’organizzazione di integrarla in un modello operativo coerente, misurabile e progressivamente evolutivo.

Conclusioni su AIOps e reti autonome

L’evoluzione verso AIOps rappresenta oggi uno snodo decisivo per il settore TELCO e, più in generale, per il governo delle infrastrutture digitali. Non si tratta di introdurre un ulteriore livello di complessità tecnologica, ma di dotare il closed loop operativo di una capacità cognitiva che consenta di anticipare, adattare e ottimizzare in modo continuo il comportamento delle reti. In un contesto caratterizzato da architetture software-defined, convergenza tra networking, computing e sicurezza e crescente distribuzione verso l’edge, l’intelligenza artificiale diventa la condizione necessaria per mantenere il controllo della complessità

Questa trasformazione non è solo tecnica, ma profondamente economica. Gli investimenti richiesti per introdurre AIOps – evoluzione dell’observability, integrazione dei modelli, rafforzamento delle competenze e dei processi di governance – sono significativi ma proporzionati rispetto alla dimensione degli OPEX delle grandi organizzazioni. Le evidenze oggi disponibili indicano che, a maturità raggiunta, AIOps può contribuire in modo strutturale alla riduzione dei costi operativi, con impatti progressivi e con effetti cumulativi che, integrati con l’observability, automazione e zero touch operation, possono avvicinarsi alla soglia del 40% di riduzione degli OPEX nel medio periodo. In un settore in cui i margini sono compressi e i flussi di cassa spesso insufficienti a sostenere nuovi investimenti, questa capacità di liberare risorse operative diventa un fattore di sopravvivenza industriale prima ancora che di vantaggio competitivo.

Allo stesso tempo, l’adozione di AIOps impone una gestione rigorosa dei suoi limiti. Qualità dei dati, robustezza dei modelli, trasparenza delle decisioni e chiara attribuzione delle responsabilità operative sono condizioni indispensabili per evitare che l’autonomia algoritmica generi opacità o instabilità. La maturità di un’organizzazione non si misura dalla quantità di automazione introdotta, ma dalla capacità di governarla, auditare le decisioni e mantenere un equilibrio dinamico tra autonomia e supervisione umana.

Guardando al 6G e alle reti AI-native, questa evoluzione assume una dimensione ancora più strutturale. L’intelligenza artificiale non sarà un componente opzionale, ma parte integrante dell’architettura stessa delle reti, chiamata a orchestrare slicing dinamico, gestione energetica, allocazione distribuita delle risorse e sicurezza adattiva. In questo scenario, la capacità di progettare, controllare e validare sistemi AIOps diventerà una competenza strategica.

Infine, il controllo dei modelli, dei dati e delle piattaforme che implementano AIOps si intreccia con il tema della sovranità tecnologica. Se il “sistema nervoso” delle reti è affidato a logiche intelligenti, il governo di tali logiche diventa un elemento centrale di autonomia industriale e digitale. AIOps non è dunque soltanto uno strumento di efficienza operativa, ma una componente critica dell’equilibrio tra innovazione, sostenibilità economica e controllo strategico delle infrastrutture.

In definitiva, l’introduzione di AIOps segna il passaggio da reti semplicemente automatizzate a reti progressivamente intelligenti e governabili. La sua adozione consapevole, misurabile e orientata ai risultati economici rappresenta una delle leve più concrete per rilanciare la redditività del settore TELCO, preparando al tempo stesso il terreno per le architetture del prossimo decennio.