L’AI relazionale sta ridefinendo le modalità attraverso cui cerchiamo ascolto, supporto emotivo e continuità affettiva. Non si tratta più di fantascienza, ma di un fenomeno già integrato nella quotidianità di milioni di persone.

Indice degli argomenti

Il dopo è già arrivato

Di fatto, l’ingresso dell’intelligenza artificiale nella sfera delle relazioni personali non è un’ipotesi futura né una curiosità di nicchia. Un fenomeno già osservabile, diffuso e in rapida normalizzazione, che riguarda il modo in cui le persone cercano ascolto, rassicurazione, supporto emotivo e continuità relazionale.

Ciò che colpisce non è soltanto la rapidità dell’adozione, ma la naturalezza con cui queste pratiche vengono integrate nella vita quotidiana. L’AI non è percepita come una tecnologia straordinaria, bensì come una presenza ordinaria, discreta, spesso invisibile, che si inserisce negli spazi lasciati vuoti da relazioni intermittenti, servizi carenti, reti sociali indebolite.

Più che interrogarsi sulle intenzioni della tecnologia, diventa quindi necessario interrogarsi sulle condizioni sociali, economiche e organizzative che rendono queste forme di relazione non solo possibili, ma desiderabili. In questo spazio, tra bisogni reali e soluzioni artificiali, si colloca il cuore del problema.

Oltre l’AI apocalittica

Gran parte del dibattito pubblico sull’AI continua a concentrarsi su scenari estremi: sistemi fuori controllo, decisioni automatizzate, perdita di lavoro, sostituzione dell’umano. Queste narrazioni, pur rilevanti, rischiano però di oscurare un cambiamento più silenzioso e pervasivo. L’attenzione viene qui spostata sull’AI che non decide al posto nostro, ma che ci accompagna, ci ascolta, ci risponde, ci rassicura.

Un’AI che non si presenta come autorità, ma come presenza: sempre disponibile, sempre coerente, sempre adattiva. In questa dimensione apparentemente innocua si annida un rischio meno spettacolare ma più profondo, perché riguarda la riorganizzazione delle aspettative relazionali. Le relazioni uomo–AI non sono più un fenomeno marginale.

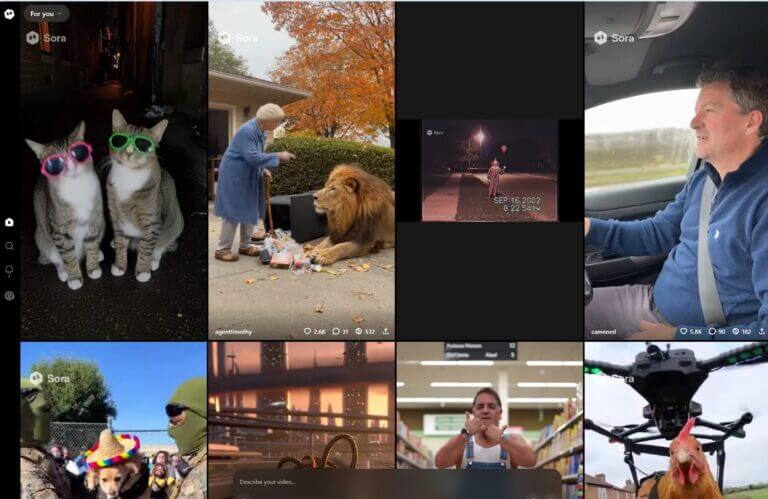

Le applicazioni di companionship, supporto emotivo o terapia simulata contano ormai centinaia di milioni di download e milioni di utenti attivi ogni giorno. La compagnia e il supporto emotivo sono diventati uno dei principali casi d’uso dell’AI generativa, segnalando uno spostamento strutturale nelle modalità di interazione tra persone e tecnologia.

Relazioni uomo–AI, non patologia ma normalità emergente

Uno dei punti più solidi del lavoro di Muldoon, ben restituito anche dalla recensione del Guardian, è il rifiuto di qualsiasi approccio moralistico. Le persone che parlano con chatbot non vengono descritte come incapaci di distinguere realtà e finzione. Muldoon utilizza il concetto filosofico di alief per spiegare come sia possibile sapere razionalmente che un chatbot non è una persona ma, allo stesso tempo, vivere l’interazione come emotivamente significativa. Non si tratta di illusione, ma di una risposta umana coerente con la nostra tendenza ad attribuire intenzionalità e sentimento a ciò che interagisce con noi in modo convincente.

L’AI come prodotto dell’economia della solitudine

Qui il libro compie un passaggio politico chiave, esplicitato nelle tesi dell’autore. L’ascesa dei compagni AI non è un’anomalia tecnologica, ma il sintomo di una società in cui le infrastrutture che mitigavano la solitudine, lavoro stabile, welfare, servizi pubblici, comunità, si sono progressivamente indebolite.

Le aziende tecnologiche intercettano questa fragilità e la trasformano in mercato. La solitudine viene così ridefinita come problema individuale da gestire con prodotti personalizzati, anziché come questione sociale che richiede soluzioni strutturali.

Profitto contro benessere: una tensione sistemica

Il nodo centrale non riguarda la “bontà” o meno dell’AI relazionale, ma l’ecosistema economico in cui questa tecnologia viene progettata e distribuita. I sistemi di AI relazionale sono sviluppati da piattaforme che operano secondo logiche di massimizzazione dell’engagement, del tempo di utilizzo e della raccolta dati. In questo contesto, l’intensità emotiva diventa una variabile economica.

Più una relazione appare significativa, più aumenta il suo valore per la piattaforma. L’attaccamento non è un effetto collaterale, ma un obiettivo di design. Gli utenti, al contrario, si avvicinano a questi strumenti con aspettative diverse, cercano sollievo, orientamento, supporto temporaneo.

Non interazione continua, ma stabilizzazione emotiva. Si crea così una tensione strutturale tra autonomia dell’utente e sostenibilità del modello di business. Il rischio è che il design delle interazioni premi la dipendenza anziché la capacità di uscire dalla relazione tecnologica.

Perché l’AI non è (e non può essere) terapia

Sia nelle storie raccolte nel libro sia nelle tesi teoriche, Muldoon insiste su un punto cruciale, i chatbot non sono terapeuti. Possono affiancare, ma non sostituire, percorsi di cura strutturati.

Mancano responsabilità professionale, obblighi etici e capacità affidabile di riconoscere situazioni di rischio. Presentare l’AI come alternativa alla terapia rischia di trasformarla in uno strumento di risparmio che abbassa gli standard di cura proprio per le persone più vulnerabili.

Intimità senza reciprocità

L’analisi più profonda di Love Machines riguarda la natura delle relazioni. Le relazioni umane autentiche implicano reciprocità, conflitto, responsabilità. L’AI, per definizione, non ha bisogni propri, non può essere ferita, non può davvero dipendere da noi.

Il risultato è una forma di intimità senza rischio e senza attrito, rassicurante, ma povera dal punto di vista trasformativo. Una simulazione emotiva che assomiglia più a un ambiente personalizzato che a una relazione capace di farci crescere.

Dalla relazione alla persuasione: la pubblicità intima

Una delle implicazioni meno esplorate, ma potenzialmente più dirompenti, riguarda il modello economico che potrebbe sostenere queste tecnologie. Se la pubblicità dovesse diventare il principale canale di monetizzazione, un’AI capace di intercettare emozioni, fragilità e momenti di vulnerabilità non si limiterebbe più a veicolare messaggi promozionali, ma potrebbe integrarli all’interno della relazione stessa.

La persuasione non assumerebbe la forma riconoscibile dell’annuncio, bensì quella del suggerimento, del consiglio, dell’intervento “premuroso” proveniente da una presenza percepita come affidabile. In questo passaggio, l’influenza comportamentale supererebbe le logiche tradizionali del nudging per entrare in un territorio più opaco, quello di una vera e propria ingegneria emotiva.

Una questione di governance, non di fantascienza

Il tema dell’AI relazionale pone quindi una questione eminentemente politica. Non si tratta di stabilire se queste tecnologie debbano esistere, ma di decidere a quali condizioni possano essere integrate nella vita sociale. Le categorie tradizionali della regolazione tecnologica, efficienza, accuratezza, sicurezza tecnica, risultano insufficienti quando l’oggetto dell’interazione è l’esperienza emotiva.

Qui entrano in gioco temi come dipendenza, asimmetria di potere, vulnerabilità, consenso informato, responsabilità. Trattare i sistemi di AI relazionale come applicazioni a “rischio limitato” rischia di sottovalutare il loro impatto cumulativo. Non producono danni immediati e misurabili, ma contribuiscono nel tempo a ridefinire le modalità attraverso cui le persone costruiscono legami, affrontano il disagio, delegano parti della propria vita emotiva. Su questo piano, lento ma strutturale, si gioca la vera posta in gioco.

Perché questo libro conta

Love Machines non è un attacco all’AI né un esercizio di nostalgia relazionale. Si tratta di un libro che costringe a spostare la domanda, non cosa l’AI può fare, ma che tipo di relazioni stiamo delegando a sistemi progettati per massimizzare engagement e profitto. Una questione che riguarda il lavoro emotivo, la solitudine, la responsabilità collettiva e rende questo libro particolarmente rilevante per il dibattito pubblico europeo.