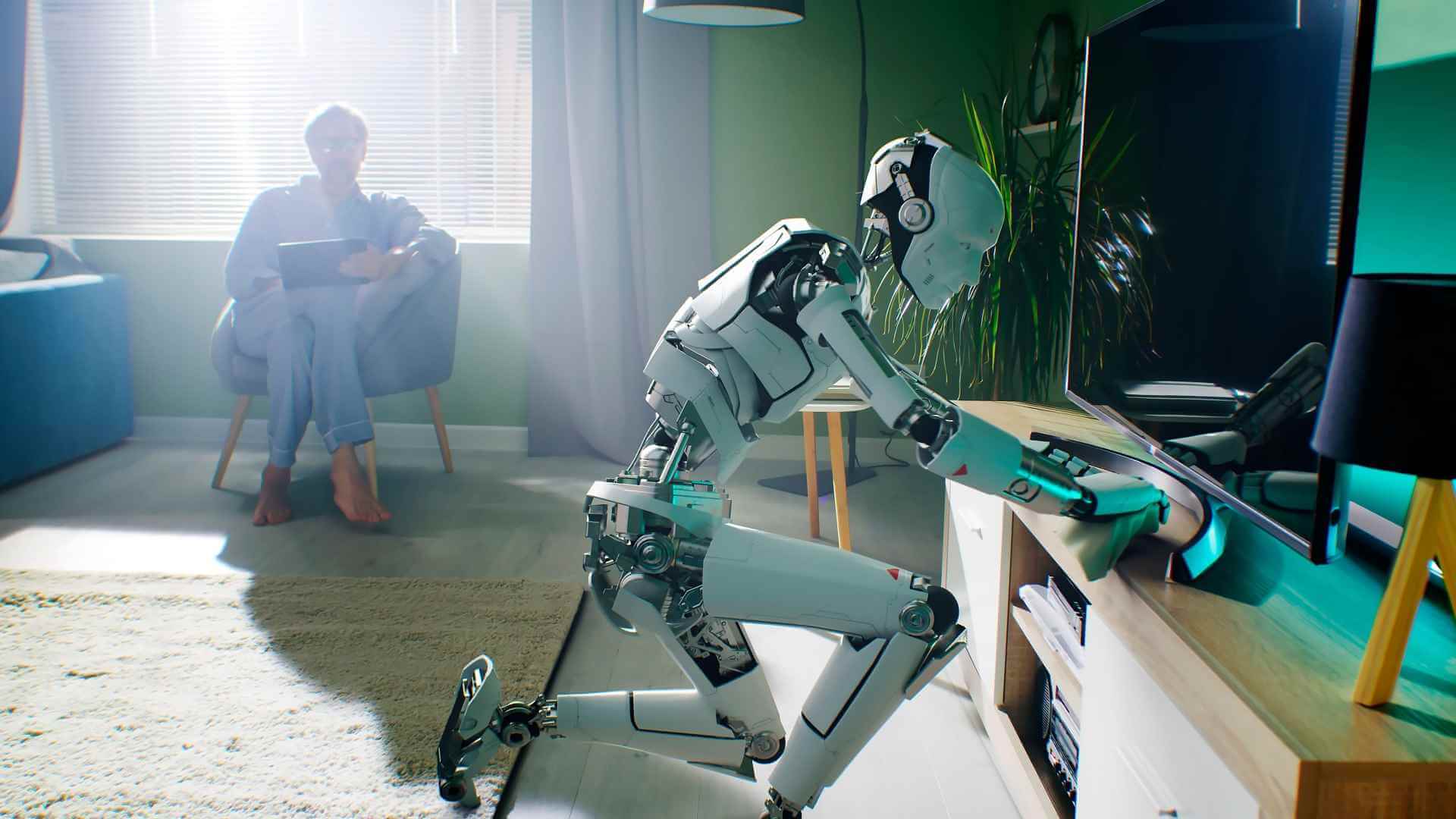

I robot umanoidi vengono raccontati come sistemi sempre più autonomi, ma la loro evoluzione continua a dipendere da una raccolta intensiva di dati prodotti da lavoratori umani. Il caso Micro1 mostra in modo concreto come questa infrastruttura si regga su gesti quotidiani, opacità contrattuale e nuove criticità regolatorie.

l'inchiesta Micro1

Dietro i robot umanoidi c’è lavoro umano globale, precario e invisibile

Dietro l’autonomia dei robot umanoidi emerge una filiera globale di lavoratori che registrano gesti domestici per addestrare le macchine. L’inchiesta su Micro1 mostra come scala, opacità e raccolta dei dati aprano problemi concreti di privacy, sicurezza e tutela del lavoro

Founder & CEO – Management Consultant, Trainer & Startup Advisor

Continua a leggere questo articolo

Argomenti

Canali

InnovAttori

-

L’IA nel turismo corre, ma non per tutti: la mappa italiana e globale

08 Mag 2026 -

AI agentica nel turismo: come cambia il mercato dei viaggi

09 Apr 2026 -

OpenBIM e interoperabilità: perché gli standard aperti sono decisivi in edilizia

03 Apr 2026 -

Competitività europea e sovranità, cosa manca davvero alle startup Ue

01 Apr 2026 -

Come l’AI porta il caffè sulle nostre tavole al tempo della guerra

13 Mar 2026