Il 2025 potrebbe essere ricordato come l’anno in cui l’intelligenza artificiale ha smesso di sembrare soltanto una rivoluzione software e ha mostrato fino in fondo la sua natura fisica.

Dietro modelli sempre più potenti ci sono infatti datacenter sempre più grandi, consumi energetici in aumento, domanda di acqua, emissioni e una nuova corsa globale agli investimenti. È questa la linea più interessante che emerge dal nuovo AI Index Report di Stanford.

Indice degli argomenti

La fotografia del 2025 nel report di Stanford

Lo Human-Centered Artificial Intelligence institute dell’università di Stanford ha pubblicato la nona edizione dell’AI index report. Si tratta di un rapporto che raccoglie informazioni rilevanti sull’AI e l’impatto nella società reale relativamente all’anno passato.

Il rapporto è una miniera di informazioni che mostrano una fotografia sullo stato di avanzamento dell’AI lungo numerosi assi (dalle infrastrutture, ai modelli, all’impatto economico e in settori chiave come la medicina).

Le 423 pagine del rapporto sono piene di informazioni e grafici che raccontano innumerevoli storie di come l’AI stia letteralmente rivoluzionando il mondo, evidenziando eccellenze, miglioramenti e criticità su scala globale. Il rapporto è concepito per essere letto a livelli ma una sua lettura integrale consente di apprezzare anche le interazioni apparentemente scorrelate tra trend differenti.

Perché i datacenter AI sono il vero tema

Dal rapporto di quest’anno credo sia molto importante concentrarsi sull’evidente esplosione di infrastrutture data center necessarie a sostenere la crescita dell’AI con i conseguenti impatti non solo in termini di risorse ambientali ma anche di trasformazione della società umana.

Cerchiamo quindi di capire come il 2025 abbia rappresentato in molti modi una svolta nella crescita di queste tecnologie attraverso una selezione ragionata degli innumerevoli grafici presenti nel rapporto.

Il sorpasso del contenuto generato dall’AI

Il punto di partenza di questa storia non può non essere il sorpasso nella percentuale di contenuto generato dall’AI rispetto a quello generato dall’uomo. Con tutti i difetti che una stima del genere può portare con se è questo grafico sicuramente corrisponde alla mia personale esperienza di navigazione sui social in cui la maggior parte dei post ormai è evidentemente generata piuttosto che creata dai vari content creator.

Si tratta di un aspetto essenziale poiché giustificare gli investimenti in AI ha richiede una domanda e questa necessità di generare piuttosto che creare evidenziata dalla ricerca di Graphite.io rappresenta un elemento rilevante. Resta da capire per quanto gli utenti si faranno affascinare dal contenuto generato e quando vi sarà un effetto di saturazione e magari un calo dell’attenzione rispetto a contenuti che, almeno per ora, sono sicuramente ben fatti ma risultano spesso omologati a un canone che li può rendere poco attraenti al passare del tempo.

Nel 2025 esplodono i modelli notevoli

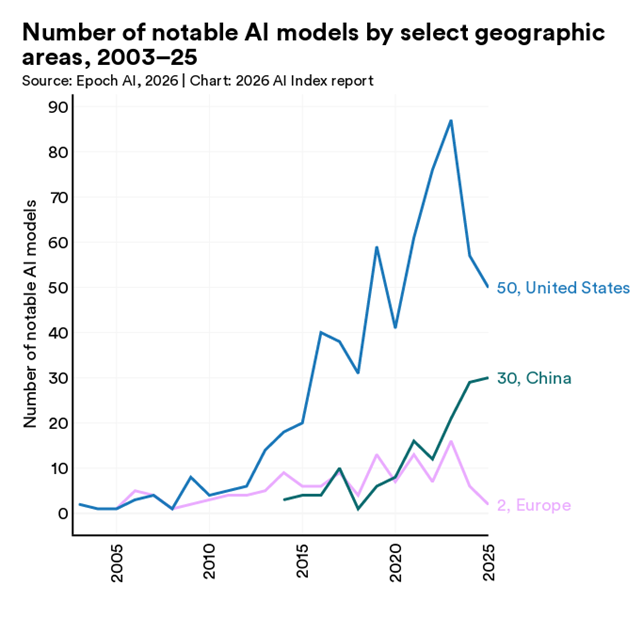

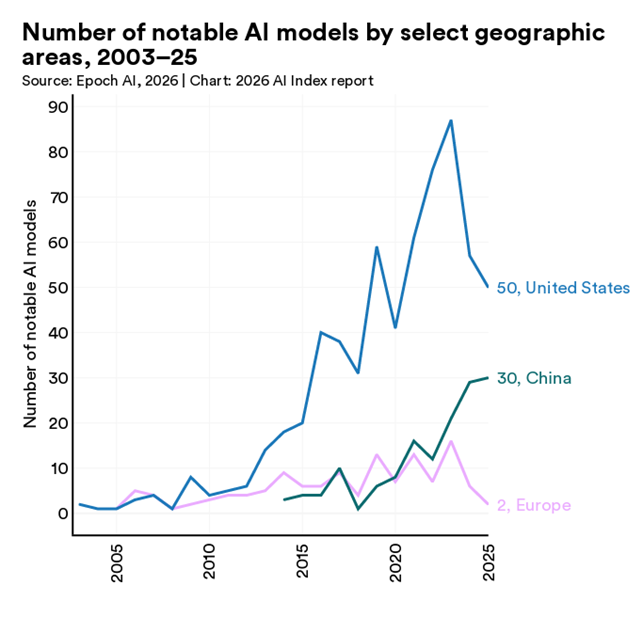

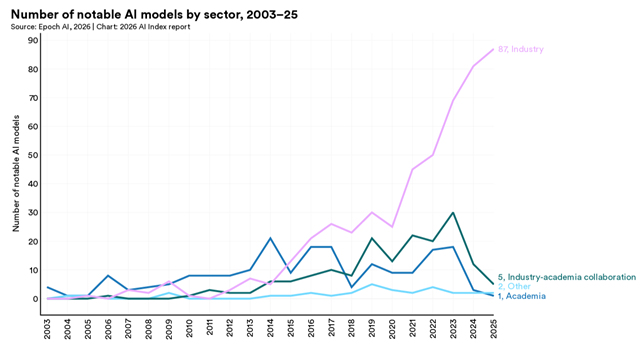

Epoch AI si occupa di manutenere e curare manualmente un database dei modelli di AI con le caratteristiche e le innovazioni che hanno introdotto rispetto allo stato dell’arte. I modelli che avanzano lo stato dell’arte in modo significativo sono etichettati come notevoli (“notable”) e non può non saltare all’occhio come il 90% di questi modelli notevoli presenti nel database siano emersi nel solo 2025.

Il ritardo europeo nella corsa ai modelli

Da una prospettiva globale salta anche all’occhio come solo due su 82 siano Europei, indicando come le politiche comunitarie stentino a supportare e sostenere questo settore strategico.

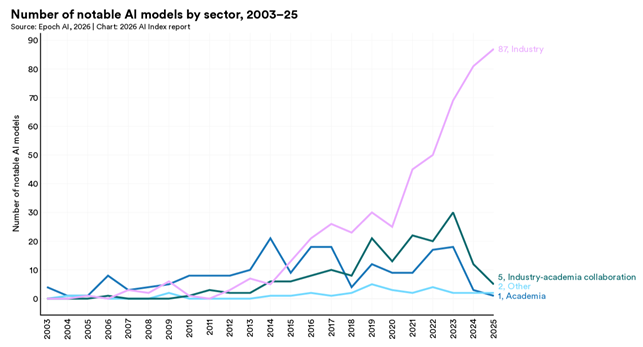

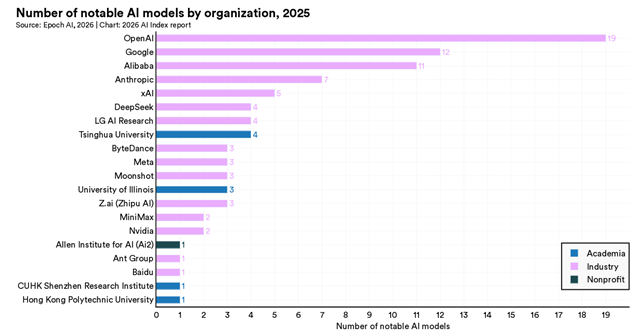

Un ecosistema sempre più chiuso e industriale

È altrettanto interessante osservare come ormai gli investimenti e la maturazione delle tecnologie dell’AI generativa sembrino focalizzarsi solo su aspetti di ottimizzazione industriale con un sostanziale crollo dei contributi da parte della comunità accademica (che sta già lavorando per contribuire ai settori del futuro). Dall’evoluzione dei modelli notevoli emerge anche come si tratti di un gioco per pochi: la creazione di un modello richiede enormi quantità di dati e di risorse per poter essere portata avanti.

Non stupisce quindi che il codice (e i dati) di addestramento dei modelli notevoli siano divenuti ormai sostanzialmente chiusi, rappresentando di fatto un enorme vantaggio competitivo. Non bisogna però essere pessimisti poiché molte delle innovazioni portate avanti trovano spesso poi ricadute nei modelli aperti che poi troviamo in piattaforme come Huggin face.

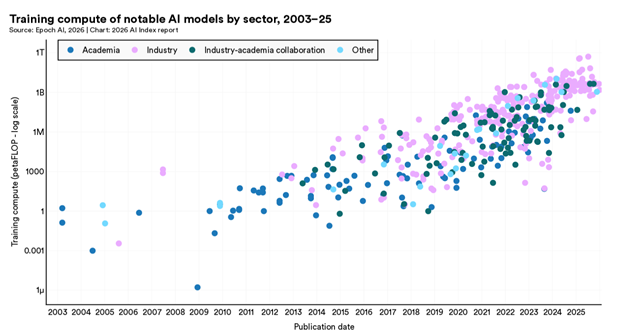

Datacenter AI e fame di potenza di calcolo

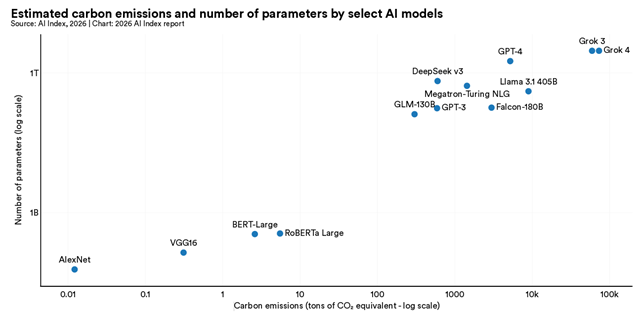

Ecco quindi che addestrare questi modelli enormi che ormai superano i mille miliardi di parametri richiede potenza di calcolo sempre maggiore. Ormai si parla di quasi 1027 di operazioni in virgola mobile per un singolo addestramento, un numero mostruoso che continua a crescere esponenzialmente e che contribuisce ad incrementare la richiesta di capacità di calcolo per poter progredire.

Il motore dell’AI spinge il boom delle infrastrutture

Dal rapporto di Stanford emerge come i modelli richiedano capacità computazionali sempre maggiori sia per l’addestramento che per l’inferenza, e la crescente richiesta di token da parte degli utenti si riflette inevitabilmente sulla crescita del costo computazionale per sostenere la domanda. Che gli investimenti relativi alle AI Factory stiano di fatto turbando il mercato globale spingendo ad una crescita vertiginosa dei prezzi di tutti i dispositivi digitali è cosa ormai nota, ma il report ci consente di dare un volto alla crescita mediante dati oggettivi.

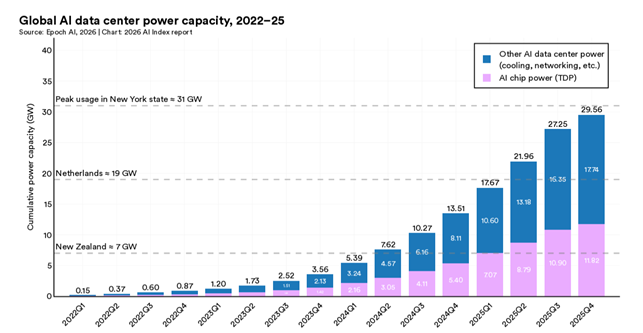

La crescita globale della potenza nei datacenter

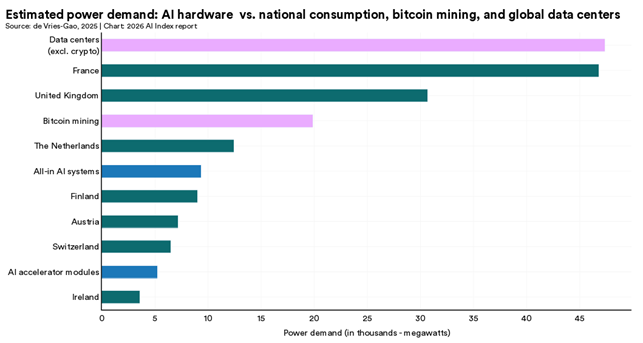

L’evoluzione della potenza complessiva sui datacenter su scala globale è uno dei dati più impressionanti. A partire dall’uscita di GPT si è passati da un decimo di gigawatt a quasi 30GW, un fattore di crescita 300x! Ancor più impressionante è il confronto che il rapporto fa con la potenza usata nel mondo, scopriamo così che i datacenter mondiali assorbono una volta e mezza la potenza necessaria ad alimentare l’Olanda e quasi quella necessaria all’alimentazione dei picchi di richiesta dello stato di New York.

Dove si concentrano i nuovi datacenter nel mondo

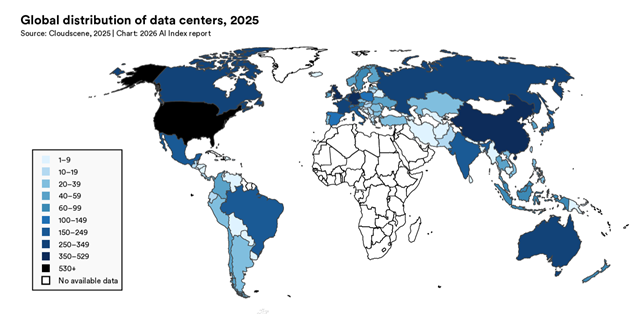

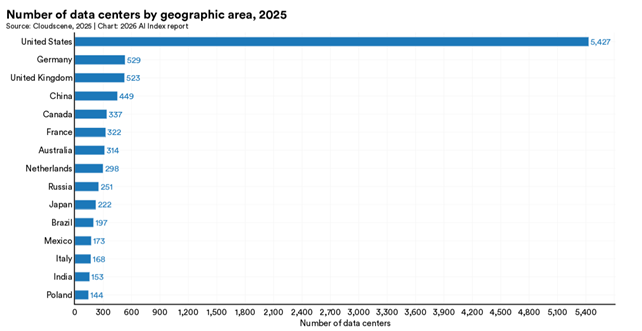

La distribuzione geografica dei datacenter da un’idea degli investimenti e come si distribuiscono su scala globale anche se il rapporto non consente di valutarne la dimensione media. La domanda energetica globale dipende anche dalle infrastrutture realizzate negli ultimi cento anni e dalla capacità territoriale in termini di disponibilità energetica e soprattutto di acqua necessaria ad assicurare il raffreddamento degli apparati.

Sorprende quindi apprendere che l’Italia abbia più di un terzo dei datacenter rispetto alla Cina e addirittura più datacenter dell’India! Sono sicuro che se si confrontasse la potenza dei datacenter i numeri sarebbero molto differenti.

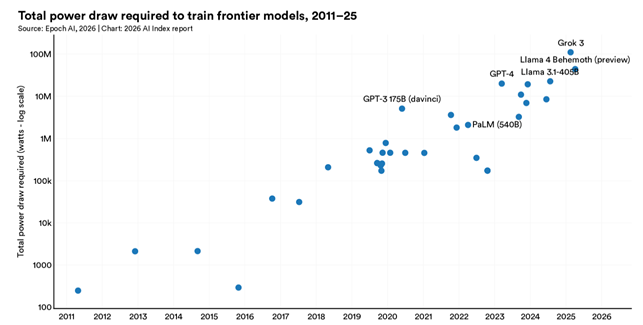

Quanta energia richiedono i datacenter AI per addestrare i modelli

L’addestramento dei modelli rimane un’attività tremendamente energivora richiedendo ormai una potenza di quasi 100MW con una crescita esponenziale a partire dal 2011.

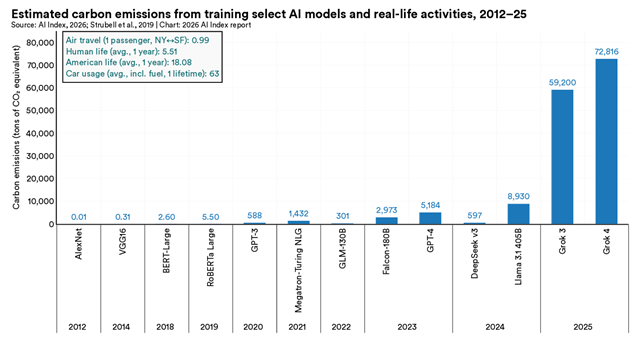

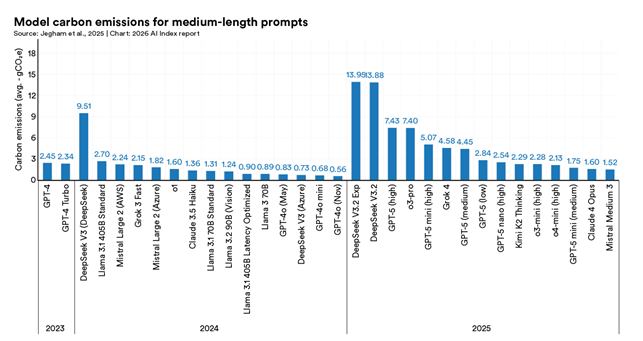

Le emissioni di CO2 dei grandi addestramenti

La crescita della richiesta di energia non può non avere impatto sulle emissioni, portandole emissioni per l’addestramento di Grok 4 a quasi 73mila tonnellate di CO2, considerando che un’automobile emette nel corso dell’intera esistenza solo 63 tonnellate. Un singolo addestramento quindi oggi sembra costare quanto 1000 autovetture in termini di emissioni, con una chiara esplosione nel 2025 di questo parametro.

Non stupisce che le emissioni di CO2 siano proporzionali al numero di parametri dei modelli, ma con l’aumentare dell’impiego di modelli Mixture Of Experts e l’incremento della densità di intelligenza nei nuovi modelli è sempre più difficile da correlare rispetto alle emissioni. Non è un caso che il rapporto menzioni solo Grok e manchino dati relativi ai big come OpenAI e Anthropic.

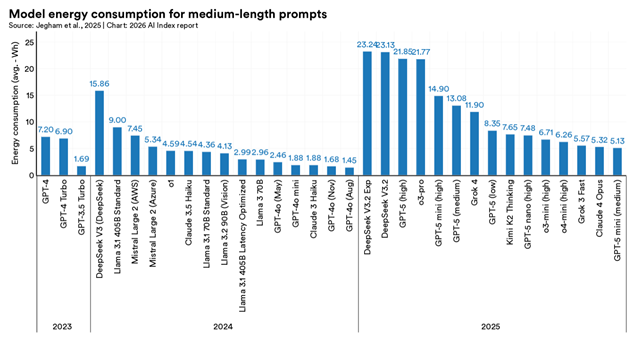

L’inferenza pesa meno, ma i datacenter AI continuano a crescere

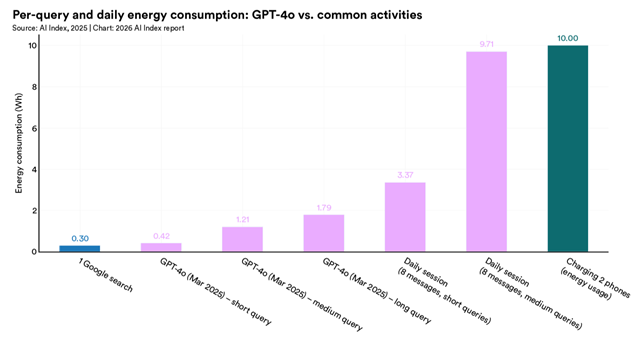

È forse più interessante osservare il costo energetico (e le relative emissioni) per rispondere a prompt di media lunghezza. In questo caso i numeri sono più incoraggianti: a fronte di un incremento di neanche 2x tra il 2024 e il 2025 abbiamo assistito ad un sostanziale miglioramento della qualità delle risposte, a conferma che le nuove tecniche di addestramento consentano di non scaricare sul mero aumento di parametri le capacità dei nuovi modelli.

Resta il fatto che una sessione media giornaliera con query di media complessità con GPT 4o equivale a due ricariche di smartphone.

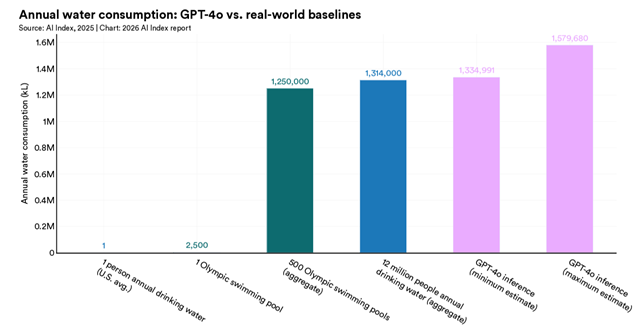

Il nodo del consumo idrico

In termini di consumo idrico le stime che il rapporto propone per l’inferenza effettuata dal modello GPT-4o mostra un consumo equivalente all’acqua potabile usata annualmente da dodici milioni di persone. È quindi evidente come sia necessario affrontare una questione di sostenibilità della crescita di questa tecnologia. Se si continua così c’è il rischio concreto che l’AI cominci ad impattare su altre attività umane come l’agricoltura.

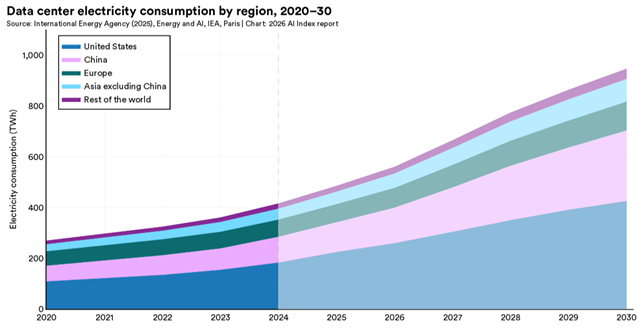

Stati Uniti, Cina ed Europa nella nuova geografia energetica

Se si guarda l’incremento della richiesta energetica per le varie regioni dovuto ai datacenter si nota come Stati Uniti e Cina stiano crescendo più rapidamente dell’Europa e del resto del mondo, anche se è difficile quantificare l’impatto dell’AI cinese visto l’approccio Open che consente l’esecuzione di modelli AI anche al di fuori dei datacenter.

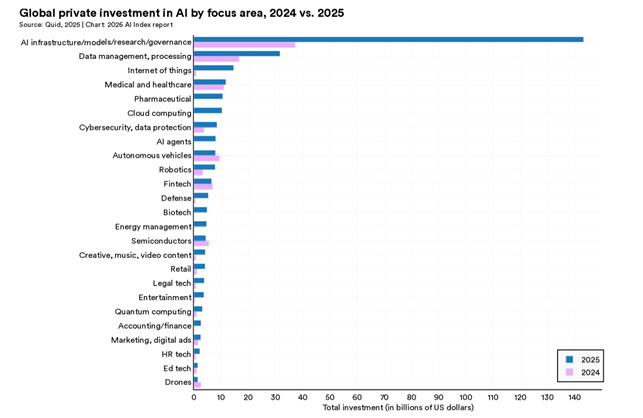

Gli investimenti seguono la corsa ai datacenter AI

I dati relativi agli investimenti in AI mostrano chiaramente come nel 2025 una parte significativa degli investimenti sia andata in AI, superando di quasi dieci volte l’investimento in settori come la farmaceutica.

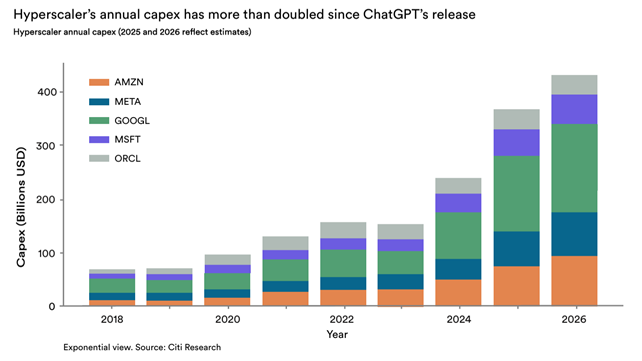

Anche gli investimenti dei grandi hyperscaler sono schizzati alle stelle a partire dal rilascio di ChatGPT nel 2022 arrivando a raddoppiare nell’arco di soli tre anni.

Il 2026 dirà se il modello di crescita è sostenibile

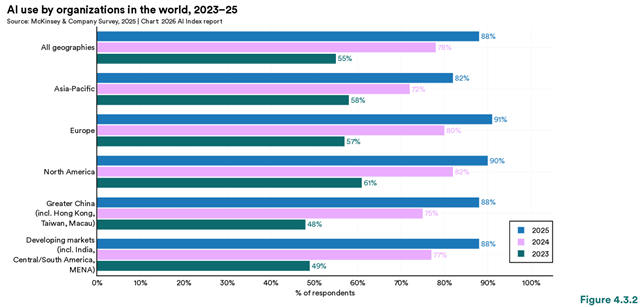

È evidente come l’aumento di domanda di AI da parte di tutte le organizzazioni su scala globale continui a spingere sulla crescita degli investimenti su infrastrutture di calcolo ed energetiche per sostenere la domanda.

Il report mostra come l’ottimizzazione dei modelli e il loro efficientamento non sia sufficiente a compensare l’aumento di domanda, e questo porta i grandi ad investire. Quando però si leggono i numeri in termini di risorse idriche ed energetiche è legittimo chiedersi se la crescita esponenziale potrà proseguire nel corso del 2026, oppure se assisteremo a qualche evento che sconvolgerà il panorama. In ogni caso dal report di Stanford le infrastrutture datacenter a supporto dell’AI emergono come uno dei grandi motori del mondo moderno, e in tutti i casi dovremo farci i conti nel prossimo futuro.