Nelle imprese italiane contemporanee, i manager si confrontano con un overload informativo crescente: volumi di dati che si espandono del 40% annuo circa, secondo analisi settoriali recenti. Questo scenario complica il decision making, rendendo le scelte strategiche spesso intuitive o procrastinate.

Indice degli argomenti

L’impatto dell’AI sui processi decisionali aziendali

L’intelligenza artificiale emerge come strumento per trasformare questi dati grezzi in insight operativi, ma una prospettiva realistica rivela complessità significative. Non si tratta di una soluzione magica, bensì di un leveraggio tecnologico che richiede governance rigorosa, mitigazione dei rischi e integrazione umana per generare valore sostenibile.

Secondo la ricerca degli Osservatori del Politecnico di Milano, in Italia il mercato dell’AI ha raggiunto 1,8 miliardi di euro nel 2025, con una crescita del 50% annuo, trainata dalla Generative AI (GenAI) che rappresenta il 46% del valore e cresce del 60%. La dinamica è guidata soprattutto dalle grandi imprese, che concentrano il 63% della spesa complessiva, mentre la Pubblica Amministrazione pesa per il 19%. Le PMI restano indietro: pur rappresentando il 18% della spesa e dichiarando interesse (69%), solo l’8% ha progetti AI attivi.

Parallelamente, l’adozione nei livelli executive sta cambiando ritmo e perimetro: un’indagine internazionale su 500 dirigenti C-level di aziende con ricavi superiori a 10 miliardi di dollari indica che oltre la metà utilizza già l’AI per orientare decisioni strategiche ad alto impatto, con un percorso di crescita che potrebbe portare l’adozione attiva al 78% entro uno-tre anni. La fiducia in una completa autonomia decisionale da parte di chatbot e agenti nel prossimo futuro è estremamente bassa, attestandosi all’1% tra i dirigenti intervistati.

Trasformare grandi volumi di dati in informazioni strategiche

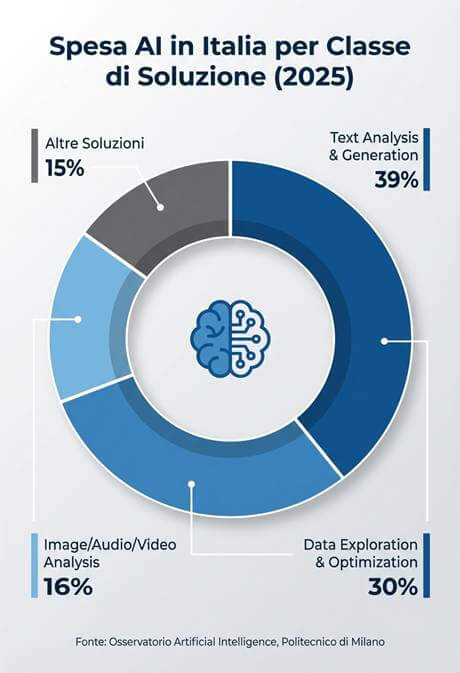

Da questo quadro emerge un punto operativo: l’AI crea valore quando rende ripetibile e misurabile la trasformazione dei dati in decisioni. Nel mercato italiano del 2025, la spesa si concentra su classi di soluzioni che hanno un impatto diretto sui processi decisionali: i sistemi di Text Analysis, Classification & Generation sono al primo posto (39%), seguiti da Data Exploration, Prediction & Optimization(30%) e da soluzioni per Image, Audio, Video Analysis & Generation(16%).

Queste famiglie tecnologiche incidono soprattutto dove le decisioni dipendono da informazioni destrutturate o da segnali deboli: documenti, ticket, verbali, note operative e comunicazioni interne. Non a caso, tra le prime funzioni in cui le grandi imprese attivano iniziative AI compaiono Customer Service, Production & Operations e ICT, con casi d’uso frequenti come chatbot conversazionali e Intelligent Document Processing. Il risultato, quando l’integrazione passa dalle demo ai workflow reali, è un’accelerazione delle decisioni e un ampliamento del set informativo a disposizione del management.

| Dimensione Impresa | Tasso di Adozione AI (2025) | Fonte Dati |

| Grandi Imprese (≥250 addetti) | 53,1% | ISTAT / Agenda Digitale |

| Medie Imprese (50-249 addetti) | 24,8% | ISTAT / AI4Business |

| Piccole Imprese (10-49 addetti) | 14,2% | ISTAT / AI4Business |

| Media Complessiva | 16,4% | ISTAT / Agenda Digitale |

Confronto dei tassi di adozione dell’intelligenza artificiale per dimensione aziendale in Italia. Emerge un marcato divario tra le grandi aziende e le PMI [Agenda Digitale].

Qui si innesta la leva più concreta, spesso trascurata nel dibattito su ai decision making: la sostenibilità economica e soprattutto la prevedibilità del costo. Con la GenAI erogata a consumo tramite API, token e infrastruttura cloud, il costo reale non coincide con il listino del modello ma prende forma nel processo, in particolare quando lo stesso workflow invoca l’LLM più volte, usa contesti lunghi e richiede chiamate iterative. In progetti enterprise, l’architettura diventa quindi una variabile di costo quanto la scelta del modello: caching, riuso di output intermedi, separazione tra ambienti di test e di produzione e riduzione delle chiamate ridondanti incidono direttamente sul TCO e sulla sua stabilità nel tempo.

| Shadow AI: il rischio dell’adozione sommersa Con “Shadow AI” si intende l’utilizzo di strumenti di intelligenza artificiale da parte dei dipendenti per scopi lavorativi senza l’approvazione o la supervisione formale dell’azienda. Sebbene possa nascere dall’esigenza di aumentare la produttività individuale, questo fenomeno comporta rischi significativi, tra cui la perdita di controllo sui dati sensibili, la non conformità normativa (es. GDPR) e vulnerabilità di sicurezza. Nelle PMI, dove la governance IT è spesso meno strutturata, il rischio è particolarmente elevato[AI4Business]. |

In questo scenario, l’offerta italiana resta prevalentemente custom (77%), anche se si osserva una tendenza verso servizi e licenze più standardizzate. E persino con licenze GenAI ready-to-use la misurazione non è automatica: solo circa metà delle aziende prova a valutare i benefici e lo fa soprattutto tramite feedback dei dipendenti. Il punto critico, per chi governa budget e outcome, è evitare che l’adozione proceda per accumulo di iniziative scollegate: senza un allineamento esplicito tra priorità di business, portafoglio di use case e modello operativo, la capacità analitica cresce ma non necessariamente migliora la qualità o la tempestività delle decisioni.

Evitare l’eccessiva dipendenza tecnologica mitigando le allucinazioni

Se l’AI accelera il ciclo decisionale, la fase successiva è gestire ciò che la velocità tende a mascherare: l’instabilità dell’output. Nella GenAI, le allucinazioni sono risposte plausibili nel tono ma non aderenti ai dati di partenza, con effetti diretti su analisi, sintesi e raccomandazioni. Il rischio aumenta quando l’AI viene inserita in workflow ripetitivi: anche scostamenti “minimi” diventano un costo cumulativo in controllo umano, correzioni e rework.

| Le principali barriere all’adozione dell’AI, secondo diverse analisi di settore, non sono primariamente i costi della tecnologia, bensì fattori organizzativi e di governance. Tra i principali ostacoli segnalati dalle imprese italiane figurano: Mancanza di competenze specifiche: la difficoltà nel reperire e formare talenti in grado di gestire e integrare soluzioni AI. Incertezza normativa: i timori legati alla compliance, in particolare con l’entrata in vigore dell’AI Act, e alla gestione della privacy. Qualità dei dati insufficiente: la disponibilità di dati disorganizzati, incompleti o di scarsa qualità che limita l’efficacia dei modelli di machine learning. |

Le barriere segnalate dalle grandi imprese italiane nel 2025 chiariscono perché la dipendenza tecnologica è un problema di processo, prima che di modello: percezione di inadeguatezza dei processi, competenze limitate e compliance normativa. Sul fronte executive, la governance emerge come collo di bottiglia: il 67% dei CXO indica la necessità di regole più chiare su governance e accountability, ma solo il 34% dichiara di avere già framework adeguati. La conseguenza è anche reputazionale: oltre il 70% evita di dichiarare pubblicamente l’uso dell’AI nelle decisioni strategiche, mentre solo l’11% lo farebbe senza riserve.

La mitigazione, sul piano operativo, passa meno da promesse di “modelli perfetti” e più da pattern architetturali e di controllo. In contesti in cui l’adozione viene gestita con logiche di portafoglio e un modello operativo esplicito, si tende a introdurre versioning dei modelli, fallback automatici su modelli alternativi o regole deterministiche e un approccio multi-modello che riserva i modelli più costosi alle fasi davvero ad alto valore. Quando l’AI deve produrre sintesi o raccomandazioni per il management, l’obiettivo pratico è ridurre la superficie di errore: limitare il contesto al minimo utile, rendere tracciabile la catena di generazione e prevedere gate di validazione umana per i passaggi critici.

In un mercato dove la GenAI pesa già per il 46% del valore e l’84% delle grandi imprese con progetti AI ha attivato iniziative GenAI, l’attenzione alle allucinazioni diventa parte della gestione ordinaria. Anche perché l’efficienza non è l’unico indicatore: nello studio sui dirigenti C-level, il 59% segnala riduzioni significative di tempi e costi dei processi decisionali e il 47% un miglioramento della qualità delle scelte, ma la fiducia resta selettiva, con solo il 41% che dichiara un livello superiore alla media nell’impiego dell’AI a supporto di decisioni esecutive.

Costruire un framework decisionale uomo-macchina

Con l’AI che entra in modo più stabile nelle decisioni, il tema si sposta dalla singola sperimentazione a una gestione “a sistema” di valore, rischi e costi. Un framework uomo-macchina non serve a stabilire se l’AI decide al posto del manager, ma quando automatizzare, dove mantenere la responsabilità umana e come rendere verificabili i risultati. I numeri di maturità mostrano un gap: nel 2025 solo il 21% delle grandi imprese dichiara numerose progettualità AI operative e soltanto il 9% una governance integrata e matura. Anche nell’area Omnichannel Customer Experience, l’OCX Index 2025 è 4,4 su 10, in calo rispetto al 2024, segnalando fondamenta tecnologiche e organizzative non ancora solide.

Un approccio che si sta affermando nelle organizzazioni che puntano a industrializzare l’AI prevede allineamento e riallineamento frequenti tra strategia AI e strategia di business, senza isolare AI da digitale/IT e da Data & Analytics. In questa logica, iniziative di mercato come quelle di from9to10 vengono normalmente attivate per tradurre obiettivi e vincoli in roadmap eseguibili, evitando una disconnessione tipica: far crescere il portafoglio di use case più velocemente del modello operativo, con il risultato di non realizzare il valore atteso.

Bilanciare l’automazione con il controllo umano e l’etica

Il collegamento con il tema delle allucinazioni è immediato: più autonomia significa più responsabilità, e la responsabilità non è delegabile. Nelle decisioni di vertice, lo schema che si sta consolidando è quello dell’human in the loop, con l’AI in ruolo di copilota cognitivo e il manager come decisore finale. È coerente con quanto dichiarato dai CXO: la delega totale è considerata marginale (1%), mentre cresce l’uso dell’AI per simulare scenari, stressare ipotesi e individuare pattern nascosti nei dati.

| Obblighi per i sistemi AI ad alto rischio L’AI Act impone requisiti stringenti per le applicazioni considerate “high-risk”. Le aziende che sviluppano o utilizzano tali sistemi devono garantire: Sistemi di valutazione e mitigazione dei rischi. Alta qualità dei dataset di addestramento per ridurre bias e discriminazioni. Logging e tracciabilità completa delle operazioni per consentire verifiche a posteriori. Documentazione tecnica dettagliata sul funzionamento del sistema e sul suo scopo. Informazioni chiare e trasparenti per gli utilizzatori finali. Un adeguato livello di supervisione umana (human oversight) per prevenire o correggere errori. |

Dal punto di vista normativo, l’AI Act introduce un impianto risk-based e impone obblighi specifici per use case high-risk, citando tra gli esempi strumenti per employment e gestione dei lavoratori come software di CV-sorting e casi di credit scoring. Tra le misure richieste rientrano sistemi di risk assessment e mitigazione, qualità dei dataset, logging per la tracciabilità, documentazione, informazioni chiare per chi utilizza il sistema e misure di human oversight. Sul piano temporale, le pratiche vietate risultano efficaci da febbraio 2025; le regole di trasparenza entrano in vigore ad agosto 2026; le regole per gli use case high-risk hanno finestre di applicazione tra agosto 2026 e agosto 2027, mentre la piena applicabilità del regolamento è fissata al 2 agosto 2026. Il riferimento operativo resta la pagina ufficiale sull’AI Act.

Questo sposta il baricentro del framework: l’etica non resta un capitolo di policy, ma diventa un insieme di controlli integrati nel workflow, in particolare dove le decisioni hanno impatto su persone, diritti e reputazione. Il tema competenze è altrettanto vincolante: nella ricerca OCX, solo l’11% delle aziende dichiara skill avanzate, mentre l’adozione corre più veloce della capacità di governarla. Ne deriva la necessità di rituali e responsabilità chiare, incluse review periodiche dell’esecuzione strategica e criteri condivisi per aggiornare modelli e prompt senza destabilizzare i processi. L’AI Act stesso introduce il concetto di “AI Literacy”, un obbligo per le organizzazioni di garantire un adeguato livello di consapevolezza e competenza in materia tra i dipendenti, trasformando la formazione da opzione a un asset strategico per la conformità e la competitività.

Strumenti di reporting e dashboard in tempo reale per manager

Con un framework definito, la parte più visibile per il management diventa l’interfaccia: reporting e dashboard che condensano dati, raccomandazioni e indicatori di rischio in una vista utilizzabile nelle riunioni decisionali. È anche il punto in cui costi e governance diventano concreti, perché un sistema in real time tende a moltiplicare chiamate API, refresh di contesto e richieste iterative.

Le grandi imprese italiane stanno già familiarizzando con strumenti pronti all’uso: l’84% di chi ha progetti AI ha attivato iniziative GenAI e l’84% ha acquistato licenze GenAI ready-to-use, con Microsoft Copilot, ChatGPT Plus e Gemini Advanced tra gli strumenti più diffusi[Teleborsa]. Ma il dato più utile per chi presidia controllo di gestione e performance resta un altro: solo circa metà prova a misurare i benefici e lo fa principalmente tramite feedback dei dipendenti. Se la dashboard è il luogo in cui si “vede” il valore, deve diventare anche il luogo in cui si vede la spesa e la sua variabilità, con metriche per modello, use case e processo.

| I benefici percepiti dai lavoratori L’adozione di strumenti AI, in particolare quelli basati su GenAI, sta già mostrando effetti tangibili sulla produttività individuale. Una ricerca condotta su un campione di lavoratori italiani evidenzia che: Questi dati suggeriscono che l’AI non solo ottimizza il tempo, ma agisce anche come un amplificatore di competenze, abilitando nuove capacità operative. Il 39% degli utilizzatori stima un risparmio di oltre 30 minuti nelle attività recenti in cui ha impiegato l’AI. Il 41% degli interpellati dichiara che l’AI gli consente di affrontare e concludere mansioni che, altrimenti, risulterebbero incompiute o del tutto impossibili da realizzare. |

In termini di design, due pratiche ricorrenti rendono più sostenibile l’AI nei cruscotti direzionali e riflettono anche l’approccio progettuale adottato in iniziative come quelle di from9to10: la segmentazione dei modelli in base al task, per evitare di usare sempre il modello più costoso, e l’orchestrazione dei workflow per ridurre chiamate ridondanti, introdurre caching e separare con rigore test e produzione. In parallelo, dove l’AI entra nella gestione del cliente, la ricerca OCX rileva che l’81% delle aziende investe in AI e che il 38% utilizza AI Agent elementari, mentre solo il 9% adotta agenti avanzati, indicando una progressione per gradi prima di aumentare il livello di autonomia.

- KPI di consumo: token o chiamate per processo e per fascia oraria, per intercettare derive prima del consuntivo.

- KPI di qualità: tasso di correzione umana, scarti su sintesi e raccomandazioni, stabilità dell’output dopo upgrade di modello.

Quando questi indicatori entrano nella routine direzionale, il focus dell’ai decision making si sposta dal “quanto è capace il modello” al “quanto è governabile il processo”, riducendo l’effetto sorpresa tipico delle adozioni che scalano senza un perimetro chiaro di responsabilità, controllo e costo.