La pubblicazione della bozza di Linee guida della Commissione europea sull’attuazione degli obblighi di trasparenza previsti dall’art. 50 del Regolamento (UE) 2024/1689 apre una fase decisiva per la concreta applicazione dell’AI Act. Il documento dell’AI Office interviene sulla categoria peculiare dei sistemi che producono rischi di opacità nella relazione con la persona fisica. L’interesse leggibile nella bozza riguarda la generazione di contenuti artificiali, dalla manipolazione dell’immagine pubblica alla classificazione biometrica e addirittura neuronale.

La scadenza normativa indicata dalla bozza coincide con il 2 agosto 2026, data dalla quale gli obblighi dell’art. 50 troveranno applicazione per i sistemi rientranti nel relativo perimetro. La natura orientativa delle Linee guida, affidata alla funzione amministrativa della Commissione, lascia alla Corte di giustizia dell’Unione europea il compito dell’interpretazione autoritativa, ma conferisce già al testo un valore pratico rilevante per autorità, provider e deployer.

Indice degli argomenti

Trasparenza AI Act e funzione dell’informazione

Il nucleo della disciplina può essere compreso solo a partire dalla funzione dell’informazione. L’art. 50 dell’AI Act affida alla trasparenza un compito che supera la dimensione documentale della compliance. La persona deve conoscere l’origine artificiale dell’interazione o del contenuto nel momento in cui tale origine incide sulla sua capacità di valutazione. Un assistente conversazionale, un avatar, una voce sintetica, un’immagine manipolata, un testo generato per informare il pubblico su una questione di rilievo collettivo partecipano alla formazione di affidamenti, giudizi, decisioni e opinioni. Per questa ragione la trasparenza assume consistenza costituzionale: essa tutela la premessa cognitiva della libertà individuale e della partecipazione democratica.

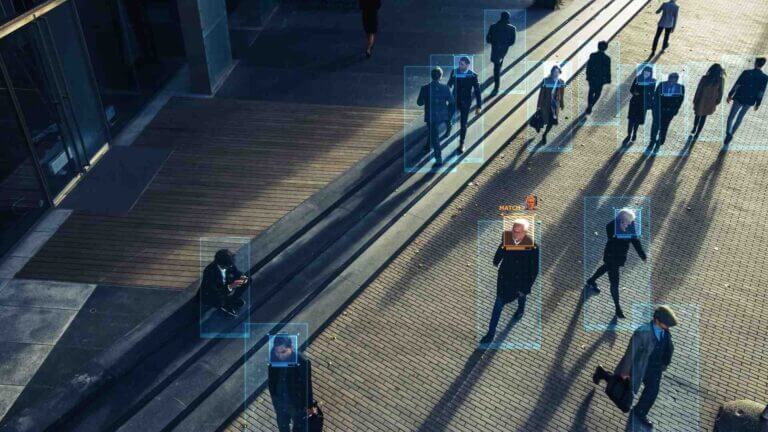

La bozza ricostruisce l’art. 50 attraverso quattro obblighi, distinti per oggetto e soggetto responsabile. Il primo riguarda i sistemi destinati a interagire direttamente con persone fisiche. Il provider deve sviluppare il sistema in modo tale che l’interessato sappia di avere dinanzi un sistema di intelligenza artificiale. Il secondo riguarda i sistemi che generano o manipolano contenuti sintetici in forma di testo, audio, immagine o video. In tale ipotesi, il provider deve predisporre marcature leggibili da macchina e strumenti di rilevazione dell’origine artificiale, attraverso soluzioni tecniche efficaci, interoperabili, robuste e affidabili. Il terzo concerne i sistemi di riconoscimento emotivo e di categorizzazione biometrica, rispetto ai quali il deployer deve informare le persone esposte al funzionamento del sistema. Il quarto investe deepfake e testi destinati a informare il pubblico su questioni di interesse generale, con obbligo del deployer di rendere percepibile l’origine artificiale o manipolata del contenuto.

Obblighi di trasparenza e spazio pubblico

La trasparenza opera come presidio dell’autodeterminazione informativa, della dignità personale e dell’integrità dello spazio pubblico. La Commissione collega espressamente gli obblighi dell’art. 50 alla riduzione dei rischi di impersonificazione, inganno, disinformazione, manipolazione su larga scala e frode, con particolare attenzione agli effetti sui processi democratici e sulla fiducia sociale. Il dato appare decisivo: l’AI Act considera l’opacità dell’origine artificiale come fattore capace di alterare la relazione tra cittadino e realtà comunicativa. Il diritto interviene, dunque, prima della lesione piena e agisce sulla condizione preliminare della libertà di giudizio.

L’obbligo relativo ai sistemi interattivi assume particolare rilievo. La bozza richiede la presenza di un sistema di IA, una destinazione all’interazione, il carattere diretto del rapporto e il coinvolgimento di persone fisiche. L’interazione può avvenire attraverso testo, voce, immagine, ambiente virtuale o presenza robotica; ciò che conta è la possibilità di uno scambio percepibile tra persona e sistema. In questa area si concentrano i problemi più delicati dell’affidamento. Il sistema artificiale può adottare linguaggio naturale, tono empatico, riferimenti personalizzati, simulazione di competenza e prossimità. La persona, in assenza di una informazione adeguata, attribuisce alla risposta ricevuta una qualità relazionale diversa da quella effettiva. La disclosure richiesta dall’art. 50 serve proprio a preservare la misura razionale dell’affidamento.

La norma in esame, al paragrafo 5, impone che essa sia chiara, distinguibile, accessibile e fornita al più tardi al momento della prima interazione o della prima esposizione. La bozza precisa che l’avviso deve risultare percepibile nel contesto concreto e separato dal resto dell’ambiente informativo. Pertanto, una comunicazione dispersa in condizioni contrattuali, documentazione tecnica o livelli secondari dell’interfaccia tradirebbe la funzione sostanziale dell’obbligo.

Provider, deployer e responsabilità funzionale

Tale obbligo riguarda l’intera catena del valore. Il provider risponde della progettazione, dello sviluppo, dell’immissione sul mercato o della messa in servizio del sistema con proprio nome o marchio; rispettivamente il deployer risponde dell’uso del sistema sotto la propria autorità, cioè della decisione di impiego e delle modalità concrete di utilizzo, output compreso.

La norma esprime una logica di responsabilità funzionale, centrata sul potere effettivo di governo della tecnologia e sugli effetti prodotti nello spazio giuridico europeo e si estende anche all’effetto extraterritoriale: gli operatori stabiliti fuori dall’Unione rientrano nel perimetro del regolamento quando l’output del sistema viene usato nel territorio europeo.

Contenuti sintetici IA e verificabilità pubblica

La disciplina dei contenuti sintetici amplia il campo della trasparenza dal rapporto individuale alla struttura dell’ecosistema informativo. Il contenuto generato o manipolato da IA deve poter essere riconosciuto tramite marcature tecniche e strumenti di rilevazione. La funzione di tale obbligo trascende il singolo destinatario: esso abilita autorità, piattaforme, media, ricercatori e società civile a ricostruire l’origine artificiale del contenuto e a preservare la tracciabilità del flusso informativo. In termini costituzionali, la marcatura tecnica diventa una condizione di verificabilità pubblica. Essa incide sulla qualità del dibattito democratico, perché consente di distinguere documento, simulazione, alterazione e produzione sintetica.

Il trattamento delle opere artistiche, creative, satiriche, fittizie o analoghe richiede un bilanciamento accurato. La bozza mantiene l’obbligo di disclosure dell’origine artificiale, ma ammette modalità compatibili con la fruizione e con il normale sfruttamento dell’opera. Il punto rivela la struttura composita della norma: la tutela del destinatario deve convivere con la libertà artistica, con la satira politica, con la produzione audiovisiva e con la sperimentazione culturale. La trasparenza assume qui una funzione di delimitazione, poiché informa il pubblico sull’artificio e preserva al contempo lo spazio costituzionale dell’espressione creativa.

Deepfake, testi informativi e controllo editoriale

La parte dedicata ai testi pubblicati con finalità informativa su questioni di interesse pubblico merita attenzione autonoma. L’art. 50, paragrafo 4, obbliga il deployer a dichiarare che il testo è stato artificialmente generato o manipolato. La bozza collega l’eccezione alla presenza di revisione umana o controllo editoriale e alla responsabilità editoriale di una persona fisica o giuridica. Tale scelta valorizza il presidio umano qualificato: revisione e controllo hanno senso solo se riguardano il contenuto sostanziale, la verifica delle fonti, l’attendibilità dell’informazione, l’assunzione finale di responsabilità sulla pubblicazione. L’automazione testuale, quando partecipa al dibattito pubblico, richiede un centro imputabile di decisione editoriale.

La disciplina delle eccezioni conferma la matrice funzionale dell’intervento europeo. L’uso puramente personale resta fuori dal perimetro degli obblighi del deployer, ma la diffusione pubblica di un deepfake capace di incidere su questioni di interesse pubblico rientra nella logica della trasparenza. La ricerca scientifica riceve tutela entro il perimetro proprio dell’attività di studio e sviluppo. I sistemi open source restano esposti agli obblighi dell’art. 50 quando producono i rischi che la norma intende governare. L’elemento decisivo resta il rapporto tra uso, destinatario, contenuto e impatto informativo.

Trasparenza dell’IA e regolazione europea

La trasparenza dell’AI Act dialoga con protezione dei dati personali dimostrando tutta la natura trasversale della regolazione sull’intelligenza artificiale. La stessa si estende alla disciplina dei servizi digitali, alla tutela dei consumatori e alle regole sulla comunicazione commerciale. Il punto di raccordo sta nella pluralità dei livelli di protezione: l’informazione sull’origine artificiale del contenuto o dell’interazione integra, ma assorbe solo in parte, gli obblighi già derivanti dagli altri settori dell’ordinamento europeo. Da questa stratificazione deriva una tecnica regolatoria che affida alla trasparenza un ruolo comune, pur con funzioni diverse a seconda del bene protetto.

L’enforcement conferisce alla disciplina consistenza effettiva. Le autorità di vigilanza del mercato, l’AI Office e il Garante europeo della protezione dei dati, entro i rispettivi ambiti, partecipano all’applicazione degli obblighi. Le violazioni dell’art. 50 possono condurre a sanzioni fino a 15 milioni di euro o fino al 3 per cento del fatturato mondiale annuo dell’impresa, ove superiore; per istituzioni, organi e organismi dell’Unione, la sanzione amministrativa può raggiungere 750.000 euro. L’apparato sanzionatorio chiarisce la natura dell’obbligo: la trasparenza non appartiene alla cortesia comunicativa dell’operatore, ma al nucleo regolatorio della sicurezza informativa europea.

Articolo 50 AI Act e riconoscibilità del potere tecnologico

La bozza delle Linee guida consente, in definitiva, una lettura costituzionale dell’art. 50 dell’AI Act come norma sulla riconoscibilità del potere tecnologico. Prima della decisione automatizzata, prima della classificazione ad alto rischio, prima della responsabilità per danno, vi è il problema elementare della percezione: sapere se ciò che parla, mostra, persuade o informa proviene da una persona, da una macchina o da una combinazione governata da soggetti professionali. In tale conoscenza minima risiede una quota essenziale della libertà contemporanea. La trasparenza dell’IA tutela il cittadino come destinatario capace di giudizio, il consumatore come soggetto razionale del mercato, la persona come titolare di dignità relazionale, la democrazia come spazio fondato sulla verificabilità del discorso pubblico.