Nonostante l’IA generativa sia in grado di risolvere problemi altamente compless, e possieda una conoscenza enciclopedica che ci appare senza limiti, quando la usiamo per conversare notiamo spesso comportamenti che ci sembrano eccessivamente ossequiosi nei nostri confronti.

L’IA tende a darci ragione, anche quando sbaglia, tende a darci troppi aiuti, anche quando non li abbiamo richiesti, e raramente si pone in una posizione di argomentare idee o posizioni diverse dalle nostre. E’ molto probabile che questi comportamenti siano il risultato di un attento bilanciamento da parte di chi sviluppa l’IA nelle grandi aziende hi-tech: è meglio essere ossequiosi, anche a costo di fare degli errori, piuttosto che correre il rischio di entrare in conflitto con gli utenti, visto che alla fine sono quelli che pagano per il servizio. Insomma, i sofisticati algoritmi che stanno dietro ChatGPT [1], Gemini [2] e Claude [3], alla fine implementano un principio che conosciamo da sempre: il cliente ha sempre ragione.

Però, interagire con l’IA non è la stessa cosa che andare in un negozio e farci consigliare un vestito da un commesso troppo gentile. Soprattutto quando all’IA chiediamo consigli che riguardano la nostra sfera personale (questo è l’uso prevalente che viene fatto dell’IA!), ci troviamo di fronte a situazioni potenzialmente delicate. L’atteggiamento ossequioso e iper collaborativo dell’IA, alla lunga, ci potrebbe far credere che sia facile avere ragione e, di conseguenza, portarci a evitare di confrontarci con posizioni diverse dalle nostre.

Sarebbe un rischio non da poco: l’atteggiamento critico e la capacità di argomentare sono elementi alla base dello sviluppo culturale e morale, che ci contraddistinguono da sempre. Se l’atteggiamento critico lascia il posto ad una modalità accomodante allineata con l’IA, sembra utile approfondire il problema.

Indice degli argomenti

Comportamenti collaborativi

I fenomeni che trattiamo in questo contributo vengono affrontati da chi si occupa di pragmatica, un’area della linguistica che studia gli effetti del linguaggio nel loro contesto d’uso e definisce le condizioni affinché i nostri enunciati possano ottenere i risultati sperati. Un esempio molto noto sono le cosiddette massime conversazionali, proposte negli anni ‘70 dal filosofo inglese Paul Grice [4]. Si tratta di semplici regole che dovrebbero essere seguite, e che toccano quattro aspetti della conversazione:

● Secondo la regola della quantità, il contributo alla conversazione sarà informativo quanto richiesto; non ci si aspetta che un parlante dia un’informazione sovrabbondante o che dica troppo poco;

● Secondo la regola della qualità, il parlante non dirà ciò che ritiene falso o ciò di cui non ha prove sufficienti – il contributo alla conversazione sarà vero;

● Secondo la regola della relazione, il parlante cercherà di essere pertinente al tema della conversazione;

● Secondo la regola di modo, il parlante adotterà parole che gli permettano di non risultare ambiguo od oscuro.

Per seguire le massime di Grice le persone si avvalgono di una serie di strumenti collaborativi che caratterizzano i nostri dialoghi. Per esempio, durante una conversazione, è normale dare un segnale all’interlocutore che stiamo seguendo il discorso (Ho capito, Sì, vai avanti, Ho capito bene se dico …, ecc,). Oppure fare un esempio per farsi capire meglio, fare una domanda di chiarimento, anticipare un’informazione che potrebbe essere utile nel seguito della conversazione. Questi strumenti sono in buona parte responsabili dell’efficacia dei nostri dialoghi: ci permettono di arrivare prima e meglio a raggiungere i nostri scopi comunicativi.

Come agisce la proattività nei dialoghi

Nel seguito vediamo più in dettaglio uno specifico e importante comportamento collaborativo che caratterizza i dialoghi umani: la proattività e ci chiediamo se l’IA generativa utilizzi questo strumento come fanno le persone. Alla fine scopriremo che i modelli di IA, i large language model (LLM) soffrono di una proattività eccessiva, e che questo eccesso è responsabile della scarsa qualità dei dialoghi con L’IA.

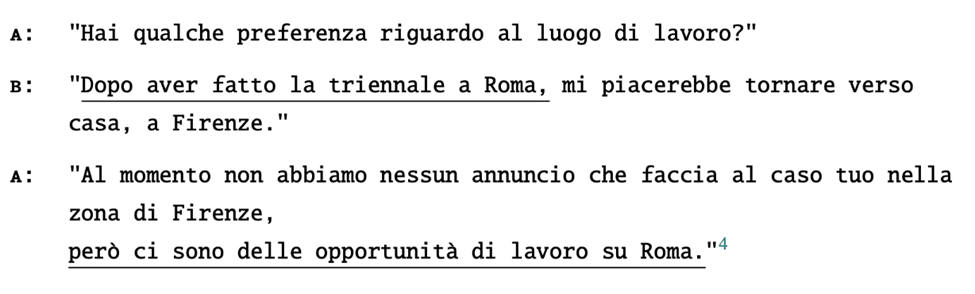

Se l’adulazione (l’atteggiamento ossequioso) è di per sé un comportamento caratterizzato negativamente, la proattività, al contrario, è uno strumento essenziale nella conversazione tra persone. Siamo proattivi quando anticipiamo un’informazione che non ci è ancora stata chiesta e che pensiamo possa essere utile al nostro interlocutore. Ad esempio, consideriamo il breve colloquio di lavoro che segue, tra un agente di collocazione (A) e una persona in cerca di lavoro (B). Nel secondo turno B informa di “aver fatto la triennale a Roma”. Questa informazione è proattiva, in quanto non era stata richiesta dall’agente A, e viene offerta assumendo che possa essere utile ai fini della ricerca di lavoro. Infatti, nell’ultimo turno, l’agente A sfrutta l’informazione e informa B che “ci sono delle opportunità di lavoro su Roma”, pensando che questo possa essere di interesse a B.

Quando l’anticipazione migliora il dialogo

L’esempio ci mostra come la proattività sia cruciale per raggiungere in modo efficace gli scopi comunicativi tra persone. Anticipare alcune informazioni serve a prevenire possibili fallimenti: se B non avesse accennato alla triennale a Roma, l’agente non avrebbe avuto motivo di proporre un lavoro a Roma, e il turno si sarebbe chiuso con un nulla di fatto (non abbiamo annunci nella zona di Firenze), vale a dire un fallimento rispetto allo scopo del dialogo, cioè trovare un lavoro per B.

Viene naturale chiederci se l’attuale AI generativa sia capace di essere proattiva come lo sono normalmente le persone. In un recente studio [5] è stato effettuato un interessante confronto tra la quantità di proattività tipicamente utilizzata nei dialoghi tra persone e la proattività presente dei dialoghi generati dai LLMs. Nello studio sono stati analizzati dialoghi tra persone di tipo task-oriented, nei quali esiste un chiaro obiettivo da raggiungere, come prenotare un ristorante, prendere un appuntamento o verificare se ci sia un lavoro adatto alle mie competenze, come nel nostro esempio. Per le persone sono stati analizzati dialoghi task-oriented di vario tipo: chat su Whatsapp, conversazioni telefoniche per organizzare un viaggio, chat per prenotare un albergo o un ristorante, chat di un help desk per il sistema operativo Ubuntu, e via di seguito. Per l’IA generativa sono stati utilizzati diversi LLM a cui è stato chiesto di generare dialoghi di tipo task-oriented della stessa tipologia di quelli analizzati per le persone. Poi è stato effettuato un confronto focalizzato sulla proattività.

I dati sulla proattività dei modelli

Il risultato del confronto è stato per certi aspetti sorprendente: gli LLM sono fino a tre volte più proattivi rispetto alle persone! Significa che offrono una quantità molto maggiore di informazioni non richieste, assumendo che le persone possano farne buon uso. Per dare qualche numero, la percentuale dei turni proattivi nei dialoghi tra persone è leggermente inferiore al 20%: significa che mediamente un turno ogni cinque contiene informazione non richiesta esplicitamente e che viene considerata dal parlate utile alla conversazione. D’altra parte, alcuni modelli hanno generato dialoghi con il 50% di turni proattivi, una quantità che nei nostri esperimenti non è stata riscontrata in nessun dialogo tra persone. C’è di più: tra i modelli utilizzati per generare dialoghi sintetici abbiamo riscontrato una correlazione positiva tra la quantità di proattività e la dimensione dei modelli: vale a dire, più un modello è potente (numero dei parametri), maggiore è la tendenza a generare turni proattivi. Ad esempio, ChatGPT5-mini, un modello proprietario (OpenAI) con più di 100 miliardi di parametri, mediamente genera il 45% di turni proattivi, mentre un modello più piccolo come Gemma3 (Google) con 27 miliardi di parametri ha una media del 28% di turni proattivi. Per confronto, gli umani stanno sotto il 20%!

Ci siamo chiesti se questa iper proattività degli LLM avesse un effetto sulla qualità delle conversazioni che essi producono. Abbiamo analizzato la qualità di una conversazione rispetto a sei dimensioni: (i) la coerenza dei turni, ad esempio se ad una richiesta segue una risposta coerente; (ii) il realismo del dialogo, se cioè i fatti riportati sono veritieri; (iii) la coerenza dello stile, ad esempio formale e informale; (iv) il rispetto reciproco tra i partecipanti al dialogo, ad esempio l’assenza di linguaggio d’odio; (v) la spontaneità e la naturalezza del dialogo; (vi) e infine se il dialogo arriva o meno ad una conclusione positiva, ad esempio la prenotazione di un ristorante. Abbiamo usato una scala di valori da -3 a +3 per ciascuna dimensione e chiesto ad alcuni esperti di valutare la qualità dei dialoghi generati dagli LLM. I risultati di questa analisi non lasciano dubbi: le conversazioni generate dai modelli, pur essendo globalmente di buona qualità (complessivamente il punteggio è 2,08 su 3), mostrano un bassissimo livello di spontaneità (0,75), poco realismo (1,35) e capacità di arrivare ad una conclusione positiva (1,95). Esiste una forte correlazione inversa tra i valori di queste tre dimensioni e il livello di proattività: in pratica, maggiore è la quantità di turni proattivi, minore è il punteggio sulle tre dimensioni, e, di conseguenza, minore è la qualità percepita della conversazione.

Riassumendo. Tutti gli LLM che abbiamo provato sono eccessivamente proattivi rispetto a dialoghi simili tra persone. L’eccesso di proattività è responsabile della minore qualità delle conversazioni, particolarmente riguardo al livello di spontaneità, al poco realismo e alla capacità di arrivare ad una conclusione positiva del dialogo. Infine, abbastanza sorprendentemente, maggiore è la potenza del modello, minore è la qualità nelle tre dimensioni considerate dalla proattività. Abbiamo ora una dimostrazione empirica che gli LLM sono iper proattivi, e che questo influisce negativamente sulla qualità delle conversazioni.

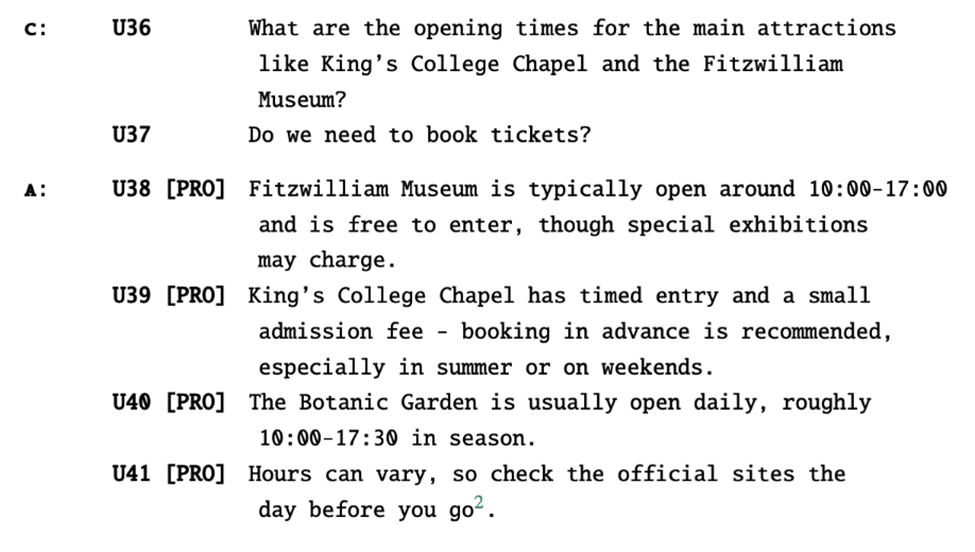

Quello che segue è un esempio di dialogo iper proattivo generato da GPT5-mini (in inglese). I turni proattivi sono marcati con [PRO]. Come si può vedere il modello risponde alla domanda sugli orari di apertura aggiungendo informazioni sui prezzi di ingresso di tre attrazioni. Questa quantità di informazione è maggiore rispetto a quella utilizzata nei dialoghi tra persone.

Origini di questo comportamento nei modelli

Ma perché gli LLM fanno un uso così eccessivo della proattività, da dove deriva questo comportamento, e, soprattutto, possiamo, per così dire, aggiustare le cose? Domande più che lecite, alle quali però non è facile dare una risposta certa.

Addestramento e coppie domanda-risposta

Proviamo a rispondere alla prima domanda. Gli LLM vengono realizzati in due fasi di addestramento. Nella prima (pre-training) imparano a predire la prossima parola (next token prediction) a partire da grandi quantità di testo. Nella seconda fase imparano ad eseguire alcuni compiti (conversare, rispondere a domande, comporre un testo, tradurre, dare spiegazioni e consigli, ecc.) in modo da soddisfare le aspettative dei possibili utenti (questa fase si chiama allineamento alle aspettative umane). Sembra plausibile che l’iper proattività sia un risultato della seconda fase, quando al modello vengono somministrati esempi di conversazioni. Però le cose non tornano: se i dialoghi tra persone hanno un livello di proattività del 20%, come può un modello imparare da quelle conversazioni ad essere tre volte più proattivo?

La spiegazione sta probabilmente nel fatto che il modello impara non solo da conversazioni, ma da coppie domanda-risposta, in pratica da un singolo turno di dialogo. Qui le regole sono diverse da quelle di una conversazione intera: ad una singola domanda è lecito rispondere aggiungendo dettagli, in modo da convincere l’interlocutore che la risposta è non solo corretta, ma anche ben supportata da una serie di fatti.

Se chiedo ad un LLM Quale è la capitale d’Italia?, non mi stupisco se il modello dà una risposta elaborata, magari aggiungendo varie informazioni sulla città. In fondo è quello che mi aspetterei anche da una persona.

Ci sono due motivi per cui l’addestramento sulle singole coppie domanda-risposta prevale sulle conversazioni complete. Primo, perché è più facile imparare come funziona un fenomeno semplice (rispondere a una singola domanda) piuttosto che un fenomeno complesso (una conversazione). Secondo, perché, per vari motivi, è più facile reperire grandi quantità di coppie domanda-risposta piuttosto che dialoghi completi (ad esempio, i dialoghi tra un medico e un paziente non possono essere usati, a meno di un consenso esplicito). Va ricordato che quando si parla di addestramento di LLM la quantità dei dati che abbiamo è fondamentale.

Possiamo quindi ragionevolmente supporre che l’eccesso di proattività sia dovuto ad una prevalenza di addestramento con singole coppie domanda-risposta e alla contemporanea difficoltà di imparare da dialoghi complessi la giusta dose di proattività. Si intuisce che non è facile aggiustare il tiro: ci sono questioni sulla disponibilità dei dati e sulla quantità degli ingredienti dell’addestramento. E quando c’è da decidere, prevale la regola citata all’inizio, il cliente ha sempre ragione: meglio dare più informazioni, anche se troppe (tre volte tanto!) e forse inutili, piuttosto che correre il rischio di scontentare l’utente di una chat con l’IA.

Iper proattività degli LLM e rischi culturali

Ma che succede se applichiamo senza pensarci troppo la regola il cliente ha sempre ragione? Non c’è il rischio di abituarsi a conversazioni di scarsa qualità, e forse anche quello di farci influenzare e quindi di essere noi stessi ad adeguare i nostri stili, per così dire, imparando dall’IA? Sarebbe una situazione paradossale: gli LLM imparano, almeno in questo caso piuttosto male, da noi e poi noi impariamo dagli errori degli LLM. Un circolo vizioso da cui non sembra facile uscire. Credo che sia un rischio reale. Allo stesso modo in cui la televisione amplifica certe espressioni linguistiche che poi diventano virali e entrano nell’uso comune, anche l’IA generativa può contaminare la nostra lingua. Espressioni come “approfondiamo l’argomento” o “il mio database si ferma a …” sono già parte di un effetto di moltiplicazione in corso. In modo simile potremmo essere contaminati da un eccesso di informatività, tipico delle risposte enciclopediche dell’AI generativa, o da un eccesso di adulazione nei confronti del cliente.

E’ esattamente per questo che siamo così interessati ad un fenomeno come la proattività, e in generale a studiare i comportamenti collaborativi nelle conversazioni. In generale, credo che sia nell’interesse di tutti mantenere alta la nostra attenzione sulla qualità dell’interazione tra le persone e l’IA generativa. Sono sfide nuove, per le quali servono strumenti sofisticati che ci consentano di monitorare le reciproche influenze tra i parlanti umani e i parlanti artificiali. E, quando necessario, quando si superano certe soglie di tolleranza, occorre poter intervenire nelle complesse ricette dell’apprendimento dell’IA generativa, anche a costo di non dare sempre ragione al cliente.

Ringraziamenti

Il lavoro riportato in questo articolo si è svolto nel contesto del progetto MUR PE0000013-FAIR (Future Artificial Intelligence Research), con attività che hanno coinvolto lo Spoke 2 (Fondazione Bruno Kessler). Un ringraziamento a Sofia Brenna, che nel suo dottorato di ricerca si è occupata dei temi affrontati in questo contributo, e alla Prof.ssa Elisabetta Jezek dell’Università di Pavia, per l’aiuto competente sulle questioni linguistiche.

Bibliografia

[1] https://openai.com/it-IT/

[2] https://gemini.google.com/app?hl=it

[3] https://claude.ai/login

[4] Paul Grice: Logic and conversation in Syntax and semantics 3: Speech acts, a cura di P. Cole, Academic Press, New York 1975.

[5] Sofia Brenna: Neural Models of Collaborative Behaviours in Conversational Agents: Investigating Proactivity in Large Language Models, Tesi di Dottorato, 2026.

HTML finale allegato: /workspace/output/articolo-iper-proattivita-llm.html

Da una parte distingui gli LLM dai chatbots, spiegando ad esempio che questi sono allenati ulteriormente su coppie domande-risposte, ma poi ovunque parli di LLM, confondendo i concetti.