È in pieno dispiegamento un insieme di forze tecno-finanziarie, che perseguono autonomamente un obiettivo strategico comune: la realizzazione dell’Intelligenza Artificiale Generale, di cui manca in verità una definizione precisa e univoca. Ciò non impedisce che le Big Tech si sforzino di realizzare un sistema di IA dotato di capacità pari o superiori a quelle degli umani in qualsiasi attività[1].

Indice degli argomenti

Coordinate di un mondo iperconnesso

Il raggiungimento dell’AGI è forma (ancora) ipotetica di intelligenza non umana, che sta mobilitando una enorme quantità di risorse, tali da indurre il Wall Street Journal (Ip, 2025) ad affermare che saremmo in presenza di una sorta di “AI boom”. Dal primo quadrimestre del 2023 ad oggi gli investimenti in attrezzature information processing sono infatti cresciuti del 23%, tenuto conto dell’inflazione, mentre il prodotto interno degli USA è aumentato solo del 6%” e la spesa per consumi ha ristagnato.

Tutta questa spesa è stata diretta ad arricchire la dotazione di GPUs (graphic processing units), nuovi chip di memoria, server, strumenti per la gestione di reti nell’addestramento e quindi di lavoro dei chatbot dei Large Language Model. Si tratta di un poderoso aumento della potenza computazionale disponibile e propedeutica ad un suo ulteriore rafforzamento, allo scopo di raggiungere la AGI, chiamata da altri attori “superintelligenza”.

Occorre correlare questo trend molto significativo ad uno scenario generale, caratterizzato da tre elementi non trascurabili[2]:

1) la dinamica accentuata degli investimenti delle Big Tech non è stata accompagnata da flussi di cassa netti altrettanto positivi[3], essendo essi diminuiti del 40% (dal 2023 a 2025) per Alphabet, Amazon, Meta e Microsoft, mentre OpenAI e Anthropic hanno “perso moneta”, nonostante i loro marcati tassi di crescita.

2) Il tasso di crescita degli investimenti in 34 Paesi OECD (Cruz, 2025; OECD, 2025) è 1,6%, ben al di sotto dei livelli precedenti alla crisi globale finanziaria del 2008 (2,5%) e a quella del periodo di diffusione del Covid. Ciò è peraltro avvenuto in presenza di significativi e generalizzati margini di profittabilità.

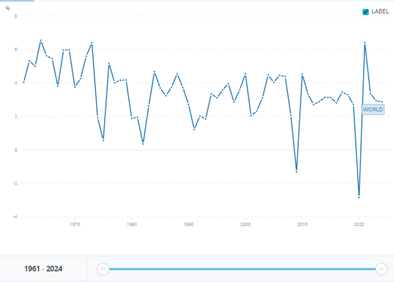

3) Alla stagnante spesa per consumi si è quindi unito il contenimento della propensione ad investire nelle economie, chiaramente collegato al clima di incertezza generale, date le crescenti tensioni geo-politiche e l’insorgere dell’ulteriore fattore squilibrante, costituito dalla caotica politica tariffaria della presidenza USA agli inizi del 2025. 4) Alla luce di quanto appena indicato, non sorprende che i ritmi di crescita dell’economia mondiale abbiano mostrato -nella seconda metà del XX secolo e nei primi del XXI- andamenti alterni intorno rispetto ad una media del 2,8% (Fig. 1).

Fig. 1 Tasso di crescita annuale nel mondo

Fonte: Worldbank (accesso 06-08-2025)

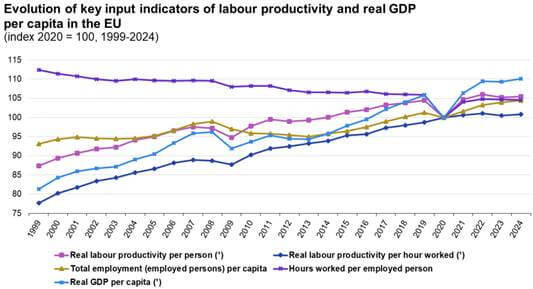

Bisogna tenere presente che il dato complessivo riflette una profonda differenza di comportamento delle economie asiatiche, cresciute a tassi anche superiori al 5%, rispetto a quelle europee e del Nord Atlantico, caratterizzate da valori più bassi. Colpisce, pertanto, che proprio nelle aree dove più intensa è stata la dinamica diffusiva di apparecchiature per l’IA, l’evoluzione degli indicatori economico-produttivi, concernenti la produttività, mostri profili molto più contenuti (Fig. 2)

Fig. 2

Fonte: Eurostat (2025, Fig. 1)

In un orizzonte contraddistinto dalle coordinate appena illustrate, vi sono in realtà attori in grado di formulare piani molto ambizioni per il futuro in un mondo iperconnesso, dove operano una serie infinita di feedback cumulativi tra una sfera informativa in accelerata espansione ed una sfera fisica, “trasfigurata” in serbatoio di risorse materiale senza limiti.

I protagonisti globali della corsa all’AGI

Da quanto esposto finora si evince che le aspettative dei maggiori protagonisti della Silicon Valley devono essere elevate, nonostante il quadro generale non esaltante. Sembra anzi che essi stiano alzando la posta in gioco, se guardiamo al dato di un potenziale computazionale che gli stessi attori stanno incrementando in vista della AGI, di cui esponenti di primo piano della AI prefigurano l’arrivo imminente da almeno tre decadi.

Nel mese di giugno, il blog di Sam Altman (CEO di OpenAI) annuncia la Gentle Singularity: “We are past the event horizon; the takeoff has started. Humanity is close to building digital superintelligence”. L’espressione “orizzonte degli eventi”, evocative della teoria della relatività generale, sta ad indicare il superamento del limite, oltre il quale si apre uno spazio di potenzialità inimmaginabili, che affascinano Elon Musk, nonché molti studiosi e operatori[4], ma l’orizzonte temporale di realizzazione rimane indefinito. Dario Amodei, CEO di Anthropic, ha affermato che la maggior parte delle persone sta sottostimando la radicalità dei potenziali effetti positivi della AGI, la quale potrebbe esserci già nel 2026 “though there are ways it could take much longer”. Secondo Demis Hassabis, CEO di DeepMind, occorrono ancora tra 5 e 10 anni per ottenere un’intelligenza assimilabile o superiore a quella umana, che già da ora è raggiunta in alcuni compiti da sistemi intelligenti, ma sono necessari un numero significativi di step per raggiungere l’obiettivo (Browne, 2025). Robin Li, CEO della cinese BAIDU, ritiene che occorrano almeno dieci anni, nonostante i passi avanti compiuti finora. Yann LeCun, chief scientist a Meta, è apparso meno ottimista parlando in pubblico al World Economic Forum di Davos nel 2024, in quanto ha proiettato la possibilità di una AGI nelle prossime decadi, ammesso che vengano effettuate “scoperte che ancora non conosciamo” (Wodecki, 2024). Invece Jeff Hinton, considerato il “grandfather” dell’intelligenza Artificiale per il suo notevole contributo alla “prima generazione” delle reti neurali del 1986[5], è decisamente preoccupato per la concreta possibilità che possa tralignare. Saremmo, infatti, di fronte ad un punto di svolta tale che si aprono scenari molto pericolosi per l’umanità, come ha affermato in interviste al New York Times, alla CBS “60 minute”, date le potenzialità di sostituire del tutto degli umani (Jackson e Huddleston, 2025) e alterare profondamene la loro percezione della realtà.

A questo punto l’interrogativo in merito a “quanto siamo vicini alla AGI” sembra ad alcuni appropriato, alla luce della corsa intrapresa dalle Big Tech, ma la risposta non può che essere interlocutoria: “AGI won’t arrive overnight, but the first systems that resemble it are already on the horizon” (Scheele, 2025). Un orizzonte indefinito, dunque, dove si riversano ingenti risorse finanziarie, dirette a raggiungere –si perdoni l’irriverenza- l’“Araba Fenice”[6], entità mitologica presente in grandi opere (dalla Bibbia, libro dell’Esodo alla Divina Commedia, Inferno XXIV canto) e simbolo di potenza e resilienza, due proprietà oggi necessarie per affrontare le sfide che si ergono di fronte all’umanità.

La corsa all’AGI e alla crescita esponenziale all’infinito

Il Los Angeles Times del primo agosto scorso (Urbano e Menon, 2025) ha quantificato in 344 miliardi di dollari la spesa complessiva delle Big Tech nella corsa alla Superintelligenza, che vede protagonisti in primo luogo Microsoft, Amazon, Google-Alphabet, Meta. Più in generale, gli analisti stimano investimenti triplicati in capitale operativo, variamente distribuiti negli attori principali della Silicon Valley, nonostante gli aspetti problematici indicati nel primo paragrafo di questo scritto.

Molti fattori stanno influendo in una gara che si svolge a scala internazionale:

1) competizione tecno-economica tra imprese e settori di molti paesi del mondo.

2) Rivalità geo-politiche globali e questioni inerenti alla sicurezza nazionale, soprattutto per i timori relativi alle prospettive di leadership cinese nelle odierne traiettorie tecnico-scientifiche (Rand Corporation: Schlapak et al., 2024: Chase e Marcellino, 2025).

3) Forte desiderio di conseguire tassi di crescita della produttività e dell’economia analoghi a quelli del “trentennio glorioso” post-bellico.

In tale scenario non è casuale che si cerchino strumenti e meccanismi ritenuti idonei per ottenere una preminenza duratura. Nella visione degli attori più impegnati in questo senso la Superintelligenza, se raggiunta per primi, consentirebbe infatti di acquisire vantaggi enormi sugli altri competitor economici e politico-strategici, evitando l’opposto, cioè che altri acquisiscano primazia, con rischio di esserne succubi. Essa potrebbe inoltre consentire di risolvere i problemi più assillanti del genere umano.

Questo tipo di considerazioni ha indotto molti studiosi ad elaborare modelli di simulazione degli scenari possibili, con esiti ovviamente molto differenti. Un modello molto interessante, anche se discutibile, è stato elaborato dal think-tank Epoch AI (Potloges e Ho 2025). L’analisi in questione si propone di stimare una “terza via” tra le opposte visioni (ottimistica e pessimistica) circa gli effetti della AI sulla crescita, mantenendo “un moderato livello di fiducia”, tradotto in determinate assunzioni alla base del modello.

Il modello, denominato GATE (Growth and AI Transition Endogenous), ha come assunzione basilare che il lavoro svolto dall’AI è più “cumulabile” del lavoro umano, quindi “l’aumento nella dimensione della forza lavoro associata con l’ampiezza dell’impiego dell’AI” porta a prevedere una crescita esplosiva, in conseguenza dell’automazione generata da un impiego cumulato di AI e di forza lavoro ad essa collegato. Di qui, traducendo le assunzioni in parametri, GATE stima tassi di crescita esplosivi (>20%) anche in caso di sostituzione di compiti lavorativi pari al 20% e più. Ciò avviene anche introducendo fattori-parametri che contengano le previsioni, quali: 1) possibilità che negli impieghi di AI emerga un divario tra il valore conseguibile teoricamente dalla spesa in R&S e quello effettivo, oppure che si investa meno di quanto stimato nel modello. 2) Introduzione dell’incertezza circa il rendimento degli investimenti, la quale potrebbe ridurre la propensione ad investire. 3) Possibilità che emergano “colli di bottiglia” nei processi di ricollocazione del lavoro durante il processo di automazione.

È a questo punto opportuno riproporre due considerazioni generali, sviluppate dagli autori del modello. Innanzitutto essi ritengono che vi sia una rilevante sottovalutazione di quanto sia oggi il livello di investimenti in AI, molto inferiore a quello ottimale. Occorrerebbe investire di più in AI, perché si potrebbe in tal modo generare un grande ammontare di valore, che resta solo potenziale, in quanto si è paralizzati dalla convinzione che altre tipologie di impiego delle risorse siano più produttive di valore. Esiste quindi un divario tra l’investimento effettivo e quello ottimale, forse causato da fattori quali: barriere normative; trattamenti fiscali sfavorevoli per rendimenti troppo alti degli investimenti; avversione al rischio; conformismo nel modo di pensare. Dal lavoro in questione si evince, pertanto, che sia razionale investire sempre di più sulla base di una ipotesi-chiave: gli sviluppi dell’IA sono tali da generare uno sviluppo cumulativo della stessa IA (self-improvement) e di conseguenza effetti via via amplificati sulla produzione. L’accumulazione di capitale comporterebbe ulteriore impiego del lavoro. Assunzione complementare in questa visione è la piena sostituibilità di capitale e lavoro.

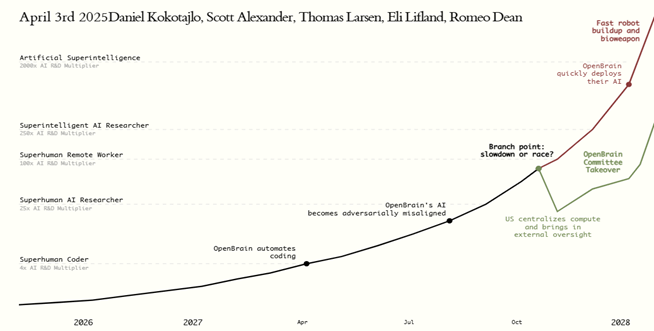

L’idea di agenti artificiali che si autoalimentano, per così dire, e per questa via richiedono impieghi aggiuntivi di competenze umane è il perno di un modello di sviluppo cumulativo, tale da portare alla Artificial superintelligence (ASI), come si evince dalla Fig. 3

Fig. 3

Fonte: AI Futures Project, https://ai-2027.com/summary (accesso 07-08-2025)

Nel 2027 Laboratori di R&S del tutto automatizzati sarebbero in grado auto-generare un’espansione permanente di produzione e del lavoro necessario per realizzare le complementari infrastrutture hardware e software[7]. Siamo in presenza di uno scenario di crescita esponenziale permanente, che sarebbe a portata di mano.

Una rappresentazione analoga del futuro può essere individuata nel lavoro di Trammel e Korinek (2023), secondo i quali la letteratura standard di teoria della crescita sottovaluta le “transformative growth consequences” (ivi: 54) degli odierni processi di automazione, che possono generare shifts nei percorsi pervasivi dell’intera economia e indurre “singolarities that involve ever-increasing growth rates”.

Una delle cause dei limiti dei modelli tradizionali viene attribuita alla prevalenza –nella letteratura economica- di un paradigma concettuale basato sull’assunzione di una crescita costante di lungo periodo, sulla base di studi relativi agli ultimi secoli di sviluppo economico-industriale.

Visioni critiche e limiti dello sviluppo infinito

Il premio Nobel per l’Economia William Nordhaus (2021) esamina un’ampia letteratura di modelli di simulazione del progresso tecnologico, di cui analizza assunzioni e metodologie di ricerca, mettendo al centro della sua riflessione l’ipotesi della Singolarità, così definita: “The idea here is that rapid growth in information technology and artificial intelligence will cross some boundary, after which economic growth will rise rapidly as an ever-increasing pace of improvements cascade through the economy” (Nordhaus, 2021: 299). Nell’analizzare gli studi tiene però presente un punto fondamentale: “The nature of the Singularity is different: it is to replace the unique feature of human labor, which is its intelligence” (ivi: 322)[8] e l’idea di uno sviluppo infinito della produttività è una chimera (Cfr nota 8). Nordhaus considera una varietà di scenari, elaborati da diversi studiosi, mettendo in discussione l’assunzione di piena sostituibilità tra “informazione e sforzi umani” (quindi del lavoro con la tecnologia in crescita esponenziale, ivi: 327), arrivando alla conclusione che non è plausibile lo scenario di un’accelerazione all’infinito della dinamica tecnologica: “So, the conclusion as of today is that ‘the Singularity is not near’.” (Ivi: 326).

Altri due Premi Nobel per l’Economia nel 2024, Daron Acemoglu e Simon Johnson mettono in rilievo aspetti ritenuti meno importanti dagli studiosi “esponenziali”, per così dire. Essi infatti sostengono che i processi di automazione comportano distribuzioni asimmetriche degli aumenti di produttività, perché non generano un sufficiente assorbimento della manodopera sostituita. Partendo da Ricardo e Thompson e dalle loro analisi degli effetti della Rivoluzione Industriale in Inghiltera, Acemoglu e Johnson (2024) pongono l’accento sul fatto che le innovazioni tecnologiche sono sempre accompagnate da cambiamenti delle condizioni politiche: “Both the technological and political pillars of shared prosperity remain important today, including in debates about the potential impact of AI.” (ivi. 600). Le grandi dinamiche innovative del passato sono state sempre caratterizzate da deskilling (la perdita di conoscenze) e disempowerment (perdita di potere) dei lavoratori (ivi: 615).

“Recent evidence also shows that new digital technologies, including robotics, automated equipment, and office automation, have led to declines in the real earnings and employment of workers who used to specialize in tasks that are now being performed by machinery and algorithms (Acemoglu e Restrepo 2020, 2022)[9].

Vale la pena accennare en passant che anche le Big Tech, creatrici dei sistemi più “prossimi” all’AGI, impiegano le ore di etichettatura-classificazione (labeling) di testi e immagini da parte di milioni di africani, sudamericani e anche italiani (Hao, 2025). Si tratta di una enorme massa di persone deskilled and disempowered[10], senza il cui lavoro non sarebbe possibile istruire a costi infimi i chatbot di quella che in Francia viene chiamata intelligence numerique.

La tesi di fondo di Acemoglu e Johnson, su cui sarebbe bene che tutti riflettessero attentamente, è che è necessario imprimere una svolta al progresso tecnologico, in modo da sviluppare un’intelligenza artificiale complementare e non sostitutiva del lavoro, cioè una tecnologia basata su un riequilibrio dei rapporti tra capitale e lavoro (Acemoglu e Johnson, 2024, Par. 7). Ciò richiede come primo pass che si affrontino le questioni cruciali nell’odierna dinamica tecnologica: “the current problems are rooted in the enormous economic, political, and social power of corporations, especially in the tech industry” (Acemoglu e Johnson, 2023, Cap. 11: Redirecting technical change).

Rischi economici e sociali della superintelligenza

Dalla precedente esposizione, sia pure parziale rispetto al volume di lavori in tema, si evince che il discorso sulla AGI o superintelligenza è polarizzato: da un lato coloro che immaginano uno scenario utopico (grande strumento a disposizione dell’umanità, risolverà tutti i problemi che assillano in nostro presente, vivremo in un mondo di produzione illimitata, ecc.), dall’altro sia quelli che sono meno entusiasti (come i premi Nobel indicati nel paragrafo precedente), sia coloro che delineano un futuro distopico. Una recente analisi dell’Economist (2025a) discute le possibili conseguenze finanziarie di uno straordinario periodo di crescita esplosiva, alimentata da elevati investimenti: i tassi di interesse salirebbero a livelli molto alti. Gli investimenti sono necessari per costruire data center e la produzione di energia, oltre che sostenere un’infrastruttura globale idonea a sostenere enormi flussi informativi. Le somme da investire sono talmente elevate da far impallidire i 500mld di dollari stimati per il progetto Stargate di OpenAI, come sostengono anche Potlogea e Anson (2025). Il possesso di capitale diviene molto remunerativo a causa della forte domanda, inducendo pertanto la diminuzione del risparmio. Per tale via le dinamiche finanziarie potrebbero essere “ambigue”, in conseguenza del fatto che le aspettative di elevati rendimenti futuri del capitale avrebbero effetti ambivalenti sui valori correnti di borsa. È superfluo sottolineare che i tassi di interesse elevati possono indurre effetti destabilizzanti, a causa degli alti deficit pubblici in molti Paesi.

L’articolo, già citato, del Wall Street Journal (Ip, 2025) segnala il rischio che si ripeta qualcosa di analogo agli eventi relativi alla precedente crisi della dot.com: creazione di capacità produttiva in eccesso, impossibilità di sostenere rendimenti finanziari elevati, amplificazione con effetti a cascata. Un altro contributo dell’Economist (2025b) mette l’accento sui possibili effetti distorsivi della AGI. Com’è noto, gli odierni chatbot possono essere “sollecitati” ad avere comportamenti ingannevoli (deceptive behavior) ed inoltre pongono problemi di “interpretatbility”, dato che non è ora possibile comprendere come la come la miriade di connessioni tra strati neurali pervenga a certe decisioni.

È positivo che già vi siano tentativi di rimediare a tali problemi, almeno parzialmente, come ha fatto Anthropic. Con agenti artificiali superintelligenti, però, la questione potrebbe diventare fonte di instabilità, dal momento che interventi di questo tipo assorbono risorse e ritardano il raggiungimento della superintelligenza. La conseguenza è un enorme svantaggio rispetto a competitori meno sensibili allo stesso tema, i quali acquisirebbero così un vantaggio competitivo non facilmente recuperabile. Di qui l’esistenza di incentivi a prestare meno attenzione alla sicurezza e quindi i rischi molto maggiori rispetto a quelli posti dai chatbot odierni.

Ovviamente questi pericoli si aggiungono a quelli ampiamente trattati da un’ampia letteratura: diffusione di disinformation e misinformatiom; pericoli di sorveglianza di massa non solo in regimi autocratici; alterazione dei processi decisionali (Hymel, 2025; Akhtar, 2021).

Le posizioni polarizzate (utopiche vs distopiche) continueranno ad essere riproposte da differenti punti di vista ma, per comprendere i motori propulsivi di questa corsa a tecnologie “transformative” come la superintelligenza, è doveroso esaminare ulteriori informazioni[11].

L’AGI come questione geopolitica e militare

Dopo la fine dell’Unione Sovietica e di un assetto globale bipolare, il mondo sembra entrato in un’era variamente definita dagli analisti, ma in ogni caso caratterizzato da uno stato di permanente fibrillazione in una vasta serie di aree geo-politiche. Se Fareed Zakaria (2008) ha descritto un “un post-american world), l’orizzonte geo-politico e strategico mondiale è certo profondamente cambiato con il moltiplicarsi di conflitti locali e l’emergere delle nuove economie, appartenenti a quello che era definito il “terzo mondo”, fino all’aggregazione di Paesi come i BRICS e il Mercosur. Il mondo è diventato multipolare, come argomentano una numerosa set di esperti, tra i quali indichiamo Adam (2024), Ashford e Cooper, 2023), Azevedo et al. (2024), Flockhart (2024), Marcellino et al. (2025), che muovo da angolazioni visuali differenti, ma sono accomunati però dall’idea di una molteplicità disarmonica di aggregazioni geo-politiche.

Il numero elevato di tensioni geo-politiche, unite a rivalità interstatali e inter-etniche di lunga durata, è all’origine delle numerose guerre attualmente in atto nel Pianeta, mentre aumentano i confronti “indiretti” tra potenze nucleari e aumenta la rivalità Cina-USA, fino a ipotizzare la possibilità di una cold war tra le due (United States Institute of Peace, 2025). In ogni caso, come mettono in luce due analisti della Rand Corporation (Mitre e Predd, 2025) vi sono cinque problemi di sicurezza nazionale da affrontare nella dinamica delle relazioni USA-China, durante questa transformative era, gravitante sulla corsa all’AGI. I problemi sono discussi in Mitre e Predd (2025) e sintetizzati nella Tabella 1 (Fonte: Chase e Marcelino, 2025)

NB: PRC è l’acronimo di People’s Republic of China. WMD sta armi di distruzione di massa. Wonder weaponi si riferisce ad “armi speciali” come la AGI.

Le molteplici combinazioni di strategie, nello sviluppo delle relazioni USA-Cina, mostrano chiaramente, secondo gli analisti della Rand Corporation, come la AGI sia destinata ad assumere un ruolo decisivo. È allora logico dedurre che vi sono imperativi geo-strategici ineludibili per le autorità USA, tra cui in primis quello di essere protagonisti della arms race (corsa agli armamenti) verso la superintelligenza, qualunque cosa essa sia.

Appare legittimo ipotizzare che di qui derivano gli accordi recentemente intercorsi tra Organismi pubblici USA e Big Tech:

1) Pochi settimane or sono Palantir ha firmato un contratto decennale di 10 mld di dollari con l’esercito americano. L’accordo sistematizza 75 accordi di prestazioni di alta tecnologia informatica e rende Palantir “core infrastructure for how America wages war – and increasingl, how it runs everything else”, con grandi margini di guadagno (Shannon, 2025a).

2) In giugno, OpenAI ha firmato un contratto per 200mln di dollari con il Dipartimento della Difesa USA al fine aiutarlo nel definire come le capabilities di frontiera dell’artificial intelligence possono essere impiegate in una gamma di attività, che vanno dalla sanità militare ai di sistemi di difesa cibernetica. A questo fine OpenAI ha costituito un’apposita unità (OpenAI for Government) con l’obiettivo di esplorare “the frontier AI capabilities to address critical national security challenges” a fini di “warfighting and enterprise domains”, frasi contenute negli annunci ufficiali, ma prive di dettagli e riportate in Shannon (2025b). L’impresa rivale di OpenAI, cioè Anthropic, sta lavorando con Palantir per fornire modelli di AI alle agenzie di difesa e di intelligence, mentre Anduril –partner di OpenAI in materie per la difesa- ha avuto l’anno scorso una commessa per 100 mln di dollari dal competente Dipartimento USA.

Occorre poi tenere presente che Sam Altman appare sempre più spesso a fianco di Donald Trump, che visita di frequente alla Casa Bianca per promuovere il Progetto Stargate (500mld di dollari per infrastrutture relative all’artificial intelligence), a cui si aggiunge l’annuncio di trattative con l’Arabia Saudita inerenti ad attività per molti miliardi di dollari.

Il quadro diventa ancora più chiaro (e problematico) se si mette a fuoco un evento molto significativo (Snow, 2025): in giugno manager di Meta, OpenAI e Palantir hanno giurato in qualità di ufficiali della Riserva dell’Esercito, per la cui attività il Presidente Trump ha intenzione di attivare un budget per un trilione di dollari.

Questi spunti conoscitivi, ovviamente ancora solo parziali, inducono a immaginare quali siano le ragioni profonde della intensa dinamica degli investimenti delle Big Tech. Qualche elemento di preoccupazione insorge dalle nubi oscure che si profilano all’orizzonte mondiale, dove sembra configurarsi il rischio –molto serio- di non potere distinguere nella sfera del potere politico-militare tra input pubblici e input privati. Intanto un’asimmetria cognitiva crescente tende a consolidarsi tra i secondi e i primi, dato che nell’odierno mondo fisico-cibernetico competenza e potere tendono ad essere simbiotiche.

Bibliografia

Acemoglu D. Lensman T., 2024. Regulating Transformative Technologies, American Economic Review: Insights,6 (3): 359–76.

Acemoglu D, Johnson S. 2023. Power and Progress: Our Thousand-Year Struggle over Technology and Prosperity, New York, PublicAffairs.

Acemoglu D., Johnson S., 2024, Learning From Ricardo and Thompson: Machinery and Labor in the Early Industrial Revolution and in the Age of Artificial Intelligence, The Annual Review of Economics, 16: 597–621.

Acemoglu D, Restrepo P., 2020, Robots and jobs: evidence from US labor markets, J. Political Economy. 128(6):2188– 244.

Acemoglu D., Restrepo P., 2022. Tasks, automation, and the rise in U.S. wage inequality, Econometrica,90(5):1973–2016.

Adam R.G., 2024, Propsect for a multipolar world, GIS Report, Lichtenstein, November 29.

Akhtar A., 2021, The singularity is Here. Artificial intelligent advertising technology is poisoning our societies, The Atlantic, November 5.

Ashford E., Cooper E., 2023, Yes, the World is Multipolar, Foreign Affairs, October 5.

Azvedo et al., 2024, An Evolving BRICS and the Shifting World Order, International Trade, April 29.

Browne R., 2025, AI that can match humans at any task will be here in five to 10 years, Google DeepMind CEO says, CNCBC News, March 17.

Chase M., Marcellino W., 2025, Incentives for U.S.-China Conflict, Competition, and Cooperation Across Artificial General Intelligence’s Five Hard National Security Problems, Rand Corporation, August 04. https://www.rand.org/pubs/perspectives/PEA4189-1.html

Cruz I., 2025, Global growth under threat, Financial Times, August 5.

Dorsen A., 2022, AI is plundering the imagination and replacing it with a slot machine, Bulletin of Atomic Scientists, October 27.

Flockhart T., 2024, NATO in the multi-order world, International Affairs,100: 2, 471–489.

Gebru T., Terres E.P., 2024, The TESCREAL bundle: Eugenics and the promise of utopia through artificial general intelligence, First Monday, Volume 29, Number 4, Apri 1.

Hao K: 2023, Empires of AI. Dreams and Nightmares in Sam Altman’s AI, Penguin Press.

Hymel Cory, 2025 Are we getting dumber? How AI affects critical thinking, Fortune, March 31.

Ip G., 2025, The AI Boom’s Hidden Risk to the Economy, Wall Street Journal, August 5.

Jackson A., Huddlestone T. Jr, 2025, There’s a ’10% to 20% chance’ that AI will displace humans completely, says ‘godfather’ of the technology, CNBC, June 17.

Marcellino et al., 2025, The Rise of Generative AI and the Coming Era of Social Media Manipulation 3.0: Next-Generation Chinese Astroturfing and Coping with Ubiquitous AI, Rand Corporation, July 11, https://www.rand.org/pubs/perspectives/PEA2679-1.html

Mearsheimer J.J., 2018, The Great Delusion: Liberal Dreams and International Realities, Yale University Press.

Mitre J., Predd J.B., 2025, Artificial General Intelligence’s Five Hard National Security Problems, RAND Corporation, February, https://www.rand.org/pubs/perspectives/PEA3691-4.html

Nordhaus W.D., 2021, Are We Approaching an Economic Singularity? Information Technology and the Future of Economic Growth, American Economic Journal: Macroeconomics,13(1): 299–332.

OECD, (Dlugosh D. et al.,), 2025, Understanding the weakness in business investment: A cross-country analysis, N. 1836.

Potlogea A, Ho Anson, 2025, AI and explosive growth, Epoch AI, June 20.

Scheele J., 2025, The Road to AGI: How Close Are We to Human-Level Artificial Intelligence?

The Medium April 25.

Shannon C., 2025, Palatir has become the AI arms dealer of the West, Quartz, May 8.

Shlapak D.A., Ohlandt C.J.R., Schmid J., 2024, Measuring China’s Technology and Science Progress. A Framework for Assessing Advances Affecting Military Capabilities, Rand Corporation, April 24, https://www.rand.org/pubs/research_reports/RRA658-4.html

Snow J., 2025, How Big Tech learned to love America’s military, Quartz, June 25.

Subin S., 2025, Palantir lands $10 billion Army software and data contract, CNBC, August 1.

The Economist, 2025a, What if AI made the world’s economic growth explode? The Economist, July 27.

The Economist, 2025b, AI labs’all-or-nothing race leaves no time to fuss about safety, July 24.

Trammel P. Korinek A., 2023, Economic Growth under Transformative AI, NBER, October.

Tripeni M.C., 26-04-2025 AGI: Fear and Loathing in Silicon Valley

United States Institute of Peace, 2025 The Perils of a Cold War Analogy for Today’s U.S.-China Rivalry, June 10.

Urbano B.T., Menon N., 2025, The AI Race has Big Tech spending $344 billion this year, Los Angeles Times, August 1.

Wodecki B., 2024, Meta’s LeCun Debunks AGI Hype, Says it is Decades Away, AI-Business, January 23.

Zakaria F., 2008, The Post-American World, Norton & Company.

[1] Si veda, per esempio, la definizione dell’IBM: “Artificial general intelligence (AGI) is a hypothetical stage in the development of machine learning (ML) in which an artificial intelligence (AI) system can match or exceed the cognitive abilities of human beings across any task. It represents the fundamental, abstract goal of AI development: the artificial replication of human intelligence in a machine or software.” https://www.ibm.com/think/topics/artificial-general-intelligence.

[2] Altri, cruciali, saranno considerati nel Par. 4.

[3] I flussi di cassa netti sono definiti come la differenza tra i ricavi operativi e gli investimeni

[4] Si veda a questo riguardo l’analisi sistematica di Gebru e Torres (2024).

[5] Il libro con cui è iniziata la cosiddetta “rivoluzione” Exploration in the delle reti neurali è D. Rumelhart, J.L. Mc Lelland and the PDP Group (di cui Hinton era un esponente di punta), Parallel Distributed Processing, Exploration in the Microfoundations of the Cognition.

[6] Il riferimento è al detto proverbiale “L’Araba Fenica, che ci sia ognun lo dice, dove sia nessun lo sa”.

[7] A meno che non siano contemporaneamente attivi sistemi robotizzati che si autoproducano secondo le necessità, quindi in grado di provvedere a tutto questo.

[8] Il passo continua così: “Labor productivity doubles when the number of pilots in an airplane goes from two to one, but it goes up infinitely when the number of pilots goes from one to zero for drones.”

[9] “ In the meantime, AI and other new tools are also intensifying surveillance and shifting the balance of power from labor to capital (Acemoglu e& Johnson 2023)”

[10] In Kenia sono pagate da 1,50 a 2,70 euro l’ora per un’attività fortemente usurante, che dà origine a disturbi pari allo stress post-traumatico.

[11] Tralasciamo in questa sede i costi enormi in termini di acqua, impiegata per contenere la temperatura dei server, e di elettricità. Entrambe le tipologie di risorse sono destinate ad aumentare in misura esponenziale, il che sta già spingendo le Big Tech ad elaborare progetti di micro-reattori nucleari.