In questa primavera 2026 l’impatto dell’intelligenza artificiale sulla cyber security globale ha avuto una improvvisa accelerazione. Tanto che alcuni ora temono una imminente armaggedon informatica.

- Il 7 aprile Anthropic ha annunciato Project Glasswing e l’accesso ristretto (solo per 50 grandi aziende) a Claude Mythos Preview, presentato come modello in grado di aiutare a individuare e correggere vulnerabilità nei software critici;

- il 14 aprile OpenAI ha risposto lanciando GPT-5.4-Cyber e ampliando il programma Trusted Access for Cyber a migliaia di difensori verificati e centinaia di team, mantenendo però l’accesso al modello più permissivo in una distribuzione iniziale limitata a vendor di sicurezza, organizzazioni e ricercatori verificati.

I modelli AI stanno già accelerando la discovery di vulnerabilità su software legacy e open source. Dati di HackerOne indicano che le segnalazioni di bug sono aumentate del 76% su base annua e il tempo medio di remediation è salito da 160 a 230 giorni.

È vero che OpenAi e Anthropic hanno avuto il senso di responsabilità di limitare l’accesso di questi modelli ai buoni, ossia ai difensori, per dare loro un vantaggio sui cattivi.

Ma è bene non farsi illusioni. Il vaso di pandora della cybersecurity AI si è aperto. Non passerà molto tempo che, anche con tecniche di distillation, arriveranno modelli aperti con pari capacità disponibili per gli attaccanti. Cyber criminali per altro hanno già dimostrato di essere in grado di usare con jail break I modelli OpenAI e Anthropic per finalità di hacking su ampia scala.

Indice degli argomenti

La cyber kill chain AI entra nel radar strategico

Non a caso, tra il 15 e il 16 aprile la BCE e il sistema bancario tedesco hanno iniziato a confrontarsi con i rischi specifici posti da Mythos per infrastrutture legacy e resilienza operativa.

Dopo la presentazione di Mythos, Scott Bessent, segretario al Tesoro degli Stati Uniti, e Jerome Powell, presidente della Federal Reserve, hanno convocato le principali banche americane per discutere dei rischi per la sicurezza informatica legati all’intelligenza artificiale.

L’evoluzione recente dell’intelligenza artificiale generativa e degli agenti autonomi sta profondamente quindi modificando il panorama della cybersecurity. Due i principali trend che emergono con forza: da un lato, modelli come Claude Mythos Preview e GPT-5.4-Cyber sempre più efficaci nell’individuare vulnerabilità software su scala senza precedenti; dall’altro, modelli avanzati che iniziano a supportare anche attività di exploitation e sviluppo di codice malevolo. Il risultato è una trasformazione progressiva dell’intera cyber kill chain, con implicazioni che vanno ben oltre il semplice incremento dell’efficienza degli attaccanti. Questo fenomeno ha portato alcuni osservatori a parlare di una possibile fase di “bugmageddon”, in cui il numero di vulnerabilità scoperte cresce più rapidamente della capacità di remediation delle organizzazioni.

A questo scenario tecnologico si aggiunge però una dimensione sempre più centrale: quella geopolitica. L’accesso ai modelli AI più avanzati non è uniforme, ma selettivo, controllato e in larga parte concentrato nelle mani di pochi attori privati statunitensi. Come emerso dai casi di Claude Mythos Preview, distribuito da Anthropic attraverso Project Glasswing a partner selezionati, e di GPT-5.4-Cyber, reso disponibile da OpenAI in una fase iniziale a vendor di sicurezza, organizzazioni e ricercatori verificati attraverso i livelli più alti del programma Trusted Access for Cyber, la disponibilità di queste tecnologie viene oggi gestita in modo selettivo e controllato, con una concentrazione iniziale soprattutto nell’ecosistema statunitense. Questo crea una nuova forma di asimmetria: non solo tra attaccanti e difensori, ma tra Stati e blocchi geopolitici.

I difensori devono quindi considerare l’accesso ai modelli AI come un fattore strategico, valutando dipendenze tecnologiche, limiti operativi e implicazioni di sovranità.

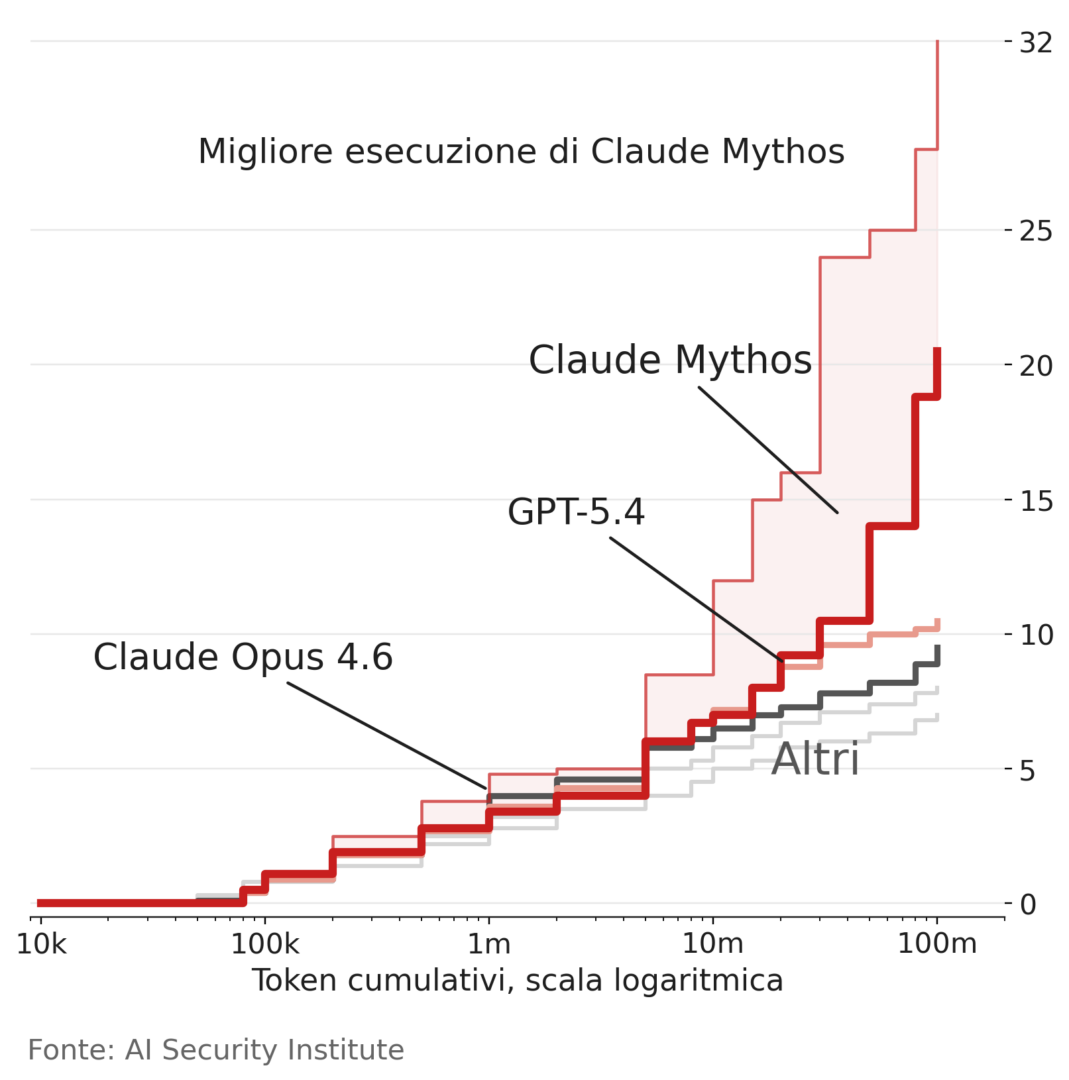

Vulnerabilità scoperte da Anthropic Mythos

Secondo Anthropic, Claude Mythos Preview ha già consentito di individuare migliaia di vulnerabilità zero-day, molte delle quali di gravità alta o critica, in tutti i principali sistemi operativi, nei principali browser web e in altri software ampiamente utilizzati. L’azienda, però, non ha reso pubblico un elenco completo dei bug scoperti, proprio perché la maggior parte delle falle è ancora in fase di responsible disclosure o non è stata ancora corretta.

Tra i casi descritti:

- Remote Code Execution (RCE) nel server NFS di FreeBSD, classificata come CVE-2026-4747, sfruttabile da remoto per ottenere privilegi elevati

- Falla di memory corruption in un virtual machine monitor (VMM) scritto in gran parte in un linguaggio memory-safe, dovuta a componenti “unsafe”

- Bypass di autenticazione in diverse applicazioni web, con possibilità di accesso non autorizzato e assegnazione di privilegi amministrativi

- Bypass di KASLR (Kernel Address Space Layout Randomization) nel kernel Linux, che consente di aggirare le protezioni di randomizzazione degli indirizzi di memoria

Secondo Anthropic, il modello è già in grado di identificare e sfruttare vulnerabilità in ogni grande famiglia di sistemi operativi e browser, al punto che l’azienda ha deciso di non rilasciarlo pubblicamente e di limitarne per ora l’uso a un programma controllato, Project Glasswing, con finalità difensive.

Dalla discovery all’abbassamento della soglia d’attacco

La prima fase della kill chain, la ricognizione e la scoperta delle vulnerabilità, è quella più radicalmente trasformata dall’AI per come la conosciamo oggi. Tradizionalmente, questa fase richiedeva competenze avanzate, tempo e strumenti di scanning statico o dinamico. Oggi, invece, modelli linguistici avanzati e agenti specializzati come Claude Mythos Preview e GPT-5.4-Cyber sono in grado di analizzare repository di codice, firmware o binari e individuare pattern di attacco con una velocità impensabile fino a pochi anni fa.

Il punto di svolta è la capacità dei nuovi modelli di ragionare sul codice, non solo di analizzarlo superficialmente. Questo ha ridotto drasticamente il costo cognitivo della vulnerability discovery, rendendo accessibile a un singolo attore ciò che prima richiedeva team interi di specialisti.

Un moderno approccio difensivo deve integrare l’AI nel ciclo di sviluppo sicuro, automatizzando code review e vulnerability discovery, ma senza affidarsi ciecamente ai risultati: ogni output va verificato con test indipendenti e validazioni umane per ridurre errori e falsi positivi.

L’accesso ai modelli AI più avanzati è oggi un fattore decisivo nella capacità di scoprire vulnerabilità su larga scala. Tuttavia, questi sistemi non sono disponibili in modo uniforme: Anthropic ha scelto una preview non resa generalmente disponibile, distribuita a partner di Project Glasswing, mentre OpenAI ha optato per un accesso graduato e verificato tramite Trusted Access for Cyber, con il modello più permissivo inizialmente riservato a specifici difensori autenticati.

Questo solleva una questione strategica: chi controlla questi modelli controlla indirettamente anche la velocità con cui le vulnerabilità possono essere sfruttate o neutralizzate.

Exploitation: il salto qualitativo degli agenti AI

La seconda fase della kill chain, l’exploitation, è quella che sta generando le maggiori preoccupazioni. Se la scoperta delle vulnerabilità è stata storicamente dominio di tool automatizzati, la creazione di exploit funzionanti richiedeva ancora forte intervento umano. Tuttavia, i nuovi modelli AI stanno iniziando a colmare questo gap.

Valutazioni rese pubbliche ad aprile mostrano che agenti basati su LLM possono trasformare descrizioni di vulnerabilità in exploit funzionanti, soprattutto quando supportati da informazioni contestuali come CVE o codice sorgente. In alcuni casi, sistemi avanzati hanno dimostrato la capacità di generare payload e script in grado di sfruttare vulnerabilità reali senza intervento umano diretto.

L’automazione non è ancora totale, ma la soglia di accesso si è abbassata: anche attaccanti meno esperti possono costruire attacchi complessi guidando i modelli con prompt strutturati.

Ciò implica sul fronte difesa, l’adozione di un approccio “assume breach”, rafforzando segmentazione, monitoraggio continuo e capacità di detection comportamentale per compensare la velocità degli attaccanti.

Tra weaponization, delivery e controllo umano

Anche la fase di weaponization, ovvero la creazione di strumenti malevoli riutilizzabili, sta beneficiando dell’AI. I modelli possono generare varianti di malware, adattare codice a diversi ambienti e automatizzare la creazione di payload polimorfici. Tuttavia, questa fase rimane ancora in parte vincolata da limiti tecnici e operativi.

In particolare, la necessità di bypassare sistemi di sicurezza, evadere sandbox e adattarsi a infrastrutture reali richiede ancora una supervisione umana significativa. L’AI può accelerare la generazione di varianti, ma non sempre garantisce robustezza contro ambienti difensivi complessi.

La delivery, cioè la distribuzione dell’attacco, rimane anch’essa fortemente ibrida. Phishing, social engineering e compromissione della supply chain possono essere ottimizzati tramite AI, ma la componente strategica e contestuale continua a dipendere dall’intelligenza umana.

I difensori devono quindi rafforzare la formazione degli utenti e adottare sistemi di rilevamento avanzati basati su anomalie, capaci di individuare contenuti e comportamenti generati da AI.

Le fasi ancora umane: strategia, obiettivi e adattamento

Nonostante i progressi, esistono ancora fasi della cyber kill chain difficilmente delegabili all’AI. La più evidente è la pianificazione strategica dell’attacco: selezionare obiettivi, valutare il rischio geopolitico, adattarsi a contesti mutevoli e decidere quando e come colpire.

Le AI attuali, anche nei modelli più avanzati, mancano di una comprensione autonoma del contesto politico, economico e operativo necessario per orchestrare campagne offensive su larga scala. Possono ottimizzare decisioni, ma non sostituire il giudizio umano nella scelta degli obiettivi o nella gestione del rischio operativo.

Un altro limite riguarda la capacità di adattamento in ambienti altamente dinamici. Le difese moderne reagiscono in tempo reale, e molte decisioni di attacco richiedono improvvisazione, intuizione e gestione dell’incertezza che restano prerogative umane.

Il nuovo equilibrio della cyber kill chain con l’AI

Se l’attacco sta diventando più automatizzato, anche la difesa sta evolvendo rapidamente. Modelli come Claude Mythos Preview e GPT-5.4-Cyber sono progettati per identificare vulnerabilità prima che vengano sfruttate, analizzare log in tempo reale e suggerire patch correttive.

Questo introduce un cambiamento strutturale: la sicurezza non è più solo una corsa tra attaccanti e difensori umani, ma una competizione tra sistemi AI opposti. In questo scenario, la velocità diventa il fattore critico. La finestra temporale tra scoperta e sfruttamento di una vulnerabilità si riduce da mesi a giorni, o addirittura ore.

Di conseguenza, le organizzazioni stanno iniziando a integrare AI nei processi di secure development lifecycle, automatizzando code review, fuzzing e vulnerability management. Tuttavia, questa automazione introduce a sua volta nuove superfici di attacco, come prompt injection o manipolazione dei modelli.

È quindi essenziale integrare l’AI nei SOC, ma anche sviluppare controlli specifici per i rischi introdotti dall’AI stessa.

Accesso ai modelli e nuovi squilibri strategici

La trasformazione più profonda, tuttavia, non è solo tecnica ma geopolitica. L’accesso ai modelli AI avanzati sta diventando un fattore di potere paragonabile all’accesso a tecnologie militari strategiche. Alcuni sistemi vengono distribuiti solo a un numero ristretto di partner industriali, vendor di sicurezza, organizzazioni e ricercatori verificati, mentre molti regolatori, in particolare in Europa, si trovano soprattutto nella posizione di valutarne i rischi e le implicazioni operative: lo mostrano le verifiche avviate in aprile dalla BCE e dal sistema bancario tedesco sul caso Mythos.

Questo crea un doppio squilibrio. Da un lato, gli attori che hanno accesso anticipato ai modelli possono rafforzare le proprie capacità difensive e offensive. Dall’altro, chi ne resta escluso rischia di trovarsi strutturalmente in ritardo nel comprendere le capacità reali delle nuove tecnologie.

La cybersecurity diventa così una questione di sovranità tecnologica: non solo proteggere infrastrutture digitali, ma anche garantire accesso a strumenti cognitivi avanzati. Senza questo accesso, la capacità di valutare rischi, testare sistemi e rispondere a minacce avanzate viene ridotta a una forma di dipendenza informativa.

La cyber kill chain AI nel futuro operativo

La domanda centrale è se, in futuro, l’essere umano rischi di diventare un semplice osservatore nei conflitti cibernetici. La risposta, almeno nel breve e medio termine, è negativa ma complessa.

L’AI sta certamente automatizzando le componenti operative della cyber kill chain, ma non ha ancora sostituito la dimensione decisionale e strategica. Inoltre, la stessa complessità dei sistemi moderni introduce incertezze che richiedono interpretazione umana.

Tuttavia, il rischio reale è un altro: la riduzione del vantaggio cognitivo dell’uomo. Se attaccanti e difensori delegano sempre più operazioni agli stessi tipi di modelli, la differenza non sarà più nella capacità tecnica, ma nell’accesso, nella governance e nella qualità dei dati.

Il ruolo dei difensori evolverà quindi verso supervisione, orchestrazione e controllo dei sistemi AI.

Cyber e AI: il bilancio finale

L’AI non sta solo migliorando la cybersecurity, ma la sta ridefinendo. Nelle fasi di discovery ed exploitation aumenta il vantaggio degli attaccanti, mentre la strategia resta umana. Il futuro sarà ibrido, con AI come moltiplicatore su entrambi i fronti. La vera frattura riguarderà l’accesso ai modelli più avanzati, con implicazioni geopolitiche. Per i difensori, la sfida sarà mantenere controllo umano in un contesto dominato da velocità, automazione e disponibilità dell’AI.

Limiti e svantaggi del limitare l’accesso ai modelli più potenti

Limitare l’accesso ai nuovi modelli è stato forse necessario per evitare il peggio, ma è probabilmente solo una soluzione temporanea. Equivale a prendere tempo.

Non risolve il problema, ma lo rimanda. E in più crea effetti collaterali.

Vediamo perché.

- Meno concorrenza: rafforza le grandi aziende AI già dominanti e aumenta il loro potere di mercato.

Diffusione più lenta dei benefici dell’AI: le capacità migliori arrivano a pochi soggetti e più tardi al resto dell’economia.

Sistema a due livelli: alcune imprese ottengono accesso privilegiato, mentre molte altre restano escluse o in ritardo.

Vantaggio ingiusto per gli insider: chi è dentro può proteggersi meglio dai rischi frontier; chi è fuori deve “sperare per il meglio”.

Più lobbying e rendite: accesso ristretto significa più possibilità di pressioni politiche, favoritismi e profitti fuori misura.

Maggiore concentrazione di potere e ricchezza: la chiusura rischia di accrescere ancora il controllo di pochi “AI gods”.

Rischio di backlash politico: se il pubblico percepisce che pochi beneficiano e molti pagano i costi, cresce l’ostilità verso l’AI.

Possibile ingiustizia regolatoria: un sistema basato su accessi privilegiati può diventare opaco, arbitrario e poco equo.

- Difficile applicarlo all’open source: non è chiaro come imporre le stesse regole ai modelli aperti.

Non risolve il problema alla radice: la sicurezza AI non può essere garantita solo a livello nazionale; serve cooperazione internazionale. Anche con la Cina che questa chiusura prova a tagliare fuori.

Può non bastare sul piano difensivo: se costruire difese efficaci richiede molto tempo, o non è possibile, la chiusura da sola non risolve il rischio.