Il Carbon-aware computing è l’informatica focalizzata sulla riduzione delle emissioni di CO2.

Nota anche come informatica “carbon-intelligent”, rappresenta un principio guida per lo sviluppo di software e hardware sostenibili. Per essere green, non devono avere impatti negativi sull’ambiente.

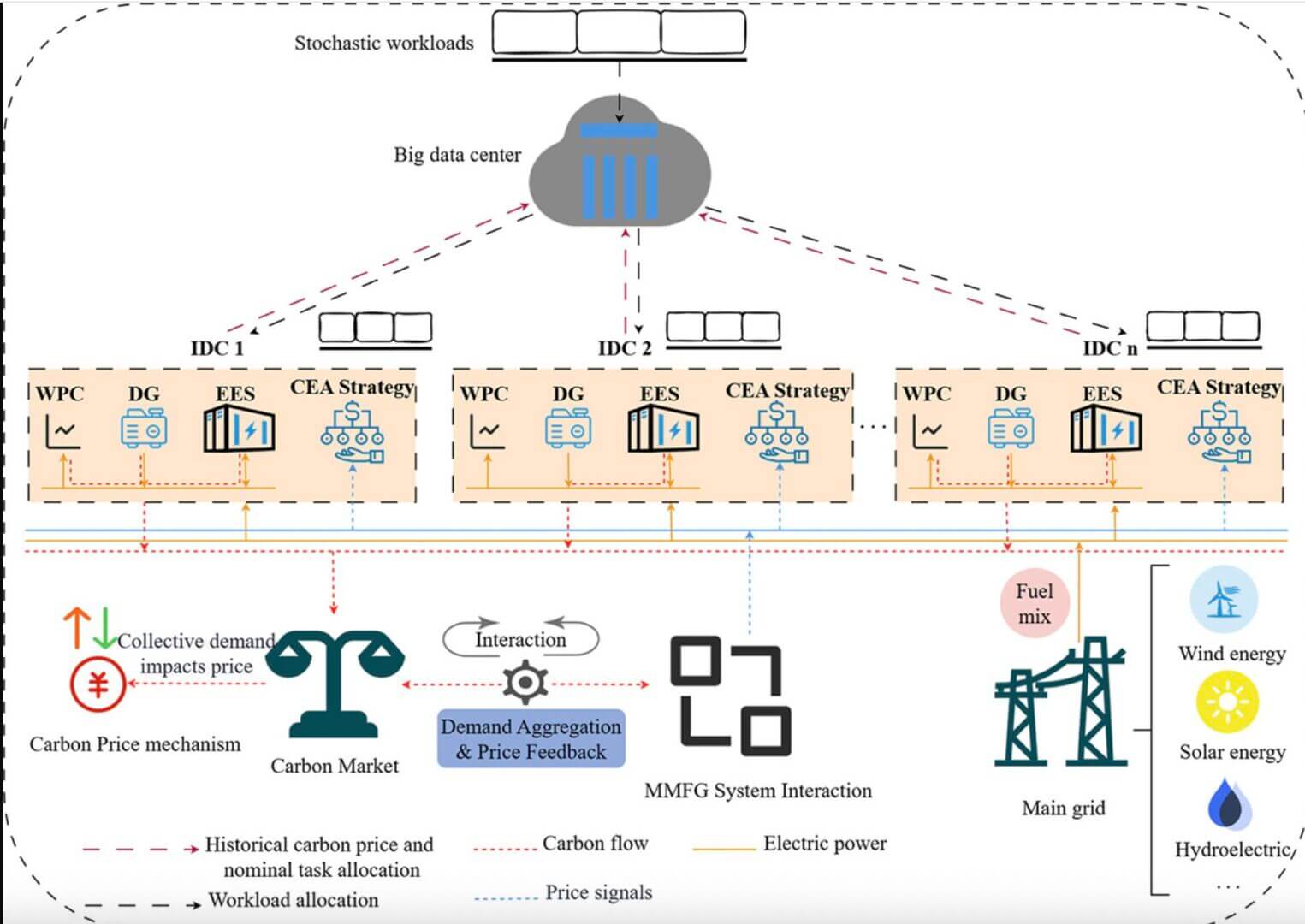

Nel caso dell’intelligenza artificiale, fortemente energivora, significa poter ottimizzare attentamente le emissioni di carbonio dei data center sfruttando energia da fonti rinnovabili, attraverso un’allocazione robusta dei carichi di lavoro e mediante un approvvigionamento sostenibile.

Ecco come è possibile applicare il Carbon-aware computing, ottimizzando i workload AI in base alla disponibilità delle rinnovabili (solare ed eolico, innanzitutto).

Indice degli argomenti

Carbon-Aware Computing: che cos’è nell’era dei data center per l’AI

Il Carbon-Aware Computing è un approccio all’informatica che mira a ridurre le emissioni di CO₂ legate all’uso di sistemi digitali, adattando il funzionamento dei computer (software, server, cloud) in base all’impatto ambientale dell’energia disponibile.

Invece di far funzionare tutto “sempre e subito”, il Carbon-Aware Computing cerca di:

- svolgere i calcoli quando l’energia è pulita (per esempio, quando c’è più solare o eolico rispetto ad altre fonti energetiche fossili);

- spostare i carichi di lavoro in luoghi con energia meno inquinante;

- ottimizzare l’uso delle risorse per evitare sprechi.

Per farlo, si basa su dati in tempo reale come efficienza dei data center, intensità di carbonio della rete elettrica (quanta CO₂ serve per kWh) e disponibilità di energie rinnovabili (che sono intermittenti, anche se è possibile usare le stoccaggio).

I sistemi possono quindi rimandare attività non urgenti (per esempio, backup, training AI), scegliere data center più “green” e ridurre la potenza computazionale quando possibile.

Un’azienda che deve addestrare un modello di intelligenza artificiale, invece di farlo subito, lo avvia quando c’è molta energia rinnovabile disponibile. Oppure lo esegue in un Paese dove l’energia rinnovabile è più disponibile. Il risultato: stesso lavoro dal punto di vista del workload AI, ma meno emissioni.

Le Big Tech come Google, Microsoft e Amazon stanno integrando questo approccio nei loro data center e servizi cloud, in modo tale da minimizzare l’impatto senza rinunciare alle prestazioni.

Carbon-Aware Computing: l’ottimizzazione dei workload AI in base alla disponibilità di rinnovabili

L’applicazione del Carbon-Aware Computing ai workload di AI significa decidere quando e dove far girare i modelli in base a quanta energia rinnovabile è disponibile in quel momento o in quella zona.

Non è teoria, ma una pratica concreta già in uso nei sistemi cloud moderni.

Ecco come si applica (passo a passo):

- occorre sapere quanta CO₂ produce l’energia in ogni momento (con API di carbon intensity, per esempio electricityMap, e dati dei cloud provider);

- classificare i workload AI: non tutti i carichi sono uguali, ma flessibili (training modelli, batch inference e preprocessing dati) e che possono essere ritardati o spostati oppure non flessibili (inferenza real-time – chatbot, raccomandazioni live) che devono restare vicino all’utente;

- Carbon-aware scheduling (se la CO₂ cala, si esegue il workload AI; se sale, slitta o si sposta a livello geografico);

- Spostamento geografico: i cloud permettono di scegliere regioni diverse (Europa nord con più idroelettrico; USA o altre zone, variabile). Piattaforme come Microsoft Azure e Google Cloud supportano sia il multi-region deployment che il workload migration, in modo tale da eseguire l’AI dove è più “green” in quel momento;

- Time shifting (slittamento nel tempo): molto potente per il training dell’AI (di giorno, c’è più energia solare; di notte, meno rinnovabili, ma dipende dal Paese: il training notturno si fa se c’è più eolico, ma si sposta di giorno quyando c’è più disponibilità di solare.

- Integrazione con orchestratori: si usa con strumenti come Kubernetes scheduler (custom) o pipeline ML (per esempio, Kubeflow), ma è possibile aggiungere policy carbon-aware o priorità basata su emissioni.

Un esempio

Un’azienda deve addestrare un modello NLP:

Un sistema che controlla carbon intensity in varie regioni, osserva che:

- Germania → alta CO₂

- Norvegia → bassa CO₂ (idroelettrico).

In questo caso, sposta il training AI in Norvegia ed avvia il workload AI quando l’energia è decarbonizzata.

Tecniche avanzate

Due tecniche evolute sono: il Carbon-aware autoscaling (scala GPU/CPU solo quando energia è pulita), i Carbon budgets, dove ogni workload ha un “budget di CO₂” e se supera questa soglia, slitta, e il Forecasting (in cui i modelli permettono di prevedere disponibilità rinnovabili, prezzo energia ed emissioni future).

I compromessi da gestire sono:

- Latenza contro sostenibilità;

- costo cloud vs energia green;

- sovranità dei dati (non sempre puoi spostare tutto).

Lo studio

Con la crescente integrazione delle energie rinnovabili nelle reti elettriche regionali, un recente studio fotografa notevoli differenze spaziali nell’intensità di carbonio.

Queste differenze evidenziano la necessità di un’allocazione dei carichi di lavoro attenta alle emissioni di carbonio nei data center distribuiti geograficamente, dove l’allineamento dei carichi computazionali con le regioni a basse emissioni di carbonio può migliorare sia i risultati ambientali che quelli economici.

Dunque, oggi il Carbon-Aware Computing permette un quadro di ottimizzazione in due fasi che integra l’allocazione dei carichi di lavoro attenta alle energie rinnovabili e l’acquisto strategico di quote di carbonio.

Nella prima fase viene sviluppato un modello di ottimizzazione robusto basato sulla generazione di colonne e vincoli per gestire le incertezze relative alla domanda di carico di lavoro e ai prezzi del carbonio, consentendo una distribuzione stabile ed economicamente efficiente del carico di lavoro tra regioni con diversi livelli di penetrazione delle energie rinnovabili.

Nella seconda fase si costruisce un modello di gioco a campo medio multi-classe per cogliere le interazioni strategiche e l’eterogeneità comportamentale tra i data center Internet nei mercati del carbonio.

Si applica un metodo di deep learning (noto come Deep Galerkin method) per risolvere le equazioni differenziali parziali ad alta dimensione risultanti, ottenendo una strategia di approvvigionamento robusta e convergente.

I risultati della simulazione dimostrano che il quadro proposto dai ricercatori, consente un risparmio sui costi superiore al 28%, garantendo al contempo la conformità sulla CO2 e la soddisfazione del carico di lavoro.

Lo studio offre approfondimenti teorici e pratici per le operazioni dei data center Internet soggetti a regolamentazione sul carbonio e supporta una più ampia integrazione delle energie rinnovabili nelle infrastrutture digitali su larga scala.

La sfida

Con la rapida crescita del cloud computing e dell’intelligenza artificiale, i data center sono diventati la spina dorsale dell’infrastruttura digitale. In particolare, l’implementazione di modelli generativi su larga scala, a partire da GPT-4, ha aumentato in modo significativo il consumo energetico dei data center sia durante la fase di addestramento che in quella di inferenza.

Secondo recenti stime dell’Agenzia Internazionale per l’Energia, la domanda globale di elettricità da parte dei data center potrebbe più che raddoppiare nel prossimo decennio, superando il consumo energetico totale di diversi paesi di medie dimensioni.

Questo aumento del consumo energetico porta dunque a una crescente attenzione all’impronta di carbonio dei data center.

Nell’ambito dei quadri normativi emergenti che promuovono la responsabilità in materia di emissioni di carbonio, come l’europeo Ets o il sistema cinese di scambio delle quote di emissione (China ETS) e il meccanismo cinese di riduzione certificata delle emissioni (CCER), ci si aspetta che le entità ad alto consumo energetico, compresi i data center, si assumano le responsabilità di conformità in materia di emissioni acquistando quote di emissione per compensare le proprie emissioni indirette.

Di conseguenza, ridurre al minimo i costi operativi legati al carbonio mantenendo le prestazioni computazionali è diventata una sfida fondamentale per gli operatori dei data center.

GreenAccounter: un toolkit per il Carbon-Aware computing

I carichi di lavoro legati al deep learning generano emissioni di carbonio significative nei data center, soprattutto perché l’addestramento richiede molto tempo ed è ad alto consumo energetico.

Per affrontare questa sfida, studi precedenti hanno esplorato sia lo spostamento temporale dei carichi di lavoro sia la migrazione geografica degli stessi.

Tuttavia, questi approcci rimangono limitati per i carichi di lavoro di lunga durata, come i modelli linguistici di grandi dimensioni (LLM), poiché non riescono ad adattarsi alle continue fluttuazioni dell’intensità di carbonio a livello regionale.

In questo contesto, il GreenAccounter è un toolkit per l’orchestrazione dei carichi di lavoro di deep learning in ambienti multi-cloud, in maniera attenta alle emissioni di carbonio.

Integra il monitoraggio in tempo reale dell’intensità di carbonio con la migrazione basata su checkpoint, consentendo all’addestramento di continuare senza interruzioni e riducendo al contempo le emissioni.

Una dashboard unificata, inoltre, visualizza l’intensità di carbonio regionale, le emissioni cumulative e il consumo energetico, fornendo agli operatori un unico pannello di controllo per la gestione delle risorse cloud distribuite. GreenAccounter funge sia da piattaforma di ricerca riproducibile per la pianificazione attenta alle emissioni di carbonio, sia da toolkit operativo pratico per la riduzione delle emissioni nell’addestramento dell’IA.

Essendo un progetto open-source, promuove pratiche sostenibili, trasparenti e basate sui dati per il deep learning su larga scala.

Prospettive future

In conclusione, applicare il Carbon-aware computing all’AI significa trasformare i workload in qualcosa di dinamico e intelligente, che si adatta all’energia disponibile. Non si cambia cosa calcoliamo, bensì quando e dove lo calcoliamo.

Le prospettive future del Carbon-Aware Computing applicato all’AI sono molto concrete e, probabilmente, diventeranno uno standard nei prossimi anni. Il motivo è semplice: l’AI sta crescendo velocemente e il suo consumo energetico pure. Quindi ottimizzare quando e dove fare computing diventerà una necessità, non un’opzione.

Oggi il carbon-aware è spesso “aggiunto” ai sistemi. In futuro sarà nativo:

- modelli AI che decidono autonomamente quando eseguire task;

- pipeline ML che si auto-ottimizzano in base alla CO₂;

- training che parte solo quando le condizioni energetiche sono ottimali.

Grandi provider come Google, Microsoft e Amazon stanno già andando in questa direzione. Vedremo:

- API integrate per scegliere regioni “low-carbon”;

- scheduler automatici basati su emissioni;

- prezzi dinamici legati all’impatto ambientale.

In sintesi, l’AI ottimizza sé stessa anche dal punto di vista ambientale, mentre il cloud stesso farà scelte sostenibili.

Infine i modelli futuri saranno pensati per essere:

- elastici nel consumo energetico;

- interrompibili e riprendibili (checkpointing avanzato);

- distribuiti geograficamente.

Tuttavia non è tutto semplice, infatti rimangono sfide aperte:

- coordinare regioni globali è complesso;

- vincoli legali sui dati (GDPR, localizzazione);

- workload real-time difficili da ottimizzare;

- rischio di aumentare complessità e costi.

Il futuro del Carbon-Aware Computing nell’AI sarà automatico, integrato (con previsioni meteo – solare, eolico -, previsione della carbon intensity e ottimizzazione multi-obiettivo: costo + CO₂ + performance) e guidato dai dati energetici.

Non sarà più una scelta esplicita degli sviluppatori, ma una proprietà intrinseca dei sistemi AI e del cloud.