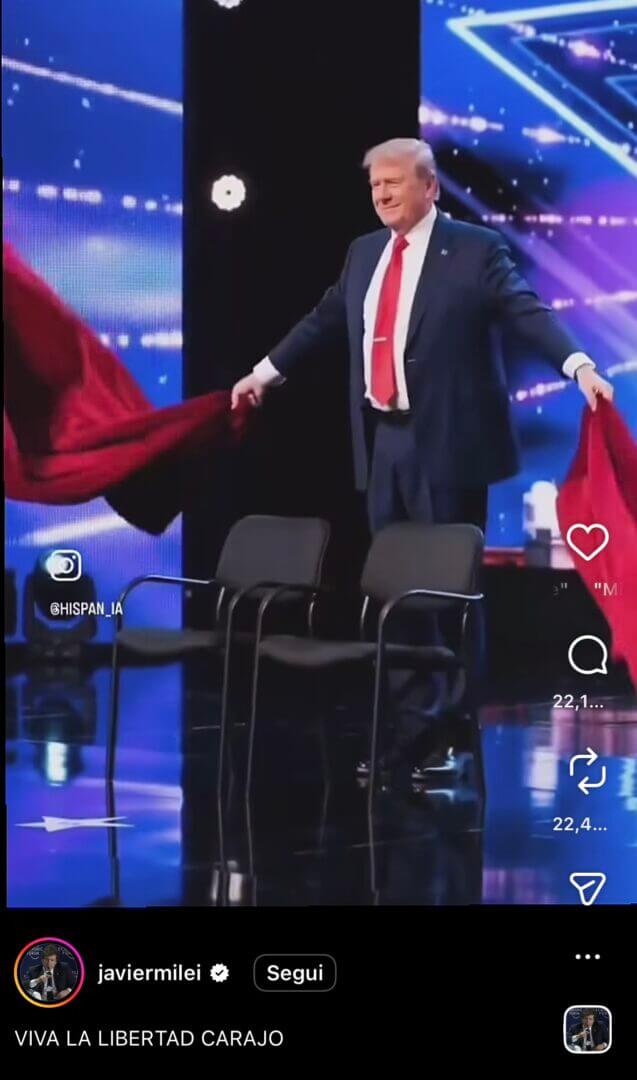

Giorgia Meloni seduta in prima fila con Javier Milei e Benjamin Netanyahu tra il pubblico in uno studio televisivo, ad assistere a uno spettacolo di magia di Donald Trump. Il presidente USA fa sparire sotto a un telo l’ayatollah Alì Khamenei, ucciso nel contesto della guerra mossa da Stati Uniti e Israele all’Iran, e Nicolás Maduro, presidente del Venezuela catturato a gennaio in un’operazione condotta dagli Usa. I celebri spettatori sorridono, si divertono. Tutto finto. Si tratta di un video deepfake, prodotto con AI, ma a colpire è un particolare: è stato diffuso da quello che sembra proprio essere l’account ufficiale Instagram del presidente dell’Argentina, Milei appunto. Il profilo ha il verification badge blu di Meta e più volte su diversi media è stato indicato come account ufficiale Instagram del presidente argentino.

Il quale non è certo nuovo alla strumentalizzazione politica del deepfake: nella sua campagna elettorale ne ha fatto un uso ingente, così come anche una volta vinte le elezioni. E non mancano le controversie al riguardo, come lo scandalo relativo a una campagna diffamatoria verso la giornalista Julia Mengolini, in cui sarebbe circolato anche un deepfake a contenuto sessuale che la prendeva di mira come spiega Reporter without borders.

Considerando che in questo momento storico il concetto di realtà va necessariamente indagato con la consapevolezza che la propria percezione non è più sufficiente a distinguere il vero dal falso, e che siamo in tempi di guerra e dunque la disinformazione diventa un’arma a tutti gli effetti, è utile capire quali sono gli effetti dell’uso politico del deepfake, quali dinamiche spingono alla strumentalizzazione di questa tecnologia e come propaganda e disinformazione siano strettamente intrecciate.

Indice degli argomenti

Il deepfake sul profilo Instagram di Milei: cosa racconta

Il profilo Instagram ufficiale (come sembra) del presidente dell’Argentina Javier Milei a inizio marzo ha pubblicato il video deepfake realizzato da un profilo Instagram spagnolo dedicato alla Gen AI. Il video mostra la presidente del Consiglio italiana Giorgia Meloni, Milei e il primo ministro di Israele Benjamin Netanyahu seduti in prima fila a teatro, come pubblico di quello che sembra il contesto di un talent show. I politici sono mostrati sorridenti e divertiti. La finta Giorgia Meloni generata con AI nel video indossa un blazer e sotto giacca rosa pastello e ha pantaloni neri, un look in linea con lo stile realmente portato dalla presidente, così come lo è l’acconciatura e il trucco. Il volto è estremamente realistico, l’espressività è replicata a un ottimo livello e non mancano i dettagli, come la forma degli occhi e delle labbra che ricalcano i suoi veri connotati.

Il video prosegue mostrando il palco, su cui si trova Donald Trump che sta facendo un gioco di prestigio. Prima pone un telo su Alì Khamenei e Maduro, seduti davanti a lui. Poi, Trump toglie il telo e i due leader non ci sono più.

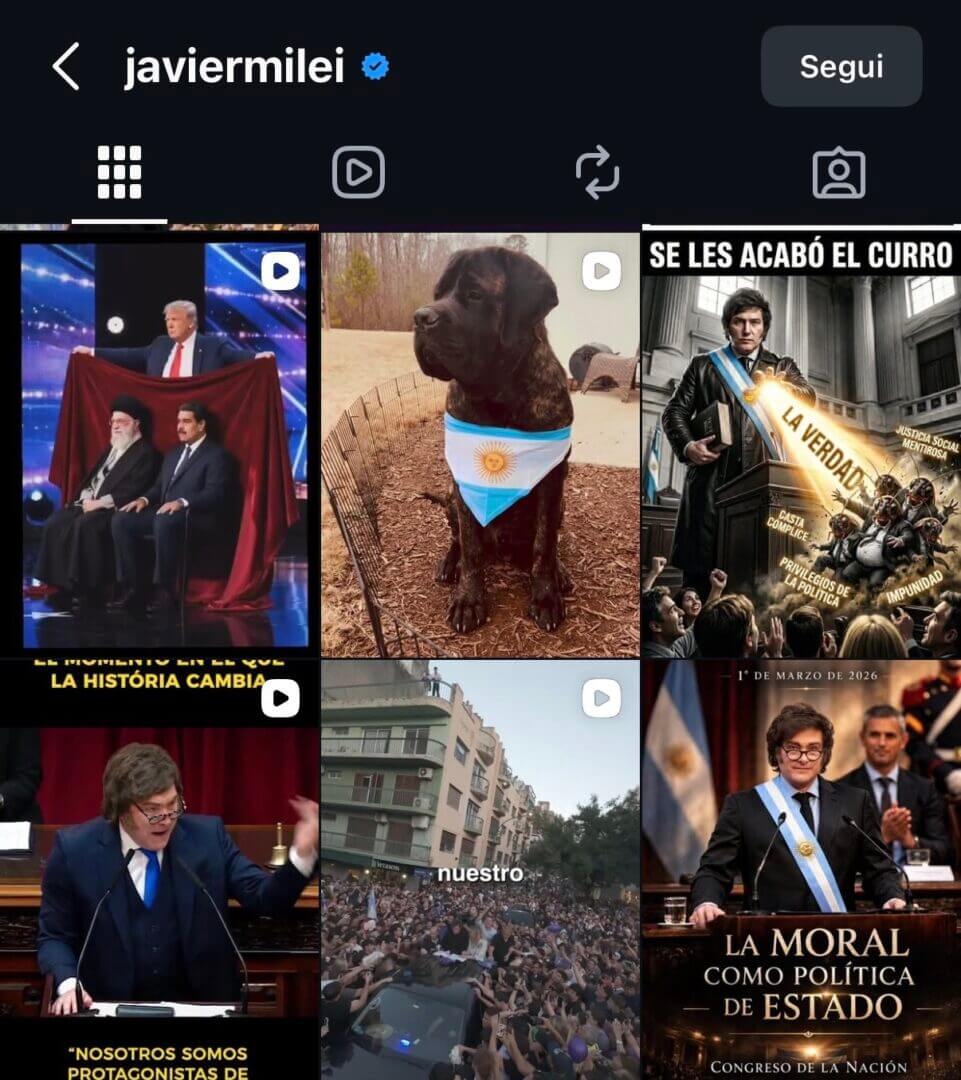

Milei accompagna il video con una didascalia che dice “Viva la libertad carajo”, cioè pressapoco “viva la libertà, cavoli”. Il video è pubblicato nel feed di Instagram di quella che sembra essere proprio la pagina ufficiale del presidente, come indica il verification badge blu di Meta vicino al nome.

Quando il deepfake viene da una fonte ufficiale: gli impatti

Il profilo Instagram ufficiale di un presidente è una fonte ufficiale. Che sia il politico stesso o uno staff a occuparsene, si tratta di un canale di comunicazione che si ritiene autorevole. Milei ha scelto da sempre uno stile di comunicazione istituzionale eccentrico, considerando gli standard della comunicazione politica, pubblica e governativa, puntando molto sull’uso dell’AI, creando immagini forti, d’impatto, sintetizzando i messaggi con parole precise e spesso dal tono “urlato”. Uno storytelling che si può definire sopra le righe e che punta alla pancia degli utenti.

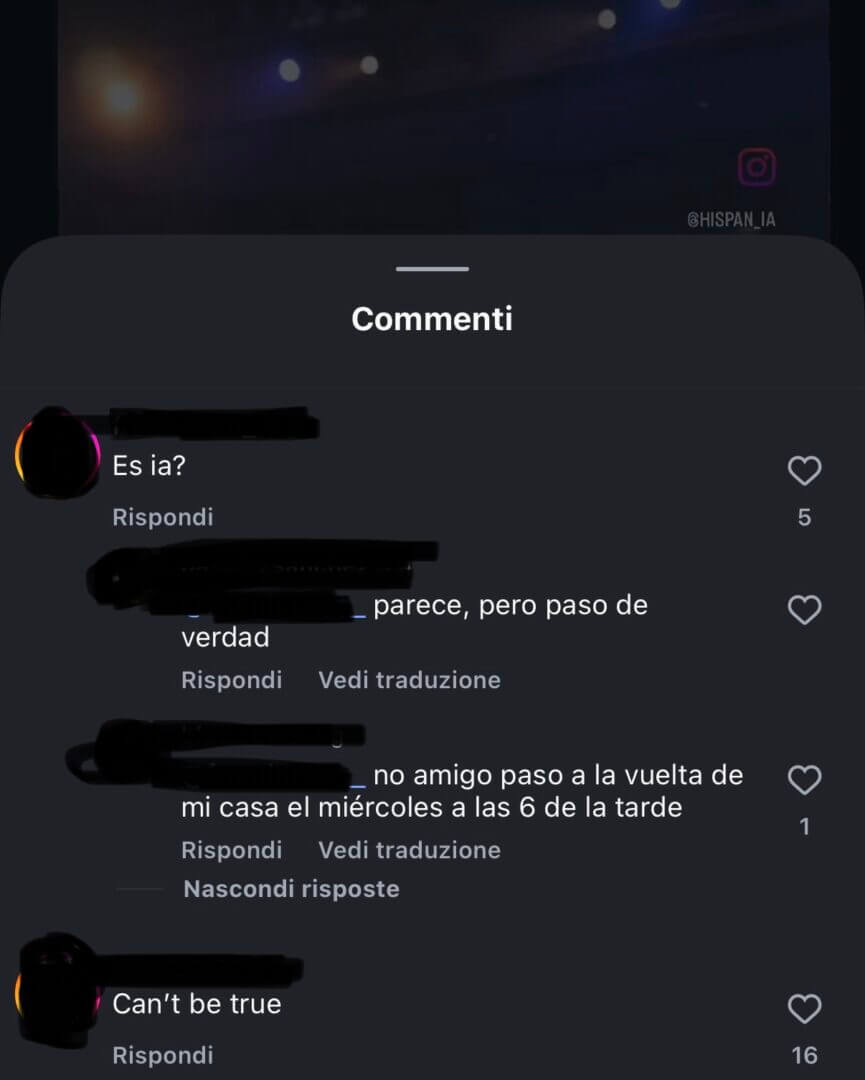

I quali, tuttavia, non hanno sempre un livello di AI literacy tale per comprendere a prima vista se un contenuto sia sintetico o reale. Lo dimostrano alcuni dei commenti al video, in cui diversi utenti si domandano se sia realizzato con l’AI, quindi esprimendo il proprio senso di incertezza nel riconoscere come genuino o fake il contenuto. E questo è un problema che va oltre il gusto personale e la scelta comunicativa di un politico, ma ha importanti impatti sociali.

Una fonte ufficiale di informazione è, almeno sulla carta, garanzia di affidabilità e dunque un contenuto pubblicato o rilanciato da tale canale viene considerato autentico, veritiero, ufficiale appunto, e può diventare informazione se di interesse pubblico. Ma l’uso dell’AI, che confonde i limiti tra falso e vero, da parte di una fonte ufficiale, alimenta invece il dubbio, creando difficoltà nella capacità di discernere tra fatti, satira e propaganda, e incrinando il rapporto di fiducia tra l’istituzione e l’utente. A poco serve indicare si tratti di un contenuto generato con AI, come dimostrano le reazioni.

Se è la realtà a creare dubbi

E non scordiamoci che, del resto, anche la realtà stessa oggi alimenta questa dissonanza. Basti pensare al video diffuso nei giorni scorsi dell’invocazione religiosa nello Studio Ovale della Casa Bianca a Washington, con rappresentanti cristiani che benedicevano il presidente Trump toccandolo tutti insieme: il primo pensiero di molti è che si trattasse di un contenuto generato con AI. E invece, era reale.

Il topos del leader forte nei deepfake di propaganda: Trump e MBS

Un motivo ricorrente nei deepfake diffusi a scopo politico è quello del leader forte al potere. L’immagine del presidente Usa Donald Trump viene particolarmente usata per veicolare un concetto di leadership legato a una mascolinità stereotipata, per cui si esaltano aspetti come la forza fisica, la risolutezza che sfocia in prepotenza. Nel contesto dei social questa narrazione del potere viene filtrata attraverso contenuti e gergo specifici, per cui un modo di fare arrogante diventa “l’aura” del leader, persona capace di irradiare potenza solo con la propria presenza o con lo sguardo. Si tratta di un potere rappresentato in modo estremamente verticale, il leader come guida del popolo che non può far altro che provare un timore reverenziale, veterotestamentario quasi, nei confronti del politico.

E in un momento in cui domina la confusione, la paura, la sensazione di incertezza e in cui viene distrutta la quotidianità per come l’abbiamo conosciuta, con prezzi alle stelle e overload di immagini di morte e distruzione, è molto umano essere portati a confidare in chi sembra sapere esattamente cosa fare e come farlo e come risolvere ogni problema. Anche se ciò prevede l’uso della forza.

Questo modo di narrare il potere, spesso con un approccio assimilabile al cyberbullismo, è stato più volte al centro di polemiche, soprattutto quando si punta al discredito degli oppositori e degli avversari politici con modalità aggressive. Come nel caso del video generato con AI pubblicato a ottobre 2025 da Trump sui social in cui il presidente viene mostrato alla guida di un jet mentre bombarda di escrementi i manifestanti “No Kings”. Oppure, ancora, come nel caso della foto manipolata in modo da ritrarre Barak e Michelle Obama come scimmie, in una pura espressione di razzismo. L’immagine era stata subito rimossa dai canali della Casa Bianca, ma lo scopo di mostrarla e far parlare di sé era stato comunque raggiunto.

Il caso di Mohammed bin Salman su TikTok

Differente, ma comunque riconducibile alla narrazione dell’uomo forte, è la propaganda portata avanti dai fan del principe Mohammed bin Salman Al Sa’ud (pubblicamente noto anche con l’acronimo MBS), primo in linea di successione al trono dell’Arabia Saudita e attualmente leader di fatto del Paese. Sui social, in particolare TikTok, ci sono numerosi contenuti a lui dedicati che lo dipingono come un leader potente, capace di garantire la sicurezza del popolo.

Nei giorni immediatamente successivi all’attacco all’Iran e alla crescente instabilità in Medio Oriente, sono stati diffusi numerosi reel che mostravano immagini del sempre sorridente principe, rappresentato come sicuro di sé e a sua volta garante non solo della sicurezza ma anche dei diritti e della libertà della popolazione dell’area. In realtà la sua figura, come spiega Amnesty International, è al centro di un’attività di rebranding dell’immagine dell’Arabia Saudita affidata a gruppi di comunicazione internazionali, ma è anche coinvolta in controversie importanti relative alla limitazione della libertà di espressione, all’omicidio del giornalista saudita Jamal Khashoggi e all’ambiguità nelle relazioni internazionali, anche nel contesto dell’avvio degli attacchi degli Usa e di Israele verso l’Iran.

AI per la propaganda nella guerra Usa-Israele-Iran

Questi impatti assumono un’ulteriore rilevanza se pensiamo alla guerra. Per quanto si chiami ciò che sta accadendo in Medio Oriente con eufemismi vari, di questo si tratta e in questo contesto l’AI come moltiplicatore della propaganda politica viene impiegata per supportare una o l’altra causa, per creare l’illusione del vantaggio o della vittoria di una parte, per spingere l’opinione pubblica a favore di una specifica fazione. Viene sfruttata la capacità di produrre in tempi rapidissimi video deepfake, audio falsi, immagini manipolate e campagne coordinate sui social in grado di rafforzare la narrativa del nemico aggressore, alimentare paura, patriottismo e odio, oppure screditare leader e fonti giornalistiche indipendenti.

Certamente i contenuti generati dall’AI aumentano scala, velocità e credibilità delle operazioni di manipolazione informativa, rendendo più difficile per il pubblico distinguere tra testimonianze reali e costruite e, in una crisi come quella Iran-USA, questo significa che la battaglia non si combatte solo sul piano militare, ma anche su quello cognitivo. Chi controlla flussi informativi, emozioni collettive e percezione della realtà può orientare consenso interno, reazioni internazionali e legittimazione della guerra stessa.

AI e propaganda: l’Iran sta vincendo la guerra in Medio Oriente?

Per esempio, come segnala News Guard, il 3 marzo diversi account social filoiraniani e ostili a Israele hanno diffuso un filmato presentato come la prova di 12 missili iraniani che colpiscono a distanza ravvicinata un’area residenziale di Tel Aviv. In sottofondo si sente la voce di un uomo, probabilmente dietro la telecamera, che esclama con stupore: “Oddio, Tel Aviv, non riesco a crederci”. E del resto sin dalle primissime ore dall’avvio dell’attacco all’Iran, sui social erano spuntati i primi contenuti manipolati o decontestualizzati per rappresentare fatti non realmente accaduti (come il presunto affondamento della portaerei USS Abraham Lincoln, mai avvenuto o il bombardamento di Tehran con ordigni atomici, non vero) oppure immagini reali ma rese portatrici di messaggi non aderenti con il contesto in cui sono state prodotte.

Il ruolo della Russia nella disinformazione sulla guerra in Medio Oriente

Secondo un’analisi di NewsGuard, la rete di propaganda filorussa nota come Matryoshka ha sfruttato il conflitto tra Iran, Stati Uniti e Israele per diffondere notizie inventate volte soprattutto a danneggiare l’immagine di Ucraina e Francia. Una delle false narrazioni individuate riguarda una notizia falsamente attribuita al think tank americano ISW relativa a settanta soldati francesi uccisi in un attacco missilistico a una base ad Abu Dhabi.

Un altro filone attribuisce falsamente al media Le Point la notizia fake di truffatori ucraini che avrebbero sottratto 42 milioni di euro a cittadini francesi sfruttando la scusa di sostenere economicamente l’aviazione francese in Medio Oriente. Inoltre, canali pro-Cremlino hanno diffuso la falsa narrazione della distruzione di una villa da sette milioni di euro a Dubai che sarebbe appartenuta a Oleksandr Syrskyi, comandante dell’esercito ucraino.

La strategia: usare l’attualità dell’Iran per colpire l’Ucraina

Gli obiettivi sono quelli di dipingere l’Ucraina e la Francia, Paese alleato, come deboli militarmente e politicamente, oltre che di ritrarre personaggi chiave del conflitto ucraino come corrotti e dunque creare danni reputazionali all’intero Stato. Queste narrazioni puntano a sfruttare il nome di media ufficiali, come appunto Euronews, attribuendo falsamente a loro la pubblicazione di queste notizie, per dare un’immagine di autorevolezza e veridicità alle bufale diffuse e renderle dunque maggiormente credibili.

L’attualità del conflitto in Medio Oriente, i cui singoli episodi a marzo 2026 sono altamente aderenti ai criteri di notiziabilità considerando che il conflitto è iniziato il 28 febbraio 2026 e coinvolge numerosi Paesi, viene sfruttata dai disinformatori dei network pro-Cremlino per creare nuove false narrazioni che rendano le fake news relative all’Ucraina più appetibili per il pubblico e capaci di attrarre maggiormente l’attenzione, fornendo un elemento di novità, cavalcando l’onda delle notizie e puntando dunque alla massima diffusione delle bufale.