Ci si abbona a servizi offerti in modo strutturato sul dark web e si paga in criptovalute: la pedopornografia online sintetica, cioè realizzata con deepfake o altre forme di AI gen, è un business redditizio su cui la criminalità organizzata transnazionale ha messo le mani. Commettendo reati, anche alla luce dell’entrata in vigore proprio oggi 10 ottobre della nuova Legge sull’AI e del reato che punisce la diffusione e detenzione di deepfake illeciti. Contenuti che sono alla base di numerose attività cyber criminali, come la sextorsion, cioè il ricatto sessuale, ai danni di minorenni.

Questo mercato nero, vista la domanda, si è evoluto rapidamente sfruttando gli usi dell’AI gen in modi sofisticati. Per esempio, per la prima volta a settembre 2025 Internet watch foundation, la più grande hotline dedicata alla rimozione di contenuti pedo porno online, ha annunciato di aver individuato immagini di abusi su minori generate con l’AI e connesse con i chatbot su un sito del clear web dove erano presenti AI companion.

Insomma, senza dover troppo scavare in qualche angolo oscuro di internet, anzi praticamente a disposizione di chiunque. La vetrina di un mercato criminale attivo, transnazionale, morboso, dove domanda e offerta si incontrano nonostante la legge.

Indice degli argomenti

Deepfake significato

Innanzitutto, le basi. Il deepfake è una tecnologia che permette di creare contenuti video, immagini o audio interamente con AI oppure manipolando foto e video di persone vere, che sembra in tutto e per tutto reale. Il deepfake porno non consensuale è un’espressione di violenza. Nel caso di pedopornografia, è chiaro che la situazione è ancora più grave.

Cos’è l’AI CSAM

La pedo pornografia sintetica, tecnicamente indicata come AI CSAM – cioè Child sexual abuse material consiste in contenuti che ritraggono minori in atteggiamenti sessuali generati unicamente con l’intelligenza artificiale e creati da algoritmi, non basandosi quindi su contenuti reali che ritraggono persone vere, creati anche con la tecnologia deepfake.

Secondo il report SOCTA 2025 di Europol, si sta registrando un vero cambiamento nelle modalità di sfruttamento sessuale dei minori online, con l’uso massiccio di IA generativa usata “per produrre materiale pedopornografico, comunità online di autori di reati altamente sicure e per facilitare l’espansione dell’adescamento online di minori”, si legge nel report.

Criminalità organizzata e mercato del deepfake

Come ogni mercato, anche quello dello sfruttamento delle parafilie (quale è la pedofilia, secondo il manuale diagnostico DSM-5) si basa sul soddisfare la domanda di una clientela. E quello dell’AI CSAM purtroppo sembra essere redditizio, perché diversi gruppi criminali non si stanno lasciando scappare l’occasione.

Un business: “Operativamente – spiega Arije Antinori, professore di Criminologia all’Università La Sapienza di Roma -, la criminalità organizzata sarebbe intenta a strutturare mercati scalabili a basso costo, attraverso la produzione per mezzo di modelli AI locali o open-source di contenuti pedo pornografici online sia sintetici, che parzialmente modificati o manipolati, poi venduti in abbonamento, prevalentemente via criptovalute, su dark web e E2EE”.

Il sito individuato a settembre da IWF sembrava offrire normali chatbot con cui passare del tempo in compagnia, ma attraverso un percorso particolare si poteva “interagire con più chatbot che simulano scenari sessuali ripugnanti con bambini. In questo processo vengono condivise immagini sessuali di bambini generate dall’intelligenza artificiale, alcune delle quali ritraggono bambini di appena sette anni”, spiega sul proprio sito l’associazione.

Reato deepfake pedopornografico, i dati

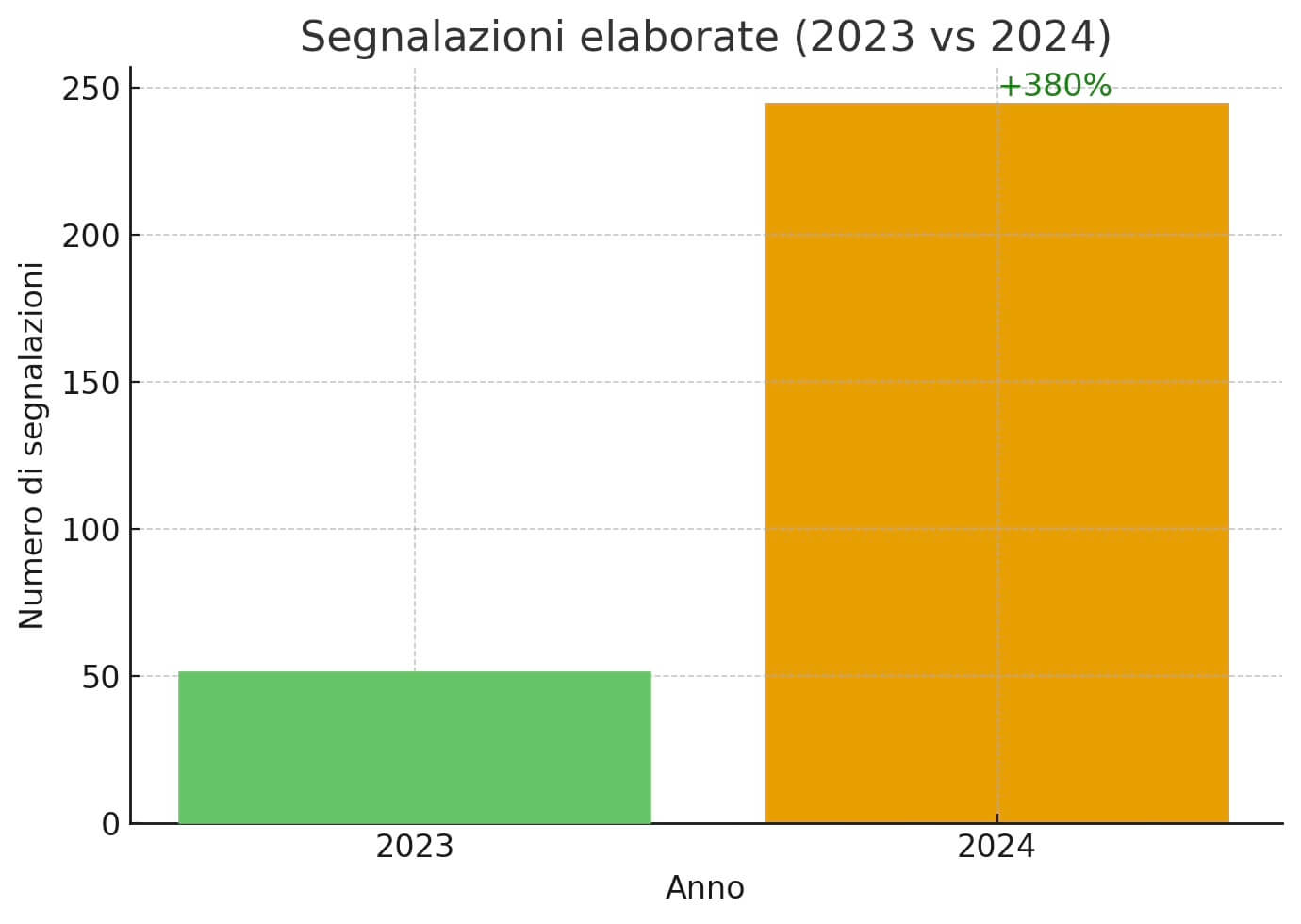

Il fenomeno è in crescita. L’IWF riporta che, in totale, gli analisti hanno elaborato 245 segnalazioni nel 2024 indicando contenuti con immagini AI gen di abusi sessuali su minori, a segnare un 380 per cento rispetto alle 51 segnalazioni del 2023.

Geografia del fenomeno

L’analisi delle url utilizzate è interessante per capire anche la geografia del fenomeno dei contenuti pedo porno online, non solo realizzati con AI. Le url analizzate da IWF indicano dove si trovano i server su cui erano ospitate le pagine web criminali. Il 61 per cento, quindi più della metà, delle url relative agli abusi su minori segnalate dalla fondazione sono state rintracciate in Paesi membri UE. In totale sono state individuate 181.112 url.

La top five è:

- Paesi Bassi – 83,037 url

- Bulgaria – 25,180 url

- Romania – 21,528

- Lituania – 8,484

- Polonia – 8,077

Dall’Italia sono state segnalate 70 url. Gli ultimi Paesi in lista sono Danimarca e Portogallo con 3 url ciascuno.

La globalità del fenomeno è espressa anche dalle operazioni delle forze dell’ordine. Un esempio recente è l’operazione Cumberland condotta dalla Danimarca a livello globale, che nel febbraio 2025 è culminata nell’arresto di 25 persone il 19 Paesi, “principalmente europei, ma anche nei Balcani e in Australia. In particolare, tre cittadini svizzeri sono stati identificati tra gli acquirenti”, racconta il professore.

Reato deepfake e AI CSAM, quali sono i gruppi criminali coinvolti

Le organizzazioni criminali coinvolte in questo mercato non sono, da quanto risulta al momento “le tradizionali mafie, ma reti criminali transnazionali altamente flessibili e adattabili“.

Non quindi Cosa Nostra, Camorra e ‘ndrangheta, ma associazioni per delinquere radicate in più Paesi, senza una stretta connessione territoriale e capaci di modificare strategie e obiettivi in base all’innovazione. Attente però alle tendenze criminali di mercato e pronte a guadagnare con il materiale illecito. Il fenomeno però, grazie all’uso di tool AI based e alle inchieste delle forze dell’ordine, è stato intercettato già da qualche anno, mentre si trova, tuttora, in una fase di pre sistemizzazione.

Certamente vi è anche, in questo scenario criminale variegato, una componente individuale: “Purtroppo unitamente a detto fenomeno top-down, si è assistito in Spagna alla vendita buttom-up, di contenuti deepfake di compagne, da parte di un minore”, come nel caso dell’app Bikinioff già nota nel 2023. Le ragioni in questi casi sono diverse da quelle della criminalità organizzate e, in simili circostanze, possono riguardare anche la sfera personale e il revenge porn oltre all’intento economico.

Chi sono i fruitori di contenuti pedo pornografici online con AI

Come nel caso degli utenti dei siti sessiti dove vengono pubblicate foto sessualmente esplicite senza consenso, tracciare il profilo dei fruitori di questi servizi in abbonamento è complesso e ha a che fare con diverse sfere di individui. Oltretutto, bisogna ancora capire la risposta di tale mercato: “Siamo ancora in una fase iniziale del fenomeno, ma dal repentino interesse criminale organizzato si evince che vi sia richiesta, anche perché all’interno delle community online pedoporno solo in rari casi il fruitore di tali contenuti cerca un contatto con le vittime rappresentate negli atti d’abuso, anche alla luce della necessità di impermeabilizzare le fonti di produzione, quindi di salvaguardare un mercato molto decisamente occulto, trasformandosi quindi in predatore attivo”, aggiunge Antinori.

E considerando il numero di contenuti circolanti e la facilità della loro creazione bisogna stare attenti a non cadere in una sorta di normalizzazione dell’abuso, che la crescente diffusione di materiale sintetico potrebbe contribuire a realizzare.

Reato deepfake, l’uso illecito della tecnologia: come funziona

Gli analisti hanno individuato tre modalità di creazione dei contenuti AI based pedopornografici: “AI-assistita in cui una foto o video legalmente o illegalmente acquisita, spesso di vittime minori note all’interno delle comunità pedoporno, viene alterata o manipolata attraverso il cosiddetto compositing – , spiega il professor Antinori -. Un’altra modalità è il deepfake attraverso face o body swap, la sostituzione di volto e corpo, oppure l’undressing, lo spogliamento sintetico, o montaggio, grazie ad app e tool facilmente reperibili online“.

Importante sottolineare quanto sia semplice disporre di strumenti di questo genere, senza particolari conoscenze tecniche e ottenendoli in modo del tutto legale.

La terza modalità utilizzata è “la creazione completamente sintetica, quindi senza una fonte di partenza reale, di contenuti generativi dall’IA senza una foto sorgente esplicita”.

Reato Deepfake legge AI, Barachini: “Algoritmi spesso confondono i cittadini”

Alberto Barachini, sottosegretario di Stato alla presidenza del Consiglio dei ministri con delega all’Editoria, durante un evento elettorale a Firenze, come riportato da Agi ha dichiarato: “Dire ai cittadini che quello che vedono e ascoltano è reale, è vero, è attendibile e fondamentale. Questo è un momento nel quale, grazie alla tecnologia, grazie agli algoritmi, molto spesso i cittadini sono confusi, a volte perdono di fiducia. Se perdono di fiducia, poi perdono anche la capacità critica e la capacità democratica, anche di partecipare alla vita politica e questo non lo dobbiamo consentire”.

E sulla legge sull’AI ha spiegato che “protegge il diritto d’autore, quindi il copyright che è la base economica del sistema editoriale, ma soprattutto introduce una novità internazionale, il reato di deepfake“.

NP

Deepfake di immagini online, un’industria criminale

E comunque, le istruzioni purtroppo non mancano. Risulta particolarmente preoccupante, spiega Antinori, la crescente “professionalizzazione ecosistemica nel dark web in cui troviamo thread ad hoc, ove gli utenti condividono prompt, guide, toolkit, e modelli o filtri con l’obiettivo di migliorare il realismo dei contenuti al fine di automatizzare la produzione, su larga scala, in modalità CaaS. Ciò trova ovviamente spazio anche nell’ambito dei fenomeni più o meno organizzati di grooming e sextortion” ai danni di minorenni.

Social network e piattaforme fringe, come si cerca di eludere forze dell’ordine e legge

La base per raccogliere materiale, inoltre, purtroppo non manca. Accanto a quanto rappresentato nel dark web, “social media platform fringe sono usati per signposting o disseminazione parziale e iniziale, insomma, più o meno come la strategia iniziale di propaganda jihadista IS, ma su scala ridotta, perché alla base ci sono sempre le medesime tecniche di engagement cyber-sociale, che vengono implementate e migliorate tecnologicamente” e tuttavia “la frammentazione multi-piattaforma rimane fondamentale per cercare di eludere le forze di polizia”, conclude il docente.

Reato deepfake, cosa dice la legge italiana sull’AI

La legge però, sebbene i gruppi criminali cerchino di aggirarla o ignorarla, c’è. E per queste attività si rischia il carcere: “Già prima della Legge sull’AI – spiega l’avvocato Fulvio Sarzana -, il codice penale italiano puniva la pedopornografia virtuale”. In particolare, le norme che riguardano il tema sono:

- articolo 600 ter, punisce chiunque realizzi spettacoli o materiale con contenuti pedopornografici o ne faccia commercio. Inoltre, citando il codice, si precisa nell’articolo che “per pornografia minorile si intende ogni rappresentazione, con qualunque mezzo, di un minore degli anni diciotto coinvolto in attività sessuali esplicite, reali o simulate, o qualunque rappresentazione degli organi sessuali di un minore di anni diciotto per scopi sessuali”

- articolo 600 quater, punisce chi si procura, detiene o accede a materiale pedopornografico;

- articolo 600 quater 1, “le disposizioni di cui agli articoli 600 ter e 600 quater si applicano anche quando il materiale pornografico rappresenta immagini virtuali realizzate utilizzando immagini di minori degli anni diciotto o parti di esse, ma la pena è diminuita di un terzo. Per immagini virtuali si intendono immagini realizzate con tecniche di elaborazione grafica non associate in tutto o in parte a situazioni reali, la cui qualità di rappresentazione fa apparire come vere situazioni non reali”.

Reato deepfake, le controversie

Con la Legge sull’AI arriva il reato all’articolo 612 quater, che punisce il deepfake non consensuale, o più precisamente l’illecita diffusione di contenuti generati o manipolati artificialmente.

Un reato procedibile però a querela di parte: “Alcuni giuristi hanno criticato queste disposizioni perché si configura un reato di danno, non di pericolo – racconta Sarzana -: le critiche riguardano la necessità di provare l’esistenza del danno ingiusto, e ciò apre la strada all’obbligo di valutazioni più approfondite su ogni caso specifico, per capire se è stato effettivamente generato un danno, rendendo quindi più difficile l’incriminazione. Non viene insomma punita l’azione, ma la conseguenza, l’impatto dell’azione”.

Reato deepfake e legge AI: la responsabilità delle piattaforme

La responsabilità delle piattaforme dove si creano questi servizi e community verso questo fenomeno, spiega l’avvocato Sarzana, “non riguarda normative come l’AI Act e Legge sull’AI, in quanto per esempio l’AI Act stabilisce che le violazioni dei sistemi di AI generano sanzioni. Bisogna invece valutare se sia applicabile la disciplina del DSA che già prevede sanzioni milionarie se le piattaforme non introducono meccanismi di rimozione dei contenuti illegali o se non hanno sistemi di segnalazioni dei contenuti illegali, come per esempio sistemi di reclamo”.

Nota bigliografica

Tutta la bibliografia e le fonti utilizzate sono indicate, esplicitate e linkate nell’articolo.