Il 5 marzo 2026 Anthropic ha pubblicato uno studio che merita attenzione nel dibattito sull’impatto dell’intelligenza artificiale sul mercato del lavoro. Si intitola Labor market impacts of AI: A new measure and early evidence ed è firmato dagli economisti Maxim Massenkoff e Peter McCrory.

Il paper non promette risposte definitive, il titolo stesso lo dichiara parlando di early evidence. Introduce però una nuova metrica di misurazione, la valida contro i dati reali e si impone la disciplina di dichiarare cosa sa e cosa non sa. In un dibattito spesso dominato da previsioni catastrofiste o da rassicurazioni troppo facili, questa sobrietà vale già da sola l’attenzione.

Il valore dello studio cresce ulteriormente se lo si legge in controluce rispetto al corpus di analisi che abbiamo presentato sulle nostre pagine negli ultimi mesi. Il quadro che ne emerge è coerente, anche quando le singole tessere sembrano contraddirsi. Proviamo a ricomporlo.

Indice degli argomenti

Misurare l’AI e lavoro senza strumenti inadeguati

Massenkoff e McCrory partono da una premessa scomoda, il track record delle previsioni sull’impatto delle tecnologie dirompenti sul lavoro è pessimo. Un celebre studio sulla delocalizzazione dei posti di lavoro statunitensi identificò circa un quarto dei posti come vulnerabili, ma un decennio dopo quei lavori crescevano bene. Le analisi sugli effetti dei robot industriali arrivano ancora oggi a conclusioni opposte. Il dibattito sul China shock è aperto, persino l’impatto di internet sul lavoro è stato misurato solo retrospettivamente, con difficoltà. Questo non è un dettaglio metodologico, è il cuore del problema. Se vogliamo capire cosa sta facendo l’AI al lavoro, dobbiamo costruire oggi gli strumenti giusti, prima che gli effetti siano così evidenti da non richiedere analisi sofisticate. Questo è quello che i due economisti si propongono di fare. Noi avevamo già segnalato questa difficoltà analitica in più occasioni. Avevamo scritto che gli studi del Budget Lab di Yale e il paper di Hosseini & Lichtinger dell’Università di Harvard evidenziano che l’effetto occupazionale è ancora contenuto, ma con segnali preoccupanti per le fasce junior . Il paper di Anthropic non contraddice questa lettura, la precisa.

La nuova misura dell’esposizione osservata

Il contributo centrale di Massenkoff e McCrory è l’introduzione di una metrica che chiamano Observed Exposure, cioè esposizione osservata. Non si tratta dell’ennesima rielaborazione delle capacità teoriche degli LLM ma di qualcosa di diverso: una misura che combina ciò che i modelli potrebbero fare con ciò che stanno effettivamente facendo nel mondo reale.

Il metodo integra tre fonti: il database O*NET con i compiti delle circa 800 professioni americane; i dati di utilizzo reale di Claude raccolti nell’Anthropic Economic Index; e la misura di esposizione teorica elaborata da Eloundou et al. nel 2023 nello studio GPTs are GPTs https://arxiv.org/abs/2303.10130. Quest’ultima assegna a ogni compito un coefficiente: 1 se un LLM da solo può dimezzare il tempo necessario, 0,5 se serve software aggiuntivo, 0 se il compito non raggiunge quella soglia di velocizzazione, il che non significa necessariamente che l’LLM sia del tutto inutile, ma che il guadagno sarebbe inferiore al 50% stabilito come criterio. La novità è che Massenkoff e McCrory non si fermano alla teoria.

Un compito viene considerato davvero coperto solo se è teoricamente fattibile e se ha registrato un utilizzo work related sufficiente nel traffico reale di Claude. Si aggiunge poi un peso che differenzia l’uso automatizzato, dove l’AI sostituisce l’umano, dall’uso potenziato, dove lo assiste.

Il primo pesa il doppio del secondo. Il risultato è una misura che tenta di approssimare l’esposizione economicamente rilevante al rischio di sostituzione meglio delle sole stime teoriche. Va però tenuto presente un limite strutturale: i dati di utilizzo coprono agosto e novembre 2025, la misura teorica di Eloundou è calibrata su capacità LLM di inizio 2023. Con modelli che migliorano trimestralmente, la fotografia invecchia in fretta. Gli stessi autori lo riconoscono esplicitamente, indicando l’aggiornamento della metrica come uno dei passi successivi necessari. Ciò non ne invalida l’utilità, ma impone cautela nell’interpretare i numeri assoluti.

Il gap tra capacità teorica e uso reale dell’AI e lavoro

Tra i risultati più discussi dello studio c’è la rappresentazione visiva di quanto l’AI sia ancora lontana dal raggiungere il suo potenziale teorico. Il grafico radar che compare nel paper, con l’area blu della copertura teorica e quella rossa dell’utilizzo osservato, è quasi impietoso. Nel settore Computer & Math, dove il potenziale teorico è del 94%, la copertura effettiva osservata si ferma al 33%. Il resto è molto più indietro.

Questo dato si connette direttamente a qualcosa che avevamo analizzato recentemente: l’adozione dell’AI nelle imprese americane non sta accelerando come promesso. Il sondaggio della US Census Bureau mostrava che la quota di lavoratori che usa l’AI nella produzione di beni e servizi è scesa dal 12 all’11%.

Il paper di Anthropic spiega perché questa stagnazione è strutturale: molti compiti che un LLM potrebbe svolgere non vengono affidati all’AI per vincoli legali, di responsabilità, di integrazione nei software aziendali, di necessità di verifica umana. L’esempio degli autori è illuminante: autorizzare la ricarica di prescrizioni farmaceutiche è classificato come pienamente fattibile per un LLM, ma non compare nelle conversazioni reali di Claude. Come avevamo scritto l’AI non libera tempo, lo ridefinisce . Computer & Math, la copertura effettiva si ferma al 33% di quella teoricamente possibile.

Le professioni più esposte tra conferme e segnali nuovi

La classifica delle professioni con maggiore Observed Exposure offre alcune conferme attese e qualche riflessione nuova. Al primo posto i programmatori informatici, con il 74,5% di copertura osservata. Al secondo i rappresentanti del servizio clienti (70,1%). Seguono i data entry keyer, i medical record specialist, i market research analyst. La presenza dei customer service representative al secondo posto è particolarmente significativa. Avevamo analizzato proprio queste due categorie come laboratorio anticipato dell’impatto dell’AI sul lavoro cognitivo. Il paper di Anthropic lo conferma con i dati di utilizzo: le attività di questi ruoli sono sempre più visibili nel traffico API di prima parte, ovvero nelle integrazioni aziendali, non negli utilizzi consumer. Vale anche il confronto con lo studio Microsoft su 200.000 conversazioni reali con Bing Copilot https://www.agendadigitale.eu/industry-4-0/lavorare-con-lai-senza-farsi-sostituire-lezioni-da-200-000-chat-reali/. Quel paper mostrava che gli operatori di customer service, con oltre due milioni e mezzo di occupati, presentavano altissimi livelli di compatibilità con l’AI generativa.

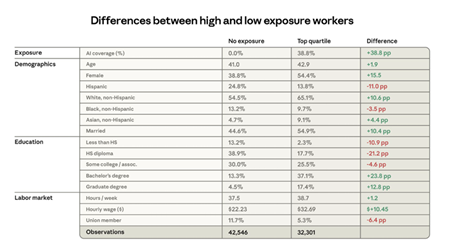

Chi è più esposto: il profilo demografico che sorprende

Forse il dato più controintuitivo dell’intero paper riguarda il profilo dei lavoratori più a rischio. Analizzando il Current Population Survey nei mesi precedenti il lancio di ChatGPT, Massenkoff e McCrory mostrano che i lavoratori nel quartile superiore di esposizione sono più spesso donne (+16 punti percentuali), guadagnano il 47% in più della media, hanno livelli di istruzione più elevati (i laureati magistrali sono quasi quattro volte più presenti nel gruppo esposto rispetto a quello non esposto), lavorano più spesso in professioni da scrivania qualificate. Non sono i meno istruiti. Non sono i meno pagati. Sono i professionisti cognitivi del ceto medio-alto, quelli che usano computer, scrivono, analizzano, gestiscono dati.

Questo si connette in modo diretto a ciò che avevamo descritto come “il ceto medio cognitivo sotto pressione”. Il paper di Hosseini & Lichtinger Generative AI as Seniority-Biased Technological Change mostrava una riduzione del 7,7% delle assunzioni junior nelle imprese che integrano davvero l’AI. Il paper di Anthropic ora aggiunge il perché. Non i lavori manuali, non i servizi di cura.

Disoccupazione stabile, assunzioni junior in calo

Il cuore empirico dello studio è chiaro: non esiste evidenza statistica di un aumento della disoccupazione per i lavoratori nelle professioni più esposte all’AI, a partire dal lancio di ChatGPT nel novembre 2022. Il coefficiente pooled post-ChatGPT nel framework difference-in-differences è +0,0020 con un errore standard di 0,0019: un effetto quasi nullo. Gli autori stessi si preoccupano di quantificare cosa sarebbe rilevabile con questo framework: impatti differenziali nell’ordine di 1 punto percentuale sarebbero visibili.

Un raddoppio del tasso di disoccupazione nel quartile più esposto, da 3% a 6%, paragonabile alla Grande Recessione per i colletti bianchi, sarebbe anch’esso rilevabile. Non si vede nulla di simile. Questo rispecchia quanto il Budget Lab di Yale aveva già mostrato analizzando 33 mesi di dati post-ChatGPT: nessuna rottura nella composizione occupazionale, nessun effetto macro. La stabilità aggregata, come avevamo avvertito, non va confusa con l’assenza di trasformazioni. Nei dati macro non si vede niente. Nei dati micro, qualcosa sta già accadendo.

Il segnale debole: i giovani vengono assunti di meno

L’unico risultato che si discosta dal “nessun effetto” riguarda i lavoratori tra i 22 e i 25 anni. Non sul fronte della disoccupazione, ma su quello delle assunzioni. Massenkoff e McCrory guardano direttamente al tasso mensile di ingresso in una nuova occupazione. Dal 2024 le due serie, ingresso nelle professioni ad alta esposizione e ingresso in quelle a bassa esposizione, divergono visibilmente. Il calo nell’era post-ChatGPT è del 14% nel job finding rate per le professioni esposte, appena statisticamente significativo. Per i lavoratori over 25 non si osserva nulla di simile. Questo è un risultato che non sorprende, ma che ora trova riscontro in un’analisi indipendente con una metodologia diversa e una misura di esposizione costruita su dati di utilizzo reale. Il paper di Brynjolfsson, Chandar e Chen di Stanford aveva già mostrato un calo occupazionale del 6-16% tra i 22 e i 25 anni nei settori più esposti all’AI, attribuito principalmente a un rallentamento nelle assunzioni.

Il paper di Anthropic va nella stessa direzione, su un dataset diverso e con una definizione di esposizione più ancorata all’utilizzo effettivo, pur con il limite di dati già datati al momento della pubblicazione. La convergenza tra studi con metodologie diverse su questo fenomeno specifico è un elemento da tenere presente, pur nella consapevolezza che nessuno dei due paper può escludere spiegazioni alternative, dal ciclo economico al riassorbimento post-pandemia, che non siano ancora del tutto risolte. Il meccanismo è quello che avevamo descritto come rottura del primo gradino della scala professionale. I compiti che i giovani svolgono nelle prime fasi della carriera, coding di base, data entry, customer support, analisi preliminare, sono esattamente quelli che l’AI sta coprendo più rapidamente. Il risultato non è la disoccupazione dei senior, ma la mancata assunzione degli junior. Un effetto che nei dati aggregati non si vede, ma che nelle traiettorie individuali è già reale.

Il confronto con la misura teorica di Eloundou: utilizzo reale e capacità teorica

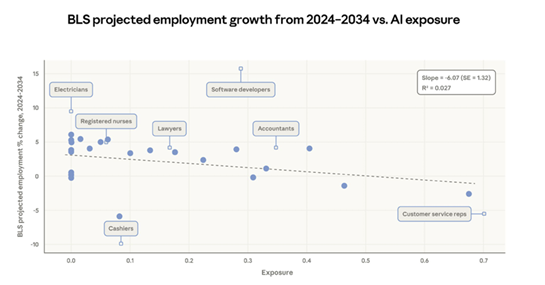

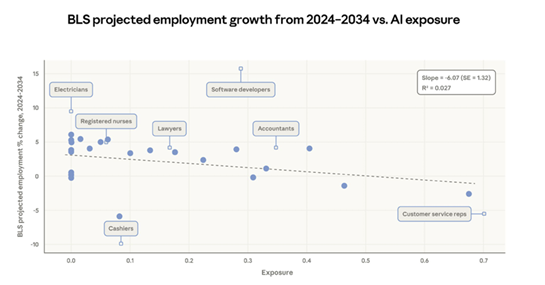

Uno degli aspetti metodologicamente più interessanti del paper è la comparazione diretta tra la metrica di esposizione teorica di Eloundou et al. e la nuova Observed Exposure. I risultati non sono equivalenti. Mentre l’Observed Exposure è correlata con le proiezioni di crescita occupazionale del BLS (la regressione mostra che per ogni 10 punti percentuali di copertura osservata in più, la proiezione di crescita BLS cala di 0,6 punti), la misura teorica di Eloundou da sola non mostra la stessa correlazione. Il dato suggerisce che integrare i dati di utilizzo reale aggiunge informazione predittiva rispetto alla sola stima teorica. Una conclusione plausibile, ma da leggere con la consapevolezza che quei dati di utilizzo riflettono un momento specifico — e già superato — dell’evoluzione dei modelli.

Questo connette il paper di Anthropic con ciò che avevamo già evidenziato nell’analisi del Remote Labor Index. Quel progetto mostrava che anche i migliori modelli di frontiera riuscivano a completare con successo solo una piccola frazione degli incarichi professionali reali, completi dall’inizio alla fine. La capacità teorica di fare qualcosa è una cosa, svolgere effettivamente un lavoro reale, con tutte le sue complessità di contesto, verifica e responsabilità, è un’altra. Il gap tra area blu e area rossa nel grafico di Massenkoff e McCrory è la rappresentazione quantitativa di esattamente questo divario.

Geografia, disuguaglianze e limiti ancora aperti

Lo studio di Massenkoff e McCrory è centrato sugli Stati Uniti e non entra nel dettaglio delle asimmetrie geografiche. La metodologia dell’Observed Exposure è estendibile ad altri paesi. Gli autori lo dichiarano esplicitamente, e il dataset è già disponibile pubblicamente su Hugging Face. Il profilo demografico dei più esposti — più istruiti, più pagati, in prevalenza femminili — potrebbe però comportarsi in modo differente in economie con strutture occupazionali diverse da quella americana, come quella italiana.

Nell’ultimo Economic Index di Anthropic di gennaio 2026 si evidenziava che l’adozione dell’AI è fortemente correlata al PIL pro capite e al livello di istruzione, con il rischio di una divergenza strutturale tra chi adotta prima e chi resta indietro. Il paper di oggi aggiunge un’altra dimensione, nei paesi in cui le professioni esposte sono più diffuse, il potenziale impatto sarà più ampio; in quelli dove il tessuto occupazionale è più orientato al manifatturiero o ai servizi di cura, il rischio immediato è minore, ma i guadagni di produttività raggiungeranno più tardi.

Cosa non dice lo studio: i limiti dichiarati dagli autori

Massenkoff e McCrory sono espliciti sui propri limiti, e vale la pena riportarli.

La misura di esposizione teorica di Eloundou et al. è calibrata sulle capacità degli LLM come erano a inizio 2023: potrebbe sottostimare l’esposizione attuale, soprattutto in seguito all’avvento dei modelli di ragionamento e degli agenti. I dati di utilizzo coprono solo Claude, non l’intero ecosistema AI.

L’analisi sull’occupazione si basa sul Current Population Survey, che ha limitazioni note nella misurazione delle transizioni lavorative per i giovani (chi non viene assunto può uscire dalla forza lavoro senza comparire come disoccupato). Infine, il paper non misura l’impatto sul reddito, sulla qualità del lavoro o sull’intensità della pressione lavorativa. Quest’ultimo punto è particolarmente rilevante. La recente ricerca Wharton-GBK https://www.agendadigitale.eu/industry-4-0/non-e-solo-colpa-dellai-cosa-succede-davvero-al-lavoro-di-programmatori-e-call-center/ mostra come molti lavoratori, in particolare nel middle management, percepiscano un aumento delle ore e della pressione operativa dall’introduzione dell’AI. “Per chi deve implementare, l’AI oggi è più lavoro, non meno”, aveva osservato Stefano Puntoni, coautore della ricerca. Il tasso di disoccupazione non cattura questo. La Observed Exposure nemmeno.

AI e lavoro: cosa sappiamo e quale direzione si apre

I risultati emersi negli ultimi mesi convergono su alcuni punti. Nessun effetto macro sulla disoccupazione aggregata, confermato da fonti indipendenti con metodologie diverse. Un rallentamento reale delle assunzioni junior, documentato con segnali deboli ma coerenti. Un gap strutturale tra capacità teorica e utilizzo effettivo dell’AI, frenato da vincoli organizzativi, legali e di integrazione.

E, forse la novità più politicamente rilevante: i lavoratori più esposti non sono i meno istruiti né i meno pagati, ma i professionisti cognitivi del ceto medio. Il pericolo più immediato non è la sostituzione massiccia, ma la compressione silenziosa: meno ingressi per i giovani, meno opportunità di apprendimento on the job, una pressione che nei dati aggregati non si vede ma cambia strutturalmente le traiettorie individuali.

La domanda politica che resta aperta

Il paper di Massenkoff e McCrory risponde a una domanda precisa: l’AI sta già danneggiando l’occupazione? La risposta, per ora, è no, o almeno non in modo misurabile su scala aggregata. Ma questa risposta non esaurisce il problema. Sapere che non c’è ancora una crisi occupazionale visibile non dice nulla su dove stiamo andando e, soprattutto, su chi sta scegliendo la direzione. Qui entra in gioco il paper Building Pro-Worker Artificial Intelligence, firmato da Daron Acemoglu, David Autor e Simon Johnson per The Hamilton Project della Brookings Institution. I due paper, pur partendo da domande diverse, si illuminano a vicenda in modo produttivo. Massenkoff e McCrory documentano che il 30% dei lavoratori ha copertura AI zero, cuochi, meccanici, baristi, addetti alle pulizie, mentre i più esposti sono i professionisti cognitivi qualificati https://www.agendadigitale.eu/cultura-digitale/lavoro-e-ai-la-rivincita-dei-tecnici-la-laurea-protegge-ma-rende-meno/. Acemoglu, Autor e Johnson mostrano che questo non è un accidente tecnologico ma il risultato di scelte precise di investimento. Le grandi aziende AI stanno costruendo strumenti per automatizzare il lavoro cognitivo qualificato, quello che costa di più, quello che crea la maggiore dipendenza dal lavoratore, molto più di quanto stiano costruendo strumenti per amplificarlo. La distinzione analitica è fondamentale: c’è differenza tra AI che automatizza (sostituisce il lavoratore, rendendo la sua expertise una commodity), AI che aumenta (rende il lavoratore più produttivo nelle attività che già svolge), e AI che crea nuovi compiti (genera domanda per competenze inedite, scarse, quindi remunerate). Solo quest’ultima categoria è inequivocabilmente pro-worker. Le altre producono effetti ambigui o negativi sulla quota di reddito che va al lavoro.

La Observed Exposure di Massenkoff e McCrory pesa più il primo tipo che il terzo: l’uso automatizzato conta il doppio di quello potenziante. Una scelta metodologica corretta se si vuole misurare il rischio di sostituzione. Ma dice anche qualcosa di importante sulla direzione attuale dell’adozione: le aziende stanno prevalentemente scegliendo l’automazione rispetto all’augmentation. Il 77% degli utilizzi aziendali di Claude tramite API che abbiamo già documentato nell’articolo del settembre 2025 riguarda l’automazione completa di compiti.

Acemoglu, Autor e Johnson spiegano perché: non è un caso, è un fallimento di mercato strutturato da incentivi fiscali favorevoli al capitale, da una path dependence dei grandi sviluppatori verso l’automazione enterprise, e da una visione teleologica dell’AI orientata all’AGI, in cui l’amplificazione delle capacità umane è un obiettivo di secondo livello. Il punto di contatto più diretto con i dati del paper di Anthropic riguarda i lavoratori giovani.

Massenkoff e McCrory documentano un rallentamento delle assunzioni dei 22-25enni nelle professioni esposte. Acemoglu, Autor e Johnson identificano il meccanismo: quando le imprese adottano AI in modalità automatizzante, eliminano proprio i compiti entry-level, ripetitivi, codificati, facilmente trasferibili a un modello, che storicamente costituivano la “palestra” professionale per i neoassunti. Non stanno costruendo strumenti per aiutare i giovani a imparare più in fretta. Stanno costruendo strumenti per non doverli assumere affatto.

La domanda che il paper di Anthropic lascia aperta, ora abbiamo la misura, ma cosa facciamo?, è esattamente quella a cui Acemoglu, Autor e Johnson cercano di rispondere con le loro nove proposte di policy. Dalla leva degli acquisti pubblici nella sanità e nell’istruzione (dove lo Stato è pagatore dominante e potrebbe condizionare gli appalti AI a criteri pro-worker) alla neutralità fiscale tra capitale algoritmico e capitale umano, dalla tutela dell’expertise theft fino alla rappresentanza dei lavoratori nei processi di adozione tecnologica.

Non sono ricette semplici. Il paper lo riconosce esplicitamente. Ma offrono una lente analitica che manca nel dibattito italiano sull’AI: la domanda non è solo “questa AI è sicura?”, ma “questa AI per chi crea valore e come?”. Due domande diverse, che richiedono risposte diverse e politiche diverse.