L’intelligenza artificiale sta evolvendo da strumento di supporto a infrastruttura di decisione delegata, capace di intervenire in tempo reale su scelte e micro-azioni finanziarie.

La sfida riguarda dati affidabili, governance e architetture “human-in-the-loop” progettate per garantire responsabilità e controllo.

Dall’interazione uomo–AI il valore emerge dall’informazione, mentre produttività e fiducia diventano proprietà di rete.

Indice degli argomenti

Quando la macchina diventa partner

La trasformazione digitale dei servizi finanziari ha superato la fase dell’automazione. Non si tratta più soltanto di digitalizzare processi esistenti o di sostituire attività ripetitive con algoritmi. Stiamo assistendo a un cambiamento più profondo: l’intelligenza artificiale sta diventando un’infrastruttura di decisione condivisa, dove azioni finanziarie emergono dall’interazione continua tra intelligenza umana e capacità computazionale [1].

Come osservato da Christine Lagarde, la rivoluzione digitale sta ridefinendo non solo i servizi finanziari, ma la natura stessa del denaro e del sistema finanziario [2]. In questo contesto, emerge una domanda fondamentale: quando un’operazione bancaria viene eseguita attraverso sistemi intelligenti che percepiscono il contesto, inferiscono comportamenti e suggeriscono (o attuano) decisioni, dove risiede effettivamente la capacità di agire—nell’utente, nella macchina o nella piattaforma che orchestra la loro interazione?

Questa domanda non è puramente filosofica. Ha implicazioni concrete per governance, responsabilità e creazione di valore. I sistemi AI stanno progressivamente assumendo funzioni cognitive tradizionalmente associate agli esseri umani: percezione, inferenza, giudizio [3]. Ma contrariamente alle narrazioni semplificate sull’automazione, questi sistemi non sostituiscono semplicemente l’umano—creano nuove forme di collaborazione dove il valore emerge proprio dall’interazione.

Questo articolo esplora quattro architetture di collaborazione uomo–AI già operative nel settore bancario internazionale, analizza come queste configurazioni generino valore attraverso cicli di feedback continui, e discute le implicazioni per governance e fiducia in un ecosistema sempre più mediato da piattaforme digitali.

Quattro architetture collaborative: dall’interfaccia alla decisione

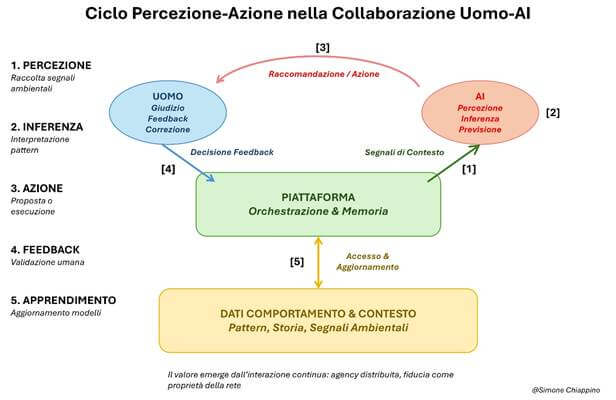

Figura 1 – Nel ciclo percezione-azione, umani e sistemi AI operano in circuiti di feedback continuo. La piattaforma orchestra l’interazione, mentre dati comportamentali alimentano l’apprendimento reciproco. L’azione finanziaria emerge dall’accoppiamento dinamico tra segnali contestuali (percepiti dalla macchina) e giudizio umano, creando un sistema adattivo dove agency, fiducia e valore sono proprietà distribuite.

Interfaccia conversazionale persistente: l’AI diventa memoria relazionale

Bank of America – Erica

Lanciato nel 2018, Erica rappresenta molto più di un chatbot evoluto. Con oltre 2 miliardi di interazioni e 42 milioni di utenti attivi, questo assistente virtuale opera come interfaccia conversazionale persistente che mantiene continuità informativa nel tempo [4].

L’architettura è significativa: ogni interazione non è un evento isolato ma un punto dati che arricchisce progressivamente il modello comportamentale dell’utente. Erica non si limita a rispondere—anticipa. Analizza pattern di spesa, identifica transazioni duplicate, suggerisce ottimizzazioni budgetarie. Ma il valore non risiede nell’automazione della risposta: sta nella capacità del sistema di apprendere dalle correzioni e dai feedback impliciti degli utenti.

Quando un utente ignora un suggerimento o modifica un’operazione proposta, il sistema registra questa “correzione” e adatta i modelli futuri. L’umano funziona simultaneamente come utilizzatore e come trainer. La macchina, dal canto suo, non sostituisce il giudizio ma lo amplifica attraverso l’accesso a pattern che sarebbero invisibili all’analisi umana diretta.

JPMorgan Chase – COiN (Contract Intelligence)

COiN analizza documenti legali e contratti di credito, processando in secondi ciò che richiederebbe 360.000 ore di lavoro umano all’anno [5]. L’architettura qui è diversa ma complementare: non si tratta di interfaccia diretta con il cliente, ma di amplificazione cognitiva per operatori specializzati.

Il sistema identifica clausole standard, segnala anomalie contrattuali, riduce errori interpretativi. Ma l’elemento cruciale è: la decisione finale rimane umana. Gli operatori utilizzano l’output di COiN come input informativo qualificato, non come verdetto automatico. Questa configurazione genera un ciclo virtuoso: gli operatori validano o correggono le interpretazioni della macchina, e queste correzioni vengono reintegrate nel training del modello.

Il risultato non è efficienza pura, ma qualità decisionale migliorata attraverso iterazione: la macchina riduce il rumore informativo, l’umano esercita il giudizio di merito.

Decisioni creditizie assistite: oltre il credit scoring tradizionale

Zest AI – Machine Learning Underwriting – Fondato da Douglas Merrill, ex CIO di Google, Zest AI utilizza machine learning per ottimizzare l’underwriting creditizio analizzando migliaia di variabili non tradizionali [6]. L’architettura decisionale qui è particolarmente istruttiva.

I modelli ML di Zest non sostituiscono i credit officer—li assistono fornendo valutazioni di rischio più granulari e inclusive. Il sistema analizza pattern che sfuggirebbero ai modelli statistici classici, ma fornisce sempre explainability: gli operatori possono vedere quali variabili hanno maggiormente influenzato la raccomandazione.

Questa trasparenza algoritmica è fondamentale per due ragioni. Prima, permette agli operatori di esercitare controllo: possono accettare, rigettare o modificare la raccomandazione sulla base di fattori contestuali non catturati dal modello. Seconda, permette apprendimento reciproco: quando un operatore sovrascrive una decisione, il sistema può apprendere se quella decisione si è rivelata corretta ex post.

I risultati sono misurabili: riduzione dei tassi di default del 20-30%, aumento dell’approvazione di prestiti per segmenti tradizionalmente esclusi, mantenimento del controllo umano su decisioni ad alto impatto sociale [6]. Il valore emerge dalla complementarità: la macchina amplia lo spazio decisionale, l’umano esercita il giudizio finale.

Fraud detection comportamentale: dall’anomalia alla fiducia

Featurespace – Adaptive Behavioral Analytics. Acquisita da Visa nel 2023, Featurespace rappresenta l’evoluzione del fraud detection da regole statiche a behavioral analytics adattive [7]. La piattaforma ARIC (Adaptive, Real-time, Individual, Change identification) Risk Hub utilizza machine learning per profilare comportamenti individuali in tempo reale, identificando anomalie che si discostano dai pattern normali di ciascun utente.

L’architettura integra capacità di detection automatizzata con case management per investigatori. Il sistema genera alert di rischio per transazioni anomale, che vengono poi processati attraverso workflow configurabili con livelli di escalation. Gli analisti possono creare casi, assegnare alert, e decidere se scartare falsi positivi o scalare per investigazione approfondita.

L’elemento distintivo è l’approccio “zero degradation”: il modello si adatta continuamente senza necessità di re-training manuale periodico. Quando operatori classificano alert come falsi positivi o confermano frodi, queste decisioni informano l’evoluzione del modello. Il sistema apprende progressivamente a distinguere meglio tra comportamenti legittimi e fraudolenti, riducendo friction per utenti genuini.

Il risultato documentato include riduzione drastica dei falsi positivi (fino al 97% in alcuni casi) mantenendo alta accuracy nel fraud detection. La fiducia emerge dalla trasparenza del sistema—gli operatori vedono le variabili che hanno generato l’alert—e dalla dimostrata capacità di miglioramento continuo.

Architetture di identità: dalla biometria ai wallet digitali europei

Liveness Detection & EUDI Wallet. L’identità digitale rappresenta il livello più critico di collaborazione uomo–AI, perché qui l’errore ha conseguenze dirette su sicurezza e fiducia sistemica [8].

Le tecnologie di liveness detection utilizzano AI per distinguere tra una persona reale e un tentativo di spoofing (foto, video, deepfake). Ma questi sistemi operano sempre in architetture multi-livello: la verifica biometrica AI è combinata con challenge-response dinamici, analisi comportamentale, e—nei casi critici—verifica umana finale.

In prospettiva europea, l’EUDI Wallet è parte del quadro regolamentare dell’identità digitale dell’UE, volto a fornire credenziali verificabili e interoperabili per accedere sia ai servizi pubblici sia a quelli privati [9]. Pur non contenendo esplicite disposizioni di supervisione umana per decisioni ad alto rischio nei servizi AI, l’adozione di tali wallet può supportare processi affidabili di identificazione e onboarding; requisiti di human oversight per decisioni ad alto rischio sono invece oggetto di altre norme europee sui sistemi AI.

Questa configurazione non è casuale: riflette il principio che in domini dove l’errore ha conseguenze irreversibili (impersonificazione, furto d’identità), la delega completa alla macchina introduce rischi sistemici inaccettabili. La collaborazione diventa quindi architetturale: l’AI riduce drasticamente il carico di verifica (processando istantaneamente la maggioranza dei casi standard), ma l’umano rimane nel loop come livello di escalation e garanzia finale.

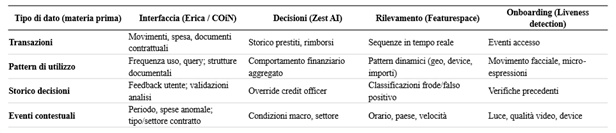

Dalla transazione all’interazione: come emerge il valore informazionale

Le quattro architetture descritte condividono una caratteristica strutturale: il valore non risiede nella singola transazione automatizzata, ma nella capacità del sistema di preservare e propagare regolarità informative nel tempo [10]. La Tabella 1 sintetizza le principali tipologie di dati che alimentano ciascuna architettura. Emerge chiaramente come la “materia prima informativa” vari significativamente: da dati comportamentali e documentali nelle interfacce (Erica e COiN), a dati finanziari storici per decisioni creditizie, pattern transazionali real-time per fraud detection, fino a dati biometrici per verifica identità. Questa diversità riflette la specializzazione funzionale di ciascun sistema, ma tutti condividono la logica fondamentale: trasformare dati grezzi in capacità decisionale attraverso cicli continui di percezione, inferenza e feedback umano.

Tabella 1 – Mappatura della “materia prima informativa” nelle 4 architetture.

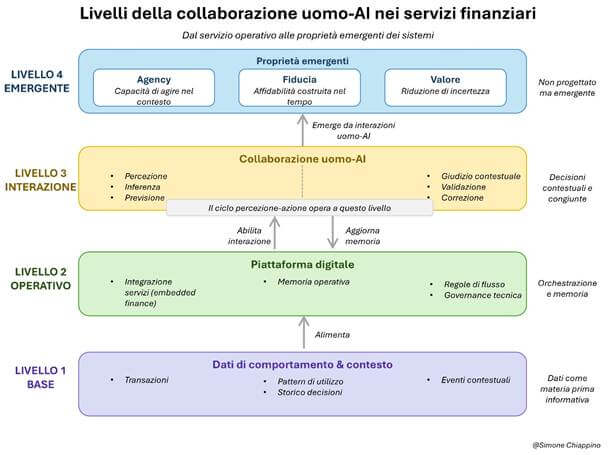

Figura 2 – Livelli della collaborazione uomo–AI nei servizi finanziari digitali. La collaborazione uomo–AI non si esaurisce nel ciclo decisionale, ma si distribuisce su più livelli. I dati comportamentali costituiscono la base informativa; la piattaforma digitale orchestra servizi e memoria; il livello di interazione ospita il ciclo percezione–azione tra sistemi AI e giudizio umano. Agency, fiducia e valore non sono progettati direttamente, ma emergono come proprietà sistemiche dall’interazione continua tra questi livelli.

Il ciclo percezione-azione come infrastruttura

Tradizionalmente, un’operazione bancaria era un evento discreto: selezione di uno strumento, esecuzione di una transazione, registrazione contabile. In ambienti mediati da AI e piattaforme digitali, questa linearità scompare. Le operazioni finanziarie si svolgono in cicli continui di percezione-azione dove:

- Percezione contestuale: I sistemi AI raccolgono segnali ambientali (transazioni precedenti, comportamenti correlati, contesto temporale e geografico).

- Inferenza adattiva: Questi segnali vengono interpretati attraverso modelli che si aggiornano continuamente.

- Azione orientata: Il sistema propone o esegue azioni (suggerimenti, approvazioni, blocchi).

- Feedback umano: L’utente o l’operatore conferma, corregge o ignora l’azione proposta.

- Aggiornamento del modello: Il feedback viene reintegrato, modificando i parametri per iterazioni future.

Questo ciclo non è sequenziale ma simultaneo e ricorrente. La piattaforma digitale orchestra queste interazioni, mentre la memoria distribuita del sistema (dati storici + modelli AI + feedback umani) costituisce l’infrastruttura su cui si costruisce il valore.

Valore come riduzione di incertezza

Il valore, se inteso come elemento che identifica i comportamenti dell’individuo (utente), può essere legato al concetto di riduzione di incertezza [10]. In altre parole, un sistema finanziario efficace deve essere in grado di ridurre incertezza per entrambe le parti:

- Per il fornitore: riduzione di rischi (credito, frode, compliance) attraverso migliore capacità predittiva.

- Per l’utente: riduzione di friction cognitiva e operativa attraverso servizi anticipatori e contestuali.

Ma questa riduzione di incertezza non avviene attraverso la semplice automazione. Emerge dall’accumulo di regolarità informative legate all’identità dell’utente—pattern comportamentali che persistono nel tempo e che permettono al sistema di “riconoscere” e anticipare bisogni, rischi, anomalie.

L’identità diventa quindi carrier di informazione: non un attributo statico (nome, codice fiscale) ma un processo informativo dinamico che si arricchisce ad ogni interazione. Il sistema “conosce” l’utente non perché ha accesso a più dati anagrafici, ma perché ha osservato e interpretato migliaia di micro-comportamenti nel tempo.

Fiducia come proprietà di rete

Un aspetto controintuitivo emerge dall’analisi di queste architetture: la fiducia non è più esclusivamente una precondizione istituzionale (regolamentazione, garanzie formali), ma diventa una proprietà emergente della rete [11].

Nel caso di Revolut—fintech mobile-first che ha raggiunto 45 milioni di utenti in meno di un decennio—la crescita è stata mediata da dinamiche di rete: diffusione peer-to-peer, interazioni ripetute all’interno dell’app, familiarità progressiva con servizi embedded. La fiducia si è consolidata attraverso partecipazione e feedback collettivo, non (solo) attraverso brand bancario tradizionale [12].

Questa trasformazione ha implicazioni profonde: significa che in ecosistemi platform-based, la fiducia si costruisce relationally—attraverso interazioni verificabili, coerenza temporale, partecipazione crescente. E qui l’AI gioca un ruolo ambivalente: può accelerare la costruzione di fiducia (attraverso performance dimostrata, riduzione errori, personalizzazione efficace) o distruggerla rapidamente (attraverso opacità, bias non riconosciuti, failure in casi critici).

Implicazioni e rischi: la tensione tra produttività e controllo

L’architettura human-in-the-loop non è una soluzione universale ma una tensione continua da governare.

Il confine del governo della delega

Ogni organizzazione deve definire dove posizionare il confine tra autonomia della macchina e controllo umano, e questo confine non è statico.

Tre principi emergono dalle pratiche internazionali:

- Tracciabilità: Ogni decisione influenzata da AI deve essere ricostruibile ex post. Questo vale sia per audit regolatori che per diritti degli utenti.

- Contestabilità: Gli utenti devono poter contestare decisioni automatizzate e ottenere revisione umana—principio già sancito dal GDPR e ribadito dall’AI Act europeo [13].

- Explainability proporzionale: Il livello di spiegabilità richiesto deve essere proporzionale all’impatto della decisione. Un suggerimento di budgeting richiede meno explainability di un rifiuto creditizio.

I rischi strutturali della collaborazione

L’interazione uomo–AI introduce rischi specifici che vanno oltre le preoccupazioni tradizionali su bias algoritmici:

Overfitting comportamentale: Sistemi addestrati su feedback umani possono specializzarsi eccessivamente su pattern locali o temporanei, perdendo capacità di generalizzazione. Un credit model ottimizzato su decisioni di operatori particolarmente conservativi potrebbe perpetuare esclusione finanziaria.

Automation bias: La tendenza degli operatori umani a sovra-affidarsi ai suggerimenti della macchina, riducendo progressivamente il proprio giudizio critico. Studi mostrano che quando un sistema AI è percepito come affidabile, gli umani tendono ad accettarne le raccomandazioni anche in presenza di segnali contrari evidenti.

Delega non controllata: In contesti ad alta pressione operativa, il “livello di escalation umana” rischia di diventare puramente formale—operatori che approvano suggerimenti AI senza vera valutazione, trasformando un’architettura human-in-the-loop in automazione de facto.

Concentrazione informazionale: Piattaforme che orchestrano interazioni uomo–AI accumulano vantaggio informativo crescente, creando potenziali asimmetrie di potere tra provider, utenti e regolatori.

Verso architetture di fiducia verificabile

La risposta a questi rischi non è il rifiuto della collaborazione uomo–AI, ma la progettazione di architetture che rendano la fiducia verificabile piuttosto che presunta.

Alcune direzioni emergenti:

Federated learning: Approcci che permettono l’addestramento di modelli AI senza centralizzazione dei dati personali, riducendo rischi privacy e concentrazione informazionale.

Continuous monitoring: Sistemi di supervisione algoritmica che monitorano in tempo reale drift dei modelli, anomalie di performance, pattern di bias emergenti.

Explainability contestuale: Non spiegazioni generiche (“questo modello usa 200 variabili”), ma spiegazioni specifiche per ogni decisione (“in questo caso particolare, le tre variabili più influenti sono stati X, Y, Z con pesi definiti”).

Audit trails immutabili: Utilizzo di tecnologie distributed ledger per garantire che ogni decisione algoritmica sia tracciabile e non modificabile ex post.

L’infrastruttura invisibile della finanza intelligente

La collaborazione uomo–AI sta diventando l’infrastruttura invisibile della finanza contemporanea. Invisibile perché sempre più embedded in esperienze utente fluide; infrastrutturale perché costituisce il layer su cui si costruiscono servizi, si allocano rischi, si genera valore.

Le quattro architetture analizzate—interfacce conversazionali, decisioni creditizie assistite, fraud detection adattivo, identity verification—mostrano che il valore non emerge dalla sostituzione dell’umano con la macchina, ma dall’instaurazione di cicli di feedback continui dove:

- L’AI amplifica capacità percettive e predittive umane.

- L’umano fornisce giudizio contestuale e correzione adattiva.

- La piattaforma orchestra e memorizza l’interazione.

- Il valore emerge come riduzione progressiva di incertezza attraverso accumulo di regolarità informative.

Ma questa trasformazione introduce relazioni strutturali tra produttività (automazione, scala, velocità) e controllo (trasparenza, contestabilità, oversight). Governare questa tensione richiede più che compliance regolamentare: richiede progettazione intenzionale di architetture che rendano espliciti i confini di delega, verificabili le decisioni, contestabili gli errori.

In prospettiva, la finanza intelligente non sarà quella che avrà eliminato l’intervento umano, ma quella che avrà costruito infrastrutture di collaborazione dove umani e macchine operano in simbiosi adattiva—con chiarezza su ruoli, responsabilità e meccanismi di accountability.

La domanda non è se l’AI trasformerà la finanza—questo sta già accadendo. La domanda è se sapremo costruire questa trasformazione in modo che agency, fiducia e valore rimangano proprietà distribuite e governabili, piuttosto che concentrarsi in black box inaccessibili.

Riferimenti

[1] I. Aldasoro, L. Gambacorta, A. Korinek, V. Shreeti, e M. Stein, “Intelligent financial system: How AI is transforming finance,” Journal of Financial Stability, vol. 81, 2025. [Online]. Available: https://doi.org/10.1016/j.jfs.2025.101472

[2] C. Lagarde, “Payments in a digital world,” Speech at European Central Bank, settembre 2020. [Online]. Available: https://www.ecb.europa.eu/press/key/date/2020/html/ecb.sp200910~31e6ae9835.en.html [Accessed: Feb. 1, 2026]

[3] Y. Tian, D. Zhu, R. Nazar, S. Ali, e A. Mirza, “From algorithms to access: Role of artificial intelligence in revolutionizing financial inclusion,” Technology in Society, vol. 84, 2025. [Online]. Available: https://doi.org/10.1016/j.techsoc.2025.103098

[4] Bank of America, “BofA’s Erica Surpasses 2 Billion Interactions, Helping 42 Million Clients Since Launch,” Bank of America Newsroom, 2024. [Online]. Available: https://newsroom.bankofamerica.com/content/newsroom/press-releases/2024/04/bofa-s-erica-surpasses-2-billion-interactions–helping-42-millio.html [Accessed: Feb. 1, 2026]

[5] D.C. Weiss, “JPMorgan Chase uses tech to save 360,000 hours of annual work by lawyers and loan officers,” AbaJournal, 2017. [Online]. Available: https://www.abajournal.com/news/article/jpmorgan_chase_uses_tech_to_save_360000_hours_of_annual_work_by_lawyers_and [Accessed: Feb. 1, 2026]

[6] Zest AI, “Model Explainability—Re-explained,” Zest AI White Paper, 2025. [Online]. Available: https://www.zest.ai/wp-content/uploads/2025/08/Modelexplainability_reexplained.pdf [Accessed: Feb. 1, 2026]

[7] Featurespace, “Enhanced real-time defense against fraud & money laundering: ARIC Risk Hub V3.19,” 2021. [Online]. Available: https://www.featurespace.com/newsroom/enhanced-real-time-defense-against-fraud-money-laundering-aric-risk-hub-v3-19 [Accessed: Feb. 1, 2026] Nota: Acquisita da Visa nel 2023. Fonte: https://www.featurespace.com/newsroom/visa-to-acquire-featurespace

[8] M. Paul, “Artificial Intelligence in Financial Services: New Risks and the Need for More Regulation?” in The Cambridge Handbook of Responsible Artificial Intelligence, Cambridge University Press, 2022, pp. 359–376. [Online]. Available: https://doi.org/10.1017/9781009207898.028

[9] European Commission, “European Digital Identity Wallet Architecture and Reference Framework,” 2023. [Online]. Available: https://digital-strategy.ec.europa.eu/en/library/european-digital-identity-wallet-architecture-and-reference-framework [Accessed: Feb. 1, 2026] Nota: Pilot implementation. Disponibile anche: https://digital-strategy.ec.europa.eu/en/policies/eudi-wallet-implementation

[10] D. Krakauer, N. Bertschinger, E. Olbrich, J. C. Flack, e N. Ay, “The information theory of individuality,” Theory in Biosciences, vol. 139, no. 2, pp. 209–223, 2020. [Online]. Available: https://doi.org/10.1007/s12064-020-00313-7

[11] M. L. Katz e C. Shapiro, “Network Externalities, Competition, and Compatibility,” The American Economic Review, vol. 75, no. 3, pp. 424–440, 1985. [Online]. Available: https://www.jstor.org/stable/1814809

[12] Chiappino, S. (2026). Network effect: come Revolut ha trasformato la finanza digitale. Agenda Digitale. [Online]. Available: https://www.agendadigitale.eu/cittadinanza-digitale/network-effect-come-revolut-ha-trasformato-la-finanza-digitale/

[13] European Parliament, “High-level summary of the AI Act,” EU Artificial Intelligence Act, 2024. [Online]. Available: https://artificialintelligenceact.eu/high-level-summary/