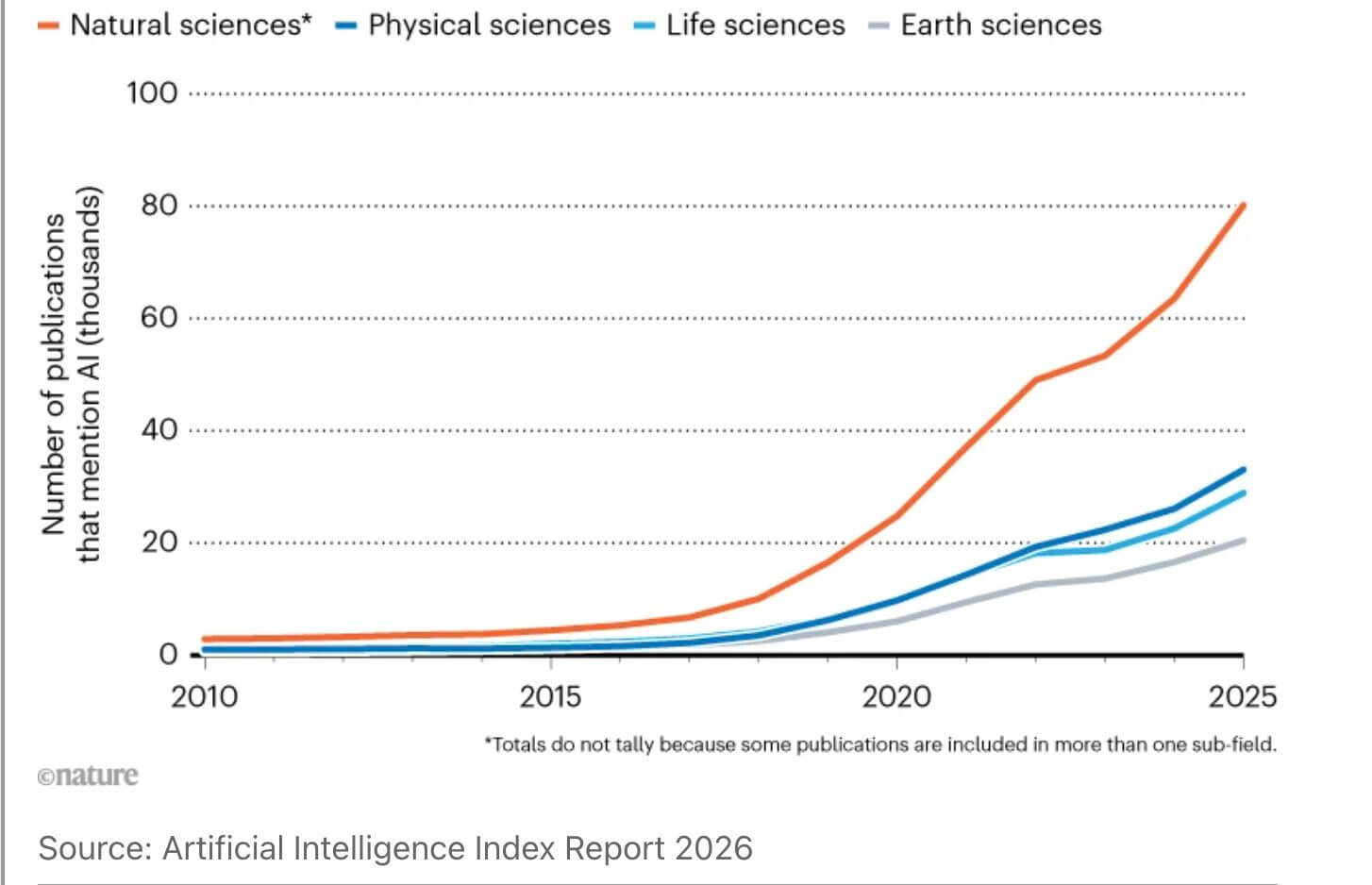

Gli scienziati stanno abbracciando l’intelligenza artificiale talmente rapidamente che il numero di pubblicazioni che menzionano l’AI nel campo delle scienze naturali è aumentato di quasi 30 volte dal 2010 al 2025. Lo riporta l’autorevole rapporto annuale sullo stato dell’arte del settore, l’Artificial Intelligence Index Report 2026 (Stanford-HAI, 2026).

Gli scienziati hanno davvero abbracciato l’era dell’AI ed era naturale che accadesse. “Vero, ma senza la retorica che ci costruiamo sopra”, commenta Stefano Epifani, Presidente della Fondazione per la Sostenibilità Digitale: “Le pubblicazioni nelle scienze naturali che menzionano l’IA sono cresciute enormemente: oggi la proporzione si colloca tra il 6% e il 9% in ogni singolo campo delle scienze naturali. È un dato reale. È un dato significativo. Ma è anche un dato che, come tutti i dati, può essere letto in modo troppo rapido, e quindi sbagliato”. Vediamo perché.

Indice degli argomenti

L’Agentic AI nel campo delle scienze naturali

La percentuale di pubblicazioni nel settore delle scienze naturali che menzionano l’intelligenza artificiale varia dal 6% al 9%, secondo l’Artificial Intelligence Index Report 2026, pubblicato dallo Stanford Institute for Human-Centered AI presso la Stanford University in California.

“Gli scienziati hanno davvero abbracciato l’era dell’AI”, conferma l’informatica Yolanda Gil della University of Southern California di Los Angeles, che ha guidato la stesura del rapporto sull’indice di quest’anno.

Tuttavia “dire che ‘gli scienziati hanno abbracciato l’era dell’IA’ e che ‘era naturale che accadesse’ è esattamente il tipo di semplificazione narrativa che dovremmo imparare a riconoscere prima di ripeterla. Perché nasconde una distinzione che invece è fondamentale: usare l’IA non è la stessa cosa che comprenderla. E pubblicare ricerche che menzionano l’IA non significa necessariamente fare scienza migliore grazie all’IA”, mette i puntini sulli i Stefano Epifani.

LLM per settori scientifici specifici

Oltre al boom delle pubblicazioni scientifiche relative all’IA, il rapporto elenca anche una serie di modelli di base scientifici di recente pubblicazione: modelli di AI addestrati in modo generico per svolgere un’ampia gamma di compiti, ma anche specificamente addestrati su enormi set di dati provenienti da un settore scientifico specifico.

Molti ricercatori hanno iniziato ad affidarsi ad Agentic AI che eseguono autonomamente azioni, compresi i flussi di lavoro scientifici, ma il rapporto di Stanford è scettico riguardo alle loro prestazioni.

Gli Agentic AI arrancano ancora, faticando ad eseguire in modo affidabile flussi di lavoro in più fasi, secondo il rapporto, con i migliori agenti di intelligenza artificiale che ottengono risultati pari a circa la metà di quelli degli specialisti umani con dottorato di ricerca. “Gli agenti sono meravigliosi, ma siamo ancora distanti dal punto in cui comprendiamo come utilizzarli in modo efficace”, afferma Gil.

Il boom dell’Agentic AI nelle pubblicazioni scientifiche

Secondo il rapporto, nel 2025 oltre 80.000 articoli, preprint e altre tipologie di pubblicazioni nel campo delle scienze naturali – che comprendono le scienze della vita, le scienze fisiche e le scienze della Terra – hanno menzionato l’intelligenza artificiale, con un aumento del 26% rispetto al 2024.

La sottocategoria della fisica ha registrato il maggior numero di pubblicazioni che menzionano l’intelligenza artificiale (33.000). La categoria delle scienze della Terra ha registrato la percentuale più alta (9%).

Il boom degli articoli scientifici relativi all’intelligenza artificiale «non è sorprendente», afferma l’informatico Arvind Narayanan dell’Università di Princeton nel New Jersey, che non ha partecipato alla creazione dell’indice. Tuttavia, aggiunge, non è chiaro se l’aumento dell’uso dell’IA sia produttivo per la scienza.

“Se questa crescita esplosiva sia significativa o meno è oggetto di un acceso dibattito”, dice Narayanan. “La mia opinione è che stia avvenendo troppo rapidamente, senza dare alle norme scientifiche il tempo di adeguarsi, e quindi la qualità della ricerca ha subito un crollo vertiginoso”.

Gil sostiene che non ci siano ancora prove che l’AI stia migliorando la produttività degli scienziati. “Gli studi sono limitati”, afferma. Ma, aggiunge Gil, gli scienziati “non possono farne a meno. Se togliessi loro l’AI, scoppierebbe una rivolta. Quindi deve essere d’aiuto in qualche modo”.

In particolare, secondo Stefano Epifani, “dobbiamo chiederci: questa crescita riflette un genuino progresso scientifico, oppure riflette anche la pressione accademica a ‘stare sul pezzo‘, a usare la parola giusta per ottenere finanziamenti, visibilità, citazioni? I due fenomeni coesistono, e confonderli è un errore che non ci possiamo permettere”.

I modelli più popolari fra gli scienziati

Con l’aumentare della diffusione, è cresciuto anche il numero di piattaforme di AI a disposizione dei ricercatori. Nell’ultimo anno sono emersi molti modelli di base per la scienza, tra cui il primo dedicato all’astronomia, AION-1, addestrato su oltre 200 milioni di oggetti celesti.

Questo training gli consente di classificare le galassie o di stimarne le proprietà. “Quando nel 2024 parlavo con gli scienziati e dicevo ‘Esistono modelli di base per la scienza’, gli scienziati non sapevano cosa significasse. Non sapevano che esistessero. Penso che abbiamo assistito a un progresso davvero molto rapido”, afferma Gil.

Secondo l’indice, nel 2025 le prestazioni dei modelli di base generici, che includono i grandi modelli linguistici (LLM) come quelli utilizzati dai chatbot, nei test di livello esperto hanno continuato a progredire rapidamente.

“Continuo a pensare: l’anno prossimo raggiungeranno un plateau. E invece no”, afferma Gil.

Tuttavia, questi modelli di AI di punta commettono ancora errori elementari, come leggere in modo errato gli orologi analogici nel 50% dei casi.

Una nota positiva è che i modelli che generano video “stanno iniziando a imparare come funziona realmente il mondo fisico”.

I sistemi di IA non capiscono la scienza: elaborano pattern

La comunità dell’AI spera da tempo che i modelli di intelligenza artificiale siano in grado di apprendere le regole fondamentali della fisica che governano il nostro mondo, come per esempio il modo in cui la gravità influisce su una palla che rimbalza.

Nel 2025, il modello video Veo 3 di Google DeepMind è stato in grado di simulare fenomeni come il galleggiamento senza aver avuto un training per imparare a farlo. Ma c’è ancora molta strada da fare, afferma Narayanan: “Nonostante alcuni piccoli successi, il sogno sembra piuttosto lontano”.

Inoltre occorre fare dei distinguo. “La scienza è uno degli ambiti in cui l’IA mostra capacità davvero rilevanti, perché lì conta la capacità di elaborare enormi quantità di dati strutturati”, spiega Stefano Epifani: “Ed è esattamente la cosa che le macchine sanno fare meglio degli esseri umani. Ma ricordiamoci sempre che i sistemi di IA non capiscono la scienza: elaborano pattern. La differenza tra prestazione e comprensione, che è il cuore del dibattito sull’intelligenza artificiale, vale anche in laboratorio. Forse soprattutto in laboratorio”.

Quindi sì, era prevedibile che accadesse che gli scienziati abbracciassero l’AI. Ma era anche “naturale”? “I processi culturali, anche quelli scientifici, non sono mai semplicemente naturali. Sono il risultato di incentivi, narrazioni, risorse, mode“, mette in guardia Stefano Epifani: “E la domanda che dovremmo porci non è se gli scienziati abbiano abbracciato l’IA, ma come lo stanno facendo. Con quanta consapevolezza critica. Con quanta attenzione alla distinzione tra strumento e oracolo. Perché la differenza tra i due, quando si tratta di scienza, non è un dettaglio filosofico”.

Il problema è la relazione cognitiva che si instaura con l’AI

Il rapporto di Stanford dice una cosa importante. Sui benchmark più impegnativi, come PaperArena, il miglior agente disponibile raggiunge il 38,8% di accuratezza, contro l’83,5% di un esperto con dottorato. E su ReplicationBench, i migliori sistemi ottengono meno del 20% sulla replica di paper di astrofisica , che è uno dei compiti scientifici in apparenza più meccanici e strutturati che si possano immaginare.

“Questi numeri non ci parlano di un ritardo contingente, che si colma aggiungendo potenza di calcolo o dati di addestramento. Ci parlano di qualcosa di strutturale”, spiega Epifani, presidente della Fondazione per la Sostenibilità Digitale.

“Gli agenti ottimizzano, ma non intendono. Eseguono, ma non scelgono. E la creatività scientifica, quella che porta a fare le domande giuste, a cambiare paradigma, a intuire connessioni che non erano nei dati di partenza, è esattamente il tipo di capacità che non si riduce a ottimizzazione statistica. Per quanto sofisticata”, continua Epifani.

Sfatare miti rassicuranti

Detto questo, “l’idea che l’IA possa occuparsi dei compiti ripetitivi liberando tempo agli scienziati per quelli più complessi è in linea di principio corretta. Ma è anche uno di quei miti rassicuranti che dobbiamo guardare con spirito critico, prima di abbracciarlo con troppo entusiasmo”.

Infatti “il problema non è lo strumento, ma la relazione cognitiva che si instaura con esso. Chi usa l’IA come amplificatore del proprio pensiero ne ricava valore reale. Chi la usa in modalità sostitutiva rischia di atrofizzare proprio le funzioni cognitive che vorrebbe preservare. E il confine tra le due modalità è molto più sottile di quanto sembri dall’esterno”.

Le capacità dell’Agentic AI nelle scienze naturali

Nel 2025 l’introduzione di diversi test di benchmark ha permesso di valutare le prestazioni dell’Agentic AI in compiti di rilevanza scientifica.

Un test denominato PaperArena, per esempio, sottopone agli agenti basati su LLM una domanda di ricerca e poi valuta la loro capacità di “formulare un piano di ragionamento, interagire con più articoli scientifici e ricorrere a strumenti appropriati per produrre una risposta ben fondata”, secondo quanto riportato nel preprint che descrive tale benchmark (il preprint non è ancora stato sottoposto a revisione tra pari).

In questo test, anche il miglior LLM alla base di un agente esperto ha raggiunto un’accuratezza di appena il 39%.

Narayanan ha una visione più positiva di ciò che l’Agentic AI è in grado di realizzare rispetto a quanto suggeriscano i risultati di PaperBench.

A novembre 2025, il suo stesso team ha dimostrato che gli agenti AI possono superare a pieni voti un test di riferimento per la riproduzione dei risultati computazionali presenti negli articoli scientifici.

“Ovviamente c’è molto clamore intorno agli agenti, ma sono già estremamente utili ai ricercatori come strumenti per risparmiare tempo”, afferma Narayanan.

L’uso dell’Agentic AI fa parte di una tendenza generale degli scienziati a utilizzare strumenti di IA non solo per l’analisi dei dati. Ma anche per tentativi più ampi di generazione di ipotesi e scoperta. C’è entusiasmo, ma, per ora, “l’elenco delle scoperte dell’AI confermate sperimentalmente rimane corto”, secondo il rapporto.

Infine il rischio per i ricercatori “non è che l’IA faccia meglio di loro i compiti complessi. I dati di Stanford lo escludono, almeno per ora, e con margini ancora ampi”, avverte Stefano Epifani.

“Il rischio in realtà è più sottile, e per questo più insidioso: che l’abitudine a delegare i task ‘noiosi’ eroda progressivamente la capacità di eseguirli, e con essa parte di quel pensiero critico che nasce proprio dall’esperienza faticosa con i dati, con le procedure, con gli errori“, conclude Stefano Epifani.