Negli ultimi anni le reti di telecomunicazione e, più in generale, le infrastrutture digitali hanno assunto un ruolo sempre più critico per il funzionamento dell’economia, delle istituzioni pubbliche e dei servizi essenziali.

Su di esse poggiano il cloud, l’intelligenza artificiale, l’Internet of Things, i servizi industriali avanzati, le piattaforme digitali per cittadini e imprese. Allo stesso tempo, cresce in modo costante l’aspettativa di affidabilità, continuità del servizio e resilienza, anche in presenza di eventi imprevisti di natura tecnologica, energetica, climatica o geopolitica.

Questo aumento delle responsabilità e delle prestazioni richieste alle reti non è però accompagnato, almeno nel contesto europeo, da una corrispondente crescita dei ricavi e dei margini degli operatori e dei gestori delle infrastrutture. Al contrario, il settore delle telecomunicazioni e delle reti digitali convive da anni con una pressione competitiva elevatissima, con prezzi medi tra i più bassi a livello globale e con una struttura dei costi sempre più sbilanciata verso l’operatività quotidiana. La combinazione di reti più estese, più distribuite, più software-based e più integrate con il mondo IT rende infatti la gestione tradizionale, fortemente dipendente dall’intervento umano, sempre meno sostenibile dal punto di vista economico.

In questo contesto, affidabilità e resilienza rischiano di essere percepite come un costo crescente e difficilmente comprimibile, anziché come un fattore di valore. È qui che emerge la necessità di un cambio di paradigma profondo, che non riguarda solo l’adozione di nuove tecnologie di rete, ma soprattutto il modo in cui le reti vengono osservate, governate e operate. La trasformazione software-defined delle infrastrutture, con la separazione dei piani di controllo, di trasporto e di gestione, ha aperto possibilità enormi in termini di flessibilità, programmabilità e rapidità di evoluzione. Allo stesso tempo, ha introdotto un livello di complessità che non può più essere affrontato con strumenti di monitoraggio tradizionali e con processi operativi manuali o semi-manuali.

In questo scenario si collocano le tecnologie e le architetture di observability e automation, che rappresentano oggi uno degli snodi centrali per la sostenibilità industriale delle reti. L’observability consente di superare il semplice controllo dello stato degli apparati per arrivare a una comprensione profonda e contestualizzata del comportamento delle reti e dei servizi, correlando dati, eventi e prestazioni su domini tecnologici diversi. L’automation, a sua volta, permette di tradurre questa conoscenza in azioni rapide, coerenti e ripetibili, riducendo drasticamente il numero di interventi manuali e aprendo la strada a modelli operativi a basso o nullo “human touch”.

L’obiettivo non è solo migliorare l’efficienza operativa, ma rendere possibile una gestione delle reti capace di adattarsi in tempo reale alle condizioni di funzionamento, di prevenire i degradi prima che si trasformino in disservizi e di mantenere livelli di qualità elevati anche in contesti di forte stress. In altre parole, osservabilità e automazione diventano i presupposti per passare da una gestione reattiva a una gestione predittiva e, progressivamente, autonoma.

Questo articolo si propone di analizzare questo percorso in modo organico, partendo dai presupposti economici che rendono inevitabile l’evoluzione verso modelli operativi fortemente automatizzati, approfondendo il ruolo della trasformazione software-defined delle reti e descrivendo le principali architetture di observability e automation oggi emergenti. Verranno inoltre discussi i target concreti che queste tecnologie consentono di raggiungere, non solo in termini tecnici ma anche di sostenibilità economica e di nuovi modelli di servizio. Infine, il tema sarà inquadrato nel contesto più ampio della digital sovereignty europea, evidenziando come il controllo delle piattaforme software, dei dati di rete e dei meccanismi di automazione rappresenti un elemento essenziale per l’autonomia strategica dell’Europa nel campo delle infrastrutture digitali.

Indice degli argomenti

La sostenibilità economica del modello operativo di gestione delle reti

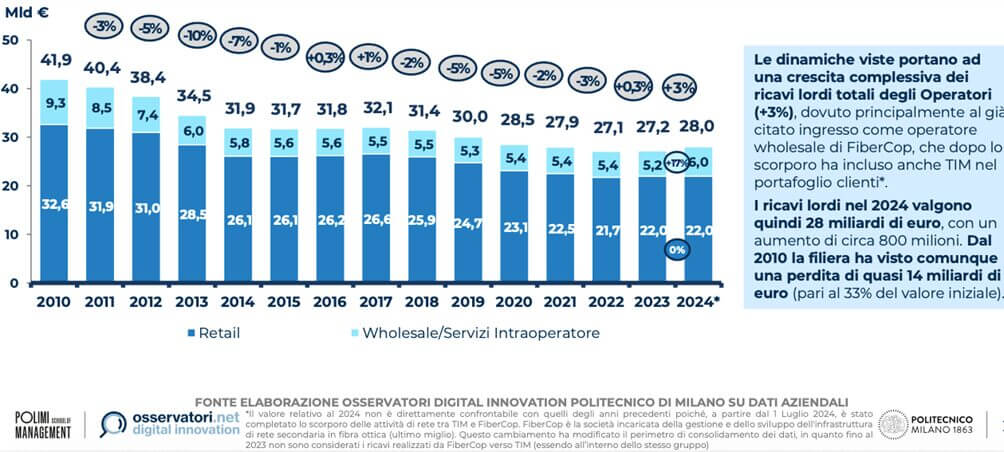

Il punto di partenza per comprendere la rilevanza delle tecnologie di observability e automation non può che essere economico. Il settore delle telecomunicazioni, in Italia come in gran parte d’Europa, vive da oltre un decennio una progressiva erosione dei ricavi che non ha eguali in altri comparti industriali a così alta intensità di capitale. Nel caso italiano, i dati più recenti mostrano con chiarezza la portata del fenomeno: i ricavi complessivi dei servizi di telecomunicazione sono passati da circa 42 miliardi di euro di quindici anni fa a poco più di 27 miliardi a fine 2024, come evidenziato nell’ultimo rapporto annuale di ASSTEL pubblicato a novembre del 2025 (figura 1).

Questa contrazione non è stata accompagnata da una riduzione proporzionale degli investimenti. Al contrario, gli operatori sono stati chiamati a sostenere cicli di CAPEX sempre più impegnativi per l’evoluzione delle reti fisse in fibra ottica, per il dispiegamento del 5G, per l’adeguamento delle dorsali di trasporto e per l’integrazione con infrastrutture cloud ed edge. Il risultato è un quadro economico-finanziario fortemente sbilanciato, in cui i flussi di cassa operativi, misurati come differenza tra EBITDA e CAPEX, risultano ormai prossimi allo zero. In queste condizioni, la capacità del settore di remunerare il capitale investito attraverso dividendi si riduce drasticamente, rendendo sempre più difficile attrarre e mantenere investitori di lungo periodo.

Figura 1: Evoluzione dei ricavi dei servizi di telecomunicazioni in Italia (Fonte ASSTEL – Politecnico di Milano)

Questo squilibrio strutturale evidenzia un paradosso che caratterizza oggi le telecomunicazioni: le reti sono più centrali che mai per lo sviluppo economico e sociale, ma il modello industriale che ne sostiene la realizzazione e la gestione appare sempre meno sostenibile. La crescita dei volumi di traffico, l’aumento della complessità tecnologica e l’estensione capillare delle infrastrutture non si traducono in una crescita proporzionale dei ricavi, mentre i costi operativi tendono a salire. Una parte significativa di questi costi è legata alle attività di gestione quotidiana delle reti, che restano in larga misura dipendenti da processi manuali, da interventi correttivi ex post e da strutture organizzative dimensionate per un mondo tecnologico molto meno dinamico di quello attuale.

In questo contesto, la riduzione degli OPEX non è più una semplice opzione di efficientamento, ma una condizione necessaria per la sopravvivenza del settore. Tuttavia, i margini di riduzione ottenibili attraverso interventi tradizionali di razionalizzazione organizzativa o di outsourcing sono ormai limitati. La vera leva di discontinuità risiede nella possibilità di trasformare radicalmente il modello operativo, passando da una gestione reattiva, basata sull’intervento umano, a una gestione proattiva e sempre più automatizzata. È precisamente in questo spazio che si collocano le tecnologie di observability e automation.

L’observability consente di ridurre in modo strutturale i costi operativi legati alla diagnosi dei problemi, all’analisi delle cause e alla gestione degli incidenti, grazie a una comprensione più profonda e tempestiva del comportamento delle reti e dei servizi. L’automation, a sua volta, permette di trasformare questa conoscenza in azioni automatiche e ripetibili, riducendo il numero di interventi manuali, abbreviando i tempi di ripristino e limitando l’impatto dei guasti sui clienti finali. L’effetto combinato di queste tecnologie non si limita a un miglioramento incrementale dell’efficienza, ma abilita una riduzione strutturale del costo unitario di gestione della rete.

In un settore in cui i flussi di cassa sono ormai insufficienti a sostenere contemporaneamente investimenti, remunerazione del capitale e crescita operativa, la capacità di comprimere gli OPEX senza degradare la qualità del servizio diventa il vero fattore abilitante di un nuovo equilibrio industriale. Observability e automation non rappresentano quindi un ulteriore costo tecnologico da giustificare, ma una risposta necessaria alla crisi di sostenibilità dei modelli operativi tradizionali. Senza questa trasformazione, il rischio è che l’evoluzione delle reti verso architetture sempre più complesse e distribuite si traduca in un aggravamento ulteriore delle difficoltà economiche del settore, compromettendone la capacità di sostenere nel tempo il ruolo strategico che la società gli assegna.

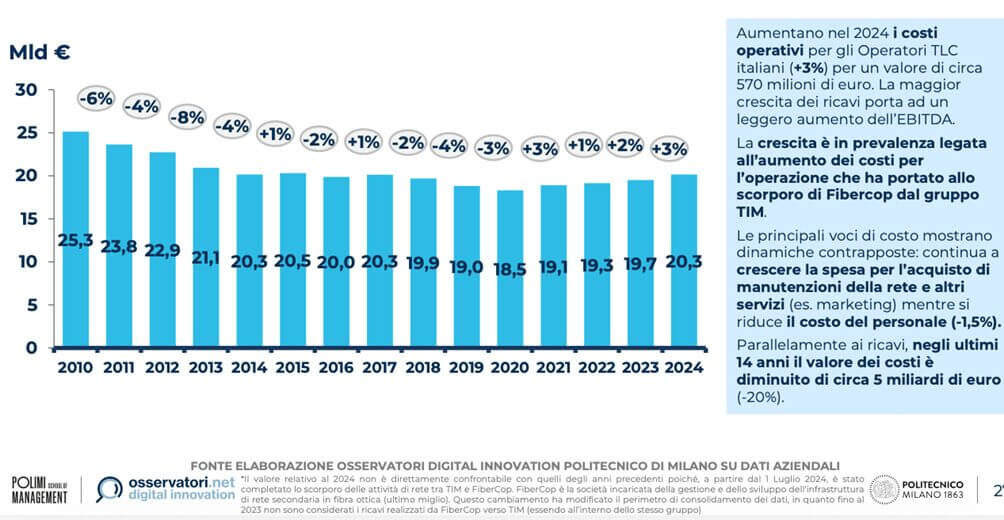

Accanto alla fotografia statica della crisi di sostenibilità economica del settore, è importante chiarire che l’adozione piena delle tecnologie di observability e automation non rappresenta una promessa astratta, ma una leva con effetti misurabili e già osservati in diversi contesti operativi. In Italia, a fronte di ricavi complessivi ormai stabilizzati intorno ai 27 miliardi di euro, i costi operativi degli operatori continuano a crescere e si collocano oggi nell’ordine dei 20 miliardi di euro annui. Questa dinamica rende evidente come anche riduzioni percentuali apparentemente contenute degli OPEX possano avere un impatto rilevante sui flussi di cassa e sulla sostenibilità complessiva del settore.

Le evidenze raccolte a livello internazionale mostrano che l’introduzione sistematica di architetture di observability avanzata, combinata con livelli crescenti di automazione dei processi di rete, consente riduzioni significative dei costi operativi lungo più direttrici. Una prima area di beneficio riguarda la gestione degli incidenti e dei degradi di servizio. La capacità di individuare precocemente le anomalie, di correlare automaticamente gli eventi e di intervenire in modo guidato o autonomo consente di ridurre drasticamente i tempi medi di ripristino e il numero di interventi manuali. In questi ambiti, le riduzioni di costo osservate sono tipicamente comprese tra il 15% e il 25% delle componenti OPEX legate alle attività di assurance e trouble management.

Un secondo contributo rilevante proviene dall’automazione dei processi di configurazione, attivazione e modifica dei servizi. Il passaggio da procedure manuali o semi-automatiche a modelli di provisioning zero touch riduce non solo il costo diretto del lavoro umano, ma anche gli errori di configurazione, che rappresentano una delle principali cause di disservizio nelle reti software-defined. In questo caso, le riduzioni di costo operative stimate si collocano frequentemente tra il 20% e il 30% sulle attività di service fulfillment e change management.

Un ulteriore effetto, spesso sottovalutato, riguarda la possibilità di stabilizzare e prevedere meglio il comportamento delle reti. La combinazione di observability e automazione consente infatti di ridurre la variabilità operativa, limitando la necessità di interventi correttivi urgenti e di strutture organizzative sovradimensionate per far fronte ai picchi di criticità. Questo porta, nel medio periodo, a una riduzione strutturale dei costi indiretti e a una maggiore scalabilità delle operazioni. Considerando l’insieme di questi fattori, una piena adozione del paradigma di zero touch network operations può realisticamente portare a riduzioni complessive degli OPEX nell’ordine del 25%–40%, a seconda del punto di partenza e del livello di maturità iniziale dell’operatore.

Su una base di costi operativi pari a circa 20 miliardi di euro annui, come nel caso italiano, questo si tradurrebbe potenzialmente in risparmi strutturali compresi tra 6 e 8 miliardi di euro. Si tratta di un ordine di grandezza sufficiente non solo a riequilibrare i flussi di cassa, ma anche a creare le condizioni per sostenere nuovi investimenti e, in prospettiva, tornare a una remunerazione adeguata del capitale; infatti, il settore produrrebbe a regime EBITDA per circa 14 miliardi di euro pari al 50% rispetto ai ricavi.

Figura 2: Evoluzione dei costi operativi per la gestione delle reti e dei servizi in Italia

Questa traiettoria evolutiva è stata formalizzata anche a livello di standard industriali. Il TeleManagement Forum ha infatti definito un modello di maturità dell’automazione delle reti, noto come Autonomous Networks, che descrive livelli crescenti di capacità operativa. Nei livelli più bassi l’automazione è limitata all’assistenza agli operatori umani e all’esecuzione di task ripetitivi sotto stretto controllo manuale. Salendo di livello, l’automazione diventa sempre più contestuale e basata sui dati, con sistemi in grado di suggerire azioni correttive e di eseguirle previa approvazione. Nei livelli più avanzati, l’intero ciclo operativo entra in modalità closed loop, con reti capaci di rilevare autonomamente anomalie, decidere le azioni più opportune e verificarne l’efficacia senza intervento umano. Il livello più elevato del modello descrive reti pienamente autonome, in grado di adattarsi dinamicamente agli obiettivi di servizio e alle condizioni operative, intervenendo in modo preventivo e continuo.

Il messaggio che emerge è chiaro: la riduzione degli OPEX non è il risultato di singole iniziative tattiche, ma l’effetto sistemico di un percorso di maturità verso la zero touch network operation. Observability e automation non sono quindi semplicemente strumenti di efficientamento, ma i pilastri di un nuovo modello operativo capace di riconciliare l’esigenza di reti sempre più affidabili e resilienti con la necessità, ormai non rinviabile, di ristabilire la sostenibilità economica del settore.

La trasformazione software-defined delle reti e la convergenza tra networking, computing e security

La possibilità di ridurre in modo strutturale i costi operativi e di abilitare modelli di gestione zero touch non nasce con le tecnologie di observability e automation, ma trova nella trasformazione software-defined delle reti il proprio presupposto tecnologico fondamentale. Senza questa trasformazione, ogni tentativo di automazione resta confinato a iniziative parziali, difficili da scalare e incapaci di incidere realmente sulla sostenibilità complessiva dei modelli operativi.

Le reti tradizionali erano costruite come sistemi fortemente hardware-centrici, nei quali funzioni di trasporto, controllo e gestione erano strettamente integrate negli apparati fisici. Questo modello, pur avendo garantito per decenni elevati livelli di affidabilità, è intrinsecamente rigido e poco adatto a un contesto in cui i servizi cambiano rapidamente, le topologie evolvono in modo dinamico e i volumi di traffico crescono in modo imprevedibile. La gestione di queste reti richiede un elevato numero di interventi manuali, competenze altamente specializzate e tempi di reazione incompatibili con le aspettative attuali di continuità del servizio.

La trasformazione software-defined ha introdotto una discontinuità profonda separando in modo sempre più netto il piano di trasporto dei dati, il piano di controllo e lo strato di gestione e intelligenza. Le funzioni di rete, un tempo vincolate all’hardware, vengono progressivamente virtualizzate, containerizzate e orchestrate attraverso piattaforme software, spesso basate su architetture cloud-native. Questo approccio rende le reti programmabili, dinamiche e potenzialmente adattive, ma introduce anche un livello di complessità che cresce rapidamente al crescere della scala e della distribuzione geografica.

È proprio in questo passaggio che emerge con forza il tema della convergenza tra networking, computing e security. Nelle reti software-defined di nuova generazione, la capacità elaborativa non è più confinata ai data center centrali, ma viene distribuita lungo la rete, dall’edge fino al core, per ospitare funzioni di rete, piattaforme applicative e meccanismi di sicurezza avanzata. Il confine tra infrastruttura di trasporto e infrastruttura di calcolo diventa sempre più sfumato, mentre la sicurezza si integra nativamente nei flussi di rete e nei processi di gestione, anziché essere aggiunta come strato esterno.

Questa convergenza non è un semplice fenomeno architetturale, ma un cambiamento strutturale del modello operativo. Le decisioni di instradamento del traffico, di allocazione delle risorse computazionali e di applicazione delle policy di sicurezza devono essere prese in modo coordinato e, sempre più spesso, in tempo reale. Ne consegue che la gestione delle reti non può più essere suddivisa in silos tecnologici separati, ma deve basarsi su una visione unificata e coerente dell’intero ecosistema digitale.

In assenza di un’adeguata observability, questa convergenza rischia di trasformarsi in un fattore di instabilità. La moltiplicazione dei punti di elaborazione, la dinamicità delle funzioni virtualizzate e la crescente interdipendenza tra rete, calcolo e sicurezza rendono infatti opaca la relazione tra eventi tecnici e impatto sui servizi. È qui che l’observability assume un ruolo abilitante, permettendo di ricostruire in modo continuo e contestualizzato lo stato del sistema, di comprendere le dipendenze tra componenti e di fornire la base informativa necessaria all’automazione.

Allo stesso tempo, l’automation rappresenta l’unico strumento in grado di governare efficacemente reti software-defined convergenti su larga scala. La programmabilità delle funzioni di rete, la disponibilità di API e la presenza di piattaforme di orchestrazione consentono di tradurre le decisioni operative in azioni automatiche e coerenti su domini diversi. In questo modello, la rete non è più un’infrastruttura statica da configurare manualmente, ma una piattaforma dinamica che reagisce agli obiettivi di servizio, alle condizioni di carico e ai requisiti di sicurezza.

La convergenza tra networking, computing e security rafforza ulteriormente la necessità di superare i modelli operativi tradizionali. Le reti di nuova generazione non possono essere gestite come una semplice somma di componenti tecnologiche, ma devono essere governate come sistemi complessi, distribuiti e adattivi. La trasformazione software-defined rende questo approccio tecnicamente possibile, ma solo l’integrazione profonda di observability e automation consente di renderlo sostenibile nel tempo, evitando che la complessità si traduca in un’esplosione dei costi operativi.

In questo senso, la software-defined transformation non è un obiettivo in sé, ma il terreno su cui si costruisce il passaggio verso reti realmente autonome, capaci di garantire affidabilità e resilienza elevata senza compromettere la sostenibilità economica. È su questo terreno che si innestano le architetture di observability e automation, che nel seguito verranno analizzate come elementi strutturali del nuovo modello operativo delle reti digitali.

È opportuno ricordare, a complemento dei punti evidenziati, che le reti di nuova generazione in futuro tenderanno a reintrodurre una logica di billing pay per use, a consumo, denominato NAAS (Network As A Service) e dunque le piattaforme di osservability e automation avranno in carico l’importante funzione di accounting in tempo reale proporzionale al consumo e alle prestazioni di qualità sottoscritte dinamicamente dai vari clienti. Anche in questo caso l’automazione completa di questa nuova prestazione è mandataria.

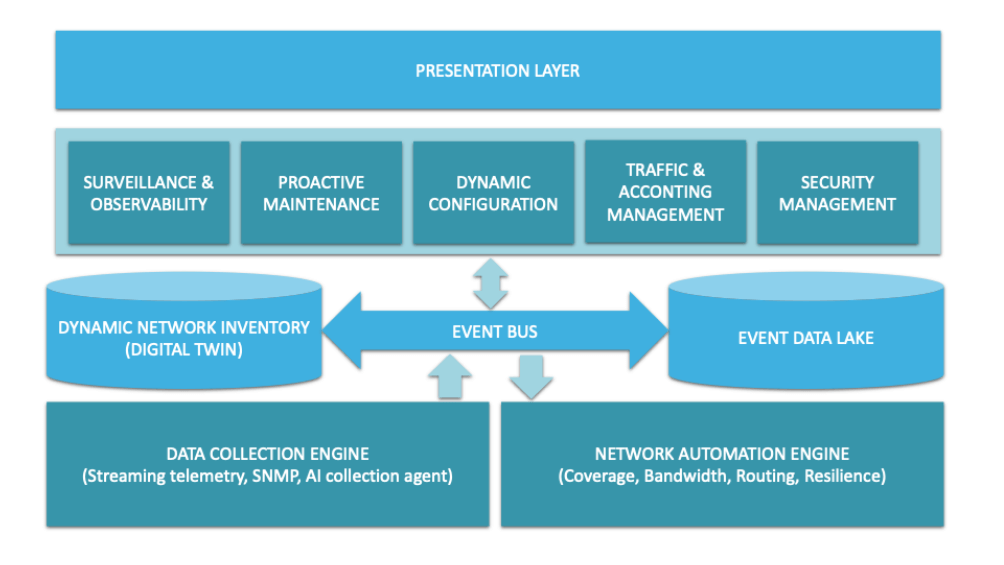

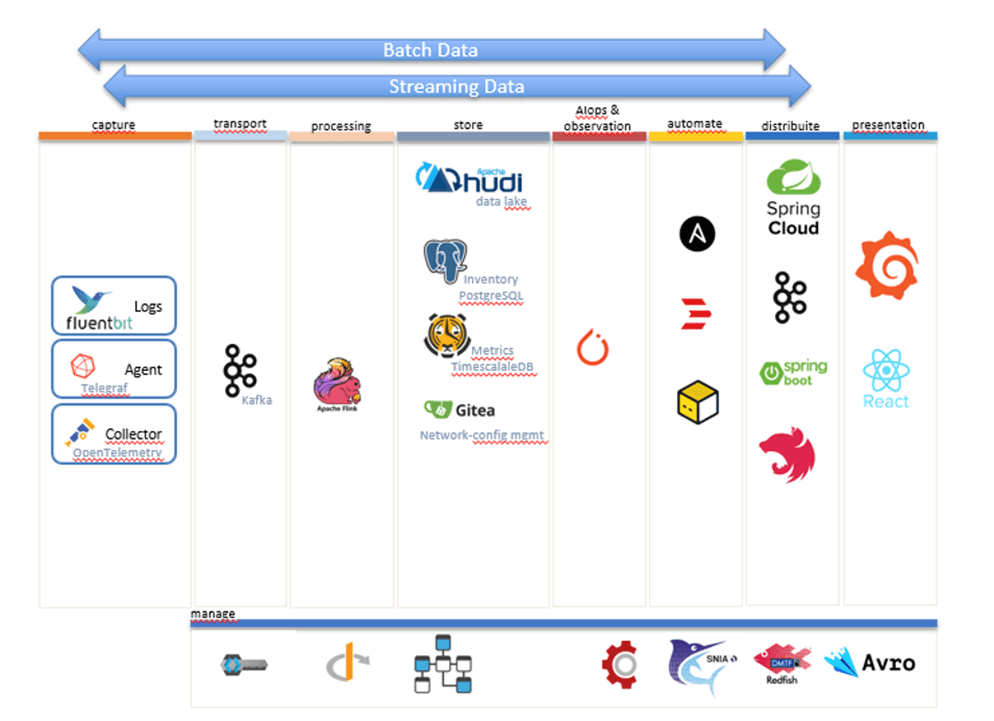

Le architetture di riferimento per observability e automation: dal network management allo zero touch operation

I sistemi moderni di Observability e Automation rappresentano un’evoluzione profonda rispetto ai tradizionali strumenti di network management. Non si tratta di piattaforme focalizzate esclusivamente sulla raccolta di allarmi o sulla visualizzazione di metriche, ma di veri e propri sistemi intelligenti di controllo operativo, progettati per governare infrastrutture digitali complesse, distribuite e convergenti. La loro architettura riflette questa ambizione e si articola in più strati funzionali strettamente interconnessi, ciascuno dei quali svolge un ruolo essenziale nel passaggio dalla visibilità alla decisione automatica. I domini e gli apparati gestiti sono molteplici: apparati e piattaforme di telecomunicazioni, dall’accesso ai POP di Edge e Core, gli ambienti di computing e storage, anche qui sia a livello Edge che Core, e gli ambienti security con le tecnologie end point, i firewall, i sistemi di controllo degli accessi e altro ancora (figura 3).

Strato di raccolta e normalizzazione dei dati

Alla base di questi sistemi si colloca lo strato di raccolta e normalizzazione dei dati. In una rete software-defined e multi-dominio, l’osservabilità efficace richiede la capacità di acquisire dati in modo continuo e near real time da sorgenti eterogenee, che includono apparati di rete, piattaforme di virtualizzazione, infrastrutture cloud ed edge, componenti di sicurezza e, sempre più spesso, applicazioni e servizi. La raccolta non può più basarsi unicamente su meccanismi periodici e pull-based, ma deve sfruttare in modo estensivo la streaming telemetry, i flussi di eventi e i log strutturati. Questo strato ha il compito di garantire la qualità, la coerenza temporale e l’arricchimento contestuale dei dati, trasformando segnali grezzi in informazioni utilizzabili dai livelli superiori. Senza questa base, qualsiasi tentativo di automazione risulta fragile e incline a generare azioni errate o incoerenti.

Modellazione dinamica dell’infrastruttura e digital twin

Al di sopra della raccolta dati si colloca il livello di modellazione dinamica dell’infrastruttura che rappresenta uno degli elementi più innovativi delle architetture moderne. La rete, il computing e la sicurezza non vengono più descritti come insiemi statici di apparati e configurazioni, ma come un sistema dinamico, continuamente aggiornato, che riflette la topologia reale, le dipendenze funzionali e le relazioni tra risorse fisiche, funzioni virtuali e servizi. Questo modello, spesso assimilabile al concetto di Digital Twin, consente di comprendere l’impatto di un evento o di una variazione su porzioni specifiche dell’infrastruttura e sui servizi erogati. In assenza di questa rappresentazione dinamica, i dati restano frammentati e l’analisi si limita a correlazioni superficiali.

Analisi avanzata e intelligenza operativa

Il terzo strato è quello dell’analisi avanzata e dell’intelligenza operativa. Qui convergono grandi volumi di dati storici e in tempo reale, che vengono elaborati attraverso motori di correlazione, algoritmi di machine learning e tecniche di analisi predittiva. L’obiettivo non è solo individuare anomalie rispetto a soglie predefinite, ma riconoscere pattern complessi, identificare cause profonde e anticipare condizioni di degrado prima che si traducano in disservizi percepiti dagli utenti. In questo livello, l’osservabilità assume una dimensione proattiva e predittiva, trasformandosi da strumento di diagnostica a fondamento della decisione automatica. È qui che la distinzione tra reti pubbliche e reti private diventa rilevante, perché cambiano le priorità di analisi e i modelli di impatto: nelle reti pubbliche prevalgono la gestione della capacità, la continuità del servizio e la resilienza multi-dominio; nelle reti private assumono maggiore peso la qualità applicativa, l’esperienza utente e la postura di sicurezza.

Figura 3: Lo schema funzionale di osservability e automation

Motore di automazione e closed loop

Il livello successivo è rappresentato dal motore di automazione, che traduce l’analisi in azioni operative. Nei sistemi più maturi, questo motore non si limita a eseguire workflow predefiniti, ma opera sulla base di policy e intent, tenendo conto di obiettivi di servizio, vincoli di sicurezza e condizioni operative correnti. L’automazione può intervenire su diversi ambiti, come la riconfigurazione dinamica della rete, la riallocazione di risorse computazionali, l’ottimizzazione dei flussi di traffico o l’attivazione di contromisure di sicurezza. Un elemento cruciale di questo strato è la capacità di verificare l’efficacia delle azioni intraprese, chiudendo il ciclo di controllo e alimentando un processo di apprendimento continuo. È questo meccanismo di closed loop che consente di ridurre progressivamente l’intervento umano e di aumentare l’affidabilità complessiva del sistema.

Presentazione e integrazione operativa

Sopra questi livelli tecnici si colloca lo strato di presentazione e integrazione operativa, che non va inteso come una semplice interfaccia grafica. Questo livello deve offrire viste coerenti e personalizzate per diversi ruoli, dall’operatore di rete al responsabile della sicurezza, fino alle funzioni di service management e di business. La capacità di rappresentare in modo chiaro lo stato della rete, l’impatto sui servizi e le azioni automatiche in corso è essenziale per mantenere la fiducia nei sistemi autonomi e per consentire un controllo umano efficace nei casi in cui sia richiesto.

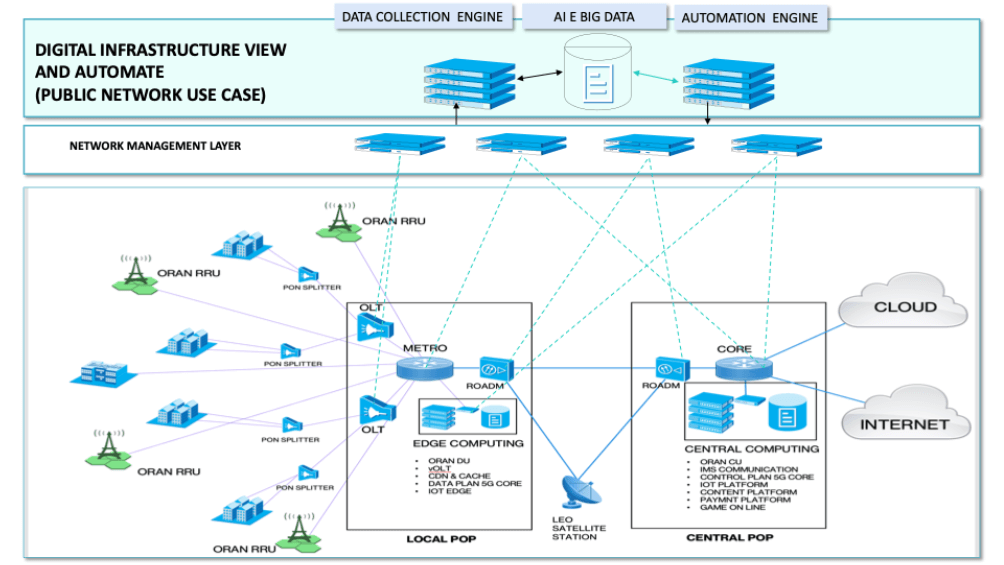

Su questa architettura funzionale si innestano i principali use case di Observability e Automation. Nelle reti pubbliche, uno dei casi d’uso più rilevanti è la gestione proattiva della resilienza, che include l’individuazione precoce di congestioni, il ribilanciamento automatico del traffico e il ripristino rapido dei servizi in caso di guasto, anche attraverso la riallocazione dinamica delle funzioni tra edge e core. Un altro ambito chiave è l’ottimizzazione della capacità, resa possibile dalla correlazione tra dati di traffico, condizioni di rete e domanda dei servizi, con interventi automatici che riducono sia il rischio di degrado sia l’overprovisioning strutturale. A questi si aggiungono use case legati all’efficienza energetica e alla sicurezza, sempre più integrati nella gestione complessiva della rete.

Figura 4: Use Case di osservability e automation nelle reti pubbliche

Nelle reti private, gli use case si concentrano maggiormente sull’affidabilità end-to-end dei servizi e sull’integrazione tra networking e security. L’observabilità consente di correlare eventi di rete con problemi applicativi e con anomalie di sicurezza, offrendo una visione unificata che riduce i tempi di diagnosi e di intervento. L’automazione permette di attuare risposte coordinate, come la riconfigurazione dei percorsi WAN, l’adattamento dinamico della banda o l’applicazione di policy di sicurezza contestuali, migliorando la continuità operativa senza aumentare il carico sul personale IT. In questo contesto, il valore principale non è solo la riduzione dei costi, ma la capacità di garantire livelli di servizio elevati e prevedibili in ambienti sempre più ibridi e distribuiti.

Nel loro insieme, queste architetture dimostrano come Observability e Automation costituiscano oggi un sistema integrato e coerente, progettato per governare la complessità delle reti software-defined e convergenti. La loro adozione non è una scelta puramente tecnologica, ma una trasformazione del modello operativo che abilita la zero touch network operation e rende sostenibile, nel lungo periodo, l’evoluzione delle infrastrutture digitali sia pubbliche sia private.

Il mercato delle piattaforme di observability ha raggiunto un livello di maturità elevato e, allo stesso tempo, una forte concentrazione attorno a un gruppo ristretto di vendor che si distinguono per completezza funzionale, capacità di esecuzione e visione di lungo periodo. Queste piattaforme non si limitano più al monitoraggio applicativo o infrastrutturale, ma si configurano come ambienti unificati per l’osservazione, l’analisi e, sempre più spesso, l’automazione delle operazioni IT e di rete.

Una recente analisi di Gartner indica tra i leader riconosciuti i seguenti: Datadog, Dynatrace, Splunk, Elastic, Grafana LABS, IBM.

Questi operatori condividono alcune caratteristiche chiave. Offrono piattaforme capaci di coprire in modo integrato infrastrutture, applicazioni, servizi cloud, ambienti containerizzati e, in misura crescente, workload di intelligenza artificiale. Sono in grado di scalare su ambienti di grandi dimensioni e ad alta dinamicità, supportano modelli operativi enterprise e dispongono di ecosistemi consolidati di integrazioni e partner. Un ulteriore elemento distintivo è la forte spinta verso l’automazione intelligente, che si traduce in capacità avanzate di analisi causale, riduzione del rumore, correlazione cross-domain e, in alcuni casi, attivazione diretta di azioni correttive.

Accanto a questi leader si collocano piattaforme con una visione particolarmente innovativa o con punti di forza specifici, come la gestione avanzata dei costi di telemetria, l’adozione radicale di standard aperti o l’attenzione alla sovranità del dato. Tuttavia, è il gruppo dei leader a definire oggi il riferimento funzionale per chi intende costruire una strategia di observability a supporto della zero touch network operation.

Funzionalità essenziali di una piattaforma moderna

L’analisi delle piattaforme più avanzate consente di individuare un insieme di funzionalità che non rappresentano più elementi differenzianti, ma prerequisiti essenziali. Una piattaforma che non le supporta in modo nativo difficilmente può sostenere casi d’uso avanzati o scalare su reti e infrastrutture complesse.

Il primo requisito fondamentale è la capacità di ingerire, correlare e analizzare in modo unificato tutte le principali forme di telemetria operativa. Metriche, log, eventi e trace devono poter convivere in un unico modello di analisi, con possibilità di esplorazione interattiva e correlazione temporale. Questa unificazione è alla base della capacità di comprendere il comportamento dei sistemi complessi e di superare la frammentazione tipica degli strumenti legacy.

Un secondo elemento imprescindibile è l’arricchimento contestuale dei dati, ottenuto attraverso la mappatura automatica delle dipendenze tra componenti infrastrutturali, applicazioni e servizi. Le piattaforme più mature costruiscono e mantengono in modo continuo una rappresentazione dinamica delle relazioni topologiche e funzionali, consentendo di collegare un evento tecnico all’impatto reale sui servizi e, in prospettiva, sui processi di business.

La terza funzione chiave è l’adozione estesa di analytics avanzati e tecniche di machine learning. Non si tratta solo di anomaly detection basata su soglie dinamiche, ma di capacità di analisi causale, clustering degli eventi, riduzione del rumore e individuazione delle cause profonde. In questo ambito, le piattaforme leader stanno progressivamente integrando funzionalità di AI generativa e agentica, a supporto dell’analisi, della diagnosi e della raccomandazione di azioni operative.

Un ulteriore requisito ormai imprescindibile è il supporto nativo alla definizione e al monitoraggio di indicatori di affidabilità orientati al servizio, come SLI (Service Level Indicator), SLO (Service Level Objective) ed error budget. Questo consente di spostare il focus dall’infrastruttura al servizio erogato, rendendo l’observability uno strumento centrale per i modelli SRE (Site Reliability Engineering) e per la governance della qualità. Senza questa capacità, l’osservazione resta confinata a una dimensione puramente tecnica.

La gestione del costo della telemetria è diventata a sua volta una funzione critica. Le piattaforme più evolute offrono strumenti per controllare ingestione, retention e granularità dei dati, consentendo di bilanciare profondità di osservazione e sostenibilità economica. Questo aspetto è particolarmente rilevante in contesti telco e large enterprise, dove i volumi di dati possono crescere rapidamente fino a diventare essi stessi una fonte di inefficienza.

Infine, una piattaforma di observability moderna deve essere progettata per l’integrazione nativa con sistemi di automazione, orchestrazione, IT service management e sicurezza. La capacità di attivare azioni correttive, di alimentare workflow automatici o di supportare processi di remediation guidata è ciò che trasforma l’observability da strumento di analisi a componente abilitante del closed loop operativo. In questa direzione si collocano anche le funzionalità emergenti di AI observability, dedicate al controllo di prestazioni, costi e comportamento dei modelli di intelligenza artificiale e dei carichi generativi.

I target raggiungibili

Il valore reale delle architetture di observability e automation non risiede nella loro sofisticazione tecnologica, ma nella capacità di produrre risultati misurabili e ripetibili sul piano operativo ed economico. È su questo terreno che queste piattaforme dimostrano di essere un fattore abilitante della sostenibilità del settore, traducendo la complessità delle reti software-defined e convergenti in un governo più stabile, prevedibile e meno costoso.

Il primo insieme di target riguarda l’affidabilità dei servizi. La disponibilità di una osservabilità end-to-end, capace di correlare in tempo reale eventi di rete, di computing e di sicurezza con lo stato dei servizi, consente di ridurre in modo significativo il numero di fault non rilevati o rilevati tardivamente. Le architetture moderne permettono di individuare anomalie prima che queste si traducano in disservizi percepiti dagli utenti, spostando l’operatività da un modello reattivo a un modello proattivo. Questo si riflette in un miglioramento diretto degli indicatori di affidabilità, come la disponibilità complessiva dei servizi e il rispetto degli obiettivi di servizio definiti attraverso SLI e SLO. In contesti maturi, l’adozione sistematica di queste tecnologie consente di stabilizzare i livelli di servizio su valori elevati senza ricorrere a sovradimensionamenti infrastrutturali o a un aumento del presidio umano.

Strettamente connesso all’affidabilità è il tema della resilienza. Le reti moderne sono esposte a un numero crescente di eventi perturbativi, che spaziano dai guasti fisici alle anomalie software, fino agli attacchi di sicurezza e ai picchi improvvisi di domanda. In questo contesto, la resilienza non può più essere garantita solo attraverso ridondanze statiche, ma richiede capacità di adattamento dinamico. Le architetture di observability e automation abilitano questa adattività rendendo possibile il ribilanciamento automatico dei flussi di traffico, la riallocazione delle risorse computazionali, la riconfigurazione dei percorsi di rete e l’attivazione coordinata di contromisure di sicurezza. Il risultato è una riduzione sensibile della durata e dell’impatto degli incidenti, misurabile attraverso indicatori come il Mean Time To Detect e il Mean Time To Restore, che tendono a ridursi drasticamente al crescere del livello di automazione. La resilienza diventa così una proprietà intrinseca del sistema, anziché un obiettivo perseguito caso per caso attraverso interventi manuali.

Il terzo e forse più rilevante ambito di misurazione riguarda la riduzione degli OPEX. Come discusso nei capitoli precedenti, una quota significativa dei costi operativi degli operatori e dei gestori di reti è assorbita dalle attività di gestione quotidiana, dalla risoluzione degli incidenti, dalla gestione dei cambiamenti e dal coordinamento tra domini tecnologici diversi. Le architetture di observability e automation intervengono direttamente su queste voci di costo, riducendo il numero di interventi manuali, abbattendo il tempo necessario per la diagnosi dei problemi e limitando gli errori di configurazione, che rappresentano una delle principali cause di disservizio. Il passaggio verso modelli di zero touch operation consente inoltre di scalare la rete e i servizi senza una crescita proporzionale delle strutture operative, introducendo un disaccoppiamento strutturale tra complessità tecnica e costo operativo.

Questi benefici non sono isolati, ma si rafforzano reciprocamente. Una maggiore affidabilità riduce il numero di incidenti critici e quindi il carico operativo. Una maggiore resilienza limita l’impatto economico dei fault residui e migliora la prevedibilità del servizio. La riduzione degli OPEX, a sua volta, crea spazio per investimenti mirati in automazione e intelligenza, innescando un circolo virtuoso che consente di migliorare ulteriormente le prestazioni senza aggravare i costi. In questo senso, observability e automation non producono solo efficienza, ma contribuiscono a ristabilire un equilibrio industriale più sano, in cui qualità del servizio e sostenibilità economica non sono più in contraddizione.

È importante sottolineare che il raggiungimento di questi target non avviene in modo istantaneo, ma attraverso un percorso di maturità. Le architetture descritte consentono di iniziare con casi d’uso circoscritti, come la riduzione del MTTR o l’automazione di specifici processi di rete, per poi estendere progressivamente il perimetro fino a coprire l’intero ciclo operativo. In questa traiettoria evolutiva, la misurazione continua dei risultati diventa essa stessa parte del sistema, permettendo di dimostrare in modo oggettivo il valore generato e di orientare le scelte tecnologiche e organizzative successive.

Quando si parla di riduzioni degli OPEX nell’ordine del 30–40%, è naturale che emerga un certo scetticismo, soprattutto in un settore storicamente abituato a miglioramenti incrementali più che a discontinuità. Tuttavia, nel caso delle architetture di observability e automation, questi livelli di risparmio non derivano da una singola leva di efficientamento, ma dall’effetto cumulativo di più trasformazioni strutturali che agiscono simultaneamente sul modello operativo della gestione delle reti.

Una prima fonte di risparmio significativo riguarda la drastica riduzione delle attività manuali a basso valore aggiunto. Nei modelli operativi tradizionali, una quota rilevante degli OPEX è assorbita da interventi ripetitivi, analisi manuali degli incidenti, verifiche incrociate tra team e riconfigurazioni eseguite sotto pressione. L’introduzione di una observability profonda, unita a meccanismi di automazione a ciclo chiuso, consente di eliminare o ridurre fortemente queste attività. La rete diventa in grado di rilevare autonomamente le anomalie, di contestualizzarle e, in molti casi, di correggerle senza intervento umano. Questo non comporta solo una riduzione del numero di addetti necessari, ma soprattutto una riduzione del tempo complessivo speso in attività operative non pianificate, che sono tra le più costose e meno prevedibili.

Un secondo fattore determinante è la riduzione dei tempi di diagnosi e di ripristino. Nei modelli tradizionali, il costo di un incidente non è dato solo dall’evento in sé, ma dalla sua durata e dalla quantità di risorse mobilitate per risolverlo. Le architetture di observability moderne riducono drasticamente il Mean Time To Detect e il Mean Time To Restore grazie alla correlazione automatica degli eventi e all’analisi causale. L’automazione consente inoltre di applicare rapidamente azioni correttive standardizzate, evitando escalation prolungate e coinvolgimenti multipli di team diversi. La conseguenza è una riduzione significativa dei costi operativi legati alla gestione degli incidenti, che in molte organizzazioni rappresentano una quota rilevante degli OPEX complessivi.

Un terzo elemento spesso sottovalutato è la riduzione degli errori operativi. Numerosi studi e analisi di settore convergono nel riconoscere che una percentuale elevata dei disservizi di rete ha origine da errori di configurazione o da cambiamenti gestiti in modo non coerente. L’automazione basata su policy e intent riduce drasticamente questa classe di errori, perché elimina l’ambiguità delle operazioni manuali e garantisce che le modifiche siano applicate in modo consistente su tutti i domini coinvolti. Questo non solo abbassa il numero di incidenti, ma riduce anche i costi indiretti associati a rollback, troubleshooting e attività correttive successive.

Un’ulteriore leva di risparmio è rappresentata dalla maggiore prevedibilità operativa. Le piattaforme di observability consentono di comprendere meglio il comportamento delle reti nel tempo, di individuare pattern ricorrenti e di anticipare condizioni di saturazione o degrado. Questo permette di passare da una gestione reattiva a una gestione pianificata, riducendo il ricorso a interventi d’urgenza e a strutture organizzative sovradimensionate per far fronte a eventi imprevisti. La possibilità di pianificare gli interventi, di automatizzare le attività ricorrenti e di ridurre la variabilità operativa si traduce in una compressione strutturale dei costi.

Infine, un contributo rilevante alla riduzione degli OPEX deriva dalla scalabilità del modello operativo. Nei modelli tradizionali, l’aumento della complessità della rete comporta quasi inevitabilmente un aumento proporzionale delle risorse umane dedicate alla gestione. Le architetture di observability e automation rompono questo legame, consentendo di gestire reti più grandi e più complesse con strutture operative sostanzialmente stabili. Questo effetto di disaccoppiamento tra crescita della complessità e crescita dei costi è uno dei principali motivi per cui i risparmi complessivi possono raggiungere percentuali elevate nel medio periodo.

È importante sottolineare che queste riduzioni non si materializzano istantaneamente, ma emergono lungo un percorso di maturità che porta dalla semplice automazione di singoli processi alla piena zero touch network operation. Tuttavia, una volta raggiunta una massa critica di casi d’uso automatizzati e un livello adeguato di observability end-to-end, l’effetto combinato di tutte queste leve rende plausibile e sostenibile una riduzione degli OPEX nell’ordine del 30–40%. In un contesto come quello italiano, dove i costi operativi complessivi si collocano intorno ai 20 miliardi di euro annui, anche la parte bassa di questo intervallo rappresenta un impatto economico di portata sistemica, capace di modificare radicalmente l’equilibrio finanziario del settore.

Sovereignty tecnologica e dei dati per le funzioni observability e automation

Il tema della digital sovereignty è entrato stabilmente nel dibattito europeo sulle infrastrutture digitali, ma viene ancora troppo spesso affrontato in modo parziale, concentrandosi prevalentemente sul controllo fisico delle reti, sulla localizzazione dei data center o sulla proprietà degli asset infrastrutturali. Nel caso delle reti software-defined e convergenti, questa impostazione non è più sufficiente. La sovranità non si gioca solo sul possesso delle infrastrutture, ma sulla capacità di osservarle, governarle e farle evolvere in modo autonomo. In questo senso, le piattaforme di observability e automation rappresentano uno degli snodi più delicati e strategici dell’intero ecosistema digitale.

Nelle architetture moderne, sono queste piattaforme a costituire il vero “cervello operativo” delle reti. Esse raccolgono e aggregano dati estremamente sensibili, che descrivono in dettaglio la topologia delle infrastrutture, i flussi di traffico, il comportamento dei servizi, le dipendenze tra domini tecnologici e, sempre più spesso, anche eventi di sicurezza e informazioni sull’esperienza degli utenti. Controllare questi dati significa avere una conoscenza profonda del funzionamento delle reti e dei servizi che su di esse si appoggiano. Delegare integralmente questa funzione a piattaforme extraeuropee comporta una dipendenza strutturale che va ben oltre il semplice lock-in tecnologico.

La questione diventa ancora più rilevante se si considera che l’observability non è più un’attività puramente descrittiva. Le piattaforme più evolute integrano algoritmi di analisi avanzata, modelli di machine learning e componenti di intelligenza artificiale che influenzano direttamente le decisioni operative. Quando queste piattaforme sono collegate a sistemi di automazione a ciclo chiuso, esse non si limitano a suggerire azioni, ma le eseguono, modificando in tempo reale il comportamento della rete. In questo scenario, la sovranità non riguarda solo i dati, ma anche gli algoritmi, le policy decisionali e le logiche di controllo che determinano come una rete reagisce a eventi, guasti o attacchi.

Dal punto di vista europeo, questo apre una serie di interrogativi strategici. Se le piattaforme di observability e automation sono proprietarie, opache e gestite al di fuori del perimetro giuridico europeo, la capacità di audit, di verifica e di intervento autonomo risulta fortemente limitata. Inoltre, l’evoluzione delle funzionalità, delle roadmap e dei modelli di licensing resta legata a decisioni industriali che rispondono a logiche di mercato e di policy non necessariamente allineate agli interessi europei. In altre parole, il rischio è quello di costruire reti formalmente europee, ma governate da “sistemi nervosi” esterni.

Il tema della sovereignty si intreccia anche con quello della resilienza sistemica. In un contesto caratterizzato da crescenti tensioni geopolitiche, da rischi cyber e da una dipendenza sempre maggiore dai servizi digitali, la capacità di mantenere il controllo operativo delle reti in condizioni di stress diventa un fattore critico. Le piattaforme di observability e automation devono poter operare anche in scenari di isolamento, di degrado delle interconnessioni internazionali o di restrizioni normative improvvise. Questo richiede architetture flessibili, opzioni di deployment locali o ibride e un controllo diretto sui meccanismi di aggiornamento, configurazione e sicurezza.

Un ulteriore aspetto riguarda la protezione e la valorizzazione dei dati di rete come asset strategico. I flussi di telemetria raccolti dalle piattaforme di observability rappresentano una fonte di conoscenza di enorme valore, non solo per l’operatività immediata, ma anche per l’ottimizzazione di lungo periodo, la pianificazione degli investimenti e lo sviluppo di nuovi servizi. Garantire che questi dati restino sotto il controllo degli operatori europei, nel rispetto delle normative e dei principi di trasparenza, è una condizione essenziale per evitare che il valore generato dalle infrastrutture venga estratto e monetizzato altrove.

In questo quadro, la digital sovereignty non implica necessariamente l’esclusione di tecnologie globali, ma richiede la capacità di scegliere, integrare e governare le piattaforme in modo consapevole. Standard aperti, interoperabilità, possibilità di deployment on-premise o in cloud sovrani, trasparenza delle API e controllabilità degli algoritmi diventano criteri fondamentali nella selezione delle soluzioni di observability e automation. Allo stesso tempo, si apre uno spazio industriale significativo per lo sviluppo e il rafforzamento di competenze europee in questo ambito, sia attraverso soluzioni native sia attraverso modelli ibridi che riducano le dipendenze più critiche.

Figura 5: Le componenti Open Source di una piattaforma di Observability & Automation e priorità della Sovereignty tecnologica e dei dati

La realizzazione di una piattaforma sovrana di observability e automation non può limitarsi alla selezione di singoli strumenti open source, ma richiede una vera e propria architettura end-to-end, capace di coprire l’intero ciclo di vita del dato operativo e di trasformarlo in conoscenza e azione. È esattamente questo il razionale alla base della opportunità di costruire una piattaforma italiana di nuova generazione facendo leva su software open source consolidati, integrati in modo coerente e completati con componenti di governo, automazione e presentazione.

L’architettura è concepita come un insieme di layer funzionali ben distinti ma strettamente interconnessi, che accompagnano il dato lungo un flusso continuo, dalla sua generazione fino all’utilizzo operativo. Alla base si colloca la fase di capture, in cui vengono raccolti log, metriche, eventi e trace attraverso agenti e collector standardizzati, capaci di operare in ambienti di rete, cloud, edge e sicurezza. La scelta di tecnologie aperte e ampiamente adottate consente di evitare dipendenze da formati proprietari e di garantire la piena portabilità dei dati, un elemento chiave quando si parla di infrastrutture critiche.

Il livello di transport e processing introduce un paradigma event-driven e streaming-first, che consente di gestire grandi volumi di dati in tempo reale, senza rinunciare alla possibilità di elaborazioni batch per analisi storiche e di lungo periodo. Questo approccio è fondamentale per supportare casi d’uso di resilienza e automazione, dove la tempestività dell’informazione è un fattore determinante. Il dato non viene semplicemente accumulato, ma filtrato, arricchito e trasformato lungo il percorso, riducendo rumore e ridondanza e aumentando il valore informativo disponibile ai livelli superiori.

La fase di store rappresenta uno dei pilastri della sovereignty della piattaforma. I dati vengono conservati in repository sotto il pieno controllo dell’organizzazione, separando in modo chiaro i diversi domini informativi: telemetria operativa, metriche temporali, inventario dinamico della rete, configurazioni e metadati. Questo consente non solo di rispettare requisiti normativi e di sicurezza, ma anche di costruire una base dati solida per analisi avanzate, digital twin di rete e modelli predittivi. In questo modello, il dato di osservabilità non è un sottoprodotto operativo, ma un asset strategico che resta all’interno del perimetro sovrano.

Sopra lo strato di gestione e modellazione si innesta il livello di observability avanzata e AIOps, dove i dati vengono correlati, analizzati e interpretati. Qui la piattaforma esprime una delle sue caratteristiche distintive: la capacità di combinare osservazione tecnica, comprensione del contesto di servizio e analisi intelligente, creando le condizioni per una riduzione drastica dei tempi di diagnosi e per l’abilitazione del closed loop operativo. L’uso di software open source in questo ambito non è una scelta ideologica, ma una garanzia di trasparenza degli algoritmi, di ispezionabilità dei modelli e di possibilità di adattamento alle specificità delle reti pubbliche e private italiane.

Il layer di automation e control rappresenta il punto di convergenza tra osservazione e azione. Le informazioni prodotte dai livelli inferiori alimentano motori di automazione basati su policy e intent, in grado di intervenire su configurazioni di rete, allocazioni di risorse, instradamento del traffico e meccanismi di resilienza. In un’ottica di sovereignty, è cruciale che queste logiche decisionali siano governabili, verificabili e modificabili localmente, senza dipendere da piattaforme esterne che operano come “scatole nere”. La piattaforma consente così di costruire modelli di zero touch operation progressivi, mantenendo sempre la possibilità di controllo umano e di audit.

Infine, il livello di presentation e visualization completa il quadro, offrendo viste coerenti per operatori, ingegneri, responsabili della sicurezza e funzioni di governo del servizio. Non si tratta di semplici dashboard, ma di strumenti di lettura integrata dello stato della rete e dei servizi, capaci di mostrare l’impatto operativo ed economico delle decisioni automatiche. Anche in questo caso, la scelta di tecnologie aperte e standard consente di evitare lock-in e di adattare l’esperienza utente alle esigenze specifiche dei contesti pubblici e privati.

Nel suo insieme, questa architettura dimostra come la sovereignty delle piattaforme di observability e automation possa essere perseguita in modo concreto ed efficace, senza rinunciare alla qualità tecnologica e all’innovazione. L’uso sapiente di software open source, integrati in una piattaforma coerente e industrializzata, consente di mantenere il controllo sui dati, sugli algoritmi e sui processi decisionali che governano le reti. È una scelta che risponde alle esigenze delle infrastrutture critiche, ma che apre anche la strada a un modello europeo di gestione delle reti, in cui efficienza operativa, sostenibilità economica e autonomia strategica non sono obiettivi in conflitto, ma parti di una stessa visione.

Conclusioni

Il quadro che emerge con chiarezza è che l’adozione sistematica delle tecnologie di observability e automation non rappresenta più una scelta opzionale o un’evoluzione incrementale dei modelli di gestione delle reti, ma una priorità industriale per la salvaguardia stessa della redditività del settore TELCO. In un contesto caratterizzato da ricavi stagnanti o in contrazione, da investimenti infrastrutturali elevati e da una complessità tecnologica in costante aumento, continuare a operare le reti con modelli fortemente dipendenti dall’intervento umano significa accettare una progressiva erosione dei margini e una crescente fragilità operativa.

Le architetture di observability e automation consentono di spezzare questo circolo vizioso, introducendo un nuovo equilibrio tra affidabilità, resilienza e sostenibilità economica. Rendono possibile una gestione proattiva e, progressivamente, autonoma delle reti, riducono drasticamente i costi operativi, migliorano la qualità del servizio e creano le condizioni per scalare le infrastrutture senza una crescita proporzionale degli OPEX. In questo senso, la zero touch network operation non è un obiettivo teorico, ma la risposta concreta a una crisi strutturale del modello industriale delle telecomunicazioni.

Questa priorità economica si intreccia in modo sempre più stretto con le esigenze di sovereignty tecnologica e dei dati. Le piattaforme di observability e automation sono oggi il vero centro di governo delle reti: raccolgono dati estremamente sensibili, li trasformano in conoscenza operativa e, attraverso l’automazione, influenzano direttamente il comportamento delle infrastrutture. Delegare integralmente queste funzioni a piattaforme opache o extraeuropee significa accettare una dipendenza strategica che incide non solo sulla competitività industriale, ma anche sulla sicurezza e sulla resilienza delle infrastrutture critiche.

Per il settore TELCO, e più in generale per l’ecosistema delle reti pubbliche e private, la sfida è quindi duplice. Da un lato, è necessario adottare rapidamente tecnologie di observability e automation avanzate per recuperare efficienza, ridurre gli OPEX e ristabilire condizioni di redditività sostenibili. Dall’altro, è fondamentale farlo in modo coerente con una strategia di controllo dei dati, degli algoritmi e delle piattaforme software che governano le reti, valorizzando soluzioni aperte, interoperabili e pienamente governabili.

In questa prospettiva, la costruzione di piattaforme di observability e automation basate su software open source integrati e industrializzati rappresenta una strada concreta per conciliare innovazione, sostenibilità economica e autonomia strategica. Non si tratta di contrapporre modelli tecnologici, ma di riconoscere che il controllo del “sistema nervoso” delle reti è ormai tanto importante quanto il controllo delle infrastrutture fisiche. Solo così il settore TELCO potrà affrontare le sfide dei prossimi anni, trasformando la gestione delle reti da fattore di costo e di dipendenza tecnologica a leva di competitività, resilienza e sovranità digitale.