L’intelligenza artificiale generativa si è affermata come una tecnologia rivoluzionaria nel settore sanitario, guidando la trasformazione in ambiti chiave quali il coinvolgimento dei pazienti e la gestione dei percorsi di cura.

Indice degli argomenti

IA generativa in sanità: potenziale e sfide per i professionisti della cura

Ha dimostrato un significativo potenziale nel rivoluzionare il modo in cui i professionisti sanitari erogano cure di qualità superiore, grazie a sistemi automatizzati dotati di strumenti di supporto diagnostico in grado di fornire suggerimenti tempestivi e personalizzati, contribuendo in ultima analisi a migliori esiti clinici. Ad esempio, uno studio pubblicato su BMC Medical Education ha evidenziato che gli studenti di medicina che hanno ricevuto feedback generati da modelli linguistici di grandi dimensioni (Large Language Models, LLM) durante interazioni simulate con i pazienti hanno mostrato un miglioramento significativo nel processo decisionale clinico rispetto a coloro che non ne hanno beneficiato.

Progettare applicazioni di IA responsabile: perché la fase di design è decisiva

Alla base di generare conversazioni estremamente naturali, consentendo agli operatori del settore sanitario di sviluppare soluzioni per la fatturazione, la diagnosi, il trattamento e la ricerca in grado di svolgere compiti complessi e operare in modo autonomo sotto la supervisione umana. Tuttavia, per sfruttare appieno il valore dell’IA generativa è fondamentale comprendere i potenziali rischi e impatti sulla fornitura dei servizi sanitari. Ciò rende necessaria un’attenta pianificazione, nonché la definizione e l’implementazione rigorosa di un approccio sistemico alla progettazione di applicazioni basate su IA generativa che siano sicure e responsabili.

Assume un ruolo fondamentale la fase di progettazione delle applicazioni di IA generativa nel settore sanitario, inclusa la definizione di politiche a livello di sistema che regolano input e output. Tali politiche possono essere considerate come un insieme di linee guida che, se applicate correttamente, contribuiscono alla realizzazione di sistemi di IA affidabili.

Architettura e guardrail: come strutturare un sistema di IA sicuro in ambito clinico

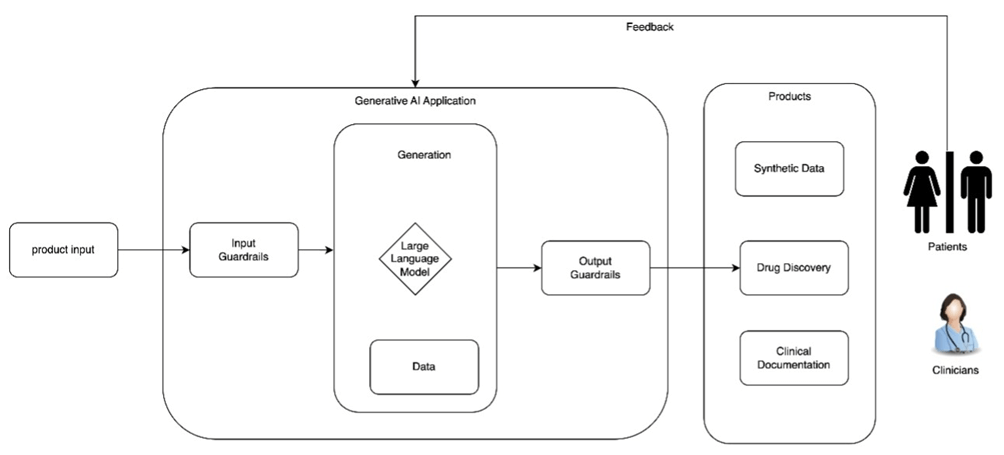

Gli LLM possono trasformare l’assistenza sanitaria riducendo costi e tempi associati a fattori critici quali la qualità e l’affidabilità dei servizi. Come illustrato nel diagramma seguente, le considerazioni relative all’IA responsabile possono essere integrate efficacemente in un’applicazione sanitaria basata su LLM, tenendo conto di qualità, affidabilità, fiducia ed equità per tutti gli utenti. L’obiettivo è promuovere e incentivare specifiche funzionalità responsabili all’interno dei sistemi di IA. Di seguito alcuni esempi:

- L’input e l’output di ciascun componente sono allineati alle priorità cliniche, al fine di preservare l’allineamento complessivo del sistema e favorire la controllabilità

- Vengono implementate misure di sicurezza, quali guardrail e meccanismi di protezione, per migliorare la sicurezza e l’affidabilità del sistema di IA

- Vengono condotte attività di red teaming e valutazioni complete dei sistemi di IA sull’intera pipeline end-to-end, per analizzare input e output con un impatto diretto su sicurezza e privacy

Il diagramma seguente illustra l’architettura concettuale di un’applicazione di IA generativa basata su un LLM. Gli input, forniti direttamente dagli utenti finali, sono inizialmente mediati da guardrail di input. Una volta validato l’input, l’LLM può elaborare la richiesta dell’utente avvalendosi di fonti di dati interne. L’output generato dall’LLM viene quindi nuovamente sottoposto a guardrail di controllo prima di essere condiviso con gli utenti finali.

Governance dell’IA generativa: rischi, bias e politiche sui contenuti

Nello sviluppo di applicazioni di IA generativa in ambito sanitario è essenziale considerare i rischi a diversi livelli, sia a livello di singolo modello o sistema, sia a livello di applicazione o implementazione. I rischi associati all’IA generativa possono differire da quelli tradizionalmente legati all’IA oppure amplificarli. Tra i più rilevanti si annoverano la confabulazione e il bias:

- Confabulazione: il modello genera output apparentemente plausibili ma errati, talvolta definiti “allucinazioni“. Tali risultati possono indurre in errore pazienti o professionisti sanitari.

- Pregiudizio (bias): indica il rischio di accentuare pregiudizi sociali storici tra diversi sottogruppi, spesso derivanti da dati di addestramento non rappresentativi o sbilanciati.

Per mitigare tali rischi, è fondamentale valutare l’adozione di politiche sui contenuti che definiscano in modo chiaro le tipologie di contenuti che le applicazioni devono evitare di generare. Queste politiche dovrebbero inoltre fornire indicazioni su come configurare e affinare i modelli, nonché su quali misure di protezione e controlli implementare. È essenziale che politiche e linee guida siano personalizzate e specifiche per il caso d’uso previsto. Ad esempio, un’applicazione di IA generativa destinata alla documentazione clinica dovrebbe prevedere esplicitamente il divieto di formulare diagnosi o di proporre piani di trattamento personalizzati.

Politiche di governance: ruoli, responsabilità e modellizzazione delle minacce

Inoltre, la definizione di politiche chiare, dettagliate e specifiche per il caso d’uso di riferimento è un elemento fondamentale per una progettazione responsabile. Questo approccio contribuisce a rafforzare la fiducia e consente a sviluppatori e organizzazioni sanitarie di valutare in modo sistematico rischi, benefici, limiti e implicazioni sociali associati all’impiego di ciascun LLM all’interno di una determinata applicazione.

Di seguito sono riportati alcuni esempi di politiche che possono essere prese in considerazione per applicazioni specifiche del settore sanitario. La prima tabella fornisce una sintesi dei ruoli e delle responsabilità nelle diverse configurazioni di collaborazione uomo–IA.

| Azione ID | Azione suggerita | Rischi dell’IA generativa |

|---|---|---|

| GV-3.2-001 | Sono state adottate politiche volte a rafforzare la supervisione dei sistemi di IA generativa attraverso valutazioni indipendenti dei modelli o dei sistemi stessi, in cui la tipologia e il livello di approfondimento delle valutazioni risultano proporzionati ai rischi identificati. | Informazioni o capacità CBRN; pregiudizi dannosi e omogeneizzazione |

| GV-3.2-002 | È opportuno considerare l’adeguamento dei ruoli e delle strutture organizzative nelle diverse fasi del ciclo di vita dei sistemi di IA generativa di grandi dimensioni o ad elevata complessità, tra cui: test e valutazione; convalida e attività di red teaming; moderazione dei contenuti generati dall’IA; sviluppo e progettazione dei sistemi di IA generativa; miglioramento dell’accessibilità di strumenti, interfacce e sistemi; risposta agli incidenti e attività di contenimento. | Configurazione uomo-IA; Sicurezza delle informazioni; Pregiudizi dannosi e omogeneizzazione |

| GV-3.2-003 | È necessario definire politiche di utilizzo accettabile per le interfacce di IA generativa, incluse le modalità e le configurazioni di collaborazione uomo–IA (ad esempio per assistenti IA e processi decisionali), specificando i criteri relativi alle tipologie di richieste alle quali le applicazioni di IA generativa devono rifiutarsi di rispondere. | Configurazione uomo-IA |

| GV-3.2-004 | Occorre stabilire politiche relative ai meccanismi di feedback degli utenti per i sistemi di IA generativa, che includano istruzioni chiare, canali dedicati ed eventuali meccanismi di ricorso. | Configurazione uomo-IA |

| GV-3.2-005 | È infine fondamentale impegnarsi in attività strutturate di modellizzazione delle minacce, al fine di anticipare e mitigare i potenziali rischi derivanti dall’utilizzo dei sistemi di IA generativa. | Informazioni o capacità CBRN; Sicurezza delle informazioni |

La tabella seguente riassume le politiche per la gestione dei rischi nella progettazione dei sistemi di IA.

| Azione ID | Azione suggerita | Rischi dell’IA generativa |

|---|---|---|

| GV-4.1-001 | Stabilire politiche e procedure che disciplinino i processi di miglioramento continuo per la misurazione dei rischi associati all’IA generativa. Affrontare i rischi generali derivanti dalla mancanza di spiegabilità e trasparenza nei sistemi di IA generativa attraverso un’adeguata documentazione e l’adozione di tecniche quali le attribuzioni basate sul gradiente, l’occlusione o la riduzione dei termini, i prompt controfattuali, l’ingegneria dei prompt e l’analisi degli embedding. Valutare e aggiornare con regolarità gli approcci di misurazione del rischio. | Confabulazione |

| GV-4.1-002 | Stabilire politiche, procedure e processi che descrivano in modo dettagliato la misurazione del rischio nel contesto d’uso, avvalendosi di protocolli di misurazione standardizzati e di esercitazioni strutturate di feedback pubblico, quali attività di red teaming dell’IA o valutazioni esterne indipendenti. | Informazioni e capacità CBRN; catena del valore e integrazione dei componenti |

Trasparenza e accountability: artefatti e feedback per sistemi di IA affidabili

Promuovere la trasparenza e la responsabilità lungo l’intero ciclo di vita dei sistemi di IA favorisce la fiducia, facilita le attività di debug e monitoraggio e abilita processi di audit efficaci. Ciò implica una documentazione accurata delle fonti dei dati, delle decisioni di progettazione e delle limitazioni del sistema, attraverso strumenti quali le schede dei modelli, nonché una comunicazione chiara in merito a funzionalità sperimentali o limitazioni operative. L’integrazione di meccanismi di feedback degli utenti supporta ulteriormente il miglioramento continuo e contribuisce a rafforzare la fiducia nelle soluzioni sanitarie basate sull’IA.

Gli sviluppatori di IA e gli ingegneri DevOps dovrebbero garantire trasparenza in merito alle evidenze e alle motivazioni alla base di tutti i risultati prodotti, fornendo una documentazione chiara delle fonti di dati sottostanti e delle scelte progettuali adottate. Questo approccio consente agli utenti finali di prendere decisioni informate sull’utilizzo del sistema.

La trasparenza agevola inoltre l’individuazione di potenziali criticità e facilita la valutazione dei sistemi di IA da parte di team interni ed esterni. Gli artefatti di trasparenza guidano ricercatori e sviluppatori verso un uso responsabile dei modelli, promuovono la fiducia e supportano gli utenti finali nel processo decisionale relativo all’adozione delle soluzioni di IA.

Di seguito sono riportati alcuni suggerimenti per l’implementazione:

- Quando si sviluppano funzionalità di IA basate su modelli o servizi sperimentali, è essenziale segnalare esplicitamente la possibilità di comportamenti imprevisti del modello, affinché gli operatori sanitari possano valutare in modo accurato l’opportunità di utilizzare il sistema di IA.

- Valutare la pubblicazione di artefatti informativi, come schede modello o schede di sistema, che documentino casi d’uso previsti, limitazioni, scelte progettuali e best practice per l’implementazione. A titolo di esempio, servizi come quelli offerti da AWS (es. Amazon SageMaker o le schede di servizio AWS AI) forniscono schede informative generali sui propri sistemi di IA, che possono essere considerate come riferimento per creare documenti ibridi che combinino elementi di schede modello e schede di servizio, soprattutto quando l’applicazione utilizza modelli di base (Foundation Models, FM) pur fornendo un servizio specifico.

- Offrire meccanismi strutturati di feedback agli utenti. La raccolta regolare e pianificata di feedback da parte degli operatori sanitari può supportare gli sviluppatori nell’introduzione di miglioramenti mirati alle prestazioni del sistema. È inoltre opportuno definire politiche che facilitino l’implementazione di tali meccanismi di feedback, includendo istruzioni dettagliate e prevedendo eventuali procedure di ricorso.

Sicurezza by design: proteggere i dati e prevenire gli attacchi nei sistemi sanitari

Nello sviluppo di sistemi di IA è fondamentale adottare le migliori pratiche di sicurezza a ogni livello dell’applicazione. I sistemi di IA generativa possono essere vulnerabili ad attacchi avversari, quali il prompt injection, che sfruttano le debolezze degli LLM attraverso la manipolazione degli input o dei prompt. Tali attacchi possono determinare fughe di dati, accessi non autorizzati o altre violazioni della sicurezza.

Per affrontare queste criticità, è opportuno condurre valutazioni strutturate del rischio e implementare misure di protezione sia a livello di input sia di output dell’applicazione. In linea generale, il modello operativo dovrebbe essere progettato per garantire le seguenti azioni:

- Tutelare la privacy dei pazienti e la sicurezza dei dati mediante il rilevamento delle informazioni di identificazione personale (Personally Identifiable Information, PII) e la configurazione di misure di protezione in grado di prevenire e controllare gli attacchi basati sui prompt

- Valutare in modo continuo i benefici e i rischi associati a tutte le funzionalità e agli strumenti di IA generativa, monitorandone regolarmente le prestazioni tramite sistemi di allerta come ad esempio Amazon CloudWatch

- Valutare accuratamente tutti gli strumenti basati sull’IA in termini di qualità, sicurezza ed equità prima della loro messa in produzione

Risorse e conclusioni: strumenti per sviluppare IA generativa responsabile in sanità

Le seguenti risorse possono risultare utili per progettare e implementare applicazioni di IA generativa:

- Strumenti di guardrail per l’IA generativa: consentono di implementare misure di sicurezza nelle applicazioni di IA in base ai casi d’uso specifici e alle politiche di IA responsabile. È possibile creare più guardrail personalizzati per diversi scenari e applicarli a diversi modelli di base (Foundation Models, FM), garantendo un’esperienza utente coerente e standardizzando i controlli di sicurezza e privacy nelle applicazioni.

- Linee guida sull’IA responsabile: costituiscono una risorsa fondamentale per professionisti sanitari e sviluppatori che progettano applicazioni di IA in contesti critici, come le terapie intensive, dove eventuali errori potrebbero avere conseguenze gravi o letali.

- Schede informative dei servizi di IA: forniscono dettagli sui casi d’uso previsti per ciascun servizio, sul modo in cui viene impiegato il machine learning e sulle considerazioni principali per una progettazione e un utilizzo responsabile delle applicazioni.

L’IA generativa ha il potenziale per migliorare quasi ogni aspetto dell’assistenza sanitaria, incrementando la qualità delle cure, l’esperienza dei pazienti, la sicurezza clinica e quella amministrativa, a condizione che venga implementata in modo responsabile. Durante la progettazione, lo sviluppo e la gestione di un’applicazione di IA, è fondamentale considerare in modo sistematico i limiti potenziali del sistema e definire un quadro di governance e valutazione che garantisca la sicurezza, la privacy e la fiducia richieste dagli utenti.