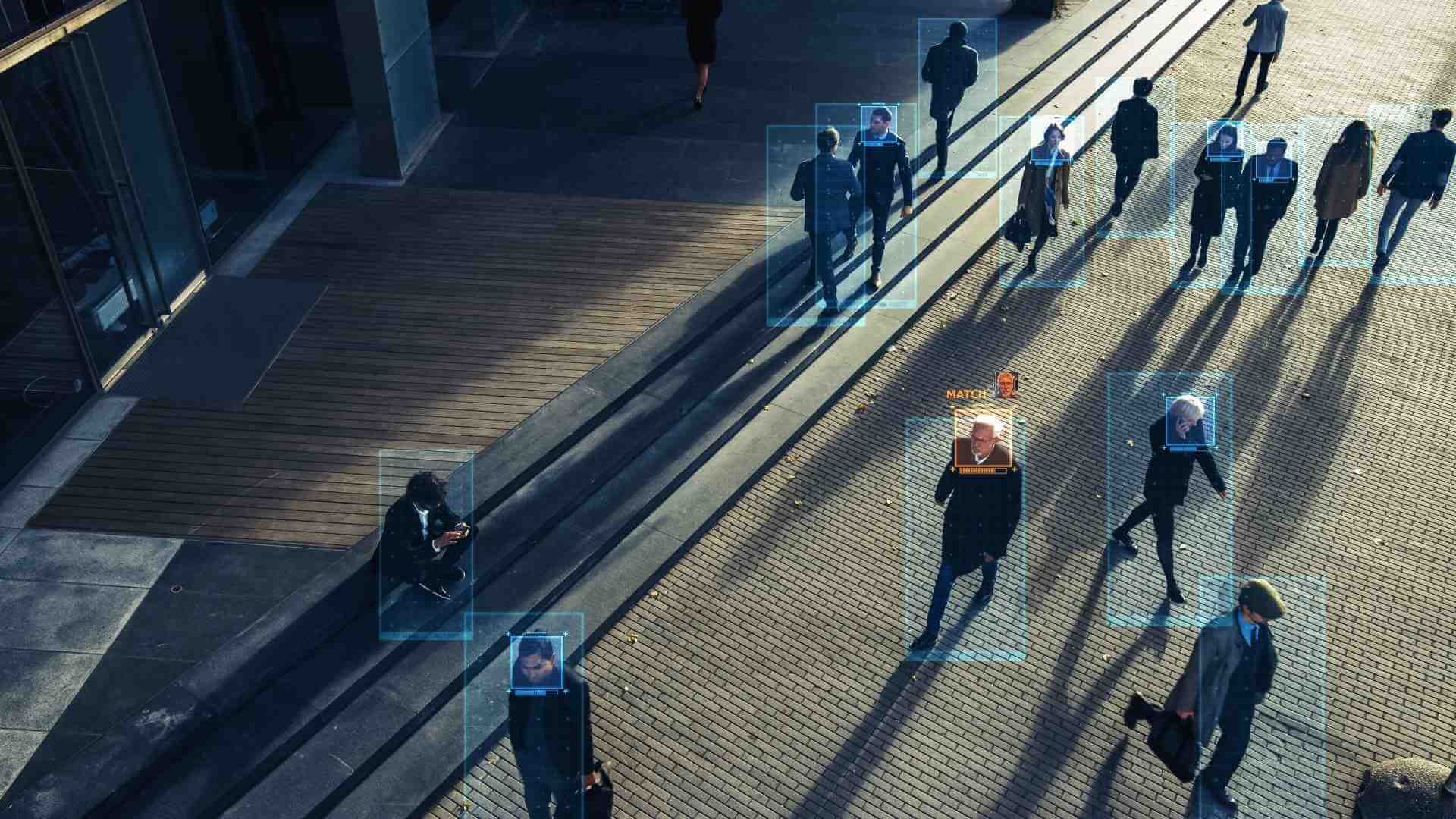

Il dibattito sul riconoscimento facciale torna al centro dell’agenda politica italiana dopo la proroga della moratoria che ne vieta l’uso nei luoghi pubblici fino al 2027. Una decisione che arriva in un momento cruciale per la governance dell’intelligenza artificiale in Europa, e che apre interrogativi profondi sul confine tra sicurezza collettiva e tutela dei diritti fondamentali.

Indice degli argomenti

La moratoria sul riconoscimento facciale: una scelta per i diritti

Quando si parla di progresso tecnologico, infatti, il temutissimo rovescio della medaglia è quello di accettare qualsiasi innovazione in nome di una maggiore efficienza, senza fermarsi a chiedersi quale prezzo pagheranno i diritti fondamentali e sul possibile impatto negativo sulle libertà dei cittadini.

È per questo che l’estensione fino al 31 dicembre 2027 della moratoria sull’uso dei sistemi di riconoscimento facciale nei luoghi pubblici rappresenta una decisione importante che, come Rete Diritti Umani Digitali, abbiamo fortemente sostenuto.

Il decreto Milleproroghe e la proroga fino al 2027

Nelle scorse settimane il Parlamento ha approvato definitivamente la legge di conversione del decreto Milleproroghe, accogliendo un emendamento che proroga la sospensione dell’installazione e dell’utilizzo di sistemi di riconoscimento biometrico negli spazi pubblici o aperti al pubblico.

Senza questo intervento, la moratoria sarebbe scaduta alla fine del 2025, lasciando un vuoto di tutela proprio nel momento in cui queste tecnologie stanno diventando sempre più diffuse e invasive per le nostre vite.

La Rete per i diritti umani digitali: chi ha sostenuto la proroga

È un risultato significativo, raggiunto anche grazie al lavoro della nostra Rete per i Diritti Umani Digitali, una coalizione di organizzazioni della società civile che da anni richiama l’attenzione sull’impatto delle tecnologie emergenti – e in particolare dell’intelligenza artificiale – sui diritti umani. Questa misura consente di mantenere un livello minimo di protezione in una fase normativa ancora incompleta e in evoluzione.

Cosa cambia: le regole per privati e forze dell’ordine

Privacy, libertà di espressione e non discriminazione sono tra i diritti maggiormente esposti ai rischi derivanti dall’uso dei sistemi di riconoscimento facciale, strumenti che, per loro natura, sono estremamente pervasivi e tutt’altro che infallibili. La proroga stabilisce che, fino all’adozione di una disciplina organica della materia, soggetti privati non potranno installare sistemi di videosorveglianza basati sul riconoscimento biometrico nei luoghi accessibili al pubblico.

Al contempo, le autorità competenti per la prevenzione e repressione dei reati potranno utilizzare i sistemi di identificazione biometrica solo previa autorizzazione dell’autorità giudiziaria oppure con il parere favorevole del Garante per la protezione dei dati personali.

Identificazione biometrica in tempo reale: il quadro europeo e la situazione italiana

In Italia la questione riguarda oggi soprattutto l’identificazione biometrica a posteriori, cioè l’analisi di immagini già registrate, mentre il riconoscimento in tempo reale è soggetto a un divieto europeo entrato in vigore lo scorso febbraio, benché con diverse eccezioni che vengono in rilievo al ricorrere di talune indagini di polizia.

Anche queste eccezioni, però, richiedono l’adozione di una specifica legge nazionale che stabilisca procedure di autorizzazione e autorità competenti: legge che l’Italia non ha ancora approvato, con la conseguenza che l’identificazione biometrica in tempo reale in Italia, allo stato attuale, è da considerarsi non utilizzabile in nessun caso.

Trasparenza e segreto di Stato: il problema dell’opacità

Questo significa che non dovrebbero essere operativi sistemi di riconoscimento biometrico in tempo reale neppure da parte delle forze dell’ordine. Ma chi può verificarlo? È estremamente difficile averne veramente contezza: le informazioni sull’utilizzo di queste tecnologie da parte delle autorità sono infatti molto scarse e le richieste di accesso civico presentate dalla Rete per i Diritti Umani Digitali si sono spesso scontrate con il ricorso al segreto di Stato che impedisce qualsiasi tipo di approfondimento e ricerca di trasparenza. Si instaura in questo modo un livello di opacità che rende ancora più urgente una discussione pubblica, informata e trasparente su questi strumenti.

Il GDPR e l’AI Act: perché la moratoria rimane necessaria

Per quanto riguarda l’identificazione biometrica a posteriori, ossia quella interessata dalla moratoria, il quadro europeo non è ancora pienamente operativo e alcune disposizioni dell’AI Act non sono ancora entrate in funzione. È vero che lo stesso GDPR contiene garanzie volte a limitare possibili abusi di potere: in caso di trattamento di dati biometrici, infatti, richiede una valutazione d’impatto sui diritti fondamentali e l’eventuale coinvolgimento di un’autorità competente. Tuttavia, in assenza di una disciplina specifica come quella prevista dalla moratoria, non si sarebbe raggiunto lo stesso livello di tutela.

Errori, discriminazioni e sorveglianza di massa: i rischi concreti

Per queste ragioni l’estensione della moratoria rappresenta un passo nella giusta direzione, ma sarebbe un grande errore considerarlo il punto di arrivo. La posizione della Rete per i Diritti Umani Digitali resta chiara: i sistemi di riconoscimento biometrico, sia in tempo reale sia a posteriori, presentano criticità strutturali in termini di affidabilità, trasparenza e impatto sui diritti fondamentali.

Il caso Tennessee: un’innocente in carcere per un errore biometrico

È di questi giorni la notizia di una donna del Tennessee arrestata e incarcerata per sei mesi, anche se in realtà innocente, a causa di un errore nel riconoscimento biometrico. L’utilizzo di tali tecnologie ha dimostrato di generare errori, discriminazioni e rischia di consentire forme di sorveglianza diffusa incompatibili con una società democratica.

Le eccezioni dell’AI Act e il rischio di sorveglianza estesa

Si ricorda, a tal proposito, che tra le eccezioni previste dall’AI Act per l’utilizzo di identificazione biometrica in tempo reale, che quindi consente la localizzazione della persona e il tracciamento dei movimenti, rientra anche il sospetto di traffico di sostanze stupefacenti e psicotrope. Una formulazione così ampia rischia, di fatto, di legittimare forme di sorveglianza estesa, potenzialmente rivolte a chiunque, basate su un sospetto non necessariamente fondato o verificato.

Governance dell’IA: la battaglia più ampia della Rete

In questo senso, la battaglia per il divieto di tali tecnologie si inserisce in un quadro più ampio di impegno della Rete per i Diritti Umani Digitali sulla governance dell’intelligenza artificiale. Non si tratta solo di fermare strumenti specifici, ma di costruire un sistema di regole e garanzie adeguato: dalla richiesta di istituire un’autorità indipendente, fino alla piena attuazione dei meccanismi di ricorso (redress mechanisms) previsti dall’AI Act, fondamentali per consentire alle persone e alle organizzazioni della società civile di difendere i propri diritti in caso di violazioni dell’AI Act o in caso di decisioni automatizzate ingiuste.

Verso un divieto completo: la posizione della Rete

La Rete per i Diritti Umani continuerà a mobilitarsi affinché l’Italia percorra una strada più netta: quella di un divieto completo dell’utilizzo di queste tecnologie, accompagnato da un quadro di governance trasparente, partecipato e orientato ai diritti fondamentali. Nel frattempo accogliamo con favore la proroga della moratoria fino al 2027, che garantisce un livello minimo di tutela in una fase ancora incerta.

La vera domanda, però, resta aperta: vogliamo davvero vivere in una società in cui ogni volto può diventare un dato da analizzare?