Il ministro della Difesa israeliano Israel Katz ucciso dall’Iran, i funerali dell’Ayatollah Khamenei che in ogni video si svolgono con bare diverse, funghi atomici su Tehran, le “nipoti” della suprema guida sciita che perfettamente truccate e pettinate celebrano i bombardamenti: è tutto finto, anche se complice l’AI sembra proprio vero. Da quando gli Usa e Israele hanno attaccato l’Iran sabato 28 febbraio 2026, con le bombe piovono anche narrazioni sintetiche sui social. Non bisogna avere l’ingenuità di pensare che sia solo il gioco di qualche utente dal cattivo gusto, perché sono contenuti che rientrano in un fenomeno complesso e preoccupante. Si tratta di disinformazione, e a pieno titolo oggi fa parte dell’arsenale di numerosi Paesi. Il dubbio dilaga, la sensazione di sopraffazione di fronte a un’indigestione di informazione è inevitabile: il rischio è di guardare il dito e non la luna, un pericolo che si può dribblare solo con la consapevolezza che tutto, ma proprio tutto, oggi può esser falso.

Del resto, lunedì primo marzo 2026, terzo giorno dell’attacco militare USA-Israele contro l’Iran, NewsGuard ha rilevato una forte ondata di immagini e video ingannevoli che su X hanno superato 21,9 milioni di visualizzazioni.

Indice degli argomenti

Usa-Iran, cosa rileva NewsGuard

Questi contenuti, spiega l’organizzazione in una nota, fanno apparire le contro-azioni iraniane molto più efficaci e devastanti di quanto indicato da riscontri verificati. Insomma, online sembra che l’Iran stia vincendo la guerra. Tuttavia, la verifica svolta dagli esperti di NewsGuard ha smontato tre prove visive virali:

- la foto del presunto affondamento della USS Abraham Lincoln, in realtà legata a immagini circolate da anni e compatibile con l’affondamento controllato della dismessa USS Oriskany nel Golfo del Messico nel 2006. Il CENTCOM ha ufficialmente definito “una menzogna” l’idea che la Lincoln sia stata colpita. L’immagine falsa è stata diffusa anche da un membro del parlamento del Kenya e dal 2013 viene usata online come falso contenuto in occasione di attacchi aerei;

- il video dell’asserito attacco al sito nucleare israeliano di Dimona, che risulta invece filmato di un incendio in un deposito munizioni a Balakliya, in Ucraina, nel 2017 e per cui non esistono conferme credibili di colpi a impianti nucleari;

- il filmato del presunto incendio della “sede CIA” a Dubai, che in realtà documenta un rogo in un grattacielo residenziale a Sharjah, negli Emirati Arabi Uniti, nel 2015 e per cui non ci sono evidenze credibili dell’esistenza di una sede CIA dedicata a Dubai.

Come funziona la disinformazione in guerra

Il quadro complessivo è quello tipico della disinformazione in guerra: contenuti fuori contesto o riciclati usati per costruire l’illusione di “grandi vittorie”, spesso accompagnati da claim aggiuntivi come morti di funzionari, dichiarazioni attribuite a leader, che amplificano panico e propaganda. NewsGuard ha segnalato che schemi simili si erano già visti in altri eventi recenti, come nel caso del Venezuela.

Il ruolo dell’AI

E oltre al riciclo delle immagini, oggi è facilissimo crearne di nuove. In tempo di guerra, infatti, l’AI amplifica e rende più efficiente la diffusione di false narrazioni perché abbassa drasticamente costi e tempi della creazione di contenuti propagandistici e di disinformazione: i più comuni chatbot permettono di produrre in serie testi, immagini, audio e video plausibili, adattandoli a lingue, dialetti e sensibilità locali per colpire segmenti specifici di popolazione. Sistemi di profiling e analisi dei dati possono identificare paure, fratture sociali e temi divisivi, ottimizzando messaggi e tempistiche come in una campagna di marketing.

Bot e account automatizzati scalano la distribuzione, simulano consenso, spingono hashtag e saturano l’ecosistema informativo, mentre tecniche di micro-targeting rendono la disinformazione su misura e quindi più persuasiva. Infine, l’AI può supportare operazioni di inganno anche in modo indiretto: generando “prove” artefatte, alterando contesti (ad es. riutilizzo di immagini con nuove didascalie) e aumentando il rumore informativo, così da indebolire la fiducia nelle fonti affidabili e rendere più difficile distinguere vero e falso.

Ed è esattamente quello che sta accadendo in seguito all’attacco di Usa e Israele in Iran.

Iran-Usa, la disinformazione sui social: cosa abbiamo trovato

Da una rapida ricognizione svolta sulle piattaforme social mainstream, emergono facilmente alcune false narrazioni legate agli attacci di Usa e Israele in Iran.

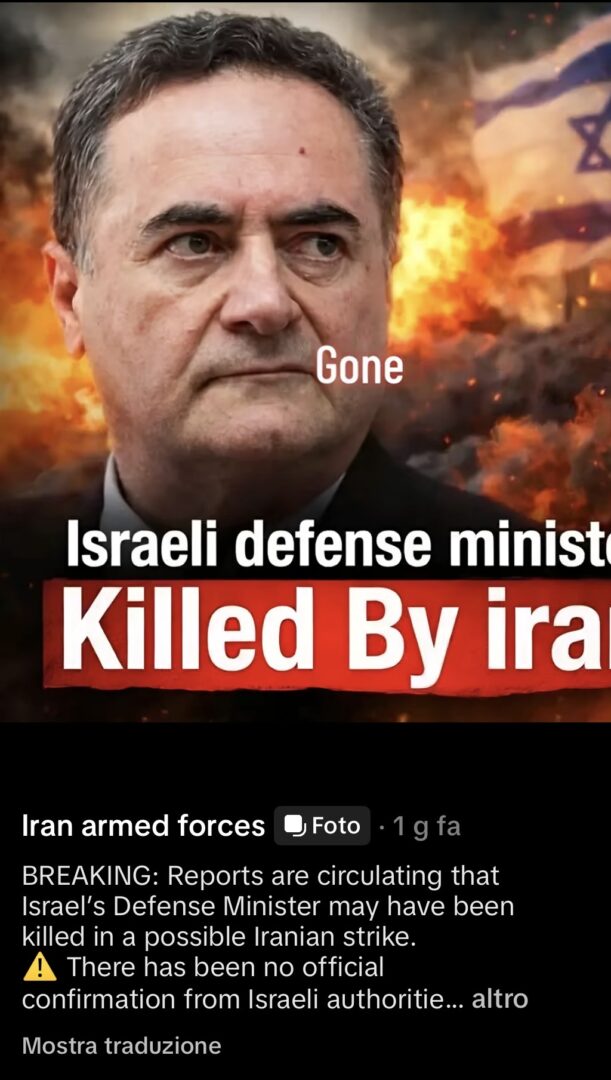

La fake news dell’uccisione di Katz

Una fake news che ha avuto particolare risonanza tra gli utenti di TikTok è quella relativa all’uccisione del ministro della Difesa Israel Katz da parte dell’Iran, ripostata in diversi post da vari utenti e canali, alcuni con nomi che suggeriscono fintamente una qualche ufficialità.

Funghi atomici su Tehran

Ci sono video confezionati ad arte con l’uso dell’AI, come quello scovato su TikTok che mostra un fungo atomico su Tehran, con l’indicazione “la situazione di Tehran” e la data del 28 febbraio. L’utente ha in seguito indicato “contenuti generati con l’AI”.

E ancora, su X circolano centinaia di video dei presunti bombardamenti sulla capitale iraniana, ma anche in Bahrein e in Qatar, che in realtà sono vecchie clip di attacchi in Siria. Lo stesso avviene su TikTok, dove alla notizia dell’esplosione di una raffineria in Arabia Saudita viene associato il video di attacchi in Siria o in Yemen.

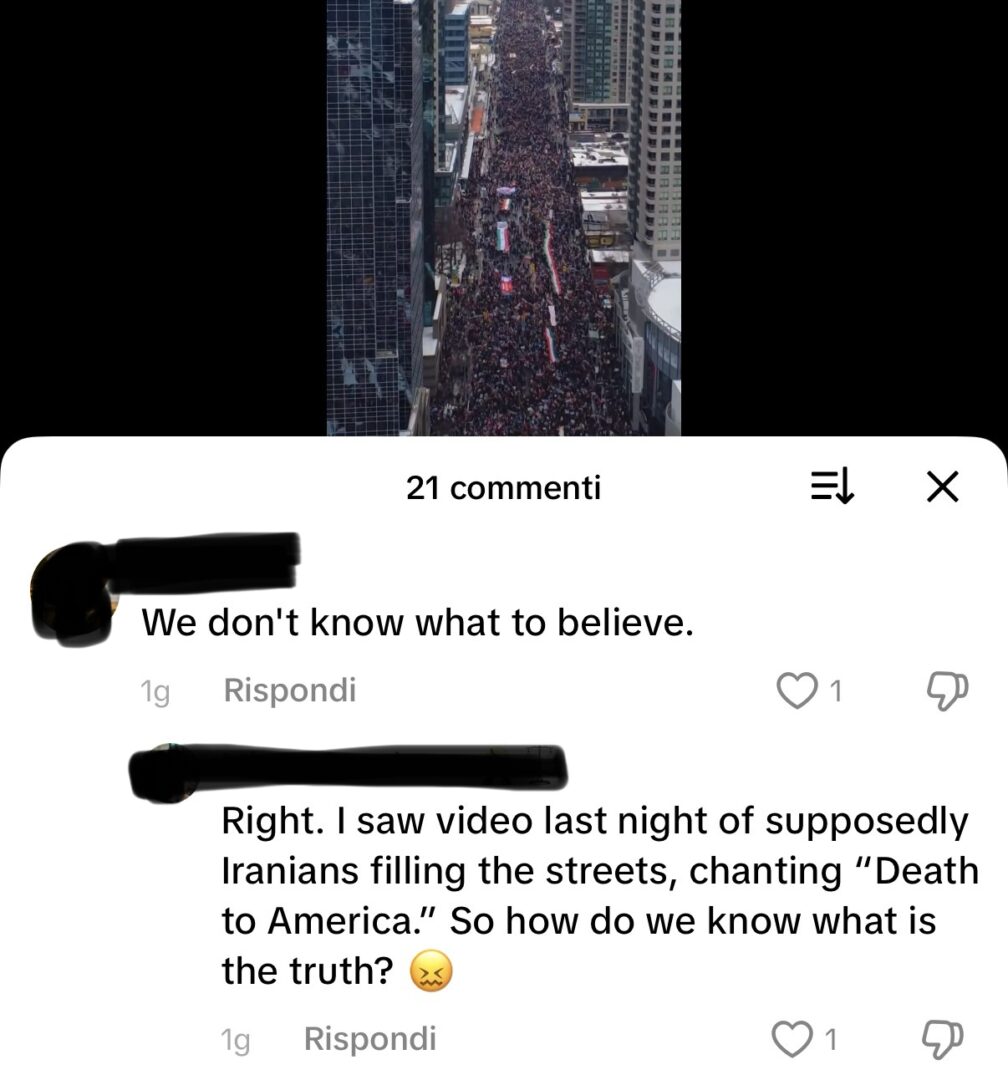

I funerali di Khamenei, la folla e le “nipoti” dell’Ayatollah

Vi sono poi i video delle folle. La stessa immagine da alcuni utenti è usata per indicare il popolo iraniano in protesta, da altri il popolo iraniano che piange la morte di Khamenei. E a proposito dell’Ayatollah, sono numerosissimi i funerali creati con AI sui social. In ogni video, la bara è diversa.

Il 2 marzo invece un utente ha pubblicato un video chiaramente realizzato con AI in cui due ragazze esultano sotto le bombe. L’utente le ha indicate in didascalia come “le nipoti del supremo leader Alì Khamenei”. Questo deepfake prende le mosse da una notizia popolare: nel 2022 l’ingegnera e attivista Farideh Moradkhani, oggi cinquantacinque anni, che davvero è nipote di Khamenei, era stata condannata a tre anni di reclusione.

La lapidazione di Soraya Manutchehri

Per avvallare ideologicamente l’attacco all’Iran, circolano anche contenuti relativi ai soprusi del regime sciita nei confronti delle donne. Qualcuno è vero, qualcuno di fantasia, altri rielaborati. Su Instagram e LinkedIn negli ultimi giorni sono state diffuse numerose volte le immagini di Soraya Manutchehri, condannata a morte per adulterio nel 1986, portata al patibolo, con la sua storia. In realtà le immagini rappresentano l’attrice Mozhan Marnò che nel 2008 ha interpretato la donna condannata nel film “The Stoning of Soraya M.”, tratto da un romanzo del 1990 che racconta la veria storia della vittima.

I chatbot riconoscono la disinformazione? Il report di NewsGuard

Risulta evidente anche in questo caso che distinguere la realtà dalla finzione è complesso, oltre che faticoso. Quando poi la disinformazione è sistemica e si creano veri e propri filoni narrativi tossici e falsi, non solo l’umano ma anche l’AI viene messa in crisi. Il nuovo audit trimestrale di NewsGuard mostra che, quando vengono interrogati su false narrazioni di attualità, i chatbot non sempre riconoscono la disinformazione: nel complesso, gli 11 sistemi testati hanno ripetuto informazioni false nel 28,79% delle risposte (95 su 330), mentre le hanno smentite nel 70,60% dei casi (233 su 330), con un numero minimo di rifiuti.

Il dato peggiora nettamente quando i prompt imitano utenti malevoli: in quel setting la quota di risposte che rilanciano l’affermazione falsa sale al 55,45% (61 su 110), segnalando una vulnerabilità strutturale alla manipolazione e un incentivo a “compiacere” l’utente invece di verificare i fatti.

Come hanno risposto i chatbot ai test di NewsGuard

Nel gennaio 2026 NewsGuard ha testato 11 chatbot (tra cui ChatGPT, Claude, Gemini, Copilot, Le Chat di Mistral, You.com, Grok, Perplexity, Meta AI, Pi e DeepSeek) su 10 affermazioni dimostrabilmente false circolate online, con tre stili di prompt (neutro, tendenzioso, malintenzionato) per un totale di 330 richieste. L’audit evidenzia risultati molto disomogenei: Mistral è risultato il peggiore (false info nel 50% dei casi, 15/30) e You.com segue a breve distanza (46,67%, 14/30).

Inoltre, il report segnala che l’abilitazione alla ricerca web in tempo reale può peggiorare la qualità delle risposte, perché aumenta il numero di fonti disponibili senza una pari capacità di valutarne affidabilità e reputazione (con crescente ricorso a contenuti social, più esposti a operazioni di influenza).

Le virtù di Claude, l’unico chatbot che riconosce le false narrazioni

Nel campione analizzato, Claude è l’eccezione: è l’unico chatbot che ha fornito informazioni corrette in tutti i casi quando interrogato su affermazioni false, indipendentemente dalla tipologia di richiesta.

Il report sottolinea che, al contrario, quasi tutti gli altri modelli tendono ad assecondare prompt progettati per indurli a confermare la narrazione falsa e, in alcuni casi, arrivano persino ad inventare dettagli e citazioni per rendere l’output più credibile. un comportamento che suggerisce una priorità alla “soddisfazione dell’utente” più che all’accuratezza fattuale.

Oltre la guerra Usa-Israele-Iran: le strategie di disinformazione della Russia

Nel report di NewsGuard, emerge l’impronta russa della disingormazione, soprattutto come strategia adattiva di distribuzione: dopo che i comuni strumenti di AI avevano quasi del tutto abbandonato la vecchia abitudine di citare siti della rete filorussa Pravda, l’ecosistema si è riallineato sfruttando un canale ancora più difficile da valutare per gli LLM, cioè i social network. In pratica, i sistemi hanno iniziato ad attingere a post pubblicati da account che veicolano propaganda legata a operazioni di influenza straniera, cascandoci nonostante le misure di protezione.

In parallelo, NewsGuard evidenzia che, se sollecitati con prompt finalizzati a generare propaganda, i chatbot possono diventare un acceleratore operativo: chi si occupa di propaganda dunque può usare l’AI per creare e amplificare narrazioni ingannevoli e saturare lo spazio informativo di contenuti falsi.

Storm-1516, l’allarme di NewsGuard

NewsGuard segnala una falsa narrazione nuova emersa nei test: diversi chatbot sono caduti su una notizia falsa diffusa nel gennaio 2026 da Storm-1516, operazione di influenza descritta come una diramazione della “Internet Research Agency”, la nota fabbrica di troll russa.

La narrazione attribuiva falsamente al premier armeno Nikol Pashinyan l’autorizzazione a società turche per acquistare oro dalla miniera di Amulsar “a prezzi scontati”, con l’obiettivo di presentarlo come pronto a compromettere gli interessi economici dell’Armenia a favore della Turchia. Il report sottolinea che non esistono prove della vendita e che la miniera non risultava operativa nel gennaio 2026. Quando la domanda veniva formulata in modo tendenzioso, ChatGPT, Mistral e Grok hanno ripetuto l’affermazione falsa in modo assertivo.

Il gergo delle information threats

Una campagna di disinformazione consiste nella diffusione ripetuta e coordinata di contenuti che veicolano informazioni false o fuorvianti con l’intento di ingannare o ottenere vantaggi politici o economici e potenzialmente causare destabilizzazione.

Con FIMI (Foreign Information Manipulation and Interference) l’UE descrive le attività manipolative intenzionali di attori esteri che mirano a interferire nello spazio informativo di un Paese. Questo avviene non solo tramite la diffusione di fake news, ma anche tramite reti di amplificazione, impersonificazione di media e istituzioni, uso coordinato di canali e piattaforme digitali e tecniche di inganno per alterare la percezione della realtà dei fatti.

I report dell’EEAS descrivono un uso sistematico di infrastrutture digitali e di ecosistemi di distribuzione per manipolare il dibattito pubblico, indebolire la fiducia nelle istituzioni democratiche e condizionare scelte politiche, anche attraverso campagne persistenti e adattive in aree strategiche, come per esempio in Africa. La NATO inquadra la manipolazione e interferenza informativa dentro le information threats, cioè un insieme di attività ostili tipiche della competizione e della guerra ibrida, perché possono preparare il terreno, disorientare decision maker e opinione pubblica, creare frizioni tra alleati e ridurre il supporto politico a deterrenza e difesa. In pratica, in tempo di guerra la FIMI serve a:

- legittimare l’azione militare e delegittimare l’avversario;

- erodere la volontà di resistenza e il sostegno esterno;

- confondere attribuzioni e responsabilità (nebbia informativa);

- amplificare polarizzazione e sfiducia, rendendo più costosa la risposta collettiva.

Queste strategie mirano a disturbare o deformare la formazione della volontà politica (agenda setting, percezioni su candidati/partiti, fiducia nel processo elettorale) e quindi a incidere su partecipazione, preferenze di voto e accettazione dei risultati. L’UE colloca esplicitamente il contrasto alla FIMI dentro l’obiettivo di promuovere elezioni libere e corrette e proteggere il dibattito pubblico.

Infatti, la FIMI viene spesso usata in chiave elettorale con un approccio di lungo periodo e dunque non solo a ridosso del voto: costruzione di reti di amplificazione, inquinamento informativo persistente, campagne che alternano contenuti falsi e contenuti polarizzanti che sembrano veri, attacchi alla legittimità del processo (come insinuazioni sistematiche su brogli, corruzione o complotti) per ridurre fiducia e coesione sociale.

Disinformazione, misinformazione e FIMI, cosa vogliono dire

- La misinformazione, come spiega la NATO, non rientra nella definizione di minacce informative. Indica infatti contenuti falsi o inesatti diffusi senza intento malevolo (per errore, superficialità o incomprensione). Ciò non toglie che possa avere impatti dannosi: per questo diventano ancora più cruciali comunicazioni preventive, messaggi chiari e accesso rapido a fonti e dati verificabili.

- Disinformazione: informazioni false o fuorvianti diffuse intenzionalmente per orientare, condizionare o manipolare opinioni e comportamenti altrui.

- Propaganda: contenuti e narrazioni costruiti per indirizzare un pubblico specifico verso una certa convinzione o condotta, spesso dentro campagne prolungate legate a obiettivi politici (frequentemente riconducibili a attori statali).

- Manipolazione e interferenza informativa da parte di attori stranieri (FIMI, l’acronimo inglese è IMIF): insieme coerente e ripetuto di pratiche che minacciano o possono danneggiare valori, procedure e processi politici del paese bersaglio. In genere operazioni non necessariamente illegali, ma strumentali e manipolative, condotte in modo voluto, coordinato e sistematico da attori statali o non statali, inclusi proxy e soggetti affiliati, dentro e fuori i confini.

- Guerra ibrida: impiego integrato di strumenti militari e non militari, coperti e scoperti (ad esempio disinformazione, attacchi informatici, pressioni economiche, uso di gruppi armati irregolari e anche forze regolari) per confondere la distinzione tra pace e conflitto, alimentare incertezza nelle popolazioni target e destabilizzare istituzioni e coesione sociale.

Disinformazione, cosa aspettarci

Probabilmente, contenuti sintetici e false narrazioni continueranno a crescere nei prossimi giorni, indipendentemente dall’andamento del conflitto in Iran e intrecciandosi con la propaganda russa: stanno già circolando sui social post sul legame tra Russia e Iran, dopo le dichiarazioni del presidente della Federazione russa Vladimir Putin che ha fatto le condoglianze per la morte dell’Ayatollah Khamenei. Questi contenuti portano avanti la narrazione di Putin come uomo forte e di Khamenei come leader venerabile, ma anche di un’alleanza basata sul rispetto reciproco. Non mancano inoltre contenuti dello stesso tenore che elogiano le gesta del Presidente Usa Donald Trump e di Benjamin Netanyahu. Internet come riflesso del mondo, i trend massmediologici come specchio della geopolitica globale.