Interpretare i modelli di AI significa capire quali segnali dell’input guidano una previsione e, sempre più spesso, come l’informazione viene trasformata dentro reti profonde e LLM.

Con l’esplosione dell’AI generativa e l’avanzare delle normative, la spiegabilità passa da “nice to have” a requisito: tecniche di attribuzione, strumenti di analisi e nuove linee di ricerca puntano a ridurre l’opacità delle black-box.

Indice degli argomenti

Le nuove frontiere dell’interpretabilità dei modelli di AI

Nel contesto del Deep Learning, soprattutto se guardiamo all’ampia diffusione recente dei modelli di AI Generativa, emerge un problema rilevante, riguardante la crescente complessità di questi modelli neurali. E’ una complessità che si accompagna poi allo sviluppo di diverse normative internazionali (AI Act, Executive Order 14179 in USA, ecc.) e anche di linee guida specifiche, come i framework del NIST, che fissano dei principi fondamentali per lo sviluppo e l’utilizzo di questi sistemi.

Dobbiamo quindi affrontare una questione importante, su cui oggi si sta discutendo ampiamente: come comprendere e spiegare il processo decisionale che è alla base delle previsioni di una rete neurale profonda.

Nei modelli su scala molto ampia, come i Large Language Models (LLM), ma anche le moderne Convolutional Neural Networks (CNN), possono esserci miliardi di parametri e varie decine, o anche centinaia, di “Hidden Layer”, che elaborano i dati di input e li trasformano in rappresentazioni sempre più complesse, per giungere infine a delle predizioni finali. Questi modelli hanno ormai raggiunto dei livelli di prestazione eccezionali nei compiti in cui sono impiegati, e in tutti i settori di attività.

Il problema che abbiamo di fronte è che a noi risultano molto spesso opachi, nel loro funzionamento interno e nella loro complessità, come se fossero delle black-box, che producono decisioni, o risultati in genere, di cui è difficile interpretare la logica interna, almeno dal punto di vista delle persone.

Da questa difficoltà di comprensione nasce, negli ultimi anni, la disciplina dell’Explainable Artificial Intelligence (XAI), che mira a sviluppare metodi e strumenti per rendere più interpretabili e verificabili le decisioni dei sistemi di IA, pur con dei limiti e delle approssimazioni, dovute all’attuale livello della ricerca, tuttora in evoluzione.

Si tratta di capire come e perché un modello, ad esempio una rete neurale profonda convoluzionale (CNN) che elabora immagini, o anche un Large Language Model (LLM) come GPT, arrivino ad una certa decisione o ad una certa previsione, e di avere la possibilità di seguirne le logiche. In un’ottica di trasparenza, di analisi critica e di valutazione delle prestazioni. E questo in un periodo storico in cui, insieme all’evidenza delle grandi potenzialità di queste applicazioni di AI, si sta man mano diffondendo la consapevolezza dei loro limiti, in termini di affidabilità dei risultati (pensiamo ai bias e alle allucinazioni) ma anche in termini di rischi sistemici.

Il grido d’allarme lanciato da molti esperti, e addirittura dai “padri” del Deep Learning, come Geoffrey Hinton (premio Nobel 2024 per la fisica) e Yoshua Bengio, hanno messo in guardia anche il grande pubblico, che usa questi strumenti ormai giornalmente, sui rischi e sulle necessità di controllo e di trasparenza.

Il tema della “Trasparenza” si è quindi posto all’attenzione generale, anche in seguito all’entrata in vigore progressiva delle recenti normative internazionali, come l’AI Act dell’Unione Europea. La necessità di rendere trasparenti e verificabili i processi interni di un sistema di AI, specie di quelli ad “alto rischio”, ha portato al centro delle analisi e delle attenzioni le tecniche dell’Explainable AI e gli strumenti che questa disciplina ci fornisce, come le “Tecniche di Attribuzione”.

Le tecniche di attribuzione rappresentano uno dei principali strumenti della XAI, per analizzare e quantificare il grado di importanza delle diverse variabili di input nelle decisioni di un modello. I grafici di attribuzione, che ne costituiscono la rappresentazione visiva, consentono di visualizzare tali informazioni in delle mappe di intensità e colori diversi, che sono utili a rendere percepibile, anche se in modo approssimativo, il risultato dell’elaborazione, con il contributo dato da ciascun input al risultato finale.

E’ una tecnica di rappresentazione facilmente interpretabile: ogni decisione della rete può essere suddivisa in contributi locali associati alle variabili di input. Visualizzare tali relazioni significa, in sostanza, cercare di “aprire la black-box” del modello, gettare lo sguardo sul suo meccanismo interno, rendendolo in parte comprensibile alle persone.

Adottando queste tecniche possiamo cercare di rendere più trasparenti questi modelli, aiutandoci ad interpretarne i risultati, e a trarre degli spunti per progressivi miglioramenti. In questo articolo verranno analizzate le principali metodologie di interpretabilità usate oggi, faremo degli esempi, dando uno sguardo ad alcune loro applicazioni.

L’esigenza di affrontare questa tematica deriva dall’insicurezza che spesso trapela tra gli analisti, e persino tra gli esperti, su rischi elevati, o addirittura incontrollabili, che potrebbero derivare da un difetto di controllo su questi nuovi strumenti della tecnologia. Avere dei metodi per renderli il più possibile trasparenti e controllabili è oggi una esigenza primaria, anche per favorirne l’utilizzo e la diffusione, superando alcuni timori ingiustificati.

Principi generali dell’attribuzione

L’attribuzione ha l’obiettivo di stimare il contributo di ciascuna variabile di input nel determinare l’output finale di un modello. In altre parole, serve a capire “quanto” ogni feature ha influenzato la decisione della rete neurale, in modo da rendere evidenti quali siano le caratteristiche di input ad avere una maggiore peso nelle decisioni del modello.

Le principali famiglie di tecniche di attribuzione, utilizzate per l’analisi dei risultati, sono tre:

- Gradient-based, che analizzano come varia l’output del modello in risposta a piccole variazioni dell’input, come nelle Saliency Maps, le Grad-CAM (tecnica ibrida) e le Integrated Gradients.

- Perturbation-based, che valutano l’effetto sull’output rimuovendo o modificando dei singoli elementi dell’input, come nel metodo LIME.

- Additive game-theoretic, che si basano sulla teoria dei giochi cooperativi per calcolare la “quota parte di responsabilità” di ciascuna feature di input, come nel caso di SHAP.

Ogni approccio presenta sia vantaggi che limiti: i metodi basati su gradienti offrono una maggiore precisione locale, quelli di perturbazione una migliore intuitività, mentre gli approcci additivi garantiscono una maggiore coerenza e solidità nell’impianto teorico.

La scelta del metodo da utilizzare dipende quindi dal tipo di modello, dal dominio applicativo e dal livello di trasparenza richiesto. Un approccio integrato di metodi diversi può servire ad analizzare più a fondo i risultati di un modello, utilizzando diverse tecniche, specialmente nelle applicazioni più critiche, come in sanità, per avere la maggiore confidenza possibile.

Saliency Maps

Le Saliency Maps rappresentano la sensibilità dell’output, della classe risultante, rispetto alle diverse parti dell’input. E’ un primo passo, molto generale, verso la “visualizzazione” del modo di funzionare di una rete neurale. Queste mappe indicano, con variazioni di colore e di intensità cromatica, quali regioni di un’immagine, o quali parole in un testo, hanno avuto il peso maggiore nella decisione finale del modello. In pratica, mostrano quali sono i punti più rilevanti a cui la rete “guarda” quando prende una decisione. L’idea è abbastanza semplice da applicare: calcolare il gradiente (con le derivate parziali) della classe di output rispetto all’input, per capire come piccoli cambiamenti nei pixel (in caso di immagini), o nei token (in generale), influenzano il risultato.

Visualizzando questi valori come una “Mappa di Calore”, si ottiene una immagine che mette in evidenza le zone più importanti ai fini della classificazione.

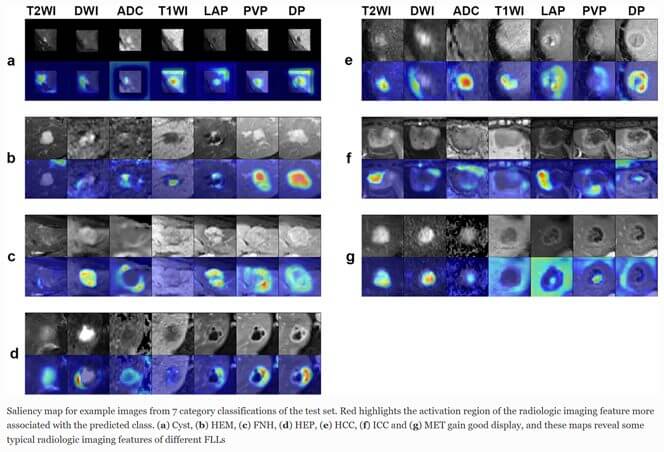

Un esempio molto significativo di questo tipo di mappe è quello che ho ripreso da un articolo relativo ad una ricerca nel settore sanitario, in cui è riportata la categorizzazione di sette diverse tipologie di lesioni. Il colore rosso indica la regione più rilevante ai fini della classificazione scelta dal modello.

Immagine: Esempi di Saliency Maps.

Fonte: “Saliency-based 3D convolutional neural network for categorising common focal liver lesions on multisequence MRI” – Shu-Hui Wang e altri – 2021 – https://insightsimaging.springeropen.com/articles/10.1186/s13244-021-01117-z

Nel campo medico, come mostrato anche nell’esempio precedente, le Saliency Maps vengono usate per localizzare aree sospette in immagini radiologiche o istologiche, aiutando i medici a capire se la rete sta rilevando gli stessi dettagli che un medico umano considererebbe. Naturalmente, nel settore medico i risultati sono rivisti da medici umani per verificare i suggerimenti del modello. Nei sistemi di guida autonoma possono segnalare, in fase di progettazione e di validazione del modello, come l’auto abbia reagito a un pedone, a un segnale stradale, o a un ostacolo imprevisto, in modo da intervenire per migliorare l’inferenza. In NLP, possono venire evidenziate le parole più importanti in una frase, come quelle che sono utilizzate in un modello di Sentiment Analysis, per classificare un testo come “positivo”, “negativo” o neutro.

Tuttavia, queste mappe, per quanto efficaci, hanno anche dei limiti, perché possono essere instabili e “rumorose”: piccole variazioni dell’input cioè, a volte generano risultati completamente diversi.

Per migliorare la coerenza è nato il metodo SmoothGrad, che media i gradienti su molte mappe, ottenute da versioni perturbate dello stesso input. Con questo sistema si ottengono visualizzazioni più pulite e affidabili, riducendo la rumorosità della visualizzazione senza modificare il comportamento del modello. E’ un approccio che consente di ridurre le approssimazioni e le incertezze.

Grad-CAM (Gradient-weighted Class Activation Mapping)

Uno dei metodi più diffusi, nato per la spiegabilità delle reti convoluzionali (CNN), ma poi esteso a qualsiasi architettura che analizza le componenti “spaziali” dell’input, è Grad-CAM. A differenza delle Saliency Maps, Grad-CAM sfrutta le attivazioni dei layer convoluzionali, ed i loro gradienti, per creare una “Mappa di Calore” che viene sovrapposta all’immagine originale, in modo da darne visivamente l’interpretazione.

E’ un metodo che anche se nato per le CNN, a differenza delle Saliency Maps che sono di utilizzo più generale, può essere esteso a quelle architetture in cui è utilizzato il meccanismo delle feature maps tipiche dell’analisi spaziale degli input.

Il risultato è una rappresentazione visivamente molto efficace: zone rosse, gialle o blu, mostrano le caratteristiche più rilevanti che sono state utilizzate dalla rete per la classificazione, ed in cui l’intensità della colorazione è proporzionale al contributo delle diverse zone dell’input all’output della classe predetta.

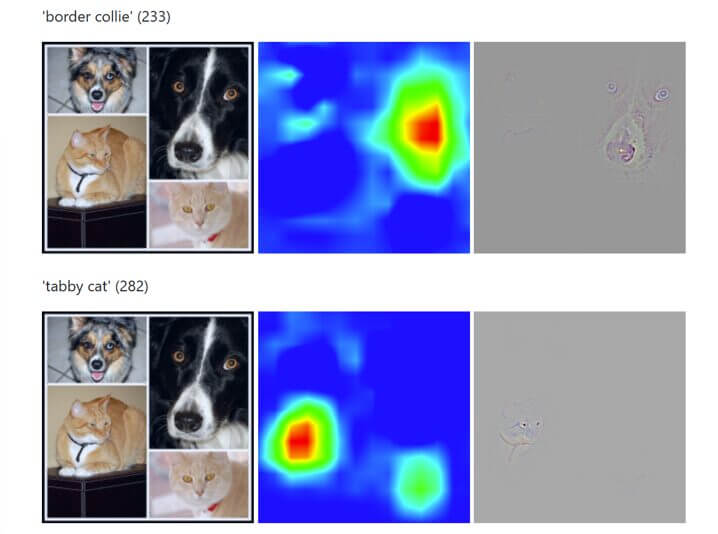

Per esempio, se un modello di classificazione riconosce un cane in una fotografia, Grad-CAM può mostrare che la rete ha concentrato le sue attenzioni sul muso e sulle orecchie, non sullo sfondo (vedi anche esempi successivi).

Sia le Saliency Maps che le Grad-CAM producono delle mappe di calore con la diversa graduazione delle colorazioni, ma mentre le prime si basano sull’analisi delle feature di input che influiscono sul risultato, la seconda lavora all’interno della rete, e cioè sui diversi layer convoluzionali, non sui pixel dell’input. Non evidenzia quindi le zone più rilevanti dell’immagine, ma quali delle loro caratteristiche sono state tra le più rilevanti per contribuire a quel risultato.

Esistono anche delle versioni di Grad-CAM applicate al testo, in architetture specifiche come ad esempio le CNN testuali, ma non nei LLM generalisti come i Transformer. La sovrapposizione della mappa nella Grad-CAM non viene effettuata sull’immagine di input, ma si mettono in evidenza le parole più rilevanti del testo con una colorazione diversa.

Sono poi state sviluppate delle varianti più sofisticate di Grad-CAM: Grad-CAM++ (2018), capace di localizzare oggetti multipli o parzialmente sovrapposti; Score-CAM, che non usa i gradienti, per ottenere maggiore stabilità; e anche XGrad-CAM, pensato per mantenere coerenza nelle reti molto profonde.

Immagine: Esempi di visualizzazione con Grad-CAM su immagini di classificazione

Fonte: “Grad-CAM: Visual Explanations from Deep Networks via Gradient-based Localization” – Ramprasaath R. Selvaraju e altri – 2016 https://arxiv.org/abs/1610.02391

Ho qui riportato un esempio di classificazione con delle mappe di calore Grad-CAM, ripreso dal paper originale di Selvaraju. Nell’esempio,la mappa di attivazione sovrapposta all’immagine originale, mostra le regioni in cui la rete convoluzionale ha concentrato la sua analisi, ai fini della classificazione. Nella classe “border collie” (in alto) la mappa di attivazione evidenzia la regione del muso del cane, mentre per la classe “tabby cat” (in basso) si concentra sulle aree corrispondenti al corpo del gatto. In rosso e giallo sono indicate le regioni con maggiore contributo alla decisione del modello, mentre quelle riportate in blu rappresentano aree meno rilevanti per la classificazione.

In ambito sanitario, le mappe Grad-CAM aiutano a verificare se un sistema di diagnostica sta basando la sua decisione su delle lesioni reali, piuttosto che su difetti dell’immagine, o anche se la rete sta concentrando l’attenzione sulla zona specifica affetta da patologia (tumori, lesioni epatiche o polmonari, o di altro tipo) e non su dettagli irrilevanti ai fini della diagnosi.

Nel settore automotive, sono fondamentali in fase di validazione del modello, per verificare la sicurezza dei modelli di visione artificiale nei veicoli a guida autonoma. E’ importante poi controllare se la rete ha valutato in modo appropriato gli elementi più rilevanti da monitorare, come i pedoni o gli altri veicoli, e non, ad esempio, gli oggetti del contorno paesaggistico.

In Cybersecurity questa tecnica può essere utile a monitorare il rendimento dei sistemi di “Malware Detection” e la loro correttezza nel classificare gli eventi, o negli “Intrusion Detection Systems” per discriminare eventuali pacchetti anomali.

Integrated Gradients

La tecnica dell’ Integrated Gradients (IG) introduce una visione più analitica nella spiegazione delle predizioni. Invece di limitarsi a un singolo punto, Integrated Gradients analizza un intero percorso lineare, tra un input neutro (“baseline”), ad esempio un’immagine completamente nera o una frase vuota, e l’input reale. Integrando i gradienti lungo questa linea retta si ottiene una misura dell’influenza di ogni feature sul risultato finale.

Il risultato di questa analisi è una matrice che indica il grado di importanza delle diverse feature di input, lungo il percorso concettuale che ha portato dall’assenza di informazione (costituita dalla baseline) fino alla predizione finale. Questa matrice può essere visualizzata come una mappa di calore, ma ha una diversa formulazione alla sua base: è basata su dei dati analitici, e non sulla rappresentazione visuale. I valori dell’Integrated Gradients sono visualizzati per ogni coppia input/output: viene mostrato quanto la variazione lineare del gradiente, calcolata lungo il percorso dal baseline all’input reale, contribuisce alla generazione dell’output. Le aree rosse, al solito le più rilevanti, indicano i contributi positivi, quelle blu indicano invece i contributi negativi. In sintesi, si tratta di un metodo analitico che produce una mappa di calore numerica della rilevanza tra input e output, fondata sull’integrazione analitica del gradiente, e non su aspetti superficiali dell’immagine, o anche del testo.

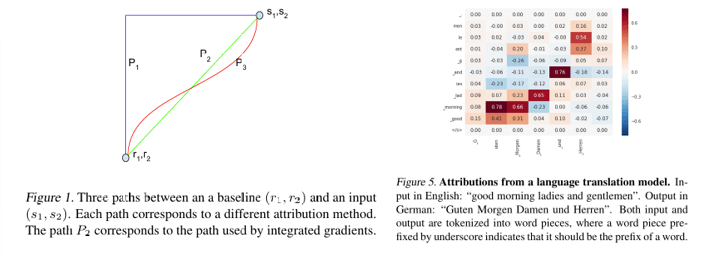

Ho ripreso anche qui un esempio dal paper originale di introduzione del modello, che mostra il percorso teorico su cui si basa il metodo: nella figura di sinistra è riportato uno dei percorsi di integrazione, in verde, che collega la baseline all’input reale P₂. L’integrazione lungo questa traiettoria genera, come risultato finale, una matrice di valori che quantifica l’importanza relativa delle singole feature. A destra c’è poi un esempio di matrice numerica relativa all’analisi di un testo, con le diverse colorazioni.

Integrated Gradients ha due vantaggi sostanziali rispetto ad altri metodi: soddisfa rigorosi principi teorici di sensibilità e completezza, e produce risultati più stabili rispetto alle semplici Saliency Maps, ad esempio. È inoltre estremamente versatile, applicabile sia a immagini che a testi.

Nella medicina di precisione, Integrated Gradients viene usato per spiegare le decisioni di reti neurali che analizzano sequenze di DNA o immagini istologiche, indicando quali regioni del genoma, o del tessuto, hanno guidato la diagnosi della rete. Nel linguaggio naturale, evidenzia le parole più influenti in una recensione positiva o negativa (Sentiment Analysis), mentre in ambito finanziario serve a comprendere quali variabili (tassi di variazione, volatilità, credito) abbiano inciso di più sulla previsione di rischio.

L’algoritmo dell’Integrated Gradients è oggi integrato in molte delle librerie Open Source più utilizzate, come la PyTorch e TensorFlow, rendendolo così uno standard di fatto, per l’analisi della trasparenza dei modelli complessi.

Nell’esempio ripreso dal paper originale di Sundararajan la figura con il grafico illustra che il metodo dell’Integrated Gradients non segue la traiettoria non-lineare dell’input del modello (curva rossa), ma adotta un percorso lineare calcolato (retta verde), che serve a definire l’attribuzione delle feature, integrando il gradiente lungo il percorso dalla baseline all’input. La colorazione (Mappa di Calore) sulla matricevisualizza invece i valori calcolati di Integrated Gradients: ogni cella indica quanto una parola in input ha contribuito alla generazione della parola in output. Le zone rosse mostrano contributi positivi, quelle blu contributi negativi, come detto, mentre i valori vicini allo zero corrispondono a parole irrilevanti.

Immagini: Esempi di applicazione dell’Integrated Gradients.

Fonte: “Axiomatic Attribution for Deep Networks” – Sundararajan e altri – 2017 – https://arxiv.org/pdf/1703.01365#page=2

La tecnica di Integrated Gradients applicata ai testi evidenzia, parola per parola, l’influenza di ciascun token sul risultato finale: le parole più rilevanti vengono mostrate con colori più intensi, rendendo così visibile il percorso che collega l’input testuale alla predizione (vedi l’esempio tratto da “Neuronpedia”, citato in seguito).

LIME (Local Interpretable Model-agnostic Explanations)

Mentre i metodi precedenti sono rivolti al funzionamento della rete neurale, LIME (Local Interpretable Model-Agnostic Explanations) adotta una prospettiva diversa: non analizza i pesi interni ai diversi layer del modello, ma osserva il suo comportamento dall’esterno, come se si trattasse di un “esperimento”. E’ un metodo di tipo “empirico”, in un certo senso, basato cioè sull’osservazione del modello, ma senza entrarci dentro.

LIME genera in automatico diverse “versioni perturbate” dell’input, generate casualmente, ma in modo organizzato (ad esempio delle immagini con porzioni oscurate, o dei testi con delle parole “mascherate”). Osserva quindi come cambia l’output del modello in base alle diverse variazioni dell’input, e ai diversi dati che raccoglie, e costruisce un modello che approssima la rete in quella specifica regione. I coefficienti di questo modello locale indicano poi quali sono le feature che hanno influenzato maggiormente la predizione.

È un metodo di tipo universale, applicabile quindi a diverse architetture di rete neurale: CNN, RNN, Transformer o anche ai modelli di tipo “Ensemble”, una combinazione di più modelli diversi per migliorare le previsioni e ridurne la variabilità.

Per questo motivo è molto utilizzato come supporto agli audit previsti dalle regolamentazioni. Possono, ad esempio, essere usati per giustificare una decisione automatica in un credito bancario, o anche per individuare bias, di genere o di etnia, in un modello di NLP. Il limite principale di questa tecnica è la sensibilità alla “vicinanza locale”: spiegazioni troppo semplificate possono risultare imprecise se l’area analizzata non rappresenta bene il comportamento complessivo del modello. E’ possibile considerare questo limite, in un certo senso, una forma di “bias localizzato”. Inoltre, può produrre risultati diversi ripetendo l’esperimento più volte.

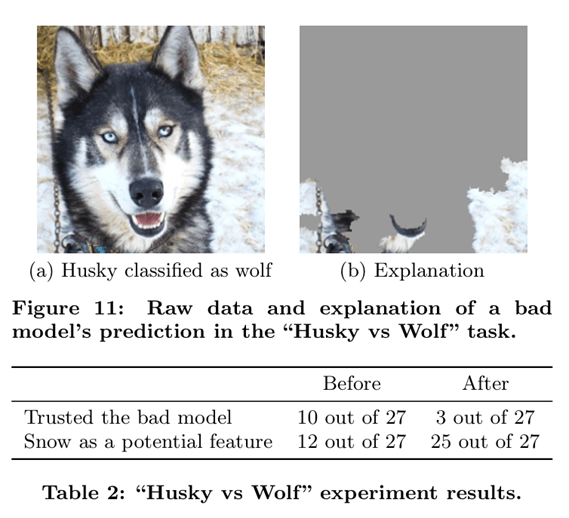

Ho riportato anche qui un esempio molto noto, ripreso dal paper originale di Ribeiro: la classificazione di un animale, se si tratti cioè di un husky o di un lupo. L’immagine mostra come il modello abbia classificato erroneamente un “husky” come “wolf”, basandosi sulla presenza della neve nello sfondo invece che sulle caratteristiche dell’animale. LIME evidenzia nell’immagine a destra quali sono state le regioni (in chiaro) che hanno influenzato maggiormente la predizione (la neve).

Immagine: Esempio del caso “Husky vs Wolf”.

Fonte: “Why Should I Trust You? Explaining the Predictions of Any Classifier” – Ribeiro M. T., Singh S., Guestrin C. – 2016 – https://arxiv.org/pdf/1602.04938

Si vede chiaramente, in tal modo, il bias locale appreso dal modello, e cioè la neve piuttosto che le caratteristiche del cane.

I valori nella tabella, insieme all’esempio, non vengono dal modello, ma sono il risultato di un’indagine statistica: indicano quante persone si fidavano della predizione, e se riconoscevano la neve come feature rilevante, sia prima che dopo aver visionato la spiegazione del LIME. Un risultato evidentemente influenzato da un aumento di scetticismo verso l’affidabilità della tecnica, non del tutto giustificato però, poiché erano forse le aspettative iniziali ad essere più ambiziose rispetto ai risultati ottenibili.

SHAP (SHapley Additive exPlanations)

Infine, per completare la panoramica delle tecniche più importanti, vediamo lo SHAP (SHapley Additive exPlanations), che introduce un approccio di tipo scientifico, ispirato alla “teoria dei giochi cooperativi”: ogni feature può essere vista come un “giocatore” che contribuisce al risultato complessivo, che viene calcolato sulla media di tutte le possibili configurazioni delle feature. Nella teoria dei giochi, infatti, ogni “giocatore” è un partecipante che contribuisce a un risultato collettivo: allo stesso modo, in SHAP ogni feature è trattata come un elemento che partecipa alla formazione della predizione complessiva.

Il metodo calcola per ciascuna feature il suo valore di Shapley, cioè la media teorica del “contributo marginale” che ogni feature aggiunge, in tutte le possibili permutazioni delle diverse feature.

In questo modo, SHAP offre delle spiegazioni ottenute da tutti i contributi, coerenti e imparziali, sia a livello locale (per una singola predizione) sia globale (per l’intero modello).

È un metodo in cui tutte le feature vengono trattate allo stesso modo, e la somma dei contributi ricostruisce esattamente la previsione finale a cui il modello infine giunge. I contributi del calcolo possono essere sia positivi, nella direzione del risultato, che negativi, allontanando dal risultato finale della classificazione, arrivando così ad una analisi sul contributo delle diverse feature. Tuttavia, il calcolo esatto dei valori di Shapley ha un costo computazionale molto elevato (Ordine di 2ⁿ o di n!), per cui in pratica si utilizzano delle versioni approssimate del modello, come KernelSHAP, o algoritmi ottimizzati come TreeSHAP.

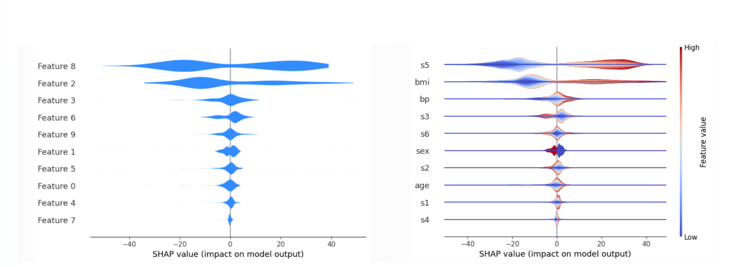

Anche per questa tecnica ho riportato un esempio, tratto dalla documentazione ufficiale di SHAP: il caso di “SHAP Summary Plot (“violin plot”),in cui ogni linea rappresenta una delle feature del dataset, ordinata in modo decrescente dall’alto, secondo l’importanza. La larghezza della forma indica la distribuzione dei valori SHAP, che danno l’evidenza dell’impatto di ciascuna variabile sull’output complessivo del modello. Valori positivi o negativi mostrano nel grafico la diversa influenza, favorevole o contraria alla classe che è stata predetta.

A differenza di LIME, che si basa su delle approssimazioni locali, SHAP ha una base teorica molto solida e coerente, fondata sulla teoria dei giochi. Questo fa assumere a questa tecnica una caratteristica di maggiore “fondatezza”. SHAP ha poi diverse varianti:

- TreeSHAP, ottimizzato per modelli ad albero come XGBoost e Random Forest;

- DeepSHAP, pensato per reti neurali profonde feed-forward e per le CNN;

- KernelSHAP, general-purpose per qualunque modello predittivo.

In finanza, SHAP è ormai uno strumento quasi standard per spiegare i modelli di rischio adottati per la concessione del credito o per l’analisi di possibili frodi.

In sanità, aiuta a comprendere i fattori che determinano le probabilità di sopravvivenza di un paziente a rischio per certe gravi patologie, o anche per analizzare le risposte all’utilizzo di un nuovo farmaco.

Nella cybersecurity rivela quali pattern di traffico portano a classificare un evento come comportamento “normale”, oppure se si tratta di un possibile caso di “attacco”, dando quindi indicazioni su eventuali debolezze su cui occorre intervenire con specifiche contromisure.

Le visualizzazioni SHAP, come i summary plot e i force plot, sono oggi tra le tecniche più intuitive: le feature che aumentano la probabilità di una classe vengono mostrate in rosso, quelle che la riducono in blu. Una classica e facilmente comprensibile classificazione.

Nel Natural Language Processing (NLP), questo si traduce in visualizzazioni di testi colorati, parola per parola, dove il lettore può osservare come il modello interpreta il linguaggio ai fini della classificazione. In questi casi SHAP consente di visualizzare l’impatto di ciascuna parola sulla classificazione del testo: ogni token viene colorato in rosso o blu a seconda del contributo, positivo o negativo, dato alla predizione. Questo permette di osservare graficamente quali token della frase hanno influenzato maggiormente la decisione finale del modello

Immagine: Esempio del “SHAP Summary Plot (violin plot)” dalla documentazione di SHAP.

Fonte: https://shap.readthedocs.io/en/latest/example_notebooks/api_examples/plots/violin.html

.

Grafici di attribuzione nei modelli di linguaggio e Transformer

Nei modelli di linguaggio basati sulle architetture Transformer, come BERT, GPT o T5, l’attribuzione assume una dimensione che si basa sulle relazioni, e sulle reciproche dipendenze tra i diversi token: ogni feature di input può essere messa in relazione con le altre del contesto, sfruttando proprio il meccanismo della “Self-Attention” che è la caratteristica di queste architetture.

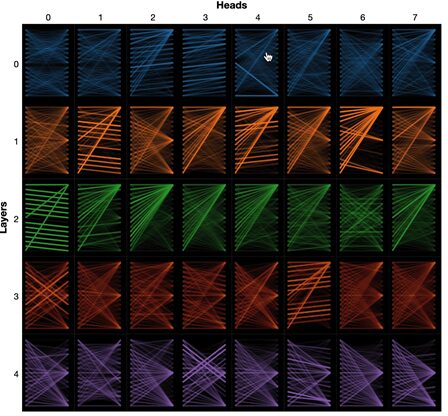

Le visualizzazioni dell’Attention mostrano graficamente come agiscono questi legami: l’intensità o la direzione delle linee indica l’intensità della relazione di Attention tra due diversi token. Tra le principali tecniche che vengono utilizzate per i Transformer ci sono la “Visualizzazione dell’Attention”, che può evidenziare i collegamenti semantici tra i token, e la “Layer-wise Attribution”, che analizza il contributo dei diversi layer, e delle varie “Head” di Attention, costituenti l’architettura degli Encoder e dei Decoder, nella decisione finale del modello.

Immagine: pattern di Attention. Ogni riquadro mostra come le diverse head dei vari layer collegano i token, visualizzano in tal modo le relazioni interne apprese dal modello.

Fonte: J.Vig su GitHub – https://github.com/jessevig/bertviz/blob/master/images/model-view-noscroll.gif

I pattern di Attention mostrano dove il modello ha concentrato l’attenzione, ma non garantiscono che quello sia esattamente il motivo della predizione. Questo perché con decine di layer e di head, la visualizzazione dell’Attention è spesso unicamente informativa, e non effettivamente comprensibile a livello umano. Piccole variazioni nel testo possono produrre risultati di Attention diversi, soprattutto se si fa riferimento ai layer più profondi, con un elevato livello di astrazione. Negli LLM, come GPT o Gemini, i pattern di Attention mostrano correlazioni tra token, ma non rappresentano delle spiegazioni fedeli, non mostrano l’esatta causalità: modificare il token più “attenzionato” spesso non cambia l’output.

Riporto un esempio di visualizzazione di una Head, all’interno dei vari layer del modello BERT. Le linee collegano le varie coppie di token, in base all’intensità dei valori di Attention: i colori indicano le diverse Head di Attention all’interno del layer selezionato. L’animazione (spero sia eseguibile, altrimenti si vada direttamente alla fonte riportata) mostra come il modello costruisca relazioni semantiche sempre più astratte quando si passa ai livelli più profondi, man mano che il modello completa, nei vari passaggi dell’architettura, la definizione del significato delle feature, dal livello più grossolano a quello più astratto.

Altri approcci anche qui possibili, come Integrated Gradients e SHAP, vengono applicati a livello di token, e misurano in modo quantitativo il contributo di ciascun token alla predizione del modello.

Gli strumenti più diffusi sono:

- BERTViz, che consente di esplorare visivamente le connessioni tra token nei vari layer.

- Captum, che integra IG e DeepLIFT per l’analisi di modelli NLP in PyTorch.

- TransformerLens (Neel Nanda, 2024), utilizzato per studi di mechanistic interpretability sui Large Language Models.

Queste tecniche trovano applicazione nell’analisi dei bias linguistici, per verificare se il modello associa connotazioni negative a specifici gruppi sociali o a certi termini; nella verifica della coerenza logica, per comprendere quali token determinano errori o omissioni nell’output; e nella sicurezza e nell’auditing dei modelli di linguaggio, dove vengono utilizzate per monitorare e documentare comportamenti emergenti dei sistemi di AI, in linea con i principi di trasparenza e responsabilità previsti dalle normative europee.

L’interpretabilità dei modelli di linguaggio rappresenta oggi una componente essenziale per garantire la trasparenza e la conformità etica nei sistemi basati sulle architetture Transformer. Queste sono le architetture di riferimento per i grandi modelli LLM che stiamo utilizzando nella vita di tutti i giorni e nelle attività di studio e lavorative, quindi avere una visibilità, per quanto approssimata, del loro funzionamento, diventa una caratteristica sempre più sentita.

Queste tecniche riguardano l’attribuzione esterna e la visualizzazione dei pattern nei Transformer. In un paragrafo successivo è invece discussa l’analisi interna dei meccanismi.

Rappresentazioni grafiche e strumenti di analisi visiva

La rappresentazione grafica è fondamentale per fornire, a livello visivo, i risultati dell’applicazione di questi metodi.

Abbiamo già visto esempi specifici nei paragrafi precedenti, ma riprendiamo qui alcune immagini come riepilogo, riprese dalla community di Matlab riportata nelle fonti.

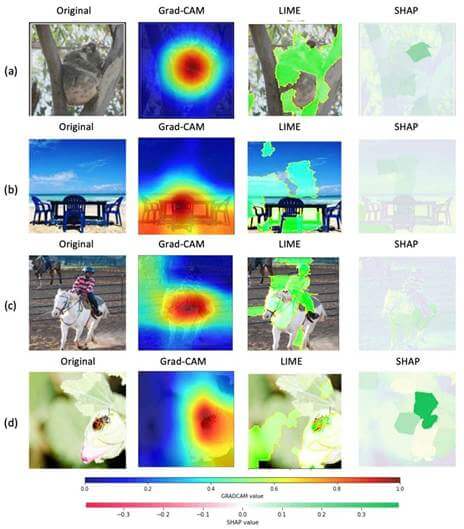

Immagine: in un post di S.Paraskevopoulou del maggio 2023: https://blogs.mathworks.com/deep-learning/2023/05/08/explainable-ai-xai-are-we-there-yet/

Fonte: https://blogs.mathworks.com/deep-learning/2023/05/08/explainable-ai-xai-are-we-there-yet/

Le immagini riportate rappresentano l’applicazione di tre tra i metodi più utilizzati in Explainable AI agli stessi input. I metodi sono Grad-CAM, LIME e SHAP descritti in precedenza, e applicati a quattro diverse immagini relative a un’architettura CNN, un tipo di architettura molto utilizzata per l’analisi e la classificazione delle immagini. Nell’esempio riportato dal post di Matlab i colori indicano, al solito, il livello di importanza delle diverse aree, così come vengono considerate dai tre metodi, dal Rosso (importanza elevata) al Blu, al Verde e fino al Grigio, per aree considerate irrilevanti nella classificazione.

Ad esempio, nella prima immagine del Koala, il Grad-CAM assegna una maggiore rilevanza al corpo, mentre il LIME alle diverse porzioni del corpo, e SHAP alla parte centrale. Lo stesso vale per le altre tre immagini. Queste differenze derivano dal diverso principio di attribuzione: Grad-CAM si basa sulle attivazioni dei layer convoluzionali, LIME su segmentazioni locali dell’immagine e SHAP su contributi di tipo probabilistico.

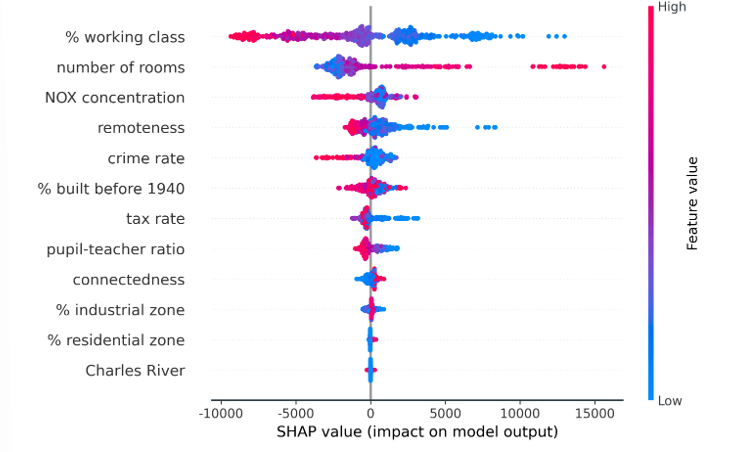

Vediamo anche un altro grafico, che dà una evidenza dell’importanza delle diverse features mettendole a confronto. Il grafico rappresenta uno SHAP “summary plot” che mostra, in ordine di importanza decrescente, i diversi fattori che influenzano il rischio di credito dei clienti di un istituto bancario. L’intensità ed il colore rappresentano i diversi aspetti delle feature di input con le relative intensità per la loro importanza nella predizione del modello. Altri esempi di SHAP sono nel relativo paragrafo, visto in precedenza.

Fonte https://www.aidancooper.co.uk/a-non-technical-guide-to-interpreting-shap-analyses/

Questi esempi mostrano che nessun metodo, da solo, è sufficiente a fornire una spiegabilità completa del funzionamento di una rete, ma che i diversi metodi vanno utilizzati in maniera integrata, perché ognuno di essi si focalizza su aspetti diversi. Per avere un quadro di insieme occorre quindi valutare i diversi approcci, evidenziati dai diversi metodi.

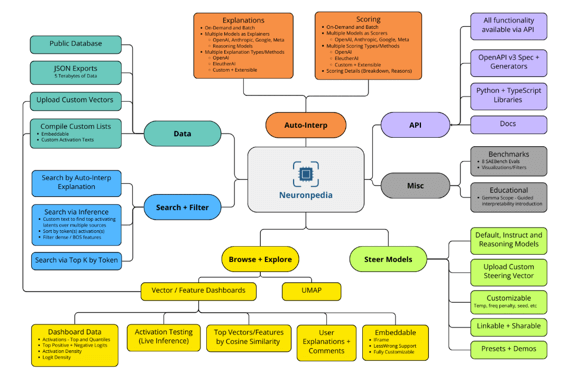

Oltre agli esempi descritti, sono oggi disponibili anche degli strumenti interattivi per analizzare il comportamento interno dei modelli. Uno dei più recenti ausili, che è possibile utilizzare in rete è “Neuronpedia”, una piattaforma Open Source sviluppata da Arthur Conmy e da altri, con l’obiettivo di rendere trasparente e interpretabile la struttura ed il funzionamento di diversi modelli neurali. Fornisce un grande Database pubblico di dati, accessibile anche tramite delle API, e viene molto utilizzata nella ricerca.

E’ possibile selezionare un modello tra quelli indicati, come ad esempio GPT, LLAMA, Pythia e altri, e scegliere diversi aspetti, relativamente ad uno specifico Layer della rete, o addirittura ad un singolo neurone, per avere una vista sull’importanza relativa dei diversi token di un contesto.

Immagine: schema dei moduli della piattaforma di interpretabilità Neuronpedia, con funzioni di analisi, ricerca e visualizzazione delle attivazioni nei modelli neurali. Mostra l’interazione tra i diversi componenti per la spiegazione automatica, la tracciabilità dei processi interni e la personalizzazione delle analisi tramite API e dashboard interattive.

Fonte: Neuronpedia – https://www.neuronpedia.org/

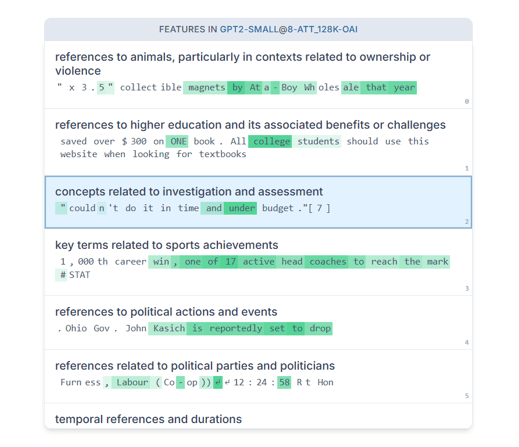

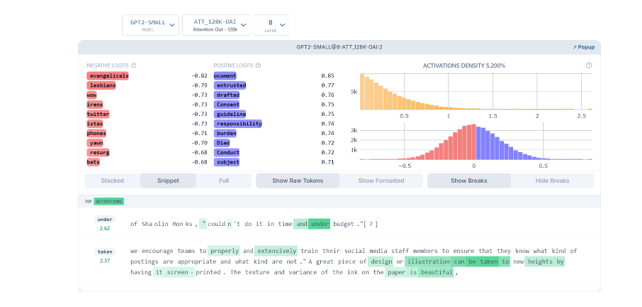

A titolo di esempio, tra le molteplici applicazioni della piattaforma, ho selezionato come esempio quello che riguarda il modello GPT2, ed un suo livello specifico, il Layer 8, in cui sono evidenziati i singoli token di una frase (selezionata tra le diverse analizzabili dell’input). Si possono effettuare vari tipi di analisi, osservando la rilevanza dei diversi token e le relazioni tra essi.

Fonte: Neuronpedia – https://www.neuronpedia.org/

Queste rappresentazioni non solo facilitano la comprensione dei modelli, ma contribuiscono anche alla loro validazione dal punto di vista etico, contribuendo alla verifica della loro aderenza alle diverse normative vigenti. Si mettono così a disposizione dei ricercatori dei supporti concreti per verificare l’aderenza di questi modelli ai principi di trasparenza, di controllo e di affidabilità dei sistemi di intelligenza artificiale.

Fonte: Neuronpedia – https://www.neuronpedia.org/

Le nuove frontiere dell’interpretabilità

Dopo aver analizzato le principali tecniche di attribuzione, e accennato anche rapidamente ad alcuni esempi applicativi, è importante dare uno sguardo ai più recenti sviluppi nella ricerca, che sono orientati a rendere trasparenti anche i modelli linguistici su grande scala, che rappresentano oggi una delle maggiori sfide, proprio a causa della loro complessità, alla spiegabilità delle reti neurali.

Le tecniche di attribuzione che abbiamo esaminato in questo articolo (come Grad-CAM, Integrated Gradients, LIME o SHAP) hanno costituito un importante progresso verso la comprensione dei modelli di Deep Learning, consentendo di visualizzare quali elementi dell’input influenzano maggiormente le decisioni finali.

Queste metodologie hanno reso possibile, come abbiamo visto, evidenziare le regioni di un’immagine che portano a una certa classificazione, o anche le parole di un testo che determinano il tono di una frase, o i fattori che influenzano certe decisioni, a cui pervengono i modelli. Oggi, per i modelli LLM generativi di grandi dimensioni, con le loro architetture Transformer, l’interpretabilità si sta gradualmente evolvendo verso un livello più approfondito di analisi. Un approccio con cui non solo si analizzano quali feature sono più rilevanti, ma anche, ed è questo l’aspetto più interessante di questi sviluppi, come l’informazione viene elaborata all’interno del modello neurale stesso.

Interpretabilità nei Transformer

A differenza delle tecniche di attribuzione e di visualizzazione trattate in precedenza, vediamo ora i meccanismi interni delle architetture Transformer.

Nei modelli Transformer la Self-Attention introduce un meccanismo interno di analisi e valutazione delle relazioni tra i diversi token: mostra cioè come ogni token “guardi” agli altri nel contesto di una sequenza, o nelle componenti spaziali dell’input (come nel caso delle immagini), rivelando i diversi pattern di dipendenza tra i token. Dipendenze non necessariamente causali, ma interpretate sia dal punto di vista linguistico che per il significato semantico delle loro relazioni, in quel determinato contesto. Un esempio lo abbiamo visto in un precedente paragrafo, relativamente alla visualizzazione delle Head di Attention.

Strumenti come BERTViz e, tra gli altri, AttentionViz, che mostrano in modo interattivo i pattern di Attention dei Transformer, permettono di visualizzare queste relazioni, offrendo un certo livello di trasparenza nei processi di elaborazione del linguaggio.

Tra gli strumenti emergenti figurano poi i Logit Lens e gli Sparse Autoencoders, utilizzati per scomporre e interpretare le rappresentazioni interne dei modelli neurali.

Tuttavia, i moderni LLM, composti da decine (o anche centinaia di layer, nei modelli più grandi), e miliardi di parametri, mostrano comportamenti che non si possono spiegare con la sola analisi dell’Attention, soprattutto nei modelli di più grandi dimensioni.

Per questo motivo è nata e si sta sviluppando una nuova linea di ricerca, molto avanzata, nota come Mechanistic Interpretability (ci stanno lavorando Anthropic, OpenAI, DeepMind, e altre piattaforme).

Questo nuovo campo di indagine mira a comprendere come funzionano questi modelli al loro interno, identificando neuroni, o combinazioni di neuroni, che rappresentano significati specifici, anche seapprossimati, e non sempre stabili nelle diverse analisi condotte, che siano però identificabili: come la sintassi o il ragionamento astratto stesso.

Tra i diversi modelli Open Source, che sviluppano la ricerca sul Mechanistic Interpretability, è da considerare “OLMo Trace”, progettato per analizzare e testare in tempo reale i meccanismi di attivazione interni al modello, mediante strumenti di tracciabilità delle elaborazioni che consentono di monitorare come funzionano effettivamente i meccanismi interni. E’ un esempio dell’applicazione della “spiegabilità intrinseca”, perché è stato progettato fin dall’inizio per dare proprio queste evidenze. E’ un modello molto avanzato, che sta facendo scuola in questo settore di ricerca.

Parallelamente, si cerca di mappare il meccanismo della Self-Attention, la caratteristica che è alla base dell’architettura Transformer, sull’intero contesto di riferimento.

Diversi studi hanno poi mostrato che la Self-Attention non è sempre il fattore predominante nelle decisioni del modello, perché gran parte del comportamento prende forma nelle rappresentazioni interne dei layer di feed-forward, a valle della composizione delle matrici di Attention, dove avvengono quelle trasformazioni non lineari che elaborano i “concetti”, e su cui sarà poi basata la classificazione finale.

Naturalmente siamo ancora all’inizio dello sviluppo di queste tecniche, e i risultati sono affidabili solo in contesti molto semplificati, ma ci sono grandi aspettative per il loro futuro, e la ricerca progredisce ogni giorno di più. La strada, insomma, è tracciata.

Altre tecniche emergenti

Tra le altre tecniche emergenti, oggi sperimentate dalle grandi piattaforme e anche da ricercatori indipendenti come Neel Nanda, sono da considerare l’Activation Patching, che sostituisce selettivamente le attivazioni di certi layer, o anche di specifici neuroni, per verificare dove avvengono certe operazioni interne. E anche la Representation Analysis, che esplora le direzioni nello spazio latente corrispondenti a concetti linguistici o semantici. E, infine, l’Attention Path Tracing, che traccia i percorsi di Attention tra i token, mostrando come l’informazione si trasforma gradualmente, nel corso della generazione del testo.

Queste tecniche superano l’approccio dei grafici di attribuzione tradizionali, offrendo una visione funzionale più approfondita dei meccanismi interni, che costituiscono il vero e proprio modo di “ragionare” del modello.

Uno degli strumenti pratici più utilizzati nella ricerca contemporanea è TransformerLens (sviluppato da Neel Nanda, nel 2024). E’ una libreria che permette di analizzare direttamente le attivazioni interne dei modelli Transformer, facilitando studi di mechanistic interpretability sui Large Language Models. Tra gli approcci più innovativi rientrano anche le “Self-Explaining Neural Networks” (SENN), che producono spiegazioni integrate direttamente nella predizione, generando output accompagnati da pesi interpretabili e feature esplicite.

Esistono ulteriori metodi, che analizzano i modelli a un livello più concettuale, cercando dei pattern interni ricorrenti. E’ questo un approccio ancora sperimentale ma molto promettente per rendere più comprensibile la logica interna; è dato da quelle tecniche che cercano di individuare automaticamente degli schemi ricorrenti all’interno delle reti neurali, evidenziando le relazioni tra certi neuroni che sembrano far parte della stessa funzione interna. Esempi di questo tipo sono metodi quali “Testing with Concept Activation Vectors” (TCAV), “Automated Concept-based Explanations” (ACE) o anche tecniche più recenti come gli Sparse Autoencoders, nati in Anthropic e poi portati avanti nello sviluppo da Neel Nanda, come evoluzioni della ricerca sulla Mechanistic Interpretability.

Metriche di valutazione della XAI

La definizione di metriche specifiche per la spiegabilità dell’AI è uno dei settori di ricerca più interessanti della XAI, perché è del tutto evidente che occorre uscire dai concetti di metrica generali, pur importanti, per arrivare a costruire degli elementi di valutazione specifici per i risultati raggiunti.

Uno dei lavori più interessanti è “Evaluation Metrics for XAI: A Review, Taxonomy, and Practical Applications” (del 2023), che propone una doppia valutazione: sia per le varie categorie di utilizzo che per tipologia di metrica.

Ci si pone quindi l’obiettivo di sviluppare degli strumenti di valutazione diversi da quelli tradizionali, che siano specifici per le tecniche di XAI, che valutino innanzitutto l’accuratezza e la chiarezza del modello. E dobbiamo anche considerare che alcune metriche generali usate nella valutazione dei modelli neurali, come l’Accuracy, la Precision, la Recall e la Sensitivity, anche se non attinenti alla spiegabilità, possono essere affiancate alle metriche utilizzate in questo settore per valutare le performance del modello.

Diversi altri lavori sottolineano la necessità di creare dei “benchmark” per garantire affidabilità e conformità rispetto alle normative (AI Act e framework NIST). Queste ricerche sono tutte concordi sull’obiettivo di creare un insieme di metriche standard che diano la misura dell’efficacia delle spiegazioni, sia per gli utenti che per le autorità preposte alla sorveglianza.

Dalla spiegazione alla tracciabilità

Le tecniche più importanti e diffuse, esaminate nelle sezioni precedenti, ci danno la possibilità di analizzare i risultati delle previsioni dei modelli neurali in riferimento alle feature di input che hanno prodotto quei determinati risultati, al loro peso relativo e alla loro rilevanza.

Il limite di queste tecniche però, è quello di rappresentare analisi e spiegazioni fatte “a posteriori”, e non durante il funzionamento del modello.

Sono necessari quindi degli sviluppi ulteriori per avere una visibilità “in corso d’opera”, per così dire, del funzionamento del modello stesso. La tendenza attuale è perciò quella di passare dalle spiegazioni a posteriori, costruite cioè dopo che il modello ha prodotto i suoi output, ad una tracciabilità “intrinseca”, in cui i processi interni diventano osservabili in tempo reale, fornendo così una efficace visibilità sul loro funzionamento. L’obiettivo finale è quello di riuscire a sviluppare dei modelli “autoesplicativi”, che per ora sono ancora teorici, in grado non solo di fornire una risposta, ma anche di motivarla, attraverso il tracciamento dei percorsi dei ragionamento seguiti, che siano comprensibili e verificabili da chiunque. Anche per metterli in discussione, e migliorarli, quando si utilizzano per applicazioni specifiche. Questo passaggio rappresenta in effetti la vera “nuova frontiera” dell’interpretabilità: non limitarsi a spiegare le decisioni, ma riuscire a capire meglio il percorso logico che ha portato a quelle decisioni.

È una prospettiva questa che mette insieme diverse discipline, come l’intelligenza artificiale, le neuroscienze computazionali e la filosofia della mente, aprendo la strada a sistemi di AI più trasparenti, affidabili e controllabili.

E’ un obiettivo questo, che renderebbe effettivamente applicabili i principi indicati dall’AI Act della Unione Europea, particolarmente in relazione agli Artt. 13 e 50 sulla trasparenza e sull’accountability.

Etica, trasparenza e Human-Centered AI

La crescente potenza dei modelli di Deep Learning, e dei Large Language Model generativi, impone di affrontare il tema dell’ “etica della trasparenza e dell’interpretabilità”.

Capire come una rete neurale prende le proprie decisioni non è soltanto un obiettivo tecnico, ma un presupposto indispensabile per garantire un uso dell’intelligenza artificiale che resti al servizio dell’uomo, risulti trasparente nelle sue decisioni, e consenta un controllo umano su ogni azione che possa essere intrapresa.

Human-Centered AI

Il principio di Human-Centered AI, introdotto inizialmente da Ben Shneiderman, e oggi ripreso dall’Unione Europea e anche dal Parlamento italiano, afferma che l’intelligenza artificiale deve essere orientata al benessere umano, garantendo trasparenza, sicurezza, equità e controllo umano effettivo (“human oversight”). In questo quadro, la spiegabilità diventa una componente imprescindibile di rispetto verso l’utente: permette di comprendere, e anche di poter contestare una decisione automatica, di fidarsi quindi di un sistema, come anche di correggerne gli errori che inevitabilmente possano essere commessi. Mettere al centro le persone, in ogni fase di sviluppo e di utilizzo di questi modelli (“human in the loop”) aumenta il grado di fiducia da parte degli utenti e favorisce la diffusione delle applicazioni di AI in ogni ambito, contribuendo così ad elevare l’efficienza e la competitività dei sistemi produttivi e dei servizi, in tutti i settori di attività, pubblici e privati.

Il tema dell’interpretabilità, in sostanza, è una condizione necessaria e non eludibile affinché l’AI rimanga controllabile, rispettando i principi etici e i valori umani. E’ solo avendo più visibilità dell’ allineamento, tra le decisioni dei modelli e i valori dello HCAI, che potranno crescere i livelli di confidenza nell’uso di questi strumenti.

AI Agent, autonomia e nuovi rischi

Una particolare attenzione merita l’emergere e la diffusione dei cosiddetti “AI Agent”, quei sistemi cioè capaci di pianificare, prendere decisioni ed eseguire delle azioni in piena autonomia, senza intervento umano, interagendo con i software di controllo, o anche con gli ambienti fisici. Questi sistemi sfruttano al massimo i benefici dell’AI, ma introducono, allo stesso tempo, dei nuovi rischi: errori di ragionamento amplificati lungo la catena delle azioni, difficoltà nel rendere trasparente il percorso decisionale seguito, e possibilità di comportamenti inattesi derivanti da obiettivi mal specificati (mancanza di “allineamento”).

In questo contesto, l’interpretabilità non è solo uno strumento di trasparenza, ma un requisito di sicurezza indispensabile. Comprendere perché un AI Agent abbia scelto una certa azione piuttosto che un’altra è essenziale per prevenire possibili danni, garantire un controllo umano efficace e tempestivo, e per rispettare gli obblighi normativi introdotti dall’AI Act.

Il quadro normativo: AI Act e legge italiana 2025

L’AI Act (Regolamento UE approvato nel 2024, e che sta entrando in vigore gradualmente) è la prima normativa organica sull’intelligenza artificiale. L’AI Act classifica i sistemi in base al livello di rischio: minimo, limitato, alto e anche inaccettabile, come nel caso di quei sistemi che utilizzano tecniche manipolative, o di sorveglianza biometrica di massa, o di “social scoring” nelle applicazioni sociali. Questi ultimi sistemi sono del tutto vietati.

Il Regolamento prevede, per i sistemi di AI ad alto rischio, l’obbligo di:

- Avere la tracciabilità e la documentazione delle decisioni;

- Programmare audit indipendenti e valutazioni di conformità;

- Utilizzare strumenti di spiegabilità e possibilità di intervento umano;

- Effettuare una marcatura dei contenuti generati artificialmente (art. 50, comma 2), inclusi immagini, audio, video e testi generati da sistemi di IA.

- adottare misure di sicurezza e di gestione del rischio (art. 9).

Molti altri paesi al di fuori dell’Unione Europea hanno utilizzato l’AI Act europeo come riferimento e come modello per le loro regolamentazioni nazionali, o anche per delle specifiche linee guida. Vediamone alcune.

Canada, Australia e Giappone hanno introdotto delle linee guida e dei quadri etici nazionali per garantire un utilizzo responsabile dell’IA, pur senza arrivare ancora a normative vincolanti paragonabili all’AI Act europeo.

Stati Uniti: la nuova amministrazione, insediatasi nel gennaio 2025, ha segnato una svolta rispetto all’approccio precedente, con il nuovo Executive Order 14179, orientato a ridurre le barriere normative e ad accelerare lo sviluppo dell’IA nazionale per mantenere il primato in questo campo, insidiato dai grandi progressi e dai notevoli investimenti fatti dalla Cina. Nel luglio 2025 è stato presentato l’ AI Action Plan, che privilegia semplificazione, investimenti e deregolamentazione. La tendenza politica della nuova amministrazione è quella di limitare l’eccesso di regolamentazione locale da parte degli stati federali.

Cina: mantiene un approccio centralizzato e preventivo, con regole severe su censura, sorveglianza e supervisione dei sistemi, considerati strumenti strategici di governance.

Nel 2025, l’Italia ha approvato la propria legge nazionale sull’intelligenza artificiale, che recepisce e integra l’AI Act. La legge istituisce una Cabina di regia nazionale e un Centro per la supervisione etica e tecnica dell’AI, con compiti di vigilanza, formazione e promozione della ricerca. La legge prevede inoltre misure di sostegno per imprese, startup e pubbliche amministrazioni, volte a favorire l’adozione di soluzioni di intelligenza artificiale conformi ai principi di sicurezza, trasparenza e tutela dei diritti fondamentali, nonché dei programmi di aggiornamento professionale e iniziative di sensibilizzazione pubblica, per diffondere una cultura dell’innovazione che sia etica e sostenibile.

L’Italia è diventata così il primo Stato membro dell’Unione Europea ad aver approvato una legge nazionale sull’intelligenza artificiale, recependo e integrando anche l’ AI Act europeo.

Questo quadro regolamentare, sia nazionale che internazionale, è rivolto a dare una attuazione concreta ai principi di controllo, e di AI centrata sulla persona, favorendo la trasparenza, la spiegabilità e la supervisione umana di questi sistemi.

L’interpretabilità come strumento etico e di accountability

Le tecniche di interpretabilità, dai grafici di attribuzione alle analisi dei circuiti nei grandi LLM, rispondono pienamente a tutte queste esigenze. Esse rendono i sistemi più trasparenti, permettendo di individuare errori, bias o discriminazioni prima che abbiano conseguenze sul piano sociale, in linea con il modello europeo di “Trustworthy AI” basato su trasparenza, sicurezza, equità, robustezza, privacy e controllo umano. Inoltre, costituiscono un ponte tra tecnologia e diritto: forniscono una base tecnica per l’accountability, la responsabilità e la spiegabilità giuridica delle decisioni automatizzate.

Comprendere il funzionamento interno dei modelli non è quindi solo una sfida scientifica, ma un obbligo etico e normativo.

Solo un’IA trasparente, interpretabile e centrata sulla persona, potrà essere davvero degna di fiducia e integrata in modo sostenibile nei processi economici, sociali e culturali del futuro.

La spiegabilità della privacy nei sistemi di AI

L’esigenza di trasparenza e di spiegabilità per i sistemi di AI non riguarda solo il modo in cui funzionano, come si arrivi cioè alle decisioni finali, che si tratti di previsioni o di classificazioni, o per altri tipi di decisioni automatizzate, ma riguarda anche il modo in cui i nostri dati vengono utilizzati per arrivare ai risultati, e come questi dati vengano o meno conservati.

La “Spiegabilità della Privacy” (privacy explainability) è un ambito emergente, che ha come obiettivo quello di rendere comprensibile agli utenti, e verificabili anche da parte delle authority di sorveglianza, i processi di utilizzo e di conservazione dei dati, in particolare per i modelli LLM, che utilizzano i dati raccolti nelle interazioni con gli utenti come input per generare le risposte.

E’ una disciplina che si collega direttamente ai diritti e alle garanzie disposte dal GDPR (per i diritti di: accesso, rettifica, cancellazione, portabilità e limitazione del trattamento).

Il tema è molto sentito, perché con l’utilizzo di questi sistemi si è aperto un nuovo fronte di rischio, per cui i nostri dati corrono rischi molto elevati di diffusione, o anche di riutilizzo, non previsti inizialmente, e che possano non essere stati autorizzati dall’utente in precedenza.

La spiegabilità della privacy deve riguardare quindi i diversi aspetti:

- Occorre avere visibilità di quali dati vengano memorizzati, e se si tratti di dati personali o addirittura di dati sensibili;

- Bisogna sapere come questi dati vengono trattati, e avere evidenza dell’uso che il modello ne fa, ai fini delle inferenze e delle decisioni automatizzate che riguardano le persone;

- Avere evidenza di rischi di sicurezza e di possibili utilizzi di questi dati per fini diversi da quelli consentiti dagli utenti.

I grandi modelli generativi devono, in sostanza, dirci quali dati dell’utente vengono temporaneamente memorizzati (nei log o nelle memorie temporanee delle chat), come vengano anonimizzati (o per lo meno pseudonimizzati) per impedire il collegamento col singolo utente, evidenziare se ci siano rischi di utilizzo diverso, e anche come, e fino a quando, questi dati vengono mantenuti.

Vanno anche rispettati i diritti degli utenti nell’accesso ai dati che li riguardano, così come le richieste di cancellazione o di rettifica.

Infine, occorre sapere se e come questi dati vengono memorizzati e dove, in quale infrastruttura, ma, soprattutto, in quali paesi del mondo, in modo da verificare l’applicabilità delle normative europee, laddove i nostri dati sono detenuti all’estero (quasi sempre praticamente).

Dobbiamo anche tener presente che il tema della spiegabilità della privacy diventa ancora più stringente con l’introduzione, come già detto, degli AI Agent, che operano in autonomia utilizzando informazioni dell’utente e che prendendo iniziative senza richiedere un intervento diretto da parte dell’utente.

Come realizzare la spiegabilità della privacy

La spiegabilità della privacy si realizza attraverso strumenti e procedure che rendono verificabile ogni fase del trattamento dei dati.

Il primo punto da considerare è la documentazione trasparente del ciclo di vita dei dati: le varie piattaforme devono descrivere in modo chiaro quali sono i dati che vengono raccolti durante l’interazione, spiegarne le finalità e le basi giuridiche di riferimento.

Questa documentazione deve poi essere accompagnata da interfacce comprensibili, e facili da utilizzare, che mostrino agli utenti quali informazioni vengono create, come vengono elaborate, e se e come vengono memorizzate durante l’uso del modello.

Il secondo punto riguarda i meccanismi di controllo messi a disposizione dell’utente. Questi devono includere degli strumenti che permettano di visualizzare in quali parti dell’input sono stati rilevati dei dati personali, come tali dati vengono gestiti dal modello e quali elaborazioni subiscono. Alcuni sistemi stanno realizzando delle dashboard del profilo, che mostrano i dati associati all’account e le modalità con cui sono stati anonimizzati o pseudonimizzati.

La privacy explainability richiede anche dei report periodici, che illustrino le politiche di conservazione, i tempi di retention, i processi di anonimizzazione, le misure di sicurezza applicate e gli eventuali trasferimenti dei dati fuori dall’UE. Questi rapporti devono essere verificabili dalle autorità indipendenti, che possono richiedere documentazione o effettuare delle ispezioni per verificare il rispetto delle norme.

Un elemento importante poi è costituito da sistemi di audit e di controlli indipendenti. I modelli devono essere progettati per conservare evidenze verificabili sul trattamento dei dati, sui log delle operazioni, avere tracciabilità interna, indicatori ed evidenze che mostrino l’eventuale utilizzo di dati personali dell’utente per produrre gli output. Questo deve consentire di ricostruire come un dato è stato elaborato, e se il suo utilizzo è stato conforme al consenso preventivamente dato dall’utente e anche alle norme.

Fondamentale è infine il supporto ai diritti dell’utente: la spiegabilità della privacy è reale solo se l’utente può accedere realmente ai propri dati, sapere dove si trovano, ottenere la loro cancellazione o modifica, e verificare che siano stati effettivamente aggiornati dopo una sua richiesta. Per questo molte piattaforme stanno introducendo degli strumenti automatici che consentono di richiedere la cancellazione selettiva o totale dei dati, con notifica delle operazioni effettuate.

Un esempio concreto è rappresentato da ChatGPT di OpenAI: le policy ufficiali indicano quali sono i dati dell’utente che vengono conservati, per quanto tempo e con quali finalità; l’utente può anche attivare la modalità “Temporary Chat”, che elimina automaticamente le conversazioni entro 30 giorni (Chat and File Retention Policies in ChatGPT | OpenAI Help Center).

Restano possibili obblighi di conservazione dei log per motivi di sicurezza o tutela legale. In GPT i dati non vengono utilizzati per l’addestramento solo se è disattivata l’opzione “Improve the model”, è quindi una scelta che l’utente può effettuare (In Impostazioni/Controllo dati/Migliora il modello), e di cui deve avere consapevolezza.

Anche Google Gemini adotta analoghi meccanismi di spiegabilità della privacy: l’utente può controllare se le conversazioni vengano conservate o meno tramite le impostazioni in “Gemini Apps Activity”, (https://support.google.com/gemini/answer/13594961) con la possibilità di disattivarle in ogni momento. Nelle conversazioni temporanee (“Temporary Chat”), inoltre, i dati vengono automaticamente eliminati entro le 72 ore (https://blog.google/products/gemini/temporary-chats-privacy-controls/).

Ricerche in corso e prospettive future

La spiegabilità della privacy, come già detto, è un settore ancora agli inizi, ma la ricerca sta andando avanti rapidamente. OpenAI, Google DeepMind, Anthropic e diversi altri gruppi di ricerca stanno sviluppando degli strumenti per verificare se e come un modello memorizza dati personali, attraverso tecniche di “memorization audit” e analisi del comportamento interno degli LLM.

Una memorization audit è un test che verifica se un modello di linguaggio conserva e può rigenerare dati sensibili appresi durante l’addestramento, e, soprattutto, dalle interazioni con gli utenti.

Altre ricerche riguardano poi la possibilità di creare sistemi capaci di generare, in automatico, spiegazioni comprensibili sul trattamento dei dati, indicando quali informazioni vengono utilizzate, per quanto tempo restano memorizzate, e quali rischi di associazione all’utente potrebbero determinarsi.

Queste tecniche, ancora sperimentali, si affiancano ai progressi sulla differential privacy (consente di addestrare modelli riducendo la possibilità che singoli dati vengano re-identificati) e a quelli sui modelli progettati fin dall’inizio per minimizzare l’uso dei dati.

Tutti questi settori di ricerca rappresentano la direzione verso cui si sta muovendo la “privacy explainability”, con l’obiettivo di creare sistemi più trasparenti, verificabili e rispettosi dei diritti degli utenti.

Nota sull’utilizzo delle tecniche di spiegabilità

Le tecniche descritte in questo articolo, come le Saliency Maps, Grad-CAM, Integrated Gradients, LIME e SHAP, vanno implementate nella fase di sviluppo di un modello, inserendole nelle istruzioni dichiarative fornite dalle varie librerie, come Tensorflow e PyTorch, anche partendo da modelli preaddestrati come BERT, LLaMA, Mistral, o altri Open Source.

Nei modelli commerciali, come GPT-4/5, Gemini o Claude, a cui si accede via web o tramite delle API, queste tecniche non sono direttamente applicabili dagli utenti, per cui si è limitati ad utilizzare gli strumenti messi a disposizione delle piattaforme.

Questi strumenti riguardano la trasparenza e la spiegazione delle modalità di funzionamento del modello, e di utilizzo dei dati. E’ questo un aspetto che richiederebbe ulteriori passi in avanti da parte di queste piattaforme.

Conclusioni

Le tecniche di attribuzione rappresentano oggi uno strumento essenziale per comprendere e visualizzare, anche se con dei limiti, il comportamento interno dei modelli di Deep Learning. Vengono da loro mostrati quali elementi dell’input influenzano maggiormente l’output, permettono di verificare la coerenza delle decisioni e di aumentare la fiducia nei risultati del modello. Le applicazioni di queste tecniche sono molteplici, come abbiamo visto, e sono già concrete.

Nei modelli linguistici avanzati l’interpretabilità si spinge anche oltre. Parlare di “tracciare i ragionamenti” non significa leggere la “mente” della macchina, ma mappare le trasformazioni intermedie, dai vettori di embedding ai pattern di Attention, dai “pesi” attribuiti ai neuroni che codificano i concetti, fino alle catene di inferenza che portano alla risposta finale.

È una sfida interdisciplinare, tra AI, neuroscienze computazionali e filosofia della mente, e rappresenta una delle frontiere più promettenti, per rendere i sistemi del futuro non solo potenti, ma anche comprensibili, affidabili e controllabili.

Questi obiettivi non sono più un mito oggi, né sono al di fuori della nostra portata: comprendere i processi interni dei modelli significa porre le basi per una nuova generazione di intelligenze artificiali realmente al servizio dell’uomo.

Ci sono ancora delle paure “ataviche” legate all’utilizzo dei sistemi di AI, paure alimentate dai modelli cinematografici alla “Terminator”, ma anche al grido di allarme, da non sottovalutare, lanciato da molti esperti, sui rischi dell’uso non controllato di questi sistemi.

Seguire la strada della trasparenza e della spiegabilità dovrà guidare sempre più il percorso evolutivo di questi sistemi, introducendo quei criteri di controllo necessari ad assicurare l’allineamento ai valori umani.

E’ una strada da percorrere con decisione, anche per dare alle aziende e alle organizzazioni gli strumenti di governance indispensabili per una diffusione più sicura, trasparente, e sotto il controllo efficace delle persone.

Bibliografia

Lavori fondamentali:

- Ribeiro, M. T., Singh, S., & Guestrin, C. (2016). Why Should I Trust You? Explaining the Predictions of Any Classifier – KDD.

- Lundberg, S. M., & Lee, S.-I. (2017). A Unified Approach to Interpreting Model Predictions (SHAP) – NeurIPS.

- Sundararajan, M., Taly, A., & Yan, Q. (2017). Axiomatic Attribution for Deep Networks – ICML.

- Vaswani, A. et al. (2017). Attention Is All You Need – NeurIPS.

Altre fonti

- Simonyan, K., Vedaldi, A., & Zisserman, A. (2014). Deep Inside Convolutional Networks: Visualising Image Classification Models and Saliency Maps – arXiv:1312.6034.

- Selvaraju, R. R. et al. (2017). Grad-CAM: Visual Explanations from Deep Networks via Gradient-based Localization – ICCV.

- Lanzi, P. L. (2020). Intelligenza artificiale. Dagli algoritmi genetici alle reti neurali – Apogeo.

- Chefer, H. et al. (2021). Transformer Interpretability Beyond Attention Visualization – CVPR.

- Shneiderman, B. (2022). Human-Centered AI – Oxford University Press.

- Molnar, C. (2022). Interpretable Machine Learning: A Guide for Making Black Box Models Explainable. Second edition.

- Raiano, L., & Stilo, G. (2023). Spiegare l’intelligenza artificiale. L’Explainable AI tra etica, diritto e società – FrancoAngeli.

- Paraskevopoulou, S. (2023). Explainable AI (XAI): Are we there yet?- Matlab Blog.

- Nanda, N. (2024). TransformerLens: Mechanistic Interpretability for Transformers -Anthropic Research.

Fonti istituzionali e normative

ACN – Agenzia per la Cybersicurezza Nazionale (2024–2025). Linee guida sull’IA.

Parlamento Europeo (2024). Regolamento (UE) 2024/1689 sull’Intelligenza Artificiale (AI Act) – Gazzetta Ufficiale dell’Unione Europea.

Presidenza del Consiglio dei ministri (2025). Legge italiana per la governance dell’intelligenza artificiale – Gazzetta Ufficiale, settembre 2025.