Come tutte le tecnologie con grandi potenzialità di “disruption”, l’intelligenza artificiale e il machine learning possono presentare significative opportunità ma anche concreti rischi se applicate in ambiti quali la sicurezza, e nello specifico di quella informatica e dei sistemi.

Ecco allora una prima ricognizione dei macro-scenari di opportunità generati dalle nuove tecnologie.

Indice degli argomenti

Intelligenza artificiale, principali limiti

Il dualismo cui accennavo sopra (opportunità vs rischi) può derivare sia dall’adozione tecnologica quando si è ancora a livelli di maturità non adeguati, sia da specifici e concreti casi d’uso.

Per chiarire il primo punto, riporto un esempio fornito da una importantissima azienda realizzatrice di soluzioni software e cloud, riguardo al riconoscimento di immagine ed estrazioni di “feature” espresse mediante parole chiave. Consideriamo la figura seguente.

Il risultato del rilevamento pare impressionante. Non solo si identificano correttamente un gran numero di elementi in una composizione grafica complessa, ma se ne fornisce una sintesi coerente e calzante. Tuttavia, riproviamo l’esperimento con un’altra immagine.

Notiamo come la descrizione sintetica fornita risulti molto meno accurata, sebbene alcune caratteristiche siano state correttamente indicate. Questo apre un primo tema: l’Artificial Intelligence (AI) declinata nel Machine Learning (ML) fornisce ottime prestazioni nella “confort zone” in cui sono stati addestrati e sviluppati gli algoritmi. Tuttavia può fallire in modo tutt’altro che graduale quando si arriva ai margini dell’addestramento. E può fallire in modi che, agli occhi di una persona, possono sembrare inspiegabili.

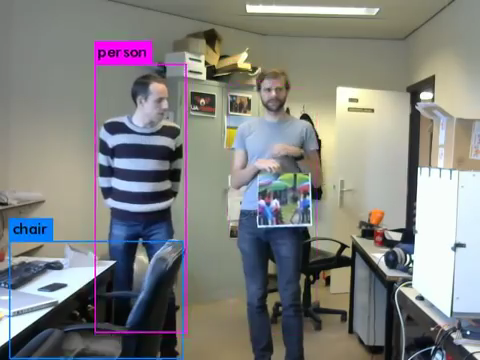

Non mi addentro ora su questi temi specifici, tuttavia spero di illustrare ancora meglio il nocciolo della questione riportando un fotogramma tratto da un video. Tale video mostra come la persona che regge in mano uno specifico cartello gode di una sorta di “invisibilità” rispetto ad un particolare sistema di video-sorveglianza oggetto di test.

Molto interessante (si apprezza nel video) il momento in cui la persona a destra passa il foglio a quella a sinistra. La caratteristica di “invisibilità”, dopo un breve momento di esitazione, si “trasferisce” al secondo soggetto mentre il primo viene identificato.

Non è mio obiettivo sviluppare in questa sede le motivazioni specifiche che causano queste “failure”, ma vorrei che venissero tenute a mente nella continuazione della lettura per meglio comprendere determinati punti. È utile infine pesare correttamente le opportunità concrete (pensiamo ancora al fotogramma sopra, indice comunque della capacità di individuare e classificare correttamente svariate altre parti dell’immagine) e i rischi.

Sistemi di AI e security, ambiti di applicazione

L’Artificial Intelligence in tutte le sue declinazioni può certamente rappresentare una grande opportunità quando applicata alla cybersecurity. Di soluzioni che ne dichiarano più o meno estensivamente l’utilizzo se ne trovano in gran numero, a diversi livelli di maturità e di readiness rispetto ad un efficace utilizzo e una concreta integrazione in ICT aziendali anche complessi.

In linea di principio, ipotizzo una suddivisione concettuale in tre macro-ambiti di applicazione o adozione:

- Tutto ciò che riguarda l’“identificazione” (anche predittiva) di fenomeni

- L’aiuto ad effettuare correlazioni “intelligenti” e a gestire risposte adattative

- La semplificazione dell’interazione tra tecnologie e persone, secondo molteplici angolazioni

Nel seguito proviamo a fornire alcuni elementi sintetici per ciascuno di questi tre filoni, identificando quelli che possono essere le declinazioni più promettenti di ciascuno.

Vi è innanzitutto l’ambito dell’“identificazione”. Con questo intendo riferirmi a tutto ciò che riguarda il riconoscimento tempestivo di fenomeni che, pur riconducibili ad un pattern noto, se ne discostano in misura anche significativa. Questo campo trae significativo vantaggio dalle tecniche basate su Artificial Intelligence e più nello specifico legate al Machine Learning (ove l’applicazione di tecniche statistiche permette alle “macchine” di migliorare con l’esperienza e l’applicazione di feedback).

Anche gli aspetti legati alla contestualizzazione vengono esaltati dalla tecnologia, data la capacità di questi algoritmi di introdurre nell’elaborazione la possibilità di discriminare il contesto e di operare valutazioni di conseguenza.

Identificazione, monitoraggio, phishing

Nella pratica, al di là di tutte le possibili sfumature che si possano tentare di introdurre, le applicazioni più concrete in questo specifico ambito paiono essere legate a:

- Identificazione (o rilevamento in assenza di signature e/o euristiche note) di nuovi malware ed in generale nuove “minacce“. La principale limitazione sembra essere quella per cui questi elementi nuovi siano evolutivi rispetto ai pattern noti esistenti. Elementi sostanzialmente nuovi sembrano essere ancora poco gestibili, quantomeno in termini di categorizzazione (ossia nel caso specifico, di attribuzione ragionevolmente certa di un’etichetta “malware”). Una declinazione interessante di questo caso d’uso include la “prioritizzazione avanzata“. A titolo di esempio, con riferimento ad una scansione alla ricerca di vulnerabilità tecniche su un gruppo di sistemi, queste tecniche permettono non solo di fornire risultati derivanti dal “CVSS”[3] associato alla vulnerabilità trovata, ma di pesare il livello di criticità anche in relazione a vari altri fattori (configurazione della rete, la probabilità di concretizzazione, ecc.)

- Monitoraggio dell’attività standard di sistemi e persone, per rilevare deviazioni e/o anomalie potenzialmente malevole (anche in assenza di una definizione di “anomalia”). Punto forte dell’approccio è infatti quello di identificare e via via raffinare “cluster” di dati e comportamenti. Pertanto, deviazioni significative dagli stessi vengono facilmente messe in luce. Ancora una volta, anche in relazione a quanto già illustrato sopra, l’applicazione di una specifica “etichetta” (es. ammissibile/frode, programma lecito/malware, ecc.) a quanto scoperto difficilmente potrà essere delegata in toto al sistema tecnologico. A meno di non stabilire di attuare valutazioni probabilistiche rispetto al punto precedente. In altri termini, si può definire quale limite di scostamento da comportamenti noti accettare per una classificazione automatica, e dove invece invocare un intervento differente. Il caso d’uso specifico include ad esempio l’identificazione di traffico e comportamento anomalo generato da BotNet o altro malware attivo sulla rete. Motivo per cui molte soluzioni di analisi in quest’ambito si stanno dotando di questo tipo di tecnologia.

- Rilevamento del phishing. Qui, le tecnologie possono operare discriminando la tipologia in senso ampio sull’intero messaggio o, in modo più mirato, analizzando specifiche feature. In pratica, è possibile procedere dal basso andando ad analizzare con approcci AI/ML alcuni elementi tipicamente rivelatori del messaggio (URL dei link, parole chiave, mittenti/destinatari, ecc,). Inoltre è anche possibile operare un’analisi ad un livello più elevato andando a capire quali composizioni di elementi come quelli citati sono più probabilmente riconducibili a email di phishing.

Va da sé che l’adozione di tutti questi casi d’uso beneficia significativamente (ma questo è vero in tutti gli ambiti di applicazione di AI/ML) di un’ampia disponibilità di dati e di esempi di riferimento. Per questo motivo la maggior parte delle soluzioni che applicano questo approccio dispongono di una componente “cloud” che raccoglie (anonimizzando o “pseudonimizzando”) le diverse segnalazioni e addestra opportunamente gli algoritmi di elaborazione (quand’anche la stessa elaborazione non avvenga in cloud).

Reazione intelligente, risposta adattativa

Come accennato all’inizio dell’esplorazione delle tipologie di opportunità abilitate dall’adozione di AI/ML in ambito di cybersecurity, rilevante può essere anche quella della correlazione, a cui segue una reazione “intelligente” e una risposta “adattativa” a quanto accade. Di fatto viene naturale, dopo l’inevitabile applicazione alla correlazione di dati, esplorare l’applicazione di AI/ML agli approcci reattivi. In pratica, è lecito chiedersi se sia possibile intraprendere decisioni basate sugli eventi riscontrati e sulla loro classificazione, innescando quindi una reazione alle “mosse” dell’attaccante.

Un passo ulteriore potrà essere quello di abilitare decisioni autonome nell’ambito dello scopo prestabilito. Sono in particolare interessanti le seguenti casistiche, che in qualche modo possono essere considerate “incrementali”:

- Ricerca e analisi rapida di correlazioni tra eventi (log, …), anche “sparsi” nell’infrastruttura ICT e/o di natura e formato differente, così da superare i limiti spesso esistenti tra le “barriere tecnologiche” costituite dall’adozione di formati specifici. Ciò permette un passo ulteriore nell’identificazione preventiva di minacce, magari realizzando un confronto con gli IOC disponibili in vari linguaggi, senza necessità di una loro “traduzione in regole” sui sistemi e conseguente generazione di un log specifico per la compromissione monitorata.

- Riconfigurazione automatica (self-patching) di reti e sistemi, in relazione alla scoperta di vulnerabilità. A seconda del livello di maturazione che gli approcci basati su AI/ML potranno avere (e ovviamente della readiness delle infrastrutture nel supportarli), una delle “promesse” è l’introduzione di meccanismi che vadano oltre l’attuale “virtual patching” (ossia il blocco tramite apparati di rete più o meno evoluti di attacchi tesi a sfruttare vulnerabilità presenti sui sistemi). Si parla non a caso di self-patching con riferimento alla capacità, guidata da AI, di governare un processo di patching automatico dei sistemi e/o riconfigurazione degli stessi in risposta ad indicatori di attacco scoperti ad esempio con tecniche di cui al punto precedente.

- Per i più “sperimentatori” tra i gestori di infrastrutture ICT e sistemi di cybersecurity, il futuro promette la disponibilità di Honeypot dinamiche, che estendono il concetto di honeypot permettendo un’intrusione “controllata” da parte dell’eventuale attaccante in porzioni di infrastruttura dedicate, al fine di meglio comprendere finalità e obiettivi dell’attacco. L’approccio rappresenta un’estensione delle ricerche e delle realizzazioni attualmente esistenti nel campo degli “automated malware analysis system”.

Difesa delle Intent Based Network

I punti appena illustrati portano, nell’intuizione di alcuni, ad identificare AI e ML come elementi centrali nella realizzazione delle funzionalità di sicurezza delle cosiddette “Intent Based Network”[4]. In particolare, mediante lo sviluppo di tecniche per declinare “intenti” di business, e conseguenti configurazioni, in requisiti di cybersecurity associati (e nella loro attuazione), così che la riconfigurazione di una rete si associ alla preservazione del livello di sicurezza. Più realisticamente, questi punti sostengono la nozione oggi sempre più propagandata di “Cognitive SOC” o altri approcci similari.

Verso un mondo passwordless

Infine, una terza macro-area di interesse per l’applicazione di AI/ML alla security, in realtà già nota e per certi aspetti sviluppata da almeno un decennio, è quella che prevede l’analisi dei dati e dei comportamenti legati a (o pensati per) le persone. Parliamo qui di comportamenti e dati non strutturati, messi in relazione con contesti di riferimento e informazioni note e generate da sistemi. Il tutto a supporto delle attività di chi deve “lavorare con i dati”… O di chi deve semplicemente lavorare, in un contesto caratterizzato sempre più da fenomeni di “infodemia” che si associano a situazioni di crisi, ma anche alla quotidianità. Ma nella pratica si possono sviluppare le più disparate applicazioni, tra cui citiamo a titolo di esempio:

- L’interpretazione di dati non strutturati (creati “dalle persone per le persone”) e messa in relazione con dati strutturati (prodotti da sistemi) per scoprire nuovi fenomeni. Con riferimento alla macro-area precedentemente esplorata e all’accenno ai “Cognitive SOC”, questa specifica capacità abilita l’analisi di report, notizie, fonti (aperte/chiuse) che analizzano o annunciano specifici fenomeni o trend di cybersecurity, distillandone una sintesi ragionata e applicabile alla specifica organizzazione ma anche mettendo in relazione il problema descritto con quanto emerge dall’analisi integrata degli eventi. La “promessa” è quella di poter supportare l’analista umano in tutta la filiera che va dall’OSINT/threat hunting fino alla predisposizione (ed in alcuni casi attuazione) della corretta remediation.

- L’autenticazione adattativa, basata su scenari e indicatori di rischio dinamici e contestualizzati. Il principio è quello di chiedere all’utente ulteriori elementi di autenticazione, o semplicemente di verifica del fatto che sia “un umano”, solo all’occorrenza sulla base di specifici indicatori di rischio dinamici. Questo ambito è esplorato da oramai un decennio ed è in realtà maturo, se si considerano gli approcci all’autenticazione adottati dai “big player” del cloud, ma non solo. Il traguardo (che svariati attori primari indicano come raggiungibile nel 2020) è quello di un mondo “passwordless”.

- Il rilevamento delle frodi, di fatto caratterizzato da operazioni concettuali come: identificazione pattern anomali, riconduzione a pattern noti, similitudini, relazioni, ecc. Di fatto, rappresenta l’applicazione del primo degli scenari d’uso analizzati, non all’ambito specificamente tecnologico, ma ai comportamenti delle persone in uno specifico dominio. Un esempio su tutti è rappresentato dall’identificazione delle frodi con carta di credito, in cui le reti neurali sono presenti in soluzioni commerciali (accanto a tecniche “rule based”) sin da prima del 2010. Lo sviluppo in quest’ambito, alla luce del miglioramento degli approcci basati su AI/ML e del crescere della potenza computazionale, può essere rappresentato dall’allargamento/generalizzazione dei contesti di applicazione. Da pattern di frodi in ambiti relativamente specifici, come quello appena citato, all’analisi congiunta (ad esempio) di indicazioni provenienti da apparati fisici e sistemi software in contesti di automazione industriale, al fine di identificare (anche con elementi comuni rispetto alla predictive maintenance e alla safety) segnali deboli sintomatici di attacco o sabotaggio.

Concludo così la prima parte di questa panoramica. Nella prossima parte approfondirò le implicazioni in termini di rischio rispetto all’introduzione di AI/ML nel contesto della cybersecurity, e proporrò qualche conclusione anche derivante da esperienze concrete di sperimentazione sviluppate in Cefriel.

(1. continua)

Note

- Il Common Vulnerability Scoring System (CVSS) è un framework aperto per comunicare le caratteristiche e l’impatto di vulnerabilità di sicurezza

- La parola chiave nelle Intent Based Network è l’intento, che descrive l’obiettivo aziendale di una rete. Nelle reti di questo tipo, i professionisti IT stabiliscono politiche che specificano l’intento aziendale (a livello di business) della rete, prescrivono automaticamente come raggiungere tale obiettivo e automatizzano il deploy su vasta scala