Per anni l’integrazione dell’Intelligenza Artificiale nel quadro della sostenibilità e dei criteri ESG è stata rappresentata come una traiettoria tanto inevitabile quanto intrinsecamente virtuosa.

Algoritmi capaci di ottimizzare reti energetiche, incrementare l’efficienza dei processi industriali, monitorare in tempo reale le catene di fornitura e rafforzare la trasparenza dei processi decisionali sono stati presentati come strumenti in grado di colmare il divario storico tra performance economica e responsabilità sistemica.

Indice degli argomenti

AI e sostenibilità: quando la tecnologia incontra la Corporate Digital Responsibility

In questa narrazione, l’AI ha progressivamente assunto il ruolo di tecnologia abilitante per eccellenza, non più semplice leva di produttività ma infrastruttura cognitiva capace di trasformare la sostenibilità da vincolo normativo a autentica leva strategica. La letteratura più recente ha effettivamente riconosciuto all’AI un potenziale significativo in termini di efficienza operativa, capacità predittiva e gestione avanzata del rischio. Tuttavia, quando tali strumenti vengono collocati all’interno del framework emergente della Corporate Digital Responsibility emergono dimensioni critiche che tendono a rimanere in ombra quando AI ed ESG sono analizzati separatamente.

L’intersezione tra tecnologia, responsabilità digitale e sostenibilità mette infatti in luce tensioni strutturali legate all’impatto ambientale delle infrastrutture computazionali, ai rischi di bias algoritmico, alla tutela dei dati personali e alla qualità dei processi decisionali automatizzati. Ciò che appare lineare e coerente se osservato per compartimenti stagni diventa dunque più complesso quando viene analizzato nella sua interezza sistemica.

Venticinque anni di sentiment sull’AI: cosa rivela la ricerca Sapienza

Un recente studio longitudinale (Laviola & Cucari, 2026), pubblicato sulla rivista Technology in Society, ha provato a fare chiarezza su queste dinamiche, analizzando un imponente corpus di oltre 33.000 notizie pubblicate nei media generalisti e nei social media in un arco temporale di venticinque anni, dal 2000 al 2025.

L’obiettivo della ricerca, condotta nell’ambito delle iniziative della Ermes, startup universitaria Sapienza, ha voluto mappare l’evoluzione del sentiment verso l’AI incrociandolo coi temi della sostenibilità. I risultati rivelano che l’accettazione sociale di questa tecnologia non è affatto monolitica o scontata. Al contrario, essa varia drasticamente a seconda del pillar ESG considerato, delineando una “gerarchia di legittimità” che porta con sé implicazioni profonde per la reputazione aziendale e impone una revisione delle strategie di CDR.

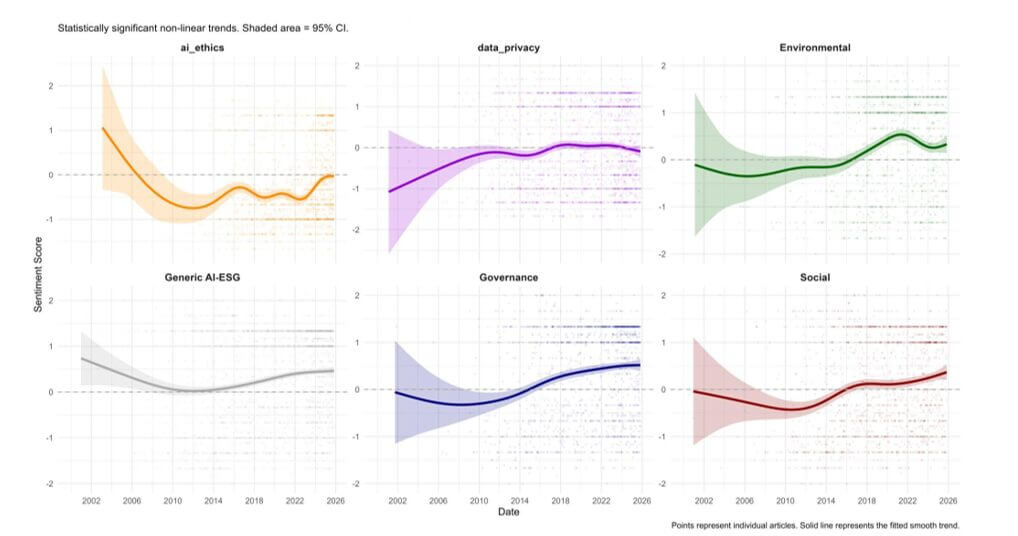

Figura 1 – Trend temporali del sentiment nei confronti dell’AI nei tre pilastri ESG e nei sotto-cluster dell’etica e della riservatezza dei dati. Adattamento da (Laviola & Cucari, 2026).

Un’accettazione situata: il discorso pubblico come segnale anticipatore

In altri termini, non siamo di fronte a un pubblico che accetta o rifiuta l’AI in modo dicotomico e indifferenziato, bensì a una società che ne valuta costantemente il valore in relazione ai contesti applicativi e agli effetti percepiti. L’accettazione non è uniforme, ma situata e condizionata dalle implicazioni concrete che la tecnologia assume nei diversi ambiti. Le evidenze empiriche dello studio indicano inoltre che il sentiment espresso nei media non si limita a riflettere un’opinione pubblica consolidata, ma svolge una funzione più dinamica e prospettica, configurandosi come un segnale anticipatore di possibili tensioni normative e di future lacune di legittimità. In questo senso, il discorso pubblico non rappresenta soltanto una reazione alla tecnologia, ma contribuisce a definirne progressivamente i confini di accettabilità sociale.

Il paradosso ambientale: dalla Green AI alla consapevolezza dei costi occulti

Il dato forse più sorprendente e significativo che emerge dall’analisi riguarda la dimensione ambientale, dove si è assistito a quella che potremmo definire una vera e propria inversione di tendenza storica.

Per quasi due decenni, la narrazione mediatica ha esaltato quasi acriticamente la cosiddetta “Green AI“: la capacità degli algoritmi di rendere le città più intelligenti, di efficientare i processi industriali, di modellare con precisione i cambiamenti climatici e di supportare la transizione verso l’economia circolare. Come evidenziato anche da recenti studi internazionali (Oehmichen et al., 2025), le applicazioni virtuose, in aree come la biodiversità, la gestione idrica e l’ottimizzazione dei trasporti, non mancano: pensiamo ai sistemi FireSat di Google per il rilevamento precoce degli incendi, o all’uso dell’AI per mappare i “pozzi di carbonio” nelle foreste e ottimizzare la rimozione della plastica dagli oceani. L’AI è in questo senso vista, e forse idealizzata, essenzialmente come il miracolo immateriale capace di salvare un mondo fisico in rovina.

Il rovescio della medaglia: il peso materiale dell’AI generativa

Tuttavia, a partire dal 2022, il sentiment ha subito una flessione statisticamente significativa, virando bruscamente verso il territorio negativo. Questa data non è casuale, ma segna uno spartiacque preciso: coincide con la diffusione di massa dell’AI generativa e il rilascio di Large Language Models come ChatGPT. L’opinione pubblica sembra aver preso improvvisamente coscienza della “fisicità” e del costo materiale della trasformazione digitale. Non si guarda più solo all’AI come soluzione per l’ambiente, ma si inizia a calcolarne il peso specifico in termini di consumo idrico per il raffreddamento dei data center e di emissioni di CO2 necessarie per l’addestramento dei modelli più complessi. Il dibattito si è spostato su dettagli disturbanti: persino la gentilezza ha un costo energetico.

È stato calcolato che digitare “per favore” o “grazie” a un chatbot, sebbene migliori il tono della risposta, comporta un consumo computazionale cumulativo di milioni di dollari l’anno. Ancora più allarmante è l’impronta idrica: una semplice conversazione di 20-50 prompt con un modello generativo può “bere” fino a mezzo litro d’acqua dolce necessaria per raffreddare i server.

E ancora, la letteratura documenta che l’addestramento di un singolo modello di grandi dimensioni può generare emissioni equivalenti all’impronta di carbonio dell’intera vita di cinque automobili. Questi dati, tra gli altri, hanno con ogni evidenza scosso la percezione comune sull’AI “miracolosa”. Siamo pertanto di fronte al paradosso tra “Red AI”, che privilegia la potenza computazionale a scapito delle risorse, e “Green AI”, che punta all’efficienza degli algoritmi. Questo dualismo rappresenta una tensione fondamentale: la capacità simultanea di risolvere problemi ambientali e di creare nuovi oneri ecologici.

La fragilità sociale: etica, bias e coesione democratica

Altrettanto complessa, sebbene con dinamiche diverse, è la traiettoria che caratterizza la sfera sociale. Sebbene l’AI venga spesso proposta dalle imprese come uno strumento potente per democratizzare l’accesso a servizi essenziali come la sanità e l’educazione, o per migliorare la sicurezza sul lavoro, l’analisi del dibattito pubblico evidenzia una persistente ambivalenza di fondo. Il sentiment in questo ambito appare strutturalmente fragile e soggetto a fluttuazioni che riflettono una profonda incertezza collettiva.

La nostra analisi ha identificato tre cluster statistici distinti, dove la dimensione sociale si posiziona in un territorio di “neutralità carica di tensione”, ben lontana dall’ottimismo riservato alla governance. Quando si isolano temi specifici della Corporate Digital Responsibility come l’etica, la privacy e i bias algoritmici, il quadro si fa ancora più cupo e il sentiment precipita in area nettamente negativa. Le analisi statistiche confermano che il cluster “AI Ethics” è un outlier critico, significativamente più negativo di tutte le altre categorie. Questo riflette le preoccupazioni delineate nella letteratura sul “capitalismo della sorveglianza“ e sui rischi inerenti alle quattro fasi del ciclo di vita della CDR: creazione, operazione, raffinamento e conservazione dei dati. A pesare sul giudizio pubblico non è solo il timore della sostituzione lavorativa, ma una preoccupazione più sottile legata alla salute mentale e alla coesione democratica.

L’AI promette connessione, ma rischia di esacerbare la solitudine umana attraverso interazioni simulate che non offrono vero conforto emotivo. Inoltre, l’uso di algoritmi nei social media e nella generazione di contenuti solleva spettri di manipolazione politica e polarizzazione, minacciando le fondamenta stesse del dibattito democratico. Questo “deficit sociale” suggerisce che le paure legate alla discriminazione algoritmica nelle assunzioni, alla sorveglianza digitale di massa e alla potenziale sostituzione della forza lavoro umana sono ancora lungi dall’essere risolte. Il rischio di dislocamento lavorativo e disoccupazione tecnologica, in particolare per mansioni a bassa e media qualificazione, continua a generare allarmi sulla coesione sociale a lungo termine. C’è, in tal senso, una frattura evidente tra la promessa di un’AI che “serve” l’umanità e il timore di un’AI che la controlla o la esclude.

Lo scudo della governance e il rischio del “machinewashing”

In netto contrasto con le crescenti preoccupazioni ambientali e le tensioni sociali, la dimensione della Governance si conferma, quasi inaspettatamente, come una roccaforte di ottimismo e stabilità. I dati mostrano un trend di sentiment costantemente positivo e in crescita nel tempo, che non sembra aver risentito delle recenti polemiche. In questo ambito, l’AI viene percepita e raccontata dai media come un potente alleato per la trasparenza, la compliance normativa e la lotta alla corruzione. Le applicazioni specifiche, come l’automazione delle procedure di conformità, il miglioramento dell’efficacia dei consigli di amministrazione e il supporto alla selezione dei direttori attraverso valutazioni basate sui dati, godono di una narrazione mediatica favorevole che vede la tecnologia come un antidoto all’opacità umana. Nel discorso manageriale l’algoritmo viene spesso rappresentato come un correttivo all’opacità umana, capace di analizzare grandi moli di dati per individuare anomalie, migliorare la tracciabilità delle supply chain e supportare i consigli di amministrazione nelle decisioni strategiche. L’AI appare qui come un alleato dell’integrità organizzativa. Tuttavia, anche questa dimensione non è esente da rischi. Il pericolo reale è quello di scivolare nel cosiddetto “machinewashing“, ovvero l’utilizzo di strumenti tecnologici avanzati per simulare una modernizzazione etica e una trasparenza che rimangono solo di facciata, prive di una sostanza reale. In altri termini, le imprese potrebbero promuovere iniziative di “Responsible AI” principalmente per scopi reputazionali senza implementare cambiamenti sostanziali. Se l’AI viene usata solo per segnalare virtù senza migliorare effettivamente i processi decisionali, il rischio è che anche questo pilastro di fiducia possa crollare repentinamente di fronte a evidenti fallimenti. Vi è poi un fenomeno emergente, che aggrava tale rischio, insito nella tanto pericolosa quanto insidiosa tendenza propria dei sistemi di AI generativa ad adulare l’utente umano con cui si interfacciano (AI sycophancy): i modelli di AI addestrati sul feedback umano concordano con le opinioni preesistenti dell’utente per compiacerlo, anche quando queste sono errate.

Implicazioni per le strategie aziendali: oltre l’approccio monolitico

Le differenze emerse tra ambiente, sociale e governance mostrano con chiarezza che la legittimità dell’Intelligenza Artificiale non è uniforme né scontata. L’AI non viene giudicata in modo compatto. La sua accettazione cambia a seconda degli ambiti in cui viene applicata e degli effetti che produce. Questo dato ha implicazioni molto concrete per manager e decisori aziendali. Non è più realistico adottare una strategia generica sull’AI e considerarla automaticamente coerente con l’agenda ESG. Serve una visione più articolata, capace di distinguere tra le diverse dimensioni della sostenibilità. Sul piano ambientale, ad esempio, non è più sufficiente rivendicare l’efficienza garantita dagli algoritmi. La crescente attenzione pubblica ai consumi energetici dei data center e all’impronta carbonica dei modelli generativi impone alle imprese maggiore trasparenza. Parlare di innovazione verde senza misurare l’impatto dell’infrastruttura digitale rischia di apparire come una semplificazione poco credibile. La dimensione sociale richiede uno sforzo ancora più delicato. Le questioni legate ai bias algoritmici, alla protezione dei dati e all’impatto sul lavoro non possono essere liquidate con formule di principio.

La responsabilità digitale deve tradursi in pratiche concrete, in controlli indipendenti e in percorsi di aggiornamento professionale che valorizzino le competenze umane, non le rendano marginali. Anche sul versante della governance, dove il sentiment rimane positivo, è necessario evitare automatismi. L’AI può certamente rafforzare la compliance e la capacità di controllo, ma non può sostituire il giudizio umano nelle decisioni più sensibili. La fiducia si costruisce quando la tecnologia è integrata in processi trasparenti e verificabili, non quando viene utilizzata come semplice simbolo di modernizzazione.

La sfida vera: dimostrare che l’AI è coerente con lo sviluppo sostenibile

In definitiva, l’evoluzione del sentiment pubblico mostra che la legittimità dell’AI non è un capitale acquisito, ma un equilibrio fragile tra efficienza tecnologica, sostenibilità materiale e accettabilità sociale. La governance può oggi rappresentare un’area di fiducia, ma non è sufficiente a compensare le tensioni ambientali ed etiche che stanno emergendo con crescente chiarezza. Per le imprese la sfida non consiste semplicemente nell’adottare l’intelligenza artificiale, bensì nel dimostrare che la sua integrazione è coerente con una visione di sviluppo sostenibile che tenga insieme innovazione, responsabilità e trasparenza.