AI Act: finalmente ci siamo. Il primo agosto 2024 è entrata ufficialmente in vigore la prima legge trasversale al mondo sull’intelligenza artificiale.

E dopo le prime norme diventate applicabili a partire dal 2 febbraio 2025, la Commissione europea ha pubblicato anche la versione finale del Code of Practice sull’IA per finalità generali.

Un tassello estremamente importante in vista dell’applicazione, a partire dal 2 agosto 2025, degli obblighi previsti dall’AI Act per i fornitori di modelli di IA per finalità generali.

Indice degli argomenti

Definizione di Ai Act: cos’è e quali sono i suoi obiettivi*

Per coglierne l’importanza è bene riassumere i punti fondamentali.

Cos’è l’Ai Act

L’Ai Act è una proposta di regolamento presentata dalla Commissione Europea il 21 aprile 2021, con l’obiettivo di creare un quadro normativo armonizzato e proporzionato per l’intelligenza artificiale (IA) nell’Unione Europea.

L’Ai Act si basa sul principio che l’IA deve essere sviluppata e utilizzata in modo sicuro, etico e rispettoso dei diritti fondamentali e dei valori europei. Per questo motivo, la proposta prevede una classificazione dei sistemi di IA in base al loro livello di rischio per la sicurezza e i diritti delle persone, e stabilisce una serie di requisiti e obblighi per i fornitori e gli utenti di tali sistemi.

L’Ai Act è parte integrante della strategia digitale dell’UE, che mira a promuovere l’innovazione e la competitività nel settore dell’IA, garantendo al contempo la protezione dei consumatori, dei lavoratori e dei cittadini.

Quali sono gli obiettivi dell’Ai Act

L’Ai Act si propone di raggiungere i seguenti obiettivi principali:

- Creare un mercato unico per l’IA, facilitando la libera circolazione e il riconoscimento dei sistemi di IA conformi alle norme dell’UE.

- Aumentare la fiducia nell’IA, assicurando che i sistemi di IA siano affidabili, trasparenti e responsabili, e che rispettino i principi etici e i diritti fondamentali.

- Prevenire e mitigare i rischi dell’IA, vietando o limitando l’uso di sistemi di IA che presentano un rischio inaccettabile per la sicurezza, la salute, la dignità o l’autonomia delle persone, o che violano i valori democratici.

- Sostenere l’innovazione e l’eccellenza nell’IA, fornendo incentivi, finanziamenti e orientamenti per lo sviluppo e il dispiegamento di sistemi di IA sicuri ed etici, e promuovendo la cooperazione e il coordinamento tra gli Stati membri, le istituzioni e le parti interessate.

Sistemi di intelligenza artificiale: una regolamentazione basata sul rischio

L’intelligenza artificiale può trasformare profondamente la società e l’economia, con benefici potenziali per la società e l’economia. Allo stesso tempo, l’IA può anche presentare dei rischi per i diritti, la sicurezza e il buon funzionamento del mercato unico. Per trovare un equilibrio tra le due istanze – accompagnare l’Europa nell’adozione dell’IA e dei suoi benefici e farlo per l’interesse generale – l’AI Act è stato pensato con un approccio basato sul rischio.

Il quadro normativo sull’IA prevede quindi una classificazione dei sistemi di IA in base al livello di rischio che presentano per le persone e per la società. Il quadro distingue tra quattro categorie di rischio: inaccettabile, alto, limitato e minimo.

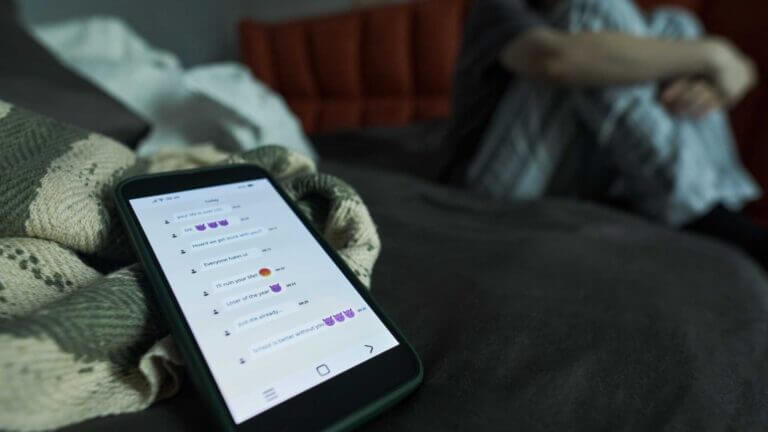

- – I sistemi di IA che presentano un rischio inaccettabile sono quelli che contraddicono i valori e i principi fondamentali dell’UE, come il rispetto della dignità umana, della democrazia e dello stato di diritto. Questi sistemi sono vietati o (nel caso della sorveglianza biometrica in tempo reale per motivi di sicurezza) soggetti a severe restrizioni. Ad esempio, sono proibiti i sistemi di IA che manipolano il comportamento umano in modo da eludere la volontà degli utenti, o che consentono lo “scoring sociale” da parte delle autorità pubbliche.

- – I sistemi di IA che presentano un rischio elevato sono quelli che possono avere un impatto “sistemico”, ossia significativo sui diritti fondamentali o sulla sicurezza delle persone. Questi sistemi sono soggetti a rigorosi obblighi e requisiti prima di poter essere immessi sul mercato o utilizzati. Ad esempio, rientrano in questa categoria i sistemi di IA utilizzati per la selezione e il reclutamento del personale, per l’ammissione all’istruzione, per l’erogazione di servizi sociali essenziali, come la Sanità, per la sorveglianza biometrica a distanza (non in tempo reale), per le applicazioni giudiziarie e di polizia, o per la gestione della sicurezza critica delle infrastrutture. Sono ad alto rischio in automatico i sistemi di intelligenza artificiale generativa dotati di potenza di calcolo superiore a 10^25 Flop.

- – I sistemi di IA che presentano un rischio limitato sono quelli che possono influenzare i diritti o le volontà degli utenti, ma in misura minore rispetto ai sistemi ad alto rischio. Questi sistemi sono soggetti a requisiti di trasparenza, che consentono agli utenti di essere consapevoli del fatto che interagiscono con un sistema di IA e di comprenderne le caratteristiche e le limitazioni. Ad esempio, rientrano in questa categoria i sistemi di IA utilizzati per generare o manipolare contenuti audiovisivi (come i deepfake), o per fornire suggerimenti personalizzati (come le chatbot). C’è il diritto a sapere di stare parlando con un bot (invece di un umano) e che quell’immagine è creata o artefatta dall’IA.

- – I sistemi di IA che presentano un rischio minimo o nullo sono quelli che non hanno alcun impatto diretto sui diritti fondamentali o sulla sicurezza delle persone, e che offrono ampi margini di scelta e controllo agli utenti. Questi sistemi sono liberi da qualsiasi obbligo normativo, al fine di incoraggiare l’innovazione e l’esperimentazione. Ad esempio, rientrano in questa categoria i sistemi di IA utilizzati per scopi ludici (come i videogiochi) o per scopi puramente estetici (come i filtri fotografici).

Obblighi e requisiti: per sviluppatori e utilizzatori di sistemi di IA

Gli obblighi cambiano a seconda del tipo di rischio, come si diceva.

I sistemi di IA ad alto rischio devono soddisfare una serie di obblighi e requisiti prima di essere immessi sul mercato o utilizzati. Questi riguardano, tra gli altri, la qualità dei dati, la documentazione tecnica, l’informazione agli utenti, la supervisione umana, la robustezza, la sicurezza e la precisione.

Non solo: gli sviluppatori e gli utilizzatori di tali sistemi sono tenuti a condurre una valutazione del rischio e a stabilire un sistema di gestione della qualità. La conformità ai requisiti sarà verificata da organismi indipendenti, che avranno il potere di rilasciare certificati o di ritirare quelli già emessi.

Gli sviluppatori e gli utilizzatori di sistemi di IA ad alto rischio saranno anche soggetti a obblighi di registrazione, tracciabilità e segnalazione.

I sistemi di IA a rischio limitato devono rispettare i requisiti di trasparenza, che implicano l’obbligo di comunicare agli utenti che stanno interagendo con un sistema di IA e di fornire loro informazioni pertinenti sulle sue caratteristiche e limitazioni. Questo consentirà agli utenti di esercitare il loro diritto di scegliere se affidarsi o meno al sistema di IA e di capire le possibili conseguenze delle loro scelte. Gli sviluppatori e gli utilizzatori di tali sistemi dovranno anche garantire che le informazioni fornite siano chiare, comprensibili e accessibili.

I sistemi di IA a rischio minimo o nullo non sono soggetti a nessun obbligo normativo specifico, ma devono comunque rispettare le leggi e i regolamenti generali applicabili all’IA, come quelli relativi alla protezione dei dati personali, alla concorrenza, alla responsabilità civile o ai diritti dei consumatori.

Impatto sull’innovazione: come l’Ai Act favorisce lo sviluppo responsabile dell’IA

L’Ai Act ha l’obiettivo di promuovere lo sviluppo responsabile e sostenibile dell’IA nell’Unione europea, in linea con i valori e i principi fondamentali dell’UE. Per raggiungere questo scopo, l’Ai Act prevede diverse misure di sostegno all’innovazione, tra cui:

- – La creazione di un quadro normativo armonizzato e proporzionato per l’IA, che riduca la frammentazione del mercato interno, aumenti la fiducia degli utenti e degli investitori, e favorisca la competitività globale dell’UE nel settore dell’IA.

- – Il sostegno alla ricerca e all’innovazione nell’ambito dell’IA, attraverso il finanziamento di progetti e iniziative che si concentrino sulla qualità, l’impatto sociale, l’interdisciplinarità e la collaborazione transnazionale. In particolare, l’Ai Act mira a incentivare lo sviluppo di un’IA di eccellenza, centrata sull’essere umano e rispettosa dei diritti fondamentali.

- – La diffusione delle migliori pratiche e delle conoscenze sull’IA, mediante la creazione di centri di competenza, di test e di innovazione, che forniscano servizi di supporto, formazione, consulenza e orientamento agli sviluppatori e agli utilizzatori di sistemi di IA, in particolare alle piccole e medie imprese e alle amministrazioni pubbliche.

- – L’istituzione di un comitato europeo per l’IA, composto da esperti indipendenti, che avrà il compito di assistere la Commissione europea e gli Stati membri nell’implementazione e nell’aggiornamento dell’Ai Act, nonché di formulare raccomandazioni e pareri sull’evoluzione e le sfide dell’IA.

Tutela dei diritti: come l’Ai Act garantisce la sicurezza e l’eticità dell’IA

L’Ai Act ha la finalità di garantire la sicurezza e l’eticità dell’IA, proteggendo i diritti e gli interessi delle persone e delle organizzazioni che ne sono interessate. Per conseguire questo obiettivo, l’Ai Act prevede diverse misure di tutela dei diritti, tra cui:

- – La definizione di una serie di requisiti e obblighi per i sistemi di IA ad alto rischio, che assicurino il rispetto dei diritti fondamentali, come il diritto alla dignità, alla non discriminazione, alla privacy, alla protezione dei dati, alla libertà di espressione e di informazione, al processo equo e alla presunzione di innocenza.

- – La previsione di meccanismi di supervisione umana adeguati ed efficaci, che permettano alle persone di monitorare, controllare e intervenire sui sistemi di IA, al fine di prevenire o correggere eventuali effetti negativi o dannosi sull’essere umano o sull’ambiente.

- – L’introduzione di un divieto o di una restrizione per i sistemi di IA che presentano un rischio inaccettabile, cioè che violano in modo flagrante i valori e i principi fondamentali dell’UE, come i sistemi di IA che manipolano il comportamento umano, le opinioni o le decisioni, o che sfruttano le vulnerabilità delle persone.

- – L’istituzione di un sistema di governance efficace e armonizzato per l’IA, che coinvolga tutte le parti interessate, tra cui le autorità nazionali competenti, la Commissione europea, il comitato europeo per l’IA, gli organismi di certificazione, i fornitori e gli utenti di sistemi di IA, e la società civile. Questo sistema prevede la cooperazione, il coordinamento, il monitoraggio, la revisione, l’informazione, la consulenza, l’ispezione, l’azione correttiva e sanzionatoria.

- – La promozione di una cultura dell’IA responsabile e consapevole, che incoraggi la partecipazione, il dialogo, la trasparenza, la responsabilità e l’educazione degli sviluppatori, degli utilizzatori e dei cittadini di sistemi di IA, al fine di rafforzare la fiducia, il rispetto e l’accettazione sociale dell’IA.

Sanzioni ed entrata in vigore

Gli obblighi e le relative sanzioni scattano dopo un certo periodo dalla data di pubblicazione dell’AI in Gazzetta Ufficiale:

| CHE COSA | DOPO QUANDO |

| divieti di pratiche vietate | 6 mesi |

| codici di condotta | 9 mesi |

| norme generali sull’IA, compresa la governance | 12 mesi |

| obblighi per i sistemi ad alto rischio | 24-36 mesi |

L’Ai Act prevede un sistema di sanzioni in caso di violazione delle disposizioni previste. Le sanzioni possono variare a seconda della gravità e della natura dell’infrazione, e sono proporzionate alla dimensione e al fatturato dell’operatore economico responsabile. Le sanzioni possono includere:

- – Avvertimenti o diffide da parte delle autorità nazionali competenti, con la possibilità di adottare misure correttive

- Fino a 35 milioni di euro o al 7% del fatturato totale annuo a livello mondiale dell’esercizio finanziario precedente (a seconda di quale sia il valore più alto) per le violazioni relative alle pratiche vietate o alla non conformità ai requisiti sui dati;

- Fino a 15 milioni di euro o al 3% del fatturato totale annuo a livello mondiale dell’esercizio finanziario precedente per la mancata osservanza di uno qualsiasi degli altri requisiti o obblighi del regolamento, compresa la violazione delle norme sui modelli di IA per uso generale;

- fino a 7,5 milioni di euro o all’1,5% del fatturato mondiale annuo totale dell’esercizio precedente per la fornitura di informazioni inesatte, incomplete o fuorvianti agli organismi notificati e alle autorità nazionali competenti in risposta a una richiesta

Le sanzioni possono essere imposte dalle autorità nazionali competenti, che sono tenute a cooperare tra loro e con la Commissione europea, attraverso il Comitato europeo per l’intelligenza artificiale.

Gli Stati membri devono garantire che le persone colpite da una violazione dei diritti fondamentali a causa dell’uso dell’intelligenza artificiale abbiano accesso a vie di ricorso effettive e giusti rimedi. L’Ai Act si propone quindi di assicurare che chi opera nel settore dell’intelligenza artificiale sia soggetto a regole chiare e vincolanti, e che chi ne subisce le conseguenze negative possa ottenere giustizia e riparazione.

Approvazione dell’AI Act: un traguardo importante per l’Europa

Un traguardo importante, si diceva, raggiunto dopo diversi anni di lavoro delle istituzioni europee, alla ricerca del giusto equilibrio tra protezione dei diritti e delle libertà fondamentali e sostegno all’innovazione.

| Aprile 2021 | La Commissione Europea ha presentato la proposta per l’AI Act |

| Dicembre 2022 | Il Consiglio dell’Unione Europea ha adottato la sua posizione sul testo dell’AI Act |

| Giugno 2023 | Il Parlamento Europeo ha approvato la sua posizione sull’AI Act |

| Dicembre 2023 | È stato raggiunto un accordo politico sul testo finale dell’AI Act tra Commissione, Consiglio e Parlamento |

| Dicembre 2023 | L’AI Act è stato approvato dal Parlamento Europeo |

| Febbraio 2024 | L’AI Act è stato approvato anche dal Consiglio dell’Unione Europea |

| 13 marzo 2024 | Il Parlamento Europeo ha definitivamente approvato l’AI Act, completando l’iter legislativo |

| Primavera 2024 | Via libera finale dal consiglio UE |

| Estate 2024 | Uscita in Gazzetta Ufficiale |

Esattamente come avvenuto all’epoca del GDPR, anche rispetto all’AI Act l’adeguamento preventivo e spontaneo sarà certamente fondamentale, tenendo conto che le norme del nuovo regolamento europeo entreranno in applicazione in momenti diversi (e in particolare dopo sei, dodici, ventiquattro e trentasei mesi).

Da qui l’idea di dare il via a una rubrica di approfondimento sui contenuti e gli impatti di questa nuova legge. L’obiettivo? Fornire a imprese, enti pubblici e professionisti una prima bussola per avvicinarsi a un regolamento dagli effetti innovativi e dirompenti.

La definizione di “sistema di IA” secondo l’AI Act

Pietra angolare dell’AI Act è innanzitutto la definizione di intelligenza artificiale adottata nel testo di legge. Si tratta di uno dei punti più discussi e divisivi nel corso dell’iter legislativo, a riprova della sua rilevante portata. È infatti scontato che tracciando i confini di questo concetto si determina cosa sia incluso nel perimetro della legge e cosa invece no.

Non potendo qui ripercorrere tutto il viaggio interistituzionale che ha interessato questo aspetto nodale della legge, possiamo richiamare il punto di partenza e quello di arrivo. Nella proposta della Commissione UE, la definizione di «sistema di IA» veniva impostata in modo flessibile e adeguabile, rimandando a tal fine a un allegato contenente un elenco di approcci e tecniche per lo sviluppo dell’IA. Tale soluzione è stata successivamente superata, e oggi l’AI Act – seguendo la proposta definitoria dell’OCSE – definisce il proprio oggetto come “un sistema automatizzato progettato per funzionare con diversi livelli di autonomia e che può mostrare capacità di adattamento dopo l’installazione e che, per obiettivi espliciti o impliciti, deduce, dagli input che riceve, come generare output quali previsioni, contenuti, raccomandazioni o decisioni che possono influenzare ambienti fisici o virtuali” (articolo 3).

Sarà dunque fondamentale comprendere tutte le sfumature tecniche e giuridiche di questa concettualizzazione, poiché essa rappresenta la prima porta di accesso al sistema di requisiti e obblighi posti dal regolamento europeo, con i relativi livelli di responsabilità. Ciò potrà essere fatto anche attraverso le linee guida che verranno adottate dalla Commissione europea proprio in relazione a tale definizione.

Chi sarà coinvolto dall’applicazione dell’AI Act

La seconda porta di accesso all’AI Act è l’articolo 2, dove viene definito e circoscritto l’ambito di applicazione del regolamento, identificando con ciò anche i diversi soggetti interessati all’adeguamento.

Le nuove regole – tese a governare l’immissione sul mercato, la messa in servizio e l’uso dei sistemi di IA nell’UE (articolo 1) – si applicheranno innanzitutto ai «fornitori» dei sistemi di intelligenza artificiale (sia pubblici che privati) che immettono sul mercato o mettono in servizio sistemi di IA nell’UE, indipendentemente da dove i fornitori stessi siano stabiliti, e a quelli situati in un paese terzo, laddove l’output prodotto dal sistema di IA sia utilizzato in Europa. Dovranno inoltre rispettare le norme dell’AI Act gli «operatori» che hanno sede o sono situati nell’UE e quelli situati in un paese terzo, sempre ove l’output prodotto dal sistema di intelligenza artificiale venga utilizzato in Europa. E’ questa una previsione analoga rispetto a quella del GDPR, che ha prodotto quell’effetto di applicazione globale del Regolamento sulla circolazione e protezione dei dati che ben conosciamo.

Il legislatore europeo intende cosi duplicare il successo del GDPR e porre al centro dei mercati mondiali le proprie innovative e sfidanti regole sull’AI. Il regolamento si applicherà altresì agli altri componenti della catena di valore dell’IA, quali importatori, distributori, fabbricanti e rappresentanti autorizzati.

A ognuno di questi soggetti l’articolo 3 riserva una specifica definizione. E così, ad esempio, viene qualificato come «fornitore» ogni persona fisica o giuridica, autorità pubblica, agenzia o altro organismo che sviluppa un sistema di IA o che lo fa sviluppare al fine di immetterlo sul mercato o metterlo in servizio con il proprio nome o marchio, a titolo oneroso o gratuito, mentre sarà considerato un «operatore» qualsiasi soggetto tra quelli elencati sopra che utilizza un sistema di IA sotto la propria autorità, tranne nel caso in cui il sistema di intelligenza artificiale sia utilizzato nel corso di un’attività personale non professionale.

Ambiti di applicazione dell’AI Act: le eccezioni previste

Lo stesso articolo 2 elenca gli ambiti esclusi dal perimetro dell’AI Act (e anche su alcune di queste eccezioni si è discusso molto negli ultimi mesi). Fatti salvi i settori che non rientrano nell’ambito di applicazione del diritto europeo, il regolamento non si applicherà ai sistemi di IA per scopi militari, di difesa o di sicurezza nazionale, a quelli per scopi di ricerca e sviluppo scientifico, o a quelli rilasciati con licenze free e open source (salvo sussista un rischio).

Esclusa dall’ambito di applicazione delle nuove norme anche l’attività di ricerca, prova e sviluppo relative a sistemi di intelligenza artificiale. È inoltre presente una household exemption applicabile agli operatori persone fisiche che utilizzano sistemi di AI durante un’attività non professionale puramente personale, anche qui viene ripreso un principio ed un meccanismo analogo a quello previsto dal GDPR.

Il codice di buone pratiche per i GPAI

Nell’attesa che tutte le disposizioni dell’AI Act diventino pienamente applicabili, il 10 luglio 2025 la Commissione europea ha pubblicato la versione finale del General-Purpose AI Code of Practice.

Si tratta di uno strumento giuridico ad adozione volontaria, elaborato in applicazione dell’AI Act da un gruppo di esperti indipendenti nell’ambito di un processo multi-stakeholder avviato a luglio 2024 e che ha coinvolto oltre 1400 partecipanti provenienti da industria, accademia, società civile e altri centri di interesse.

L’obiettivo di questo codice è quello di aiutare l’industria dei grandi modelli di intelligenza artificiale a rispettare i nuovi obblighi previsti dall’AI Act per i fornitori di modelli di IA per finalità generali (GPAI), applicabili a partire dal 2 agosto 2025.

All’interno di questo strumento di soft regulation – che ricorda e ci si augura possa replicare la fortunata esperienza dei codici di condotta adottati ai sensi del Regolamento Generale sulla Protezione dei Dati (GDPR) – sono descritte le modalità con cui i fornitori di questi grandi modelli di intelligenza artificiale possono dimostrare la conformità ai propri obblighi ai sensi della legge europea sull’IA.

Il codice, che non introduce nuovi obblighi da rispettare per gli aderenti, è composto da tre sezioni, ognuna dedicata a un’importante area di adempimenti previsti dall’AI Act per i fornitori di GPAI: la trasparenza, il diritto d’autore e la sicurezza. Il codice di buone pratiche fornisce quindi modelli e soluzioni per adempiere concretamente e correttamente agli obblighi dettati dal regolamento europeo.

Potranno beneficiare del regime di conformità semplificato previsto dal codice di buone pratiche – che dovrà ora essere approvato dagli Stati membri e dalla Commissione europea – tutti i fornitori di GPAI che decideranno di aderirvi. Si viene così a rafforzare il senso di responsabilizzazione degli operatori della catena di valore dell’IA.

Prime considerazioni sull’impatto dell’AI Act

Il pacchetto di norme messo insieme dal legislatore europeo è sicuramente ambizioso, e non a caso si tratta del primo progetto di legge trasversale sull’IA che vedrà la luce a livello mondiale. Il fatto di essere i primi ha sicuramente un peso e un’importanza, permettendo di definire a livello internazionale uno standard di riferimento per gli altri paesi (e in molti stanno già seguendo l’approccio europeo).

Il Brussels effect dell’AI Act: influenze a livello globale

Il vero valore del cosiddetto Brussels effect non sta tuttavia nel mero effetto emulativo. E la storia del GDPR ce lo insegna. La portata di queste norme e il relativo significato sul piano internazionale risiedono nel complesso e radicato sistema di protezione dei diritti fondamentali e di visione umanocentrica che sta a monte delle norme europee sulla data economy e che permea il sistema di regole a valle. E allora ecco che grazie al Brussels effect il riconoscimento di questi valori, e l’equilibrio identificato dal legislatore con le istanze di sostegno all’innovazione, rappresentano il vero prodotto di esportazione normativa dell’UE, prodotto e portato della nostra tradizione costituzionale.

Conclusioni

Dobbiamo essere tutti molto orgogliosi di questo traguardo importante. La legge non è la migliore possibile e, per certi versi, il GDPR ha avuto più coraggio. Ma dissento fortemente da chi considera patetico e di retroguardia l’atteggiamento dell’Unione Europea in tema di AI, che è invece coraggioso, ambizioso, innovativo ed estremamente tempestivo, mentre il resto del mondo, per ora, resta a guardare.

*Capitolo a cura della redazione

FAQ: ai act

Cos’è l’AI Act e quali sono i suoi obiettivi principali?

L’AI Act è il primo corpus normativo organico a livello mondiale che disciplina l’intelligenza artificiale, entrato ufficialmente in vigore il 1° agosto 2024. Si tratta di un regolamento presentato dalla Commissione Europea nel 2021 con l’obiettivo di creare un quadro normativo armonizzato per l’IA nell’Unione Europea. I suoi obiettivi principali sono garantire che l’IA sia sviluppata e utilizzata in modo sicuro, etico e rispettoso dei diritti fondamentali, promuovere l’innovazione e la competitività nel settore, assicurando al contempo la protezione dei consumatori, dei lavoratori e dei cittadini. L’AI Act si basa su un approccio basato sul rischio, classificando i sistemi di IA in base al livello di rischio che presentano per le persone e la società.

Come classifica l’AI Act i sistemi di intelligenza artificiale in base al rischio?

L’AI Act classifica i sistemi di IA in quattro categorie di rischio, con obblighi differenziati per ciascuna:

1. Rischio inaccettabile: sistemi proibiti come il social scoring, le tecniche subliminali finalizzate a condizionare il comportamento, il riconoscimento biometrico in tempo reale negli spazi pubblici e la classificazione automatica di caratteristiche sensibili.

2. Alto rischio: sistemi che impattano su diritti, sicurezza o condizioni di vita, come quelli usati per selezione del personale, valutazione delle prestazioni, accesso a servizi essenziali o identificazione biometrica. Questi devono rispettare requisiti stringenti su qualità dei dati, documentazione tecnica, supervisione umana e sicurezza.

3. Rischio limitato: sistemi soggetti a obblighi di trasparenza, come chatbot o generatori di contenuti, che devono informare gli utenti della loro natura artificiale.

4. Rischio minimo o nullo: sistemi non soggetti a obblighi specifici dell’AI Act, ma comunque tenuti a rispettare le leggi generali applicabili come quelle sulla protezione dei dati o sui diritti dei consumatori.

Quali sono le principali scadenze e tempistiche di applicazione dell’AI Act?

L’AI Act prevede un’applicazione graduale delle sue disposizioni:

– 1° agosto 2024: entrata in vigore ufficiale del regolamento

– 2 febbraio 2025: applicazione dei divieti relativi ai sistemi proibiti (rischio inaccettabile) e obbligo di AI literacy

– 2 agosto 2025: entrata in vigore delle regole sui modelli GPAI (General Purpose AI), governance istituzionale e regime sanzionatorio

Per i sistemi ad alto rischio, la timeline è attualmente in discussione con il Digital Omnibus che propone un rinvio condizionato: gli obblighi high-risk non scatterebbero più a data fissa, ma sei o dodici mesi dopo la conferma di “misure adeguate a supporto della conformità”. Le date limite invalicabili sarebbero il 2 dicembre 2027 per i sistemi dell’Allegato III e il 2 agosto 2028 per quelli dell’Allegato I. Questa modifica è motivata dal ritardo negli standard del CEN-CENELEC e nella designazione delle autorità competenti da parte degli Stati membri.

Quali sono gli obblighi per le aziende che utilizzano sistemi di IA ad alto rischio?

Le aziende che utilizzano sistemi di IA ad alto rischio devono rispettare diversi obblighi previsti principalmente dall’articolo 26 dell’AI Act:

1. Utilizzare il sistema in conformità alle istruzioni del fornitore e adottare misure tecniche e organizzative adeguate

2. Garantire supervisione umana con personale competente e formato in grado di monitorare il sistema e intervenire in caso di anomalie

3. Assicurare che i dati di input siano pertinenti, rappresentativi e privi di pregiudizi

4. Monitorare costantemente il funzionamento del sistema e interromperne l’uso in caso di rischi

5. Mantenere tracciabilità conservando i registri di funzionamento (log) per almeno sei mesi

6. Informare preventivamente lavoratori e rappresentanze sindacali prima dell’adozione di sistemi che possano incidere sul rapporto di lavoro

7. Condurre una Valutazione d’impatto sui diritti fondamentali (FRIA) in determinati casi

Le sanzioni per violazioni possono arrivare fino a 35 milioni di euro o al 7% del fatturato annuo globale, rendendo essenziale un approccio strutturato alla governance, fondato su trasparenza, responsabilità e tutela dei diritti.

Quali pratiche di IA sono vietate secondo l’AI Act?

L’AI Act vieta espressamente alcune pratiche di intelligenza artificiale considerate a rischio inaccettabile, che saranno proibite sei mesi dopo l’entrata in vigore del regolamento (dal 2 febbraio 2025):

1. Sistemi di social scoring che valutano le persone sulla base del loro comportamento sociale

2. Tecniche di manipolazione subliminale finalizzate a condizionare il comportamento delle persone

3. Riconoscimento biometrico in tempo reale negli spazi pubblici (con limitate eccezioni per motivi di sicurezza)

4. Classificazione automatica di caratteristiche sensibili come etnia, convinzioni religiose o orientamento politico

5. Sistemi che sfruttano vulnerabilità specifiche di gruppi di persone dovute all’età o alla disabilità

6. Sistemi di polizia predittiva basati sulla profilazione

Le aziende devono verificare che i sistemi in uso non rientrino tra queste tecnologie proibite. Le sanzioni per l’utilizzo consapevole di sistemi vietati sono particolarmente severe, con aggravanti specifiche previste dal regime sanzionatorio.

Cosa prevede l’AI Act per i modelli di IA per finalità generali (GPAI)?

L’AI Act dedica particolare attenzione ai modelli di IA per finalità generali (GPAI), come ChatGPT, Claude o Gemini, con regole specifiche applicabili dal 2 agosto 2025. I fornitori di questi modelli devono:

1. Garantire trasparenza sui dati di addestramento e sul funzionamento del modello

2. Rispettare il diritto d’autore sui contenuti utilizzati per l’addestramento

3. Implementare misure di sicurezza contro potenziali abusi o rischi sistemici

4. Etichettare chiaramente i contenuti generati artificialmente

Per facilitare l’adeguamento, la Commissione europea ha pubblicato il 10 luglio 2025 la versione finale del General-Purpose AI Code of Practice, uno strumento giuridico ad adozione volontaria che fornisce modelli e soluzioni per adempiere concretamente agli obblighi. Le aziende che aderiscono a questo codice possono beneficiare di un regime di conformità semplificato, rafforzando il senso di responsabilizzazione degli operatori della catena di valore dell’IA.

Quali sono gli obblighi di trasparenza previsti dall’AI Act?

L’AI Act prevede importanti obblighi di trasparenza, in particolare per i sistemi a rischio limitato, che si applicano dal 2 agosto 2026 (con alcune eccezioni):

1. Informare gli utenti quando stanno interagendo con un sistema di IA (come chatbot o assistenti virtuali)

2. Rendere evidente se un contenuto (testo, immagine, audio o video) è stato generato o manipolato artificialmente

3. Etichettare chiaramente i deepfake e altri contenuti sintetici

4. Fornire informazioni pertinenti sulle caratteristiche e limitazioni del sistema di IA

Per i sistemi ad alto rischio, gli obblighi di trasparenza sono ancora più stringenti e includono la necessità di fornire documentazione tecnica dettagliata, istruzioni per l’uso comprensibili e informazioni sul funzionamento del sistema. Nel contesto lavorativo, è obbligatorio informare preventivamente i lavoratori e le rappresentanze sindacali prima dell’adozione di sistemi di IA che possano incidere sul rapporto di lavoro, descrivendo le caratteristiche, finalità e impatti potenziali del sistema.

Come si integra l’AI Act con il GDPR e altre normative europee sulla protezione dei dati?

L’AI Act si integra con il GDPR e altre normative europee creando un ecosistema normativo coerente per la governance digitale. Alcuni punti chiave di questa integrazione:

1. La Valutazione d’impatto sui diritti fondamentali (FRIA) prevista dall’AI Act è analoga alla Valutazione d’impatto sulla protezione dei dati (DPIA) del GDPR. Se un ente ha già fatto la DPIA per un sistema di IA ad alto rischio, può recepirla nella FRIA.

2. Gli obblighi di trasparenza dell’AI Act si aggiungono a quelli informativi del GDPR (articoli 13 e 14), richiedendo di informare gli interessati non solo sul trattamento dei dati ma anche sull’uso di sistemi di IA.

3. Per decisioni automatizzate, si applicano sia l’art. 22 del GDPR (diritto alla revisione umana) sia i requisiti di supervisione umana dell’AI Act.

4. Come il GDPR, l’AI Act adotta un principio di extraterritorialità, applicandosi a fornitori e operatori situati fuori dall’UE quando l’output del sistema viene utilizzato in Europa, replicando il Brussels Effect che ha reso il GDPR uno standard globale.

Quali sono le sanzioni previste per le violazioni dell’AI Act?

L’AI Act prevede un sistema di sanzioni particolarmente severo per le violazioni, applicabile dal 2 agosto 2025:

– Per violazioni dei divieti o dei requisiti relativi ai dati: fino a 35 milioni di euro o il 7% del fatturato annuo globale dell’azienda, a seconda di quale importo sia maggiore

– Per la fornitura di informazioni inesatte, incomplete o fuorvianti agli organismi notificati o alle autorità nazionali competenti: fino a 15 milioni di euro o il 3% del fatturato annuo globale

– Per altre violazioni: fino a 7,5 milioni di euro o l’1,5% del fatturato annuo globale

Sono previste aggravanti per l’utilizzo consapevole di sistemi vietati o per la mancata adozione di misure correttive. Le sanzioni possono essere imposte dalle autorità nazionali competenti, che cooperano tra loro e con la Commissione europea attraverso il Comitato europeo per l’intelligenza artificiale. Gli Stati membri devono garantire che le persone colpite da violazioni abbiano accesso a vie di ricorso effettive e giusti rimedi.

Come dovrebbero organizzarsi le aziende per essere conformi all’AI Act?

Per essere conformi all’AI Act, le aziende dovrebbero adottare un approccio strutturato:

1. Creare un inventario di tutti i sistemi di IA in uso, sviluppo o acquisizione, classificandoli per ruolo (provider, deployer, importatore) e livello di rischio

2. Implementare una governance integrata che intersechi GDPR, NIS2, Cyber Resilience Act e altre normative correlate

3. Adottare un approccio “design for compliance” per i nuovi progetti di IA, integrando fin dall’inizio requisiti come tracciabilità e supervisione umana

4. Definire ruoli e responsabilità chiare, considerando figure come Chief AI Officer (CAIO), Responsible AI Officer (RAIO), o un Comitato AI

5. Garantire la formazione del personale sull’IA (AI literacy), come richiesto dal regolamento

6. Predisporre sistemi di monitoraggio e documentazione per dimostrare la conformità

Non è necessario creare intere nuove strutture, ma è fondamentale sviluppare competenze e integrare le funzioni esistenti (compliance, legale, IT, DPO) in un modello organizzativo strutturato che garantisca trasparenza, responsabilità e tutela dei diritti.

Quali sono gli obblighi specifici per Regioni ed enti locali che utilizzano sistemi di IA?

Regioni ed enti locali che utilizzano sistemi di IA sono soggetti a obblighi specifici, soprattutto se impiegano sistemi ad alto rischio come quelli per l’accesso ai servizi pubblici, la valutazione dell’idoneità a ricevere assistenza pubblica, o la gestione delle risorse:

1. Devono registrarsi nella banca dati UE prima di mettere in servizio un sistema ad alto rischio, selezionando il sistema prescelto e attestandone l’uso

2. Sono tenuti a effettuare una Valutazione d’impatto sui diritti fondamentali (FRIA) prima del primo utilizzo di un sistema ad alto rischio

3. Devono garantire supervisione umana, con personale competente in grado di monitorare il sistema e intervenire in caso di anomalie

4. Sono responsabili del monitoraggio del sistema e dell’interruzione del suo uso in caso di rischi per la sicurezza o i diritti fondamentali

5. Devono mantenere registri di funzionamento (log) per almeno sei mesi

Se apportano modifiche sostanziali a un sistema già in uso, gli enti pubblici possono essere considerati essi stessi fornitori, con tutti gli obblighi conseguenti. La Commissione UE ha pubblicato Clausole Contrattuali Modello non vincolanti (MCC-AI) che possono essere utilizzate negli appalti pubblici di sistemi di intelligenza artificiale.

Cosa prevede la Legge italiana 132/2025 in relazione all’AI Act?

La Legge 132/2025, entrata in vigore il 10 ottobre 2025, si innesta sull’AI Act europeo e ne traduce i principi in ambito nazionale, con particolare attenzione al settore sanitario:

1. Stabilisce che i sistemi di IA in sanità devono operare nel rispetto dei diritti della persona e dei principi di protezione dei dati, garantendo affidabilità e verifiche periodiche

2. Qualifica le attività di ricerca e sperimentazione con IA come di rilevante interesse pubblico, autorizzando l’uso secondario di dati privi di identificativi diretti

3. Affida ad AGENAS il compito di definire linee guida per anonimizzazione, pseudonimizzazione e tecniche di sintesi dei dati

4. Introduce gli “spazi speciali di sperimentazione a fini di ricerca” (sandbox regolatorie) per testare soluzioni di IA in ambienti controllati

5. Istituisce la piattaforma nazionale di intelligenza artificiale per l’assistenza territoriale, gestita da AGENAS

6. Chiarisce che i sistemi di IA rappresentano un supporto alle attività cliniche ma non sostituiscono la decisione medica

7. Introduce il reato di deepfake (art. 613-quater c.p.) e rafforza il nesso con il Modello 231

Questa legge rappresenta una base solida per lo sviluppo dell’IA in sanità, bilanciando innovazione e protezione delle persone.

Quali sono le principali critiche e sfide dell’AI Act?

L’AI Act affronta diverse critiche e sfide significative:

1. Complessità normativa: con 113 articoli preceduti da 180 premesse, è un testo ostico anche per gli esperti, che rischia di creare incertezza interpretativa

2. Tempistiche incerte: il Digital Omnibus propone modifiche alle scadenze applicative, creando confusione per le imprese che devono pianificare l’adeguamento

3. Ritardi implementativi: la Commissione non ha rispettato la deadline del 2 febbraio 2026 per le linee guida sui sistemi ad alto rischio, e molti Stati membri non hanno ancora designato le autorità competenti

4. Tensione tra innovazione e regolamentazione: alcuni critici sostengono che gli obblighi di conformità potrebbero ostacolare l’implementazione dell’IA e rallentare l’innovazione

5. Pressioni geopolitiche: il “Brussels Effect” che ha reso il GDPR uno standard globale potrebbe non ripetersi con l’AI Act, a causa delle pressioni politiche internazionali e della competizione con USA e Cina

6. Gold-plating: la prassi degli Stati di aggiungere norme nazionali ulteriori rischia di frammentare il quadro normativo

Nonostante queste criticità, l’AI Act rappresenta un tentativo ambizioso di governance by rule of law in campo tecnologico, inserito in una più ampia strategia costituzionale digitale europea.