Il primo agosto del 2024 è entrato in vigore, prevedendone l’applicazione graduale, il “Regolamento UE 2024/1689 del Parlamento Europeo e del Consiglio” denominato “AI Act”, che ha regolamentato lo sviluppo, l’immissione sul mercato, la messa in servizio e l’utilizzo dei sistemi di Intelligenza Artificiale all’interno dell’Unione Europea [1].

Indice degli argomenti

Lo scopo dell’AI Act

Nel primo dei 180 “Considerando”, introduttivi ai 113 Articoli e ai 13 Allegati del regolamento, viene dichiarato il suo scopo:

“Lo scopo del presente regolamento è migliorare il funzionamento del mercato interno istituendo un quadro giuridico uniforme in particolare per quanto riguarda lo sviluppo, l’immissione sul mercato, la messa in servizio e l’uso di sistemi di intelligenza artificiale (sistemi di IA) nell’Unione in conformità dei valori dell’Unione, promuovere la diffusione di un’intelligenza artificiale (IA) antropocentrica e affidabile, garantendo nel contempo un livello elevato di protezione della salute, della sicurezza e dei diritti fondamentali sanciti dalla Carta dei diritti fondamentali dell’Unione europea («Carta»), compresi la democrazia, lo Stato di diritto e la protezione dell’ambiente, proteggere contro gli effetti nocivi dei sistemi di IA nell’Unione, nonché promuovere l’innovazione. Il presente regolamento garantisce la libera circolazione transfrontaliera di beni e servizi basati sull’IA, impedendo così agli Stati membri di imporre restrizioni allo sviluppo, alla commercializzazione e all’uso di sistemi di IA, salvo espressa autorizzazione del presente regolamento.”

Da questa dichiarazione si evince in modo chiaro l’obiettivo che con questa regolamentazione l’Unione si pone, per conciliare innovazione e difesa dei diritti, per promuovere un utilizzo dei sistemi di AI che metta l’Uomo e i Valori Democratici al centro delle politiche e degli utilizzi di questi sistemi, garantendone allo stesso tempo la sicurezza e l’affidabilità.

L’ambito di appicabilità del regolamento

Un punto importante da chiarire, in via preliminare, è l’ambito di applicabilità di questo regolamento. Sono infatti esclusi quei sistemi sviluppati o utilizzati esclusivamente in ambito militare e di sicurezza nazionale dei singoli Stati, su cui il regolamento non interviene. Sono invece inclusi nel suo ambito di applicazione quei sistemi di provider extra UE se immessi sul mercato nell’Unione, o se gli output sono qui utilizzati.

L’obiettivo di questo articolo non è quello di esaminare punto per punto tutte le disposizioni contenute nel regolamento, ma di discutere quegli aspetti ritenuti critici da una vasta platea di attori economici, istituzionali e civili. Da questi punti, che hanno sollevato diverse perplessità e richieste di revisione, partiremo per analizzare le modifiche presentate, sia all’AI Act che alle altre regolamentazioni del mondo digitale. Queste proposte sono attualmente in discussione da parte del Parlamento e del Consiglio dell’Unione Europea.

Il cuore del Regolamento

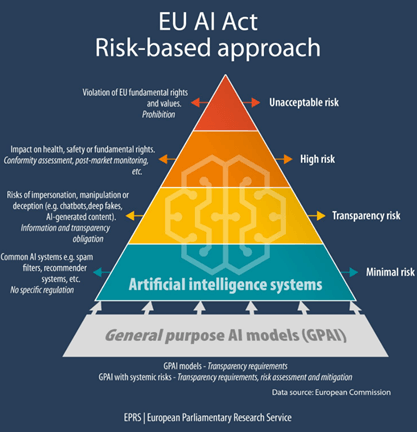

Il Regolamento, risultato di un lavoro preparatorio molto approfondito e articolato, si basa su un approccio di analisi e Gestione dei Rischi che la realizzazione e l’utilizzo di questi sistemi comportano, e che questo regolamento si propone di contenere. Viene definita una classificazione dei sistemi per livello di rischio. Si definiscono innanzitutto i sistemi che sono vietati, come quelli che possono essere utilizzati per la manipolazione del comportamento delle persone, e che potrebbero portare a operazioni di “social scoring”, utilizzabili per la profilazione del comportamento degli individui.

Sono altresì vietati quei sistemi per il riconoscimento biometrico remoto in tempo reale negli spazi pubblicamente accessibili, o che possano consentire il rilevamento del comportamento emozionale delle persone in ambienti di lavoro e di istruzione. Fanno eccezione quei casi autorizzati espressamente dalle autorità giudiziarie e di pubblica sicurezza, soggetti a condizioni molto particolari e chiaramente elencati. Posti questi divieti, il regolamento passa a definire i contorni, e i limiti da rispettare, dei sistemi definiti “Ad alto rischio”, quei sistemi cioè che possono avere un impatto significativo sulla vita delle persone, come quelli utilizzati in settori critici come la sanità, la gestione delle infrastrutture, l’occupazione, la gestione dei lavoratori, l’istruzione e i servizi pubblici essenziali.

Per questa tipologia di sistemi deve essere definita una Governance complessiva, che partendo dal processo di Gestione dei Rischi, definisca le policy di Gestione dei Dati, predisponga la documentazione necessaria per la trasparenza e l’accountability, definisca i processi di controllo e di audit, e assicuri accuratezza, robustezza e sicurezza nella gestione.

Una specifica attenzione è posta ai modelli definiti “General Purpose AI” (GPAI), quei modelli di partenza addestrati su grandi quantità di dati, ed in grado di eseguire compiti di vario genere, come generazione di codice, di testo o di immagini. Sono i sistemi che hanno dato luogo agli attuali Large Language Model (LLM), come GPT, Gemini, Claude e altri.

Per questi sistemi sono state introdotte norme specifiche (entrate in vigore il 2 agosto 2025) che riguardano la documentazione tecnica da rendere disponibile, l’informativa agli utenti, il rispetto del copyright e la messa a disposizione di una sintesi dei dati di addestramento.

Il Rischio di questi sistemi è legato all’enorme potenza computazionale e alla possibilità che possano creare danni su larga scala durante il loro utilizzo, se non controllati opportunamente.

I livelli ulteriori di classificazione del rischio riguardano i sistemi “A rischio limitato”, per cui sono definiti gli obblighi di trasparenza, e i sistemi a “Rischio minimo”.

Questo quadro normativo e regolatorio è accompagnato da sanzioni amministrative pecuniarie, con soglie graduate in base alla gravità della violazione, e che possono arrivare fino a 35 milioni di euro o al 7% del fatturato mondiale annuo dell’organizzazione. Per le PMI vale il criterio del valore più basso tra importo e percentuale.

Sono inoltre definiti gli organismi di Governance, sia a livello europeo, con l’Ufficio Europeo per l’AI, sia a livello di Stati membri, con la richiesta agli Stati di designare delle Autorità Nazionali competenti, per la notifica e la sorveglianza. A livello europeo l’AI Office è accompagnato da altri organismi: un AI Board, un Forum Consultivo, e un comitato di Esperti scientifici indipendenti.

I tempi di attuazione

L’Italia è stata il primo paese dell’Unione ad aver approvato una legge nazionale sull’Intelligenza Artificiale, la Legge 132/2025 entrata in vigore ad ottobre 2025, che integra e completa il quadro complessivo delineato dall’AI Act. Con questa legge si demandano all’AGID (Agenzia per l’Italia Digitale) e all’ACN (Agenzia per la Cybersecurity Nazionale) i compiti di indirizzo e di vigilanza [2]. Sono state inoltre definite, con questa legge, sanzioni specifiche per la diffusione di “deepfake”.

L’applicazione del regolamento europeo sta seguendo una timeline graduale, che ha già visto l’attuazione dei primi adempimenti. Le varie fasi, allo stato vigente del regolamento, sono state così scadenzate:

- Febbraio 2025: resi operativi i divieti per le pratiche vietate e l’obbligatorietà dell’AI literacy.

- Agosto 2025: diventate operative le norme che riguardano i GPAI (documentazione tecnica del modello, sintesi dati di training, misure di mitigazione dei rischi sistemici), e istituiti gli organismi di Governance. Sono inoltre state definite le sanzioni previste.

- Agosto 2026: entrerà in vigore la gran parte del regolamento, con gli obblighi per i sistemi ad Alto Rischio (quelli definiti nell’Allegato III dell’AI Act), gli obblighi di trasparenza per i sistemi conversazionali e di generazione contenuti, e l’istituzione di sandbox di sperimentazione regolatoria a livello di singolo Stato.

- Agosto 2027: scatteranno gli obblighi relativi ai sistemi ad alto rischio integrati in prodotti soggetti alla certificazione della UE (dispositivi medici, ascensori, macchinari industriali, autoveicoli, giocattoli, ecc.).

- Dicembre 2030: verrà completato l’adeguamento dei sistemi messi in servizio prima dell’agosto 2027, come i sistemi informatici su larga scala a livello europeo: il SIS per Schengen, il VIS per il sistema dei visti, l’Eurodac per le impronte digitali dei richiedenti asilo, e altri.

La gradualità nell’applicazione delle norme è funzionale alla progressiva preparazione, da parte degli attori interessati, dei processi, del quadro complessivo della sorveglianza e per la predisposizione delle regole interne ai diversi paesi per consentirne l’adeguamento [3].

Le criticità operative emerse

Già nelle prime fasi di attuazione del regolamento sono emerse delle criticità operative e delle richieste di modifica proposte da attori di tipo diverso. Richieste non tanto in relazione ai principi di fondo, oggi in larga parte condivisi, almeno a livello di UE, ma su questioni legate all’applicabilità del regolamento e alle modalità operative che occorre introdurre.

Le richieste di modifica provengono da più parti, sia a livello delle istituzioni dell’UE, che dalle grandi industrie (specie dalle “Big Tech”), e soprattutto dalle Piccole e Medie Imprese, la cui struttura, e i cui livelli di competenza, non sono ancora pienamente adeguati per gestire i nuovi processi. Altre critiche e suggerimenti provengono dal mondo politico, dalle autorità di settore, dalle ONG, e dalla comunità scientifica e accademica.

La gran parte di queste critiche sono dettate da un approccio costruttivo, che mette in evidenza dei limiti seri, che richiedono correzioni e adeguamenti, perché il regolamento non sia un ostacolo all’innovazione.

Altre critiche, invece, sembrano dettate da una interpretazione diversa all’approccio regolatorio, che manifesta una impostazione di maggiore deregolamentazione, un’idea cioè di ottenere un allentamento dei vincoli, per evitare intralci burocratici e normativi, per lo sviluppo degli affari e per gli usi commerciali nella gestione delle piattaforme [4].

Esamineremo ora le criticità emerse, e le critiche che sono state sollevate, e vedremo quali sono le richieste di modifica che sono state avanzate per affrontare questi problemi. Successivamente passeremo ad analizzare le modalità con cui si sta svolgendo il dibattito per l’approntamento di queste modifiche, sia all’AI Act che alle altre regolamentazioni sul digitale. Queste modifiche si sono concretizzate in quella che è stata denominata “Proposta Omnibus”, presentata dalla Commissione Europea nel novembre 2025 [5].

Complessità normativa

Un primo fattore di criticità, che è subito emerso, riguarda l’eccessiva complessità, sia dal punto di vista dell’interpretazione giuridica, in termini di ambiti di applicabilità e di classificazione dei sistemi, sia sotto il profilo della effettiva applicabilità in certi contesti. In particolare, per le PMI, ancora non pronte a adeguarsi compiutamente a questo regolamento, per carenze di skill, innanzitutto, ma anche di risorse organizzative.

Queste obiezioni appaiono fondate, e provengono sia da categorie imprenditoriali che da piccole startup, in particolare nel settore della tecnologia. Sono obiezioni sollevate per l’oggettiva articolazione e complessità del quadro normativo, che richiede un tempo di adeguamento significativo per formare le competenze necessarie, e richiede anche dei costi corrispondenti, non sempre alla portata delle realtà più piccole.

Infine, incide anche una conoscenza ancora superficiale di questi sistemi, che rende difficile entrare nel merito delle loro criticità tecniche, e comprendere appieno le tipologie di rischio da gestire.

Senza una comprensione degli elementi di criticità che questi sistemi presentano, il rischio è che si proceda ad un adeguamento puramente formale alle procedure, come è successo qualche volta in passato per altre regolamentazioni, ad esempio nella progressiva attuazione del GDPR. C’è un rischio di adottare un approccio di non completa condivisione, almeno nelle fasi di avvio del regolamento, della necessità dei controlli e della gestione dei possibili effetti indesiderati. Effetti che potrebbero arrecare grave danno alle persone e alle organizzazioni.

Tuttavia, ci si sta rapidamente rendendo conto che adottare dei sistemi di Intelligenza Artificiale è ormai non solo una opportunità, ma anche una necessità imprescindibile per rimanere sul mercato, per competere ad armi pari con attori internazionali che operano in tutti i settori. Si sta quindi prendendo rapidamente atto di questa realtà oggettiva, che richiederà anche politiche e strumenti di supporto alla trasformazione [6], compito che passa alla politica e alle scelte economiche degli Stati.

Eccessiva ampiezza della categoria “Sistemi ad alto rischio”

Un secondo elemento che fa discutere è la classificazione che è stata fatta dei cosiddetti “Sistemi ad alto rischio”, elencati nell’Allegato III del regolamento. Questa classificazione è oggetto di molte critiche per la sua eccessiva ampiezza. Si ritiene che siano stati inclusi in questa categoria anche dei sistemi ad impatto limitato, che non necessiterebbero di un impianto regolatorio tanto articolato come quello che si rende necessario per i sistemi critici, che sono quelli che possono impattare significativamente sulla vita delle persone. Si richiede, in sostanza, una maggiore proporzionalità regolatoria. Il problema di questa “over classification” è che impone una struttura di Governance, e un corrispondente impegno economico, anche per quelle realtà e quei sistemi che non hanno una rilevanza critica.

Il problema si pone anche per quei sistemi, adottati ad esempio in servizi pubblici non essenziali o nell’istruzione, che non sempre producono effetti diretti sulle persone. Questi sistemi a minore impatto potrebbero essere gestiti con un livello di complessità minore, pur nel rispetto dei principi generali, e con una adeguata gestione del loro effettivo livello di rischio.

In ogni caso, va assicurato il controllo da parte di operatori umani, anche nel caso di sistemi ad impatto limitato. Un problema specifico si pone per i sistemi definiti “General Purpose AI” (GPAI), che il regolamento suddivide in GPAI ordinari e GPAI a rischio sistemico, ed impone obblighi più stringenti per quelli appartenenti alla seconda categoria. Il criterio di appartenenza a queste due categorie si basa sulle soglie di potenza computazionale utilizzata per l’addestramento, sulla capacità del modello, e sulla sua diffusione. Questi criteri non sono semplici da applicare e questo crea incertezze decisionali e ritardi dovuti ad errate interpretazioni.

Diversificazione del quadro normativo

In ambito di sistemi digitali sono state emanate negli ultimi anni diverse normative, introducendo delle sovrapposizioni e in qualche caso una mancanza di chiarezza sugli effettivi confini di applicabilità (regulatory fragmentation). Questo rende molto complessa la loro adozione, e introduce delle duplicazioni di compiti e delle ambiguità interpretative. Sono inoltre previste diverse autorità, per la vigilanza e la sorveglianza, in relazione alle diverse normative [7].

Questo articolato sistema regolatorio ha come obiettivo quello di garantire il rispetto dei diritti fondamentali della persona, la sicurezza dei dati e un corretto esercizio della concorrenza sui mercati digitali e la sovranità tecnologica dell’Unione Europea. Vediamo quali sono queste normative, oltre l’AI Act, in ordine di pubblicazione.

General Data Protection Regulation (GDPR) – Regolamento UE 2016/679

È il regolamento europeo che disciplina il trattamento dei dati personali delle persone fisiche. È applicabile dal 25 maggio 2018 e costituisce il punto di riferimento per la protezione dei dati. È basato sulla responsabilizzazione, l’accountability e la gestione del rischio. Si applica ai titolari e ai responsabili del trattamento a livello UE, ma anche ai soggetti extra-UE che trattano i dati dei cittadini residenti nell’unione (come le piattaforme digitali statunitensi). È uno dei regolamenti per cui esistono le maggiori sovrapposizioni con l’AI Act dal punto di vista operativo, anche se le basi giuridiche sono diverse: il modello di Gestione dei Rischi, gli obblighi di trasparenza, gli audit e la gestione della documentazione tecnica. L’ Autorità responsabile è l’Autorità Garante per la protezione dei dati personali (Garante Privacy).

Data Governance Act (DGA) – Regolamento UE 2022/868

È la prima componente che contribuisce a creare una strategia europea per la creazione di un mercato unico digitale. È applicabile dal 24 settembre 2023 e disciplina il riutilizzo dei dati, come quelli raccolti dalla Pubblica Amministrazione e dai servizi di intermediazione dei dati.

Ha come obiettivo la creazione di rapporti di fiducia nella loro condivisione, che deve essere fatta in modo sicuro e regolamentato. Le interconnessioni con l’AI Act riguardano le modalità di utilizzo di questi dati pubblici, così come la regolamentazione e la gestione dei flussi informativi. Alle modalità di utilizzo deve essere anche connessa la Gestione dei Rischi, come quelli legati all’addestramento dei modelli.

Digital Markets Act (DMA) – Regolamento UE 2022/1925

È il regolamento che disciplina i mercati digitali, e vuole garantire la leale concorrenza nei confronti delle grandi piattaforme digitali ritenute di tipo sistemico. È entrato in vigore nel novembre 2022, ed è pienamente operativo dal 2 maggio 2023. È una normativa che mira a proteggere la libera concorrenza, a limitare le pratiche di tendenza monopolistica e gli abusi di posizione dominante e a favorire l’interoperabilità dei mercati. Si applica ad imprese identificate come aventi un impatto significativo sui mercati interni, che controllano servizi basilari come app store, grandi motori di ricerca, social network e marketplace. Gli obblighi previsti sono quelli di interoperabilità, di limitazione nell’incrocio dei dati, del diritto di disinstallazione delle App preinstallate, e altri. Le connessioni con l’AI Act sono diverse, in termini di conformità e di trasparenza. È un regolamento che mira a regolare e a limitare lo strapotere delle grandi piattaforme.

Digital Operational Resilience Act (DORA) – Regolamento UE 2022/2554

Regolamento europeo che disciplina la resilienza operativa del settore finanziario. È entrato in vigore nel 2023, ed è pienamente operativo dal 17 gennaio del 2025. Lo scopo è quello di garantire che gli operatori finanziari dell’Unione (Banche, Assicurazioni, intermediari finanziari, fornitori di sistemi ICT critici per il settore finanziario) siano in grado di gestire in modo resiliente gli incidenti informatici e i possibili malfunzionamenti nel corso delle operazioni: con la prevenzione e la gestione degli incidenti, il ripristino operativo, la comunicazione. Anche per questa regolamentazione è fondamentale l’applicazione di un framework per la Gestione dei Rischi, il reporting degli incidenti e la documentazione dei processi; adempimenti simili a quanto previsto nell’AI Act. È inoltre fondamentale la gestione della supply-chain, con un focus particolare sui provider ICT per i sistemi finanziari. Le Autorità di sorveglianza sono: Banca d’Italia, CONSOB e Istituto per la Vigilanza sulle Assicurazioni (IVASS).

Network and Information Security Directive 2 (NIS2) – Direttiva UE 2022/2555.

È la direttiva europea per il rafforzamento della comune postura di Cybersecurity della UE che sostituisce la precedente direttiva NIS del 2016 ampliando in modo molto significativo sia il numero dei soggetti coinvolti che gli obblighi di sicurezza previsti. È stata recepita dai singoli stati alla fine del 2024.

Si applica sia ai “Soggetti essenziali” che ai “Soggetti importanti”, e i settori sono tutti quelli più delicati di una nazione: energia, trasporti, sanità, infrastrutture digitali, gestione infrastrutture critiche, pubblica amministrazione, servizi finanziari, ecc. I soggetti coinvolti devono adottare adeguate misure tecniche ed organizzative per la Gestione dei Rischi di Cybersecurity. Devono gestire la notifica in tempi stretti degli incidenti e rafforzare i processi di prevenzione, vigilanza e controllo da parte delle autorità nazionali. Sono inoltre previste responsabilità dirette del top management aziendale. La NIS2, in quanto direttiva e non regolamento, è stata recepita in Italia con il D.Lgs. 138/2024, in vigore dal 16 ottobre 2024. Anche con questa normativa ci sono sovrapposizioni con l’AI Act, come la Gestione del Rischio, le misure di sicurezza, il monitoraggio, il reporting degli incidenti di sicurezza e le procedure di prevenzione e controllo. L’ Autorità responsabile è l’Agenzia per la Cybersecurity Nazionale.

Digital Service Act (DSA) – Regolamento UE 2022/2065

È il regolamento che disciplina le responsabilità delle piattaforme e degli intermediari digitali. È entrato in vigore nel 2022, ed è pienamente operativo dal 17 febbraio 2024. È rivolto a rafforzare la tutela degli utenti nel contrasto alla diffusione di contenuti illegali sulla rete, ad aumentare la trasparenza degli algoritmi, ad obbligare le piattaforme digitali a valutare i rischi e a gestire le segnalazioni di contenuti illegali. Le sovrapposizioni funzionali con l’AI Act sono direttamente riscontrabili, poiché le grandi piattaforme online utilizzano ormai dei sistemi di AI per ogni tipo di servizio, dalle raccomandazioni agli acquisti alla profilazione degli utenti, dai controlli sui contenuti alla creazione degli stessi, anche mediante agenti autonomi. Sono inoltre previsti obblighi di documentazione, di valutazione del rischio e di auditabilità. È un regolamento molto importante, proprio alla luce degli sviluppi della AI nella gestione del business delle piattaforme.

Data Act – Regolamento UE 2023/2854

Regolamento europeo che disciplina la modalità di accesso, di utilizzo e di condivisione dei dati raccolti da terminali e prodotti connessi a servizi digitali, in particolare in ambito industriale e nell’ambito dei dispositivi IOT. È entrato in vigore l’11 gennaio 2024, ed è pienamente operativo a partire dal 12 settembre 2025. È rivolto a garantire gli utenti dai possibili utilizzi impropri dei loro dati raccolti dai dispositivi utilizzati, a favorire la condivisione di informazioni tra aziende e a promuovere il mercato unico dei dati favorendo l’innovazione. Non si occupa di protezione dei dati personali (come il GDPR), ma della circolazione dei dati industriali e di processo. Le connessioni con l’AI Act sono importanti, dalla raccolta dei dati (utilizzabili per l’addestramento dei modelli), alla protezione dei diritti industriali e di copyright. Laddove si raccolgano dati personali c’è una sovrapposizione anche col GDPR.

Cyber Resilience Act (CRA) – Regolamento UE 2024/2847

È il regolamento che impone misure specifiche di Cybersecurity per quei prodotti che contengono elementi digitali quando vengono immessi sul mercato. È stato adottato nel 2024 e sta entrando progressivamente in vigore. Indica l’obbligo di utilizzare misure di sicurezza “by design”, la gestione delle vulnerabilità e l’effettuazione di aggiornamenti per tutta la loro durata di esercizio. Si applica sia a componenti hardware che software connessi in rete, inclusi quelli che abbiano come componenti elementi di AI. Le sovrapposizioni con l’AI Act riguardano anche qui la Gestione dei Rischi, gli obblighi di conformità e di documentazione e la notifica delle vulnerabilità rilevate, in particolare per le componenti di AI integrate in questi componenti.

In conclusione, ci sono molti elementi in comune tra le diverse normative, come la Gestione dei Rischi, gli obblighi di trasparenza di documentazione e audit, la Cybersecurity e la notifica degli incidenti. Il modello Risk Based è alla base di gran parte di queste normative e una maggiore integrazione tra di loro è auspicabile, anche in relazione alle diverse Autorità incaricate della sorveglianza. Un’azienda che deve applicare diverse di queste normative ha necessariamente bisogno di un sistema molto complesso di verifiche e di armonizzazione degli adempimenti (compliance complexity).

Ruolo delle autorità di sorveglianza

La designazione di Autorità diverse, per le varie normative, rende l’applicazione del quadro normativo digitale non solo molto complicata ed onerosa da gestire, nella struttura dei processi di Governance e della documentazione da produrre, ma introduce anche possibili diversità di interpretazione e di comportamenti, in relazione alle diverse Autorità, ai diversi modelli di compliance e alla diversità di strutture normative. Per le PMI, in particolare, è un peso spesso insostenibile in termini organizzativi, come anche per il reperimento delle giuste competenze, e questo rende possibile ritardi e inadempienze. Esiste poi il rischio di sanzioni multiple comminate dalle diverse amministrazioni, sia a causa della differenza di basi giuridiche, sia per possibili diverse interpretazioni.

Un secondo ordine di problemi deriva dal moltiplicarsi delle Autorità di sorveglianza e di coordinamento a livello comunitario. Ogni normativa che abbiamo esaminato corrisponde a diverse Autorità, non solo a livello nazionale, come abbiamo visto, ma anche a livello di Unione Europea.

L’elenco delle Autorità comunitarie, in relazione alle diverse normative, è molto diversificato:

- AI Act: AI Office ed European AI Board.

- GDPR: European Data Protection Board (EDPB) ed European Data Protection Supervisor (EDPS).

- DORA: European Banking Authority (EBA), European Securities and Markets Authority (ESMA), European Insurance and Occupational Pensions Authority (EIOPA).

- NIS2: European Union Agency for Cybersecurity (ENISA).

- DSA: Commissione europea ed European Board for Digital Services.

- DMA: Commissione europea.

- DGA: European Data Innovation Board (EDIB).

- Data Act: European Data Innovation Board (EDIB).

- CRA: Commissione europea.

Ci sono, in particolare, delle sovrapposizioni di adempimenti e di competenze tra AI Act e GDPR. Si potrebbe determinare, ad esempio, una doppia violazione in caso di data breach dovuto a carenze organizzative, sia per la violazione dei requisiti del Sistema di AI, sia per un trattamento dei dati personali non conforme.

Ed infine, c’è un problema dovuto alla diversità di interpretazione, ed applicazione delle norme, nei diversi Stati dell’Unione Europea. È una mancanza di omogeneità che a volte spinge aziende multinazionali a scegliere la sede europea più conveniente giuridicamente, in quei paesi che applicano in modo meno restrittivo certe normative, come il GDPR. È stato coniato il termine di “forum shopping regolatorio” per questo fenomeno[8].

Esiste quindi un problema di armonizzazione a livello comunitario, non solo per l’aspetto normativo e per la diversificazione delle Autorità, ma anche nell’interpretazione e nell’applicazione delle norme da parte delle singole Autorità nazionali di riferimento.

Incompletezza degli atti integrativi

L’insieme delle normative esistenti non completa il quadro di riferimento per la loro corretta applicazione, in quanto molti elementi di chiarificazione sono demandati ad atti successivi, non ancora del tutto disponibili.

Questo rende incerto l’adeguamento normativo nella fase transitoria, e costringe le organizzazioni ad un monitoraggio e adeguamento continuo, per recepire in tempi successivi i riferimenti che ancora non sono stati prodotti. L’AI Act è una normativa che contiene un numero notevole di “rinvii” nell’attuazione.

È infatti prevista la possibilità (la necessità, visti gli elementi mancanti) da parte della Commissione di modificare o completare alcuni elementi della normativa mediante lo strumento degli “Atti Delegati”.

Il problema più rilevante riguarda la revisione dell’Allegato III, relativo ai sistemi ad Alto Rischio, di cui abbiamo già esaminato la criticità e la necessità di revisione, in ottica di chiarificazione e di semplificazione.

Una seconda questione aperta, come già evidenziato, riguarda la categoria dei sistemi GPAI, che non è autoesplicativa. Il regolamento distingue due tipologie di GPAI, quelli di tipo ordinario e quelli a “Rischio Sistemico”, e la differenza di classificazione (che prevede misure di tipo sostanzialmente diverse) è nella definizione di metriche di valutazione e di criteri di tipo tecnico, con le soglie quantitative già indicate. Queste metriche dovrebbero essere meglio definite e dotate di criteri di utilizzo direttamente operativi. Alcuni di questi elementi non sono ancora completamente chiari, e richiedono adeguate specifiche tecniche e atti esecutivi per completarle.

C’è poi la necessità di chiarire, ed eventualmente allargare da parte dell’European AI Office, le “Linee Guida” di tipo interpretativo, sia di chiarimento che di indirizzo.

La normativa promuove anche l’adozione di codici volontari di condotta e di autoregolamentazione, resi disponibili solo in parte. Questo introduce ulteriori rinvii nella loro adozione.

In sostanza, l’AI Act offre un quadro di riferimento dinamico, come è inevitabile che sia, vista la continua accelerazione nell’evoluzione del contesto, che va costantemente tenuto aggiornato, per seguire i rapidi cambiamenti di tipo tecnologico e industriale. Questi cambiamenti hanno oggi una velocità di evoluzione rapidissima, non comparabile con alcuna esperienza passata. Andrebbero quindi definiti dei criteri di aggiornamento che seguano tempi molto più accelerati rispetto all’ordinario processo di proposta, discussione, e approvazione. Un ciclo che oggi richiede spesso anni di lavoro, come stiamo vedendo nel caso delle “Proposte Omnibus”.

Anche per altre normative sul digitale, oltre all’AI Act, si rende necessario il completamento di elementi aggiuntivi per la loro corretta applicazione. Ad esempio, gli standard regolatori per il DORA, i codici di condotta per la disinformazione nel DSA, le specifiche tecniche di interoperabilità del Cloud per il Data Act, tra le più rilevanti.

Complessità e impatti sulla ricerca

Per quanto riguarda l’attività di ricerca e di sperimentazione, il regolamento prevede esenzioni per l’attività di ricerca pura e di produzione di prototipi da laboratorio, che non rientrano quindi nell’ambito del regolamento. Tuttavia, se dai prototipi di ricerca si passa alla messa in produzione, all’immissione sul mercato e alla messa in servizio, o quando l’output di questi sistemi è utilizzato nell’Unione, allora i sistemi sviluppati entrano pienamente nell’ambito di competenza dell’AI Act. In questo caso i sistemi sviluppati devono essere adeguati alle norme, e devono rispettare gli obblighi previsti dal regolamento.

La questione di fondo, che viene frequentemente posta, è quella che troppe norme e regolamenti intralcerebbero lo sviluppo di questi sistemi, con rallentamenti e ostacoli all’innovazione, che ci consentirebbe invece, se non appesantita dalla burocrazia, di sfruttare al meglio le opportunità offerte da questa tecnologia.

Questa argomentazione, in linea di principio, avrebbe un suo fascino, se non si tenesse conto che non ci troviamo di fronte ad uno sviluppo tecnologico come altri emersi in passato. Ci troviamo di fronte a dei sistemi previsionali, e di supporto alle decisioni, e ad agenti operativi, che possono provocare danni di grandi proporzioni se non pienamente sotto il controllo umano, se non vengono sviluppati tenendo conto dei principi e dei diritti fondamentali delle persone.

La nascita di una nuova branca della ricerca scientifica, la Human-Centered AI (HCAI), è quella direzione della ricerca che è rivolta a conciliare i diritti ed i controlli con le grandi potenzialità dei modelli di AI moderni, in particolare per quelli di grande potenza computazionale e ad alto livello di rischio. L’obiettivo che si pone la HCAI è quello di rendere trasparenti questi sistemi, ed impedire che le decisioni finali vengano assunte senza controllo umano e senza una supervisione da parte degli operatori.

La questione riguarda quegli aspetti spesso oscuri del processo decisionale, delle modalità effettive che portano questi modelli alle loro conclusioni, tanto da definirli in certi casi delle black-box. Questo avviene non per malafede o errori nella progettazione, ma per l’oggettiva complessità delle Reti Neurali profonde utilizzate in questi sistemi.

Quando si sviluppano modelli con centinaia di layer e miliardi di parametri, la completa tracciabilità dei risultati non è assicurata. Questo sta imponendo lo sviluppo di quelle tecniche di trasparenza e controllo che vanno sotto la denominazione di “Explainable AI (XAI)” [9], una direzione di ricerca ancora agli inizi.

Per gestire la complessità, ed esercitare il controllo sui risultati, l’AI Act ha elaborato un quadro complessivo di regole e di controlli, che vanno nella direzione della trasparenza e della tracciabilità. Il fatto che queste norme richiedano una revisione ed un affinamento, in particolare per la loro semplificazione, è un fatto del tutto comprensibile se lo si confronta con la grande complessità tecnologica introdotta dai modelli di AI.

La richiesta di un adeguamento non mette in discussione la necessità dei controlli ed il rispetto dei principi e dei diritti delle persone, ma costituisce un passaggio fisiologico per meglio attuarli, con una attenta considerazione delle criticità emerse, e delle richieste di adeguamento.

C’è infine da dire che a livello internazionale l’AI Act costituisce oggi un modello di regolamentazione dell’AI a cui molte altre normative nazionali fanno riferimento, come quella canadese, australiana (in itinere), coreana e brasiliana. Anche la Cina ha adottato una specifica regolamentazione nell’uso dell’Intelligenza Artificiale, che prevede controlli e obblighi per i produttori, anche se più orientata ad un controllo statale. La posizione recente degli Stati Uniti è invece più liberale a livello federale, mentre molti stati, come la California e il Colorado, hanno discusso regolamentazioni più orientate al controllo.

Le proposte di modifica in discussione: il pacchetto legislativo “Omnibus” sul digitale

Per rispondere alle osservazioni sollevate e alle richieste di modifica provenienti da molti soggetti, pubblici, accademici e privati, la Commissione Europea ha predisposto un pacchetto di modifiche non solo all’AI Act, ma anche a diverse altre normative sul digitale, intervenendo in maniera selettiva su una serie di punti. Il pacchetto è stato presentato il 19 novembre 2025 e mira ad una maggiore armonizzazione tra le diverse normative e ad una semplificazione dell’AI Act nei punti più critici, come alcuni chiarimenti applicativi sui modelli GPAI, sia quelli ordinari che a rischio sistemico, e una semplificazione degli adempimenti per le PMI.

Questa proposta dovrà essere discussa e poi approvata dal Parlamento Europeo e dal Consiglio dell’Unione, secondo la procedura legislativa ordinaria. Ci saranno sicuramente emendamenti e richieste di modifica con una discussione di merito, e probabilmente questo percorso durerà un paio di anni. È un iter avviato, che richiederà i tempi necessari per arrivare all’approvazione finale di questa importante revisione delle normative interessate dalle proposte. L’impressione generale è che esista un’ampia convergenza sugli obiettivi, ma che molti dettagli debbano essere ancora discussi e approfonditi prima di arrivare all’approvazione.

Vediamo più dettagliatamente quali sono le proposte contenute nel pacchetto di misure denominato “Pacchetto Omnibus”, a cominciare proprio dall’AI Act. Sono riportate in nota [10] i riferimenti ai diversi provvedimenti del pacchetto.

Regolamento UE 2024/1689 – AI Act

- Semplificazione delle procedure per valutare la conformità, armonizzando le norme a livello UE per evitare duplicazioni di adempimenti.

- Coordinamento delle scadenze e delle timeline di attuazione.

- Mitigazione degli oneri per i sistemi non ad “Alto rischio”, evitando l’effetto di “over classification” nella classificazione e nella registrazione.

Altri punti sono oggetto ancora di discussione e dovranno essere valutati nel dibattito in parlamento e in Consiglio:

- Chiarimenti sugli obblighi di compliance in modo da renderli più facilmente interpretabili dagli operatori.

- Per i General Purpose AI, precisazione degli obblighi di documentazione e compliance, armonizzandoli con le altre normative (GDPR, NIS2, ecc.).

Sintesi critica: le modifiche affrontano molte delle criticità emerse e delle critiche sollevate, ma non affrontano completamente alcuni problemi, che dovrebbero invece essere risolti con questa revisione. In particolare, non è affrontato il tema riguardante la Governance multilivello, della stratificazione dei compiti tra Autorità nazionali e quelle comunitarie. Inoltre, il problema del possibile doppio sanzionamento non è chiarito in maniera soddisfacente, anche in riferimento al principio del “ne bis in idem” esistente nel diritto europeo. Non viene ridotto, ma soltanto alleviato, il numero dei compiti a carico delle PMI. Non viene rivista la scelta di fondo che porta al problema degli atti delegati e dei rimandi a linee guida, che rende il regolamento perennemente “in itinere”. Anche se questo pacchetto venisse approvato, non risolverebbe quindi alcuni dei problemi importanti, di tipo strutturale. Ci si aspettano integrazioni nella fase di discussione.

General Data Protection Regulation (GDPR) – Regolamento UE 2016/679.

- Armonizzazione di tutto il sistema delle notifiche, evitando duplicazioni e rivedendo le scadenze.

- Definizione di un “single entry point” per le notifiche, problema comune anche ad altre normative.

- Chiarimenti sull’uso dei dati personali nell’addestramento dei modelli di AI.

Altri punti sono oggetto di discussioni in corso e dovranno essere valutati nel dibattito in parlamento e in Consiglio:

- Armonizzazione degli obblighi di trasparenza con le altre normative digitali.

- Aggiornamento del GDPR in relazione alle nuove normative intervenute successivamente, come l’AI Act.

Sintesi critica: con le modifiche proposte vengono affrontati alcuni dei punti di criticità più importanti, come l’armonizzazione con l’AI Act. Tuttavia, altri punti restano ancora aperti, come il regime sanzionatorio separato e il problema di fondo delle differenti valutazioni da parte delle Autorità dei singoli paesi. Inoltre, rimane irrisolto il grande nodo dell’addestramento dei modelli di AI su dataset che possono includere dati personali. Dovrebbe essere definita la loro base giuridica, l’indicazione degli ambiti in cui utilizzare la pseudonimizzazione, il diritto alla cancellazione, la verifica delle compatibilità tra scopi e dati raccolti.

Data Governance Act (DGA) – Regolamento UE 2022/868

Questo regolamento sarebbe oggetto di abrogazione, prevedendone il riassorbimento nelle altre norme, in particolare il Data Act e il GDPR, per razionalizzare le sovrapposizioni e armonizzare le diverse normative.

Digital Markets Act (DMA) – Regolamento UE 2022/1925

Il DMA non risulta incluso tra le normative oggetto di modifica nel pacchetto Omnibus digitale; la disciplina relativa agli obblighi in materia di concorrenza nei mercati digitali resta pertanto invariata.

- Digital Operational Resilience Act (DORA) – Regolamento UE 2022/2554.

- Armonizzazione delle notifiche di incidente con le altre normative.

- Coordinamento delle tempistiche di reporting.

- Razionalizzazione dei flussi informativi verso le diverse Autorità di vigilanza.

Sintesi critica: alcuni problemi sono stati considerati, ma il problema di fondo della molteplicità degli organismi di controllo non viene affrontato. Inoltre, anche la questione dei diversi standard tecnici e linee guida che possono sovrapporsi a quelli delle altre norme (come l’AI Act e la NIS2) andrebbe meglio definita.

- Network and Information Security Directive 2 (NIS2) – Direttiva UE 2022/2555.

- Armonizzazione delle notifiche di incidente con le altre normative.

- Coordinamento delle tempistiche delle notifiche, per evitare sovrapposizioni.

- Coordinamento delle informazioni.

Sintesi critica: si affrontano problemi procedurali importanti, ma alcuni aspetti di merito restano ancora da chiarire, come la distinzione delle tipologie di incidente, tra quelli di sicurezza (CIA: confidentiality, integrity, availability) e quelli relativi ai modelli (ad esempio bias, discriminazioni, errori strutturali di sistema).

Inoltre, a livello nazionale andrebbero distinte le competenze delle Autorità di vigilanza, ma questo non riguarda la proposta Omnibus ma le legislazioni nazionali.

Digital Service Act (DSA) – Regolamento UE 2022/2065

Il DSA non risulta incluso tra le normative oggetto di modifica nel pacchetto Omnibus digitale; la disciplina relativa alle responsabilità delle piattaforme e degli intermediari digitali in materia di gestione dei contenuti, alla trasparenza e tutela degli utenti, resta pertanto invariata.

- Data Act – Regolamento UE 2023/2854

- Chiarimenti sulle interazioni con il GDPR.

- Revisione dei conflitti interpretativi sui dati personali e non personali.

- Armonizzazione degli ambiti di applicazione, in particolare con l’AI Act.

- Esenzioni specifiche per le regole del cloud-switching.

- Chiarimenti e limitazioni sul business-to-government sharing.

- Consolidamento delle regole sui dati in possesso di soggetti pubblici.

- Nuove misure di supporto e linee guida.

Sintesi critica: anche in questo caso resta aperto un problema importante riguardante l’accesso a dati strategici per l’addestramento dei modelli di AI. Un ulteriore punto non ancora affrontato in modo esaustivo è un corretto bilanciamento tra diritto alla concorrenza e la tutela dei diritti sui dati.

Cyber Resilience Act (CRA) – Regolamento UE 2024/2847

Il CRA non risulta incluso tra le normative soggette a revisione nel pacchetto Omnibus digitale, resta quindi invariata la disciplina relativa ai requisiti di sicurezza dei prodotti immessi sul mercato che contengono elementi digitali.

AI e sistemi d’arma autonomi: una questione aperta

Un’ultima considerazione, di tipo più generale sui sistemi di AI, riguarda un ambito che esula dall’analisi dell’AI Act e delle altre normative digitali europee: quello relativo ai sistemi d’arma autonomi o semi autonomi basati sull’Intelligenza Artificiale, i cosiddetti “Lethal Autonomous Weapon Systems” (LAWS). Questa tipologia di sistemi, sviluppati e utilizzati esclusivamente per usi militari o di sicurezza nazionale, non rientra nell’ambito di applicazione dell’AI Act, ma costituisce oggi una delle maggiori criticità che ci troviamo ad affrontare a livello internazionale, alla luce dei conflitti in corso, e per gli imprevedibili sviluppi futuri del panorama geopolitico.

Questo problema non è oggi affrontato in maniera adeguata, ed ogni stato può potenzialmente sviluppare in autonomia sistemi d’arma di questo tipo, in assenza di un trattato internazionale che li vincoli. Questo vuol dire che sono i paesi più avanzati su queste tecnologie ad approfittarne maggiormente, con una corsa agli armamenti non controllata.

C’è un dibattito in corso in seno alle Nazioni Unite, nell’ambito della “Convention on Certain Conventional Weapons (CCW)”, per allargare alle LAWS certi vincoli di utilizzo che riguardano altri tipi di armamento, e un apposito gruppo di lavoro sta lavorando proprio su questo tema [11]. Occorre quindi promuovere accordi e trattati a livello internazionale, per disciplinare e limitare l’utilizzo di questi sistemi, analogamente a quanto si è fatto, con alterne vicende, nel campo della non proliferazione delle armi nucleari. Non sembri azzardato il paragone, perché molti studiosi ed esperti hanno sollevato questo parallelo, ad iniziare da Geoffrey Hinton, premio Nobel 2024 per la fisica per le sue ricerche sul Machine Learning e le reti neurali [12].

Negli ultimi giorni una posizione molto decisa è stata assunta anche da Dario Amodei, CEO di Anthropic, l’azienda statunitense che ha sviluppato Claude, uno dei maggiori LLM sul mercato:

“Oggi, i sistemi di intelligenza artificiale di frontiera semplicemente non sono sufficientemente affidabili per alimentare armi completamente autonome. Non forniremo consapevolmente un prodotto che mette a rischio i combattenti e i civili americani”.

È una posizione nettamente contraria all’utilizzo di sistemi d’arma autonomi allo stato attuale di sviluppo, ed Amodei è stato pesantemente attaccato per queste dichiarazioni, da chi vorrebbe invece mano libera nel loro utilizzo [13].

Per quanto riguarda l’Italia, anche a livello nazionale si stanno pianificando azioni per introdurre, dal punto di vista della Difesa, capacità operative e strategiche che sfruttino i sistemi di AI. Le dichiarazioni espresse sono molto chiare: “Va sottolineato come la strategia riconosce il ruolo centrale del fattore umano, impegnandosi per un uso etico e responsabile della tecnologia, sempre in linea con i principi del Diritto Internazionale Umanitario.”, e ancora: “Un principio centrale è il mantenimento del controllo umano sulla tecnologia e la responsabilità della linea di comando.“ Un approccio quindi in linea con i principi generali dichiarati nell’AI Act, anche se il settore della difesa non rientra nel suo ambito di applicazione. Un’impostazione che dimostra come questi principi siano ormai patrimonio comune nel nostro continente [14].

Conclusioni

L’AI Act è stato un risultato molto importante raggiunto dall’Unione Europea, arrivato dopo un lungo lavoro di elaborazione e di approfondimento, su una tematica nuova e complessa come quella dell’Intelligenza Artificiale. È finora la regolamentazione più completa e organica a livello internazionale, e ha l’obiettivo di regolamentare un mercato in rapidissima evoluzione.

Il regolamento ha posto alla sua base i principi fondamentali del rispetto della dignità e dei diritti delle persone. Ma proprio per la difficoltà di affrontare un compito così complesso, anche per lo sviluppo rapidissimo di questo mercato, sono stati evidenziati fin dall’inizio una serie di criticità nella sua applicazione che hanno portato a delle richieste di modifica, prima ancora che il regolamento entrasse pienamente nella sua fase attuativa.

Le modifiche richieste non vengono da singoli settori della società o da lobby ristrette, ma dalla maggioranza dei soggetti interessati: dai provider alle Autorità di regolamentazione, dal mondo imprenditoriale a quello politico, da soggetti istituzionali e accademici.

È una convergenza molto ampia, indice in generale un approccio positivo, che si misura con le difficoltà oggettive nella definizione dei principi, e nella loro applicazione nella pratica. Non si tratta quindi, a mio parere, di pregiudiziali ideologiche o di principio, che tuttavia sono anche presenti in alcuni settori marginali, ma di critiche che hanno come obiettivo il miglioramento del regolamento, per facilitarne la comprensione e l’applicazione. Il senso di queste osservazioni, da parte di tutti i soggetti interessati, vuole essere la salvaguardia del diritto all’innovazione, ma anche il consolidamento dei punti fermi nel controllo e nei diritti delle persone.

La necessità di avere un sistema di regole che guidino gli sviluppi, presenti e futuri, di questa tecnologia è chiara a tutti. Ci troviamo di fronte a sistemi che stanno rivoluzionando il modo di lavorare e di vivere delle persone, ed i loro impatti non sono ancora completamente chiari sulle nostre società e sulla vita di ognuno di noi.

Ci sono dei rischi da affrontare e da contenere, ma assicurando, allo stesso tempo, il pieno sviluppo delle trasformazioni che questi sistemi consentono, sfruttandone le potenzialità in ogni settore della nostra società, professionale, educativo e della ricerca. Questi rischi potrebbero provocare effetti trasformativi molto pesanti, sull’intera società e sulle vite di ognuno, senza voler ricorrere a evocazioni apocalittiche. Per questo motivo è di fondamentale importanza adottare, e migliorare costantemente, dei sistemi di controllo per assicurare l’allineamento di questi sistemi ai valori umani, etici e giuridici.

La predisposizione di un pacchetto di misure migliorative, sia dell’AI Act che delle altre normative sul digitale, va nella direzione giusta. Tuttavia, secondo molti, queste modifiche presentate non sono ancora sufficienti a risolvere tutte le questioni più importanti, perché molti problemi rimangono ancora aperti, come ad esempio la revisione dell’Allegato III, gli obblighi dei sistemi GPAI, e un migliore coordinamento delle varie autorità. Ci si aspetta, quindi, che nel corso del dibattito che precederà la loro approvazione, nel Parlamento Europeo e nel Consiglio dell’Unione, i testi presentati vengano ulteriormente integrati e migliorati.

L’Unione Europea rimarrà in futuro un punto di riferimento a livello internazionale nello sviluppo di sistemi etici e rispettosi dei diritti e delle prerogative delle persone, ma questo posizionamento deve anche portare ad un recupero dei ritardi accumulati rispetto ai protagonisti di questa rivoluzione tecnologica: la Cina e gli Stati Uniti.

È necessario, in definitiva, trovare un punto di equilibrio, tra lo sviluppo e la regolamentazione, per mitigare i rischi che abbiamo di fronte, ma anche per promuovere lo sviluppo di questo mercato, dando fiducia e sicurezza ai cittadini, alle imprese e alle istituzioni.

Un’idea innovativa è stata proposta dal premio Nobel Giorgio Parisi, che ha lanciato l’idea di un “CERN” dell’AI, un centro di ricerca europea sull’Intelligenza Artificiale e le sue applicazioni. Questo istituto dovrebbe essere, nella proposta di Parisi, un centro di ricerca pubblico sul modello del CERN di Ginevra, che è il fiore all’occhiello della ricerca mondiale nel campo delle particelle elementari. Se a questa proposta aderiranno le maggiori nazioni dell’UE, l’Unione potrà indicare la via dello sviluppo etico e controllato di questo settore al resto del mondo, e fondare la propria sovranità tecnologica sui principi dell’AI etica e sicura. L’iniziativa potrebbe inoltre contribuire ad attrarre ricercatori e investimenti da ogni parte del mondo [15].

Vedremo nei prossimi mesi se la comunità internazionale, pur in quest’epoca così travagliata a livello geopolitico, saprà percorrere la strada di una AI efficiente, etica e responsabile, o se invece prevarranno la competizione indiscriminata e una corsa ad armamenti intelligenti e modelli di mercato sempre più difficilmente controllabili.

Note

[1]: Regolamento UE 2024/1689 del Parlamento Europeo e del Consiglio:

https://eur-lex.europa.eu/legal-content/IT/TXT/?uri=OJ%3AL_202401689

[2]: Disposizioni e deleghe al Governo in materia di Intelligenza Artificiale:

https://www.gazzettaufficiale.it/eli/id/2025/09/25/25G00143/SG

[3]: The European Union Artificial Intelligence Act:

[4]: Reuters: EU to delay high-risk AI rules until 2027 after Big Tech pushback:

[5]: Norme digitali più semplici per aiutare le imprese dell’UE a crescere:

[6]: Supporting the implementation of the AI Act with clear guidelines:

https://digital-strategy.ec.europa.eu/en/news/supporting-implementation-ai-act-clear-guidelines

[7] : CEPS – The AI Act and emerging EU digital “acquis”:

[8]: The AI Act and emerging EU digital acquis. Overlaps, gaps and inconsistencies –

[9]: Ribeiro, M. T., Singh, S., & Guestrin, C. (2016). Why Should I Trust You? Explaining the Predictions of Any Classifier – KDD – https://dl.acm.org/doi/10.1145/2939672.2939778

[10]: Provvedimenti del pacchetto “Omnibus”:

https://eur-lex.europa.eu/procedure/IT/2025_359

https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:52025PC0836

https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:52025PC0837

https://digital-strategy.ec.europa.eu/it/faqs/digital-package

[11]: United Nations – The Convention on Certain Conventional Weapons

https://disarmament.unoda.org/en/our-work/conventional-arms/convention-certain-conventional-weapons

[12]: Future of Life: An Open Letter to the United Nations Convention on Certain Conventional Weapons: https://futureoflife.org/open-letter/autonomous-weapons-open-letter-2017/

[13]: Statement from Dario Amodei on our discussions with the Department of War:

https://www.anthropic.com/news/statement-department-of-war

[14]: IA e Difesa 2026 – https://www.difesa.it/ia-e-difesa-2026/90197.html

[15]: Si dell’Italia al progetto del centro europeo sull’AI: