Le fake news stringono un nuovo e più forte abbraccio mortale con la tecnologia deep fake (intelligenza artificiale). Da ultimo, nella guerra in Ucraina, messe in rete dal governo russo.

E se non sono proprio fake news, certo i deep fake sono armi della propaganda, una qualche alterazione della realtà di cui i destinatari possono non essere del tutto al corrente. Come avvenuto per le elezioni presidenziali in Corea del Sud.

Indice degli argomenti

Deep fake della guerra

Ultimo caso un video falso e pesantemente manipolato che ritrae il presidente ucraino Volodymyr Zelenskyy è circolato sui social media ed è stato messo su un sito di notizie ucraino da hacker mercoledì prima di essere sfatato e rimosso. Adesso rimosso anche dai social network. Il video, che mostra un rendering del presidente ucraino che sembra dire ai suoi soldati di deporre le armi e abbandonare la lotta contro la Russia. Il deepfake – secondo l’Ucraina di probabile fonte russa – è per fortuna visibilmente falso per problemi audio.

A deepfake of Ukrainian President Volodymyr Zelensky calling on his soldiers to lay down their weapons was reportedly uploaded to a hacked Ukrainian news website today, per @Shayan86 pic.twitter.com/tXLrYECGY4

— Mikael Thalen (@MikaelThalen) March 16, 2022

Ad esempio, a messaggi diffusi da media statali russi che davano il presidente ucraino Zelensky in fuga dal paese ha risposto puntualmente lo stesso Zelensky con messaggi diffusi in inglese, ucraino e russo per confermare la sua presenza a Kiev.

Le conseguenze di questi deepfake non sono soltanto quelle della disinformazione ma più complessivamente l’indebolimento della verità, secondo molti ricercatori. “Inquinano l’ecosistema dell’informazione e gettano un’ombra su tutti i contenuti, che stanno già affrontando la complessa nebbia della guerra”, ha detto Sam Gregory, del gruppo per i diritti umani Witness. “La prossima volta che il presidente va in televisione, alcune persone potrebbero pensare: ‘Aspetta un attimo – è reale?'”.

La morte della verità: i danni della guerra su informazione e democrazia

E questo vale ora per il presidente ucraino; in futuro per altri presidenti.

In generale, il governo ucraino ha trattato il campo di battaglia dell’informazione come una vera linea del fronte, gli alti funzionari hanno incessantemente diffuso le proprie informazioni sui social media, fornito aggiornamenti regolari, represso le illazioni e smentito tutte le false affermazioni russe prima che si potessero diffondere velocemente.

E così, tra un messaggio e la sua smentita, sui social network si combatte una guerra di informazione e disinformazione che è al centro dell’attenzione dei servizi di intelligence dei due paesi in lotta ma anche degli altri paesi interessati ad evitare che il conflitto si propaghi su scala mondiale.

È una guerra ibrida combattuta in parte sul campo ed in parte sui social con l’uso più avanzato dell’intelligenza artificiale per creare deep fake uno dietro l’altro, per fare pressione psicologica, seminare panico e confusione prima di sferrare il suo attacco, su cui la Russia ha una consolidata esperienza.

Se da un lato il governo russo ha messo al bando i social network di origine americana o occidentale, dall’atro può contare sul sistema di messaggistica crittografato Telegram che ha dozzine di canali dedicati al conflitto in corso che raccontano di un esercito russo che non sta combattendo contro il popolo e l’esercito ucraino, ma contro i battaglioni nazisti e i mercenari stranieri.

Il popolo ucraino ed il suo governo privilegiano social come Twitter per raccontare la verità e smentire i messaggi dei russi ed è incredibile osservare l’evoluzione della moderna guerra dell’informazione in tempo reale attraverso l’analisi dei social.

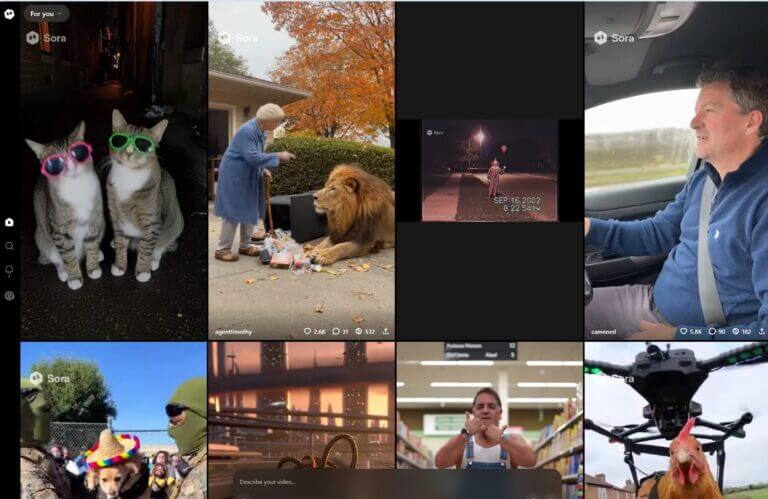

Se l’intelligenza artificiale scende in politica

Passando a un tema più pacifico sul tipo di uso che si può fare dei social per influenzare l’opinione pubblica, ci sono esempi di come l’abbinamento ad una intelligenza artificiale esterna al social network stesso, abbia permesso al candidato alla presidenza per la Corea del Sud, Yoon Suk-yeol, di creare il proprio avatar guidato dall’intelligenza artificiale e che si presenta alle interviste con “I am AI Yoon Suk-yeol“: “sono la versione Artifical intelligence di Yoon Suk-yeol” che suona, guarda e gesticola in modo molto simile all’uomo politico nella vita reale anche se con un umorismo molto più malizioso.

Mr. Yoon è ricorso all’intelligenza artificiale perché nuovo alla politica e desiderava un modo efficiente per raggiungere il suo elettorato fatto di giovani elettori, cercava un’immagine pubblica più morbida ed aveva solo tre settimane per fare ufficialmente la campagna elettorale, ovvero voleva mostrare agli elettori il suo lato umano, non l’immagine severa che appare in televisione.

E lo ha fatto utilizzando rilasciando sui social network più di 80 clip del proprio avatar, pubblicate giornalmente ottenendo più di 80.000 commenti da quando ha debuttato a gennaio. In sostanza gli elettori pongono domande, i membri dello staff della campagna elettorale scelgono le domande a cui rispondere e scrivono una sceneggiatura per l’avatar.

AI Yoon risponde ad argomenti come i lanci di missili nordcoreani o notizie false con la stessa disinvoltura con cui approfondisce il gruppo di ragazze K-pop Blackpink o la sua lista della spesa del giorno. Ed il risultato è sorprendente perché non solo l’AI Yoon fa meno confusione nelle risposte del vero Yoon, ma quest’ultimo studia le risposte ed i video pubblicati che ottengono più “like” per adattare il suo linguaggio a quello del suo avatar.

Poco dopo anche il concorrente di mr. Yoon, il dott. Lee Jae-myung, ha creato il suo avatar dando un taglio ed un profilo diverso da quello di AI Yoon ed ha aperto sui social una campagna elettorale parallela tra i veri candidati ed i loro avatar, puntando ad un target di candidati e di età ben diversa da quello di mr. Yoon.

Così come nel conflitto tra Russia ed Ucraina, anche qui l’opinione pubblica ha iniziato a formare il proprio pensiero guardando e riguardando quello che gli avatar facevano al punto tale da confondere i veri candidati con i loro twin digitali. Perché con il tempo gli uni si sono uniformati agli altri.

Il confine tra disinformazione e propaganda si confonde così nelle menti dei destinatari. E l’effetto del messaggio è ciò che davvero conta nella comunicazione.

In altri momenti questi twin digitali si sarebbero detti dei veri deep fake in quanto generavano video ed immagini di persone vere ma per affermare o fargli fare cose false, non per questo diventando più interessanti dei propri originali. Anche perché in questi casi il gemello digitale è gestito dallo staff della campagna elettorale con la volontà di esaltare il volto umano ed i lati positivi ma anche nascondere i difetti ed i lati negativi dei candidati. E c’è anche chi dichiara che voterà per mr. Yoon in quanto segue la sua versione digitale che è più simpatica e riconoscibile mentre gli sembra di parlare con qualcuno della sua stessa età.

Questi due esempi di uso dei social, di un uso spinto dell’intelligenza artificiale e di una sapiente regia con un obiettivo ben preciso, dimostrano come da ora in poi ogni tipo di competizione che abbia come target o audience privilegiata una community, si debba combattere sul campo quanto sui social facendo attenzione a non confondere il vero da quello che ci vogliono far apparire come vero, tenendo presente che ci troveremo di fronte non ad una falsa notizia, ma alla versione più sofisticata ed edulcorata di quella che è la verità.

Conclusioni

Il tema vero rimane sempre quello etico legato all’utilizzo di queste tecnologie, si possono usare per fini di bene ma anche per fini criminali, con l’ulteriore complicazione che chi le usa è anche il titolare della propria immagine, del proprio avatar e non qualcun altro intento a creare deep fake. Ciò complica notevolmente la possibilità di censurare o limitare alcuni contenuti, spinge in avanti il confine tra il lecito e l’illecito spostandolo verso il plagio o la parziale rappresentanza di sé stessi che può indurre gli altri in un errore di giudizio. Il tutto alla velocità virale dei social.