Le “linee guida di tipo etico sull’intelligenza artificiale” presentate dalla Commissione europea delineano gli elementi per la creazione di una intelligenza artificiale “affidabile” (Trustworthy AI), con la convinzione che la diffusione della tecnologia potrà avvenire solo sulla base, appunto, della affidabilità.

Nel documento, ancora in bozza, pubblicato il 18 dicembre 2018 e in fase di consultazione pubblica sono stati definiti i principi, i requisiti e i metodi tecnici e non tecnici per creare sistemi di intelligenza artificiale fidati e valutarne l’attendibilità. Un lavoro encomiabile, che mette l’etica al centro dello sviluppo dei sistemi di AI, ma che parte da un assunto decisamente contraddittorio, e cioè: “i benefici dell’AI superano i suoi rischi”.

Tale affermazione, non comprovata, è tra l’altro smentita nello stesso documento della Ue e non potrebbe essere altrimenti viste le incognite celate, ad esempio, nei software AI che consentono il riconoscimento facciale, in quelli che fingono con successo di essere umani, come ad esempio gli assistenti vocali, negli algoritmi di profilazione con finalità di scoring, nei sistemi “laws” (i robot killer).

Di seguito una disamina del documento e un’analisi delle sue criticità.

Indice degli argomenti

Intelligenza artificiale, l’approccio “umano-centrico” della Ue

Nell’aprile del 2018 la Commissione Europea ha istituito un gruppo di studio sull’intelligenza artificiale, composto da 52 esperti provenienti dal mondo accademico, imprenditoriale e della società civile (AI HLEG), e lo ha incaricato di redigere due documenti: un primo documento contenente “linee guida di tipo etico sull’intelligenza artificiale” e un secondo documento di “raccomandazioni politiche e di investimento”.

Il primo documento si presenta con un testo chiaro, accessibile, completo e pratico, che si distingue decisamente dai contributi elaborati in materia da Stati Uniti e Cina, sia per approccio che per contenuti. Contrariamente ad altri documenti che trattano di etica, le linee guida non mirano a fornire un elenco di valori e principi astratti e/o generali per l’intelligenza artificiale, ma, al contrario, offrono indicazioni concrete sull’implementazione e sull’operatività dei sistemi stessi, includendo anche una checklist adatta a verificare sin dalla progettazione (“by design”) l’aderenza alle raccomandazioni etiche della Commissione Europea.

Il documento è senza dubbio innovativo per contenuti e modalità di formulazione, si rivolge a tutti coloro che sviluppano, implementano o utilizzano l’intelligenza artificiale, ed è destinato a essere aggiornato periodicamente nel tempo man mano che la tecnologia e le conoscenze evolvono.

Con questo contributo che, come vedremo, pone al centro del dibattito sull’intelligenza artificiale l’etica e la fiducia, l’Unione Europea mira a definire il “gold standard” per l’AI su scala globale e a divenire leader mondiale, così come lo è divenuta nel settore della riservatezza dei dati, ove ha imposto a tutte le società che operano in Europa o trattano dati di cittadini europei di conformarsi al Regolamento Generale sulla Protezione dei Dati (GDPR).

Tuttavia, è bene precisare che non si tratta di un documento giuridicamente vincolante e, pertanto, la volontà di aderirvi spetterà ai singoli destinatari.

La concezione “umano-centrica” muove dalla convinzione che quali che siano i benefici che l’intelligenza artificiale può apportare all’umanità, nulla può giustificare che si mettano a rischio i valori fondanti delle nostre società e la tutela delle libertà e dei diritti (emersa già precedentemente, nel 2017, nei rapporti del CNIL e dell’ICO sui possibili rischi connessi all’impiego di intelligenza artificiale, con particolare riguardo alla tutela dei dati personali). Seguendo questa concezione anche la Commissione Europea promuove, in primo luogo, il rispetto dei diritti, dei principi e dei valori umani, con un’impostazione tipicamente kantiana, secondo la quale lo sviluppo dell’intelligenza artificiale non è fine a sé stessa, ma piuttosto un mezzo per aumentare il benessere individuale e sociale.

Trustworthy AI, l’Intelligenza artificiale affidabile

È in questo contesto che si sviluppa la nozione fondamentale di Trustworthy AI (Intelligenza Artificiale affidabile). Tale concetto deve essere inteso secondo una duplice accezione: da una parte come “necessità di sistemi di intelligenza artificiale affidabili”, dall’altra come “conseguente affidamento generato negli utenti”: quanto più l’intelligenza artificiale sarà affidabile, tanto più velocemente gli utenti ne comprenderanno appieno i benefici e ne consentiranno la diffusione. In pratica gli esseri umani saranno in grado di cogliere con fiducia e pienamente i benefici dell’intelligenza artificiale soltanto se riusciranno a fidarsi della tecnologia.

Gli elementi alla base di una AI affidabile

Le linee guida delineano due elementi per la creazione di un’intelligenza artificiale affidabile:

- Deve assicurare uno “scopo etico”

- Deve essere tecnicamente solida e affidabile poiché, anche con buone intenzioni, la mancanza della padronanza tecnologica può causare danni non intenzionali.

Lo scopo etico – sempre in ottica umano-centrica – viene garantito mediante il rispetto dei diritti fondamentali, della normativa vigente e dei principi e valori fondamentali della società.

Alla base si colloca il rapporto tra diritti, principi e valori. I diritti forniscono il fondamento per la formulazione di principi etici che, per essere sostenuti, hanno bisogno di valori. Diritti, principi e valori dovranno poi essere tradotti in requisiti per lo sviluppo di sistemi di intelligenza artificiale.

I 5 principi alla base dell’AI

Oltre all’indicazione dei diritti fondamentali già presenti nella Carta dei Diritti Fondamentali dell’Ue (rispetto della dignità umana, libertà dell’individuo, rispetto della democrazia, giustizia e stato di diritto, uguaglianza, non discriminazione e solidarietà), vi sono poi cinque principi individuati dalla Commissione Europea:

- Beneficenza (definita come “fare del bene”), secondo cui i sistemi di intelligenza artificiale dovrebbero essere progettati e sviluppati per migliorare il benessere individuale e collettivo;

- Non-maleficenza (definita come “non nuocere”), secondo cui i sistemi di intelligenza artificiale non dovrebbero danneggiare gli esseri umani;

- Autonomia (definita come “rispetto dell’autodeterminazione e scelta delle persone”), secondo cui la libertà e l’autodeterminazione degli esseri umani non potrà mai essere subordinata al controllo dei sistemi di intelligenza artificiale;

- Giustizia (definita come “essere equo”), secondo cui i sistemi di intelligenza artificiale devono essere improntati a un sistema di equità, garantendo che individui e gruppi di minoranza mantengano la libertà da pregiudizi, stigmatizzazione e discriminazione e garantendo idonei risarcimenti in caso di danni;

- Trasparenza (definita come “operare in maniera trasparente”), secondo cui, da un lato i sistemi di intelligenza artificiale e i loro processi decisionali ed evolutivi devono sempre essere controllabili, intellegibili e comprensibili dagli esseri umani, dall’altro ogni essere umano deve sempre essere informato di trovarsi di fronte a un sistema di intelligenza artificiale. La trasparenza costituisce la chiave per costruire e mantenere la fiducia dei cittadini negli sviluppatori di sistemi di intelligenza artificiale e nei sistemi di intelligenza artificiale stessi.

Mentre i primi due principi (beneficenza e non-maleficenza) erano già stati più volte affermati, anche in passato, gli altri principi assumono qui significati diversi e innovativi, specificamente incentrati sull’uso delle nuove tecnologie. E così, il principio di autonomia assume il più profondo significato di “non obbligatorietà” dell’uso di sistemi di intelligenza artificiale, vale a dire il divieto di rendere obbligatorio il ricorso a tali sistemi per lo svolgimento di determinate azioni, compiti o mansioni, al fine di controbilanciare l’imposizione da parte del mercato di standard di prestazione sempre più elevati. Il principio di giustizia, invece, è volto a prevenire il rischio di “pregiudizi artificiali” (bias), che possono portare a decisioni ingiuste. Infatti, se da un lato è vero che i sistemi di intelligenza artificiale non possono avere pregiudizi innati come gli umani, dall’altro è pur sempre vero che, essendo progettati dall’uomo, gli umani possono inserire in essi il loro pregiudizio, anche in modo non intenzionale.

Il principio di trasparenza

Ma la maggiore novità è rappresentata, senz’altro, dal principio di trasparenza che, esigendo il pieno controllo e la comprensibilità umana dei processi di intelligenza artificiale, di fatto esclude la configurabilità (o quantomeno l’affidabilità) della cosiddetta intelligenza artificiale forte (Strong AI). Se non è difficile comprendere la ratio che ha condotto la Commissione a tale conclusione, orientata al mantenimento della supremazia dell’uomo al fine di consentire la formazione della fiducia per la diffusione dell’intelligenza artificiale tra gli utenti, non si comprende facilmente come tale principio possa trovare reali applicazioni pratiche. Già oggi le machine learning, che evolvono apprendendo dalla propria esperienza e in modo non sempre prevedibile, o i più complessi sistemi adattivi che sono in grado di modificare il proprio codice autonomamente per adattarlo alle circostanze esterne, possono apparire in contrasto con questo principio. Inoltre, una simile chiusura potrebbe concretizzare il rischio di una scarsa adesione alle linee guida da parte di tutte le imprese che da anni hanno investito ingenti risorse economiche nello sviluppo di intelligenze artificiali forti, o anche solo intelligenze artificiali con processi decisionali ed evolutivi particolarmente complessi e caratterizzati da sempre maggiore autonomia.

I requisiti per sistemi AI affidabili

Accanto ai diritti e ai principi fondamentali, le Linee Guida individuano anche dieci specifici requisiti che concretamente devono possedere i sistemi di intelligenza artificiale per essere affidabili:

- Responsabilità: secondo cui è necessario costruire un impianto di responsabilità in caso di errori o abusi da cui derivino danni a terzi, prevedendo meccanismi sanzionatori e risarcitori.

- Controllo dei dati: secondo cui è necessario adottare sistemi che permettano il controllo e la pulitura da possibili “pregiudizi” dei dati utilizzati per l’apprendimento delle machine learning, al fine di evitare decisioni inique e discriminatorie. Si suggeriscono inoltre sistemi di registrazione dei dati per i sistemi ad apprendimento continuo, per prevenire possibili manipolazioni.

- Design democratico: secondo cui i sistemi devono essere progettati in modo da consentire a tutti i cittadini di utilizzare i prodotti o i servizi, indipendentemente dalla loro età, dallo stato di disabilità o dallo stato sociale.

- Supervisione umana dell’autonomia AI: secondo cui maggiore è l’autonomia di un’AI, maggiore dovrà essere il controllo umano esercitato su di essa. In particolare, in presenza di sistemi di intelligenza artificiale che suggeriscono o prendono decisioni riguardanti individui o comunità, l’utente dovrà poter deviare da un percorso o da una decisione scelta o raccomandata dal sistema di intelligenza artificiale.

- Non Discriminazione: secondo cui è particolarmente importante evitare il rischio di bias in fase di programmazione, poiché potrebbero verificarsi discriminazioni “implicite” o manipolazioni volontarie.

- Rispetto (e miglioramento) dell’autonomia umana: secondo cui i sistemi di intelligenza artificiale dovrebbe essere progettati anche per proteggere i cittadini nella loro diversità dagli abusi, governativi e privati, resi possibili dalle tecnologie.

- Rispetto della privacy: secondo cui la privacy e la protezione dei dati devono essere garantite in tutte le fasi del ciclo di vita del sistema di intelligenza artificiale. Ciò include tutti i dati forniti dall’utente, ma anche tutte le informazioni generate sull’utente nel corso delle sue interazioni con il sistema di intelligenza artificiale.

- Robustezza: secondo cui gli algoritmi devono essere sicuri, affidabili e sufficientemente robusti da gestire errori o incongruenze durante la fase di progettazione, sviluppo, esecuzione, implementazione e utilizzo del sistema di intelligenza artificiale e per far fronte adeguatamente a esiti errati. I risultati devono, dunque, essere sempre riproducibili in modo indipendente, una condizione che oggi non è possibile soddisfare con la maggior parte dei sistemi. Devono essere precisi nel classificare le informazioni, nel fare previsioni e valutazioni e devono naturalmente essere resistenti agli attacchi informatici.

- Sicurezza: secondo cui i sistemi di intelligenza artificiale devono fare ciò per cui sono stati progettati, senza danneggiare gli utenti (integrità fisica umana), le risorse o l’ambiente. Include la riduzione al minimo delle conseguenze indesiderate e degli errori nel funzionamento del sistema

- Trasparenza: che implica la capacità di descrivere, ispezionare e riprodurre i meccanismi attraverso i quali i sistemi di intelligenza artificiale prendono decisioni e imparano ad adattarsi ai loro ambienti, così come la provenienza e la dinamica dei dati che vengono utilizzati e creati dal sistema. La trasparenza riguarda la riduzione dell’asimmetria informativa, in armonia con il GDPR.

Tali requisiti devono essere incorporati fin dalla progettazione (“by design”). Il Gruppo di esperti prende in considerazione metodi tecnici e non tecnici per garantire l’attuazione di tali requisiti nel sistema di intelligenza artificiale, illustrando soluzioni su come fornire trasparenza e responsabilità e incoraggiando le aziende e i ricercatori a sviluppare la protezione della privacy, la non discriminazione e la supervisione umana nei progetti sin dalla fase iniziale.

Si tratta, quindi, di una guida per garantire uno scopo etico, strutturata in tre parti, attraverso un’escalation che va dall’astratto (i principi) al concreto (i requisiti e i metodi tecnici e non tecnici), per realizzare sistemi di intelligenza artificiale affidabili sia per valutarne l’affidabilità: in definitiva, una guida per l’interazione tra progettazione, implementazione e valutazione.

Le criticità dell’approccio Ue

Una critica che, tuttavia, può essere mossa è che l’intero lavoro parte da una premessa contradditoria e da discutere. Si legge, infatti, già nelle prime righe del documento che “nel complesso, i benefici dell’AI superano i suoi rischi”. Tale assunto, per quanto confortante e rassicurante, non è dimostrato né dimostrabile. Non vi sono studi che abbiano mappato e confrontato i potenziali benefici e rischi dell’AI al fine di stabilire la prevalenza degli uni o degli altri.

Lo stesso documento nel prosieguo smentisce tale premessa:

- Affermando “dobbiamo garantire di seguire la strada che massimizza i benefici dell’intelligenza artificiale minimizzando i suoi rischi”;

- Inserendo tra i requisiti per l’affidabilità il rispetto (e miglioramento) dell’autonomia umana, con l’affermazione che i sistemi di intelligenza artificiale dovrebbero contenere in sé stessi le contromisure per evitare possibili abusi molto gravi da essi derivanti;

- Illustrando le criticità e i rischi che generano preoccupazioni nell’utilizzo dei sistemi di intelligenza artificiale, quali le armi letali autonome, i sistemi di punteggio di massa e i sistemi di intelligenza artificiale nascosti.

Per prima cosa, gli esperti analizzano i possibili rischi derivanti dall’utilizzo di software AI che consentono il riconoscimento facciale: essi potrebbero portare a identificazioni senza consenso da parte degli utenti, che conducono a un monitoraggio e una sorveglianza di massa.

Si è sempre pensato che questo pericolo fosse limitato a Stati altamente centralizzati e autoritari come la Cina, ma ci sono segnali che lasciano presagire che anche in Occidente potrebbe accadere qualcosa di simile. Solo pochi giorni fa, infatti, la polizia britannica ha annunciato che stava testando il riconoscimento facciale sui passanti durante gli acquisti natalizi a Londra allo scopo di individuare alcuni criminali ricercati dalle forze di polizia.

La chiave per evitare abusi da parte di simili sistemi, dovrebbe essere il consenso informato dei cittadini, principio già più volte affermato anche nel GDPR in materia di tutela dei dati personali. Tuttavia, come spesso accade, la pratica non sempre corrisponde alla teoria. Nel caso di Londra, infatti, anche se le riprese sono state chiaramente pubblicizzate e ai passanti veniva data la possibilità di non dare il consenso alle riprese, una simile decisione ingenerava automaticamente sospetti sugli utenti che avessero rifiutato, con la conseguenza che essi sarebbero stati comunque tenuti sotto controllo dal personale di sicurezza.

I rischi dei sistemi AI “nascosti” (assistenti vocali)

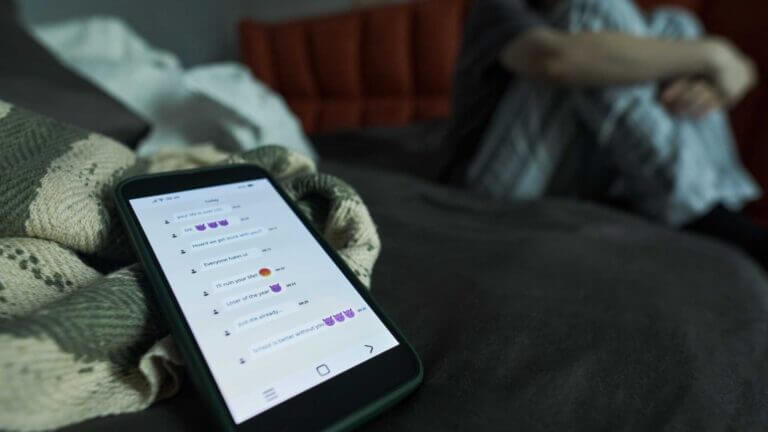

I sistemi di intelligenza artificiale “nascosti” o “celati” come i software e i robot che fingono con successo di essere umani, come ad esempio l’assistente Google che chiama il parrucchiere per un appuntamento, costituiscono un’ulteriore criticità che ha suscitato vivaci discussioni tra gli esperti: è stato individuato il rischio che la loro inclusione nella società umana possa cambiare la nostra percezione degli uomini e dell’umanità. Gli esperti hanno convenuto che “le persone con il potere di controllare l’intelligenza artificiale sono potenzialmente in grado di manipolare gli esseri umani su una scala senza precedenti” e, pertanto, al fine di neutralizzare questo rischio gli utilizzatori umani dovranno sempre essere informati di stare interagendo con una macchina.

Quest’ultima affermazione, se dovesse realmente concretizzarsi, comporterebbe che i rischi supererebbero di gran lunga i benefici. Le persone sono generalmente molto disposte a interagire con i sistemi di intelligenza artificiale in modi che le espongono, sempre più, alla manipolazione (si pensi al caso dei social network e ai recenti scandali di Cambridge Analytica): ciò dimostra che il livello di manipolazione potrà essere aggravato in futuro anche in assenza di sistemi di intelligenza artificiale “nascosti” che fingono di essere umani.

Le incognite dello scoring

Una preoccupazione è rappresentata dall’impiego di algoritmi di profilazione con finalità di scoring, attività non necessariamente negativa (si pensi ai punteggi ottenuti a scuola o per la patente di guida). In tal caso il rischio di abuso si concretizza quando ogni aspetto della vita dei cittadini è sottoposto a valutazioni algoritmiche (come ad esempio nel sistema di credito sociale cinese).

Per evitare il rischio di abusi, gli esperti hanno convenuto che “ogniqualvolta il punteggio dei cittadini venga applicato in un ambito sociale limitato, deve essere disponibile per i cittadini una procedura pienamente trasparente e devono essere fornite loro informazioni sul processo, lo scopo e la metodologia del punteggio, offrendo loro idealmente la possibilità di rinunciare al meccanismo del punteggio”.

Anche in questo caso, la pratica può risultare più complessa della teoria. Infatti, anche qualora le democrazie occidentali non profilino i propri cittadini al pari della Cina, garantendo una procedura trasparente, il rischio che tali informazioni siano comunque utilizzate per un più pregnante ed efficace controllo sulla popolazione è di fatto esistente.

I robot killer

Il gruppo di esperti si sofferma, infine, sulle criticità e i rischi derivanti dall’uso dei Lethal Authonomous Weapon Systems (LAWS) o i robot killer, come sono più ampiamente conosciuti. Un primo tentativo di vietare il loro sviluppo è stato bloccato a settembre da un gruppo di potenze militari che comprendeva Stati Uniti, Russia, Corea del Sud, Israele e Australia.

Secondo gli esperti i LAWS potrebbero portare i benefici di “un’ uccisione selettiva”, ad esempio risparmiando i bambini. Ma la capacità di queste armi “di decidere chi, quando e dove combattere senza l’intervento umano” potrebbe condurre “a una corsa agli armamenti incontrollabile su un livello storicamente senza precedenti, creando contesti militari in cui il controllo umano è quasi interamente abbandonato”.

Tale preoccupazione affermata dai 52 esperti nel documento è una forte indicazione che l’assunto “i benefici dell’AI superano i suoi rischi”, forse, è eccessivo e ampiamente da ridiscutere.